策略产品如何进行效果评估?

本文以“策略产品如何进行效果评估”为讨论对象,认为可以在不同阶段,结合用户反馈、埋点、AB测等方法进行评估。

新人产品经理要切记从“定性思维”转变到“定量思维”。特别是策略产品,要在整个产品生命周期里进行实时的数据监控。

那么一个新策略要怎么进行效果的预测和评估呢,以下是我的一些思考感悟,希望能帮助到大家。

一、策略是如何诞生的

在说策略衡量指标之前我们要先了解策略是如何诞生的?策略具有以下四个要素:

- 待解决问题:即我们进行这个策略的最本质的目的

- 输入:即我们通过考虑不同场景下的不同用户的感受和诉求,得到的一系列影响策略制定的因素

- 计算逻辑:也就是我们如何将这些因素利用起来,并且赋给他们合适的权重和计算规则

- 输出:即问题的具体解决方案

下面可以以一个例子具体说明四要素的具体应用:

feed流智能推荐策略

1. 待解决问题:针对不同的用户提供更为恰当、更感兴趣的信息推荐。

2. 输入:

- 用户特征,可能包括用户的性别、年龄、搜索过的内容、观看的时长、点赞收藏了哪些信息等。

- 信息标签,如信息包括的关键字、当今热度的匹配情况(比如明星结婚离婚总引领信息热点)。

3. 计算逻辑:通过对这个不同输入赋予不同的权重,设置一个多因素的公式最终得到用户喜爱度这种量化的指标。

4. 输出

二、建立衡量指标的意义

通过对四要素的理解,我们可以将建立衡量指标的意义抽象为以下几点:

- 待解决问题:明确“待解决问题”的聚焦和定位是否准确

- 输入:检验输入的多因素是否充足并恰当

- 计算逻辑:检验赋值权重是否合适

- 输出:明确此策略是否有效的解决了问题,以及解决问题的占比

三、建立衡量指标

策略产品有别于和端接触密切的用户产品,其主要目的是提高性能,提升准确率,所以端上的感知和反馈就未必有其他类型产品显著,因此建立更为准确的衡量指标更显得尤为重要。

1. 小数据,代表性的case分析——CPO投诉、用户反馈+case分析

(1)<CPO投诉>

CPO投诉主要是用户对产品体验萌生不满情绪,通过网站或进线客服等方式对产品做出投诉。

CPO投诉的特征是以负面反馈为主,样本量小,重要性高。我们在进行策略优化和迭代时,主要目的是在保证满足用户基本需求的基础上(即能用,好用)增加个性化体验(即好用)。而CPO反映给我们的通常是一些Badcase,即产品连用户基本需求都满足不了,所以是需要我们着重注意的。

优点:对Badcase的定位和分析可以帮助我们迅速定位到策略的不足之处,进而快速止损。

缺点:

- 由于客服同学对策略的了解不够仔细,且用户的表述也一般不会非常明确,会导致用户的实际反馈和case对应困难,大量的投诉实际上并没用于最终的分析;

- 可以和case关联的投诉也可能由于客服同学的不了解无法定位到具体原因导致还需要花费大量的时间进行case的中转;

- 由于样本量小,我们无法准确衡量这类问题的占比。

例子:

比如司机在开网约车的时候发现导航存在绕路现象被乘客举报,打电话给平台投诉,希望平台给予赔偿。可能你认为查一下历史log,如果是我们的问题就给予赔偿,并从中发现优化点就OK了。

而真实的情况可能是这样的:

- 大部分司机无法提供准确的时间和位置,这会导致司机投诉的情况和case难以对应。

- 即使case对应上了,客服同学可能简单的认为导航绕路是路线规划的问题进而中转给规划的pm同学,但实际的问题是由于司机点定位的漂移,所以case浪费了规划同学的人力,还要再进行中转,导致case分析的周期长。

- 等到中转到恰当同学那里log已经过期了,什么都查不到。

- 就算log没过期,我们最后查明了原因给予了司机赔偿,但是司机等待时间长,用户满意度跌倒谷底,认为我们的客服机制拖延时间,没有效率。

改进方向:

- 加强的用户的引导,用户进线时提供更准确和详细的信息,帮助case定位。

- 加强客服培训同学的学习,帮助case可以快速的流转到对应的产品同学名下。

(2)<用户反馈>

用户反馈主要通过调查问卷、用户调研等形式开展。和CPO投诉不同,用户反馈的互动性更强,更能得到不同用户的特征感受,且用户反馈传递的是正面和负面的信息兼而有之,其样本量也比CPO投诉要大。

优点:强互动性,通过和不同群体用户的对话可以帮助发现他们不同的诉求,便于我们完善输入指标和规则,也可以帮助明确我们解决问题的定位是否准确。

缺点:

- 虽然样本量比CPO投诉高,但还是不具有代表性;

- 需要的时间花费、人力成本非常大;

- 有时用户的感知和他们的行为是相悖的,所以输出结果的准确性也不高;

- 另外也会存在和case对应不上的情况。

例子:

我们想衡量一个feed流智能推荐新算法是否好用,于是邀请了小张来做用户调研。

小张的用户画像是一个在互联网公司的软件工程师,平时的爱好是在休息时间看看NBA,小张抱怨feed流每天给他推荐的都是女友喜欢看的吃播,他怀疑是由于女友有时候用他手机看吃播造成的。

这时我们的产品经理可能就认为是历史观看赋的权重太大且粗糙了,要给短时长内的历史观看视频赋予给小的权重,于是回去修修改改了好久。

但实际上可能这个策略的赋权是没有问题的,每天推给小张的也是大量的体育新闻,只是偶尔有一个吃播推送,但是在不喜欢吃播的小张眼里这条推送就显得无比“耀眼”,所以给出了错误的反馈。

改进点:

- 在进行调查问卷设计时要尽量使用明确的问题和答案,减少用户主观感性上带来的偏差。

- 有意识的建立“用户反馈群”、“爱好者群”这类人群集合,引导他们在使用中进行有意识的观察,但是这种有意识以及特定群体可能又会使得样本的随机性被破坏,所以对此也要进行恰当的权衡。

(3)<Case分析>

case分析实际上是这上述两者发挥作用的最重要的一部分,也是在策略迭代中要不断进行的一个工作,下面举个例子来说明case分析是如何帮助我们进行指标的衡量的

例子:

还是用feed流智能推荐距举例:

48岁的赵叔叔抱怨每天给她推送的都是哪个明星又结婚了离婚了,这是他的爱人黄阿姨喜欢看的东西,但是他根本不知道这些明星是谁,他只是想看看新闻。

我们通过case分析,发现给信息标签中热度匹配情况赋予的值太高了,但是贸然的赋值低也不太好,于是我们考虑到通过人群标签来指导热度匹配情况的赋值,比如年轻人可能更喜欢明星八卦,就可以尽量赋值高些。年龄稍微大些的人呢,可能对此不太感兴趣,就可以赋值低一点。女生可能更喜欢女团,就可以赋值高一些;男生更喜欢篮球,就可以尽量将体育类赋值高些。

通过上述例子我们可以看出,case分析会帮助我们更为准确的分析多因素,并且将其粒度变得更细,面对不同场景下不同用户赋予更为准确的权重,得到更为准确的计算规则。

2. 大数据,统计性的指标分析——埋点统计、AB测试+阶段性放量

(1)<埋点统计>

埋点就是指在开发过程中,RD小哥哥写在代码里的一些“感知器”,我们会给埋点设置一定的触发时机(比如命中了XXX策略,点击了XXX按钮),和搜集数据属性(比如用户id,触发时间等)。于是这些埋点便可以在我们设定的时机将我们希望其上传过来的数据以log的形式源源不断的发送过来。

在我们进行指标选取时首先要明确我们需求解决的问题,优化的点是哪?这个问题回答的越小而具体,指标就会建立的越明确,以下是两个例子:

例子一:

背景:车辆在行驶过程中偏离规划道路这一情况被称为“偏航”,假设我们这个新策略是为了让导航更快的感知到车辆的偏航。

指标:我们可以将指标量化为【偏航识别距离】和【偏航识别时间】。

触发/结束时机:这个结果是瞬时的,需要在每次偏航时提供给我(即进行一次记录)。

例子二:

背景:我们设定了新策略是让视频智能推荐变得更准确。

指标:我们可以将指标量化为【用户点击首页视频的次数】和【用户点击视频后观看的时长】等等。

触发/结束时机:这是一个持续性的事件我期望设置的事件开始是【用户首次进入app】和【用户返回主页】,那么事件的结束是【用户退出app】和【用户切入后台】和【用户在搜索栏进行搜索】和【用户进行手动刷新】等。

所以总结来看如何设置一个埋点只需要回答两个问题,即我想在什么时间获取到信息?以及我想获取的信息是什么?

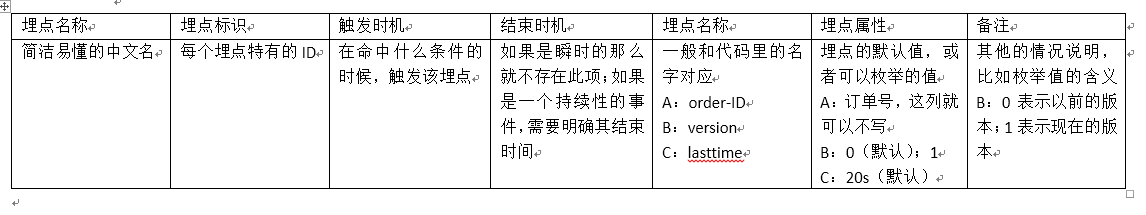

埋点的设置可以参考以下表格:

我们可以总结埋点的优缺点。

优点:不必担心样本量和准确性,数据是不会骗人的;便于分析case的占比情况。

缺点:

- 开发成本比较大

- 大量的数据才有统计意义,但是在新策略上线阶段,直接给予很高的流量是有很大风险的,所以其应用时段有限制。

- 和用户的互动性差,仅通过埋点难以定位到用户的具体诉求和他们的感受。

改进点:埋点的主要问题是和端的互动性差,可以将埋点分析和用户调查、case分析等结合起来。

(2)<AB测试>

AB是PM在进行策略效果衡量时一种常用的手段,简单来说就是为同一个目标制定两种解决方案(一般为新策略和旧策略),通过用户的使用情况,数据呈现来分析哪个策略是更优的。

一般可以选择几个实验城市进行AB测的放量,即保证了样本量是足以消除掉个体差异和其他因素干扰的,也可以有效控制流量保证风险的可控性。

AB实验示例:

1. 城市选择:一般选择特征和该策略待优化点一致的无其他实验的城市。

2. 分组依据:为了保证流量的独立性,即A组和B组没有交集,一般选用手机倒数第二位来进行AB分组。

3. 时间选择:且为了避免假期或者不同工作日影响,一般AA阶段和AB阶段都要在一周及以上,避开节假日(春节、端午等,不指周六日)。

- AA阶段:即两样本策略完全相同,通过数据对比和显著性分析来验证其随机性。

- AB阶段:即两样本只有实验策略不同,通过数据对比(可从平均值、相对差值、绝对差值几个维度)和显著性分析(即p值<0.05认为显著)来衡量收益情况。

优点:AB测可以很好的解决样本量的问题,通过数据的对比和数据显著性检验来准确衡量策略的收益。

缺点:

- 无法做到完全随机;

- 实验的周期长,AB实验两阶段完成至少需要两周;

- 新策略可能具有尝鲜效应,导致收益不能准确衡量(这一点在CPO投诉、用户反馈中也有体现)。

改进点:可以利用<分片AB实验>的方式加强样本的随机性。即一定时间内实验城市所有流量都用A策略,经过一段时间后翻转所有流量都用B策略,经过不断的翻转来实现AB的切换,在进行数据统计的时候不是根据AB组进行,而是根据AB事件进行。

(3)<阶段性放量>

阶段性放量实际上并不是一种策略收益衡量方式,而是为了保证策略上线稳定性而进行的一种灰度放量模式。在进行阶段性放量时pm要时时进行埋点数据的监控,并依次进行放量计划的调整或者叫停。

衡量指标在不同阶段的应用

总的来看策略性产品效果衡量是以【埋点统计】为主,【用户主观感受】为辅,因为其主要面向提升产品性能,提高准确性,虽说最本质的目的是为了提升用户体验,但是端上感知并不一定明显,所以如果过于依赖用户主观感受的话可能会导致结果不准确。

而埋点统计是大数据下的产物,也就是说只有在需求上线且样本量多的情况才能反映出其准确性,有效的消除掉个体的影响和其他因素的干扰,但是新需求上来就全量或者大面积放量肯定是不行的,所以在不同的阶段下进行的效果衡量和评估是不同的。

阶段一:未上线——通过离线数据集进行的埋点统计

以我实习过的偏航为例,在上线一个新策略之前一般RD会在离线数据集上进行新策略的“试用”,即通过一些历史轨迹进行回放观察其在新策略上的表现,如果这个表现是正向且符合预期的,一般才会正式上线。

阶段二:小流量上线——AB测进行数据比较+用户反馈

离线阶段认为此策略可以上线后,一般还是会保守的先上线一部分用户(一般是用户反馈体验群、产品组里的用户)和实验城市,通过搜集他们的主观感受和实验城市的AB组数据衡量一定流量下新策略的表现并进行下一步放量计划的制定。

阶段三:随机放量——埋点数据为主,用户反馈为辅

在此阶段一般会制定相关的放量计划,这时的流量一般就比较大了,用户的埋点数据也更为真实可信,所以以埋点数据为主,进行实施的监控,直到全量。

本文由 @Crystal 原创发布于人人都是产品经理。未经许可,禁止转载

题图来自 Unplash,基于 CC0 协议

起点课堂会员权益

起点课堂会员权益

不好意思请问一下,我对阶段一的理解是:在后台已有的用户数据内添加新的埋点,再观测这些新增埋点给出的新信息是否符合期望。这个理解是正确的吗?

写的很好,案例举得生动形象,通俗易懂