别被GEO割韭菜了:一个做了25年SEO的人,告诉你AI搜索优化的五大皇帝新衣

GEO正成为2026年最能赚钱的三个字母——对卖服务的人而言。一位做了25年SEO的从业者,用数据拆穿五大“皇帝新衣”:平台碎片化、追踪幻觉、数据黑洞……结论很直接:先把SEO基础做扎实,76.1%的AI引用URL本就出现在Google前10名。

GEO 正在成为 2026 年最能赚钱的三个字母——对卖 GEO 服务的人而言。

Generative Engine Optimisation,生成式引擎优化。或者你更喜欢叫它 AEO,LLM-SEO,AI 搜索优化——反正总有一个顾问等着用这个词向你收取月度服务费。

Daniel Foley Carter 做了 25 年 SEO。他见过 PageRank 崇拜、链接建设大审判、”内容为王”的反复加冕。他看着一波又一波恐慌来了又去,也看着那些宣告”旧 SEO 已死”的人,最终悄悄把旧方法继续用下去。

现在轮到了 GEO。他用一篇长文,用数据和亲历经验,把这场热潮里最需要被追问的五个问题,逐一摆上台面。

01 身份危机

SEO 行业的身份焦虑,像一个永远滚动的循环。从”内容为王”到 RankBrain,从 E-E-A-T 到现在的 GEO,每隔几年就有一套新术语出来,配上新的顾问、新的课程、新的恐慌。

身份通货膨胀:从”SEO专家”一路演化到”SEO/AEO/AIO/GEO专家”——越加越多,头衔越来越长

Foley Carter 自己也中过招。他曾经在 Google 搜索”SEO Audits”,发现自己的精确匹配域名 seo-audits.io 依然稳居第一——那是在 Matt Cutts 宣告”精确匹配域名时代终结”十多年之后。

Google 搜索”seo audits”,精确匹配域名 seo-audits.io 排名第一——十年前宣告消亡的策略,至今依然有效

Matt Cutts 2012年那条著名推文:精确匹配域名将被降权——但现实并未如他所言

Foley Carter 把这个现象总结得非常精准:行业每隔几年就需要一次”重新命名”。不是因为底层发生了颠覆性的变化,而是因为新词可以卖出新的培训课程、新的工具订阅、新的月度服务合同。这个循环本身并不新鲜。

他亲眼见证了 Google 的 Bigdaddy 更新,见证了”精确匹配域名之死”的反复宣告与反复被打脸,见证了 RankBrain 应该对我们做什么却始终模糊不清。每一次,行业里都有人站出来说”一切都变了,以前那套不管用了”——然后那套继续在用。

他的结论很简单:每一次行业恐慌,最终都会归于平静。问题不是 GEO 是否存在,而是它是否值得你现在就单独花一笔预算去”优化”,以及这笔预算的 ROI 是否经得起审查。

02 平台碎片化

传统 SEO 的底层逻辑是:一个平台,一套规则。Google 占主导,工具链、方法论、考核指标全部围绕这一个目标收敛。付费广告或自然排名,二选一,或者两者兼顾——规则清晰,可以建立可重复的执行框架。

当前主要 AI 搜索平台:Gemini、Perplexity、Copilot、ChatGPT——四套截然不同的训练数据、检索逻辑与引用行为

GEO 没有这个奢侈条件。数据说话:ChatGPT 目前占据 AI 聊天机器人市场约 68% 的份额,但这个数字在一年前还是 86.7%,正在快速下滑。同期,Google Gemini 从 5.7% 飙升至 21.5%。与此同时,Perplexity 走自己的路,Grok 接入 X 的实时数据流,Claude 有完全不同的训练集和检索逻辑。

这还只是主要玩家。研究显示,89% 的引用结果在 ChatGPT 和 Perplexity 之间存在差异——换句话说,同一个问题,两个平台给出的参考来源几乎完全不同。

当一家 GEO 机构告诉你”我们要优化你的 AI 可见度”,先问他们:是哪个 AI?因为你面对的不是一个搜索引擎,而是五个运行方式截然不同的黑箱。

更复杂的是,即便针对同一个平台,你还要面对模型版本更迭(GPT-4o 之后是 5.2、5.3,Sonnet 之后是 Opus)、个性化记忆的干扰、用户所在地理位置的影响,以及生成内容本身的非线性与不一致性。这四个变量叠加在一起,让”统一 AI 可见度”这个概念在技术上就已经站不住脚。

“你不是在追踪一个搜索引擎。GEO 在尝试同时为五个不同算法、五套数据源、五种’个性’的平台做优化。”——Daniel Foley Carter

03 追踪幻觉

传统 SEO 的排名追踪建立在一个前提之上:关键词是可重复的。”SEO 顾问伦敦”这个词,今天有人搜,明天还有人搜,你可以追踪排名变化,形成有意义的时间序列数据。

AI 用户不这样提问。他们会输入:”我经营一家面向中型美国企业的 B2B SaaS 公司,之前试过内容营销,现在应该找哪个 SEO 顾问?”——告诉我,你打算把这句话放进哪个追踪工具里?同样的问题,不同用户表达方式各异,没有两个人会字字相同。每一条提示词,都是一个独一无二的查询事件。

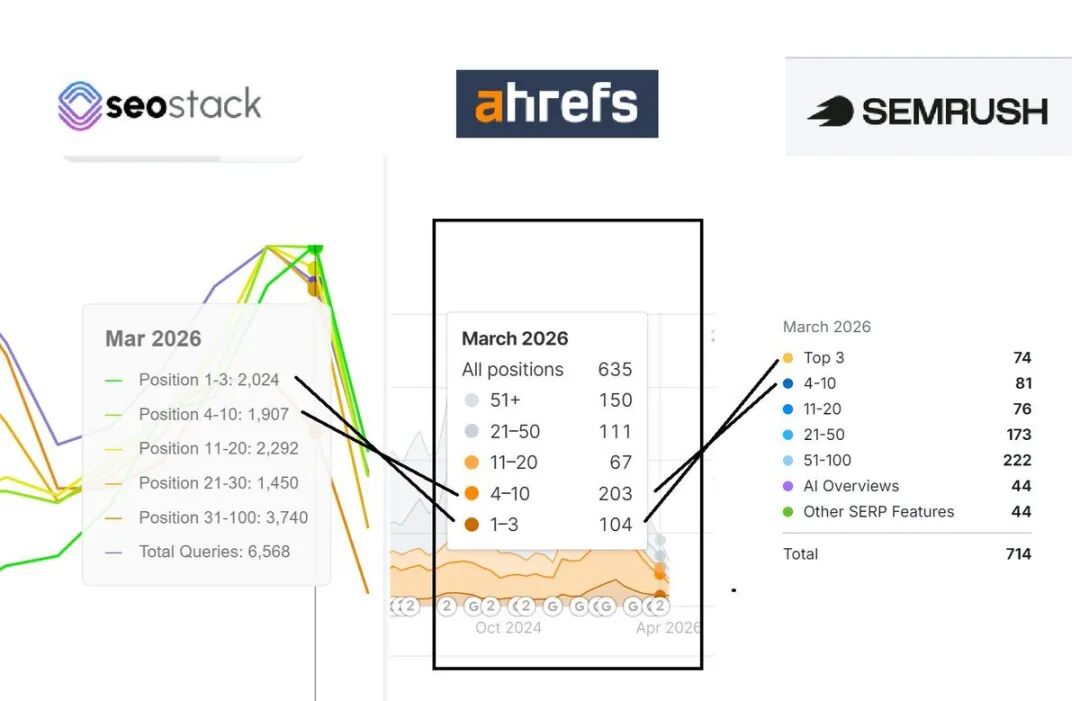

同一网站,SEO Stack 识别出 6,568 个关键词,Ahrefs 只识别到 635 个,SEMrush 仅识别到 714 个——最大的工具也只是在捕捞部分数据

即使在传统 Google 搜索里,每天约有 15% 的查询是从未出现过的全新词组,而那些词平均只有 3 到 4 个单词。把这个长度乘以五倍或十倍,变成一句对话式的 AI 提示词,组合爆炸的规模让”追踪覆盖率”这个概念几乎失去意义。

Ahrefs 和 SEMrush 是全球最大的 SEO 数据持有者(Google Search Console 除外),但即便如此,它们也遗漏了 70% 到 80% 的实际搜索词。对于 AI 提示词的追踪,这个缺口只会更大,不会更小。

你可能要追问 GEO 机构的另一个问题:除了 SEO,你具体在做哪些 GEO 工作?如何衡量绩效?如何应对不同追踪平台之间天差地别的”可见度”评分?还有一个没有人想正视的问题:GEO 工具的提示词搜索量数据,究竟从哪里来的?Google 给了我们 Search Console。ChatGPT、Gemini、Grok、Perplexity、Claude——这些平台目前没有一个提供类似的关键词数据接口。GEO 追踪工具在尝试为一个没有公开数据的市场构建洞察,其方法论的可靠性从根基处就存疑。

GEO 追踪工具在尝试从无限宇宙中采样。它们抓取一把提示词,检查你的品牌有没有被提及,然后把这个叫做”可见度”。充其量是方法论上有趣的尝试,最坏的情况则是用一个意义存疑的数字收取真实的服务费用。

04 唯一性陷阱

提示词越长,重复率越低。这不是观点,是基本概率。

“SEO 顾问”——全球每个月有数万人搜这个词,你可以建立真实的市场模型。”正在经营 B2B SaaS 平台、目标客群是美国中型企业、已经试过内容营销的公司应该找什么样的 SEO 顾问”——今年可能只有三个人输入这句话,其中两个还是在写关于 GEO 的博客文章。

Google Search Console 数据:关键词”seo consultant”每月带来 2,397 次点击和超过 38 万次曝光——传统关键词追踪建立在真实、可重复的搜索量之上

传统 SEO 的绩效框架依赖于关键词搜索量的真实性和可重复性。即便今天你的品牌在某个 40 字 AI 提示词的回答里被完美引用,这条提示词明天被同一个潜在客户再次输入的概率,趋近于零。

SEO 的绩效测量框架建立在关键词体量的真实性与可重复性之上。GEO 的等效体系根本不存在。即便今天你的品牌在某个 40 字 AI 提示词的回答里被完美引用,这条提示词明天被同一个潜在客户再次输入的概率,趋近于零。

基于提示词追踪的 GEO 绩效报告,信噪比将成为任何严肃运营团队的噩梦。这不是工具成熟度的问题,而是底层数学结构决定的困境。

05 数据黑洞

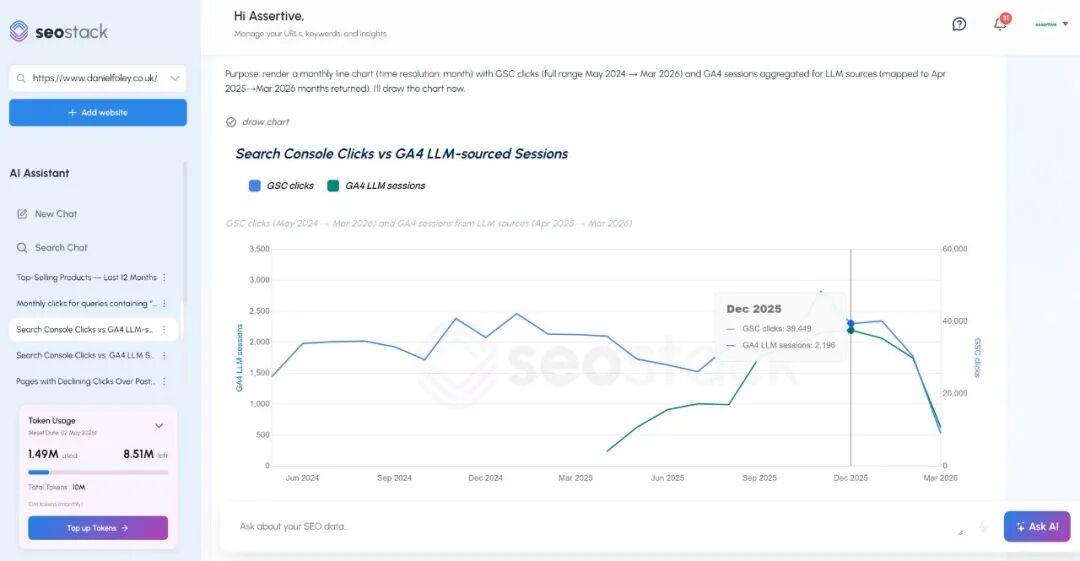

在 SEO 里,我们有 Google Search Console。不完美,但它给你展示曝光、点击、平均排名、点击率。我们有 GA4,有 Ahrefs,有 SEMrush,有像 SEO Stack 这样能把 GSC 数据与 GA4 LLM 来源流量整合对比的工具。我们可以证明发生了什么,可以把流量变化归因到具体的行动。

GEO 可见度追踪工具:danielfoley.co.uk 的 AI 可见度评分为 19/100(低),Mentions: 15,Citations: 60——这个数字意味着什么?没有基准,无从判断

AI 平台什么都不给你。

目前,AI 推荐流量仅占全球网络流量的约 1%,而且即便是这一小部分,也因为大多数 AI 平台不传递一致的 Referer 信息,而难以准确归因。OpenAI 没有提供数据仪表盘,Perplexity 没有类似 Search Console 的入口,Claude 不会寄给你月度绩效报告。

SEO Stack 将 GSC 点击与 LLM 来源会话并排呈现:Dec 2025 时,GSC 点击 39,449 次 vs LLM 会话 2,196 次——比例已经悬殊

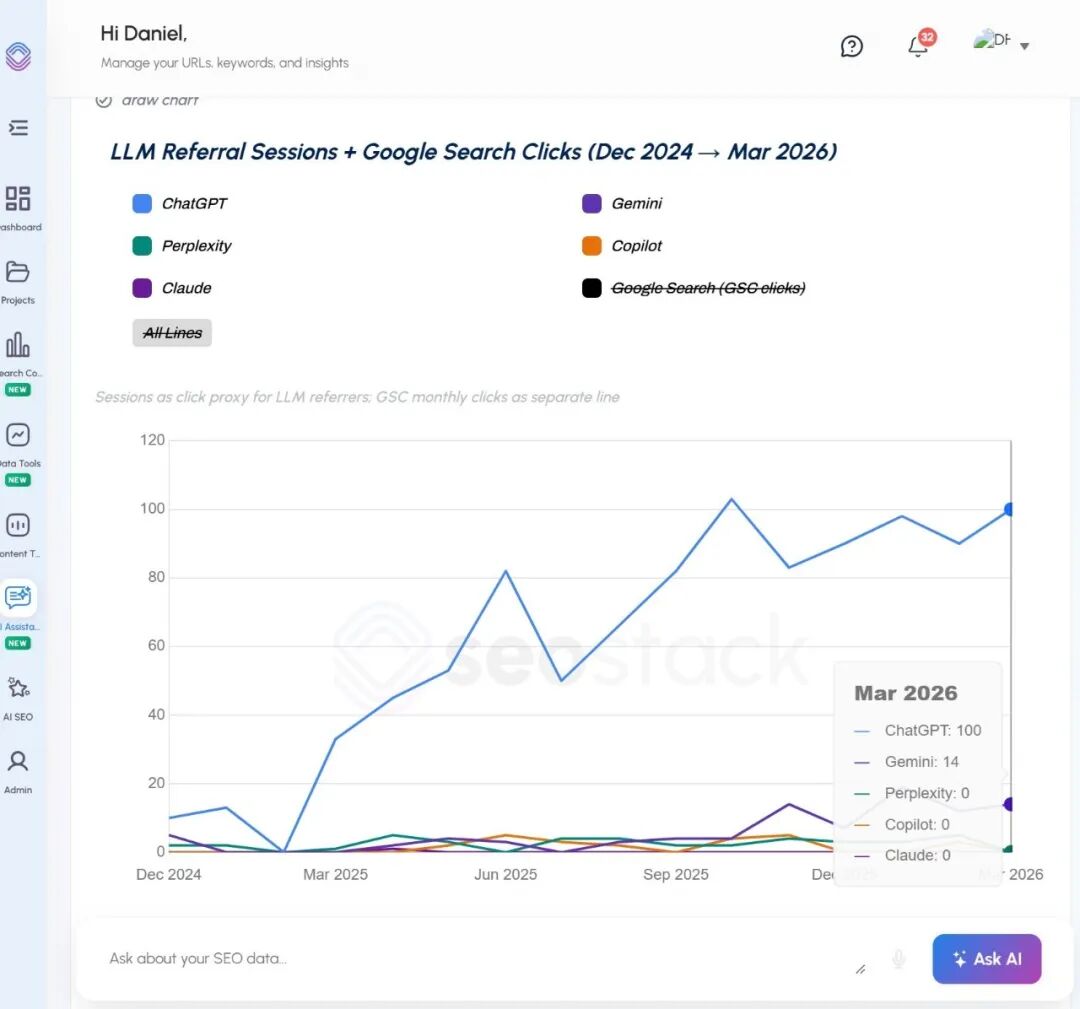

Mar 2026 实际数据:ChatGPT 引流 100 个会话,Gemini 14 个,其余平台为 0——相比之下,Google 搜索带来 17,532 次点击

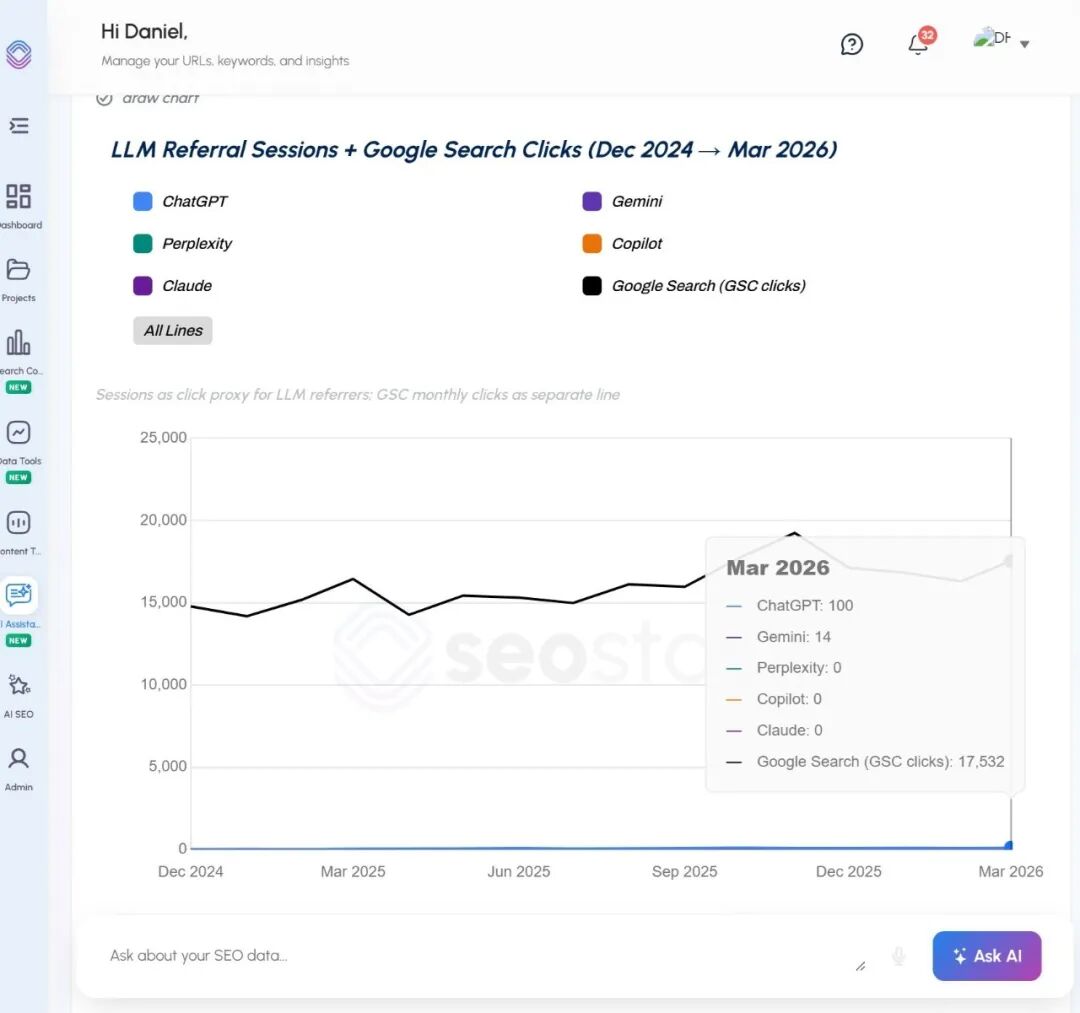

加入 Google 搜索基准线后的全景对比:Google 17,532 次点击 vs 所有 AI 平台合计 114 次会话——规模差距一目了然

这是真实数据,不是理论。Foley Carter 自己网站的 2026 年 3 月数据:Google 搜索带来 17,532 次点击,ChatGPT 带来 100 次会话,Gemini 带来 14 次,其余 AI 平台合计为零。

当一家 GEO 机构声称”我们运行了 500 条提示词,你的品牌被提到了 47 次”,下一个问题应该是:这 47 次提及,换算成多少实际流量、潜在客户和营收?如果答案是”我们还没有办法直接归因”,那你其实是在为一个无法测量结果的服务付款。

没有 OpenAI 数据仪表盘。没有 Perplexity Search Console。你只能靠第三方工具猜测,而这些工具本身也在靠猜测运作。在这种情况下,向客户呈现”AI 可见度提升了 23%”的月度报告,实质上是用一个无法独立校验的数字收取真实的服务费用。这个数据黑洞,是当前 GEO 服务无法绕过的结构性问题。

06 概率机器

搜索引擎具有足够的确定性,可以支撑可靠的排名追踪体系。Google 的算法在变,但在一个给定的时间窗口内,搜索”SEO 顾问”基本上会得到相同的前十名结果。这种稳定性是排名追踪有意义的前提。

LLM 从设计上就不是这样运作的。它们是概率性的。加上 RAG 检索增强、查询扩展、个性化记忆、地理位置差异,以及同一模型不同版本之间的行为分歧——这是一个比 SEO 曾经遇到过的任何问题复杂几个数量级的测量难题。

同一个问题问 ChatGPT 两次,你可能得到两个有不同引用来源的回答。加上记忆功能,响应会因为你之前的对话记录而偏移。加上地理位置,曼彻斯特的用户和旧金山的用户问同一个问题,可能获得完全不同的引用列表。这个现象不是 bug,是 LLM 的核心设计属性——概率采样本就是为了让输出多样化,而非一致化。

可以这样理解:搜索引擎像一台经过精密调校的机器,输入相同,输出虽有波动但大致稳定,所以排名追踪是有意义的工程行为。LLM 更像一位学识渊博、每次表达都有差异的演说家——即便面对相同的问题,他也不会一字不差地重复昨天说过的话。

这不是一个脚注,它从根本上动摇了可扩展、可重复的 GEO 追踪的前提假设。在测量基础设施建立起来之前,任何声称”你的 AI 可见度提升了 X%”的报告,都应该被追问方法论。

07 真实价值

Foley Carter 不是 GEO 的全盘否定者。他只是要求这个行业用证据说话,而不是用恐慌卖课。他愿意承认,GEO 并非一无是处。只是它的真实价值被严重过度包装了。

Ahrefs 研究:在 15,000 条提示词数据集中,仅有 12% 的 AI 引用 URL 出现在 Google 同一查询前 10 名——LLM 确实在从不同的内容池中引用

有几个方面确实值得关注。LLM 的引用来源与 Google 排名的重叠度很低——Ahrefs 的研究显示,80% 的 LLM 引用页面在 Google 前 100 名之外,28.3% 的 ChatGPT 高频引用页面甚至没有任何自然搜索流量。这说明 LLM 在从一个更广泛、不同的内容池中汲取内容,搞清楚这个池子的构成,是一个合理的研究课题。

结构清晰、事实准确、权威性强的内容,在 LLM 引用中确实表现更好。这会推动内容策略从长篇说服式文章向定义式、参考式内容倾斜,更注重明确性与可验证性,而非说服力与情感调动。这是一个真实的战术调整,值得执行。只是不需要为此另外买一份”GEO 服务”。

品牌实体的权威性也确实在 LLM 引用中发挥了不同于传统 SEO 的作用。在训练数据中被更多权威来源提及——维基百科、主流媒体、行业数据库——能直接影响模型是否”知道你存在”。这是一个值得关注的信号,尤其对品牌知名度尚低的公司而言。

但这些都不足以支撑”GEO 是一个独立的、可单独计费的全新学科”这个结论。John Mueller 也说过同样的话:这是 SEO 的进化,不是革命。把本属于内容质量和品牌建设的工作重新包装成 GEO,只是换了一张新的收费账单。

08 数字说话

数字不会说谎。Google 每天处理约 137 亿次搜索。ChatGPT 每天有 10 亿次搜索——令人印象深刻,但仍是 Google 的 7%。全球约 80% 的数字查询发生在 Google 上,ChatGPT 占 17%。而当你把范围缩小到”有商业价值的搜索”——购买决策、本地服务、商业调研——Google 的优势更是数量级上的差距。人们买东西、找服务,习惯上还是走 Google。这种行为惯性不会在一两年内翻转。

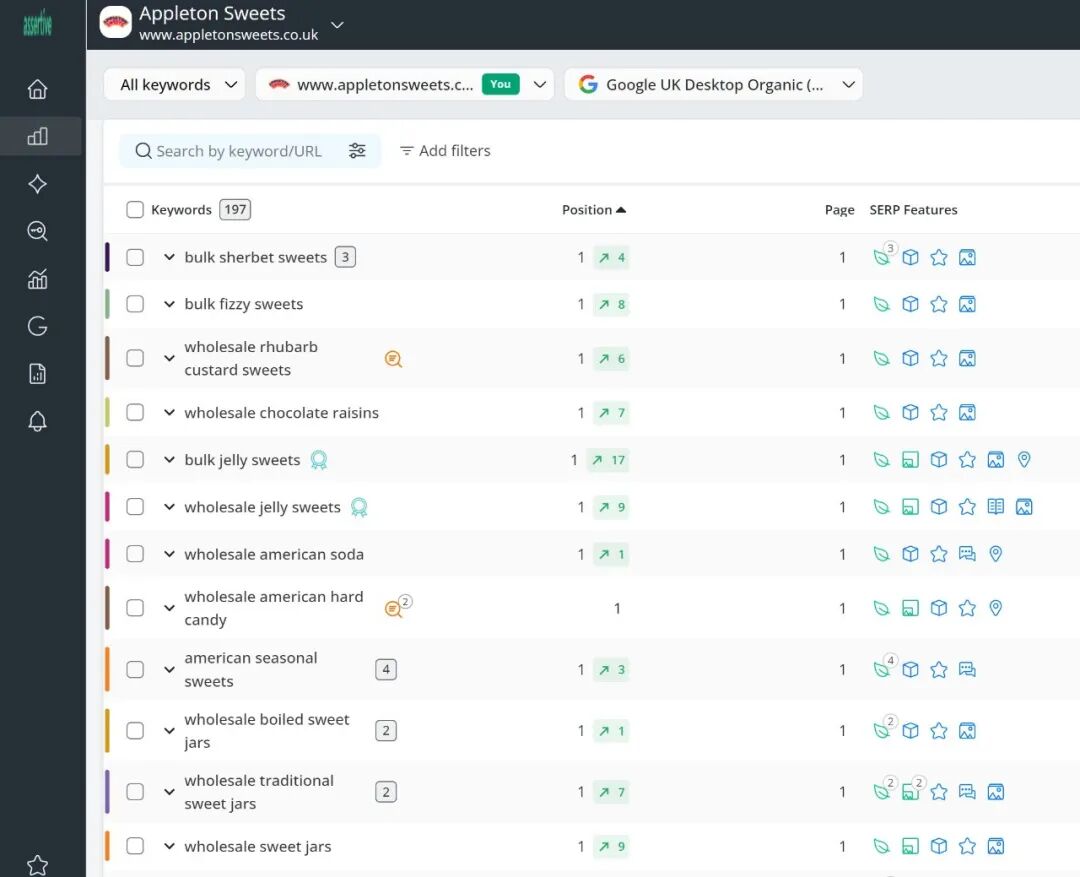

传统 SEO 排名追踪依然有效:Assertive 平台显示,关键词排名数据清晰可查、可追踪、可归因——这是 GEO 工具目前还无法提供的

传统搜索在美国桌面端活动中约占 10%,这个份额在整个 2025 年几乎没有变化。Gartner 预测 2026 年传统搜索量将下滑 25%。即便这个预测成真,Google 依然是规模最大的 AI 搜索平台之一——它的 AI Overviews、Gemini 集成和 AI Mode 本身就是 AI 搜索界面。做好 SEO 并出现在 Google 的 AI 摘要里,往往是同一件事。

数据很清楚:76.1% 出现在 Google AI Overviews 中的 URL,同时也在 Google 自然搜索前 10 名。做好 SEO,GEO 的大部分价值自然随之而来,不需要额外付一份顾问费。

Foley Carter 的建议清晰直接:先把 SEO 基础做扎实。结构化内容、权威性建设、技术健康度、品牌实体在权威来源中的一致性——这些在传统 SEO 里成立的事情,在 GEO 里同样成立。而且因为 76.1% 的 Google AI Overviews 引用 URL 也在 Google 前 10 名中,你把 SEO 做好,就已经在大部分情况下顺带做了 GEO,不需要为两件事分别付钱。

等到 AI 平台开放真实的分析数据,等到行业形成经过验证的测量方法论,等到追踪工具能提供真实可归因的结果——那时候再来认真谈 GEO 作为一个独立实践的意义。现在这个阶段,更像是淘金热早期:卖工具的人比挖到金子的人赚得多。

Google 见过无数次自己的死亡预言。它有一个习惯:在别人为它写悼词的同时,悄悄把 AI 搜索功能内置进来,让”做好 SEO”和”被 AI 引用”变成同一件事。那 137 亿每天在 Google 上搜索的人,并没有消失。

本文由人人都是产品经理作者【深思SenseAI】,微信公众号:【深思SenseAI】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益