AI席卷音乐圈,索尼音乐率先“退出群聊”

自从大模型兴起后,算力和语料就是各家必争之地。而衍生的版权问题悬而未决,一直也是困扰各大公司、国家的难题。而索尼音乐退出大模型的训练,就和这些事儿有关。

5月16日,索尼音乐在官网上发布了一则声明,宣告索尼音乐将退出AI训练,禁止任何企业在尚未取得授权的状态下,以其内容训练AI模型,包括且不限于旋律、歌词、音频录音、视听录音、插图、肖像等。

据BBC消息,索尼音乐集团目前已向约700家AI公司和流媒体平台发出了警告函。在信中表示,索尼音乐认识到人工智能的“巨大潜力和进步”。然而,在人工智能系统的训练、开发或商业化中,未经授权使用索尼音乐的内容,剥夺了其内容使用的控制权和收益。

其中,索尼音乐集团要求每个收件人提供其用于训练人工智能系统的歌曲详细信息,以及如何访问这些歌曲、询问歌曲的副本数量等。

虽然索尼音乐集团并未明确表示向哪 700 家公司发送了这封信,信函的完整版也未公开,但据知情人士透露,当中包括OpenAI、微软、谷歌等多家大企业。

据国外媒体报道,除了人工智能开发者之外,SMG还单独寄信给了苹果公司和Spotify,要求流媒体平台采取最佳措施,保护艺术家和词曲作者,规避未经授权的AI公司的非法训练模型,并要求他们更新服务条款,禁止挖掘和抓取其内容。

简单来说,这封致信是在向大约700家AI公司和流媒体平台警告,要么就承认未经授权发生侵权了,不承认的话,就提供进行人工智能训练的详细信息。

一、索尼音乐率先“退出群聊”

索尼音乐集团之所以这么做,除了贵为三大唱片之一的市场地位,还有日趋规范的法律法规提供了底气。

今年3月,欧盟通过《人工智能法案》,该法案要求通用人工智能模型的提供商公开用于训练这些模型的内容的“足够详细”的摘要。而根据《人工智能法案》从欧盟2019年《版权指令》中引入的一项原则,如果版权所有方选择退出,人工智能开发者必须获得使用的受版权保护材料的授权许可。

尽管该条款当时遭到了业界的反对,美国音乐版权代理协商会(NMPA) 在 2023年向美国版权局提交的一份意见书中表示:“选择退出制度将获取许可的负担转移给用户,从根本上破坏了版权保护。”

据了解,索尼音乐集团也是三大唱片中唯一没有参与此前 YouTube「Dream Track」新功能的公司,但该公司并没有完全回避人工智能。

去年夏天,索尼音乐聘请了首位人工智能执行副总裁Geoff Taylor后,在11月就推出了电子乐队The Orb 和老牌乐队 Pink Floyd的AI项目“Metallic Spheres In Colour”,邀请歌迷通过使用AI工具重新参与创作新专辑的音乐和封面。

去年11月美国参议院举行的人工智能论坛上,索尼音乐美国销售总裁 Dennis Kooker也在演讲中表明了这家大型音乐公司在人工智能和版权法方面的立场。

Dennis Kooker公开讨论了索尼音乐将未经授权的人工智能内容从在线平台上删除而做出的努力,包括该公司已公布的近10,000个单独的删除内容。此外,Dennis Kooker也明确表示,反对谷歌人工智能开发商“使用受版权保护的材料来训练人工智能模型,应该属于版权法的合理使用豁免范围。”

Dennis Kooker认为,即使素材收到版权保护,如果任由AI公司随意使用,那就意味着“某些公司可以在未经许可的情况下侵占创意部门产生的全部价值,并以此为基础建立庞大的业务,而无需向相关创作者支付任何费用。”

可以看出,索尼音乐在人工智能领域的策略,更倾向开发能够增强创造性和保护内容的工具,而不是参与可能涉及较大版权和道德风险的实验。而通过这次对约700家AI公司和流媒体平台的致信,也体现了索尼音乐对于促成版权方、艺术家和AI技术方共赢的局面的决心。

二、AI音乐版权纷争从未停息

近年来,无论是国内还是国外,AI技术在音乐行业的应用早已屡见不鲜。

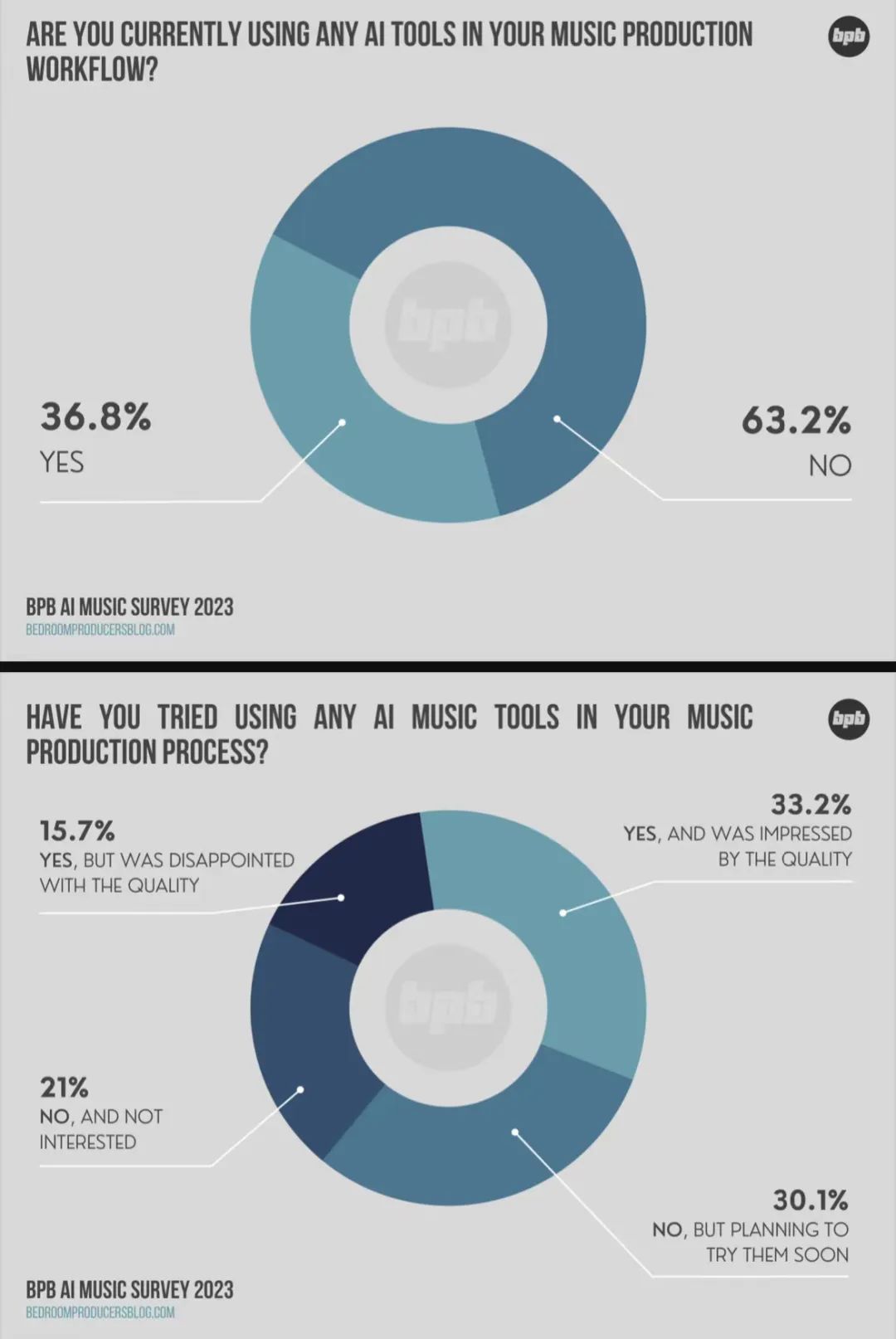

根据BPB(音乐制作论坛)去年一项针对1500名音乐制作人的调查显示,大约36.8%的制作人已经在音乐制作流程中使用了AI工具,而有30.1%的制作人计划尝试使用AI工具。据MBW报道,仅2023 年,就有1.7 亿首歌曲使用人工智能创作,并上传到Apple Music、Spotify和Amazon Music等音乐流媒体平台。

无论是国外的Suno、AIVA、Boomy等AI音乐工具,还是国内的TME Studio、Xstudio等AI音乐工具,都在词曲创作、混音和音乐生成等方面提供了多样化的功能。

而由此引发的版权争议和诉讼也在不断增加。根据海外数字媒体平台Sustainable Tech Partner信息,粗略统计从2023年至今,共有40起AI音乐相关的争议事件,其中牵扯诉讼8起。

今年4月,艺术家版权联盟和Billie Eilish、Nicki Minaj、Katy Perry等约200位艺术家联名发布了一封公开信,呼吁数字音乐开发商“停止使用人工智能侵犯和贬低人类艺术家的权利”。

不久前,TikTok与环球音乐集团共同宣布,双方达成新的版权许可协议。其中,很重要的一项协议,便是双方承诺“共同努力,确保整个音乐行业的人工智能发展将保护人类艺术,而由此产生的经济收益将流向那些艺术家和词曲作者。”

同样陷入尴尬境地的,还有OpenAI。

自去年3月推出炙手可热的文本转视频生成模型Sora后,该公司首席技术官Mira Murati在接受《华尔街日报》采访时却含糊其辞,无法明确说明Sora的训练数据来源。

在今年5月,据CNBC 消息,谷歌的首席执行官Sundar Pichai表示:如果确定微软支持的 OpenAI 依赖 YouTube 内容来训练能够生成视频的人工智能模型,谷歌将采取法律措施解决这个问题。

自AIGC技术诞生至今,关于其训练内容的版权纷争从未平息,现如今也着实跨界动了创意行业巨头的蛋糕。而索尼音乐此次的正式警告,也为这场AIGC的版权捍卫战再添战火。

AI对艺术创作所提供的相关工具,早已不止于对创作者和版权方的威胁,这不似画家放下画笔拿起手绘板的进化,更像是对行业未来的颠覆,也正因此,各大公司的介入也将倒逼相关法律法规的快速迭代与完善。

三、从立法到技术,如何维护人类艺术价值?

从去年12月8日,欧洲议会、欧盟成员国和欧盟委员会三方就《人工智能法案》达成协议。在今年3月13日,欧洲议会以523票赞成、46票反对、49票弃权通过了《人工智能法案》。

这部法案是全球首个针对人工智能广泛应用的综合性立法,旨在确保在欧盟市场上部署和使用的人工智能系统安全,且符合基本权利和欧盟价值观。法案中包括对高风险人工智能系统的严格规定,对可能对社会造成重大影响的通用人工智能模型提出了新的治理要求,并设立了一个专门的人工智能办公室,负责监督和执行这些规定。

另一边,美国田纳西州近期也通过了《确保肖像声音和图像安全(ELVIS)法案》,以保护音娱行业免遭人工智能的滥用。与《人工智能法案》不同的是,这一新法案主要集中在保护个人的声音和形象不被人工智能未经授权的使用,对于未经授权使用个人声音或形象的行为,可以通过民事诉讼来追究责任。

在技术层面,今年5月,法国音频技术公司Ircam Amplify推出了一款新工具 AI-Generate Detector,旨在识别使用人工智能创作的音乐,可以在一分钟内扫描多达5,000首音乐曲目,准确率高达98.5%。

Ircam Amplify首席执行官Nathalie Birocheau表示:“我们的人工智能生成探测器改变了游戏规则。它将在不透明的地方提供透明度,为用户带来战略优势,帮助他们对音乐内容做出明智的决策。”

AI工具、反AI工具,以及相关法律的颁布与执行,正在拉开一场旷日持久的较量。

作为行业的从业者,或许只有拿出师夷长技以制夷的心态来看待,一方面积极拥抱行业变化,多尝试、应用AI工具以防止被淘汰,另一方面时刻关注风向变化,保护好当下的权益不被侵犯。

四、结语

科幻电影正在照进现实。

当人类用工具使其与万物划清界限,逐渐在创造的高速发展中带入了上帝之感。

无论是智能机器人还是人工智能技术,以“人”的烙印标志着其“人造”的特性。而这种硅基生命的诞生让人类产生了上帝造人之感,也使其创造者在发展中展现了人类对科技发展的两重憧憬与担忧——一方面是如《S1m0ne》、《人工智能》那般以人为中心、高新技术永远平等服务于每一个人类的美好憧憬,一方面是,如《黑客帝国》、《西部世界》所忧虑的,担心其高度发展的智慧最终会颠覆人类社会造成不可避免的威胁。

然而,过去几十年科幻作品尚在讨论的未来已经悄然而至,人工智能已经粗鲁地闯入我们的日常生活。而科技对传统行业降维打击的风,终于吹到了人类艺术领域。

这与此前乐观派对于人工智能处理繁琐重复的日常、把创意留给人类的期待背道而驰,而更令人担忧的在于,法律法规等制度层面仍需要较长时间才可予以合理的规范。

如何最大程度地减轻人工智能技术的负面影响,避免音乐行业在未来变成混乱无序、弱肉强食的原始丛林,将成为未来一段时间内不可避免的行业话题。

毕竟在《圣经》里,即便是上帝造人,投放于伊甸园的亚当夏娃也难逃象征智慧的蛇的诱惑,偷吃禁果而反叛。

作者:李沁予 编辑:范志辉

来源公众号:音乐先声(ID:nakedmusic),解读音乐产业,见证黄金时代。

本文由人人都是产品经理合作媒体 @音乐先声 授权发布,未经许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益