本地大模型的”豪华驾驶舱”:Open WebUI深度测评

Open WebUI是一款开源自托管AI界面,专为Ollama等本地大模型打造。凭借128k GitHub Stars和749名贡献者,它已成为私有化AI部署的首选方案。支持RAG知识库、多模型管理、语音视频通话等功能,完全离线运行,隐私安全有保障。

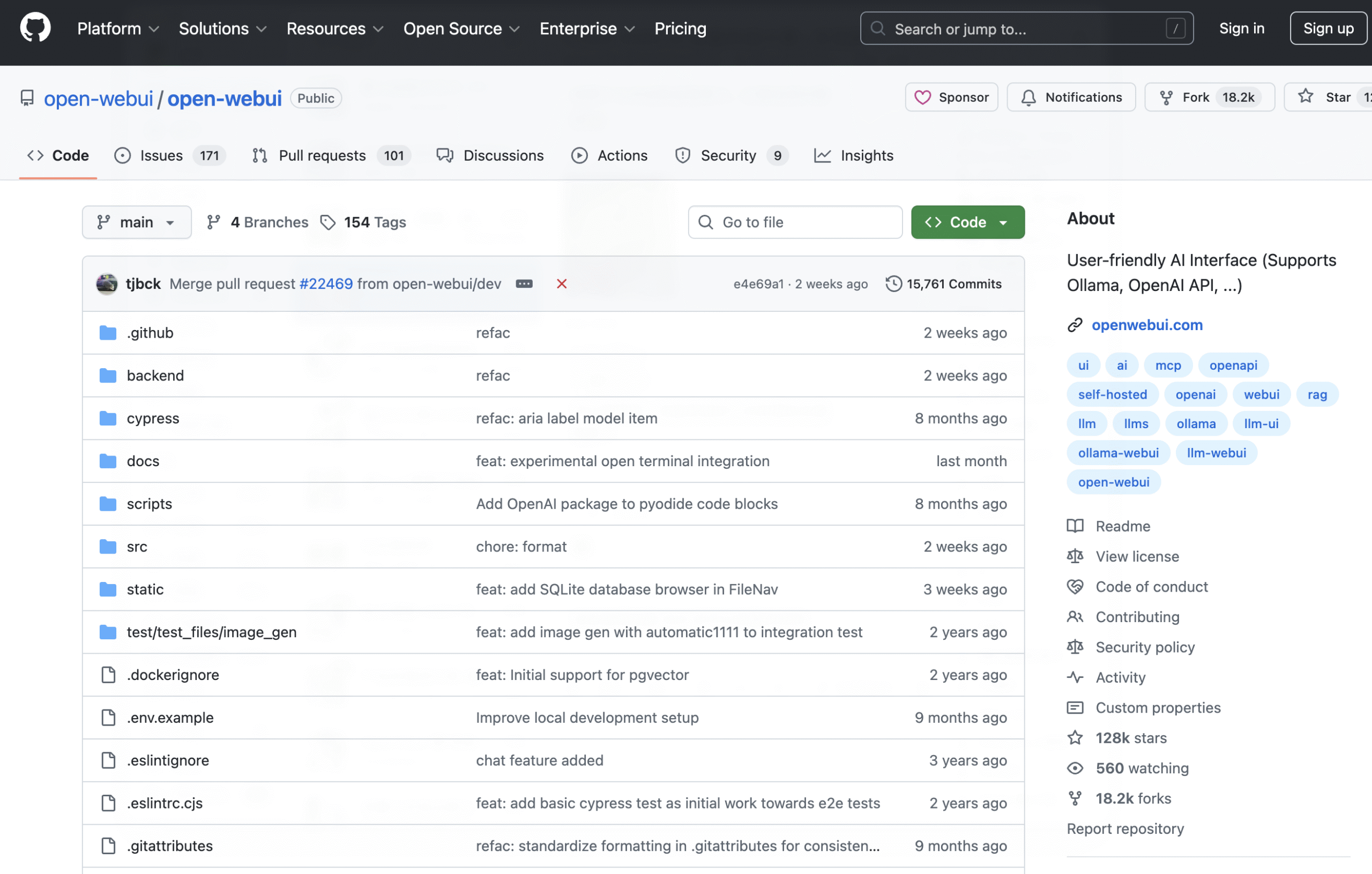

最近在GitHub上看到一款开源项目,上线不到两年狂揽128k Stars,成为本地大模型部署领域的”顶流”。它就是——Open WebUI。如果说Ollama是本地大模型的”引擎”,那Open WebUI就是让这台引擎发挥最大价值的”豪华驾驶舱”。今天我们就来实测一下,看看它到底值不值得用。

📌 产品速览:3分钟了解核心信息

Open WebUI是一款功能丰富、用户友好的自托管AI平台,设计为完全离线运行。它支持Ollama和OpenAI兼容API,内置RAG推理引擎,是目前最完整的本地大模型部署解决方案之一。

核心数据速览:

-

GitHub Stars:128k ⭐(全球最受欢迎的开源项目之一) -

Fork数量:18.2k -

贡献者:749人 -

最新版本:v0.8.10(2026年3月9日发布) -

作者:Timothy Jaeryang Baek(@tjbck)

技术栈:

-

前端:Svelte 32.4%、JavaScript 25.9%、TypeScript 5.1% -

后端:Python 33.9%

目标用户:开发者、AI爱好者、企业团队、研究人员

✨ 核心功能:这7个亮点最值得关注

1. 🚀 一键部署,极简安装

告别繁琐的配置,两行命令即可启动:

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data --name open-webui \

--restart always ghcr.io/open-webui/open-webui:main

支持Docker和Kubernetes部署,带GPU支持,一个命令搞定一切。

2. 🤝 多后端API无缝集成

不仅支持Ollama,还能对接:

-

LM Studio -

GroqCloud -

Mistral -

OpenRouter -

任何OpenAI兼容API

一个界面,统一管理所有AI模型。

3. 📚 内置RAG知识库系统

这是Open WebUI的”杀手级功能”:

-

支持9种向量数据库(ChromaDB、PGVector、Qdrant等) -

上传PDF、Word、TXT文档构建知识库 -

聊天时自动检索相关内容并引用来源 -

使用 #命令快速访问文档

4. 🔍 联网搜索能力

集成15+搜索提供商(Google、DuckDuckGo等),让本地大模型也能”上网冲浪”,实时获取最新信息。

5. 🎨 多模态交互

-

图像识别:上传图片,用Llava、Qwen-VL等模型分析内容 -

图像生成:对接ComfyUI、Automatic1111等,在聊天界面直接生成图像 -

语音/视频通话:支持多种语音转文字和文字转语音引擎

6. 🛡️ 企业级权限管理

管理员可创建详细的用户角色和权限:

-

用户注册白名单 -

模型使用权限分配 -

聊天记录审计 -

支持LDAP/Active Directory、OAuth单点登录

7. 🧩 插件和扩展支持

通过Pipelines插件框架,可以自定义Python函数和工作流,满足各种定制化需求。

🧪 实测体验:真实使用感受

优点

-

✅ 完全免费开源:所有代码公开,无任何付费墙,适合个人和商业使用 -

✅ 隐私安全有保障:所有数据保存在本地,不用担心对话上传云端 -

✅ 界面美观直观:复刻ChatGPT操作体验,深色模式、代码高亮、LaTeX公式渲染一应俱全 -

✅ 功能高度集成:聊天、知识库、联网搜索、图像生成在一个界面完成 -

✅ 多语言支持:提供中文界面,翻译质量良好

缺点

-

❌ 资源消耗较大:Open WebUI本身轻量,但运行的大模型会消耗大量GPU资源(建议8GB+显存) -

❌ 配置有一定门槛:需要正确配置Ollama和Docker网络参数,新手可能需要查阅文档 -

❌ 非Ollama官方出品:作为第三方项目,更新节奏依赖社区驱动

⚖️ 竞品对比:和Text Generation Webui相比怎么样

| 对比维度 | Open WebUI | Text Generation Webui | Jan |

|---|---|---|---|

| 界面美观度 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ |

| 功能集成度 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| RAG知识库 | 原生支持 | 需额外配置 | 基础支持 |

| 联网搜索 | 原生支持 | 需插件 | 不支持 |

| 权限管理 | 企业级 | 基础 | 基础 |

| 安装便捷性 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ |

| 社区活跃度 | 非常活跃 | 一般 | 一般 |

结论:如果你追求美观界面、完整功能和便捷部署,Open WebUI是最佳选择;如果你是极客玩家需要高度定制,Text Generation Webui更适合你。

🎯 适合人群:这些人最值得尝试

✅ 强烈推荐

-

开发者和AI爱好者:在本地电脑运行私有化AI助手,进行代码编写、学习、文档总结 -

企业和团队:在内部网络部署,安全分析内部文档,构建知识库系统 -

注重隐私的用户:不希望将对话数据发送到第三方云服务

❌ 不太适合

-

电脑配置较低的用户:没有8GB+显存的GPU,很难流畅运行主流模型 -

追求极速部署的用户:希望5分钟内完成一切,可能会被初始配置时间劝退

💡 使用技巧:让你效率翻倍的5个秘诀

技巧1:用户模板定制

在「管理面板→用户」中创建自定义提示词模板,让AI助手更懂你的需求和说话风格。

技巧2:知识库快速上手

上传公司内部文档或个人笔记集,使用 #文档名 命令在聊天时快速引用,大幅提升回答准确性。

技巧3:多模型对比

同时接入多个模型(如Llama 3、DeepSeek、Mistral),在聊天界面左侧一键切换,轻松对比不同模型的回答效果。

技巧4:快捷键熟练掌握

-

Ctrl + Enter:发送消息 -

Ctrl + Shift + O:切换模型 -

Ctrl + /:打开快捷键列表

技巧5:移动端PWA应用

在Chrome中打开「安装应用」,可以把Open WebUI当作原生App使用,支持离线访问。

📝 总结:值不值得用

综合评分:⭐⭐⭐⭐⭐(5/5)

核心优势:

-

🏆 GitHub 128k Stars,开源社区认可度最高的本地AI界面 -

🔐 完全离线运行,隐私安全有保障 -

🎨 功能高度集成,聊天+RAG+搜索+多模态一站搞定 -

🚀 部署极简,Docker两行命令启动

不足之处:

-

需要一定的硬件配置(建议8GB+显存) -

初始配置对新手有一定学习成本

最终推荐:

如果你想在本地部署一个功能强大、界面美观、隐私安全的大模型平台,Open WebUI几乎是唯一的选择。它将复杂的本地模型部署变得如此简单,让任何人都能轻松拥有自己的”私人AI助理”。

项目地址:https://github.com/open-webui/open-webui

本文基于公开资料整理,实际体验可能因版本更新有所差异。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益