千人千面是伪命题吗?端侧模型正在终结“云端隐私焦虑”

智能座舱正在经历一场从云端到本地的技术革命,如何在实现个性化服务的同时守护用户隐私,成为行业核心命题。本文将深度解析端侧优先架构的四大技术支撑,揭秘如何通过本地SLM、联邦学习与多模态融合,打造真正懂人却不越界的智能座舱体验。

智能座舱的下半场,大家都在谈“懂人”。

01 信任是智能的“第一性原理”

但有一个行业悖论始终绕不开:AI 要想懂你,就得窥探你。过去那种“把数据传到云端做匹配”的逻辑,本质上是把用户的隐私当成燃料。

但如果你的个性化是建立在“窃听”和“云端裸奔”的基础上,那不叫智能,叫冒犯。

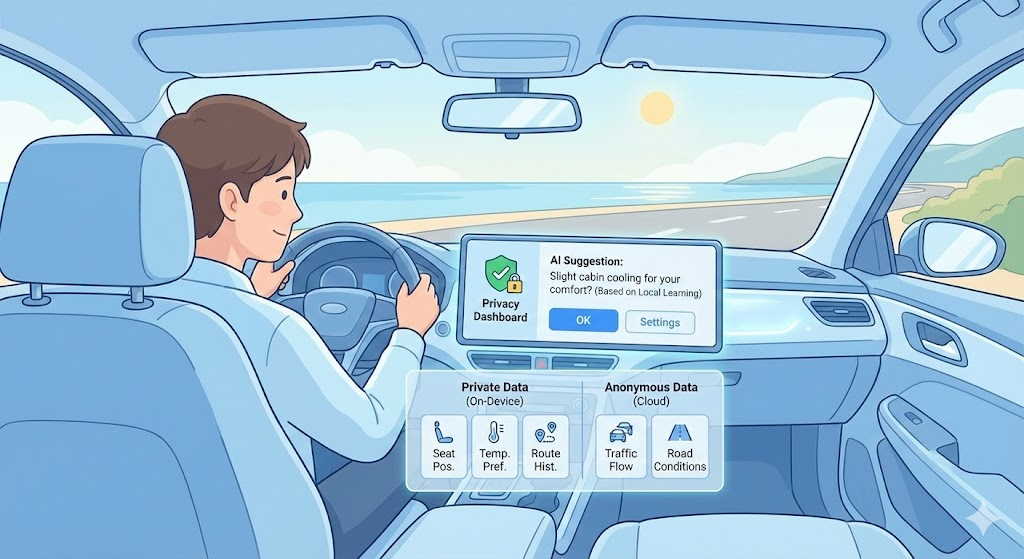

要实现“真·定制”且守住隐私,产品架构必须完成从 Cloud-Native 到Edge-First(端侧优先)的转型。

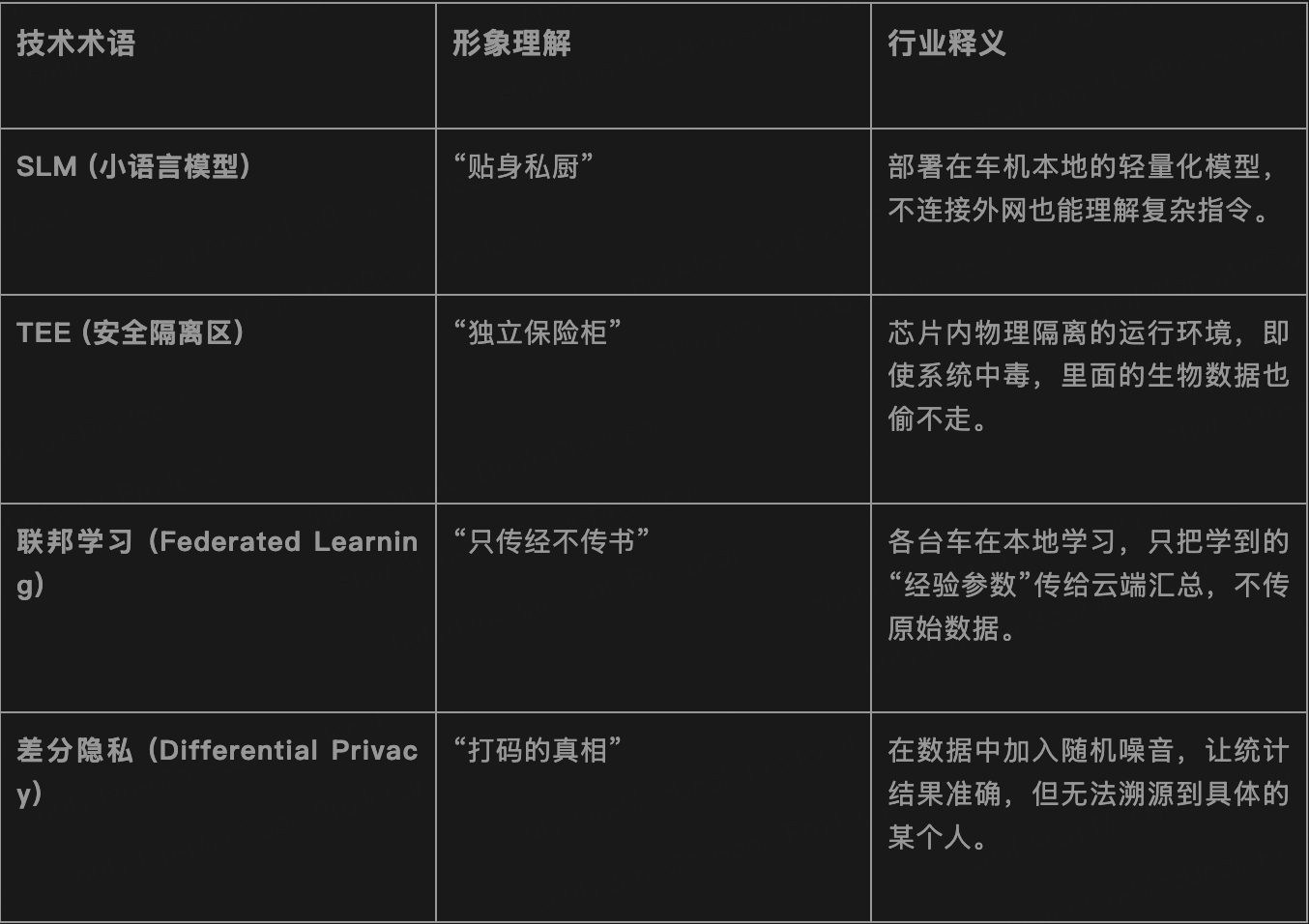

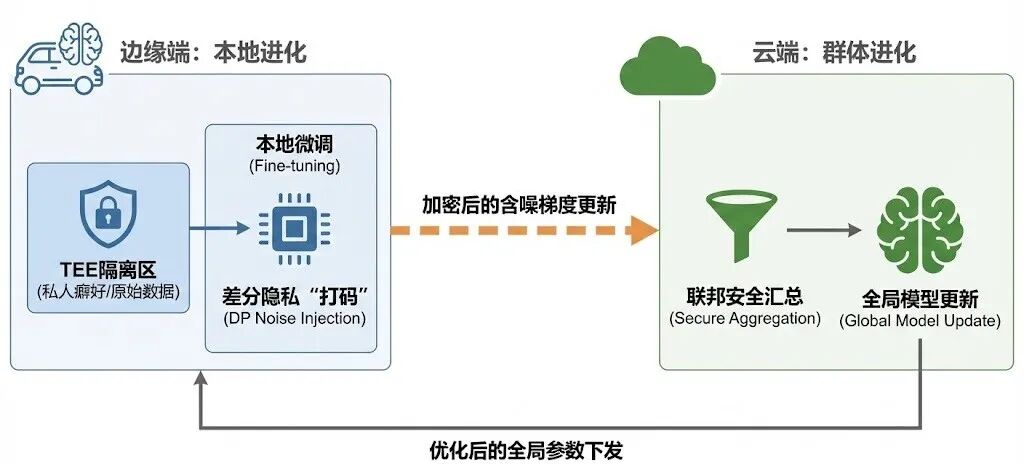

在深入讨论逻辑前,我们需要理解支撑这一变革的四大硬核技术:

02 核心变革:从“画像标签”到“实时状态感知”

过去座舱所谓的“个性化”大多是基于静态标签:你是“都市白领”,所以给你推爵士乐。这种逻辑极其粗放,因为它忽略了驾驶是一个高频、高隐私、强实时的流动场景。

真正的个性化不应产生于云端数据库的匹配,而应产生于座舱内多模态感知流(Perception Stream)的本地实时推理。

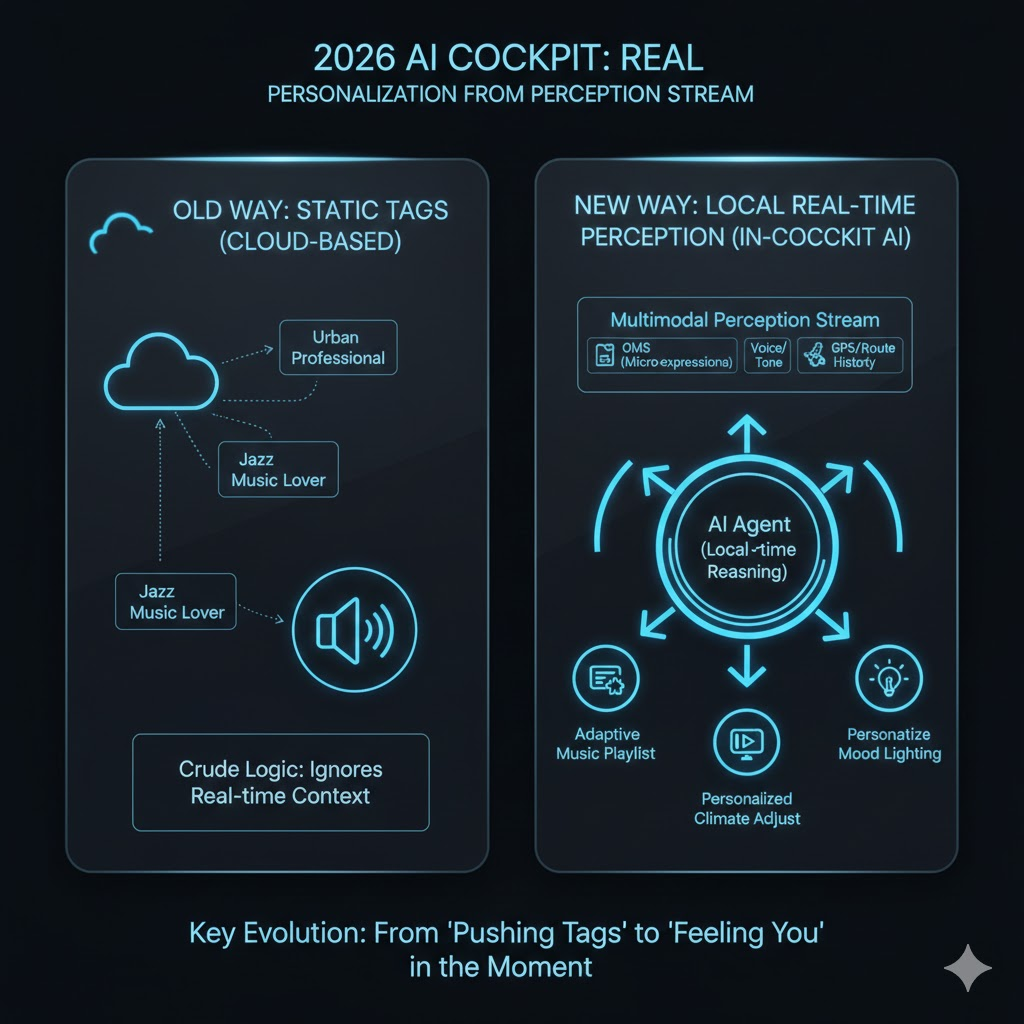

1. 端侧 SLM 的本地闭环

借助高算力 NPU,我们将 7B 或更小参数规模的 SLM 部署在车机本地。

- 语义脱敏:所有的语音交互、视线轨迹、甚至车内乘客的对话,都在本地完成特征提取。上传到云端的不再是原始音频或图像,而是经过矢量化的无感指令。

- 低延迟决策:涉及座椅调节、空调偏好、驾驶模式切换的推理,无需经过云端握手,响应时间从秒级降至毫秒级。

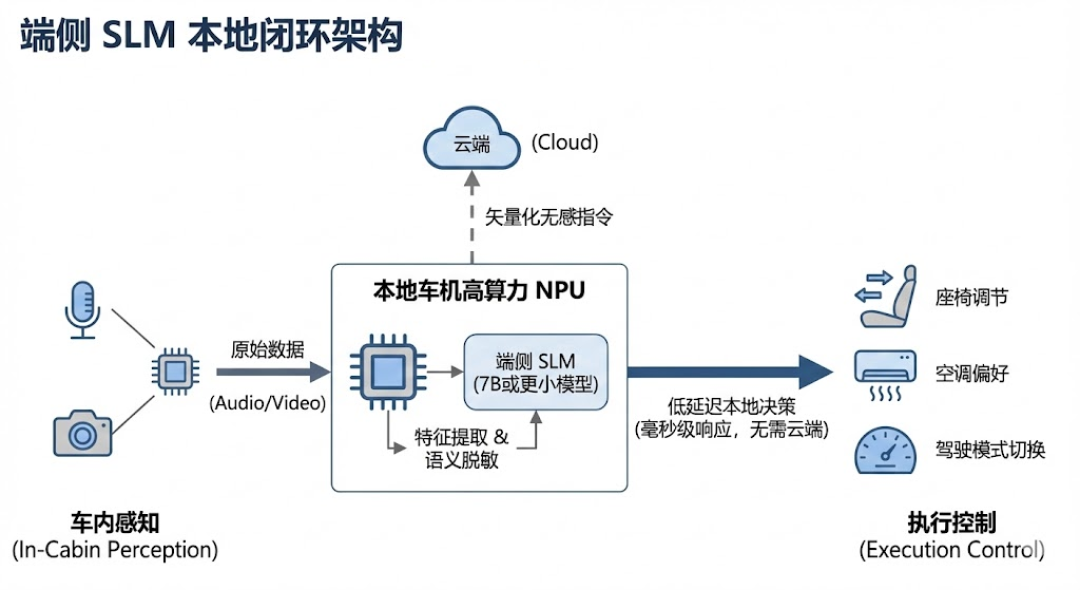

2. 联邦学习与差分隐私的工程实践

这是解决“个人偏好”与“群体进化”矛盾的关键。

- 本地进化:模型在本地进行微调(Fine-tuning),学习用户的特定习惯(如:进入隧道自动切换内循环、特定的转向灯力度偏好)。

- 安全汇总:通过联邦学习,模型更新的参数在经过差分隐私“打码”加密后上传云端。这保证了 AI 的整体进化依赖群体智慧,但你的私人癖好只锁在 TEE 隔离区里。

03 产品深度:传感器融合的“预判力”

当端侧模型具备了多模态处理能力,个性化将进入“情境感知”阶段:

- 视觉与座舱状态融合:传感器捕捉到驾驶员频繁揉捏颈部,结合长途驾驶里程,端侧 AI 自动触发座椅按摩与香氛切换,而非等待用户下达指令。

- 长短期记忆架构:短期捕捉当前行程的突发偏好(如临时改变导航偏向)。

- 长期:沉淀用户长期的生活节律,并存储在硬件安全区,确保数据主权归用户所有。

04 产品的冷思考:边界究竟在哪里?

作为一线实践者,我们必须警惕“过度智能化”。在算力分配上,我坚持以下优先级:

- 算力优先级:隐私相关的感知推理 > 娱乐化建议。

- 干预度控制:所有的个性化执行应遵循“最小干扰原则”。AI 可以主动调节温度,但不应在未确权的情况下大幅度改变驾驶辅助(智驾)设置。

- 透明化补偿:给用户一个“隐私看板”,明确告知:哪些数据在本地学习,哪些数据参与了匿名进化。

结语

“千人千面”不是靠云端喂数据喂出来的,而是靠端侧算力磨出来的。隐私不是功能的对立面,而是高级智能的标配。当我们把推理权还给车辆本地,个性化才真正从“营销噱头”转变为“私人管家”。

本文由 @OpenAIer 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

评论

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益