黄仁勋最新2万字演讲实录:推理的拐点已经到来,Token将成最值钱的大宗商品

当黄仁勋在GTC大会上宣布'推理拐点已至',AI产业正式从训练时代迈入推理时代。英伟达推出的Vera Rubin架构将算力需求推高100万倍,Token成为新的大宗商品。从CUDA二十年护城河到AI工厂新范式,从物理AI机器人到OpenClaw开源框架,这场技术革命正在重构全球计算基础设施。本文深度解析英伟达如何通过极致协同设计实现35倍性能提升,揭示万亿美元市场背后的技术逻辑与商业图景。

算力即印钞机,需求激增100万倍。

当地时间2026年3月16日,被誉为“AI界春晚”的英伟达(NVIDIA)GTC大会如期而至。大会上,英伟达创始人兼CEO黄仁勋发表了一场长达两小时的主题演讲。

演讲中,黄仁勋指出,人工智能已经跨越了只能陪人聊天、画图的“感知与生成”阶段,正式进入了以“智能体(Agentic AI)”和“物理AI(Physical AI)”为核心的执行时代。算力也不再仅仅是研发支出,而是直接转化为新一代大宗商品——Token(词元)。

此外,黄仁勋再次强调了“AI工厂”概念。他指出,过去的数据中心是用来存放文件和照片的静止仓库,而未来的数据中心,将变成日夜不停运转的轰鸣工厂。它们生产的不再是传统产品,而是未来数字世界最核心、最值钱的大宗商品:Token。而为了让这些工厂的产能达到极致,英伟达不仅推出了Vera Rubin硬件系统,还发布了能够让AI安全替人类“打工”的操作系统框架。

演讲要点如下:

1.转折点到来。黄仁勋指出,AI 已经能够从事生产性工作,AI 市场最核心的转变是从“训练”全面走向“推理”。

2.计算量激增。在推理时代,所需的 token 量和计算量相比训练阶段增加了约一万倍,他相信过去两年计算需求实际增加了100 万倍。

3.万亿美元机会。基于这一转变,他预期到 2027 年底,Blackwell 与 Vera Rubin 两代架构将带来至少 1 万亿美元的累计收入机会。

4.推理分工化。英伟达打破单芯片处理传统,将推理拆分为两步:第一阶段“预填充”由 Vera Rubin 负责;第二阶段“解码”交由新整合的 Groq 芯片负责,每瓦特性能提升了几十倍。

5.路线图发布。Groq 3 LPU,专注于低延迟计算,预计今年下半年出货;Vera Rubin,性能比上一代高出 10 倍,预计 2026 年下半年出货;Kyber 架构,将 144 个 GPU 垂直集成,预计 2027 年应用于 Vera Rubin Ultra;Feynman 芯片,暗示了 Rubin 之后的长远产品线。

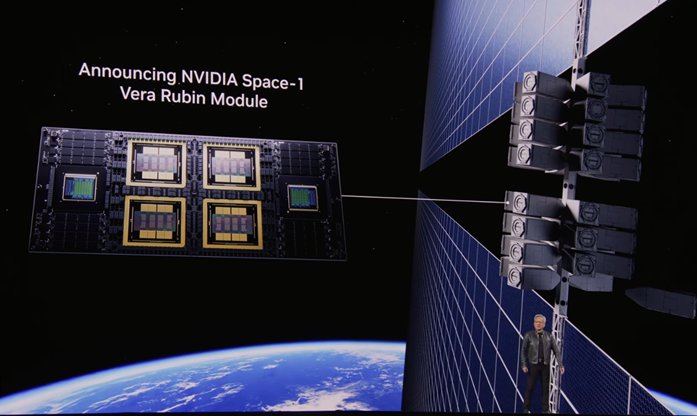

6.进军太空。宣布与 Axiom Space 合作推出 Vera Rubin Space-1 模块,开启“轨道数据中心”计划。

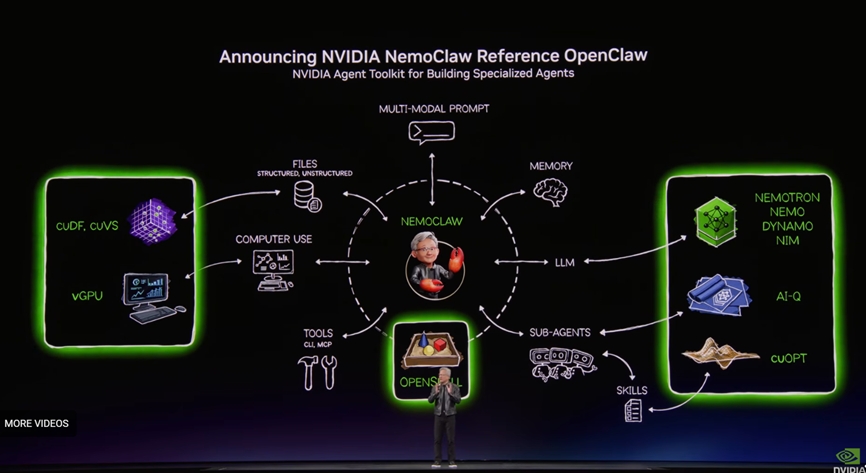

7.与OpenClaw 合作的项目。黄仁勋形容其重要性堪比 Linux 和 HTML,能让 AI 智能体自主执行任务、调用工具并重塑软件架构。NemoClaw 参考设计,用于确保企业级应用的安全可控。

8.多次强调“AI 工厂”平台。英伟达定义了三个平台:CUDA X 相关平台、系统平台以及新平台“AI 工厂”。与此相应的核心度量指标也有改变——未来 CEO 将重点关注 AI 工厂的 token 吞吐量和 token 速度(在恒定功耗下),这直接关系到企业的收入。

9.关于年度 token 预算。建议为每位工程师配备“年度 token 预算”,作为推动生产力增长的新标配。

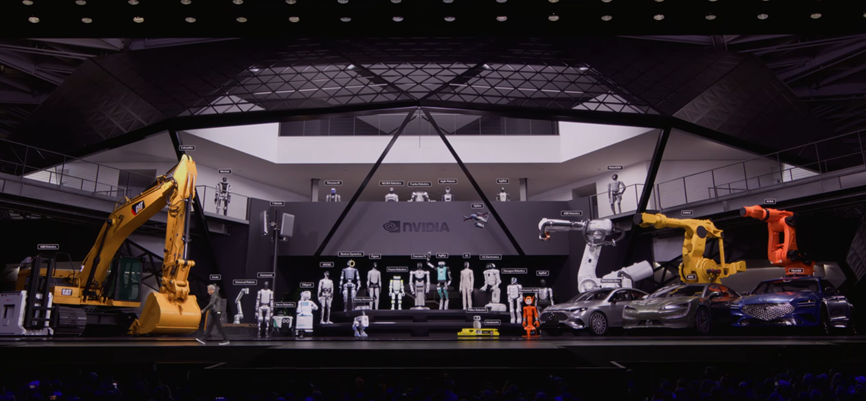

10.关于物理 AI 与机器人。黄仁勋展示了新的机器人训练平台 GR00T,并宣布其 N1 版本开源。同时,也聊到了未来的迪士尼,现场描绘了未来机器人角色在乐园中穿梭的景象。

以下为演讲实录,有删改:

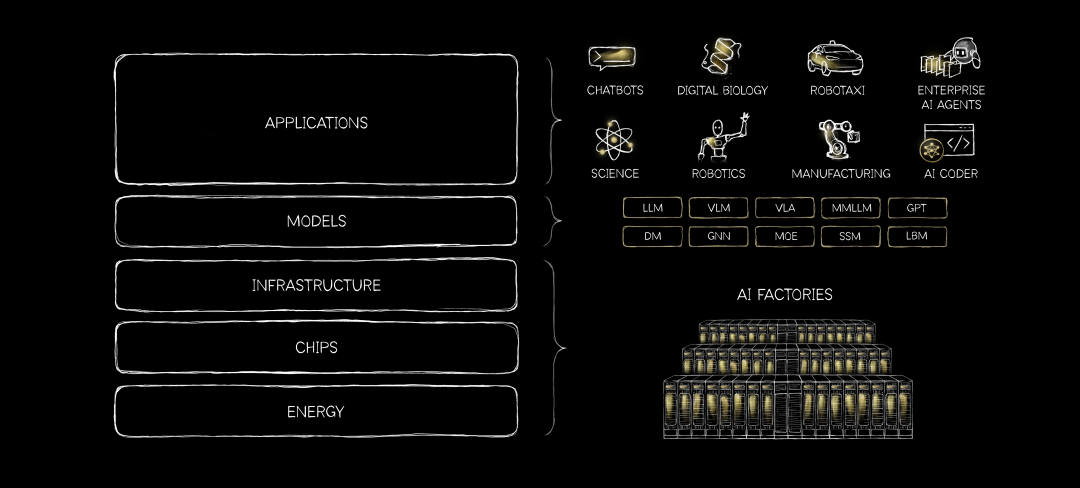

01 谈CUDA二十年的护城河和新变化

在 GTC,我们将谈论技术,我们将谈论平台。NVIDIA 有三个平台。你可能认为我们主要只谈论其中之一。它与 CUDA-X 有关。我们的系统是另一个平台,现在我们有了一个名为 AI Factories 的新平台。我们将谈论所有这些平台,最重要的是,我们将谈论生态系统。

这次会议将涵盖人工智能五层蛋糕的每一层,从土地、电力和外壳等基础设施,到芯片,再到平台、模型,当然,最重要也是最终将推动这个行业腾飞的,是所有的应用程序。

今年是 CUDA 的 20 周年纪念,我们在 CUDA 上深耕了 20 年。20 年来,我们一直致力于这种架构。这项革命性的发明,SIMT(单指令多线程),让编写标量代码可以衍生出多线程应用程序。这比 SIMD 编程要容易得多。我们最近添加了 tiles,用来帮助人们对Tensor Cores 以及当今人工智能基础的数学结构进行编程。

成千上万的工具、编译器、框架和库,在开源领域,有几十万个公共项目。CUDA实际上已经把它们整合到了每一个生态系统中。

这张图基本上描述了 NVIDIA 100% 的战略。你们从一开始就看我在讲这张幻灯片。最终,最难实现的是最底层的东西,即安装基数。CUDA 的安装基数是飞轮加速运转的原因,安装基数吸引了开发者,开发者在此基础上创造了新的算法并取得突破。例如,deeplearning,还有很多其他的例子。

这些突破带来了全新的市场,并围绕它们与加入的其他公司建立了新的生态系统,这又创造了更大的安装基数。

这个飞轮现在正在加速。NVIDIA 库的下载量正以惊人的速度加速增长。它的规模非常大,而且增长速度比以往任何时候都快。这个飞轮使得这个计算平台能够支撑如此多的应用程序和新突破,但最重要的是,它也使得这些基础设施拥有了超长的使用寿命。

原因很明显,有很多应用程序可以在 NVIDIA CUDA 上运行。应用程序的覆盖范围如此之广,以至于一旦你安装了 NVIDIA GPUs,它的使用寿命将极高。这也是为什么我们大约六年前出货的 Ampere,其在云端的定价还在上涨的原因之一。这是因为安装基数大,飞轮效应强,开发者触达范围广。同时,我们会不断更新我们的软件,计算成本随之下降。加速计算极大地提升了应用程序的速度。同时,随着我们不断培育并在其生命周期内更新软件,你不仅获得了首次的性能爆发,还能获得加速计算随着时间推移带来的持续成本降低。

我们愿意培育,愿意支持世界上每一个 GPUs,因为它们在架构上都是兼容的。我们愿意这样做是因为安装基数如此庞大,如果我们发布一个新的优化,它将惠及数百万人。这种动态的结合使得 NVIDIA 架构扩大了它的覆盖范围,加速了它的增长,同时降低了计算成本,最终鼓励了新的增长。而CUDA 处于这一切的中心。

我们走向 CUDA 的旅程实际上始于 25 年前的GeForce。我不知道你们中有多少人是伴随着 GeForce 长大的?GeForce 是 NVIDIA 最伟大的营销活动,早在你们自己能买得起之前很久,我们就开始吸引未来的客户,是你们父母买的单。

你们的父母为你们成为 NVIDIA 的客户买单,他们年复一年地付钱,直到有一天你成为了一名了不起的计算机科学家,成为了一名真正的客户,一名真正的开发者。这就是 GeForce 建立的根基。25 年前,我们开始了我们的旅程,这促成了 CUDA 的诞生。

25年前,我们发明了可编程着色器。这是一个完全不显眼的发明,目的是让加速器变得可编程。世界上第一个可编程加速器,像素着色器。25年前,它引领我们进一步探索。

20年后,也就是着色器发明的5 年后,CUDA 诞生了。它是我们最大的投资项目之一,在 GeForce 的基础上把 CUDA推向每一台计算机,消耗了我们公司绝大部分的利润。

我们全身心地投入到创建这个平台中,我们强烈地感受到了它的潜力。最终在20 年的 13 代产品中日复一日地坚持,我们现在让 CUDA 无处不在。像素着色器引发了 GeForce 的革命。

8年前,针对现代计算机图形时代,我们对架构进行了彻底的重新设计,推出了RTX。GeForce将CUDA带给了世界。因此,GeForce让Alex Krizhevsky和Ilya Sutskever,以及Geoffrey Hinton、Andrew Ng和许多其他人发现,GPU可以成为他们加速deep learning的朋友。它开启了AI的大爆炸。

10年前,我们决定融合可编程着色技术,并引入两个新想法:ray tracing和硬件ray tracing,这是一项极难做到的技术,也是当时的一个新想法。想象一下,大约10年前,我们认为AI会彻底改变计算机图形学。就像 GeForce 把 AI 带给世界一样,AI 现在反过来将彻底改变计算机图形的制作方式。

今天我要向你们展示一些属于未来的东西。这是我们下一代的图形技术。我们把它称为neural rendering——3D图形与artificial intelligence 的融合,这就是 DLSS 5。不可思议吧?计算机图形变得栩栩如生了。

那么,我们做了什么?

我们融合了可控的 3D 图形、虚拟世界的基准事实(ground truth)、生成的虚拟世界的 structured data。我们将 3D 图形、structured data 与 generative AI 结合在一起。其中一个是完全预测性的,另一个是概率性的,但高度逼真。

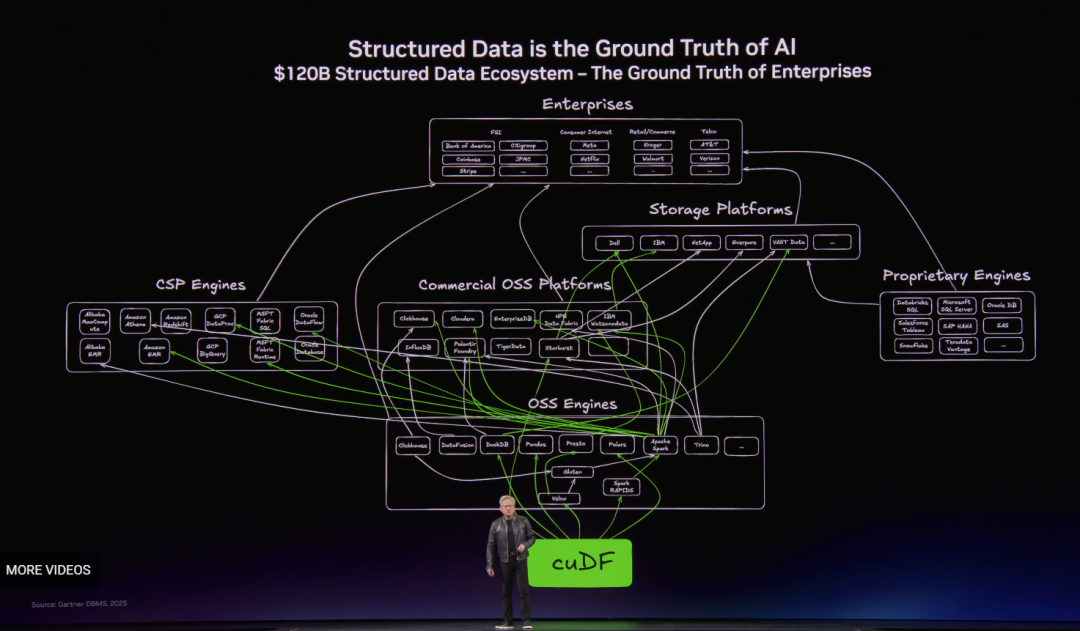

我们将这两个想法结合起来,通过 structured data 进行控制,完美控制的同时又在生成内容。结果就是,内容不仅美丽、惊人,而且是可控的。这种融合结构化信息和 generative AI 的概念将在一个又一个行业中重演。Structured data 是值得信赖的 AI 的基础。在接下来的时间里,我们将深入探讨这张原理图。

这是我最好的一张幻灯片。每次我问团队,“我最好的幻灯片是哪张?”他们总说是这张。他们会说,“别放这张,Jensen。别放。”我说,“不行,你们中有些人的座位可是免费的。”所以这就是你们入场的代价。

这就是structured data。你们听说过它,SQL、Spark、Pandas、Velox,还有一些重要的大型平台,Snowflake、Databricks、EMR、Amazon EMR、Azure、Fabric、Google Cloud、BigQuery。所有这些平台都在处理data frames。这些data frames是巨大的电子表格,它们保存着生活的所有信息,这是structured data,商业的基准事实。这是企业计算的基准事实。那么,现在我们将让AI来使用structured data,而且我们最好能极大地加速它。

过去这样是可以的,我们会加速structured data,这样我们就能做更多的事,成本更低,每天处理的频率更高,并让公司以更加同步的方式运转。然而,在未来将会发生的是,这些数据结构将被AI使用,而AI的速度将比我们快得多。未来的agents也将使用structured databases。

当然,还有unstructured database,即生成式数据库。这个数据库代表了世界上的绝大部分内容。Vector databases,unstructured data、PDFs、视频、演讲、世界上所有的信息,每年生成的数据中约有 90% 是 unstructured data。直到现在,这些数据对世界来说完全无用。

我们阅读它,把它放入我们的文件系统中,仅此而已。但是,我们无法查询它,我们无法搜索它。这很难做到。原因是目前没有简单的方法来索引 unstructured data。你必须理解它的含义和目的。

现在我们让 AI 来做这件事。就像 AI 能够解决多模态感知和理解一样,你可以使用相同的技术,多模态感知和理解,去阅读 PDF,理解其含义,并从这个含义中,将其嵌入到一个我们可以搜索、可以查询的更大结构中。

NVIDIA创建了2个基础库。就像我们为3D图形创建了RTX一样,我们为data frames和structured data创建了cuDF;我们为vector stores、语义数据、unstructured data、AI data创建了cuVS。

这两个平台将成为未来最重要的两个平台。我非常兴奋地看到它在这个由世界数据处理系统组成的复杂网络中被广泛采用。

02 谈垂直整合

NVIDIA 是垂直整合的,是世界上第一家垂直整合但在水平层面开放的公司。这样做的必要性非常简单。加速计算不是一个芯片问题。加速计算不是一个系统问题。加速计算漏掉了一个词。我们现在只是不再说它了,应用程序加速。如果我能制造出一台运行所有东西都更快的计算机,那叫做 CPU,那已经失效了。

未来我们要想加速应用程序并继续带来巨大的速度提升、巨大的成本削减,唯一的方法是通过应用程序或特定领域的加速。我把那个词去掉了,因此它就变成了加速计算。这就是 NVIDIA 必须一个库接一个库、一个领域接一个领域、一个垂直行业接一个垂直行业去做的原因。

我们是一家垂直整合的计算公司,别无他法,我们必须理解这些应用程序,我们必须理解这个领域。我们必须从根本上理解算法。我们必须弄清楚如何在它希望被部署的任何场景中部署算法,无论是在数据中心、云端、本地、边缘还是在机器人系统中。

所有这些计算系统都是不同的。最后是系统和芯片。

我们是垂直整合的,使它无比强大,你们能看到所有这些幻灯片,是因为NVIDIA 也是水平开放的。我们将进行合作,把 NVIDIA 的技术整合到你们希望我们整合进去的任何平台中。我们向你们提供软件,向你们提供库。我们与你们的技术整合,以便我们可以将加速计算带给世界上的每个人。那么,这次 GTC 就是一个很好的证明。

你知道,大多数时候你会看到我谈论这些垂直领域,我会举一些例子。在每一个案例中,无论是汽车行业,顺便说一句,还有金融服务业,参加这次 GTC 人数比例最高的是金融服务业的人士。

我知道。我希望来的是开发者,而不是交易员。伙计们。有一件事我想说。台下的观众代表了 NVIDIA 供应链上游和供应链下游的生态系统。我们工作时,会考虑我们供应链的上下游。令人兴奋的是,在过去的一年里,我们的整个上游供应链,不管你们是 50 年历史的公司,还是有 70 年历史的公司,我们还有 150 年历史的公司,现在都成为了 NVIDIA 供应链的一部分,在我们的上游或下游与我们合作。

去年,你们迎来了创纪录的一年。不是吗?恭喜你们,我们在这里大有作为。

如果你看看加速计算,我们现在已经建立好了计算平台。为了让我们激活这些计算平台,我们需要拥有特定领域的库,来解决我们所涉足的每一个垂直领域中非常重要的问题。你可以看到我们正在解决这其中的每一个问题,如Autonomous vehicles(自动驾驶车辆)。

我们的覆盖范围、我们的广度、我们的影响力,令人难以置信。我们在这方面取得了进展。

金融服务。我刚才提过了。Algorithmic trading(算法交易)正在从带有被称为quant(量化)的人工特征工程的经典机器学习时代,跨入超级计算机分析海量数据、自己发现洞见和发现模式的时代。它正在经历它的deep learning和transformer时刻。

医疗保健正在经历他们的ChatGPT时刻。我们在那里正在做一些令人兴奋的工作。我们在这里有一个很棒的主题演讲环节。Kimberly Powell正在主持一场关于医疗保健的精彩主题演讲。我们在谈论用于药物发现的AI物理学或AI生物学,用于客户服务和辅助诊断的AI agents,当然,还有physical AI机器人系统。所有这些不同的AI载体都有NVIDIA提供的不同平台。

工业领域,我们正在彻底重置并开始人类历史上最大规模的建设。世界上大多数正在建立 AI factories、建立芯片工厂、建立计算机工厂的行业,今天都在这里有代表出席。媒体和娱乐、游戏,当然还有实时 AI 平台,以便我们可以进行翻译和广播支持以及现场比赛和现场视频,海量的内容将通过 AI 得到增强。

我们有一个名为 Holoscan 的平台。Quantum 领域,有 35 家不同的公司在这里与我们一起构建下一代 Quantum GPU 混合系统。零售和 CPG 领域,使用 NVIDIA 进行供应链管理,创建 agentic 购物系统、用于客户支持的 AI agents,这里正在进行大量的工作,35 万亿美元的产业。Robotics,50万亿美元的制造业。NVIDIA 已经在这个领域耕耘了十年,构建了 3 台计算机,这是构建机器人系统所必需的基础计算机。

我们与大部分我们知道的制造机器人的公司进行了整合与合作。我们在展会上有110 个机器人。然后是电信领域。其规模与全球 IT 产业差不多,约2万亿美元。当然,我们看到基站无处不在。它是世界的基础设施之一。

它是上一代计算技术的基础设施。那个基础设施将被彻底重塑。原因非常简单。那个只做一件事的基站,也就是基站功能,未来将变成一个 AI 基础设施平台。AI 将在边缘运行。

我们在该领域的平台叫做 Aerial 或 AI RAN。与 Nokia 有大规模合作,与 T-Mobile 及许多其他公司也有大规模合作。我们业务的核心,也就是我刚才提到的所有内容,计算平台,但非常重要的一点是,我们的 CUDA-X 库。我们的 CUDA-X 库就是算法,NVIDIA 发明的算法。我们是一家算法公司,正是这一点让我们与众不同。

正是这一点让我能够进入所有这些行业,想象未来,并让世界上最优秀的计算机科学家描述和解决问题,重构它,重新表达它,并将其变成一个库。

我想在这次展会上,我们要宣布 100 个库,70 个库,也许 40 个模型,而这仅仅是在展会上。我们一直在更新这些内容。我们一直在更新它们。库是我们公司皇冠上的明珠。它使得这个计算平台,能够被激活来解决问题,产生影响。我们创建的最大、最重要的库之一,cuDNN(CUDA Deep Neural Network)。它彻底改变了artificial intelligence,引发了现代 AI 的大爆炸。

过去两年发生了一些事情,特别是去年。我们与 AI natives 合作了很长时间,而就在去年,它一飞冲天,我来向你们解释一下为什么会这样。这个行业已经一飞冲天了。1500 亿美元的投资进入了风险投资,进入了初创企业,这是人类历史上规模最大的。这也是投资规模首次从数百万美元、数千万美元跨越到了数亿美元甚至数十亿美元。原因在于,所有这些公司都需要算力,而且是海量的算力。他们需要 tokens,而且是海量的 tokens。

他们要么去创造、建立和生成 tokens,要么去整合 Anthropic、OpenAI 和其他公司创造的可用 tokens,并为之增加价值。这个行业在很多方面都与众不同,但有一点非常清楚,它们正在产生的影响,它们已经交付的令人难以置信的价值,是非常显而易见的。AI natives,这全是因为我们重塑了计算。就像 PC 革命期间,诞生了一大批新公司。就像互联网革命期间,诞生了一大批新公司。在移动云时代,也诞生了一大批新公司。它们都有自己的标准等等。我们将谈论其中一个刚刚发生的主要标准,它极其重要。

03 谈推理拐点已至,Token与算力爆发

我们重塑了计算,理所当然地,将会涌现出一大批对世界未来具有深远影响的新一代重要公司。那些因为上一次计算平台转变而诞生的 Googles、Amazons、Metas 等深具影响力的公司,我们现在正处于一个新的平台转变的起点。

过去几年发生了什么?嗯,如你们所知,我们一直在观察,我们一直致力于deep learning,致力于 AI。现代 AI 的大爆炸,我们就身处现场,我们推动这个领域发展已经有很长一段时间了。为什么是过去两年?过去两年发生了什么?

第一,ChatGPT 开启了 generative AI 时代。它不仅能够理解、感知并理解,还能够进行转化和生成。生成独特的内容。我向你们展示了 generative AI 与计算机图形学的融合,它让计算机图形变得栩栩如生。各位,世界上的每个人都应该使用 ChatGPT。ChatGPT 代表了 generative AI 的时代。

第二点,generative computing(生成式计算)与我们过去进行计算的方式相比,是不同的。Generative AI 是软件的一种能力,但它深刻改变了计算的方式。过去的计算是基于检索的,现在则是生成式的。

当我在谈论某些事情时,请记住这个想法,你会意识到为什么我们所做的一切将改变计算机的架构设计,改变计算机的供应方式,改变计算机的构建方式,以及计算本身的意义到底是什么。

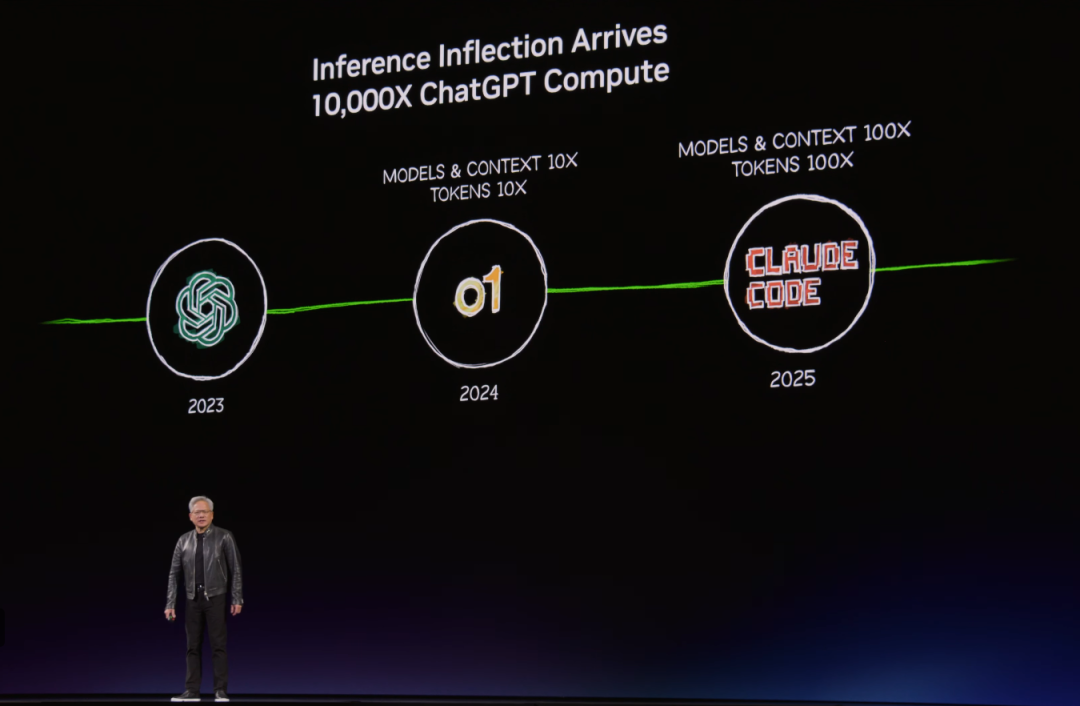

Generative AI, 2022 年底,2023 年。接下来,推理 AI,o1,随后的 o3 更是让它一飞冲天。推理使它能够反思,使它能够自我思考,使它能够计划,分解问题,并将它不理解的问题分解成它能理解的步骤或部分。它可以将自己扎根于研究之中。o1 使 generative AI 变得值得信赖并建立在事实之上。这使得 ChatGPT 直接起飞,这是一个非常非常重要的时刻。

为了生成内容所需的输入 tokens 数量,以及为了推理生成的输出 tokens 数量,模型变得稍微大了一些。当然,你可以拥有更大的模型。o1 模型稍微大了一点,但大不了多少。它用于语境的输入 token 用量和用于思考的输出 token 增加了极其庞大的计算量。

第三,是Claude Code,第一个agentic模型。它能够读取文件、编写代码、编译它、测试它、评估它,然后返回并对其进行迭代。如大家所知,Claude Code 彻底改变了软件工程。NVIDIA 100% 的人都在使用 Claude Code、Codex 和 Cursor 的其中之一,或者通常是这三者同时使用,这在 NVIDIA 内部随处可见。

今天,没有一个软件工程师不在一个或多个协助他们编写代码的 AI agents 的帮助下工作。Cloud Code 彻底带来了新的拐点。这是第一次,你不再问 AI 什么、在哪里、什么时候、怎么做。你要求它去创造、去执行、去构建。

你要求它使用工具,获取你的语境,阅读文件。它能够以代理(agentic)的方式分解问题,进行推理,进行反思。它能够解决问题并实际执行任务。一个能够感知的 AI 变成了一个能够生成的 AI。一个能够生成的 AI 变成了一个能够推理的 AI。一个能够推理的 AI 现在变成了一个可以实际工作、非常具有生产力的 AI。过去两年里的计算量,我们知道,这个房间里的每个人都知道,对NVIDIA GPU 的计算需求已经爆表了。

现货定价正在飙升。你就算想找也很难找到一颗 GPU,然而与此同时,我们正在不断出货 GPUs,数量惊人,而需求还在不断攀升。这背后是有原因的,那就是这种根本性的转变。最终,AI 能够从事生产性工作。

因此,推理的拐点已经到来。AI 的每一个环节,每当它需要思考,需要讲道理,需要执行,需要生成tokens 时,它都必须进行推理。现在早已经过了训练的阶段。现在是推理的领域。

推理的拐点已经到来。当时,tokens的数量、所需的计算量增加了大约 10,000 倍。现在,当我把这两个因素结合起来,即在过去两年里,工作的计算需求增长了10,000倍,而使用量可能增长了100 倍。大家听我说过,我相信在过去两年里,计算需求增长了 100 万倍。这是我们所有人的感受,这是每一家初创公司的感受。这是 OpenAI 的感受。这是 Anthropic 的感受。

如果他们能获得更多的算力,他们就能生成更多的 tokens,他们的收入就会上升,就会有更多的人使用它,AI 就会变得更高级、更聪明。我们现在正处于那种正向的飞轮系统中。我们已经到达了那个时刻。

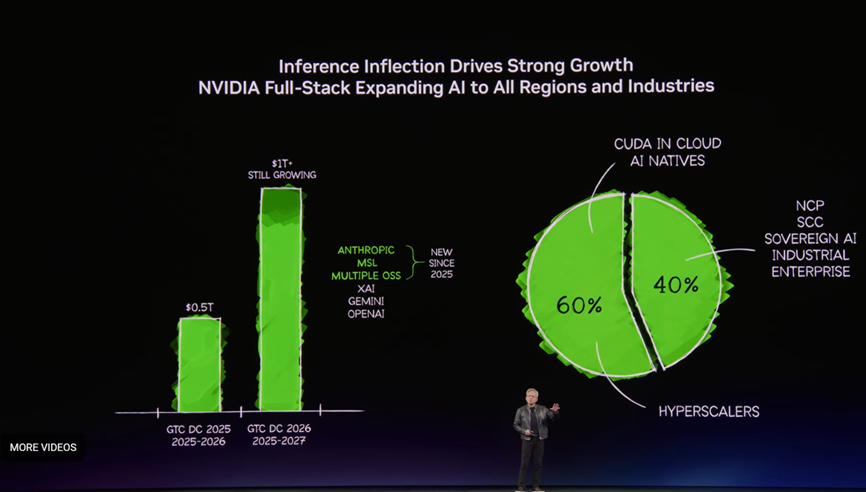

推理的拐点已经到来。去年这个时候,我说站在当时那个时间点上,我们看到了大约 5000 亿美元。我们看到了截至2026 年,对 Blackwell 和 Rubin 高达 5000 亿美元的高信心需求和采购订单。那是去年我说的。现在,我不知道你们是否有同感,但 5000 亿美元是一笔庞大的收入。没有人感到惊讶。我知道你们为什么不惊讶,因为你们都迎来了创纪录的一年。

那么,我在这里告诉你们,就在现在我所站的地方,在 GTCDC 之后的短短几个月,在去年 GTC 之后的一年,就在我所站的这里,我看到了截至 2027 年至少 1 万亿美元的需求。

那么,这有意义吗?这就是我接下来要讲的内容。事实上,我们甚至会供不应求。我敢肯定计算需求会远高于这个数字,这背后是有原因的。第一件事是,我们在过去的一年里做了很多工作。当然,如你们所知,2025 年是 NVIDIA 的推理之年。

我们想确保不仅在训练和后期训练方面表现出色,而且在 AI 的每个阶段都表现得极其出色。这样,对我们基础设施的投资就能随心所欲地扩展使用时长,并且 NVIDIA 基础设施的有用寿命会很长,从而使得成本极低——你使用它的时间越长,成本就越低。

在我心里毫无疑问,NVIDIA 的系统是你能在世界上获得成本最低的 AI 基础设施。

与此同时,作为一个整体,作为一个群体,这代表了全球 1/3 的 AI 计算量,开源模型已经逼近了前沿水平,而且它简直无处不在。

NVIDIA,如你所知,今天,我们是当今世界上唯一一个跨越每一个 AI 模型运行在每个 AI 领域的平台,无论是在语言和生物学、计算机图形学、计算机视觉、语音、蛋白质和化学物质、机器人技术或其他领域,边缘或云端,任何语言。NVIDIA 的架构对所有这些都是通用的,而且我们在所有这些方面都表现得不可思议。

这让我们成为成本最低、信心最高的平台,因为正如我提到的,当你构建这些系统时,1 万亿美元是极其庞大的基础设施。

你必须拥有绝对的信心,你投入的这 1 万亿美元将被充分利用,将具有高性能,将极具成本效益,并且在你能预见的未来里拥有使用寿命。你在 NVIDIA 上进行的基础设施投资,你可以带着十足的信心去进行。

它是世界上唯一的基础设施,让你可以走到世界任何地方,充满信心地进行构建。我们 60% 的业务来自hyperscalers(超大规模云服务商),排名前五的 hyperscalers。

然而,即使在这前 5 大 hyperscalers 内部,也有一些是内部的 AI 消耗。内部 AI 消耗,比如非常重要的 RecSys(推荐系统)正在从图表、协同过滤和内容过滤的 recommender systems 转变为 deep learning 和 large language models。搜索,正在转向 deep learning,large language models。几乎所有这些不同的hyperscale 工作负载现在都在转移,正在转向 NVIDIA GPUs 极其擅长的工作负载。

最重要的是,因为我们与每一个 AI 实验室合作,我们加速每一个 AI 模型,并且因为我们有一个庞大的 AI natives 生态系统与我们合作,我们可以把他们带到云端,因此,那笔投资无论有多大,无论有多快,算力都将被消耗掉。这占据了我们 60% 的业务。其余 40% 的业务遍布各地。

区域云、主权云、企业、工业、机器人、边缘、大型系统、超级计算系统、小型服务器、企业级服务器。系统的数量惊人。AI 的多样性也是它的韧性。AI 覆盖范围的广度就是它的韧性。毫无疑问,这不是一项单一应用的科技。这现在已经成为了基础。这绝对是一次新的计算平台转变。那么,我们的工作是继续推进技术,去年我提到的最重要的事情之一是我们的推理之年。我们倾注了一切。

人们过去常对我说,“ Jensen,推理太简单了。”

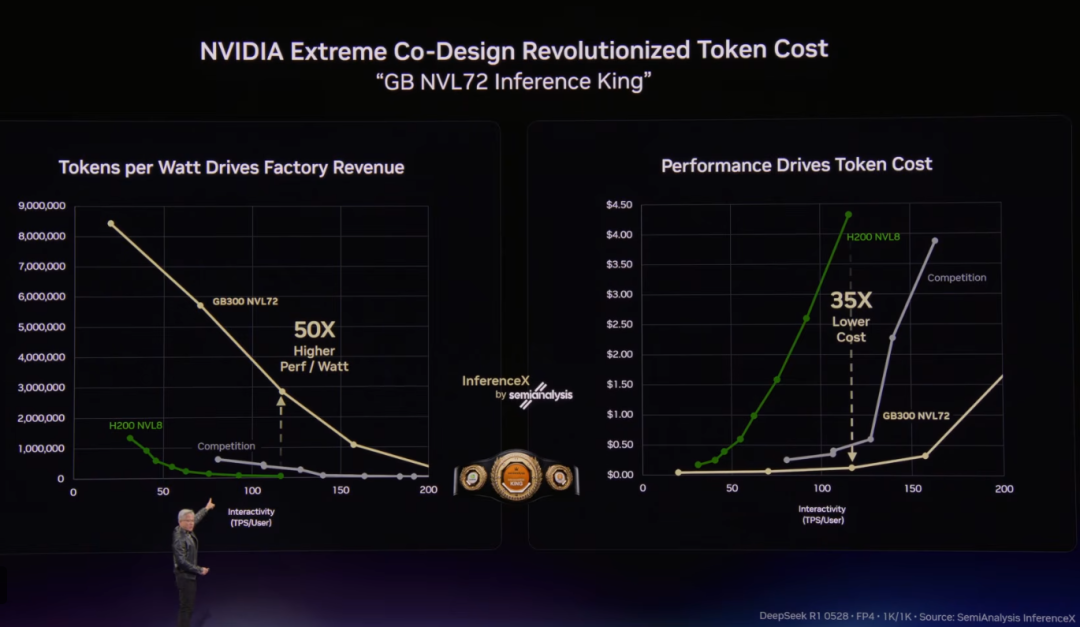

推理才是终极的难题。它也是终极重要的部分,因为它驱动着你的收入。这就是结果。这是来自 SemiAnalysis 的数据。

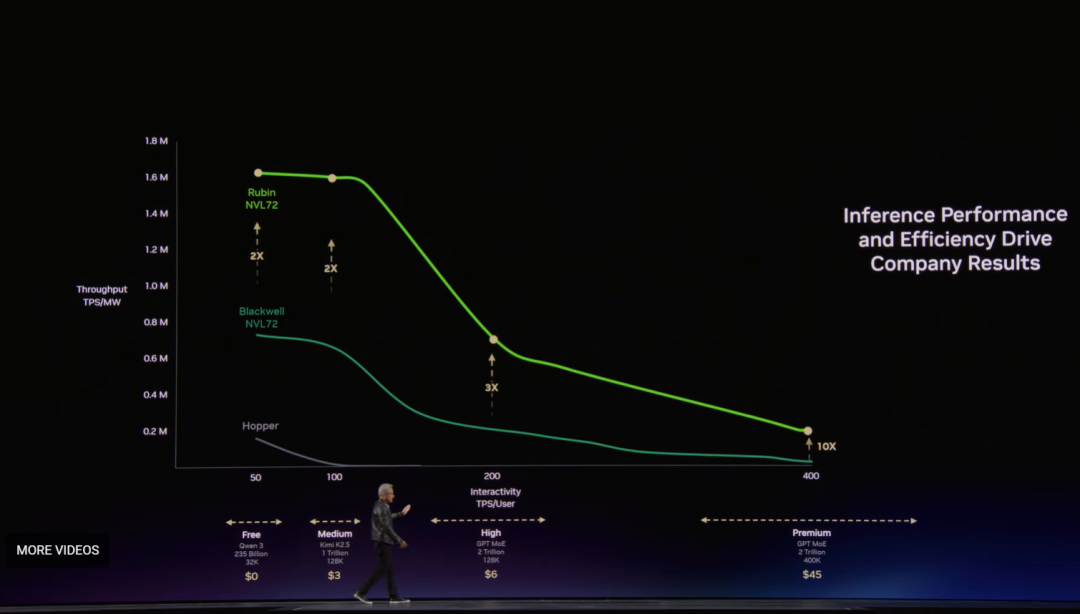

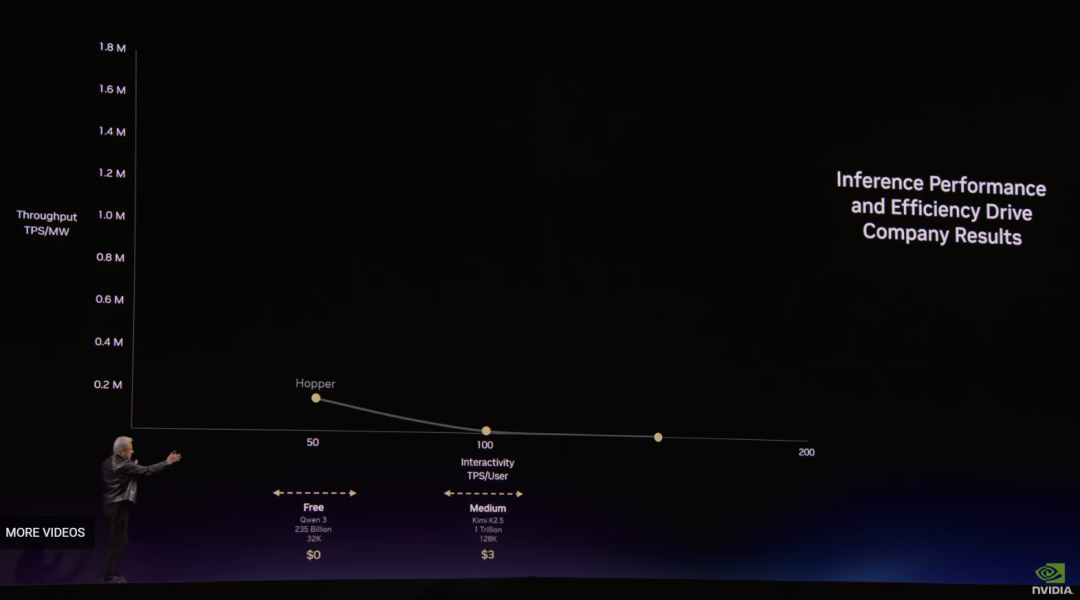

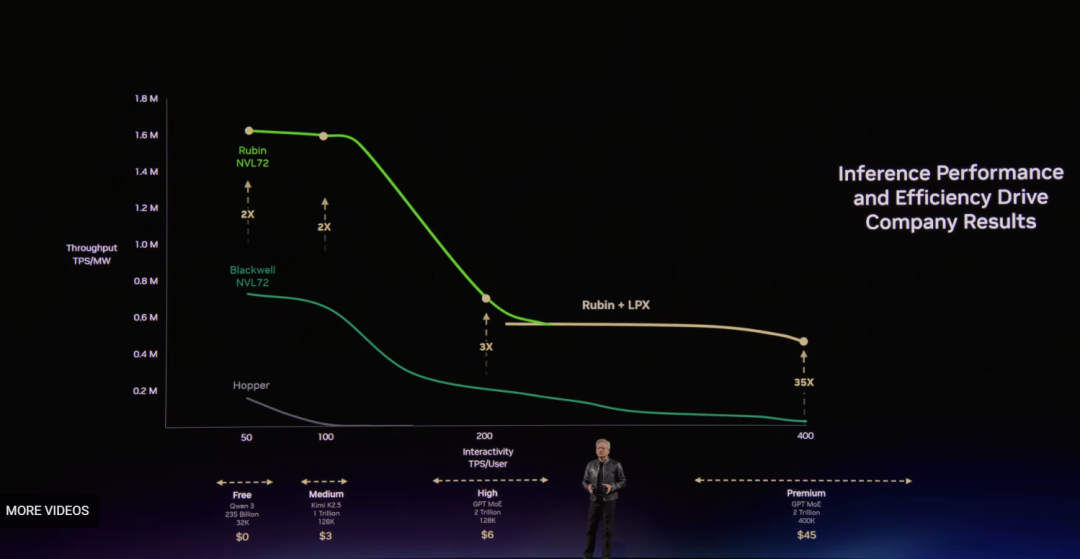

这是有史以来对 AI 推理进行的最大规模、最全面的扫描。你在这里左侧看到的,这一边是每瓦的tokens 数(tokens per watt)。每瓦 tokens 数很重要,因为每个数据中心,每个工厂,根据定义,都是受电力限制的。一个1 吉瓦的工厂永远不会变成 2 吉瓦。它受到物理规律的限制,原子的规律,物理的规律。

对于那个 1 吉瓦的数据中心,你希望驱动最大数量的 tokens,也就是那个工厂的产出、产品。你希望位于这条曲线的顶端,越高越好。这个,x轴是交互性,推理的速度,每次推理的速度。你的推理速度越快,当然,你的响应就越快。

但非常重要的一点是,你的推理速度越快,模型就越大,你可以处理的语境就越多,你可以思考的 tokens 就越多。

这个轴等同于 AI 的聪明程度。这就是 AI 的吞吐量。这是 AI 的聪明程度。注意,AI 越聪明,你的吞吐量就越低。这说得通。你思考的时间变长了,对吧?

这个轴是速度,我回头再来讲这个。这就是我折磨你们所有人的地方,但它太重要了。你看世界上的每一位 CEO,从现在起,世界上的每一位CEO 都会以我将要描述的方式研究他们的业务,因为这就是你们的 token 工厂。这就是你们的 AI 工厂。这就是你们的收入。这在未来是毫无疑问的,这就是吞吐量,这就是智能。在数据中心的给定功率下,每瓦的性能越好,吞吐量就越高,你能生产的 tokens 就越多。这一侧是成本。注意,NVIDIA 拥有世界上最高的性能。没有人会对此感到惊讶。

他们会惊讶的是,在一代产品中,而 Moore’s Law 如果通过晶体管来实现,通常只能给我们 50% 的提升,也就是翻倍的时间。Moore’s Law 大概能让我们获得 1.5 倍的性能。你原本预期从 Hopper H200 那里获得 1.5 倍的提升。没有人会预料到是 35 倍的提升。

去年这个时候我说过,NVIDIA 的 Grace Blackwell NVLink 72 的每瓦性能是之前的 35 倍。没有人相信我。后来 SemiAnalysis 发布了报告,Dylan Patel 说了一句话。他指责我有所保留(sandbagging)。他说,“Jensen 隐藏了实力,实际上是 50 倍。”他没说错。我们的单 token 成本是世界上最低的。你无法击败它。

我之前说过,如果你的架构是错误的,即使它是免费的,它也不够便宜。原因在于,无论发生什么,你仍然必须建立一个吉瓦的数据中心。你仍然必须建立一个吉瓦的工厂。那个吉瓦的工厂要在 15 年内摊销,那个吉瓦的工厂大约需要 400 亿美元。

即使你在里面什么都不放,也投入了 400 亿美元。你最好确保把最好的计算机系统放进去,这样你才能拥有最佳的 token 成本。NVIDIA 的 token 成本是世界级的,目前基本上是无法企及的。这之所以成真,是因为极致的协同设计(co-design)。我很高兴他称呼我们为 Monkey King,Token King。

我们整合了我们所有的软件和我们所有的技术,无论我们如何将它们打包并整合到世界上的推理服务提供商那里。这些公司正在飞速发展。他们正在飞速发展。Fireworks,Lin 在这里,他们一起正在以难以置信的速度增长。去年增长了 100 倍。他们是 token 工厂。这些工厂的有效性、性能和 token 成本生产能力对他们来说就是一切。这就是发生的事情。我们更新了他们的软件,在同一系统上,注意看他们的 token 速度。令人难以置信。

在 NVIDIA 更新一切之前,包含我们引入的所有算法、软件和所有技术之前,平均每秒约700 tokens,变成了将近 5000,高出了 7 倍。这就是极致协同设计不可思议的力量。

我之前提到了工厂的重要性,这就是工厂的重要性。你的数据中心,过去是用于存放文件的数据中心。现在它是生成 tokens 的工厂。无论如何,你的工厂容量是有限的。每个人都在寻找土地、电力和外壳。一旦你建好它,你就会受到电力限制。在那个受电力限制的基础设施内,你最好确保你的推理系统,因为你知道推理是你的工作负载,而 tokens 是你新的商品,这些算力是你的收入,所以你想确保架构得到尽可能优化。

在未来,每一个 CSP(云服务提供商),每一家计算机公司,每一家云公司,每一家 AI 公司,坦白说,每一家公司,都将考虑其 token 工厂的效率。这就是你未来的工厂。我之所以知道这一点,是因为这个房间里的每个人都受到智能的驱动。在未来,这种智能将得到 tokens 的增强。

04 谈硬件架构的重大突破与路线图

让我向你们展示我们是如何走到这一步的。

2016 年4 月6日,也就是十年前,我们推出了DGX-1,世界上第一台专为 deep learning 设计的计算机。8 块 Pascal GPUs ,通过第一代 NVLink 连接。一台计算机的算力达 170 万亿次浮点运算(teraflops),那是世界上第一台为 AI 研究人员设计的计算机。

Volta时期,我们引入了 NVLink Switch。16 块 GPUs 满配带宽全互联(all-to-all),就像一个巨大的 GPU 一样运行。这是向前迈出的一大步,但模型规模继续增长。因数据中心需要变成一个单一的计算单元,于是 Mellanox 加入了 NVIDIA。

2020 年,DGX A100 SuperPOD 成为第一台结合了scale-up(纵向扩展)和scale-out(横向扩展)架构的 GPU 超级计算机。NVLink 3 用于纵向扩展,ConnectX-6 和 Quantum InfiniBand 用于横向扩展。

接着是Hopper。第一款搭载了开启生成式AI时代的 FP8 Transformer 引擎的 GPU。NVLink 4,ConnectX-7,BlueField-3 DPUs,第二代 Quantum InfiniBand。它彻底改变了计算。

Blackwell用NVLink 72 重新定义了AI超级计算系统的架构。72块GPUs由NVLink 主干(Spine)连接。全互联带宽达到130 TB/s。计算托盘集成了 Blackwell GPUs、Grace CPUs、ConnectX-8 和 BlueField-3。通过 Spectrum-4 Ethernet 进行横向扩展运行。随着三大定律(预训练、后期训练和推理)全速推进,现在又迎来了智能体系统的出现,计算需求继续呈指数级增长。

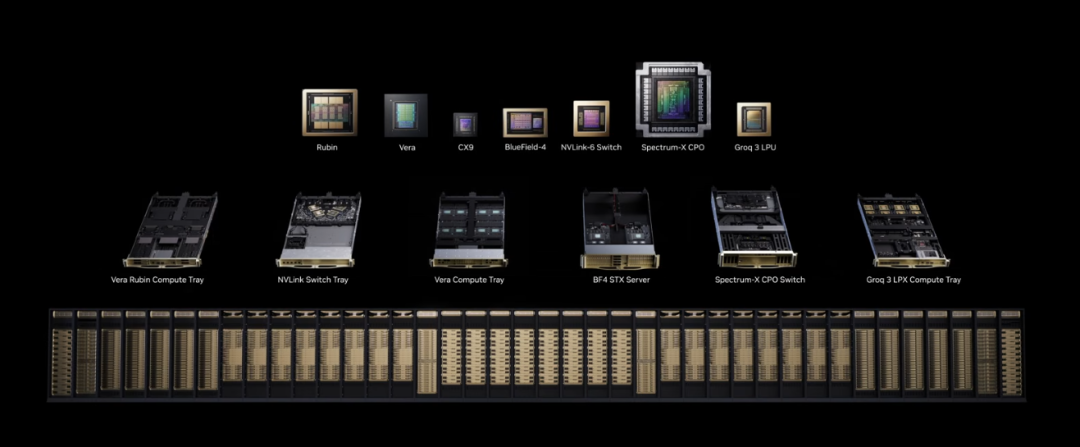

现在,Vera Rubin的架构,专门 agentic AI 的每个阶段架构设计,推动计算的每一个支柱发展,包括 CPU、存储、网络和安全。Vera Rubin NVLink 72,3.6 百亿亿次(exaflops)的算力,260 TB/s 的全互联 NVLink 带宽。为 agentic AI 时代注入超级动力的引擎,Vera CPU base(raft),专为编排和agentic 工作流设计。STX Rack,采用 BlueField-4 构建的 AI 原生存储,利用 Spectrum-X 共封装光学器件(co-packaged optics)进行横向扩展,从而提高能效和恢复力。

现在有一项令人难以置信的新加入,即Groq 3 LPX 机架。它紧密连接到 Vera Rubin,Groq 的 LPU 拥有庞大的片上 SRAM,为本已快得惊人的 Vera Rubin 加装了一个 token 加速器。加在一起,每兆瓦的吞吐量增加了 35 倍。这就是全新的 Vera Rubin 平台。7 种芯片,5 台机架级计算机,1 台专为 agentic AI 打造的革命性 AI 超级计算机。仅仅 10 年,算力就提升了 4000 万倍。

过去,当我说起 Hopper 时,我会举起一块芯片。那真可爱。而这是 Vera Rubin,当我们想到 Vera Rubin 时,我们想到的是整个系统。通过软件实现了彻底的垂直整合,端到端延伸,作为一个巨大的系统进行了优化。

它专为智能体系统设计,原因非常明确——对于 agents 而言,毫无疑问,最主要的工作负载就是让大语言模型进行思考。大语言模型将会变得越来越大,它将以更快的速度生成越来越多的 tokens,从而能够思考得更快。

但它也必须访问内存,那会对内存打来极大的压力,比如KV缓存、结构化数据(cuDF)、非结构化数据(cuVS)。它会对存储系统造成极其猛烈的冲击,这就是我们重新发明存储系统的原因。

它也将使用各种工具。与对慢速计算机有较高容忍度的人类不同,AI 希望这些工具越快越好。这些工具,比如网络浏览器。未来,它们也可能变成云端的虚拟 PC。这些 PC 和计算机必须尽可能快。我们创造了一款全新的 CPU。

这款全新的 CPU 专为极高的单线程性能、令人难以置信的高数据输出、极佳的数据处理能力以及极致的能源效率而设计。它是世界上唯一采用 LPDDR5 的数据中心 CPU,其无与伦比的单线程性能和每瓦性能表现出色。

我们打造它是为了让它与这些机架的其余部分配合,进行 agentic 处理。这就是 Vera Rubin 系统。

大家注意,自上次以来,它实现了 100% 液冷,所有的线缆也都不见了。以前需要两天才能安装完的设备,现在只需两小时,制造周期将大幅缩短。这同时也是一台由 45 摄氏度热水冷却的超级计算机,它减轻了数据中心的压力,省去了用于冷却数据中心的所有成本和能源,并将其全部供给系统使用。这就是我们的秘密武器。

我们是当今世界上唯一一家打造出第六代纵向扩展交换系统的公司。这不是以太网。也不是 InfiniBand,这是NVLink,这是第六代 NVLink。

坦白讲,仅仅是把它做出来就极其困难。我为这个团队感到超级自豪。NVLink,完全采用液冷技术。这是全新的 Groq 系统,稍后我会向你们展示更多相关内容。这个系统,包含 8 块 Groq 芯片,这就是 LP30。之前面世的都只是 V1 版本,这是第三代,而且我们现在已经进入量产阶段。等一下我会向大家展示更多相关信息。

世界首个 CPO Spectrum-X 交换机,这款产品也已全面投产。Co-packaged optics(共封装光学),光学器件直接连接到这块芯片上,与硅片直接接口。电子转化为光子,直接与这块芯片相连。我们与 TSMC 共同发明了这项工艺技术。我们是目前唯一将其投入量产的公司。它被称为CPO。这是彻底革命性的技术。NVIDIA 的 Spectrum-X 已全面投产。

这是 Vera 系统,其每瓦性能是当今世界上任何 CPUs 的两倍,它也已经投产了。你知道,我们之前从未想过我们会单独销售 CPUs。而现在我们正在单独销售大量的 CPU。毫无疑问,这已经成为我们一项价值数十亿美元的业务。所以我对我们的CPU 架构师感到非常满意。我们设计出了一款具有革命性的 CPU。这是由 Vera CPU 驱动的 ConnectX-9,BlueField-4 STX,我们全新的存储平台。

这些是机架,而且它们是连接在一起的,这正是 NVLink 机架。我以前给你们看过这个。它超级重,而且感觉每年都在变重。因为我认为每年里面的线缆都在增加。这就是 NVLink 机架。由于这项技术效率极高,我们还利用这些布线系统、结构化电缆来创建数据中心。

我们决定将其用在以太网上。这是一个包含 256 个液冷节点的以太网机架,并且它也通过这些令人难以置信的连接器连接在一起。你们想看看Rubin Ultra 吗?这就是 Rubin Ultra 计算节点。

不同于水平插入的 Rubin,Rubin Ultra 放入的是一个全新的机架中。它叫做 Kyber,使我们能够在一个 NVLink 域内连接 144 个 GPUs。Kyber 机架,这个我肯定能举起来,但我不会这么做。它很重。这是一个计算节点,它垂直滑入 Kyber 机架。它就是连接在这里的,这是中板(midplane)。Kyber 机架顶部的那四个NVLink 连接器滑入并与之连接,这就成了其中一个节点。这些机架中的每一个都是不同的计算节点,接下来是令人惊叹的部分。

这就是中板,而在中板的背面,取代了由于铜缆传输距离限制而存在局限的线缆系统,我们现在有了这个系统来连接 144 个 GPUs。这就是新型的 NVLink。它同样垂直放置,并连接到背面的中板上。前面是计算单元,背面是NVLink 交换机,共同组成了一台巨型计算机。明白了吗?这就是 Rubin Ultra。

你知道,只有在 NVIDIA 的主题演讲中,你才会看到去年的幻灯片再次被展示。之所以这么做,我只想让大家知道,去年我告诉过你们一件非常、非常重要的事情,因为它太重要了,所以值得再告诉你们一次。

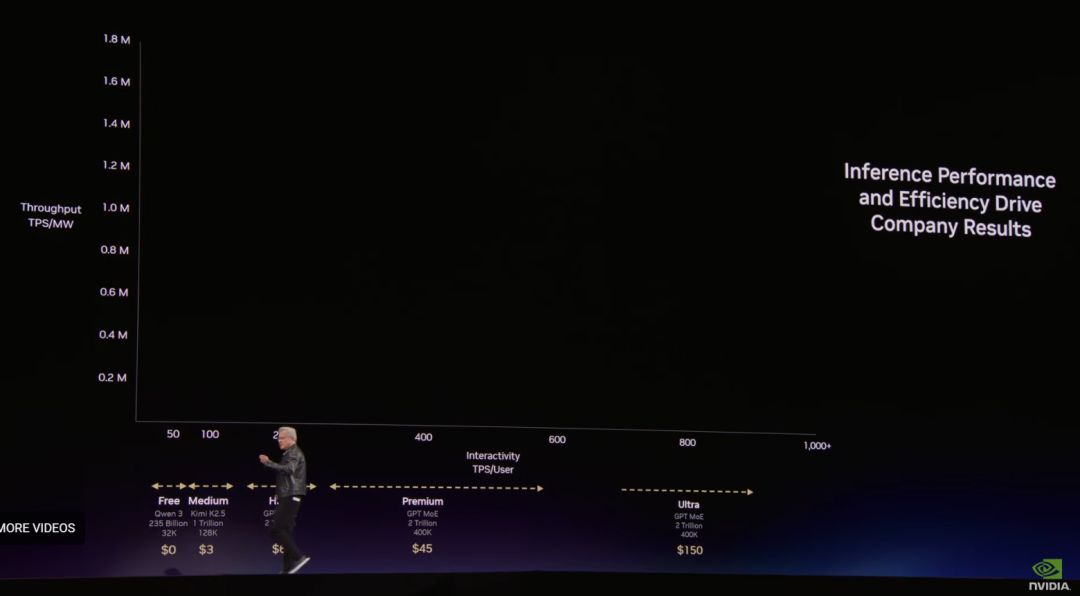

这可能是未来AI工厂最重要的一张图表,世界上每一位 CEO 都会追踪它,并深入研究它。实际情况比这要复杂和多维,但你们将研究各自AI工厂的吞吐量和 token 速度。

也就是谁,在恒定功耗条件下的吞吐量 token 速度,这就是你所拥有的全部电力,你的工厂在未来的吞吐量和 token 速度。这项分析将直接转化为你的收入。你今年所做的,将准确无误地体现在明年的收入中,而这张图表说明了一切。刚才,我说过纵轴是吞吐量,横轴是 token 生成率。

今天,我要给你们看这个。因为我们现在有能力提高 token 的速度,同时也因为模型规模在不断增加,取决于不同应用场景不同等级的需要,token的长度、语境的长度,不断从10 万个 token 的输入长度增长到数百万个。输入的 token 长度在增长,输出的 token 长度也在增长。所有这些最终都会影响未来 tokens 的营销和定价。

Tokens 是新的商品,就像所有的商品一样,一旦它到达一个拐点,一旦它成熟或正在走向成熟,它就会细分为不同的部分。高吞吐量、低速度的可以作为免费层(free tier)使用。下一层可能是中级层。也许是更大的模型,肯定是更高的速度,更长的输入语境长度,这会转化为不同的价格点。你可以从所有这些不同的服务中看到,这个是免费的。它是一个免费层。第一层可能是每百万 tokens 3 美元。下一层可能是每百万 tokens 6 美元。

你希望能够不断推动这个边界,因为模型越大越聪明,输入 token 的语境长度越长,相关性就越强。速度越快,你就能思考和迭代得越多,AI 模型也就越聪明。这关乎于更聪明的 AI 模型。

当你拥有更聪明的 AI 模型时,这里的每一次升级都允许你提高价格。这是 45 美元,也许有一天会有一个高级模型,允许你提供一项高级服务,提供极高的token 生成速度,因为你处于关键路径上,或者你正在进行一项非常长期的研究,那么每百万 tokens 150 美元根本不算什么事。让我们算算看。假设你作为一名研究人员每天使用 5000 万个 tokens,按每百万 tokens 150 美元计算。

事实证明,作为一个研究团队,这点钱根本不算什么。我们相信这就是未来。这就是 AI 想要发展的方向。这就是它今天的现状。它必须从这里开始建立其价值和实用性,并且变得越来越好。在未来,你将看到大多数服务涵盖所有这些层级。

这是 Hopper。Hopper 从这里开始,然后我移动了图表。

这是50,这是100。Hopper看起来像这样,你原本会期望 Hopper 的下一代产品比它高,但没有人会想到它会高出这么多。这就是 Grace Blackwell。Grace Blackwell 所做的是,在你的免费层,极大地提高了你的吞吐量。然而,在你主要盈利的服务层,它将你的吞吐量提高了 35 倍。

这与世界上任何公司生产的任何产品没有什么不同。层级越高,质量越高,性能越高,产量越低,产能越低,所以这与世界上任何其他业务没有什么不同。现在我们能够把这个层级提升 35 倍,并且我们引入了一个全新的层级。这就是 Grace Blackwell 带来的好处,相对 Hopper 是一个巨大的飞跃。

那么,这是我们在 Grace Blackwell 上所做的事情。好的,这就是 Grace Blackwell。现在想想刚才发生了什么。在每一个层级,我们都提高了吞吐量。在你平均售价(ASP)最高、最具价值的细分市场,我们将它提高了 10 倍。

那就是最艰难的工作。在这个区域实现这一点是极其困难的。这就是NVLink 72 带来的好处。这就是极低延迟带来的好处。这就是极致协同设计带来的好处,让我们能够将整个区域向上推移。

那么,从客户的角度来看,最终这意味着什么?假设我拿 25% 的电力用于免费层,25% 的电力用于中级层,25% 的电力用于高级层,最后 25% 的电力用于白金级/尊享层。我的数据中心只有一吉瓦,所以我得自己决定如何分配。免费层让我能吸引更多客户,而尊享层让我能服务于最有价值的客户。

所有这些的结合、这些要素的乘积,从根本上决定了你的收入,你可以产生的收入,在这个简化的例子中,Blackwell 能够创造 5 倍的收入,Vera Rubin 能够创造 5 倍的收入。是的,你应该尽快部署 Vera Rubin,原因在于你生产 tokens 的成本下降了,而你的吞吐量上升了。

正如我告诉你们的,这种吞吐量需要海量的浮点运算(flops)。这种延迟,这种交互性需要极大的带宽。计算机并不喜欢极高的浮点运算和极大的带宽同时存在,因为任何系统的芯片表面积都是有限的。

对高吞吐量进行优化和对低延迟进行优化,实际上是一对死敌。当我们与Groq 结合时,情况就变成了这样,明白吗?我们收购了研发 Groq 芯片的团队并获得了技术授权,现在我们正携手整合这个系统。它看起来就像这样。在这个最具价值的层级上,我们现在要把性能提升 35 倍。

现在,这张简单的图表向你揭示了,为什么 NVIDIA 迄今为止在绝大部分工作负载中如此强大。原因在于,在上面这个区域,吞吐量极其重要。NVLink 72 是如此具有颠覆性,它正是最正确的架构,即使在你加入 Groq 之后,也很难打败它。

然而,如果你把这张图表延伸到很远的地方,并且你说你想要拥有一项服务,它不仅能每秒提供400个tokens,而是每秒提供1000个tokens,突然之间,NVLink 72就会耗尽所有动力,它就是达不到那个目标。我们就是没有足够的带宽。这正是Groq 的用武之地,当我们把边界向外推时,这就是所发生的事情。它超出了 NVLink 72能力的极限。

如果你这样做,把它转化为相对于 Blackwell 的收入,Vera Rubin 是 5 倍。如果你绝大多数的工作负载是高吞吐量的,我建议你坚持 100% 使用 Vera Rubin。如果你有很多工作负载是需要编写代码和生成具有极高价值的工程 token,我就会把 Groq 加进去。

我可能会在数据中心总量的约 25% 中加入 Groq。我数据中心的其余部分 100% 都是 Vera Rubin。这让你了解了如何将 Groq 加入到 Vera Rubin 中,以进一步扩展其性能和价值。这正是发生的事情。这是一个对比。

Groq 之所以对我如此有吸引力,是因为他们的计算系统,一种确定性的数据流处理器,它是静态编译的,由编译器调度的,意思是编译器能计算出何时进行计算,数据和计算任务同时到达。所有这些都是提前静态完成并在软件中完全调度好的。不存在动态调度。该架构在设计上拥有海量的 SRAM。它专为推理而设计,就针对这一种工作负载。

现在,正如事实证明的,这单一的工作负载,正是 AI factories 的核心工作负载。随着世界不断渴望利用超级聪明的 tokens 生成高速的 tokens,这种整合的价值将会变得越来越高。你们可以看到,这是两款走向极端的处理器。

一颗芯片,500 MB(指Groq)。一颗 Vera Rubin 芯片,一颗 Rubin 芯片,288 GB。你需要数量庞大的 Groq 芯片才能装下 Rubin 级别的参数规模,以及随之而来的所有上下文环境,即必须配套的 KV cache。这限制了 Groq 真正走向主流、真正起飞的能力,直到我们有了一个伟大的主意。如果我们将一款名为 Dynamo 的软件与推理完全解耦会怎样?

如果我们在流水线中重构推理的进行方式,将最适合在 Vera Rubin 上运行的任务交给它,然后把面临延迟要求低、受限于带宽挑战的 decode生成任务卸载给 Groq 会怎样?我们将两款截然不同的处理器合二为一,一款用于高吞吐量,一款用于低延迟。这仍然改变不了一个事实,那就是我们需要大量的内存。关于 Groq,我们只需要加入一大堆Groq 芯片,从而扩展它的内存容量。大家可以想象一下,对于一个万亿参数的模型,我们必须把所有参数都存储在 Groq 芯片中。

然而,它紧挨着 NVIDIA Vera Rubin,在这里我们可以容纳处理所有这些 agentic AI 系统所必需的海量 KV cache。它就是基于这个分解推理的想法。我们进行 prefill(预填充),那是简单的部分,但我们也紧密整合了 decode(解码)。

Decode 中的 attention(注意力机制)部分在 NVIDIA 的 Vera Rubin 上完成,这部分需要大量的数学运算,而前馈网络(feed forward network)部分,即 decode 部分,token 的生成部分则在 Groq 芯片上完成。这两者在今天的 Ethernet 上紧密耦合地协同工作,采用一种特殊的模式将其延迟降低约一半。这种能力让我们得以将这两个系统整合在一起。

我们在其上运行了 Dynamo,这是一款专为 AI factories 打造的不可思议的操作系统,然后你获得了 35 倍的性能提升。35 倍的提升,更不用说在 token 生成方面为推理性能开辟了世界从未见过的新层级。

就是这个,这是 Groq。Vera Rubin 系统,包括 Groq,我要感谢 Samsung(三星),他们为我们制造了 Groq LP30 芯片,他们正开足马力拼命生产。我真的非常感谢你们。我们的 Groq 芯片已经投产,正如大家所知,我们将在下半年发货,大概在第三季度左右。Vera Rubin,大家知道,很难想象还有更多的客户了。

真正棒的是,Grace Blackwell 的早期样品测试因为整合了 NVLink 72 变得非常复杂,但 Vera Rubin 的样品测试进展得非常顺利。事实上,我想 Satya 已经发信息告诉我,第一台 Vera Rubin 机架已经在 Microsoft Azure 上启动并运行了,所以我为他们感到超级兴奋。我们将继续大量生产这些设备。

我们现在已经建立了一个供应链,可以每周生产数以千计的这种系统,本质上相当于在我们的供应链内部每月生产数吉瓦的 AI factories。我们将在全力生产 GB300 机架的同时,源源不断地生产这些 Vera Rubin 机架。我们已经全面投产。Vera CPUs 取得了令人难以置信的成功。

原因在于 AI 在使用工具时需要 CPUs,而 Vera CPU 的设计完美契合了这一黄金位置(sweet spot)。对于下一代数据处理来说,它不可思议的棒。Vera CPU 是理想的选择。Vera CPU 加上 CX9 连接到 BlueField-4 堆栈。全球 100% 的存储行业都在与我们一起加入这个系统。原因在于他们看到了完全相同的情况。存储系统将会受到猛烈冲击。它会受到猛烈冲击是因为我们过去是由人类使用存储系统,我们过去是由人类使用 SQL。现在我们要让 AIs 来使用这些存储系统,它将存储 cuDF 加速存储内容、cuVS 加速存储内容,以及非常重要的,KV caching。这就是Vera Rubin 系统。现在,令人惊叹的是这个。

在短短两年时间里,在一个 1 吉瓦的工厂中,利用我刚才向你们展示的数学计算,原本 Moore’s Law 可能只会带给我们几个小步幅的进步,我们本可以让晶体管数量翻倍,本可以让浮点运算数翻倍,本可以让带宽容量翻倍。但借助于这种架构,我们将把我们的 token 生成速度、token 生成率从 200 万提升到 7 亿,这是 350 倍的飞跃。这就是极致协同设计的力量。这就是我所说的我们在垂直层面进行整合与优化,然后在水平层面面向所有人开放的含义,让每个人都能享受到红利。这是我们的路线图。

我们始终保持向后兼容,因此如果你不想做任何更改,只想继续使用新架构,你完全可以做到。标准的机架系统,Oberon,依然可用。Oberon 是基于铜线的 scale-up(纵向扩展),并且通过 Oberon,我们还可以使用光学 scale-up 将连接扩展到 NVLink 576。明白了吗?关于 NVIDIA 将使用铜线 scale-up 还是光学 scale-up 有很多讨论?我们两者都会做。我们将提供采用 Kyber 机架的 NVLink 144,然后使用 Oberon 机架,我们将提供 NVLink 72 加上光学连接,以达到 NVLink 576。Rubin 的下一代产品配备了 Rubin Ultra,我们即将推出 Rubin Ultra 芯片,目前正在流片阶段,并且我们还有一款全新芯片,LP35。

LP35 ,将首次集成 NVIDIA 的 NVFP4 计算结构,为你带来又一个数倍的 X 因子速度提升。明白了吗?这就是 Oberon,NVLink 72,光学 scale-up,并且它使用了 Spectrum-6,世界上首个共封装光学系统(co-packaged optical),所有这些都已投产。由此往后的下一代是Feynman。

Feynman 显然有一款新的 GPU。它还拥有一款新的 LPU,LP40。这是很大的一步跨越。令人难以置信的新技术。现在融合了 NVIDIA 的规模以及携手打造的 Groq 团队,这就是 LP40。它将不可思议。一款名为 Rosa 的全新 CPU,它是 Rosalind 的缩写。BlueField-5,它将下一代 CPU 与下一代 SuperNIC(超级网卡)CX10 连接起来。我们将提供 Kyber,也就是基于铜线的 scale-up。我们也将提供 Kyber 的 CPO scale-up。我们将破天荒第一次同时采用铜线和共封装光学技术(co-packaged optics)进行 scale up。

很多人一直在问,“Jensen,铜线还会重要吗?”答案是肯定的。“Jensen,你会用光学进行 scale up 吗?”会的。“你会用光学进行 scale out 吗?”会的。

对于我们生态系统中的每一个人来说,我们需要更多的容量,这才是真正的关键。我们需要用于铜线的更多容量。我们需要用于光学的更多容量。我们需要用于 CPO 的更多容量,这就是我们一直与大家合作,为这种程度的增长奠定基础的原因。Feynman 将拥有这一切。让我看看我有没有遗漏什么。就是这些。每一年,都有全新的架构。

05 谈数字孪生与NVIDIA DSX平台,“榨干”每一瓦电

NVIDIA 正在飞速地英伟达从一家芯片公司变成了一家AI工厂公司,或者说 AI 基础设施公司、AI 计算公司,打造这些系统,而现在我们正在构建完整的AI工厂。

在这些AI工厂中有太多的能源被浪费了。我们想要确保这些AI工厂以最佳的方式组合和设计在一起。过去,这里的多数组件彼此之间毫无交集。而在座的我们大多是技术供应商,现在我们彼此都认识了,但在过去,直到进了数据中心我们才碰面。这种事绝不能发生。

我们正在构建极其复杂的系统,所以我们必须在其他地方以虚拟的方式会面。所以,我们创造了Omniverse和Omniverse DSX世界——一个让大家都能聚集在一起,在系统中通过虚拟方式设计这些千兆瓦级的工厂,这些千兆瓦级的工厂AI平台。

我们拥有在机械、热力学、电气和网络方面的机架模拟系统。这些模拟系统集成到了我们生态系统合作伙伴令人难以置信的工具软件中。我们在运行时还连接到了电网,这样我们就可以互相交互,互相发送信息,以便我们能够相应地调整电网电力和数据中心电力,从而节约能源。

在数据中心内部使用 Max-Q 技术,这样我们就可以跨电力、冷却系统以及我们共同研发的所有不同技术,动态地调整系统,从而确保我们不浪费一丝电力,让我们以最优化的速率运行,从而提供海量的 token 吞吐量。在我的心里毫无疑问,这里面潜藏着两倍(的提升空间),而在我们所讨论的这种规模下,两倍的意义是极其巨大的。

我们将其称为 NVIDIA DSX 平台,并且就像我们所有的平台一样,它有硬件层,有库层,还有生态系统层。运作方式完全一样。

Omniverse 的初衷是为了承载世界的数字孪生,从地球开始,它将承载各种规模的数字孪生。我们拥有极其出色的合作伙伴生态系统。我想感谢你们所有人。所有这些公司对我们的世界来说都是全新的面孔。仅仅在几年前,我们还不认识你们当中的许多人,而现在我们紧密合作,共同努力建造世界上前所未有的最庞大的计算机,并且要在行星的尺度上实现这一目标。

NVIDIA DSX 是我们全新的 AI工厂平台。我这次只会花很少的时间谈论这个。然而,我们正在进军太空。我们已经进入了太空,Thor 已经通过了防辐射认证,并且我们正搭载在卫星上。你将在卫星上进行成像处理。

未来,我们还将在太空中建造数据中心。显然,这样做非常复杂。我们正与我们的合作伙伴合作研发一款名为Vera Rubin Space One 的新计算机,它将进入太空并开始在那里建立数据中心。现在,当然,在太空中没有传导,没有对流,只有辐射。我们必须弄清楚如何在太空中冷却这些系统,但我们已经有许多优秀的工程师在研究这个问题了。

06 谈OpenClaw引发的软件界大地震

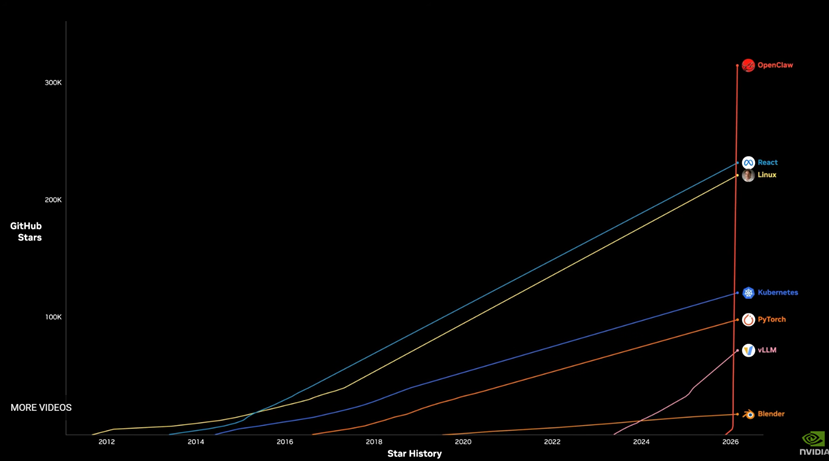

Peter Steinberger (彼得·斯坦伯格)就在现场,他编写了OpenClaw。我不知道他是否意识到了它将会取得多大的成功,但它的重要性是极其深远的。OpenClaw 是人类历史上排名第一、最受欢迎的开源项目,它在短短几周内就实现了这一壮举,它超越了 Linux 在 30 年内所取得的成就。

让我快速给大家演示一下。我想给你们展示两样东西。你只要简单输入这个。你把它输入到控制台,它就会运行,找到 OpenClaw,下载它并为你构建一个 AI agent,然后你可以告诉它任何你需要它做的事情。

不可思议。刚才我以大家都能理解的方式,直观地演示了什么是OpenClaw,但让我们想一想究竟发生了什么。

什么是 OpenClaw?

它是连接件,它是一个智能体系统。它调用并连接到大语言模型。首先它拥有它所管理的资源,它可以访问工具,可以访问文件系统,还可以访问大语言模型。它能做调度安排。它能运行定时任务(cron jobs)。它能够把你给它的 prompt 分解成一步步的操作。它可以衍生并调用其他次级 agents。它拥有 IO 接口。你可以用任何模态与它对话。你可以向它挥手,它就能理解你。你可以用任何你想要的模态与它交谈。它会发信息给你,给你发短信,发电子邮件。

它有输入输出(I/O)。基于这一点,你可能会说,实际上,它就是一个操作系统。我刚才用来描述它的语句,就和我描述一个操作系统用的语句一模一样。OpenClaw 本质上就是开源了 agentic computers 的操作系统。这与 Windows 让我们得以创造出个人电脑没有什么不同。现在,OpenClaw 让我们得以创造出个人智能体(personal agents)。其影响是不可思议的。

首先,它的采纳速度本身就说明了问题。然而,最重要的事情是这个——现在的每一家公司,每一家软件公司,每一家技术公司,对于这些公司的 CEOs 来说,他们面临的问题是,“你的 OpenClaw 战略是什么?”

就像我们都需要有一个 Linux 战略一样,我们过去都需要有一个 HTTP、HTML 战略,它开启了互联网时代。我们都需要有一个 Kubernetes 战略,它使得移动云成为可能。当今世界上的每一家公司都需要有一个 OpenClaw 战略,一个智能体系统战略。

接下来才是激动人心的部分。这就是拥有 OpenClaw 之前的企业 IT,你们知道吗?我之前提到了企业 IT 的工作方式,之所以把它们称为数据中心,是因为这些大房间、大楼里保存着数据,保存着人们的文件,保存着商业运作的 structured data。

它会经过包含工具的软件,你知道,包含记录系统以及所有这些被编纂进软件的工作流,然后这些就变成了供人类使用、供数字工作者使用的工具。那就是旧的 IT 产业,软件公司创建工具,保存文件,当然还有 GSI 的顾问们来帮助公司弄清楚如何使用和集成这些工具。这些工具在管理、安全、隐私和合规性方面极具价值,而所有这些在今天依然是真理。

只不过,在后OpenClaw时代,在后agentic时代,它将会变成这副模样。这就是非同寻常的部分。每一家IT公司,每一家公司,每一家SaaS公司,每一家SaaS公司都将成为一家AaaS公司。这一点毫无疑问。每一家SaaS公司都将成为一家AaaS公司,一家agentic as a service(代理即服务)公司。

令人惊叹的是:大家知道,OpenClaw 在最恰当的时机给了整个行业最需要的东西。就像 Linux 在最恰当的时机给了整个行业最需要的东西一样,就像 Kubernetes 在最恰当的时机出现一样,就像 HTML 的出现一样。它使整个行业能够抓住这个开源软件栈去做点什么。

只是有一个问题。公司网络中的智能体系统可能会访问敏感信息,它可能执行代码,并且可能向外部通信。仔细想想。访问敏感信息,执行代码,向外部通信。当然,你可以访问员工信息,访问财务信息、敏感信息,并把它发送出去,向外部通信。显然,这绝对不能被允许。

我们所做的是与 Peter 合作。我们召集了世界上最顶尖的安全和计算专家,与 Peter 合作,让 OpenClaw 具备保障企业级安全和企业级隐私的能力。我们将其称为 NemoClaw——它包含了所有这些 agentic AI 工具包,其中第一部分就是我们称为 OpenShell 的技术,它现在已经被整合到了 OpenClaw 中。

现在它已经具备了企业级就绪(enterprise-ready)能力。这个包含我们称为 NemoClaw 的参考设计的技术栈,明白吗?

有了名为 NemoClaw 的参考栈,你就可以下载它,体验它,你可以将世界上所有 SaaS 公司的策略引擎连接到它上面,而你们的策略引擎极其重要,极具价值。

NemoClaw或者搭载OpenShell的OpenClaw将能够执行那个策略引擎。它有网络护栏,它有隐私路由器,这样一来,我们就可以保护并阻止爪子(claws,指代agents)在我们的公司内部执行危险操作,并且安全地运行。

我们还在智能体系统中添加了一些功能,你想对你自己定制的爪子做的最重要的一件事,就是让你可以拥有你的定制模型,这就是NVIDIA的Open Model Initiative。我们现在处于每个AI模型领域的前沿,无论是在Nemotron、Cosmos world foundation model、Groot、通用人工智能机器人、人形机器人模型,用于自动驾驶车辆的Alpamayo,用于数字生物学的BioNeMo,还是用于 AI 物理的 Earth-2。我们在每一个领域都处于前沿。

以下为视频内容:世界是多样的。没有哪个单一的模型能够服务于所有的行业。Open Models 是世界上最大、最多样化的AI 生态系统之一。近 300 万个跨越语言、视觉、生物、物理和自主系统的开放模型,使专业领域的 AI 构建成为可能。NVIDIA 是开源 AI 的最大贡献者之一,我们构建并发布了六个系列的开放前沿模型,外加训练数据、配方和框架,以帮助开发者定制和采用。每个系列都有霸榜的新模型发布。处于核心的是 Nemotron,用于语言、视觉理解、RAG、安全和语音的推理模型。

Groot,通用机器人的foundation models。BioNeMo,用于生物学、化学和分子设计的开放模型。Earth-2,根植于 AI 物理学的用于天气和气候预测的模型。NVIDIA 的开放模型为研究人员和开发人员提供了为他们自己的专业领域构建和部署 AI的基础。我们的模型对你们所有人都有价值,因为第一,它位居排行榜榜首,它是世界级的。最重要的是,我们绝不会放弃在这上面继续努力。我们将日复一日地继续开发它。

Nemotron-3 之后将会有 Nemotron-4。Cosmos-1 之后是 Cosmos-2。Groot 将进化到第二代。所有这其中的每一个,我们将继续推进这些模型。垂直整合,横向开放,以便我们能够让每个人都加入这场 AI 革命。

在研究、语音和 world models、人工通用机器人、自动驾驶汽车以及推理等方面位居排行榜榜首,当然,其中最重要的一项是,这是在 OpenClaw 中的 Nemotron-3,看看前 3 名,它们是世界上最好的 3 个模型。我们处于前沿。而且,我们确实想创建基础模型,这样你们所有人都可以对其进行 fine-tune(微调)和 post-train(后期训练),使之成为你们所需要的那种智能。这是 Nemotron-3 Ultra。它将成为世界上曾被创造出的最优秀的 base model(基础模型)。这使得我们能够帮助每个国家建立他们的 sovereign AI(主权AI),我们正在与外面的许许多多不同的公司合作。

我们今天正在做的,也是我今天正在宣布的最令人兴奋的事情之一,是一个Nemotron 联盟。我们对此非常专注,已经在 AI 基础设施上投资了数十亿美元。这样我们就可以开发 AI 所必需的核心引擎,包括用于推理的所有库等等,而且还创建激活世界上每一个行业所需的 AI 模型。大语言模型确实非常重要。人类智能怎么可能不重要呢?然而,在世界上的不同行业中,在世界上的不同国家里,你需要具备定制自己模型的能力,而这些模型涉及的领域截然不同,从生物学到物理学,到自动驾驶汽车,到通用机器人,当然,再到人类语言。

我们有能力与每一个地区合作,创建属于他们特定领域的、他们的sovereign AI。

这是一次重塑,这是企业 IT 的一场文艺复兴。这个原本规模达 2 万亿美元的产业,将变成一个价值数万亿美元的产业,不仅仅提供给人们使用的工具,而是提供深耕于你们所擅长的特定领域的 agents,我们可以租用这些 agents。我可以完全想象在未来,我们公司的每一位工程师都需要一笔年度 token 预算,他们每年的底薪会是几十万美元。

在那基础之上,我很可能会额外提供一半的价值作为 tokens 给他们,这样他们的产出就能被放大 10 倍。我们当然会这样做,它现在已经成为了硅谷招聘的筹码之一。我的工作附带多少 tokens?其原因非常明显,因为每个能使用 tokens 的工程师都将更具生产力。

大家知道,这些 tokens 将由AI工厂生产出来,那是我们与你们所有人合作建立的,明白吗?当今的每家企业级公司都建立在文件系统和数据中心之上。未来的每家软件公司都将是 agentic 的,他们将成为 token 制造商。他们将成为其工程师的 token 用户,并且他们将成为他们所有客户的 token 制造商。

OpenClaw 这一事件的影响怎么强调都不为过。这绝不亚于 HTML 的重要性。这绝不亚于Linux 的重要性。我们现在拥有了一个世界级的开放 agentic 框架,我们所有人都可以使用它来构建我们的 OpenClaw 战略。我们创建了一个我们称之为 NemoClaw 的参考设计,供你们所有人使用,它经过了优化,性能卓越,并且安全可靠。

07 谈物理 AI 与机器人

说到 agents,你们知道,它们会感知、推理和执行。我刚才谈到的世界上绝大多数agents 都是 digital agents。它们在数字世界里行动。它们进行推理,它们编写软件。一切都是数字化的。但很长一段时间,我们也一直致力于研发具有物理实体的 agents。我们称之为机器人,而它们需要的 AI 是物理 AI 。

这里有 110 个机器人,我就简单带大家过几个。

我想不出世界上几乎有哪一家制造机器人的公司没有在与 NVIDIA 合作。我们有三台计算机:用于训练的计算机,用于合成数据生成和模拟的计算机,当然,还有内置于机器人本身的机器人计算机。我们拥有做到这一点所需的所有软件堆栈。帮助你的 AI 模型。所有这些都被整合到了世界各地的生态系统中,并且我们有来自 Siemens、Cadence 的不可思议的合作伙伴遍布各地。

今天,我们宣布了一大批新的合作伙伴。如你们所知,我们在自动驾驶汽车领域深耕已久,自动驾驶汽车的 ChatGPT 时刻已经到来。我们现在知道我们可以成功地让汽车自动驾驶,今天我们宣布了 NVIDIA robotaxi-ready 平台的四位新合作伙伴。

BYD、Hyundai、Nissan、Geely,加在一起每年生产 1800 万辆汽车。加上我们之前的合作伙伴,Mercedes、Toyota、GM ,未来 robotaxi-ready 汽车的数量将令人惊叹。我们也宣布了与 Uber 达成的一项重大合作。在多个城市,我们将把这些robotaxi-ready 车辆部署并连接到他们的网络中。我们有 ABB、Universal Robots、KUKA 以及很多机器人公司在这里,我们正在与他们合作,将我们的 physical AI 模型整合到模拟系统中,以便我们可以将这些机器人部署到世界各地的生产线上。我们有 Caterpillar 在这里。我们甚至有 T-Mobile 在这里,其原因是,在未来,过去被称为无线电塔的设施,将变成一座 NVIDIA Aerial AI RAN。

它将变成一座机器人无线电塔,这意味着它可以对交通情况进行推理,计算出如何调整其波束成形(beam forming),从而能够尽可能多地节省能源并尽可能地提高信号保真度。这里有许许多多的人形机器人,但我最喜欢的是迪士尼的机器人。

这是 physical AI 和机器人技术的时代。在世界各地,开发人员正在构建各种各样的机器人。真实世界是极其庞大且多样化的、不可预测的,充满了边缘情况。现实世界的数据永远不足以用来针对所有场景进行训练。我们需要从 AI 和模拟中生成数据。对于机器人来说,计算就是数据。开发者在互联网规模的视频和人类演示动作上预训练 world foundation models,并评估模型的表现,为后期训练做准备。利用经典和神经模拟,他们大规模生成海量的合成数据并训练策略(policies)。

为了加速开发人员的进度,NVIDIA 构建了用于机器人训练、评估和模拟的开源 Isaac Lab,用于可扩展且 GPU 加速的可微物理模拟的 Newton,用于神经模拟的 Cosmos world models,以及用于机器人推理和动作生成的GROOT开放机器人基础模型。只要有足够的算力,各地的开发人员正在填补物理AI 数据的空白。

Peritas AI 在 NVIDIA Isaac Lab 中训练他们的手术室助手机器人,借助 NVIDIA Cosmos world models 将他们的数据成倍增加。Skilled AI 使用 Isaac Lab 和 Cosmos 为他们的 skilled AI 脑生成后期训练数据。

他们使用强化学习在数千种变化场景中对模型进行强化。Humanoid 使用 Isaac Lab 来训练全身控制和操作策略。Hexagon Robotics 将 Isaac Lab 用于训练和数据生成。Foxconn 在 Isaac Lab 中对 Groot 模型进行 fine-tunes,Noble Machines 也是如此。Disney Research 使用他们在 Newton 和 Isaac Lab 中的 Camino 物理模拟器来训练他们在所有宇宙中的角色机器人的策略。

AI 工厂正在苏醒,Agents 正在学习如何驾驶。从开放模型一直说到机器人,现在我们为你全部拆解,计算量如爆炸般呈现。从 CNNs 一路进化到 OpenClaw,Agents 在大地上劳作,但它们需要电力来满足需求。所以我们聪明地解决了问题,我们将算力翻了 4000 万倍。

曾几何时,在 AI 的过往岁月里。训练是主流的范式。毫无疑问,它教会了模型该怎么做。但如今,是推理驱动着整个世界,Vera 向我们展示了谁才是王者。成本下降 35 倍,Blackwell 让 tokens 欢快地歌唱。NVIDIA,推理之王。AI 工厂过去一建就是好几年。供应商们拽着机架和齿轮缓慢前行。像拼图一样东拼西凑慢慢搭建。根本没有清晰的办法来扩展这头巨兽。DSX 和 Dynamo 懂得该怎么做。

把电力转化为实实在在的收入。过去,Agents 只能袖手旁观。现在,它们可以自主行动了。如果它们敢跑偏。安全的claws 就会立刻拦截并说,“没门”。NemoClaw在那儿为整个旅程保驾护航。是的,我的朋友,它是开源的。会思考的汽车和奔跑的机器人。这可不是在演电影,一切都已经开始了。Alpamayo 掌控全局。属于机器人的 GPT 时刻已经到来。从虚拟模拟走上真实的街头,现在看它们一路驰骋。工业时代造就了往昔的一切。

现在我们为 AI 建造更宏伟的蓝图。Vera、Rubin 加上 Groq 掀起了推理的狂潮。把它们组合在一起,现在下起了钞票雨。我们每年都在打造全新的架构。因为 claws 在不停地呼喊,“把更多的 tokens 丢过来。”这个 AI 技术栈属于所有人去构建。让我们共同品尝这块五层蛋糕。此刻无比闪耀,前路清晰明了。

因为是开放模型引领我们来到了这里。当数据不足时,我们不再争论。我们只用算力生成更多数据。机器人完美无瑕地进行学习。为四大扩展定律(scaling laws)注入燃料。未来已来,你们不想来看看吗?

本文由人人都是产品经理作者【盒饭财经】,微信公众号:【盒饭财经】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益