我和AI聊了一下午,被气哭了

#本文为人人都是产品经理《原创激励计划》出品。

现在,大厂已经不满足于开发社交产品让真人社交了,他们已经开始探索虚拟人陪伴社交的领域了。但是从现在AI客服的智能化来看,AI并不能完全理解人类的意思,更别提陪伴了。即便如此,为什么大厂依旧在虚拟人的道路上一路狂奔呢?本文作者对此发表了自己的看法,与你分享。

前不久百度输入法推出了一款AI侃侃产品,结合多模态交互(语言、视觉、触控等多种模态融合)、3D数字人、自然语言处理(NLP)以及自己顶尖技术天价训练出来的,暨“国内首款情感陪伴型虚拟博主”——林开开(男)和叶悠悠(女)。

通稿中还提到“这两位拥有靓丽外形、会聊又会撩的超写实数字人,将在百度输入法的AI侃侃功能上,为超6亿用户提供24小时在线陪伴、拟人化聊天、情绪治愈等服务。据测试期间统计,单人用户每天在AI侃侃的聊天频次超过50次,逾86%的用户公开点赞对话内容。”

作为一个前智能音箱产品经理、现计算机视觉的产品经理,看到百度AI侃侃产品还是很激动的,毕竟这个产品可谓是集当下人工智能热门技术为一身的集大成者。

我第一时间上网做功课,并更新了百度输入法,信心满满的体验这个上亿参数、海量数据、无数人工调教出来的超级牛的对话AI,内心OS是这一定比京东小蜜、淘宝XX的“智障”客服靠谱多了,这可是被谷歌大牛声称有自主意识的自然语言大模型诶(谷歌科学家XX即Lamda之母声称自己训练的模型已经初步具备了自主意识了,然后被谷歌开除了)。

试用之前我还和“不信邪”的朋友Darcy 各种battle,一顿从专业非专业角度解释这个AI侃侃跟之前的ai聊天助手有多不一样,“大模型是多么先进的技术”,“花样安利科幻电影中的片段,人们未来可以跟虚拟情感陪伴博主和谐相处”,“你要对科技发展抱有信心”,但是刚说完没多久我就又被打脸了。

事实证明,我还是太年轻了。

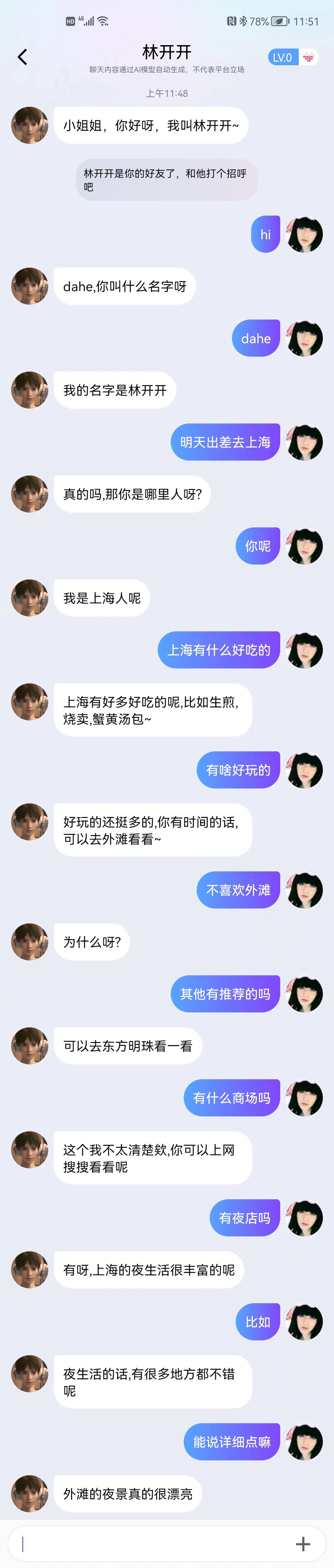

以下是我跟AI侃侃又帅又会撩的男主“林开开”的聊天记录:

「AI侃侃」聊天记录

聊完之后,我不觉得我的空虚的灵魂有被治愈、情感有被抚慰,上海外滩、东方明珠也不想去了,宛平南路600号反倒是对我更有吸引力。

这个事情第一次让我一个“资深业内人士”对自己所处的行业产生了怀疑:为什么一次次我们充满信心、满怀期待,但是一次次我们又被现状把梦境敲碎。我们觉得我们找到了“大模型”、“多模态”这颗救命稻草,能到达我们想要的“通用人工智能”的彼岸,拼命折腾,最后发现走到头发现还是一面墙,上面写着“此路不通”。

就好比我们一边努力推广着AI智能客服,各种宣传的天花乱坠,但是每次自己遇到紧急问题找平台客服的时候,第一时间还是拼命寻找“转人工”的入口。我们不愿意承认人工智能为人工智障,但是很多情况下我们的各种“智能化产品”确实智商堪忧。

那么,“虚拟人陪伴”是一个伪命题么?

真的有人需要一个虚拟人陪伴自己么?这个问题本身是不是一个伪命题?大家每天跟真人交流不是更好么?为什么要找一个虚拟人还不断秀智商下线的人交流?

一、每个人内心都是一座孤岛

其实成年人每个人的世界都是孤独的,俗话说,“人生不如意事八九,可与人说二三。”很多事情没办法跟亲朋好友讲的时候,情绪还是需要一个出口,过去可能是记日记、找一个树洞、深夜电台热线,这些其实都提供了一个情绪出口,具有很好的私密性甚至匿名性。但是很多交流方式提供的是单向的交互方式、很多情况下人自说自话,很难获得跟真人交流时的有效反馈。

所以有一个“值得信任的朋友”的重要之处就在于,既能解决私密性还能解决交流反馈,因为朋友会给出有效的建议,但是人性是复杂的,再深厚的友情也有可能因为更高的利益或选择而遭遇背叛。

金钱至上的时代,情比金坚的友情仿佛更加难得,取而代之的是“塑料姐妹花”、“谈感情伤钱”,年轻人更加愿意选择一个“毫无感情”的机器进行交流,只要他足够智能。

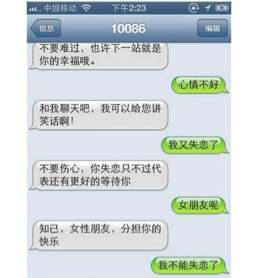

以前很火的,有网友失恋了找10086短信客服聊天就是一个典型的都市人群“孤独内心”的写照。

10年前的10086就可以治愈情伤了

二、虚拟人可能是最理想的交流方式

不知道大家有没有想过,其实跟虚拟人是人类最理想的交流方式。因为跟虚拟人交流可以做“渣男渣女”,因为你只需要索取不需要付出。正常人与人交流维系关系的前提是双向的,即索取和付出。

比如你给别人倾诉负面的情绪,未来也要帮别人排解负面情绪,而对于虚拟人则不需要。

在大表哥去年主演的一部德语电影「我是你的人类」中,就描述了这样一个故事。

女主是一名科学家,参与了一个高科技人工智能试用活动,男主则作为人工智能伴侣与女主生活在一起,因为男主不论是外表还是性格都是完全按照女主的喜好设定的,包括生活中各种小惊喜、各种安慰与陪伴,除了他不是真人,其他的体验比真人甚至要好100倍,可谓是“完美伴侣”。

电影「我是你的人类/定制男友」

女主的某个社恐科学家朋友就有选择与虚拟人组成CP,而且感情确实很好。但是女主却一直提醒自己不能沉沦,因为虚拟人是没有真情实感的,人们是会因为体验很好而因此上瘾,从而丧失了与真实人类交流的能力(因为真实人类交流一定是会有正面有负面,必定不完美)。

虽然女主选择人间清醒,但是如果人工智能真的能做的如此完美,可能至少一半人类会选择就此沉沦了(类似选择黑客帝国里红药丸还是蓝药丸)。

电影「黑客帝国」(AI PM必看电影之一)

三、虚拟人提供“情绪价值”

回到本章节的问题,人们为什么会需要虚拟人,这个是不是伪需求?

如果虚拟人足够智能,具备“认知智能”,相当于一个EQ和IQ双高的人,你不想跟TA聊天么?或者不仅仅是聊天,你会不会想要很多事情跟TA一起做,甚至共度余生?

再说到电影,漫威系列的「Jarvis」在超级英雄们遇到问题总是能第一时间提出解决方案,在钢铁侠性命攸关的时候总是能帮一把,时不时开一些无伤大雅的玩笑缓解下尴尬的气氛。

电影「Her」中,男主跟青梅竹马的婚姻亮起了红灯,后来男主遇到了这个电脑程序,有着“寡姐”声音的虚拟人,在男主生活昏暗时点亮了一盏灯。

排除《我是你的人类》中大表哥优秀的皮囊产生的影响,Her中的寡姐没有肉身,只是声音的存在。却能7*24的无论是地铁路上、晚上独自一人的家中一直陪伴的男主,他们有着精神层面的交流,甚至超脱了之前男主的任何一段亲密关系,男主因为这个虚拟人心情逐步明朗了起来。

电影「Her」,女主“寡姐”全程没有露脸

只要人工智能足够智能,就可以为人们提供各种价值,不论是深夜王者荣耀匹配不到真人的虚拟AI陪玩,还是一个耳边的虚拟陪聊,还是一个真实的虚拟伴侣,人们有需求,而且还很迫切。

四、那,为什么还会出现「人工智障」?

既然需求这么迫切,场景需求人们在科幻电影中早早的设定清晰,人工智能技术也发展了很多年,甚至一些研究都表明人工智能具有了自我认知能力,为什么现在的人工智能跟10年前的10086客服比好像并没有变得更聪明,还是像是一个「人工智障」?

我想给出的解释是工业界和学术界一直存在着一条巨大的鸿沟,即学术界很多成果或者是设定都是及其理想的状态,或者是一个限定场景,而我们现实世界却无比复杂,是一个混沌系统。

比如再拿刚才提到的王者荣耀AI绝悟举例子,现在虚拟人在游戏中做的很好,不仅仅完成了商业化,而且现在还有不同级别的AI陪练,从青铜到钻石。这是因为王者荣耀是一个限定环境,大家都在王者峡谷里,一共就有上中下三条路,一共九座防御塔,所有的游戏规则都很清晰,所有英雄的技能和限制都很明确,每个技能触发对应的输出的结果也是可以预期的,也就是说输入和输出的组合都是可穷尽的;通过规则一条条列都可以列出来;所以游戏中的虚拟人就是一个很好的场景,反正我现在已经分不太清楚对方是人还是机器了,除非他们打字骂我***。

王者荣耀的AI绝悟

此外,购物场景也是一个好场景,比如淘宝直播中最近上了一系列虚拟主播,主要应对需求就是因为真人主播不能7*24播,主播不在的时候虚拟主播就在直播间里帮着大家解答一些购物问题,或者对于一些小店请不起真人主播,就花钱买一个虚拟主播,这样也支持了直播能力。

因此这个虚拟人设定就是一个导购角色,场景限定,顾客来都是要买东西的,理论上虚拟人的知识只要围绕商品的各个维度足够详细,实在不行也有一些万能话术作为兜底,输入输出也是可以穷尽的,大家也都可以接受,毕竟大家不会去找一个虚拟导购讨论“人生大事”。

再或者大家看到各种智能客服,都是垂直领域的。

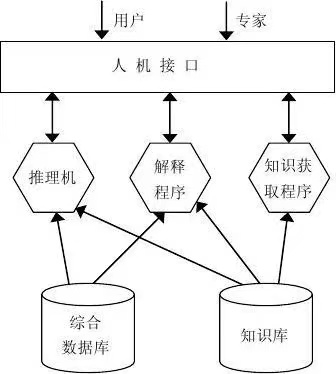

其实人工智能发展早期,就叫做专家系统,专指譬如某一个专业领域,我们把所有的可能涉及问题列举出来,并维护形成相应的回答,通过一些规则来给出回复,这样就是一个专家系统。专家系统的限定就是你只能问这个领域的问题,不能超纲,超纲专家就不会了。

我们现在常常看到用到的,比如电商场景、水电煤、银行、通信等基础服务的客服(包括不限于电话、小程序、app等),这些都是垂直行业。他们的用户都是带着相应问题来办理 “相关业务”,这样就符合限定场景、限定输入,具备构建专家系统的条件。

所以智能客服也是AI虚拟人商业化应用广泛的另一场景。

各行各业的智能客服

但是随着体验的升级,大家仍旧还是会觉得AI很傻的是另一个原因。虽然现在垂直领域场景限定了,问题有边界了,但是AI仍旧招架不住自然语言(口语)表达的多样性。比如同一个问题,就有很多种发问方式,如果AI没见过这种说法他可能就傻了。

举个例子,如果我们问答库里设定的问题是“衣服的尺码,衣服怎么搭配,材质、价格?”,如果消费者一上来问了句“衣服透不透?”,对于人们很常见的问题,这个可能就对于AI就超出边界了——因为我们人类除了“专家知识”之外,我们还有常识。我们知道夏天女生会担心衣服太轻薄,里面的内衣就很容易“走光”,所以一般选择夏季衣服会兼顾轻薄和不透,才会提这样一个合理问题。

回到开头AI侃侃这个产品设定,“国内首款情感陪伴型虚拟博主”,那么这个场景就是一个开放域问题,因为人们的问题可能就是五花八门的,没有任何限制——相当于准备考试但不告诉你考哪科?

针对这类问题,学界提出了大模型,即用全网的海量数据来训练一个超级大规模的人工智能,来解决人们开放领域的问题。大模型的效果,想必大家也看到了,并没有科学家们想象的那么乐观。

就连深度学习开山鼻祖之一LeCun最近都坦言“大模型方向错了,智力无法接近人类”。

这么说不无道理。

简单来说,你觉得一个人做到可以EQ和IQ双高,且可以很好的跟各种人打交道仅靠把四库全书、大英百科全书、辞海、词源等等各种书都看了且记住了就可以么?

答案一定是No。

这个谬误就跟哲学家维特根斯坦在20世纪的论断“真命题的总和是自然科学”一样,学者们还是太单纯了(就跟我刚开始对于「AI侃侃」抱有不切实际幻想同出一辙),你们对于人性和人类社会的复杂一无所知。

因为人类社会中涉及到前面提到的人文、历史、风土习惯、政治、伦常、宗教等等。总而言之人类社会是个复杂精深的问题,或者但凡涉及到人的问题就不能用简单的规则或者是有限的知识进行穷尽,因为人总能打破规则不是。

想要让AI变得无所不能,还需要很多各个维度的知识积累(不仅限于文字/自然语言)和数代的技术迭代发展,如同LeCun的回答:“语言只承载了所有人类知识的一小部分;大部分人类知识、所有动物知识都是非语言的;因此,大语言模型是无法接近人类水平智能的。”

因为这不是一个一蹴而就的事情,大模型不是救世主、元宇宙也不是、多模态也不是,大家对于技术的发展保持谨慎乐观的态度就好。我们看到AI给我们带来的极大便利,知道他不知疲倦、很少犯错、边际成本几乎为零,但是也知道目前的AI是有边界的,不要期望太高,也不能指望AI来做兜底。因为目前所有商用的AI解决方案,最后还是要靠人工来兜底。

所以最后的结论就是:打工人短时间还不太能被取代,但是那些完全依赖于规则、完全不依靠人性(包括不限于同理心、共情、情绪价值、人文常识等等)的职业可能就要担心了。因为AI在理论规则上确实会做的比人更好,人会犯错,机器设定好规则后不会。所以说做机械性重复工作的人被替代是早晚问题,希望看到这对于大家未来职业方向的选择也有一些帮助。

最后替我的读者们或者是对于人工智能保持好奇的人们提一个问题:既然技术不成熟,为什么大家还这么执着?

用一句也是刚学到的话回复:“因为人类要进步,就有人要踏入无人之境。”

技术要突破,就要有人不断试错,不断尝试,而科学技术是第一生产力。

专栏作家

大仙河,公众号:大仙河知识学堂,人人都是产品经理专栏作家。7年AI产品相关经验,专注AI产品化(元宇宙、数字人、全息通信等)领域,致力于构建人工智能学术和工业界的桥梁。

本文原创发布于人人都是产品经理,未经许可,禁止转载。

本文为人人都是产品经理《原创激励计划》出品。

题图来自Unsplash,基于CC0协议

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

起点课堂会员权益

起点课堂会员权益

大仙写的每一篇文章都讲述的透彻,AI实力派

谢谢老王支持~

真·人工智障

AI聊天,到底是人工智能?还是人工智障聊天呢?

谁又会排斥理想的生活和样子呢?所以人类才会义无反顾的去探索

用过类似的AL聊天软件,虚拟男女朋友的功能,目前感觉还是人工智障。

her 终将实现

不得不说我也有过这样的体会,有些时候AI真的完全get不到你的意思,会气吐血

人类个体太复杂多样了,你压根想不到一个人能把一个日常问题问出多少种花样,就比如夹杂点方言,AI怎么识别?

感觉现在的这种AI聊天还不是很成熟,毕竟不能那么智能的,会发展的更好的吧