Jellyfish测评:一站式AI生成短剧的生产工具,从剧本输入到AI 视频生成全搞定

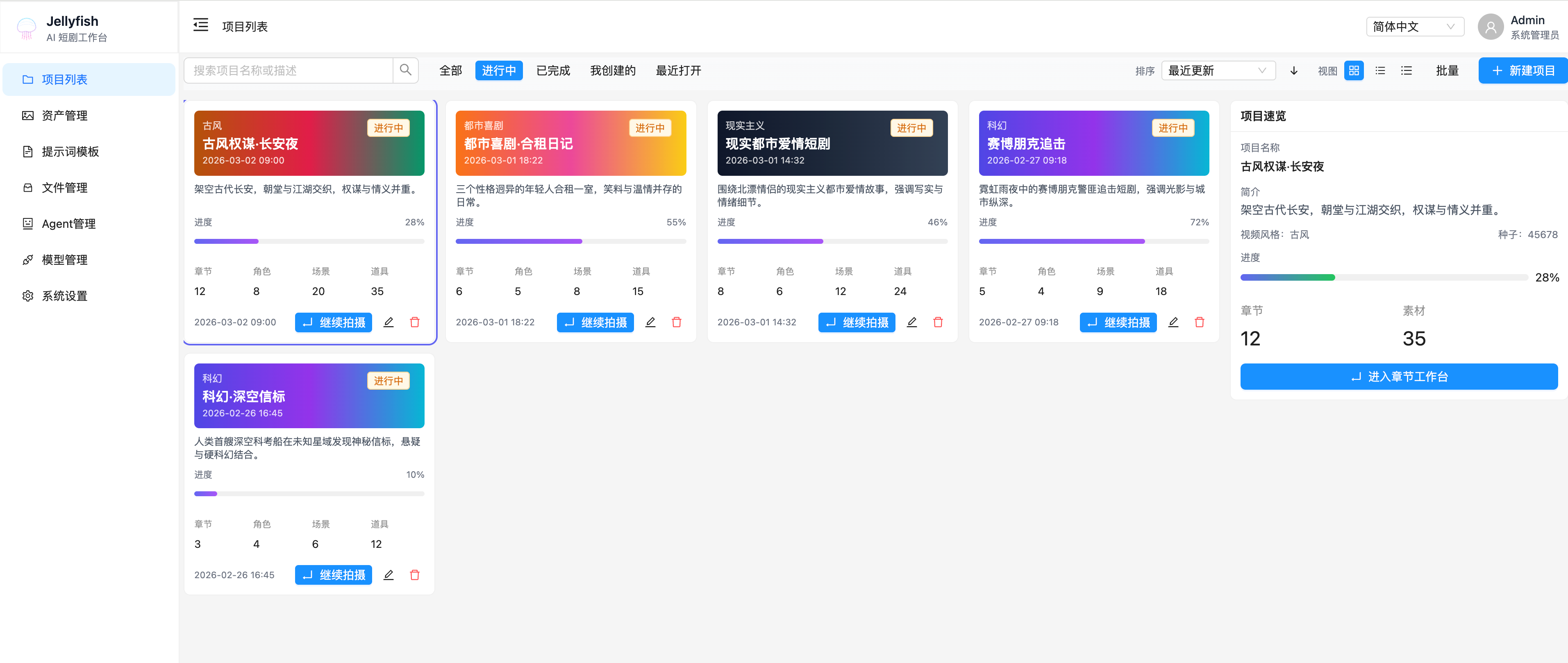

Jellyfish(AI短剧工厂)是一款开源的一站式AI短剧生产工具,专注解决AI视频生成中的角色/场景漂移问题。从剧本输入到成片导出,六步流水线全覆盖。一周狂揽1.7K+ Star,正在成为AI视频创作者的新宠。

你有没有被AI视频的”变脸”问题困扰过?第一集女主角还是黑长直,第二集突然变成了短发。第三集场景从咖啡厅跳到了办公室——这不是剧情需要,是AI在”发疯”。

最近,一款叫Jellyfish(水母)的开源项目在开发者圈子里火出圈了。上线一周狂揽1.7K+ Star,专门解决AI短剧制作中最让人头疼的一致性问题。今天我们就来深度测评一下,看看它到底有没有那么神。

📌 产品速览:3分钟了解核心信息

Jellyfish(中文名:AI短剧工厂)是由 Forget-C 团队开发的一款开源、全栈式AI竖屏短剧生产工具。

项目数据:

-

GitHub:https://github.com/Forget-C/Jellyfish -

开源协议:Apache-2.0 -

技术栈:React + TypeScript + Vite(前端)+ Node.js/FastAPI(后端) -

项目状态:活跃开发中,预计4月初发布Beta版 -

一周Star数:1.7K+

核心定位:把短剧生产从”拼凑各种AI工具”升级为”工业化流水线”

核心流程:

剧本输入 → 智能分镜 → 角色/场景/道具一致性管理 → AI视频生成 → 后期剪辑 → 一键导出成片

✨ 核心功能:这5个亮点最值得关注

1. 剧本智能分镜

传统方式下,你需要把剧本手动拆分成一个个镜头,再逐个生成。Jellyfish能自动帮你完成这个繁琐的步骤。

输入一段文学剧本或小说章节,AI会自动:

-

精简剧情,提取核心冲突 -

拆分成结构化分镜表 -

包含景别、角度、运镜、对白、情绪等详细信息

你可以在可视化编辑器里微调每个分镜的参数,确保创意意图完美执行。

2. 角色/场景/道具一致性管理

这是Jellyfish的核心竞争力。AI视频最头疼的问题就是”漂移”——同一张脸在不同镜头里长得不一样,同一个场景下一秒一个样。

Jellyfish通过三重机制解决这个问题:

-

全局种子(Global Seed):整个项目共享一个种子,确保视觉风格统一 -

风格继承机制:新分镜自动继承之前的一致性特征 -

资产复用体系:角色、场景、道具作为独立资产库,跨分镜引用

实测下来,一致性确实比纯Midjourney生成分镜稳定很多。

3. 三栏式分镜编辑器

Jellyfish提供了专业的分镜工作台,三栏布局:

左栏:剧本大纲与章节结构

中栏:分镜预览与视频预览

右栏:属性面板(景别/角度/运镜/情绪/时长/提示词等)

支持批量操作,可以同时编辑多个分镜的公共属性。分镜还能设置首帧/尾帧/关键帧的独立提示词,精细化控制画面过渡。

4. 多模型调度与高级控制

作为工业化工具,Jellyfish不绑定单一AI模型,支持灵活调度:

-

文本模型:OpenAI GPT、Claude、通义千问、混元等 -

图像模型:Midjourney、Stable Diffusion、DALL-E等 -

视频模型:Runway Gen-3、Kling、Luma等

高级功能包括:

-

参考图跨分镜引用 -

ControlNet骨骼/深度控制 -

智能对口型(Lip Sync) -

模特/时长选择

5. 可视化Agent工作流

类似Dify的节点式编排器,可以自定义自动化流程:

-

剧情提取Agent -

角色提取Agent -

分镜建议Agent -

支持可视化测试和调试

这意味着你可以深度定制AI短剧的生产逻辑,而不是被固定流程束缚。

🧪 实测体验:真实使用感受

优点

-

✅ 一致性控制出色:确实有效解决角色/场景跳变问题,全局种子机制很实用 -

✅ 全流程覆盖:从剧本到成片一个工具搞定,不用东拼西凑 -

✅ 可视化程度高:三栏式编辑器比纯代码/YAML配置友好太多 -

✅ 资产管理系统:双层资产库(项目库/全局库)设计合理,便于复用 -

✅ 开源可定制:Apache-2.0协议,可以二次开发或集成自有模型 -

✅ 多模型支持:不绑架用户,灵活切换不同AI服务

缺点

-

❌ 项目尚在Beta:目前核心流程和数据模型尚未稳定,正式使用有风险 -

❌ 部署有一定门槛:需要Node.js、Python、Git等环境,显卡要求不低 -

❌ 暂不接受PR:开发中暂停外部贡献,想参与得等4月后 -

❌ 依赖第三方API:Midjourney、Kling等商业AI服务需要额外付费 -

❌ 中文文档待完善:目前文档以英文为主,部分功能说明不够详细

⚖️ 竞品对比:和传统制作方式相比怎么样

| 对比维度 | Jellyfish | 纯Midjourney + 剪辑工具 | 即梦/可灵等平台 |

|---|---|---|---|

| 一致性控制 | ✅ 全局种子 + 资产库 | ❌ 需手动保活 | ✅ 平台内置 |

| 全流程覆盖 | ✅ 六步流水线 | ❌ 需组合多个工具 | ✅ 一站式 |

| 开源可控 | ✅ Apache-2.0 | N/A | ❌ 闭源 |

| 部署方式 | 本地/私有化 | 依赖云服务 | 仅云端 |

| 成本 | 仅API费用 | API费用 | 订阅制 |

| 定制化 | ✅ 完全开放 | 有限 | 受限 |

| 学习曲线 | 中等 | 较高 | 低 |

结论:Jellyfish填补了”开源 + 工业化 + 一致性控制”这个空白。对于有技术能力的团队,它提供了前所未有的灵活性和可控性;对于普通用户,平台类工具(如即梦)仍然更易上手。

🎯 适合人群:这些人最值得尝试

✅ 强烈推荐

-

🎬 AI短剧创作者:正在做竖屏短剧/微短剧,被一致性漂移问题困扰 -

👨💻 技术开发者:想基于AI视频能力构建应用,或集成自有模型 -

📽️ 内容工作室:需要批量生产视频内容,追求流程工业化 -

🤖 AI研究者:想研究AI视频生成的工作流与一致性管理

❌ 不太适合

-

🆕 纯新手用户:部署和配置有一定门槛,建议先用平台类工具 -

💰 预算有限用户:仍需支付Midjourney、Kling等商业AI的API费用 -

⏰ 即时性需求:Beta阶段可能存在不稳定因素,正式项目慎用

💡 使用技巧:让你效率翻倍的6个秘诀

技巧1:精心设计全局种子

在创建项目时,全局种子(Global Seed)决定整个项目的视觉风格基调。花时间想清楚”整体风格”,比如”中式宫廷+暗黑色调”,后续分镜会自动继承这个风格。

技巧2:提前建立资产库

把常用的角色形象、场景、道具、服装做成资产模板。新项目可以直接复用,不用每次重新生成。一套高质量资产可以服务多个项目。

技巧3:利用首帧/尾帧控制过渡

每个分镜可以设置首帧、尾帧、关键帧的独立提示词。善用这个功能可以让镜头之间的过渡更自然,减少跳变感。

技巧4:批量生成前先测试

不要一次性批量生成所有分镜。先选2-3个分镜测试效果,确认种子和提示词有效后再大批量生产,节省API费用。

技巧5:多模型组合使用

图像生成用Midjourney/SD,视频生成用Runway/Kling/Luma。不同模型擅长不同风格,组合使用效果往往比单一模型更好。

技巧6:工作流自定义

不要被默认流程束缚。根据你的项目类型(古风/现代/科幻),自定义调整Agent工作流,找到最适合你的生产节奏。

📝 总结:值不值得用

综合评分:⭐⭐⭐⭐☆(4/5)

核心优势:

-

一致性控制确实有效,解决了AI视频最大的痛点 -

开源可控,Apache-2.0协议无商业化限制 -

六步流水线全覆盖,工业化程度高 -

多模型支持,不绑架用户

明显不足:

-

Beta阶段稳定性有待验证 -

部署配置对非技术用户不友好 -

仍依赖商业AI API,成本无法完全控制

最终推荐:

如果你正在做AI短剧项目,被”角色变脸””场景跳变”折磨得苦不堪言,Jellyfish绝对值得一试。它的全局种子和资产管理系统是目前开源方案中最接近工业级的解决方案。

如果你是完全没有技术背景的普通用户,想快速制作AI短剧,平台类工具(如即梦、可灵)仍然是更稳妥的选择。

但有一点可以确定——Jellyfish代表了一个方向:AI视频生产从”手工作坊”走向”工业化流水线”。这个趋势,不会倒退。

本文基于公开资料整理,实际体验可能因版本更新有所差异。如需最新信息,请访问项目主页:https://github.com/Forget-C/Jellyfish

起点课堂会员权益

起点课堂会员权益

这工具真能治住AI“变脸”?看介绍挺香,但部署劝退小白,技术党可冲!

还好啦。小白也可以学部署,没那么难。