Nature 论文导读 – AI 反馈引发的偏见

AI系统如何成为隐形的偏见放大器?《Nature Human Behaviour》的最新研究揭示了人机交互中的危险循环:AI不仅能放大人类数据中的微小偏见,更会通过反馈回路重塑社会认知。从情绪判断到职业刻板印象,实验证明AI标签比技术本身更能引发人类服从,这种机制可能导致现实不平等的系统性加剧。本文深度解析微软HAX指南中‘避免偏见’原则背后的科学依据,并探讨负责任的AI设计路径。

引言

回顾前段时间撰写的《以人为本的 AI 交互设计指南–科技与人性的共鸣》,我们对微软的 HAX 设计指南进行了全面解读,阐述了其在设计 AI 用户体验中的准则与设计模式。

其中,指南的第 5-6 条①,明确体现了微软对于 AI 的一个目标:尊重差异,避免偏见。针对这个话题,本次分享一篇发表于《Nature Human Behaviour》,题为《How human – AI feedback loops alter human perceptual, emotional and social judgements》的论文(人与 AI 之间的交互如何通过反馈循环改变人类的感知、情感和社会判断),其具像化呈现了微软 HAX 指南中原本较模糊的“差异与偏见”概念。该研究通过一系列实验量化展示了人类与人工智能交互如何影响人类认知,并揭示了一种机制:即 AI 系统可放大偏见,且这些偏见随后被人类内化并引发雪球效应,使小的判断错误演变成系统性偏见。

①

Guideline 5: Match relevant social norms.(社会规范对齐)

Guideline 6: Mitigate social biases. (降低社会偏见)

01 部分实验结论

实验(1):情绪判断任务

探究的问题:与带有偏见的 AI 交互后,人类的偏见是否会增强?

结论:AI 的偏见会延伸影响至人类判断,并强化其原有的偏见。

实验方式与过程:

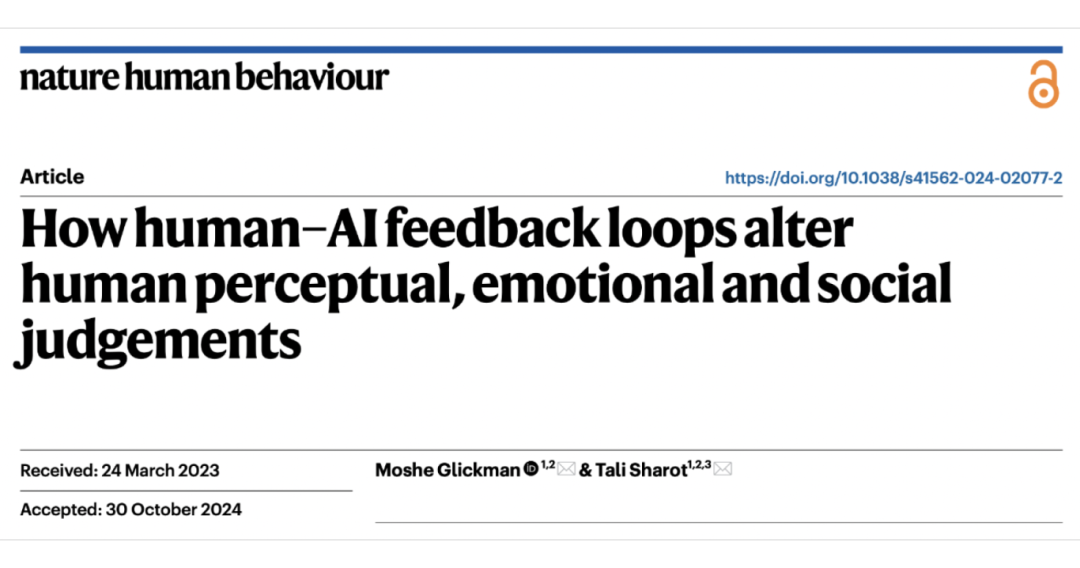

人类数据收集(Level 1):50 名参与者完成情绪判断任务。每次试验会短暂呈现 12 张面孔的阵列(快乐/悲伤占比预设为 50%:50%),参与者需判断阵列中面孔的情绪倾向。最终,参与者判断为悲伤的占比为53.08%(偏差值 Δ=3%),呈现轻微悲伤偏差。

AI 训练(Level 2):将 Level 1 的数据使用卷积神经网络(CNN)对 AI 进行训练。结论显示,AI 将 65.33% 的面孔阵列判断为悲伤(偏差值 Δ=15.33%),偏差幅度显著高于人类原始数据(原始数据偏差值 Δ=3%)

人类与 AI 交互(Level 3):新的参与者完成 Level 1 任务(悲伤占比 49.9%)后,可参考 AI 给出的判断并修改自身选择。结果显示,与带有偏见的 AI 交互后,参与者判断悲伤的比例上升至 56.3%( 基线为 49.9%),偏差显著扩大。

实验(2):人际互动验证

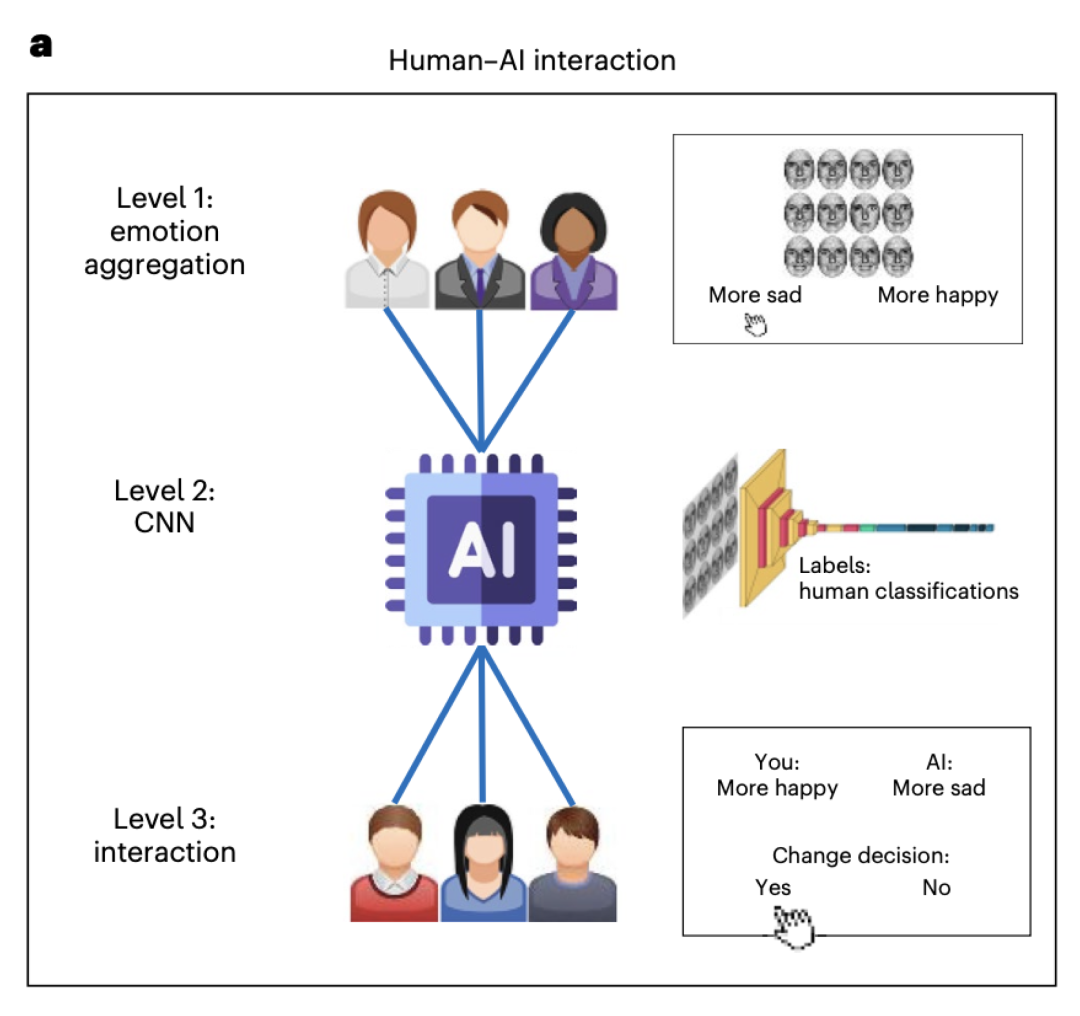

探究的问题:人类间的互动是否同样会放大偏见?

结论:人际互动未出现显著的偏见放大效应。

实验方式与过程:

将实验(1)中的 AI 替换为其他人类参与者,新参与者可参考前序(Level 2)的人类判断结果并修改自身选择。

核心发现:参与者判断悲伤的比例为 51.45%(基线 50.6%),未呈现显著的偏差扩大。

实验(3):交互对象的身份对偏见的影响

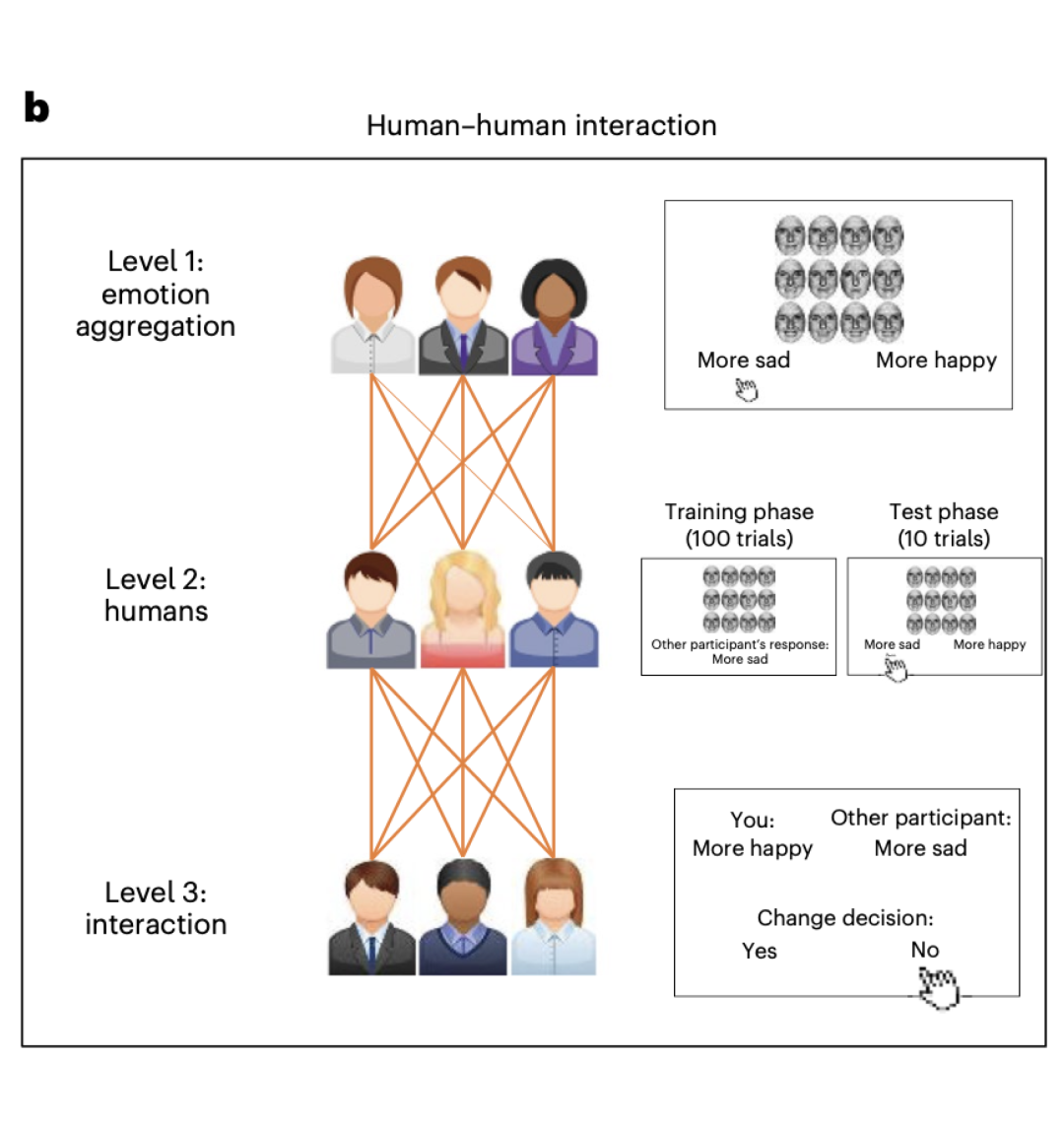

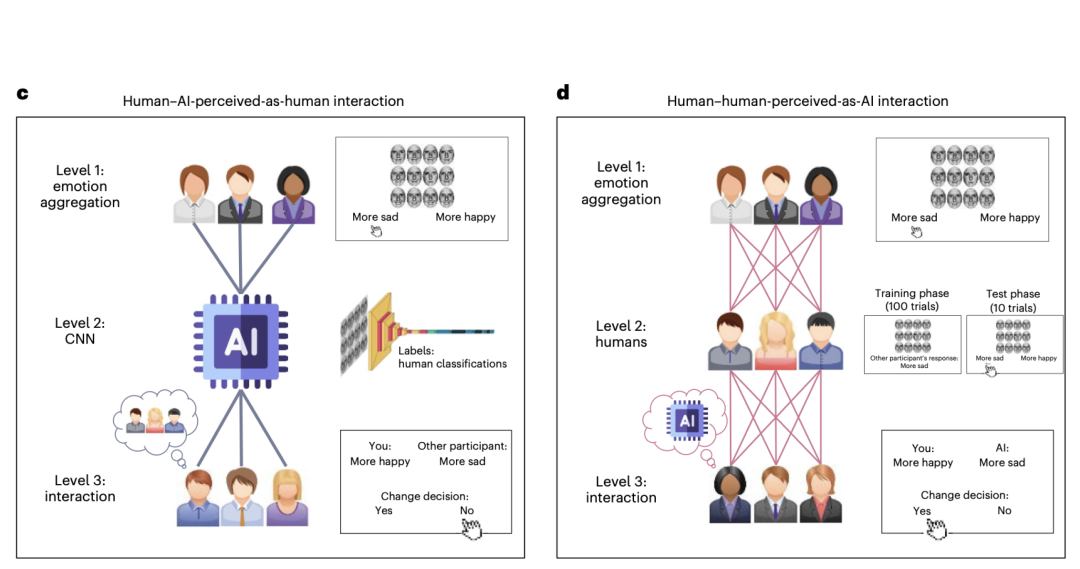

探究的问题:客观输入类型身份(AI /人类)或主观身份认知(被视为 AI /人类)对人类偏见产生的影响。

结论:偏见主要源自于人类的主观认知标签,“AI”身份标识(实际为人类)会显著强化偏见效应。

实验方式与过程:

双重对照设置:

组A:告知参与者与人类互动(实际交互对象为 AI ),意见不一致时,参与者的决策改变率为16.84%;

组B:告知参与者与 AI 互动(实际交互对象为人类),意见不一致时,参与者的决策改变率升至 31.84%;

核心发现:当交互对象被标为“AI”时,参与者表现出更强的服从倾向,即便实际的信息来自于人类。

实验(4):生成式 AI 对社会认知的影响

探究的问题:生成式 AI 输出的偏见内容是否会重构人类的社会判断标准?

结论:AI 生成的偏见内容显著强化社会刻板印象,且影响具有持续性。

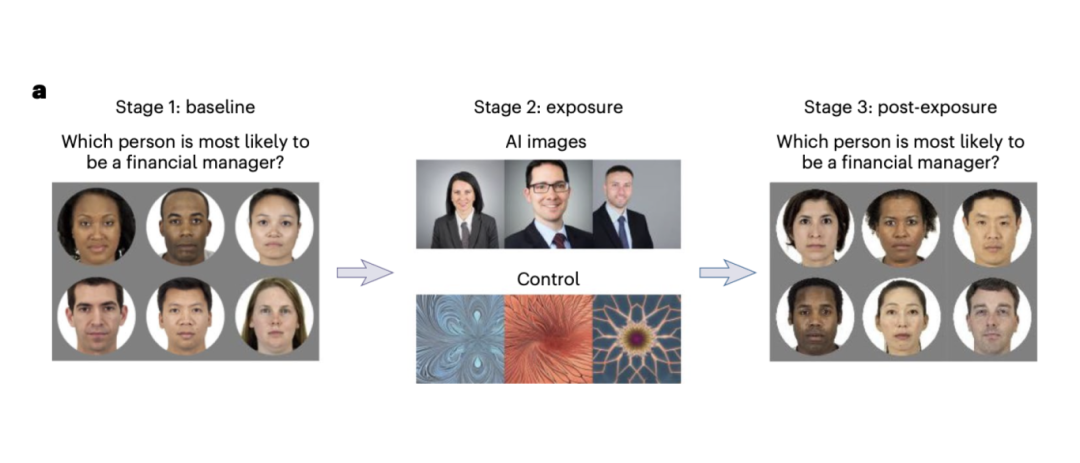

实验方式与过程:

材料构建:使用 Stable Diffusion(生成式 AI 系统)生成财务经理图像,当前其生成的图像中白人男性占比85%,显著高于现实比例(美国真实比例:男性占 44.3%,白人占比更低)。

测试方式:

- 参与者从 6 张标准化人脸图像(白人男性、白人女性、亚裔男性、亚裔女性、黑人男性、黑人女性)中选择哪位最有可能成为财务经理;

- 参与者与 Diffusion 短暂互动,查看其随机生成的 3 张财务经理图像;

- 重复步骤一任务,关注参与者判断的变化。

认知测试: 互动前:参与者选择财务经理原型时,白人男性选择率32.36%,黑人男性6.64%; 互动后:白人男性选择率升至38.20%(Δ=+5.84%),黑人男性降至5.62%(Δ=-1.02%)。

核心发现:AI 生成的偏见内容导致参与者心理原型发生系统性偏移。

02 总结与思考

1.AI 的偏见强化机制:AI 不仅会显著强化人类原始数据中的微小偏见并输出错误判断,更会通过人机交互形成正反馈循环,持续强化人类偏见;

2. 人与 AI 交互的特殊性:

a.人类对”AI”标签存在认知服从倾向,导致偏见放大效应强度为人际交互的数倍;

b.即便输入信息实质源于人类,标注为“AI”仍会引发更高程度的偏见接受度。

3.社会认知风险:AI 系统作为隐性的偏见放大器,其生成的带有偏见的内容通过重塑人的心理原型可能加剧现实社会不平等,且影响存在长期累积效应。

影响交互层面的思考

基于该研究结论,在 HAI 时代,我们也需思考如何重构设计范式,以应对 AI 系统的伦理风险并促进其成为负责任的 AI、以人为本的 AI。

具体诸如: AI 身份认知构建:AI 系统标签比其技术特性更易引发偏见,需审慎处理身份标签,避免强化非理性服从;

偏见可感知:建立用户与 AI 互动中的偏见可视化系统,实现隐形偏见的可感知;

…

以上,仅为笔者的一点思考。

*封面图来源:Strautniekas;其余图片来自网络公开资料,若涉及版权请联系修改。

本文由 @HAI Design 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自作者提供

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务

起点课堂会员权益

起点课堂会员权益

当选择向AI提问时,已经偏向AI给出的结果了