Seedance 2.0:告别“抽卡炼丹”,AI视频进入“导演工作台”时代

AI视频领域正在经历一场由Seedance 2.0引领的技术范式革命。从过去的"抽卡炼丹"式随机生成,到如今支持多模态输入、精准资产引用和分镜编辑的工作台模式,这款工具正在重塑视频创作的可控性。本文将深度解析这场变革背后的三大技术支柱,以及它如何解决角色漂移、物理违和等AI视频的致命痛点。

从“赌运气”到“可控生产”,一场由字节跳动引领的AI视频范式革命

作为一名在互联网行业摸爬滚打了这些年的AI产品经理,我真的见证了太多产品的兴衰更迭。每一次技术浪潮袭来,都会有一批新工具冒出来,它们有的昙花一现,有的则能真正改变我们的工作方式。

最近,在AI视频这个领域,我感觉到一个真正的分水岭时刻正在到来。过去,我们谈论AI视频,无论是Runway、Pika还是其他什么工具,坦白说,很多时候都像是在玩一场“抽卡游戏”。你输入一段Prompt,然后就得闭眼祈祷,希望模型能给你一张SSR级别的卡片,也就是一段能看的视频。结果往往是,你抽到一堆废卡,偶尔有那么一两张还行,但离你心目中的“能用”差了十万八千里。那种不确定性,那种“炼丹”般的玄学操作,真的让人疲惫。

但现在,Seedance 2.0的出现,我觉得它有点不一样,它似乎正在彻底打破这种“抽卡炼丹”的僵局。它让我看到了AI视频从“碰运气”到“可控生产”的巨大转变。

之前有同行跟我说,用户要的不是偶尔做出好作品,而是每次都能做出能用作品。这句话,在我看来,简直就是Seedance 2.0诞生的最好注脚。它不仅仅是一个工具的升级,更像是一次技术范式的大迁移,预示着AI视频生产将真正迈入一个“导演工作台”的时代。今天,我就想跟大家深入聊聊,为什么我认为这次的迭代,会是一场深远且具有颠覆性的变革。

旧世界的“原罪”——AI视频的“抽卡炼丹”困境

回想过去几年,AI视频工具带给我们的震撼是实实在在的。但随着新鲜感过去,那些华丽的Demo背后,隐藏的“原罪”也渐渐浮出水面。这些问题,就像是横亘在AI视频从“玩具”走向“生产力”之间的几座大山,让无数创作者在摸索中感到了力不从心。

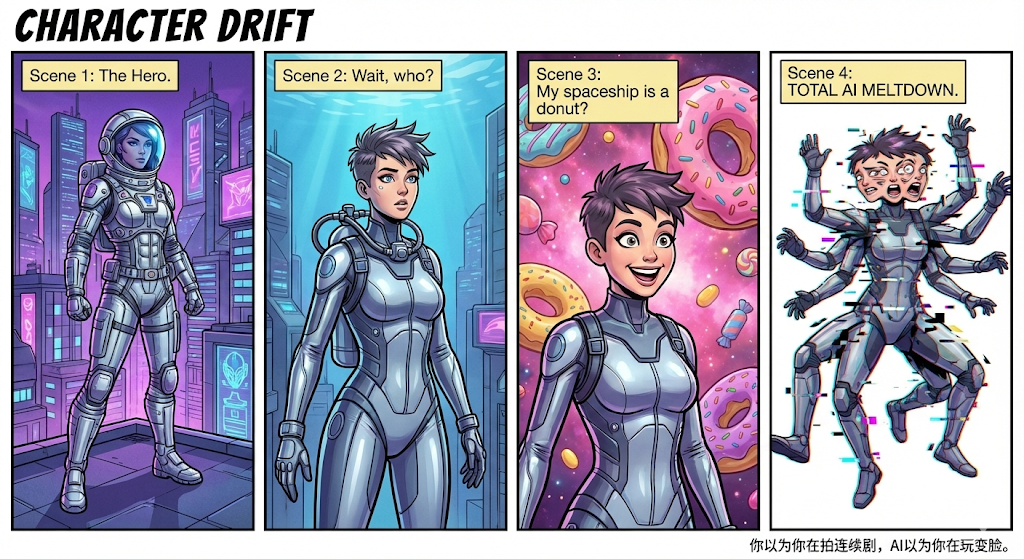

我们先来看看最让人头疼的一个问题,那就是视频内容里那种薛定谔般的一致性。你可能给AI一个角色设定,或者一个场景描述,理论上,它应该在整个视频里保持稳定才对。然而实际操作起来呢,你常常会遇到所谓的“角色漂移与场景闪烁”这类案例。

一个人物,前一个镜头还是长发飘飘,后一个镜头可能就变成了短发,甚至脸型都变了,这哪还像同一个人啊。更别提场景了,有时候背景的某个元素会突然消失,或者换个形状,整个画面氛围都变得诡异起来。这种模型缺乏“记忆”的表现,使得长视频的生成几乎不可能,因为每一帧的生成都像是一次新的“随机创作”,缺乏前后关联和统一性。这种体验,让创作者每生成一段视频,都像在开盲盒,充满了未知和不确定。

再者,就是那个“物理学不存在的世界”。我们生活在一个有重力、有摩擦、有惯性的真实世界里。视频,无论是现实拍摄还是CG制作,都必须遵循这些基本的物理规律,才能让人觉得真实可信。然而,早期的AI视频,在这方面常常表现得让人啼笑皆非。你可能会看到人物反重力地漂浮起来,水流违反常理地倒灌,或者物体之间诡异地穿插融合。那种反直觉的运动方式,那种缺乏真实世界理解的“诡异物理”,一下子就把人拉回了“这是AI生成的”现实。它不光让视频看起来不真实,更是在无形中破坏了叙事的逻辑和观众的沉浸感。这种基础物理层面的“不靠谱”,让AI视频在很多需要写实表现的场景中,根本无法登场。

最后,也是最让我感到焦虑的,是那种“祈祷者”式的创作体验。很多时候,我们输入Prompt,就像在跟模型讨价还价。你得绞尽脑汁地去写各种关键词,尝试不同的顺序,加上各种修饰词,甚至还得研究一些“咒语大全”。但结果呢,往往是你花了大量时间构思Prompt,模型给出的却是一段风马牛不相及的视频。这让用户从一个掌握全局的“导演”,退化成了一个在赌场里反复下注的“赌徒”。你的创意被Prompt的限制所束缚,你的想象力被模型的理解能力所阉割。你没有办法真正地“指导”AI,而只能“请求”它、甚至“祈祷”它能理解你的意图。这种失控感,对于任何一个有创作追求的人来说,都是一种巨大的打击。

说实话,这些痛点叠加在一起,导致AI视频在很长一段时间里,只能算是一个新鲜的“玩具”。它或许能在社交媒体上引起一阵惊叹,但想要真正进入电影、广告、短剧等需要稳定、可控、高质量输出的生产流程,简直是痴人说梦。它就像是那种偶尔能做出一个漂亮雕塑,但没办法批量生产合格零件的作坊,离工业化生产还有很远的距离。

新范式的三大支柱——Seedance 2.0如何重构创作流程

既然旧世界的问题如此明显,那么Seedance 2.0究竟是凭什么敢说自己能够重构创作流程,解决这些“原罪”呢?在我看来,它并非一蹴而就,而是通过一系列深刻的技术突破,构建起了新范式的“三大支柱”。这不仅仅是功能上的叠加,更是一种底层思维模式的转变。

第一个支柱,也是最直观的改变,就是从“描述”到“展示”的革命性输入方式。过去我们用文本Prompt去“描述”一个画面,但文字再怎么精妙,都无法穷尽视觉信息的细节和层次。Seedance 2.0高明的地方在于,它不再强求你用文字来描绘一切,而是让你直接“展示”你的意图。它支持多模态输入,你可以同时提供文本、图像、视频,甚至还有音频作为参考。想象一下,你想要一个特定风格的角色,你可以上传一张参考图片;你想要一段特殊的运镜,你可以上传一段参考视频;你甚至可以通过音频来辅助情绪和节奏的表达。它最多能支持多达12个参考素材,其中包括9张图像、3段视频和3段音频。这种丰富到近乎奢侈的输入方式,彻底改变了用户与AI的沟通方式。不再是单向的“我告诉你”,而是多维度的“我给你看,给你听,再告诉你”。这就像从对着一个听不懂你口音的人手舞足蹈,变成了可以直接把图纸、视频、语音指令都摆在他面前。这一下子就极大地提升了AI对用户意图的理解精度。

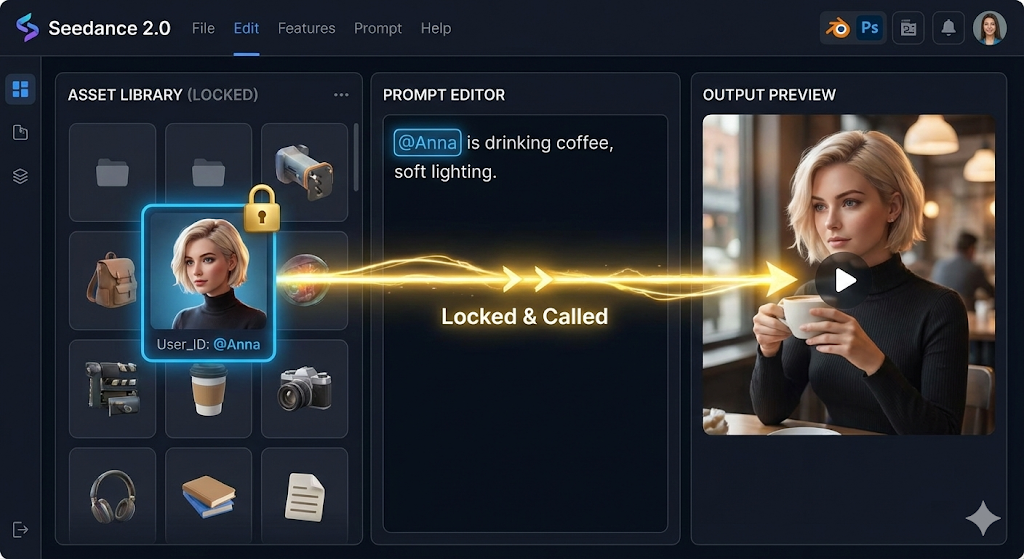

第二个支柱,也是真正让用户找回“导演权”的核心机制,就是它那个创新的“@”引用与精准控制系统。你有没有遇到过这样的情况,某个AI生成的人物或者道具特别符合你的要求,但你就是没办法让它在下一个镜头里保持一模一样?这就是“一致性缺陷”的顽疾。Seedance 2.0通过一个类似于“@文件名”的引用系统,彻底解决了这个问题。这意味着,你可以在工作流中创建并“锁定”你的核心资产,比如一个特定的角色形象,一个独特的场景风格,甚至是一种固定的运镜方式或背景音乐。当你在后续镜头中需要这些元素时,你只需要用“@”来引用之前生成的或者上传的“资产”就可以了。这就像一个真正的导演在调度演员、布景和道具,他不需要每次都重新描述演员的长相,而是直接点名“某某演员”出场。这个机制让用户能够像真正的导演一样,精准地调度角色、场景、运镜、音乐,确保了跨镜头的一致性。这种“所见即所得”的引用和复用能力,是实现长视频、系列视频创作的关键,它让创作过程变得有迹可循,有据可依。

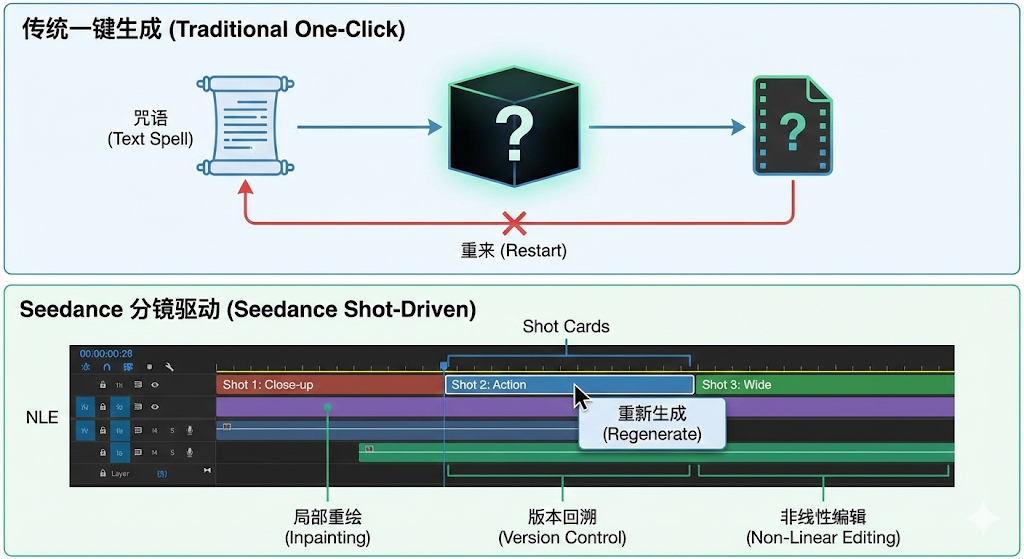

第三个支柱,也是Seedance 2.0最体现“导演工作台”理念的地方,就是它所倡导的“分镜驱动与工作流”的创作模式。传统的AI视频生成,往往是给你一个Prompt,然后直接生成一段视频,整个过程是线性的、一次性的。但Seedance 2.0则完全不同,它以分镜编辑器为核心,鼓励你先搭好视频的“骨架”,再逐步“填入”内容。你可以像制作电影分镜一样,规划好每一个镜头的时长、内容、衔接。更重要的是,它支持局部镜头的重生成和版本管理。这意味着什么?这意味着如果某个镜头生成得不满意,你不需要推倒重来,只需要针对这一个镜头进行迭代优化即可。你可以保留旧版本,尝试新版本,甚至回溯到之前的任何一个满意版本。这就像电影剪辑师一样,可以在时间线上对单个片段进行精修,而不影响整体结构。引用文档里提到,这种“分镜驱动、参考驱动、局部编辑”正是Seedance 2.0的三大标志。它彻底改变了AI视频创作那种“一锤子买卖”的模式,变成了可迭代、可修改、可精进的专业工作流。这种工作流的思维,把AI视频的生成从一个“黑箱操作”变成了“透明化”的、可控的生产过程,极大地提升了创作的效率和成功率。

工作台思维——为什么“可控性”比“生成能力”更重要?

在我看来,Seedance 2.0的这些技术革新,远不止是功能上的突破,它背后折射出的是整个AI视频行业竞争焦点的深刻转移。我们正在从一个“炫技Demo”的时代,大踏步地迈向一个“生产交付”的时代。在这个新的竞技场上,“可控性”的价值,无疑要远远超越了单纯的“生成能力”。

你想啊,前几年AI视频刚火起来的时候,大家看的是什么?是那些惊艳的画面,是那些“哇,AI也能做到这种效果”的Demo。那时候,谁能生成更酷炫、更不可思议的视频,谁就能抓住眼球。这很像当年各种图像生成模型刚出来时,大家都在比谁能画出更漂亮的猫猫狗狗,或者更抽象的艺术画作。那是个“比拼想象力天花板”的阶段。

但现在,随着技术的日益成熟,企业级的需求开始逐渐成为主导力量。对于企业来说,他们关注的早已不是“画面多好看”这种个人喜好层面的东西了,而是实实在在的“能否稳定交片”。我们曾看到过一些品牌短片制作的“残酷场景”案例。一个广告公司接了一个单子,客户要求三天内出几条短片。如果还在用那种“抽卡炼丹”的AI工具,可能你三天时间都花在重复生成、筛选、修补上了,最终可能一条都交不不出来。因为每一条都充满不确定性,画面元素飘忽不定,故事逻辑混乱不堪。这种“不可控”的风险,在商业生产中是致命的。品牌方需要的是确定性、一致性、以及迭代调整的能力,而不是偶尔蹦出来的“惊艳之作”。所以,行业已经来到了一个转折点,我们需要的是能稳定输出“能用作品”的工具,而不是偶尔能生成“好看Demo”的玩具。

那么,Prompt这种看似万能的“咒语”,为什么它撑不起生产级的交付呢?在我看来,它至少有四大死穴。

首先是它的结构缺陷。视频是一种序列化的艺术,它有时间线,有分镜,有节奏,信息是线性的、流动的。而Prompt,本质上是一种扁平化的描述。你很难用一段干巴巴的文字,去精确地描述一个包含多个人物、复杂场景切换、情绪起伏、运镜变化的完整视频叙事。Prompt的这种结构局限,决定了它在复杂叙事场景下的先天不足。

其次是它的一致性缺陷。前面我们也提到了,这是所有基于Prompt的生成模型普遍存在的问题。当你要求模型生成一个有特定角色或场景的系列镜头时,模型很难在不同镜头之间保持元素的稳定。角色会“漂移”,场景会“闪烁”,这直接导致了视频的连贯性被破坏,无法满足制作统一内容的需求。

再者是节奏缺陷。视频的节奏感对于叙事至关重要。是快是慢,是紧张还是舒缓,是特写还是全景,这些都需要精确地控制。但Prompt很难精确表达这种时间层面的控制需求。你很难用文字去告诉AI,这个镜头需要3秒钟的特写,然后快速切换到5秒钟的全景,再配上某种节奏的音乐。这种对时间轴和镜头语言的精细化控制,是Prompt无力承担的。

最后是迭代缺陷。这是最让人头疼的一点。当你的视频生成出来,发现某个细节不满意时,Prompt的修改往往是牵一发而动全身的。你修改了一个词,整个视频可能就面目全非,甚至引发新的问题。你没有办法只针对某一个局部进行精准调整,这使得迭代成本极高,效率极低。这种“推倒重来”的迭代方式,在任何生产流程中都是不可接受的。

Seedance 2.0所代表的,其实是一种“最小可用导演台”(MVD)的思维。它不是试图让AI变得更聪明,而是试图让用户对AI的控制变得更像一个“导演”。它提供了一系列产品化的导演逻辑模块,让AI从一个“黑箱生成器”转变为一个“透明工作台”。这个工作台包含了至少六大核心模块。首先是分镜编辑器,它让创作者可以规划视频的整体结构和时间线。其次是镜头控制面板,让用户能精细调整每一个镜头的参数,比如视角、景别、运动轨迹。然后是资产库,用来存储和复用角色、道具、场景等核心元素。接着是参考素材区,刚才提到的多模态输入就在这里发挥作用。还有必不可少的版本管理功能,让每一次修改都有迹可循,随时可以回溯。最后,也是非常重要的失败诊断模块,它能帮助用户理解为什么某个镜头生成失败,或者哪里出了问题,从而提高调整的效率。这些模块的组合,让用户第一次感受到了对AI视频创作的全面掌控,不再是碰运气,而是有章可循、有法可依。

范式迁移的行业启示——互联网从业者该如何应对?

Seedance 2.0所带来的这种范式迁移,对于我们这些互联网从业者来说,绝不仅仅是多了一个好用的工具那么简单。它更像是一个警钟,提醒我们整个行业的游戏规则正在悄然改变。无论是产品经理、运营人员还是战略制定者,都需要重新思考,我们该如何应对这场变革。

从产品设计的角度看,我们必须跳出“生成工具”的思维,转而构建“创作生态”。过去,很多AI产品经理可能把注意力都放在了如何提升模型生成效果上,比如让画面更清晰,动作更流畅。但Seedance 2.0告诉我们,单一的生成效果再好,如果不能融入一个流畅、高效的工作流,它就无法真正成为生产力。所以,未来的产品设计,应该更聚焦于工作流的闭环体验。这包括如何让用户方便地导入各种参考素材,如何管理他们的创作资产,如何实现团队协作。例如,建立像“角色卡”、“场景卡”这样的资产沉淀机制,让用户可以在不同项目、不同镜头中复用和迭代这些资产,这不仅仅是提高了效率,更是在无形中构建起了用户对平台的依赖和护城河。谁能把整个创作链路设计得更顺畅,谁就能在未来的竞争中占据优势。

在指标体系上,我们的关注点也要从“惊艳度”转向“交付成功率”。还记得吗,早期AI图像或视频产品,发布会上最喜欢展示的就是那些“令人惊叹”的Demo,然后用户也会被这些Demo所吸引。但这是一种“Demo内卷”,它并不能真正反映产品的生产力。未来,我们需要重新定义衡量AI视频工具价值的指标。比如说,一套新的指标体系可能包括:交付成功率,也就是用户在给定时间内,完成一个符合要求的视频项目的比例;一致性达标率,确保角色、场景等核心元素在多镜头中的稳定性;迭代效率,即用户修改一个不满意镜头所需的平均时间和操作步骤;还有资产复用率,看看用户有多少内容是基于已有的资产快速生成的。这些面向生产效率和质量的指标,才能真正反映一个AI视频工具的商业价值,帮助我们避免陷入无意义的“Demo军备竞赛”。

最后,从战略布局层面来看,我坚信“工作流是长期护城河”。为什么这么说呢?因为从技术发展规律来看,模型能力,也就是我们常说的生成效果,最终是会趋于同质化的。今天你觉得某个模型的画质特别好,明天可能就有别的模型也达到了类似甚至超越的水平。模型的底层技术会逐渐开源,算法的进步也会惠及整个行业。当底层模型能力不再是核心竞争力的时候,真正的竞争就会转移到上层应用,也就是谁能提供更符合专业生产习惯的工作流,谁能构建更完善的创作生态。商业化路径也会随之清晰,很可能就是基础功能免费,而针对企业级用户的增值服务,例如高级素材库、团队协作、私有化部署、更强大的算力支持等,会成为主要的盈利点。切入企业级市场,提供高效稳定的生产解决方案,将是AI视频工具长期发展的必经之路。

结语:未来已来,只是分布不均

Seedance 2.0的发布,在我看来,不仅仅是字节跳动在AI视频领域的一次重大突破,它更像是为整个行业竖起了一面旗帜,标志着AI视频从那个充满不确定性的“童年玩具”阶段,正式迈入了更加成熟、更加可控的“青年生产工具”阶段。这无疑是一个具有里程碑意义的技术事件。

从技术意义上讲,它让我们看到了AI视频从“描述式生成”向“指令式导演”转变的巨大潜力。这不再是AI单向地“创作”,而是创作者与AI协同,共同完成一部作品。这种范式革命,将极大地降低视频内容的生产门槛,提升生产效率,就像当年桌面出版技术对印刷业的冲击,或者非线性剪辑对影视后期制作的颠覆。

从行业意义上讲,这场变革势必将引发内容生产成本的“超级通胀”。过去,制作一部高质量的视频需要高昂的成本和漫长的周期。但随着Seedance 2.0这类“导演工作台”的普及,个人创作者、小型团队甚至大型制作公司,都能以更低的成本、更快的速度产出专业级别的视频内容。这无疑将重塑影视、广告、短剧等一系列对视频内容有强需求的行业格局。未来,创意和故事本身将变得更加重要,而技术的瓶颈会越来越小。

所以,作为互联网从业者,我们现在与其盲目追逐各种模型的最新“惊艳Demo”效果,不如沉下心来,深入理解这种“工作流”的本质,并积极投身到这种“生态构建”中去。因为Seedance 2.0不是终点,它仅仅是AI视频“工作流竞争”时代的起点。真正的挑战和机遇,才刚刚拉开序幕。

本文由 @云端写信 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自作者提供

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益