当推理成本降到原来的1/100,AI产品还能怎么活?

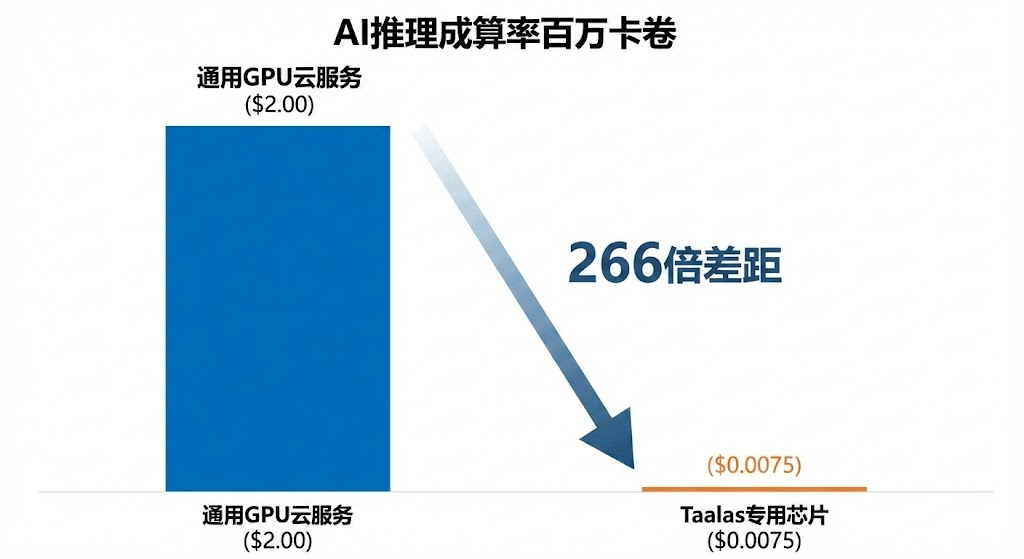

加拿大公司Taalas的革命性技术将Llama 3.1 8B模型的推理成本降至0.75美分/百万token,比传统GPU云服务低266倍。这不仅颠覆了AI产品的成本结构,更迫使产品经理重新审视定价逻辑、场景选择和交互设计。当推理变得又快又便宜,那些曾被成本扼杀的需求或将迎来新生,而现有的交互范式也面临全面重构。

一家叫Taalas的加拿大公司,把Llama 3.1 8B的推理成本打到了0.75美分/百万token。

你现在用的通用GPU云服务大概是2美元/百万token。差了266倍。

如果你正在做AI产品,这个数字意味着:你Excel里那个怎么都调不绿的ROI模型,可能突然就算得过账了。

我上周试了他们的demo(chatjimmy.ai),输入一段话,回车。没有逐字输出,没有loading动画,整段回复直接”弹”在屏幕上——快到我怀疑”它有没有认真想”。这种不适感背后是一个更大的问题:我们现有的定价逻辑、场景选择、交互设计,全都建立在”推理很贵、推理很慢”的假设之上。这个假设正在崩塌。

一、成本重算:现有的ROI模型可能已经过期了

1.1 先搞明白它干了什么

Taalas干的事情用一个类比就能说清:

传统方案像每次做数学题都要去图书馆借公式表——算一步,查一趟,再算一步,再查一趟。图书馆(HBM内存)和你的书桌(计算单元)之间那条路,就是最大的瓶颈。NVIDIA的解法是把图书馆搬近一点、路修宽一点——但路还是要走的。

Taalas的解法是直接把公式表纹在你手臂上。不用跑了。

他们把Llama 3.1 8B的全部模型参数直接固化在芯片的晶体管里。数据从头到尾不离开芯片,”内存墙”这个概念对他们不存在。

代价是什么?这块芯片只能跑这一个模型。 换模型?重新做芯片。这是产品管理中最极端的一次trade-off:用100%的灵活性,换10-73倍的性能提升和20倍的成本降低。

这里有一个关键细节让这个trade-off不那么可怕:他们只需要定制芯片最上面两层金属层,其余100多层都是标准的。这意味着从拿到新模型权重到交付可用的硬件卡,只需要两个月,而不是传统芯片的半年。灵活性虽然在”同一块芯片上”归零了,但在”换芯片”这个维度上,速度够快就能对冲。

不过也别被这个两个月迷惑——第一代产品的量化精度有妥协(3bit+6bit的激进方案),输出质量确实不如标准精度版本。对输出质量要求严苛的场景暂时不适用。第二代已经在改用标准4bit格式。

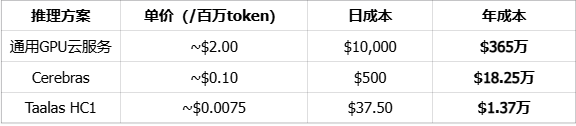

1.2 一张让老板坐直的表格

理解了原理,我们来算个账

假设:我们的AI产品DAU 100万,每用户每天消耗5,000 tokens,也就是大概3~4轮对话

从365万美元到1.37万美元。

这不是”省钱”的量级了。这是”项目根本立不住”和”闭着眼睛都赚钱”之间的鸿沟。

很多做AI产品的朋友,跟老板汇报ROI时,推理成本是那个让整张Excel泛红的变量。不管你怎么调用户增长假设、怎么优化转化率,只要推理成本卡在那里,LTV就是覆盖不了CAC。当这个变量降低两个数量级,大量之前被判”商业不可行”的产品方向,要被重新打捞出来了。

假设我们在做一个企业级智能客服产品。客户是一家电商平台,日均咨询量50万次,每次对话平均消耗3000 tokens。那么这个时候我们的成本结构里,推理费用是大头。

用通用GPU云服务:50万×3000tokens×$2/百万token=每天3000美元,每年109万美元。这笔钱直接吃掉了给客户报价的空间——总不可能比客户自建客服团队还贵

如果推理成本降到Taalas级别(0.75美分/百万token):同样的调用量,每天1.13美元,每年412美元。

这意味着什么?推理成本从成本结构的”主角”变成了”误差项”。我们的定价逻辑可以从”卖算力”彻底转向”卖效果”——按问题解决率收费、按客户满意度收费、按替代人工坐席的数量收费。推理成本不再是定价的锚点,业务价值才是。

:当我们的产品成本结构中推理费用占比从60%降到0.5%时,那我们的竞争壁垒就不再是”谁拿到了更便宜的GPU“,而是”谁的业务理解更深、谁的解决方案更完整”。 而这恰恰是产品经理的主场。

但是这里我可能需要泼一盆冷水: Taalas至今没有公布HC1的售价,上面的成本数据来自他们自己公布的单位成本估算。在没有公开定价和第三方实测之前,这张表格的绝对值要打问号——但数量级的差异方向是确定的。这不只是Taalas一家的故事,Epoch AI的数据显示推理成本中位数每年降50倍。方向是确定的,区别只在于业务能不能等到那一天。

1.3 马上就能做的三件事

任何的行动一定要落地,不能只在脑子里”认知重构”。虽然目前HC1的售价尚未公布,但是推理成本暴降这件事,我认为有三个可以立刻启动的产品动作:

第一件:拉一张”被成本杀死的需求”清单。

打开你过去一年的需求评审记录或周报,找到所有因为”调用成本太高”而被毙掉的功能

常见的”成本受害者”包括:多步推理校验(让AI自己检查自己的回答,需要两次推理)、多模型投票(同时调用三个模型取最优,成本直接×3)、实时逐句翻译(每句话都要过一遍大模型)、Agent连续调用(一个任务触发5-10次推理链)、全量数据AI标注(手动标注太慢但AI标注太贵)

把这些需求列出来,用1/100的推理成本重新算一遍ROI。我们可能会发现,被我们亲手埋掉的需求里,藏着下一个增长点。特别是”多步推理校验”——当推理成本趋近于零时,让AI自检、自纠、多轮优化输出质量,变成了几乎零边际成本的事情。这对产品的交付质量提升是质的飞跃。

第二件:在产品成本模型里加一个”推理成本弹性系数“。

不要再用固定值了。推理成本中位数每年降幅在10-50倍之间。你的三年规划应该包含三组成本假设:保守(年降5倍)、中性(年降10倍)、激进(年降50倍)。然后看看,在”激进”假设下,哪些产品方向突然变绿了——那就是应该提前布局的方向。

第三件:跟技术负责人约一次”Build vs Buy”讨论。

议题很明确:我们的核心推理场景,是否存在”模型固定、调用量大、延迟敏感”的特征?如果答案是肯定的,专用芯片方案值得被放上选项清单——不一定是Taalas,但”为特定模型定制硬件”这个思路,在推理成本战争中正在变得越来越有经济合理性。

二、场景重选:不是所有业务都需要一把”瑞士军刀”

2.1 一个每个PM都懂的类比

通用GPU像瑞士军刀——什么都能干,什么都不极致。

ASIC专用芯片像手术刀——只能做一件事,但那一件事做到了物理极限。

当手术需求足够大、足够标准化时,没有医生会拿瑞士军刀上手术台。

这个类比成立的前提是:我们的”手术”确实是标准化的。如果每天做的手术都不一样,瑞士军刀反而更好用。所以关键问题不是”专用芯片好不好”,而是业务场景是否已经收敛到”一把手术刀就够了”的程度。

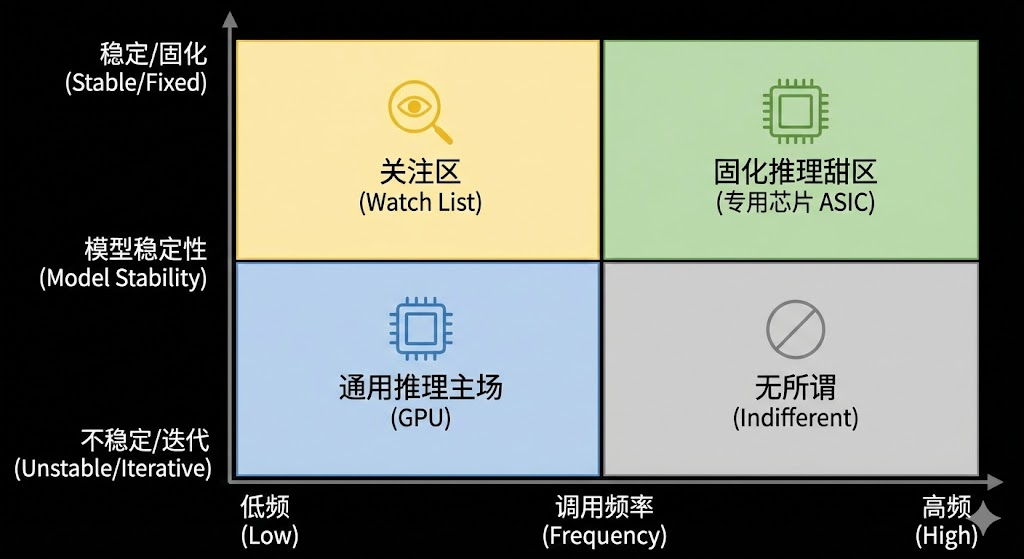

2.2 判断场景在哪个象限

左上角那个绿色象限,就是Taalas类方案的精确打击区。

Zoho创始人Sridhar Vembu说了一句很有画面感的话:想象一个芯片专门生成食谱代码,代码再驱动烹饪机器——每台设备里装一块专用推理芯片,就像每台设备里装一个电机一样自然。

这个愿景落到B端场景里就是:智能客服不需要跑通用大模型,它只需要跑那个针对你业务场景微调过的7-8B模型,但要跑得极快、极便宜、极稳定。当这个需求足够明确时,为它定制一块芯片,可能比每年付几百万云推理费用更划算。

让我们把这个逻辑落到一个具体的场景里。

假设做一个工业质检AI产品。客户是一家汽车零部件工厂,产线上每秒过一个零件,每个零件需要AI做缺陷检测。一天工作16小时,就是57,600次推理调用。这个场景的特征极其鲜明:

- 模型固定:质检模型半年才更新一次,而且每次更新只是微调参数,不换架构

- 延迟敏感:零件在传送带上不等人,100毫秒的延迟就意味着漏检

- 功耗受限:产线边上没有机房,只能用风冷设备

- 成本敏感:工厂采购决策看的是三年TCO,云推理的持续支出让他们焦虑

这个场景几乎是为”固化推理”量身定做的。Taalas的HC1功耗200W、风冷部署、毫秒级响应——完美匹配。而且两个月的流片周期意味着,当质检模型微调升级时,新芯片可以在下一个季度交付。

但更重要的是确定性。现在用GPU云推理,工厂最恨的不是贵,是不稳定——产线不能停,但云服务的延迟波动偶尔会让零件卡在摄像头前等半秒,后面整个流水线都得降速。Taalas的方案不只是便宜,是每颗芯片只跑这一个模型,响应时间像机械表一样准。对工厂来说,”确定性”三个字值的钱,可能比成本降低本身还多。

相反,如果你做的是一个企业知识库问答产品,客户今天想接Llama,下周想试试DeepSeek,下个月又考虑换成自训模型——这种场景就应该老老实实用通用GPU方案,灵活性在这里是刚需。

不过这里有一个反直觉的观察:很多客户嘴上说”要灵活性”,实际半年没换过模型。 如果你的客户也属于”嘴上说不要,身体很诚实”的类型,值得重新评估——他们真的需要那把瑞士军刀吗?还是只是因为”万一要换呢”的心理保险在替他们做决策?

但模型锁定风险是真实的。Taalas创始人自己承认,这个方案的核心假设是”客户愿意为这个芯片/模型组合锁定至少一年”。在AI模型迭代极快的当下,让客户做这个承诺不容易

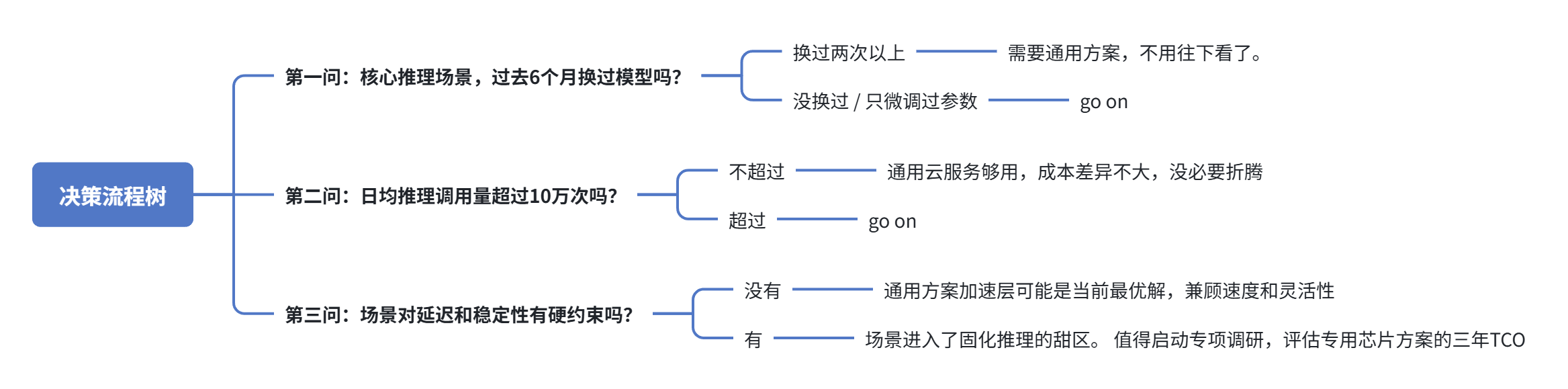

2.3 一棵选型决策树

说了这么多”适合”和”不适合”,给一个可以直接拿去开会的决策流程:

第一问:核心推理场景,过去6个月换过模型吗?

→ 换过两次以上 → 停,你需要通用方案,不用往下看了。

→ 没换过 / 只微调过参数 → 继续。

第二问:日均推理调用量超过10万次吗?

→ 不超过 → 通用云服务够用,成本差异不大,没必要折腾。

→ 超过 → 继续。

第三问:场景对延迟和稳定性有硬约束吗?

→ 没有 → 通用方案加速层可能是当前最优解,兼顾速度和灵活性。

→ 有 → 场景进入了固化推理的甜区。 值得启动专项调研,评估专用芯片方案的三年TCO。

推理芯片市场正在分层——NVIDIA在2025年底花200亿收编了Groq团队来补推理短板,Taalas这边24人团队刚融了2.19亿美元、路线图是2026年底推出支持前沿大模型的HC2平台。巨头在防守,新锐在进攻,“通用GPU一统天下”的格局正在松动,按需选型的窗口已经打开。

现在就可以做的事:拿这棵决策树,跟CTO约30分钟,把现有的推理场景过一遍。如果走到了最后一步,值得把专用芯片方案放上选项清单。

三、交互重改:当AI回复快到”不像AI”

3.1 现有的所有交互设计,都是为”慢”而生的

这部分要回到引子里那个让我略微不适的体验。

先看一下为什么chatjimmy.ai的回复”弹”得那么快。Taalas的HC1芯片推理速度是17000tokens/秒。一段500token的标准回复,生成时间是500/17000 = 0.03秒。作为对比,主流GPU的推理速度大概是200-300tokens/秒,同样的回复需要1.5-2.5秒。

这个速度差距意味着什么?打开任何一个AI聊天产品,你会看到:逐字输出的流式效果、”正在思考…”的加载动画、打字机式的文字呈现、骨架屏和进度条。

这些设计存在的原因是:AI回复需要1-3秒才能生成完毕,我们需要管理用户在这段时间里的焦虑感,让用户看到我们正在运行

当推理速度达到17000tokens/秒时,500token的回复在0.03秒内全部生成完毕。那么这时候我们精心设计的流式输出动画,在这个速度面前不是”优化体验”,而是”人为制造拖延”。

这不是一个小问题,我认为这意味着围绕”等待”建立的整套设计语言都要更新。

3.2 三个具体的交互命题

命题一:实时语音对话从”演示”变成”产品”。

如果你做过语音交互,你知道最大的卡点不是语音识别、也不是TTS,而是中间LLM的思考时间。用户说完一句话,等1-3秒才能听到回复——对话感完全被打断,像在跟卫星电话那头的人聊天。

17000tokens/秒意味着LLM思考时间被压到毫秒级。语音交互的瓶颈从”AI在想”变成了”麦克风和喇叭的物理延迟”。 如果你的产品有语音交互需求,这个变化直接影响产品形态——从”语音版聊天框”进化为”真正的实时对话”。

命题二:AI从”对话伙伴”变成”实时协处理器“。

当AI回复快到用户感知不到延迟,交互模式可以从”一问一答”变成”连续协作”。代码编辑器里每敲一行代码,AI同步给出补全建议——不是后台慢慢加载,是跟你的打字速度同步呈现。AI客服后台里每输入一条用户反馈,分类、情感分析和建议回复同时出现。

共性是:AI的响应速度快到融入了用户的操作流,而不是打断它。 这对交互设计的要求完全不同——你不再是在设计”对话界面”,而是在设计”增强型工作台”。

如果你做过B端产品,你对这个区别应该有体感。B端用户的核心诉求是”效率”,他们最恨的就是”切换上下文”——从自己的工作流里跳出去问AI,等AI回复,再跳回来继续干活。如果AI的响应速度快到可以嵌入用户的连续操作中,”切换上下文”这个问题就从根本上消失了。AI不再是你要”去找”的工具,而是你工作台上一直亮着的一盏灯。

这也意味着产品形态的变化。当前大多数AI功能是”对话框模式”——侧边栏弹出一个chat窗口,用户在里面输入问题。但在极速推理场景下,更合理的形态可能是”内联模式”——AI的输出直接出现在用户正在操作的位置,不需要跳转、不需要复制粘贴、不需要任何额外的交互步骤。

命题三:太快反而会”翻车”。

这个反直觉但极真实。

2000字的回复瞬间出现在屏幕上,用户来不及消化。流式输出虽然是因为”慢”才存在的,但它客观上给了用户一个”逐步阅读”的节奏——像有人在面前一句一句说。瞬间呈现则像有人把一沓A4纸拍在你面前说”看吧”。

更麻烦的是信任问题。用户心理研究反复表明,“太快”的回复会让人觉得”没认真想”。就像你问医生一个复杂问题,他0.5秒就答了——你反而不信。AI产品可能需要设计一个”合理的思考时间”来维持信任。这听起来荒诞:我们费尽心思提速,最后还要人为加回延迟?但人类的直觉就是这样——信任不只来自准确性,也来自”它看起来是否认真对待了我的问题”。

这里有一个很实际的设计决策需要做。我把它叫”速度-信任光谱”:

- 事务性任务(查数据、格式转换、状态查询):越快越好,0延迟是最佳体验。用户不需要AI”思考”,只需要AI”执行”。

- 分析性任务(数据洞察、方案对比、风险评估):需要适度的”思考感”。可以用结构化输出替代人为延迟——先出结论,再展开依据,让用户感知到AI”做了功课”。

- 创造性任务(文案撰写、方案设计、策略建议):最需要”慎重感”。可以先展示AI考虑了哪些维度,再给出结果。

关键洞察:解决”太快”问题的方法不是加延迟,而是加结构。 当AI的输出从一整坨文字变成”结论→依据→备选方案”的分层结构时,即使它是瞬间出现的,用户也能感知到”它想了很多”。

3.3 马上就能做的事

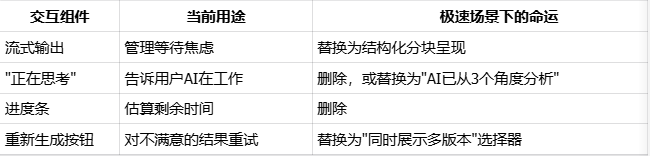

做一次”零延迟压力测试“。 花半天时间,把产品里的每一个交互组件过一遍:

- 这个流式输出动画——如果回复是瞬间完成的,它还需要存在吗?

- 这个”正在思考…”的文案——在0.03秒出结果的场景下,它是”安抚”还是”碍事”?

- 这个进度条——如果没有等待,它放在哪里?

- 这个”重新生成”按钮——如果AI可以在毫秒内同时生成三个版本让用户选,你还需要”重新生成”吗?

不需要改任何代码。只需要在我们的设计文档里标注:哪些组件是”为慢而生”的,哪些是”速度无关”的。 当推理速度真的跳上来那天——可能是三个月后,可能是一年后——你的设计系统已经准备好了切换方案,不用从头返工。

我建议把压力测试的结果整理成一个简单的三列表格:

这张表格的价值不在于现在就执行,而在于当技术条件成熟时,你的设计决策已经想清楚了。大多数团队在技术跳变发生时,设计侧永远在追着补课。提前做完这个练习,你就是那个不用追的人。

同时,开始关注”信息分层”设计:摘要-详情、要点-论据、结论-过程。当”等AI说完”不再是问题,”理解AI说了什么”就成了新的体验瓶颈。这套分层能力,不管推理速度怎么变,都是加分项。

结语:方向确定,节奏自己定

方向是确定的——推理成本暴降、专用芯片崛起、交互范式迁移,不可逆。Taalas只是最激进的案例。即使它自身不成功,这条技术路线也必然被其他玩家推进。

但节奏需要自己判断。HC1目前还是Technology Demonstrator,没有公开定价,生态近乎空白,第一代输出质量有妥协。如果已有的业务对这些短板敏感,现在不是All-in的时候。

PM的价值从来不在于”第一个冲进去”,而在于”在正确的时机做正确的准备”。

模型能力的变化改变的是”AI能做什么”,推理经济学的变化改变的是”AI产品怎么活”。后者,才是产品经理的主场。

基于Taalas HC1芯片公开信息(来源:EE Times、CNX Software、Next Platform、Kaitchup等)、Deloitte 2026 TMT预测、Epoch AI推理成本研究、NVIDIA-Groq交易公开报道等材料撰写。

文中成本计算为简化估算,实际部署成本受多种因素影响,仅供各位大大参考;

本文由 @浩思AI 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

起点课堂会员权益

起点课堂会员权益

有一个问题,在拿到模型参数进行芯片定制的两个月时间内,如果模型更新迭代,参数发生变化了该怎么办呢?

完全可以用旧的模型接着往下走,如果一定要换新模型那就只能重新做芯片了;不过这个芯片不适合频繁更换模型的场景,成本太大了,他更适合那种核心业务模型已经固化且高频调用的场景