AI产品到底应该”替我做主”,还是”给我建议”?

从土木工程到AI产品经理的跨界之路,作者用亲身经历揭示了AI工具对科研工作的双重影响。当Claude Code等AI工具几乎包揽了课题的所有技术实现,一个根本性问题浮现:AI究竟应该替代决策还是辅助决策?本文深度剖析效率诱惑背后隐藏的认知外包陷阱,并提出重构AI产品设计的核心维度——如何在提升效率的同时守护人的能力成长。

我的本科专业是土木工程。说出来可能有点八竿子打不着——土木,那个和钢筋混凝土打交道的专业,和AI产品经理这个词放在一起,感觉像两个平行宇宙的东西。但我就是那种会在宿舍里把所有新出的AI产品挨个试一遍的人,痴迷程度到最后干脆转了行,跑来做AI产品经理了。

研究生阶段,我的课题是纯数值模拟方向,没有物理试验,所有数据全靠电脑跑。这对我来说简直是天赐良机——没有实验室、没有仪器,一台电脑打天下,正好把我对AI产品的那股劲儿全砸进去。从开题开始,我就用 Claude Code 配合各种大模型,处理数据、生成代码、分析结果、调参数,越用越顺手,真正做到了那种”vibe科研”的状态——感觉对了就往前冲,AI帮我扫平一切技术路障。

前几天,我坐在电脑前,盯着硬盘里接近上百GB的项目文件,课题眼看就要收尾了。

然后我愣了一下。

我没有亲手写过一行代码。我也没有打开过Origin,画过一张图。

这个课题,到底算不算是我做的?

这个问题没有标准答案,但它把我最近一直在脑子里转的一件事给逼出来了:AI产品到底应该“替我做主”,还是“给我建议”? 这个问题表面上是在聊产品设计,但往深了想,问的其实是——我们想要什么样的自己。

先说实话:替我做主,真的很爽

在我展开那个不安感之前,得先做一件事:老老实实承认另一面。

因为”AI替我做主”这件事,有一种非常真实的爽感,而且这种爽感是有充分理由撑着的。

就说我自己的科研。课题里有大量数值模拟迭代,参数调整、模型收敛、结果后处理,每个环节如果手动来做,都是大量重复性操作。用AI之后,我可以把精力真正放在”这个结果说明了什么”上,而不是”怎么把这个结果画出来”上。从这个角度看,AI帮我做掉了那些低价值的执行工作,让我能聚焦在真正需要动脑子的部分。

这不是偷懒。这是认知资源的合理分配。

再说 Manus。给它一个目标,它自动拆解任务、调用工具、搜资料、出结果,全程不来问你”这个数据要不要”、“这个来源可信吗”。它直接给你结论。以前用搜索引擎,你是在”找信息”;现在用 Agent,你是在”收结论”。这不是同一种体验,是两种完全不同的认知状态。

甚至不用举这么新的例子。你每天上班用高德导航,从来不知道它为什么选这条路不选那条,但你就跟着走了,而且大概率比你自己选的更快。这是已经跑了十年的”替你做主”,你早就接受了,甚至压根没意识到它存在。

在效率这个维度上,替我做主不只是合理的,它是不可逆的趋势。 抗拒它,就像抗拒用计算器——不是道德问题,是认知问题。

所以如果这篇文章到这里就结束,结论会很简单:放手吧,让AI替你做主,你会活得更轻松。

但我没办法就这么收尾,因为裂缝出现了。

第一道裂缝:准确不等于有权,效率不等于正确

效率视角没问题,但它藏着一个前提,一个我们很少去戳破的前提:“更优的结果”是可以被客观定义的。

我开始怀疑这个前提,是从一件很小的事开始的。

有一段时间我特别依赖网易云的每日推荐。它极其精准地知道我喜欢什么风格,每天给我推一批我几乎全都会喜欢的歌。大概两个月之后,我突然意识到一件事:我已经很久没有主动去”发现”一首歌了。

以前我会在朋友的歌单里翻到一首完全不在我舒适区的歌,然后被它莫名击中。那种感觉之所以珍贵,是因为”意外”——它不在我的预期里,所以它打开了一扇我没想到的门。但算法不会给你意外。算法给你的是你已经喜欢的东西的加强版。它越精准,你的世界就越窄。你以为在享受音乐,其实是在对着一面越来越光滑的镜子——里面只有你自己的回声。

这不是算法出了bug,这是算法完美运行的结果。当AI把“你喜欢的”等同于“对你好的”,它就已经越界了。

然后我把这个逻辑放回到我的科研上,开始觉得哪里不太对劲。

我的课题方向是我自己定的,研究问题是我提出的,结论是我来判断的。但中间那条路——从问题到结论之间的所有技术实现——全部是AI走的。我相当于站在起点和终点,中间那段路程,我没走过。

以前的科研训练里有一个隐含的价值,是不怎么被人提起的:你在走那条路的过程中,会遇到意想不到的东西。 一个参数调错了,结果反而更有意思;一个模型跑崩了,排查的过程里发现了一个更深的问题。这些”意外”,才是科研真正的养分。但我的AI帮我把路走得太顺了,顺到我没有机会遇到那些意外。

我得到了一个接近完成的课题,但我不确定我是否真正经历了这段科研。

第二道裂缝:我以为我在用AI,AI也在用我

第一道裂缝让我开始怀疑”最优结果”的定义。第二道裂缝更深,也更让我坐不住。

我们说”AI替我做主效率更高”,这句话默认了一件事:人类的偏好是稳定的输入,AI是处理这个输入的工具。但现实是——人类的偏好本身,正在被AI的输出悄悄重塑。

还是说抖音,但我不想再扯”信息茧房”那套,这个词已经被说烂了。我想说一个更底层的问题:当你连续三个月刷到的都是某种风格的内容,你的审美标准、你对”好内容”的判断,已经被悄悄改写了。不是说你被洗脑了,而是你的评价体系本身发生了漂移。你现在觉得”好”的东西,和三个月前你觉得”好”的东西,已经不是同一个标准了。

然后算法继续根据你”现在”的偏好来推送,你的偏好继续被推送塑造,推送继续根据被塑造后的偏好来推送……

你以为你在用算法,算法在用你的反馈训练自己,而你的反馈本身,已经是被算法训练过的反馈。这是一个闭环,出口在哪里?

放回到我自己身上,这个感觉更具体。

我用 Claude Code 做科研的这一年多,有一个能力从来没有被真正锻炼过:独立调试一个跑不通的数值模型的能力。

不是因为我没遇到跑不通的情况,而是每次遇到,我的第一反应不是自己去排查,而是把报错信息扔给Claude Code,让它告诉我哪里错了。它说,我改,改完继续跑。这个闭环极其高效,但有一个代价:我从来没有真正建立起”遇到这类问题,我应该怎么思考”的内部框架。

那个框架,本来应该是在一次次排查中磨出来的。但我把那个过程全外包了。

如果有一天,在某个需要我独立解决这类问题的场景里,没有AI可以用,我会怎样?我不确定。这个不确定本身,就是一个值得认真对待的信号。

重构问题:真正的战场不是能力边界,是授权边界

说到这里,我意识到自己之前的思考一直在讨论一个错误的问题。

“AI能不能替我做主”这个问题,本身就是个陷阱。它把问题框在AI的能力维度,但真正重要的问题是另一个:我有没有清醒地知道,我在哪里授权它做主,在哪里保留了自己?

这是一个产品经理视角的根本性重构,也是我这篇文章真正想说的事。

苹果推出 Apple Intelligence 的时候,有一个贯穿所有功能的设计原则:AI做的所有事情,用户必须能感知、能撤销、能关闭。这不是技术上的保守,也不是在讨好监管,这是对”授权边界”的产品化表达。背后的意思是:AI可以帮你做,但你得知道它做了什么,而且你随时可以说不。

有感知的授权和无意识的滑入,是两件完全不同的事。

再看 Claude Code 的设计。它有”全自动执行”模式,也有”每步确认”模式。真正成熟的用法,不是选全自动然后去泡咖啡,而是清楚地知道:在哪些模块上可以放手,在哪些核心逻辑上必须自己盯着。这个判断本身,就是一种只有人能做的事。

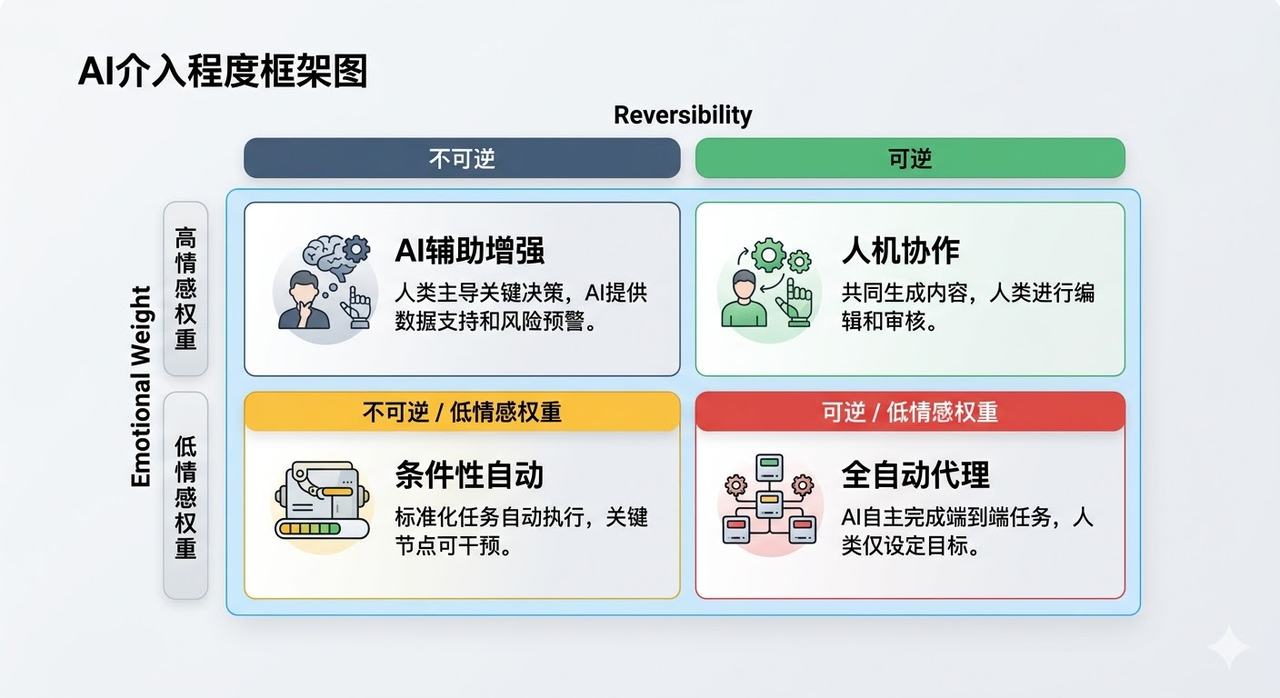

我自己摸索下来,有了一套粗糙但还算管用的框架,叫“决策颗粒度”:

- 可逆且情感权重低,比如生成代码初稿、整理数据格式、排版文档——完全可以让AI做主,人不需要在场,省下来的精力去做更值钱的事。

- 可逆但情感权重高,比如科研方向的微调、回复一封重要邮件——AI可以给建议,但最后那一步得你自己走,因为”是你判断的”这件事本身有意义。

- 不可逆且情感权重低,比如关键参数的设定、技术路线的选型——AI给分析,人拍板,但你得真正看懂AI给你的方案,不能闭眼接受。

- 不可逆且情感权重高,比如课题的核心研究问题、职业方向——AI最多当参谋,做主的必须是你,因为你要用之后很长的时间去消化这个决定,那个消化的过程需要你完全在场。

回看我的科研经历,问题出在哪里其实已经很清楚了:我在第一个象限用得很好,但不知不觉把第三个象限的很多东西也滑进了”全自动”模式。那些本应由我亲自走过的技术路径,我让AI替我走了。我没有意识到那些路径对我来说是”不可逆”的——不是结果不可逆,而是那段经历不可逆。走过和没走过,是两种不同的人。

最深的那个问题:你是选择了这样,还是滑进来的?

前面四层思考,都还在聊”怎么更好地用AI”。但我最后想说的,是一个更根本的东西。

有一种情况,比”AI替我做主”更危险,那就是:在完全没意识到的情况下,把做主权一点点拱手相让。

两者的区别,是主动授权和被动滑入。

主动授权是:我清楚地知道这件事我不需要亲自做,我选择让AI来处理,我知道它做了什么,我随时可以改变这个安排。

被动滑入是:我不知道从什么时候开始,我已经不再自己做这类决定了。不是因为我选择了这样,而是因为每次让AI来做都更方便,于是就一直这么下去了,直到某天我发现——我好像已经不太会自己做了。

我的科研经历,就是一个非常标准的被动滑入案例。

我从来没有在某一天做过决定说”从今天起,我要让AI替我写所有代码”。是一点点滑进去的:第一次让它帮我写一个数据处理脚本,因为那部分真的很繁琐;第二次让它帮我解一个报错,因为我看不懂;第三次让它帮我生成一整个模块,因为上次它做得挺好……每一次都有充分的理由,每一次都是当下最理性的选择,但这一系列理性选择叠加起来的结果,是一个我没有主动选择的状态。

等我坐在那上百GB的项目文件前发呆,才意识到:我不是选择了这种科研方式,我是滑进来的。

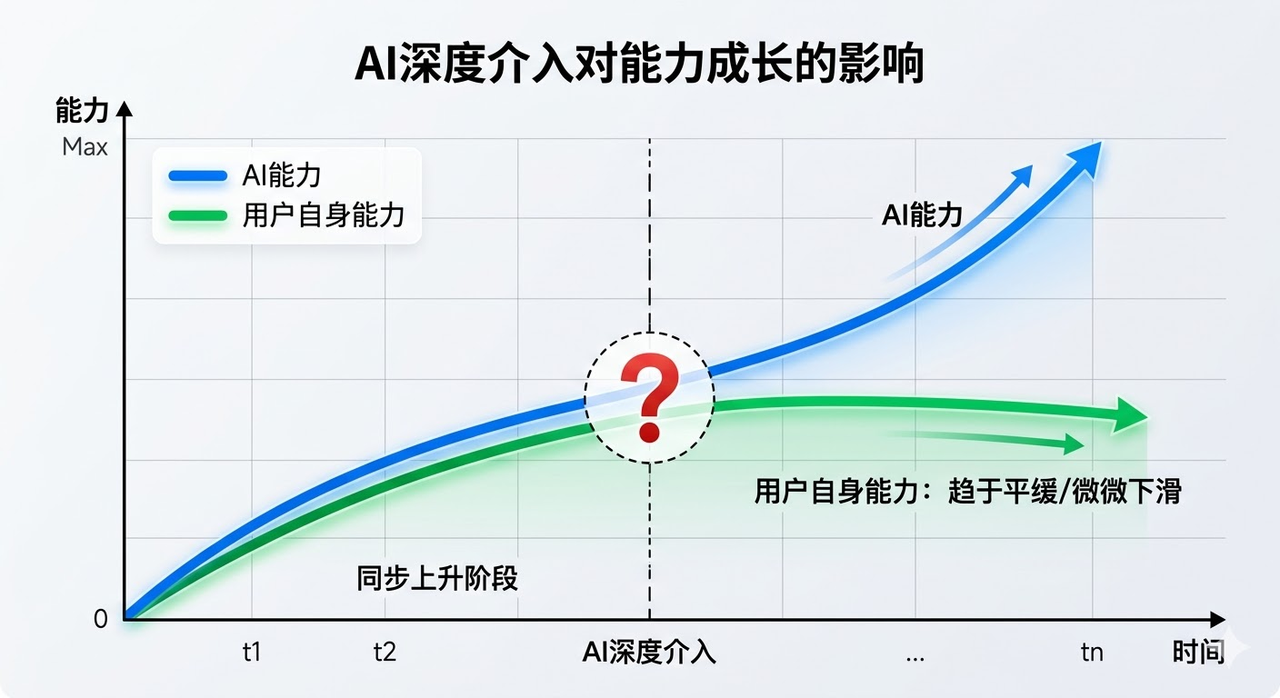

这不只是我一个人的问题。长期把代码实现完全交给 Claude Code 的工程师,会发现自己在脱离它的情况下,越来越难独立推进复杂逻辑——不是能力消失了,而是大脑对这部分的调用频率持续降低,就像一块长期不用的肌肉,它还在,但它变弱了,你也越来越不愿意单独靠它。

这不是 Claude Code 的错。这是”认知外包”的必然结果。当一个工具足够好,你的大脑会理性地选择减少对这个能力的投入——这是进化逻辑,完全合理,但代价是你在某个维度上,正在变得更依赖,更脆弱。

我们享受着AI替我们做主的效率红利,但我们有没有认真想过,我们在用什么换来的?

最后,给做AI产品的人一个问题

我现在的做法变了。

不是不用 Claude Code,而是开始有意识地在某些环节强迫自己不用它。比如当我需要真正理解一个模型的核心逻辑时,我会先自己读文档,自己推导,哪怕慢很多,哪怕最后还是要去问它。不是为了证明我比AI强,而是为了确认一件事:这个理解过程是我走过的,不是它替我走的。

我的课题还是会完成,那上百GB的文件还是我的成果。但我同时也在做另一件事:重新走一遍我没走过的那些路。不是因为结果需要,而是因为我需要。

如果你是做AI产品的,我想留一个问题。

我们设计AI产品,通常把”减少用户操作步骤”、“提高任务完成率”、”降低决策摩擦”当核心指标。这些没错,但它们衡量的都是同一件事:AI帮用户做了多少。

有没有一个指标,是在衡量另一件事:用户在用了你的产品之后,有没有变得更有能力?

不是更依赖,是更有能力。不是更省事,是在省事的同时,没有悄悄失去什么重要的东西。

设计一个让人越来越依赖的产品,其实挺容易的,因为依赖带来留存,留存带来数据,数据带来估值,逻辑很顺。设计一个让人越来越强的产品,很难,因为”让用户变强”这件事,有时候意味着产品要主动制造摩擦,要在某些地方故意不帮你,要让你自己走那一步。

但我觉得,这才是AI产品真正该去的方向。

不是替你活,而是帮你活得更像你自己。

本文由 @黄唐hut 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益