用 ComfyUI 训练 LoRA,普通人也能定制专属 AIGC 模型

从通用AI工具的惊艳到精准控制的渴望,LoRA微调技术正在成为AIGC领域的关键突破。本文深度解析LoRA如何通过低秩适应实现轻量化模型定制,结合ComfyUI可视化工作流,打造从数据准备到参数调优的完整解决方案,揭秘如何让AI真正学会你的专属风格与需求。

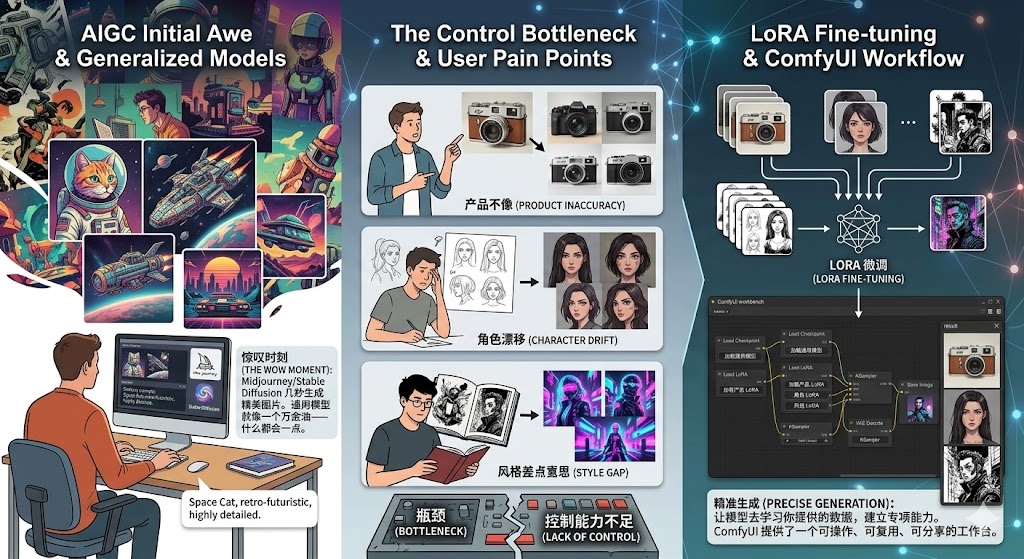

一、引言:AIGC 时代,”通用”已经不够用了

打开 Midjourney、Stable Diffusion,输入一段提示词,几秒钟后一张精美的图片就生成了。这是很多人第一次接触 AIGC 时的惊叹时刻。

但惊叹过后,问题来了。

你想生成自己公司的产品图,结果模型生成的不像;你想固定一个角色的脸,结果每次生成都在漂移;你想要某种特定的插画风格,结果提示词怎么写都差点意思。通用模型就像一个万金油——什么都会一点,但很难在某一件事上做到精准。

这是 AIGC 工具普及后,越来越多人遇到的瓶颈:生成能力已经足够强,但控制能力还不够细。

真正的需求不是”生成好看的图”,而是”生成我想要的图”。要做到这一点,需要让模型去学习你提供的数据,对特定风格、特定对象、特定场景建立专项能力。

这就是 LoRA 微调的价值所在。而 ComfyUI,则提供了一个让这件事变得可操作、可复用、可分享的工作台。

二、读懂 LoRA:不是重造模型,而是给模型”打补丁”

全参数微调的代价

在 LoRA 出现之前,要让模型适应新任务,主流方法是”全参数微调”(Full Fine-tuning)——用新数据把模型的所有参数全部重新更新一遍。

这个方法有两个致命问题。

第一是算力壁垒。GPT-3 有 1750 亿个参数,全参数微调一次需要数十块 A100 GPU 协同运算,对大多数公司和个人来说,成本直接把人拦在门外。

第二是”灾难性遗忘”。用医疗数据微调一个通用模型,它可能在医学问答上表现变好了,但同时忘记了如何正常对话。学了新的,忘了旧的——这是深度学习领域一个长期存在的问题。

LoRA 的核心思想

2021 年,微软研究院提出了 LoRA(Low-Rank Adaptation,低秩适应)。它的核心思路来自一个数学观察:

当大模型适应一个新任务时,它实际需要”学习”的信息量,远比模型参数量小得多。

用一个类比来理解:一幅 1000×1000 像素的高清图片,直接传输需要 100 万个像素点的数据。但如果这张图是一片纯色蓝天,信息高度重复,JPEG 压缩后可能只有几十 KB,图片质量几乎无损。

LoRA 的逻辑类似:它不去修改原始模型的大型权重矩阵,而是为每一个被微调的矩阵插入一对低秩矩阵(A 和 B)作为”补丁”,只训练这对补丁,不动原始权重。

训练结束后,把补丁和原始权重合并,推理时没有任何额外开销,就像什么都没发生过一样——只是模型”懂”了新的东西。

一句话总结:LoRA 不是重造模型,是对部分结构做轻量调整,让模型更”听话”——不改知识,只改表达方式。

关键参数扫盲

理解 LoRA,有几个参数不可不知:

- Rank(秩 r):补丁矩阵的维度,决定了 LoRA 的”信息容量”。r 越小,参数越少,训练越快,但表达能力有限;r 越大,能学到更复杂的模式,但需要更多显存。常见取值:4、8、16、32。简单任务取低值,复杂风格取高值。

- Alpha:缩放系数,控制 LoRA 补丁对原始权重的影响强度。通常设为 Rank 的 1~2 倍。

- 训练步数(Steps)/ 轮数(Epoch):训练太少欠拟合,风格没学到;训练太多过拟合,生成结果死板,只会”复制”训练图。

- Loss 值:衡量模型学习效果的指标。理想情况下,Loss 应随训练进程稳定下降,维持在 08~0.1 之间是比较理想的状态。

为什么 LoRA 特别适合 AIGC 图像领域

LoRA 在语言模型和图像模型中都可以使用,但它在 AIGC 图像领域尤其流行,原因有三:

- 文件极小:一个 LoRA 模型文件通常只有几十 MB,而完整的 SD 模型动辄 2~7GB,方便分发和分享。

- 可插拔、可叠加:LoRA 是”挂载”在底模上使用的,可以随时切换,甚至多个 LoRA 叠加使用,组合出新风格。

- 社区生态成熟:Civitai 等社区聚集了大量用户训练和分享的 LoRA 模型,涵盖各种风格、角色和场景,形成了一个繁荣的”模型插件市场”。

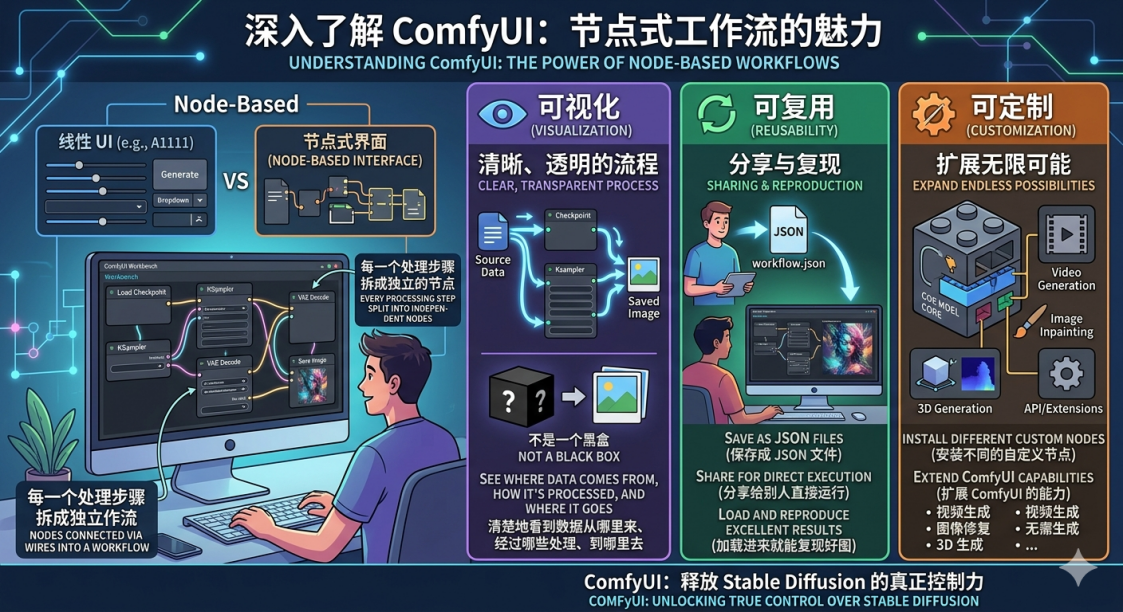

三、认识 ComfyUI:专为工作流设计的 AIGC 操作台

ComfyUI 是什么

ComfyUI 是一个基于节点的 Stable Diffusion 操作界面。与 WebUI(A1111)这类线性界面不同,ComfyUI 把每一个处理步骤都拆成独立的”节点”(Node),用连线把节点串联成工作流(Workflow)。

这种设计带来了三个核心优势:

- 可视化:你能清楚地看到数据从哪里来、经过哪些处理、到哪里去。整个生图过程是透明的,而不是一个黑盒。

- 可复用:工作流可以保存成 JSON 文件,分享给别人直接运行。你看到别人出了好图,拿到工作流文件,加载进来就能复现。

- 可定制:通过安装不同的自定义节点(Custom Nodes),可以扩展 ComfyUI 的能力——支持视频生成、图像修复、3D 生成等各种扩展功能。

ComfyUI 是一个基于节点的 Stable Diffusion 操作界面。与 WebUI(A1111)这类线性界面不同,ComfyUI 把每一个处理步骤都拆成独立的”节点”(Node),用连线把节点串联成工作流(Workflow)。

这种设计带来了三个核心优势:

- 可视化:你能清楚地看到数据从哪里来、经过哪些处理、到哪里去。整个生图过程是透明的,而不是一个黑盒。

- 可复用:工作流可以保存成 JSON 文件,分享给别人直接运行。你看到别人出了好图,拿到工作流文件,加载进来就能复现。

- 可定制:通过安装不同的自定义节点(Custom Nodes),可以扩展 ComfyUI 的能力——支持视频生成、图像修复、3D 生成等各种扩展功能。

ComfyUI vs WebUI:各自适合谁

WebUI 更适合入门用户。界面直观,参数集中在一个页面,上手快。但越用越会觉得不够灵活,某些进阶操作只能靠脚本或插件绕路实现。

ComfyUI 更适合进阶用户。学习曲线陡一些,但一旦熟悉节点逻辑,可以实现任意复杂的生成流程,并且完全可重复。对于需要批量出图、精细控制、团队协作的场景,ComfyUI 几乎是唯一选择。

与 LoRA 训练结合的意义

ComfyUI 的意义不仅在于”用 LoRA 出图”,更在于打通了从训练到出图的完整链路。通过相关的自定义节点(如 ComfyUI-Kohya),可以直接在 ComfyUI 中配置并运行 LoRA 训练任务,训练完成后无缝接入出图工作流进行验证——整个过程不需要切换工具,不需要反复折腾环境。

四、实战:用 ComfyUI 跑通一个 LoRA 训练工作流

第一步:数据准备

训练 LoRA 的核心是数据。数据质量直接决定最终效果,这一步往往比参数调整更重要。

图片收集原则:

- 数量:通常 15~50 张图足以训练一个风格 LoRA,人物 LoRA 建议 20~80 张。

- 质量:清晰、主体明确、背景干净。模糊、水印、遮挡严重的图片会引入噪声。

- 多样性:避免大量相似角度、相似构图的图片,适当保证视角、光照、表情的多样性。

- 分辨率:建议 512×512 或 768×768 以上,过小的图片会损失细节。

图片打标(Captioning):

每张训练图片需要对应一个文本描述(Caption),告诉模型”这张图里有什么”。打标方式有两种:

- 自动打标:使用 BLIP 或 WD14 等模型自动生成描述,速度快,适合风格类 LoRA。

- 手动打标:人工撰写描述,精度高,适合人物 LoRA 或需要精准控制的场景。

常见做法是自动打标后手动校对,剔除错误描述,补充关键特征。

第二步:参数配置

在 ComfyUI 中配置 LoRA 训练节点,关键参数如下:

第三步:训练监控

训练过程中,Loss 曲线是最重要的观测指标:

- 理想状态:Loss 从较高值(2 以上)逐步平稳下降,最终稳定在 0.08~0.1 区间。

- 过拟合信号:Loss 下降过快(两三个 Epoch 就骤降至 05 以下),或训练中后期出图效果”死板”、只会复制训练图的构图。

- 欠拟合信号:Loss 长期居高不下(15 以上),出图效果和底模差别不大,风格没学到。

发现异常时,优先调整学习率(过拟合则降低,欠拟合则提高),其次考虑增减训练轮数。

第四步:输出验证

训练完成后,将 LoRA 文件加载进 ComfyUI 的出图工作流,进行效果验证:

- 用触发词(Trigger Word)激活 LoRA,测试风格是否生效

- 调整 LoRA 权重(通常 6~1.0 之间),找到效果与底模平衡的最佳值

- 对比加载 LoRA 前后的出图效果,确认风格迁移是否符合预期

- 测试多个不同提示词,验证 LoRA 的泛化能力(不能只在训练图的描述下生效)

五、踩坑与优化:从”能跑”到”好用”

数据质量比数量更重要

很多初学者的第一反应是”多收集图片”。实际上,50 张精心筛选的高质量图,远比 200 张随手扒下来的杂图效果好。

图片筛选的几个原则:剔除主体不清晰的图、剔除风格差异过大的图、剔除有明显水印或遮挡的图、剔除过度后期处理导致细节丢失的图。

过拟合与欠拟合的调参思路

- 过拟合:降低学习率、减少训练步数、增加数据多样性、适当降低 Rank。

- 欠拟合:提高学习率、增加训练步数、检查打标质量是否有大量错误、适当提高 Rank。

找到平衡点的最简单方法:每隔几百步保存一次 checkpoint,对比不同阶段的出图效果,选择最合适的版本。

多 LoRA 叠加的权重调节

ComfyUI 支持同时加载多个 LoRA,通过调整各自的权重来混合风格。使用时有几点注意:

- 叠加的 LoRA 越多,权重冲突的概率越高,建议每个权重不超过 8

- 同底模训练的 LoRA 叠加效果更稳定,跨底模叠加容易出现风格混乱

- 先单独测试每个 LoRA 的效果,再逐步叠加,方便排查问题

不同底模对 LoRA 的影响

LoRA 是绑定底模的,不同底模训练出来的 LoRA 不能混用:

- SD 1.5:参数少,训练快,资源消耗低,风格化能力强,适合写实和二次元风格

- SDXL:参数更多,生成细节更丰富,但训练成本更高,对显存要求更大

- Flux:新一代架构,细节表现力更强,训练方式略有不同,生态仍在完善中

选底模的原则:先考虑你的出图需求,再考虑你的硬件上限。

六、LoRA 的生态价值与 AIGC 的未来方向

“能力模块化”:一个底模 + N 个插件的新范式

LoRA 最深远的影响,不只是让微调变便宜,而是带来了一种新的模型使用范式:一个通用底模 + 若干专项 LoRA 插件。

底模提供基础能力,LoRA 提供专项增强。需要写实人物?挂一个写实 LoRA。需要特定画风?换一个风格 LoRA。需要生成特定产品?加一个产品 LoRA。就像手机的 App 生态:系统是共享的,能力是按需加载的。

Civitai 等社区的繁荣,正是这种范式的体现。用户不需要从零训练,可以直接使用社区里数万个 LoRA 模型;有能力的用户可以把自己训练的 LoRA 分享出去,形成良性循环。

从个人创作到商业落地

LoRA 的轻量化特性,使它具备了明确的商业应用价值:

- 品牌定制:训练品牌产品、品牌人物、品牌视觉风格的专属 LoRA,用于广告物料的批量生成

- IP 复刻:为特定 IP 角色训练 LoRA,实现角色形象的一致性输出

- 虚拟人:结合人物 LoRA 和 ControlNet,生成形象固定的虚拟主播、品牌代言人

- 内容工厂:用 LoRA + ComfyUI 工作流搭建自动化出图流水线,大幅提升内容生产效率

LoRA 做不到什么

LoRA 并非万能,它有一个明确的能力边界:只能强化模型已经具备的能力,无法凭空注入全新知识。

如果底模从来没见过某种风格、某种物体,LoRA 再怎么训练也学不会——因为它的机制是调整表达方式,而不是扩充底层知识库。超出底模知识边界的内容,需要的是重新预训练,而不是 LoRA 微调。

未来方向:更强、更广、更智能

LoRA 技术仍在快速演进:

- 动态秩调整:根据任务复杂度自动选择最优 Rank,在简单任务中节省资源,在复杂任务中保证精度

- 视频 LoRA:将 LoRA 微调从图像延伸到视频生成,让角色和风格在时序上保持一致

- 多模态 LoRA:横跨图像、文本、音频的联合微调,打破单模态的限制

- 更高效的变体:QLoRA(4bit 量化 + LoRA)让单卡就能微调更大的基础模型

七、结语

LoRA 的出现,本质上是一次”民主化”——它把原本只有大机构才能负担的模型定制能力,交到了个人开发者、独立创作者、中小企业手中。

ComfyUI 则进一步降低了操作门槛——把训练和出图整合到一个可视化的工作流中,让流程变得可重复、可分享、可迭代。

两者结合,意味着你不需要是算法工程师,也能为自己的业务场景定制一个专属的 AIGC 模型。

如果你此前觉得”模型训练是别人的事”,不妨换一个角度:从一个具体的需求出发,收集 20 张图,跑通第一个 LoRA 训练。 当你看到模型开始”认识”你提供的风格,那种感觉和第一次用 AI 生成图片时的惊叹,其实并没有什么不同。

本文由 @ 张锅聊AI 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Pixabay,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益