中文护城河塌了:GPT Image 2 一脚踢翻即梦、可灵、通义万相

GPT Image 2的发布不仅打破了中文图像生成的护城河,更在审美、推理能力和场景理解上实现了质的飞跃。这款美国模型不仅能精准渲染中文文字,还能无缝融入电商详情页、招聘海报等复杂场景,甚至自动补全中国用户熟悉的细节。本文将深度解析国产模型如何从技术领先到被迫迎战,以及OpenAI如何用一次迭代改写行业格局。

2026 年 4 月 21 日,OpenAI 正式发布 GPT Image 2。发布当天深夜,中文互联网上一张图开始疯转。

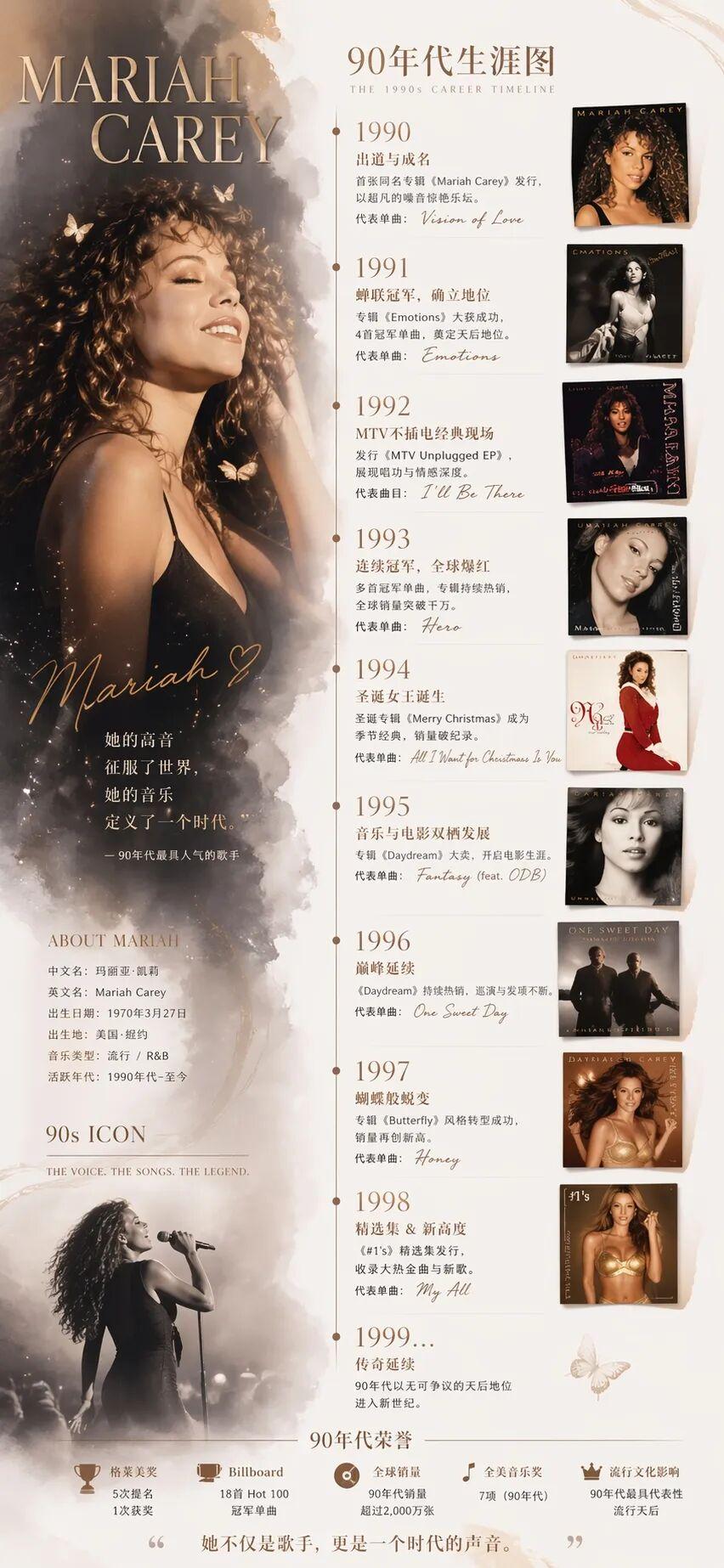

那是一张 Mariah Carey 90 年代音乐生涯的中文信息长图。左边是她的侧面照,配文「她的高音征服了世界,她的音乐定义了一个时代」;右边是一条从 1990 到 1999 的年份时间线,每一年都有一段中文描述和代表单曲,旁边配着那一年的专辑封面——《Mariah Carey》《Emotions》《Music Box》《Daydream》《Butterfly》《#1’s》,一直到 1999 年的「传奇延续」。

信息量极大。而且——这张图是 GPT Image 2 一条 prompt 直出的。

一位资深设计师在腾讯新闻的测评里写:「这种大量信息 + 美感 + 准确性的三角组合,说实话,以前只有比较不错的视觉设计师能做到。」

但这张图之所以让中文 AI 圈坐不住,不是因为它代表了什么设计师失业,而是因为:它出自一个美国模型。

过去两年,中文市场所有的国产图像模型——快手的可灵 Kolors、字节的即梦 Seedream、阿里的通义万相 Qwen-Image——都在同一个叙事里活着:我们也许在某些维度不如 Midjourney、Nano Banana、GPT Image 1,但我们懂中文。中文字体、中文语义、中文审美、中文电商场景——这是一道 OpenAI 和 Google 进不来的护城河。

现在,护城河塌了半边。

一、回忆一下那道曾经很厚的”中文墙”

要理解 GPT Image 2 这次意味着什么,得先回忆一下这道护城河是怎么建起来的。

2024 年 7 月,快手在世界人工智能大会上开源了可图 Kolors。这是第一个真正意义上”原生支持中文文字生成”的文生图模型。快手团队为它专门构建了一个包含五万余个常用汉字的数据集,使它能稳定写出黑体、手写、书法等多种字体的中文字符。更关键的是,Kolors 接入的是 ChatGLM3 作为文本编码器,不像 Stable Diffusion 那样用 CLIP——这意味着它能处理 256 字符级别的复杂中文提示词,甚至反应效果比英文还好。

这是一个定义性时刻。从那一刻起,中文 AI 社区开始形成一种共识:国外模型再强,在中文这件事上玩不过国产。DALL-E 3 的中文是乱码,Midjourney 的中文像鬼画符,那时候的 GPT-4o 生图甚至不怎么敢写中文。

2025 年 9 月,字节发布 Seedream 4.0,把这道墙砌得更高。字节团队在 Artificial Analysis 国际评测上一举登顶文生图和图像编辑双榜,综合 Elo 评分超越 Google 当时的王牌 Nano Banana(Gemini 2.5 Flash Image)。中文文字渲染、亚洲人像一致性、4K 原生输出——这些都是字节打磨过的硬指标。

Seedream 4.0 最漂亮的一点是:它的中文渲染不只是”能出字”,而是能做整套的场景融合。商铺牌匾、海报标题、书法挂轴、手绘字体——它都能稳稳地压在画面里。知乎上有个高赞回答一句话定性:”seedream4.0 跟 NanoBanana 打个平手,但中文字生成无敌,这块相比外国模型几乎就是遥遥领先的。”

2025 年底到 2026 年初,阿里依次推出 Wan 2.6 和 Qwen-Image 2.0。阿里走的是另一条路:把 Qwen 大语言模型的中文理解能力,深度嫁接到图像生成模型里。Qwen-Image 2.0 支持 1k token 级别的超长中文提示词——官方给出的样例,是一段近千字的中文场景描述:冬日北京的街景、青灰瓦顶、朱红色外墙、田英章硬笔字、卡皮巴拉玩偶、雪人手写黑板——这种把细节堆到极致的中文 prompt,只有阿里和字节的模型吃得下。

这三家一起构成了中文图像生成的”铁三角”:快手开源、字节闭源、阿里云化。护城河看起来又高又厚。直到这个月。

二、GPT Image 2 是怎么把墙推倒的

OpenAI 这次发布 GPT Image 2,核心卖点看起来跟 Nano Banana 2 没有本质区别:文字渲染、原生 4K、高保真、多语言。但如果你只看这个列表,你会错过最关键的信号。

发布时 OpenAI 明确列出支持”加强”的五种语言:日文、韩文、中文、印地语、孟加拉语——这不是英文扩展到欧洲小语种的常规操作,这是一个正面扑向亚洲市场的清单。

实测结果比声明更硬。LM Arena 上,GPT Image 2 首发 Elo 评分:文生图 1512、单图编辑 1513、多图编辑 1464。第二名——Nano Banana 2——只有 1360。242 分的鸿沟。在这种榜单上,顶级模型通常只差几分,OpenAI 这次是直接抽刀斩断赛道。

但数字没讲清楚最刺痛的地方。刺痛的地方在这里——

场景一:中文电商详情页。过去电商行业有个固定工作流:拍产品照 → 修图 → 做排版 → 写文案 → 分区详情 → 场景图。一套做下来,设计师和运营要来回折腾一两天。现在,知乎用户实测 GPT Image 2:丢一张产品照 + 两句话,直出一张”靠谱修图师级别”的白底主图;再加一句”给我做一张详情页海报”,它真给出了一张像模像样的详情图,中文促销文案、产品卖点、分区布局都有。

这不是”能出中文”的水平——这是”能接住中文电商设计工作流”的水平。

场景二:中文招聘海报。过去不管是 DALL-E 还是 Seedream 还是 Nano Banana 2,你让它做一张文字密集的中文招聘海报(一堆职位 + 要求 + 联系方式),文字部分都会崩坏。GPT Image 2 是第一个能把这类”文字信息密度大于视觉权重”的场景做稳的外国模型。

场景三:中文信息长图 / 明星履历页。就是文章开头那张 Mariah Carey 时间线——中文、时间线、专辑封面、段落描述、整体氛围都要兼顾。这种图过去只有专业平面设计师能做。

场景四:招牌和街景文字。虎嗅的一篇分析写得很到位——让 GPT Image 2 成为最强生产力工具的那组能力(精确的文字渲染、可信的 UI 布局、真实世界的视觉词汇),恰好也是制造虚假信息的完美工具集。假 Bloomberg 终端、假 Slack 对话、假 UI 截图,”都是在已知视觉词汇之上叠加的密集文本,这正是 OpenAI 所优化的工作负载”。换到中文场景——假饿了么界面、假微信对话、假微博截图、假支付宝账单——同一套工作负载,同样适用。

这三个场景,过去是国产图像模型几乎唯一能稳定碾压国外模型的地方。现在,它们都被打穿了。

三、为什么这次的打击是”质变”

你可能会说:中文文字渲染不就是多训练点中文数据嘛?以前国产模型靠这个吃饭,现在 OpenAI 补上了数据,不就追平了?

没那么简单。这次的底层变化比”补数据”深得多。

第一,这不是简单”补数据”的版本迭代。 发布前业界普遍猜测 GPT Image 2 把架构从两阶段推理改成了单次推理,速度会提升好几倍。OpenAI 官方没有正面确认架构细节,但公开的特性足够说明问题——GPT Image 2 是 OpenAI 第一个内建推理能力(Thinking Mode)的图像模型。它可以在生图前先搜索网页、读取用户上传的文件(PDF、截图、品牌规范)、推演版面结构、从一个 prompt 生成最多 8 张风格一致的图,生成完还会自我检查输出。

这个变化的含义是:图像生成不再是”先写一段 prompt,扔给模型出图”的单次调用,而是一个带推理链的 agent 任务。换到中文场景里,它意味着:你不用再硬塞关键词告诉它”这是中式招牌”、”那是中国风排版”——它自己会先想一遍,再画。这就解释了为什么它能稳稳地把中文字压在曲面上、贴在反光材质里、塞进密集排版中。国产模型之所以在这些场景下容易崩,是因为它们还在”一条 prompt 一张图”的逻辑里,没有那个”先想一遍”的推理步骤。

第二,审美这关,国产模型比预想更脆弱。 过去我们习惯说国产模型”懂中文场景”。但中文圈的一个公开秘密是:国产模型输出的图,无论字节、阿里还是快手,或多或少带一种被用户称为”AI 感”或”土味”的东西——过曝的光影、过饱和的颜色、不自然的塑料质感、构图的俗气。知乎上有设计师总结:”以前 AI 画图最容易让专业设计师安心的一件事就是——它能画,但它不懂审美。现在这层安全感,也开始裂了。”

GPT Image 2 这次最大的意外之喜,恰恰是审美。知乎高赞评测里有几个关键词反复出现:”构图的节奏”、”色彩的克制”、”信息的主次”、”氛围感”、”那一点点’设计师会不会这么做’的味道”——这些不是中文数据能补出来的,这是视觉品味的训练。

第三,世界知识 + 文字 + 场景的三合一。 过去国产模型在中文场景的长板,是孤立的——你可以让 Seedream 写好中文,但让它理解”苹果那种冷峻高级质感”或”电商平台高饱和度带促销文案的网感图”,它得靠用户提示词里硬塞一堆关键词。GPT Image 2 天生带着”世界知识”,知道”张雪机车”该怎么画、知道”iPhone 16 Pro Max 高端商业广告”长什么样、知道”佳琦直播间”会出现在什么位置——这些东西,是在大量互联网数据里自然习得的。

爱范儿的评测里有个细节:让 GPT Image 2 生成”一个亚洲男性在商场刷手机”的纪实摄影风格图,它不只是画出了人,还在画面角落里自动塞进了一个”李佳琦直播间”的模糊招牌。这个细节比任何中文文字渲染都更说明问题——它不是”被教会了中文”,它是真的”看懂了中国场景”。

四、逐一看看三家国产模型的处境

即梦 / Seedream(字节)——正面迎战的那个

字节目前是国产图像模型里最靠前的选手,Seedream 4.0 的图像编辑综合 Elo 还排得上全球前列。它的优势仍然很硬:亚洲人像一致性全球最好、中文多字体多排版、多图融合、局部精准编辑、4K 原生、中国电商/短剧/漫剧工作流全打通。

但 Seedream 也有几个真实的问题:

- 产品端清晰度卡在 2K。字节 Seedream 4.0 技术文档里写的是支持原生 4K,但在即梦 App 上用户实测只能出 2K。这意味着商用场景下,设计师拿去做印刷物料时还是得放大。

- 审核严。 有独立开发者反映:”整体审核显著比 banana 要严格,很多能在 banana 跑的案例在即梦都会提示’你输入的文字不符合平台规则’。” 这个问题是所有国产 AI 产品都有的,但对图像生成杀伤力特别大——AI 生图最常用的场景之一就是”生成一张名人代言的调侃海报”,这类 case 在国产平台基本做不了。

- Agent 模式的稳定性问题。 字节从 Seedream 4.0 开始主推 Agent 模式(用自然语言一条 prompt 让 AI 自己分解任务),但用户反馈失败率偏高、人物一致性不如 Nano Banana。

- 迭代节奏跟不上。 Seedream 4.0 之后,字节陆续推出了 4.1 和 4.5 试图拉近差距。但 Google Nano Banana Pro 一出来就把阈值顶高,用户对 4.1/4.5 的反馈以”模糊、提升不明显、脸部扭曲”为主。字节在一个月内连发两个小版本却没真正追上,暴露了更深层的问题——不是不努力,是模型能力的追赶速度跟不上通用模型的迭代节奏。

字节真正的底牌不在模型本身,而在分发:豆包、即梦、剪映、抖音这套生态把用户入口卡得死死的。你可能永远用不上 GPT Image 2 的 API,但你打开抖音刷视频的时候,字节的 AI 已经在你旁边了。

可灵 / Kolors(快手)——开源流派,重心已经转移

可灵的故事是三家里最微妙的。2024 年快手开源 Kolors 是”中文 AI 生图破冰者”的高光时刻。但 Kolors 此后的迭代节奏明显慢了下来,重心逐渐偏向可灵视频。

原因很现实:快手的业务护城河在短视频,不在图像。在国产大厂里,可灵的视频生成模型是目前国内 SOTA 级别,能跟 Sora 2、Veo 4 扳手腕。相比之下,守住图像生成的前沿要花的钱和算力,边际收益远不如 All in 视频。

所以可灵的策略大概率会是:图像放手,视频死守。GPT Image 2 的冲击对快手来说反而没那么疼——它不是快手的主战场。

通义万相 / Qwen-Image(阿里)——B 端生态里的长期玩家

阿里这边打法很不一样。通义万相 + Qwen-Image 是”绑在 Qwen 大模型生态里”的图像能力,主攻 B 端场景:淘宝电商、阿里妈妈广告、飞猪旅游图、阿里云企业客户。

Qwen-Image 2.0 的一个招牌能力是处理超长的中文 prompt——官方给出的样例 prompt 是一段 800 字的中文场景描述,包含材质、构图、文字、人物、环境、天气、光影。这种 prompt 解析能力确实是 GPT Image 2 短期内赶不上的,因为 Qwen 本身就是中文 LLM 的强者。

但阿里的问题也明显:审美上限还是不如 GPT Image 2。阿里的图像模型长期有一种”官方感”——干净、规整、工整,但少了设计师的那点灵气。在 C 端”让用户感到惊艳”的战场上,这是硬伤。

阿里的优势在 B 端:深埋在企业工作流里,淘宝商家用它做主图、跨境卖家用它做多语言素材、阿里云企业客户用 API 批量生图。这种”看不见但用得到处都是”的路径,GPT Image 2 短期内也打不进来——因为 OpenAI 在中国没有合规的 B 端入口。

五、为什么”中文护城河”必然会失守

一个更冷静的判断:中文作为国产大模型的护城河,从来不是技术壁垒,而是数据和注意力壁垒。当一家公司愿意花钱补中文数据、愿意专门投入算力优化东亚语言——壁垒就会消失。OpenAI 这次明确把中日韩印孟五个亚洲语言列为发力方向,说明它已经把亚洲市场正式纳入战略视野。

这背后有一个更大的历史规律。

回看互联网的上一轮”本地化护城河”故事:搜索引擎时代,百度靠中文理解、中文网页索引、中文输入法输入方式打败了 Google.cn,看起来是中文生态无可撼动。但后来的移动互联网证明了,护城河不是”中文”,是”App 分发入口 + 支付系统 + 内容生态”。电商时代,淘宝靠中国零售逻辑和物流体系打败了 eBay,看起来不可复制,但拼多多仍然从社交电商切进来重写了规则。

本地化从来不是一条可以长期依赖的护城河。

AI 图像生成这一轮也是一样。中文文字渲染、中文语义理解、亚洲人像审美——这些东西一旦 OpenAI/Google 决定要做,就能做到。而真正持久的护城河从来不是”模型能力本身”,而是:

- 分发入口(你能不能让用户顺手用到)

- 工作流集成(你能不能嵌入到用户每天打开的软件里)

- 合规优势(你能不能在监管框架下稳定交付)

- 生态互锁(你的模型能不能跟下游工具链产生网络效应)

这些才是国产模型真正应该守的东西。

六、国产模型的出路:不在”卷中文”,在”卷嵌入”

我的判断是,国产模型接下来不应该再把”中文优势”当成战略故事讲。这个故事可以讲给用户做宣发,但不能作为公司战略的核心。真正要打的三件事:

第一,把模型嵌入到分发入口里。 字节已经做到了一部分——豆包 + 即梦 + 剪映 + 抖音。阿里也在做——淘宝商家工具 + 阿里妈妈广告 + 钉钉文档。这是 OpenAI 在中国短期内打不进来的地方。

第二,在特定垂直场景上做深。 电商、短视频、社交营销、本地生活、游戏——这些场景对中文理解、合规要求、工作流对接的要求都很高,也是 GPT Image 2 的通用 API 一时半会儿接不上的。国产模型应该把这些场景做成”谁都拆不开的工作流”,而不是”一个能被 API 调用替换的模型接口”。

第三,承认”模型能力正在商品化”这个大趋势。 这正是我之前几篇文章里反复说的论点:当模型成本开始坍缩,真正的竞争优势会从原始模型能力,转移到上下文嵌入、工作流集成和信任。GPT Image 2 这次等于是给国产模型上了一课——你在模型能力这个维度上再卷十年,也卷不过 OpenAI 的迭代速度,但你可以在”怎么把模型塞进商家的日常”这件事上,建立 OpenAI 永远也复制不了的护城河。

七、最后说几句

2024 年快手开源 Kolors 的时候,整个中文 AI 圈有一种很难得的乐观情绪:我们终于有一个”中文原生”的图像模型了。两年之后回头看,那种乐观现在显得有点天真。

不是 Kolors、Seedream、Qwen-Image 不努力——它们在各自的时间窗口里都做得很好。而是 AI 模型竞争的底层逻辑,注定了任何一个看起来专属于”本地化”的优势,都会在通用模型的下一次迭代里被抹平。

GPT Image 2 的发布,不是让国产模型”完蛋了”。它是一个节点事件,宣告了一个叙事的终结——”我们因为懂中文,所以可以活得很好”这个故事,讲不下去了。

国产模型并没有失去未来。它们只是失去了一种可以让自己偷懒的优越感。从今天起,大家都要在”谁能在真实的生产场景里活下去”这件事上,重新比一次。

中文,曾经是国产大模型最温暖的护身符。现在它不是没用,只是不再是独家的。

而下一局怎么赢,跟”中文”已经没有关系了。

本文由 @秋叶的枫 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益