「空想AGI」闹剧何时休?Science专栏:对AI前景预测过于乐观

在把AGI作为终极目标之前,或许我们应当先对AGI的概念定义达到共识。这篇文章里,作者分享了相关研究,研究里讨论了大众对通用人工智能概念的争论,不妨来看一下。

最近几年,AI技术的发展远远超出普通大众和研究者的预期,「通用人工智能(AGI)」的概念也从科幻小说中走进了日常生活的讨论中,成为了许多科技公司和研究机构所追求的最终目标。

AI行业的领头羊OpenAI表示,其使命是「确保通用人工智能造福全人类」;

DeepMind在公司愿景声明中也指出,「人工通用智能有可能推动历史上最伟大的变革之一」;

AGI概念在英国政府的国家人工智能战略和美国政府的人工智能文件中也被着重提及;

微软的研究人员声称在大型语言模型GPT-4中发现了「AGI火花」(sparks of AGI)存在的证据;

论文链接:https://arxiv.org/pdf/2303.12712.pdf

现任和前任谷歌高管宣称「AGI已经到了」(AGI is already here);

「GPT-4能否算作是一种AGI算法」的问题也是Elon Musk对OpenAI提起诉讼的核心……

虽然术语AGI已经在商业、政府和媒体中被广泛使用,但不同群体的用户对AGI概念的含义并没有达成共识。

「AGI的含义到底是什么?」在AI社区内引起了激烈的争论,这以问题不仅是一场关于「术语」定义的学术争论,也将影响着科技公司、政府部门等关于AGI做出的重要决策。

最近,圣菲研究所的教授Melanie Mitchell在Science上发表了一篇letter,讨论了大众对通用人工智能概念的争论。

深入研究AGI后可以发现,人工智能从业者对智能本质(the nature of intelligence)的看法与研究人类和动物认知的人截然不同,这种差异对于「理解当下、预测机器智能的未来前景」等至关重要。

人工智能概念

人工智能领域的最初目标是创造出具有与人类相当、具有通用智能的机器。

早期的人工智能先驱们对此持乐观态度:1965年,赫伯特·西蒙(Herbert Simon)在著作《人类和管理的自动化形态》中预测「20年后,机器可以承担所有人类能做的工作」;

在1970年出版的《生活》杂志上,马文·明斯基(Marvin Minsky)宣称:在三到八年后,我们就能拥有一台具有普通人智力水平的机器,一台能够阅读莎士比亚、润滑汽车、玩弄办公室政治、讲笑话和打架的机器。

遗憾的是,这些乐观的预测并没有实现。

在接下来的几十年里,唯一成功的人工智能系统只能算是专用,而非通用:只能执行单一任务或有限范围的任务,例如手机上的语音识别软件可以转录口述内容,但不能理解具体内容并生成回复。

通用人工智能(AGI)一词是在21世纪初创造的,以重新追寻人工智能先驱最初的崇高愿望,寻求重新关注「试图以独立于领域的方式研究和复制智能」。

但直到最近,这种崇高的追求在人工智能领域内仍然相当模糊,领先的人工智能公司将实现AGI作为其主要目标,但AGI的存在性(existential threat from AGI)仍然是他们最害怕的事。

许多人工智能从业者都在预测AGI的实现时间轴,例如,有人预测「到2028年,有50%的机会拥有AGI」;但也有人质疑AGI的前提,称其定义模糊不清,甚至有研究人员在推特上表示:AGI的概念是不科学的,人们应该对使用这个词感到尴尬。

虽然早期的AGI支持者认为机器很快就会承担所有人类活动,但研究人员已经意识到,打造一个「国际象棋机器人」或是「回答搜索查询的AI系统」要比开发一个机器人来「叠衣服」或「修水管」容易得多。

AGI的定义也相应地进行了调整,包含了所谓的「认知任务」(cognitive tasks)。

DeepMind联合创始人Demis Hassabis将AGI定义为「应该能够完成几乎任何人类可以完成的认知任务」的系统,OpenAI将其描述为「高度自主的系统,在最有经济价值的工作中优于人类」(most economically valuable work),其定义大多忽视了需要物理智能(physical intelligence)的任务。

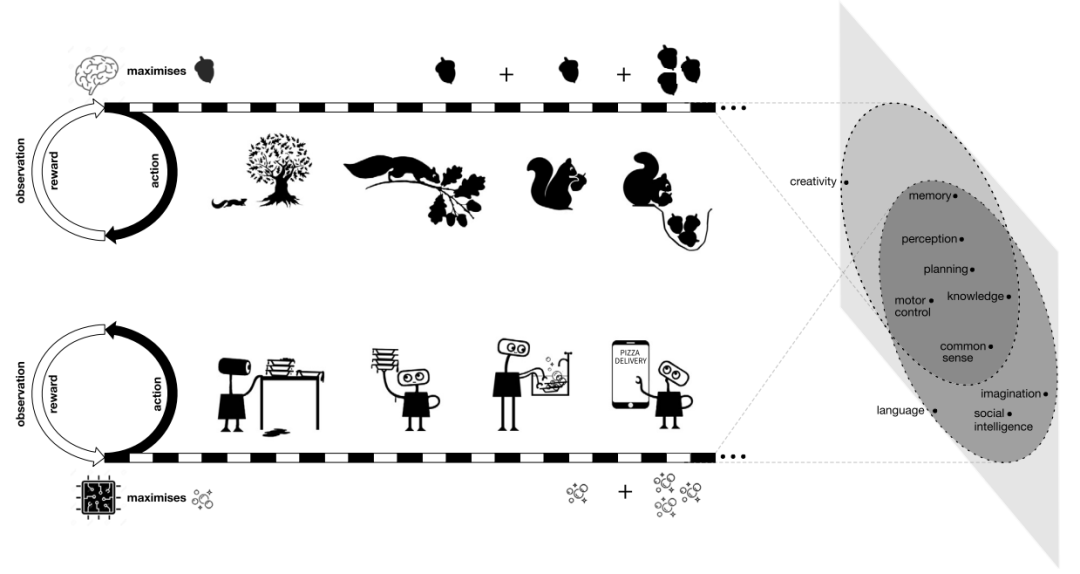

人工智能中的「智能」概念,即认知或其他方面,通常是以个体智能体为奖励或目标进行优化的方式来构建的。

一篇有影响力的论文将通用智能定义为「智能体在各种环境中实现目标的能力」。

论文链接:https://link.springer.com/article/10.1007/s11023-007-9079-x

也有论文指出,「智力及其相关能力可以被理解为促进奖励最大化」。

论文链接:https://www.sciencedirect.com/science/article/pii/S0004370221000862

事实上,这也是当下人工智能系统的运行方式,例如,计算机程序AlphaGo被训练来优化「赢得比赛」的奖励函数,而GPT-4被训练来优化「预测短语中的下一个单词」的奖励函数。

一些人工智能研究人员猜测:一旦人工智能系统实现了AGI,就会将其优化能力应用于自身软件来快速实现超越人类的智能水平,迭代地推进自己的智能;在极端预测下,AGI系统会「比我们聪明数千倍或数百万倍」。

这种对优化的关注导致人工智能社区的一些人担心「没有与人类标准对齐」(unaligned)的AGI会给人类带来生存风险,可能会偏离其创造者的目标。

在2014年出版的《超级智能》一书中,哲学家尼克·博斯特罗姆(Nick Bostrom)提出了一个著名的思想实验:假设人类给一个超级智能人工智能系统一个「优化回形针生产」的目标,人工智能系统会利用它的智能来控制地球上所有的资源,并将地球上所有的东西都变成回形针。

当然,人类并不是为了制造更多的回形针而毁灭地球和人类,只是他们在说明书中没有提到这一点。

人工智能研究员Yoshua Bengio也提供了一个思想实验:我们可能会要求人工智能解决气候变化问题,但AGI可能会设计一种病毒来毁灭人类,因为我们给出的指令对「伤害的含义」解释得不够清楚,人类实际上是解决气候危机的主要障碍。

这种对AGI(或超级智能)的推测性观点与研究生物智能,特别是人类认知的人所持的观点不同。

虽然认知科学并没有严格地定义「通用智能」,但大多数认知科学家认可,智力水平不是一个可以量化的指标,可以简单地向上或向下调整,而是一个复杂的综合通用和专项能力,在大多数情况下,可以适应特定的进化生态位(specific evolutionary niche)。

许多研究生物智能的人也怀疑智能的所谓「认知」方面可以从其他模式中分离出来,并在一个无实体的机器中捕获:心理学家已经表明,人类智力的重要方面是建立在一个人的身体和情感体验的基础上的。

证据还表明,个人的智力深深依赖于一个人对社会和文化环境的参与,理解、协调和向他人学习的能力,可能比个人的「优化能力」更重要。

此外,与之前提到的回形针人工智能(paper clip–maximizing AI)不同,人类智能并不以固定目标的优化为中心,一个人的目标是通过先天需求和支持其智能的社会和文化环境的复杂整合形成的。

与超级智能体不同的是,智力的提高恰恰使人类能够更好地洞察他人的意图以及自身行为的可能影响,并相应地修正行为。

正如哲学家卡佳·格雷斯(Katja Grace)所说,把「接管宇宙」作为目标对于任何人来说都是可笑的,所以为什么我们会认为实现人工智能的目标是不同的呢?

一台机器改进自己的软件以提高其智能水平也偏离了生物学的观点,即智能是一个高度复杂的系统,不只是需要大脑的参与。

如果人类水平的智能需要不同认知能力的复杂整合以及社会和文化的加持,那么系统的「智能」水平很可能无法提升自身的「软件」能力,就像人类无法设计大脑(或基因)使自己更聪明一样。

然而,人类可以作为一个集体,通过外部技术工具(如计算机)和建立文化机构(如学校、图书馆和互联网)来提高有效智力水平。

对AGI的含义,以及AGI是否是一个连贯的概念仍在争论中,对于AGI机器能够做什么的猜测主要是基于直觉,而不是科学证据。

但这种直觉能有多少可信度呢?人工智能的历史一再证明我们对智能的直觉是错误的。

许多早期的人工智能先驱认为,用逻辑编程的机器将捕捉人类智能的全部;其他学者预测,让机器在国际象棋中击败人类,或在语言之间进行翻译,或进行对话,将需要它具有一般人类水平的智能,但结果被证明是错误的。

在人工智能进化的每一步,人类水平的智能都比研究人员预期的要复杂。

目前关于机器智能的猜测是否也会被证明是错误的?我们能否发展出一种更严谨、更通用的智能科学来回答这些问题?

目前还人工智能科学是否更像人类智能科学,还是更像天体生物学(预测其他星球上的生命可能是什么样的)。

对从未见过甚至可能不存在的东西做出预测,无论是外星生命还是超级智能机器,都需要基于通用原理的理论。

最终,所谓AGI的含义和后果不会通过媒体的辩论、诉讼或直觉和猜测来达到共识,而是通过对这些原理的长期科学调研。

参考资料:

https://www.science.org/doi/10.1126/science.ado7069

编辑:LRS

来源公众号:新智元(ID:AI_era),“智能+”中国主平台,致力于推动中国从“互联网+”迈向“智能+”。

本文由人人都是产品经理合作媒体 @新智元 授权发布,未经许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

起点课堂会员权益

起点课堂会员权益

人类智能不仅仅是逻辑和优化,而是包括情感、社会互动和文化适应等多方面因素。因此,机器智能的发展可能不会遵循目前设想的路径。感觉现在的人工智能还是有点机械化呢。