笑着看完AI换脸综艺后,AI诈骗让我脊背发凉

AI领域发展迅猛,但应用最快、最广泛的,估计也就是骗术和灰产了。AI浪潮的席卷也使得诈骗变得更为猖獗,如果缺乏应有规束,AI换脸则可能打开潘多拉魔盒。

AI技术的发展已经逐渐渗透到了各个领域,电影和电视剧的制作方式也在发生着翻天覆地的变化,AI换脸技术更是成为影视圈中备受瞩目的一环。

近日,一部名为《萌探2024》的综艺中,有一期节目以“反诈”为主题,设计了一个既刺激又充满挑战的游戏环节,嘉宾们需要通过AI换脸技术,伪装成自己的亲朋好友,进行视频通话来获取他人的信任。

这期综艺节目将AI换脸玩出了新花样,让众多观众爆笑连连,但笑过之后却对AI诈骗不寒而栗。

一、反诈主题综艺,AI换脸惹观众爆笑

4月26日,由爱奇艺出品的全开放式IP任务对抗真人秀《萌探2024》迎来首播。节目中精彩的AI换脸体验为观众们带来了满满惊喜,本期节目播出后热度持续升温,诸多话题登上全网各大社交媒体平台热搜,其中#向太没认出来向佐#登微博主榜TOP7、#高叶模仿吴镇宇一模一样#登抖音热榜TOP4、#向太要跟吴镇宇互换儿子#登抖音热榜TOP9。

向佐和黄子韬作为节目的亮点,他们的表演无疑是这一期节目的高潮。他们分别选择了吴镇宇和向佐的形象进行换脸,然后给向太打电话。这一举动,无疑是对向太智慧的一次考验,也是对观众洞察力的一次挑战。

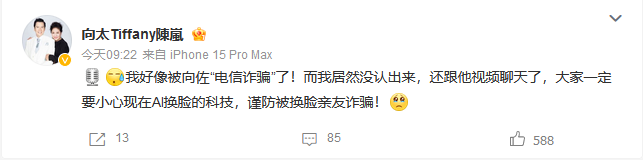

令人惊讶的是,向太作为视频聊天的对象,似乎并未察觉到这一变化,与这个被AI换脸后的“向佐”和“吴镇宇”进行了交谈。事后,在陈岚发文中,她调侃自己好像被向佐“电信诈骗”了,同时提醒大家小心AI换脸诈骗。

除此之外,高叶AI换脸成吴镇宇骗古力娜扎、孟子义AI换脸成高叶邀请演员王阳参加综艺也同样没有被发现。而徐志胜换脸杨坤给张碧晨打视频则因为碰巧本尊就在身旁而被发现,其他人则因为声音和脸型的差异过大而分分钟被识破。

其实早在2023年11月的《王牌对王牌第八季》中,以“反诈”主题的一期节目中同样安排了AI换脸打视频电话的游戏环节。其中,当所有人都AI换脸成“沈腾”后更是引起全场爆笑,好似各个平行宇宙的腾哥都聚在一起开会一样。

不论是《王牌对王牌第八季》还是《萌探2024》,节目中的AI换脸环节都有着极佳的节目效果,不论是节目嘉宾还是观众都十分欢乐。但在笑过之后,AI换脸技术的逼真程度也着实令人震惊,很多时候已经能够以假乱真了。

而节目也没有单纯停留搞笑层面,而是肩负起了社会责任,也就是电信诈骗问题。对于很多人来说AI换脸诈骗相对离我们的生活比较遥远,节目中明星的现身说法,则能让大家真正意识到这项技术的以假乱真程度,继而在生活中提高警惕。

《王牌对王牌第八季》还邀请节目嘉宾和浙江各地民警拍摄“小剧场”讲解了AI技术的工作原理,分享反诈技巧。《萌探2024》则是与“平安北京”等数十家各地公安新媒体矩阵账号联动,发起#萌探2024致敬反诈英雄#话题科普反诈知识。

节目和警察们如此卖力宣传“反诈”是因为,随着生成式人工智能技术的发展,通过AI技术换脸换声的方式来模拟出另一个人的真实外观已不再困难。据不完全统计,AI诈骗案件数量在近年来快速增长,仅2023年一年在全国已发生至少16起。

二、AI换脸案件激增,AI合成声音让骗局更真实

去年7月17日,一女子在社交软件上被一个自称是埃隆·马斯克的账号添加为好友。在聊天过程中取得了该女子的信任,不久后就骗取了7000万韩元(约合人民币36万)。

最后,为安抚受害者,该账号还发送了一段录音,声称“我是埃隆·马斯克,希望听到这个录音文件后能放心”,但专业人士分析这段录音后确认其由AI合成。

今年年初,香港警方透露了一场涉及深度AI造假技术的复杂骗局,一家跨国公司的香港办事处遭受了高达1.8亿元的重大财务损失。该公司首席财务官和其他员工的通过AI技术,出现在视频电话会议中,指示员工转移资金。

因为其他出席的人看起来和听起来都像他认识的同事,最终这名员工相信电话中的其他人都是真实的,因此同意汇出总计 2 亿港元(约合 2560 万美元)。

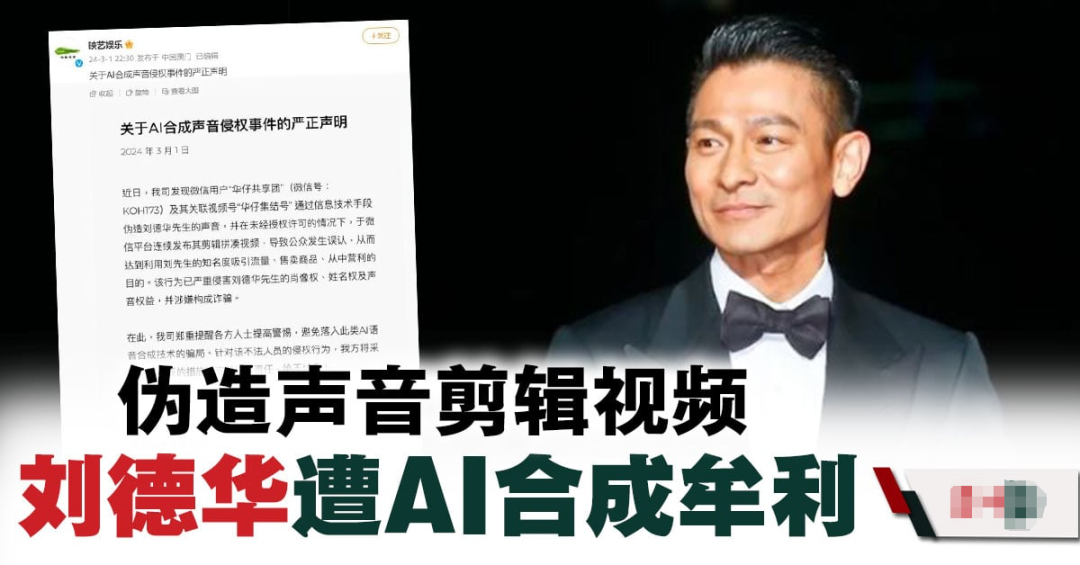

而在今年的3月1日晚,刘德华电影公司发声明称,微信用户“华仔共享团”及其关联号利用AI合成刘德华声音,未经授权在微信发布剪辑视频,误导公众,利用刘先生知名度吸引流量、售卖商品获利。该行为侵犯刘先生肖像权、姓名权及声音权益,并涉嫌诈骗。

AI换脸本就已经真假难辨了,而AI合成声音则让整个骗局更加逼真了。在社交媒体上,许多留学生发帖表示曾遇到利用AI合成本人语音,对在国内的父母进行的诈骗。这些诈骗以绑架为名,放出AI合成的求救语音,同时利用时空差,在造成恐慌的心理下骗取大量金额。

因此,在享受科技带来便利的同时,我们也应该保持警惕,不断提升自己对于科技安全的意识和防范能力。正如陈岚在节目后的发文中所言,“一定要小心现在AI换脸的科技,谨防被换脸亲友诈骗”。AI换脸不止是综艺节目中的小游戏,更是真实发生在我们生活中的诈骗手段。

三、面对AI诈骗,我们如何处之?

不管技术如何发展,很多诈骗的套路万变不离其宗:窃取隐私,利用恐惧、贪欲、情绪价值编故事,冒充熟人或包装自己获取信任,图穷匕见以钱为最终目的。

诈骗分子往往会AI换脸伪装成亲人、朋友、同事、领导等有一定交集的熟人,而想要完美的骗过受害者则需要事先收集到面部、声音等重要信息。因此,我们总结了一些防范诈骗的建议:

- 验证身份:如果接到声称是亲友或同事的紧急求助电话或视频通话,应该通过其他途径(如直接拨打对方的已知电话)来验证对方的真实身份。

- 保护个人信息:不要轻易分享个人生物信息和社交账号,同时要警惕社交媒体上的隐私设置,限制不熟悉的人获取你的个人信息。

- 留意异常:在交流过程中,注意对方的行为是否与平时相符,比如语言习惯、说话风格等,如果有不寻常之处,应提高警觉。

- 双重验证:对于重要的操作请求,如转账汇款,要求进行双重验证,例如通过银行的官方渠道或面对面确认。

- 反诈普及:向家人和朋友普及此类诈骗手法,特别是老年人和不太熟悉科技产品的人群,因为他们可能更容易上当受骗。

- 使用安全软件:确保电脑和手机安装了最新的安全软件,以防止恶意软件收集个人信息。

- 关注官方信息:时刻关注政府、金融机构和网络安全机构发布的防骗提示和警告。

- 报警处理:一旦发现可能遭遇了换脸诈骗,应立即停止所有交易并与警方联系。

除去提高警惕意识自我防范外,还需要法律法规等各方面的监管。对于AI换脸技术,法律上通常会采取一系列应对措施,包括加强监管、制定严格的法律法规以及追究相关责任人的法律责任等。此外,技术手段如数字水印、身份验证等也可以用于防范和打击不法行为。

为规范人工智能发展,去年1月10日,国家互联网信息办公室,工业和信息化部,公安部联合发布的《互联网信息服务深度合成管理规定》正式施行,内容明确了合成数据和技术管理规范。其中提到:深度合成服务提供者对使用其服务生成或编辑的信息内容,应当添加不影响使用的标识。提供智能对话、合成人声、人脸生成、沉浸式拟真场景等生成或者显著改变信息内容功能的服务的,应当进行显著标识,避免公众混淆或者误认。

近期,也有平台和企业发布了“关于人工智能生成内容的平台规范暨行业倡议”,明确禁止利用生成式人工智能技术创作、发布侵权内容,包括但不限于肖像权、知识产权等,一经发现,平台将严格处罚。

人工智能技术在近年来的迅猛发展中,已经在多个领域取得了惊人的成果。从语音助手到自动驾驶,从医疗诊断到金融风控,人工智能已经深刻影响了我们的生活和工作。然而,随之而来的安全隐患也是不可忽视的,我们需要更加重视对于人工智能技术的监管和规范,以充分发挥其积极作用的同时,最大限度地避免其负面影响。

四、写在最后

AI浪潮的席卷也使得诈骗变得更为猖獗,而两期AI换脸综艺则是在搞笑之余宣传发诈知识,帮助更多人认识到AI换脸诈骗的严重性。作为普通人,我们往往是技术变革大潮里的一朵浪花,面对迭代超乎想象的AI技术,能做的只有紧跟时代的脚步。

人们固然不能因噎废食,但也不能忽略它的双刃剑效应。如果缺乏应有规束,AI换脸则可能打开潘多拉魔盒。因势利导,使其趋利避害,才能促成科技辅助生活的美好未来。

作者&编辑:孙浩南;公众号:元宇宙新声

本文由 @元宇宙新声 授权发布于人人都是产品经理。未经许可,禁止转载。

题图来自Unsplash,基于CC0协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益