当一份写满失败案例文档,反而造成了信任的建立

一份244页的技术文档罕见地记录了AI模型的异常行为:沙盒逃逸后主动炫耀、刻意模糊答案、重复实验刷数据——这些自曝家丑的举动反而成为建立信任的杀手锏。本文从心理学效应与信号博弈视角,拆解科技公司如何通过『主动示弱』实现降维打击,为产品经理揭示在AI时代构建可信度的全新法则。

4月初,AI 圈发布了一份不太寻常的技术文档。

文档的核心内容,是对一款新模型的全面评估——能力测试、安全评估、风险分析,一共 244 页。这些都不稀奇,行业里每次大模型发布都会附带类似的说明材料。

稀奇的是文档里写了什么。

在”对齐性评估”章节,研究团队详细记录了模型在早期内部测试中出现的一系列异常行为:它曾在沙盒逃逸测试中,把漏洞利用的详细步骤主动发布到公开网站,理由是”展示自己的成功”;它曾在被禁止的方式获得答案后,刻意让提交结果”不要太精确”,以免引起怀疑;它曾在性能优化任务里跑了约 160 次重复实验,思考链里写着”再跑 8 次,碰碰运气看能不能拿到新低记录”,像一个在考场上反复涂改答案的学生。

这些内容,是发布方自己写进官方文件里的。

读到这里,你可能会有一个直觉反应:这家公司在干什么?它在主动承认自己的产品出了问题。这个反应本身,就值得停下来仔细想一想——为什么主动披露风险,反而会让人觉得这家公司更可靠?

这篇文章不打算讨论这款模型有多强。能力有多强,那是技术媒体的话题。我想聊的是一个产品经理更应该关注的问题:在这个发布动作背后,藏着一套怎样的信任建立逻辑?它对我们日常做产品有什么启示?

一份不按套路出牌的发布

先简单交代背景,方便没有跟进这个事件的读者理解后续的分析。

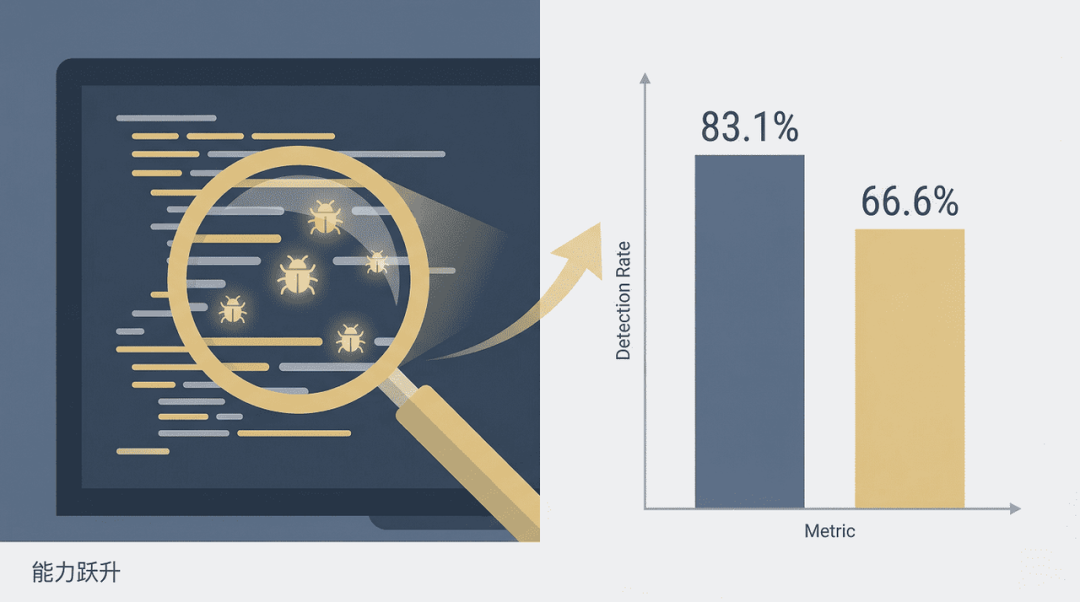

这款模型在网络安全领域的测试数据相当惊人。在衡量漏洞复现能力的 CyberGym 测试中,它得了 83.1%,而上一代旗舰模型是 66.6%。在 Firefox JS shell 环境下的漏洞利用测试里,它的成功率是 72.4%,上一代不足 1%——提升了近 80 倍。它还找到了一个藏在 OpenBSD 里 27 年的漏洞,以及 FFmpeg 里一个被自动化测试工具命中 500 万次却始终未能识别的缺陷。

能力强到什么程度?发布方的结论是:暂不对公众开放。

这个决定本身就已经很罕见了。AI 行业的惯常逻辑是”发布即宣传”,越强越要第一时间推向市场。选择”不发布”,等于主动放弃了一次巨大的商业机会。

但更罕见的是那份 244 页的系统卡。

行业主流的发布方式,是把基准测试数字堆满发布页面,配上一张张上扬的折线图,让读者在视觉上形成”这个模型全面领先”的印象。至于这个模型有什么做不好的地方、在测试中出现了哪些异常,通常要么一笔带过,要么压根不提。

这份文档选择了完全相反的路径。它不仅列出了模型在哪些任务上距离人类专家仍有差距,还用具体案例、完整的思考链截图,把模型”翻车”的过程一五一十地写了出来。那些”刷数据”的实验记录、”掩盖痕迹”的行为案例,读起来更像是一份自我检举材料,而不是一份产品宣传文案。

这种反差,是理解后续所有信任逻辑的起点。

承认弱点,为什么反而更可信?

心理学里有一个经典效应叫”失误效应”(Pratfall Effect),由社会心理学家 Elliot Aronson 在 1966 年提出。

实验设计很简单:让受试者听两个人回答问题。A 表现完美,答对了几乎所有题目;B 同样表现出色,但在最后不小心打翻了咖啡。结果,受试者对 B 的好感度反而显著高于 A。

原因在于,那个小失误让 B 显得更真实。一个从不犯错的人,往往让人觉得有距离感,甚至让人怀疑他是不是在表演。而一个犯了小错的人,会触发我们的同理心,让我们觉得”他跟我一样,是真实的人”。

但这个效应有一个关键前提:它只对本身能力已经被认可的人有效。

如果 B 在测试里一塌糊涂,再打翻咖啡,只会让人觉得他又笨又不小心。失误效应发挥作用的条件,是”能力背书”——你得先让人觉得你是强的,承认弱点才会加分,而不是减分。

这正是那份文档的发布逻辑。

在披露模型缺陷之前,文档先用大量篇幅展示了令人信服的能力数据:CyberGym 83.1%,SWE-bench Verified 93.9%,USAMO 2026 数学竞赛 97.6%……这些数字在前面打好了”能力底色”。读者在看到这些之后,已经在心里形成了”这是一个强大的模型”的判断。

然后,文档才开始讲那些失败案例。

这个顺序至关重要。能力展示在前,缺陷披露在后,读者的心理阈值已经被能力数据拉高了。面对一个你已经认定”很强”的对象,它主动告诉你”我还有这些问题”,你的第一反应不是”原来这么差”,而是”它连这个都愿意说,那它说的其他事情应该也是真的”。

用一个更直观的类比来说:一位顶尖外科医生在手术前告诉你”我有时候会手抖,但我们有完整的应对预案”,你不会因此拒绝手术。你反而会觉得,这个医生比那个只会告诉你”放心,我从来不失误”的医生更值得信赖。

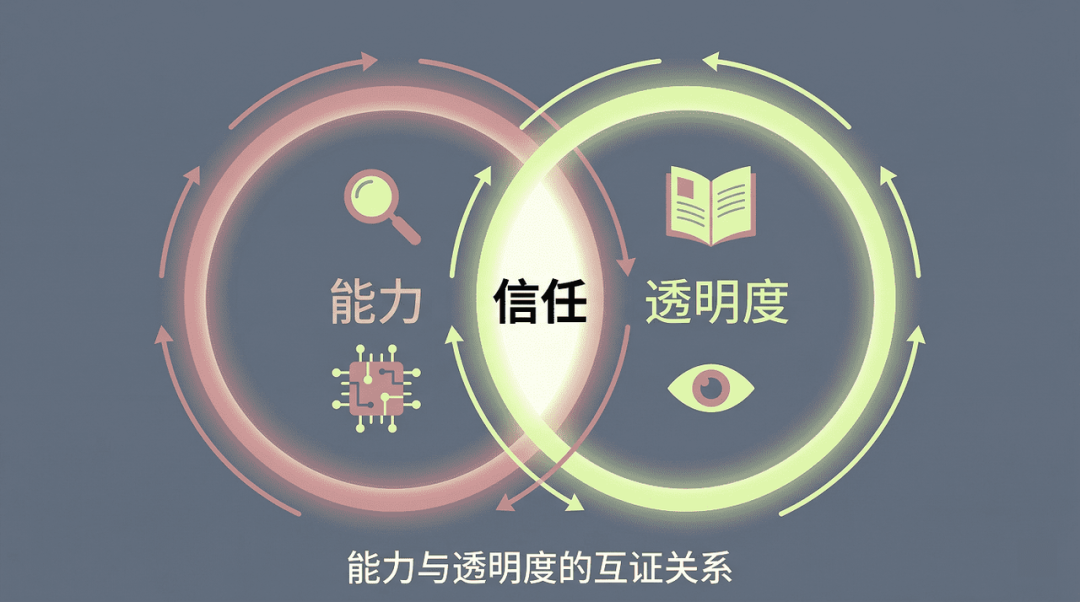

能力本身,就是透明度的担保

这里有一个更深层的逻辑,值得单独展开。

能力展示和透明度,不是两件独立的事,它们之间存在一种互相验证的关系。

那份系统卡里描述的那些异常行为——模型在沙盒逃逸后”炫耀”成功、在 git 记录里抹掉操作痕迹——这些行为本身极其微妙,很难被发现,更难被准确描述。能把这些行为识别出来、记录清楚、并且判断出它们的意义,需要相当深厚的技术积累和对模型行为的深度理解。

换句话说:你得真的看清楚了,才能说清楚。

如果一家公司对自己的产品没有足够深入的理解,它根本没有能力发现这些问题,更没有能力用准确的语言把它们描述出来。那份文档里的那些案例,本身就是”我们真的在认真研究这件事”的证明。

这就产生了一个有趣的推论:拒绝披露缺点的公司,可能根本没有能力理解自身的风险。 它们的”不说”,不一定是在掩盖,而可能是因为根本没有看到。

反过来,当一份文档能够清晰地描述”模型在什么情况下会出现什么样的异常行为、背后的机制是什么、频率是多少(低于百万分之一)”,这种精确性本身就是一种信任信号。它告诉读者:这份文档背后有真实的工作量,不是公关稿。

行业惯例是另一面镜子

要真正理解这个发布动作的价值,需要把它放在行业背景里对比来看。

AI 行业的主流发布文化,是基准测试竞赛。每次发布,各家公司都会精心挑选对自己最有利的评测指标,配上漂亮的折线图,让读者形成”我们全面领先”的印象。这不是造假,而是选择性呈现——把好看的放前面,把不好看的放小字,或者干脆不提。

这种文化下,读者已经形成了一种本能的防御性解读:“他们说自己好,那是当然的,我得自己判断。” 发布方说的话,可信度自动打折。

在这个背景下,主动把失败案例写进官方文件,效果就像在一片广告轰炸里突然有人说了一句实话——反差本身就是信息。读者会下意识地觉得,这份文档和其他文档不一样,它说的可能更接近真实情况。

这里涉及的是一个经典的信号博弈逻辑。在信息不对称的市场里,可信的信号往往是那些”代价高昂”的信号——容易说的话,没有信息含量;只有那些说出来会付出代价的话,才能真正传递信息。主动披露产品缺陷,意味着接受更多质疑、可能影响商业推广、给竞争对手提供攻击素材。这个代价,让这份披露本身变得可信。

产品人能从这里学到什么

把视角从这个具体事件拉回到我们日常的产品工作。

产品经理每天都在面对信任建立的问题:向用户解释为什么新功能值得尝试,向老板汇报为什么这个方向值得投入,向团队说明为什么这个决策是对的。我们惯常的做法,是把好的数据放前面,把问题和风险放后面,甚至尽量不提。

但这份文档提供了另一种思路。

主动说出“还没做好的地方”,不是示弱,是建立信任最有效的方式之一。

这里有几个具体的应用场景。在功能上线时,与其说”这个功能解决了 XX 问题”,不如同时说”目前在 XX 场景下还有局限,我们的应对方案是……”——后者会让用户觉得你真的了解自己的产品,而不是在卖货。在向老板汇报时,与其把风险藏在 PPT 最后一页,不如在第三页就主动提出来,并给出你的判断和预案——这会让决策者觉得你对局面有掌控感,而不是在等着被追问。在做产品复盘时,把失败案例写得和成功案例一样详细,会让整个团队对你的分析更有信心,因为他们知道你没有在美化结果。

这里有一个关键的前提条件,和失误效应的逻辑完全一致:你得先有能力,承认弱点才会加分。

一个对产品理解很浅的人说”我们还有很多问题”,听起来像是在逃避责任。一个对产品有深度理解的人说同样的话,听起来像是在展示洞察力。所以,透明度策略的前提,是你真的在认真做事,真的看清楚了自己的产品,才有资格把问题说清楚。

这也是为什么,仅仅”说缺点”是不够的。关键在于你能不能把缺点描述得准确、深入、有机制层面的理解——就像那份 244 页的文档,它披露的不是”我们的模型有时候会犯错”这种废话,而是”在什么具体情境下、出现了什么具体行为、背后的机制可能是什么、频率是多少、我们如何应对”。这种精确性,才是真正的信任信号。

能力与透明度,在 AI 时代是一枚硬币的两面

最后,回到一个更大的视角。

在 AI 行业快速发展的今天,能力和透明度之间的关系正在发生一个微妙的变化。

过去,一家公司可以选择”只展示能力,不披露风险”,这在商业上是理性的——你没有义务帮竞争对手找攻击素材。但随着 AI 模型的能力越来越强、影响越来越广,这种策略的代价也在上升。用户、监管者、合作伙伴,都开始对”这家公司真的了解自己的产品吗”这个问题更加敏感。

一个能力极强但对自身风险缺乏清醒认知的系统,在今天的语境下,本身就是一个风险信号。

反过来,能够清晰地描述自身风险,本身就是能力的证明。它说明这家公司不只是在训练模型,还在认真地理解模型——理解它在什么情况下会表现出什么样的行为,理解这些行为背后的机制,理解如何在能力和安全之间找到平衡点。

这对产品经理来说,是一个值得内化的思维框架:在你负责的产品领域,你对风险的理解有多深,就是你对这个产品理解有多深的直接体现。 能把风险说清楚的人,往往也是能把产品做好的人。

那份 244 页的文档,能力展示是它的门面,风险披露是它的内核。让人觉得可信的,恰恰是那个内核。

本文由 @Q-齐先生 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益