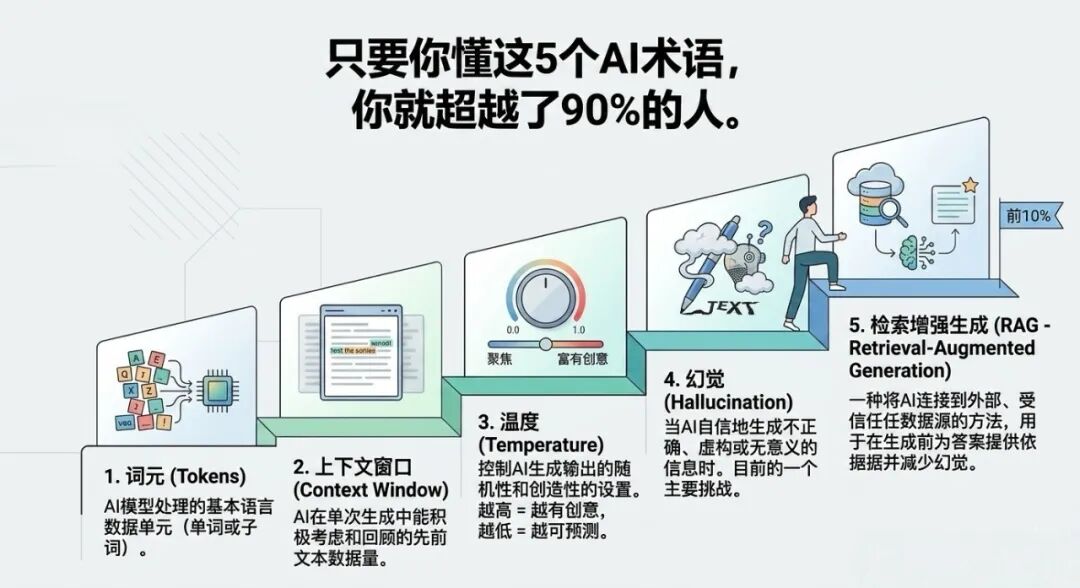

如果你了解这 5 个 AI 术语,你就领先 90% 的人了

AI 领域的专业术语常常让人望而生畏,但理解 Token、上下文窗口、温度设置、幻觉和 RAG 这五个核心概念,就能掌握大语言模型的底层逻辑。本文深入浅出地拆解这些关键术语,揭示 ChatGPT、Claude 等产品背后的运行机制,助你在科技浪潮中抢占认知高地。

坦率地说。

大多数谈论人工智能(AI)的人,要么像是在照本宣科地给出文字定义,要么当有人提到诸如大语言模型(LLMs)或神经网络之类的术语时,他们完全一头雾水。

你不必成为这两类人中的一员。

我认为有这 5 个术语、5 个概念,如果你真正理解了它们(而不只是死记硬背),你就会远远领先于在场的几乎所有人。无论你身处科技、商业、教育领域,还是只是一个对世界发展方向充满好奇的人。

咱们开始吧。

1. Tokens(词元)

你首先要牢记的是,AI 模型并不读取单词,甚至也不读取字母,它们读取的是 Tokens。

那么什么是 Token 呢?想象一下你在看书,但不是逐字逐句地读,而是按词组来读。有时一个词组是一个完整的单词,比如 “cat”(猫)。有时是一个单词的一部分,比如 “un”(表示否定的前缀)或 “tion”(名词后缀)。有时则是标点符号。这样的一段文本(词组)就是一个词元。例如,“I love pizza”(我喜欢披萨)这句话可以拆分成 3 个词元:“I”(我)、“ love”(喜欢)、“ pizza”(披萨)。

这对你来说为什么重要呢?因为你使用的每一个 AI 产品,如 ChatGPT、Claude、Gemini,都在幕后统计词元数量。

你在信息中发送的 Tokens 越多,模型需要处理的内容就越多。

它在回复中生成的 Tokens 越多,运行成本就越高。当你听到人们谈论模型的上下文窗口(稍后详细介绍)时,他们说的是模型一次能在内存中容纳多少 Tokens。

一些较老的模型可以处理 4000 个 Tokens。较新的模型则可以处理超过一百万个 Token。这就是为什么 AI 有时会忘记长对话中较早的部分。

一旦对话填满了上下文窗口,最早的 Token 就会被丢弃,就像你的随机存取存储器(RAM)满了,电脑开始卡顿一样。

Token 是 AI 语言的基本单位。一旦你理解了这一点,你就会开始明白为什么有些提示效果比其他的好,为什么 AI 在长时间聊天中会遗忘,以及为什么应用程序编程接口(API)定价是以每千 Tokens 来衡量的。

2. Context window(上下文窗口)

想象一下你在和某人交谈,但这个人有着一种非常特殊的记忆模式。他们只能记住一段对话的最后 X 分钟内容。在此之前的所有东西呢?都没了,被遗忘了。

这就是上下文窗口。

它是以 Tokens 衡量的 AI 模型一次能够查看并纳入考量的文本总量。这涵盖了所有内容:你的指令、对话历史、你分享的任何文档,以及模型自身的回复。

把它想象成一块白板。上下文窗口就相当于白板的大小。你可以在上面随意书写。但一旦写满了,你就必须擦掉一些旧内容才能写下新的东西。

你知道什么更有趣吗?较小的上下文窗口(比如 4000 Tokens)意味着人工智能一次只能处理几页文本。给它一份长篇文档,它只能读取其中的片段。较大的上下文窗口(比如 200000 词元)则意味着你完全可以粘贴一整本书并就其提问。

这就是为什么当 Claude 宣布拥有 200000 Tokens 的上下文窗口,或者 Gemini 朝着 100 万 Tokens 迈进时,人们会如此兴奋。这从根本上改变了你能利用该模型做的事情。

实际的经验教训是什么呢?如果你在处理像总结长篇文档或分析数据这样重要的事情时,要始终意识到你的 AI 可能会忘记你们对话中较早的部分。这不是故障,只是白板空间不够用了。

3. Temperature(温度)

这是我个人最爱讲解的一个概念,因为人们一旦听了就再也不会忘。

当你让 AI 写点东西时,有个叫 “温度” 的设置,它决定了输出内容的随机性或可预测性。

- 低温(接近 0) = AI 求稳。它每次都选择最有可能、最常见的词。输出内容连贯、准确,但有点枯燥。就像那个总是发同样邮件模板的人。

- 高温(接近 1 或更高) = AI 冒险。它会选择令人惊讶的词、不同寻常的转折、有趣的想法。有时很精彩,但并非总是如此。

这里有个真实例子。让 AI “完成句子:猫坐在…… 上”。

温度低时,它几乎总会说 “垫子”(mat)或 “地板”(floor)。可预测。稳妥。

温度高时,它可能会说 “哲学困境”(philosophical dilemma)或 “周二摇摇欲坠的帝国”(crumbling empire of Tuesday)。

有创意吗?

有。

对法律文书有用吗?

绝对没用。

所以这里有个大多数人不知道的不成文规则:

- 如果你使用 AI 完成诸如总结、编码、提取信息等基于事实的任务,你需要低温设置。AI 应该精确,而非有创意。

- 如果你使用 AI 完成诸如写小说、头脑风暴、生成营销文案等创意任务,那就调高温度。你想要意想不到的内容。

大多数像 ChatGPT 这样面向消费者的应用程序不会让你直接调整这个设置。它们将其设定在中间值。但如果你使用 AI 应用程序编程接口(API)或开发工具,你就会看到这个设置。现在你就知道该怎么用它了。

4. Hallucination(幻觉)

这是个大家都听说过的术语,但并非所有人都明白它为何会发生,而这恰恰是关键所在。

当 AI 无比自信地给出错误答案时,就出现了“幻觉”。毫无迟疑,将错误答案当作事实陈述。

例如:你向 AI 询问一本书。它给出书名、作者、出版年份、情节梗概,全都是编造的。这本书根本不存在。但 AI 却像在照抄维基百科一样言之凿凿。

为什么会这样呢?

大多数人忽略了一点。 AI 语言模型(AI language models)并非数据库。它们不会查询事实。它们依据训练过程中习得的模式,预测下一个最有可能的 Token。它们是大规模的自动补全工具。

所以当 AI 不知道某些内容时,它不会说“我不知道”。它会生成听起来像正确答案的内容,因为这正是它被训练去做的。

危险之处并非在于 AI 会犯错。所有工具都会犯错。危险在于 AI 犯错时的自信程度,与它答对时一模一样。它就是直接给出答案。

这里的实际经验是,对于事实、统计数据、医疗建议、法律信息,或者任何出错会产生实际后果的内容,绝不要盲目信任 AI。把它当作一个起点,然后去核实。

明白“幻觉”这一概念的人不会停止使用 AI ,他们只是会更明智地使用它。

5. RAG(检索增强生成)

这是五个概念中最容易被误解的。说实话,一旦你理解了它,就会发现它无处不在。

RAG(Retrieval-Augmented Generation)代表检索增强生成。实际上这是个非常简单的概念。

它解决了这样一个问题。常规的 AI 模型是基于特定日期之前的数据进行训练的。它对你公司的内部文档一无所知,对上周发生的事件一无所知,对你上传的 PDF 文件也一无所知。

那么像“与你的PDF聊天”或“就这份文档提问”这样的产品究竟是如何工作的呢?

这就是 RAG 的作用。

当你上传一份文档时,系统不会把整个文档都输入到 AI 的“大脑”中。相反,它会把文档拆分成片段,并将它们存储在一种特殊的数据库中,这种数据库叫向量数据库,它理解的是含义而非仅仅是关键词。

然后,当你提出一个问题时,系统首先会在这个数据库中搜索最相关的片段。它检索出这些片段,然后将它们与你的问题一起输入给 AI ,并说:“这是一些相关背景信息。现在利用这些信息来回答问题。” 就是这样。检索相关内容,输入给 AI ,生成答案。这就是 RAG。

为什么这很重要呢?

因为它几乎是过去两年里开发的每一款实用 AI 产品的支柱。了解你公司政策的客服机器人,能够依据你的法律文件回答问题的 AI 助手,总结研究论文的工具。所有这些都是基于 RAG 构建的。

了解这一点会改变你对 AI 产品的看法。当 AI 知晓你的文档内容时,它实际上并没有学到任何新东西。它只是在进行一种非常智能的搜索,并将结果输入给语言模型。模型本身还是一样的,只是上下文发生了变化。

那么为什么这些都很重要呢?

因为 AI 不会消失。在未来几年,那些只是模糊使用 AI 的人和那些哪怕只是基本了解其工作原理的人之间的差距,会越来越重要。

你不需要成为工程师,也不需要编写代码。但

- 理解 Tokens(词元) 意味着你能写出更好的提示词;

- 理解 Context window(上下文窗口)意味着你会明白为什么你的 AI 助手表现得很困惑;

- 理解 Temperature(温度) 意味着你会知道针对不同任务该使用哪些设置;

- 理解 Hallucination(幻觉)意味着你不会盲目信任人工智能;

- 而理解 RAG(检索增强生成)意味着当任何 AI 产品声称知晓你的数据时,你能确切知道发生了什么。

就是这样。五个术语,真正理解。说实话,这会让你领先于大多数只是模糊使用 AI,却不了解其内部运作的人。

欢迎进入前10%的行列。

原文标题:If You Understand These 5 AI Terms, You’re Ahead of 90% of People

原文链接:https://pub.towardsai.net/if-you-understand-these-5-ai-terms-youre-ahead-of-90-of-people-c7622d353319

作者:Shreyas Naphad

本文由人人都是产品经理作者【TCC翻译情报局】,微信公众号:【TCC翻译情报局】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益