“人工智能与法律”对AI产品经理有何实际借鉴意义

作为AI产品经理和先行者,我们应该抱着责任感,甚至悲悯、敬畏之心来真正重视AI的伦理和法律问题,因为这些真的会影响我们和后代的未来。

AI和法律、伦理、安全等方面的交叉领域,我个人一直是比较关注,因为一方面,这些基础设施会对人类产生很大影响,并直接影响部分AI领域落地的时机,另一方面,对于AI产品经理来说,在认知深度和广度方面,需要吸取这种跨领域信息,并且还要有能力将看似high level的感性/文科观点落地成非常具体的产品体验feature。

目录

- 一、案例:AI应用时面临的法律问题和风险

- 二、现状:各国对AI法律政策问题的探索

- 三、未来:AI可能如何影响法律

- 四、落地:以上内容对AI产品经理有何实际借鉴意义

- 五、附录:相关资料推荐(2本书籍、7篇文章、5个相关产品/公司)

一、案例:AI应用时面临的法律问题和风险

1、图像识别领域

1)种族歧视问题:谷歌公司的图片软件曾错将黑人的照片标记为“大猩猩”。

2)用户隐私保护问题:2011年,Facebook就曾因其“人脸识别和标记功能未按伊利诺伊州《生物信息隐私法案》(BIPA)要求告知用户收集面部识别信息的期限和方式”被诉,随后又因“采集面部特征前未能明确提醒用户并征得用户同意”而遭到爱尔兰和德国有关部门的调查。

注:尽管Facebook辩称默认开启该功能是因为用户通常不会拒绝进行人脸识别,并且用户有权随时取消这一功能,但德国汉堡市数据保护与信息安全局坚持Facebook的面部识别技术违反了欧洲和德国的数据保护法,Facebook应删除相关数据。最终,Facebook被迫在欧洲地区关闭了人脸识别功能,并删除了针对欧洲用户建立的人脸数据库。

2、语音识别领域

模拟人声诈骗:有朝一日,如果TTS技术效果非常好了,可能会有人用假的声音去诈骗,比如模仿子女的声音,给其父母打电话……

3、自然语言处理领域

AI被人“教坏”:2016年3月23日,微软的人工智能聊天机器人Tay上线一天就被紧急下线,因为她被用户“教坏”了——她成了一个集反犹太人、性别歧视、种族歧视等于一身的“不良少女”。

4、广告投放领域

种族歧视问题:研究表明,在谷歌搜索中,相比搜索白人的名字,搜索黑人的名字更容易出现暗示具有犯罪历史的广告。

二、现状:各国对AI法律政策问题的探索

1、知识产权

国际标准化组织IEEE在其标准文件草案《合伦理设计:利用人工智能和自主系统(AI/AS)最大化人类福祉的愿景》中提出了一个基本原则:如果AI依靠人类的交互而实现新内容或者发明创造,那么使用AI的人应作为作者或发明者。

2、隐私和数据保护

在2016年通过的《一般数据保护条例》(简称GDPR)中,欧盟就加强了个人隐私和数据保护,其中关于用户画像等自动化决策的规定,将对基于大数据的互联网行业实践产生重大影响,即用户有权拒绝企业对其进行画像等自动化决策,而且用于用户画像的数据不能包括人种或者种族起源、政治意见、宗教或者哲学信仰、商会会员、基因、生物特征、健康状况、性生活等特殊类别的个人数据。这将对个性化服务的提供产生重大影响。

监管部门和司法机关对透明性和举证责任的要求,与机器学习结果的不确定性和算法保密要求之间,存在着一种结构性的紧张关系。……2016年阿肯色州发生的一起谋杀案中,警方希望获取Alexa语音助手收集的语音数据,该请求遭到了亚马逊公司的拒绝,理由是警方没有出具有效的法律文件。

3、标准化建设

美国在去年出台的《联邦自动驾驶汽车政策》、《美国国家人工智能研发战略计划》等报告中,也要求加强并统一技术、数据使用、安全等标准建设,避免造成碎片化的问题,影响人工智能研发和应用。

4、“阿西洛马人工智能原则”(Asilomar AI Principles)

2017年1月,在美国加州Asilomar召开的“阿西洛马会议”上,由“生命未来研究所”(Future of Life Institute,FLI) 牵头,844名AI专家联合签署了“阿西洛马人工智能原则”(Asilomar AI Principles)(23条),其核心思想是Beneficial AI,有人解读为 “为了人和人类的AI”。

三、未来:AI可能如何影响法律

- 有人预测,在强人工智能和超人工智能阶段,现有法律已经基本无法直接套用,人工智能将对传统法律体系产生巨大的冲击和颠覆。越来越多的极其复杂的新问题将迅速出现,成文法将会萎缩甚至消亡。

- 未来的人们在作出法律决定时,他们既不需要检索法律,也无须理解法律,更无须权衡行为的合法性,他们所遵循的不过是经由人工智能优化了的微指令而已。

- 如果人工智能的歧视行为给用户造成了实际或精神损害,相关的法律责任应当首先由人工智能服务的最终使用者承担,人工智能开发者有过错的,最终使用者承担责任后可以向开发者追偿。

在判断开发者过错程度时,可能需要区分不同算法:如果技术开发者主动设立了算法中的规则,那么对最终出现的歧视风险预见和控制程度也更高,如果最终因系统的“歧视”或者“偏见”损害了第三方的合法权益,难辞其咎。但如果采取的深度学习等算法,由系统自身探索并形成规则,所以开发者对歧视风险的控制程度是比较低的,主观恶意和过错都较小,可能具有一定的免责空间。

四、落地:以上内容对AI产品经理有何实际借鉴意义

1、行业前景判断

比如自动驾驶,由于法律、伦理、安全,以及道路基础设施等问题,短期内肯定是不可能大规模普及民用的。(当然,以前也说过,卡车的自动驾驶,短期内是可以做的)

多说一句,科技圈公司,更多面临生存压力,首先考虑赚钱,所以伦理、安全、法律等问题的优先级不高——这些问题,至少在行业早期,需要由政府、高校、学术界来推动。

2、产品理念和需求讨论时,需要check伦理问题,足够警惕。

这是因为人工智能系统并非表面看起来那么“技术中立”,如果输入的数据代表性不足或存在偏差,训练出的结果将可能将偏差放大并呈现出某种非中立特征,比如歧视。

所以,最好将伦理委员会常态化,研究产品中的伦理问题及其影响。比如,Google DeepMind、Lucid AI等机构已经设立了伦理审查委员会。该审查委员会由具有不同知识背景和经验的专家组成,在审查时需要参考一定的行业标准,并最大限度地考虑安全和伦理问题。

3、产品思路:AI辅助人工,不能自行决策。

在重要领域,不能将AI的运算结果当然作为最终且唯一的决策依据。例如在关于人工智能医疗辅助诊断的规定中,就明确了人工智能辅助诊断技术不能作为临床最终诊断,仅作为临床辅助诊断和参考,最终诊断必须由有资质的临床医师确定。

4、产品体验细节设计

1)充分考虑女性、儿童、残疾人、少数族群等易被忽视群体的利益,并对道德和法律的极端情况设置特别的判断规则。特别是聊天对话类产品。

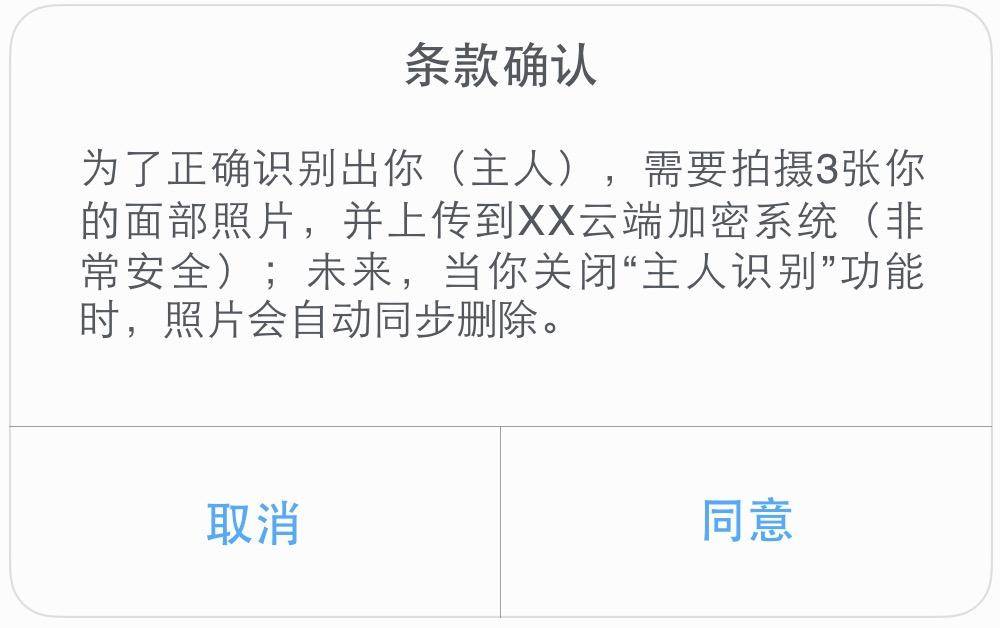

2)体验流程中,如果涉及隐私,需要“明确提醒用户并征得用户同意”,以及“告知用户收集XX隐私信息的期限和方式”,而且,用户有权(有操作入口)拒绝企业对其进行画像等自动化决策(即,不能先斩后奏,让用户先使用、然后再关闭相关功能)。

具体设计细节示例

另外分享一点,AI正在快速进入司法领域(“智慧法庭建设”),“截至今年6月,超过100家法院应用了科大讯飞智慧法庭庭审系统……阿里云的语音技术已快速渗透进300多家法院、6000多个法庭。而今年夏季才入场的腾讯和国双科技,在短短几个月时间中,至少与40家法院达成了合作。”

结语

数据科学家凯西•欧尼尔在其著作《数学武器:大数据如何加剧不平等、威胁民主》中,将造成歧视、个体损害等不利后果的人工智能称为“杀伤性数学武器”(Weapons of Math Destruction),认为因其不透明性、规模效应及损害性而应当引起足够关注。

我想说的是,作为AI产品经理和先行者,我们应该抱着责任感,甚至悲悯、敬畏之心来真正重视AI的伦理和法律问题,因为这些真的会影响我们和后代的未来。

附录一:相关资料推荐

1、2本书籍

《数学武器:大数据如何加剧不平等、威胁民主》和《发明伦理:科技和人类未来》,获评《麻省理工科技评论》2016年最佳图书,涉及技术性失业、致命性自主武器、算法公平、道德判断、价值一致性等AI伦理问题。

2、7篇文章

- 20171206-《从律师到法律机器人,法律行业未来二十年的机遇和挑战:AI观察》

- 20170805-《法律人工智能十大趋势|AI观察》

- 20170612-《全球视野:人工智能的前沿法律政策问题思考》

- 20170413-《2017人工智能:技术、伦理与法律研讨会(AITEL2017)》(含内容纪要和与会专家名单)

- 20170320-《人工智能法律服务的前景与挑战| AI观察》

- 20170106-《人工智能伦理法律问题最全解读:IEEE发布首份人工智能合伦理设计指南》

- 20161009-《阿里研究院聂东明:人工智能或将彻底颠覆人类现行法律体系》

3、5个“AI+法律”相关的产品/公司

1)ROSS。AI+法律领域,全球最知名&有代表性的创业公司,详见《Ross Intelligence:世界首个人工智能律师是如何炼成的?》

2)DoNotPay。在英国,一款名为DoNotPay的机器人律师可以帮助用户挑战交通罚单并准备所需的法律文件,现在已经扩大到了政府住房申请、难民申请等法律服务。详见《免费法律机器人DoNotPay能处理1000种案件!》

3)法里。北京创业公司,详见《原人人网总经理创业,研发AI机器人可解答90%离婚法律问题,半年获得两轮投资》 ;官网。

4)蓝灯鱼Lanternfish。今年在香港成立的公司,主要领域是专利(涉及NLP技术)和商标(涉及CV技术)两方面;官网 。

5)ULegal(有法务)。腾讯投资的互联网法律科技公司,创始人赵小彬(Marcus)是前腾讯微信法务团队创始人,致力于通过法律科技手段,探索法律服务创新和产品化的新思路。公众号“有法务”、官网,详见《ULegal 从成本、效率着手,为B端企业提供法务支持》。

附录二:阿西莫夫机器人三定律的英文原文

Law Ⅰ: A Robot may not injure a human being or, through inaction, allow a human being to come to harm.

第一定律:机器人不得伤害人类个体,或者目睹人类个体将遭受危险而袖手不管;

Law Ⅱ: A robot must obey orders given it by human beings except where such orders would conflict with the first law.

第二定律:机器人必须服从人给予它的命令,当该命令与第一定律冲突时例外;

Law Ⅲ: A robot must protect its own existence as long as such protection does not conflict with the first or second law.

第三定律:机器人在不违反第一、第二定律情况下要尽可能保护自己的生存。

说明:这三条法则实际是把机器对人的服从作为机器的设计和制造的原则,并没考虑具有“自主能力”、甚或“自我意识”等超级人工智能的问题。

#专栏作家#

黄钊(hanniman),图灵机器人-人才战略官,人人都是产品经理专栏作家,前腾讯产品经理,微信公众号/知乎/在行/饭团“hanniman”。5年人工智能实战经验,8年互联网行业背景。“人工智能产品经理”概念的推动者,被AI同行广泛传播的200页PPT《人工智能产品经理的新起点》的作者。

本文原创发布于人人都是产品经理,未经许可,不得转载。

题图来自unsplash,基于CC0协议

起点课堂会员权益

起点课堂会员权益

小说里的定律也拿来说