从“撞大运”到“控概率”:Transformer 告诉我的 AI 协作真相

很多 AI 产品经理都经历过这样的阶段:沉迷于搜集各种“Prompt 秘籍”,却在模型偶尔的“人工智障”面前束手无策。当我摸索着了解 Transformer 黑盒后才发现:如果不理解概率,我们对 AI 的掌控终究只是幻觉。

蜜月期后的“背刺”:它明明很聪明,却莫名其妙地蠢

刚接触大模型那会儿,那种震撼感至今记忆犹新。随手一个问题,它能回馈一段逻辑缜密、措辞讲究的长篇大论。

但蜜月期并没有持续多久。

我曾尝试让模型列举“用户模糊意图的响应场景”:

第一次:逻辑满分。

第二次(换个说法):答案全变了,但依然说得头头是道。

这种不确定性让我陷入了巨大的不安。作为 PM,我每天设计的逻辑,底层竟然建立在一个我完全搞不清楚的“黑盒”之上。

Prompt 优化:那把没有说明书的钥匙

为了解决不安,我开始狂钻研Prompt Engineering。加角色、加思维链(CoT)、给 Few-Shot 示例…… 效果确实有提升,但我始终感到一种“不踏实”。

我的真实体感:

为什么某种结构今天有效,明天就失灵?

我积累了一堆模板,但每次遇到新任务,仍像是在“撞大运”。

我意识到:我是在用一把钥匙开锁,但我完全不知道这把锁的内部构造。

拆开黑盒:Transformer 到底在计算什么?

在一个深夜,我终于决定彻底搞懂 Transformer。当我剥离掉那些复杂的数学公式,我发现了一个残酷但真相:模型从不“理解”任何东西,它只是一台精密的概率计算器。

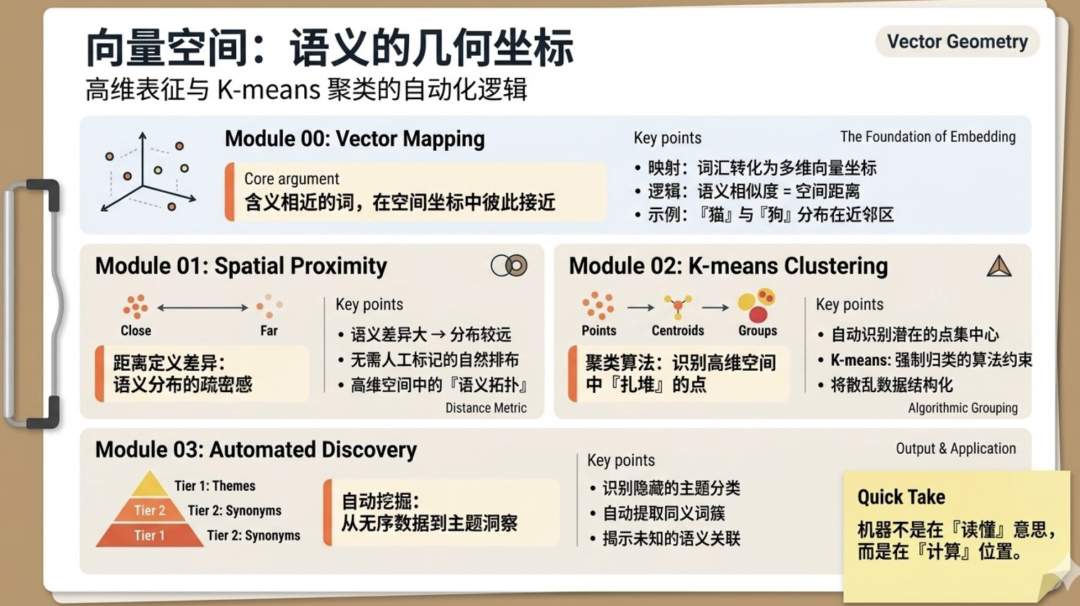

语义坐标:词语的“位置感”

当你输入一句话,模型会将其拆解为Token,并转化成高维向量。

真相:意思相近的词,在空间里的位置更接近。向量承载了词语在数万亿语料中沉淀的“语义坐标”。

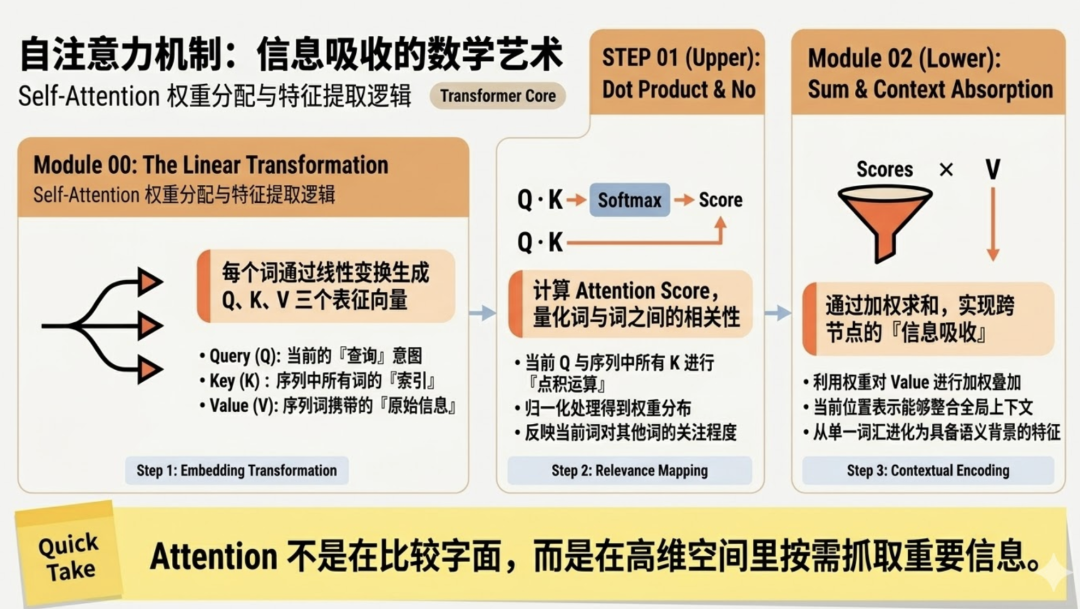

自注意力机制:谁在关注谁?

模型会为每个词计算三组向量:Q(查询)、K(键)、V(值)。

Q:我在找什么?

K:我是什么?

V:我包含什么信息?

模型不是在“阅读”句子,而是在进行一场全局的“卡片配对游戏”。它一眼看穿整句话,计算所有词之间的关联权重。

认知觉醒:那些“奇怪行为”的终极解释

理解了机制后,我之前的所有困惑都有了科学解释:

换个说法,输出全变

Transformer 视角

不同的词触发了不同的注意力权重分布,导向了不同的概率路径。

答非所问 / 幻觉

Transformer 视角

模型没有“事实核查”,它只有**“下一个词的概率预测”**。

一本正经地胡说八道

Transformer 视角

它的目标是生成**“看起来最合理”**的输出,而非“真实”的输出。

方法论升级:从“对话”转向“工程”

认知升级后,我做 AI 产品的方式发生了本质变化,从“求它懂我”变成了“为它铺路”。

✅ 从“扔问题”到“喂上下文”

以前我习惯直接问结论。现在我知道:输出质量高度依赖输入的信息密度。我会把背景、目标、约束打包输入,人为地缩小模型在概率空间里的搜索范围。

✅ 从“自然语言”到“结构化指令”

别指望模型能“心领神会”。我开始用Markdown结构或JSON格式明确定义 Role、Task 和 Constraints。

✅ 从“期待完美”到“设计兜底”

既然不稳定是 AI 的天性,那么产品设计就必须包含:

验证环节:让模型标注信息来源(引用)。

两步走:先输出框架,确认后再填充内容。

失败路径:预设当模型概率偏离时的降级策略。

产品经理的思维“升维”

传统产品的逻辑是确定性的:点击 A,必然出 B。

AI 产品的逻辑是概率性的:输入 A,系统给出概率最高的 B。

这种从“控制确定性”到“管理概率性”的思维转变,才是 AI 时代PM最核心的护城河。

你不必手写反向传播算法,但你脑子里必须有一张系统能力的“地图”。只有知道边界在哪里,你才能做出真正合理的产品决策。

本文由 @van ner 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益