AI越来越便宜,为什么AI产品不一定降价?从Copilot按量计费看AI定价重构

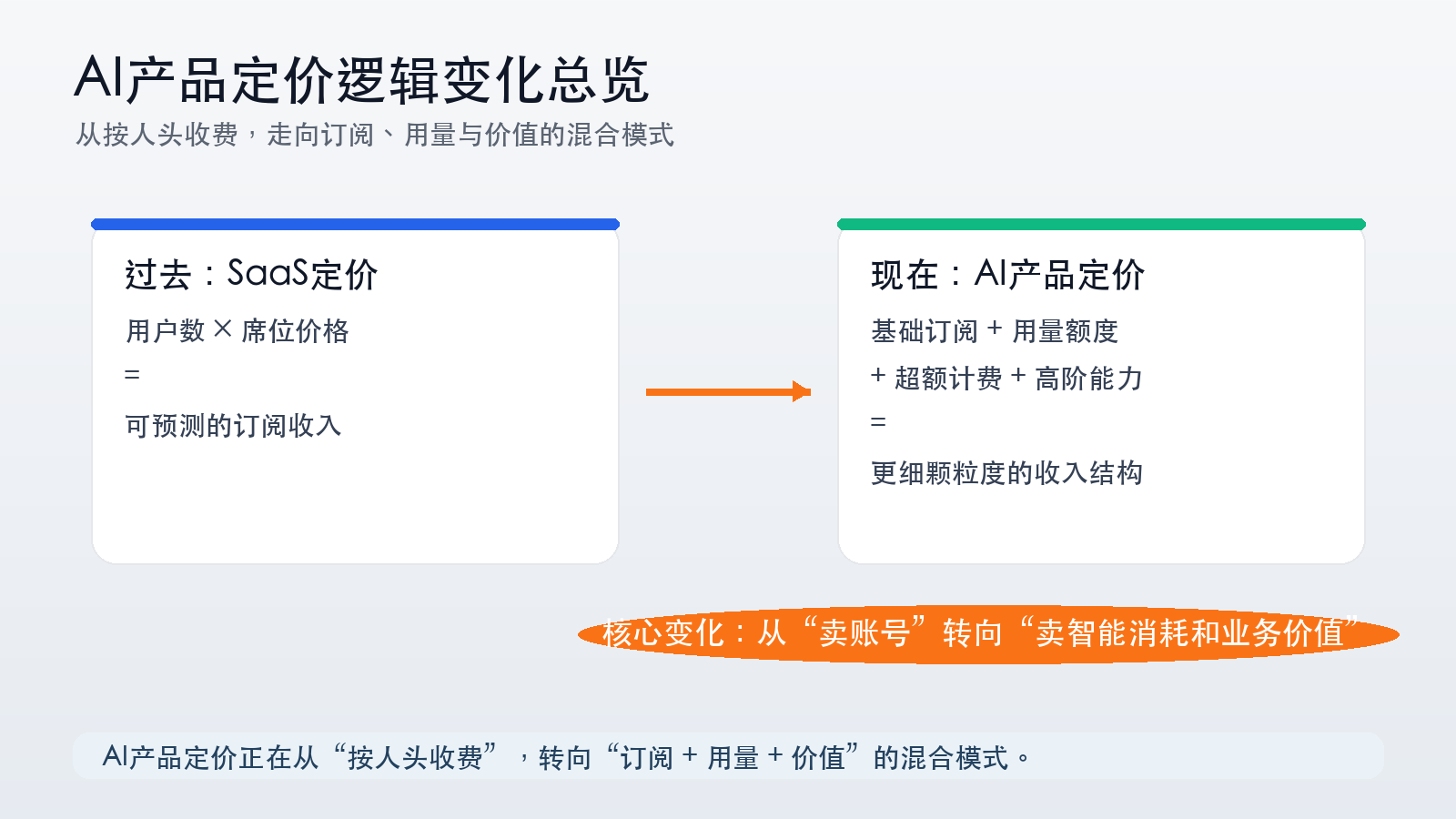

AI产品的定价模式正在经历一场深刻的变革,从传统SaaS的按人头收费转向更复杂的混合计费机制。GitHub Copilot、DeepSeek V4和微软OpenAI的最新动向揭示了这一趋势的核心:按消耗、按价值、按结果分层定价正成为行业新标准。本文将从成本结构、用户价值到产品设计,深度剖析AI产品定价的底层逻辑与实战框架。

最近,AI产品的定价出现了几个值得产品经理关注的信号。

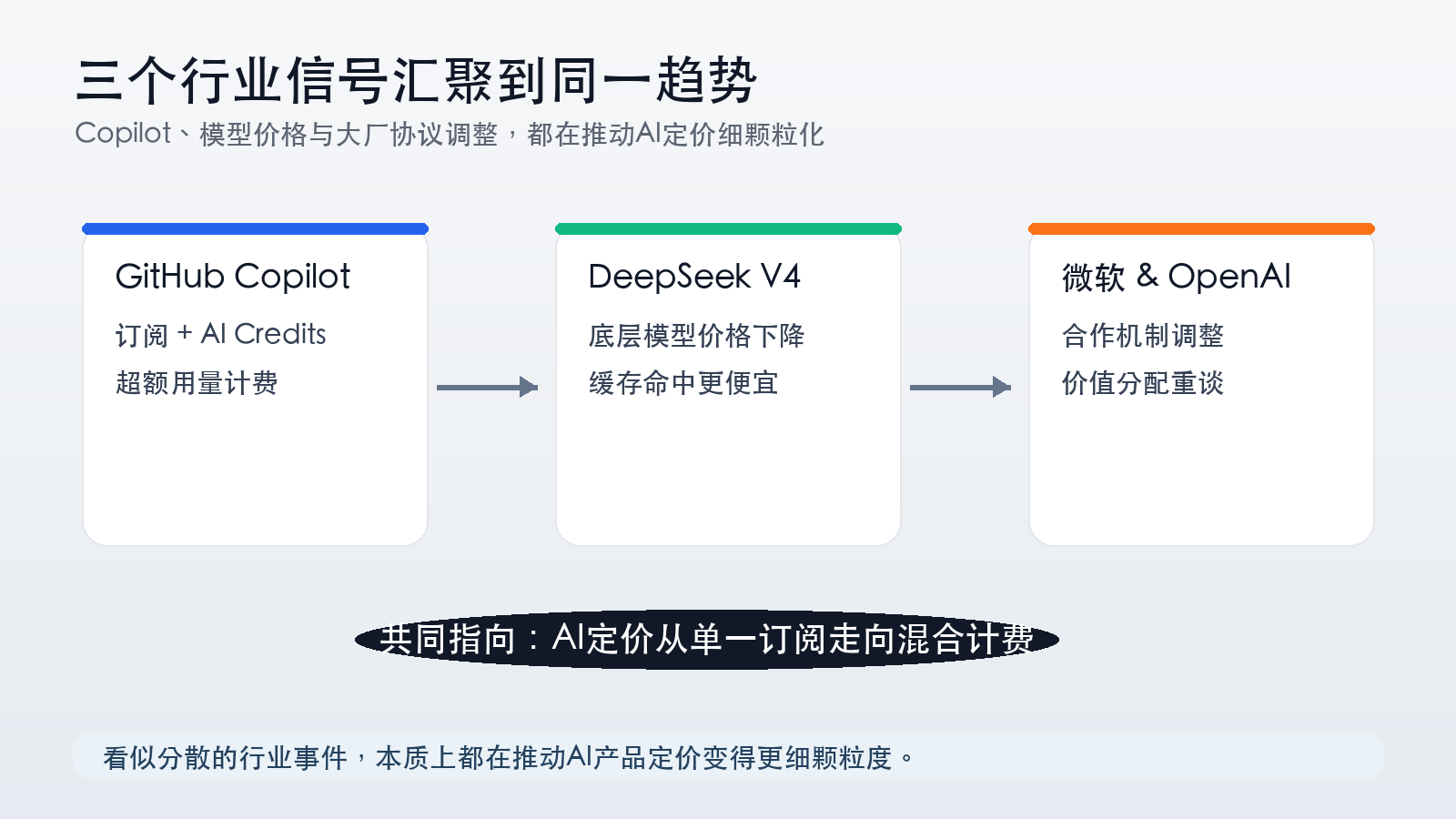

GitHub 宣布,Copilot 将从 2026 年 6 月 1 日起全面引入基于 GitHub AI Credits 的用量计费机制;DeepSeek V4 发布后,公开 API 价格被报道大幅低于 OpenAI 同类模型;微软和 OpenAI 也重新调整了合作协议,云资源、模型授权和收入分成关系变得更加灵活。

这几件事看似分散,但背后指向同一个变化:

AI产品的定价逻辑,正在从“按人头卖软件”转向“按消耗、按价值、按结果分层定价”。

这不是简单的涨价或降价问题,而是AI产品商业模式的一次底层重构。

对产品经理来说,这件事很重要。因为未来设计AI产品时,我们不仅要考虑功能、体验和转化率,还必须把“算力消耗”“用户价值”和“计费方式”一起纳入产品系统设计。

我把这个问题拆成五个维度,逐一聊。

一、旧逻辑:SaaS“按人头收钱”,为什么在AI时代开始失灵?

传统SaaS的定价逻辑非常简单:按席位收费。

团队有10个人用飞书,就买10个席位;有100个人用Salesforce,就买100个席位。每个席位一个月多少钱,明码标价,收入可预测,续费率可追踪。

这套逻辑在过去十几年被反复验证,几乎成了B端产品的默认定价方式。

但AI产品天然不是这样运转的。

核心矛盾在于:

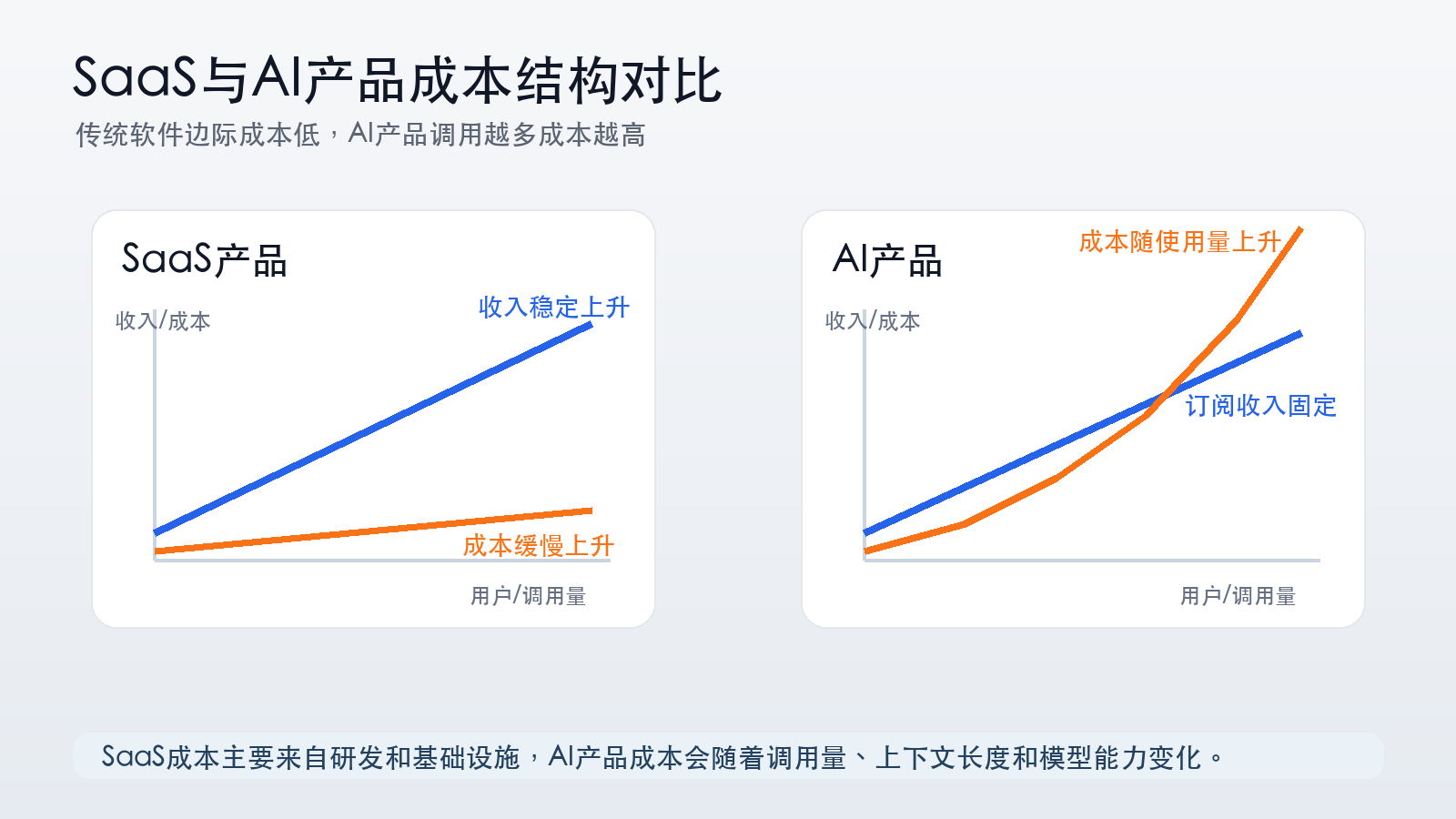

传统软件的边际成本趋近于零,但AI产品的每一次调用,都对应真实的推理成本。

多一个用户登录Notion,平台的边际成本变化并不明显。但多一个用户让AI生成一份5000字的行业分析、跑一轮复杂代码生成、处理一批长文档,背后都需要模型推理、上下文处理、缓存、带宽和算力资源。

用户用得越多,成本越高。

这就导致固定订阅制在AI产品里天然存在一个问题:

重度用户可能亏钱,轻度用户贡献利润,平台依靠用户之间的交叉补贴维持整体模型。

在增长期,这种模式问题不大。用户规模快速扩大,订阅收入持续增长,轻度用户能够覆盖一部分重度用户的成本。

但当增长放缓、用户使用深度提升,问题就会越来越明显:收入按月固定增长,成本却可能随着调用量、上下文长度和高阶模型使用频次快速上升。

一句话:

SaaS卖的是“软件使用权”,AI产品卖的很大一部分其实是“持续消耗的智能能力”。两者的成本结构不同,定价方式自然也会发生变化。

二、三个信号:为什么AI产品正在走向“订阅 + 用量”的混合计费?

按量计费并不是GitHub一家的选择,而是整个AI产品定价正在发生的结构性变化。

最近几个信号,可以放在一起看。

信号一:GitHub Copilot引入AI Credits计费

GitHub Copilot并不是简单取消订阅,转向纯按量收费。

更准确地说,它正在走向一种混合模式:基础订阅仍然存在,但订阅中包含一定额度的AI Credits;用户超出额度后,再为额外用量付费。

这个变化的本质是:平台不再只按“你是否拥有账号”收费,而是开始计量“你实际消耗了多少智能能力”。

这对AI产品有很强的风向标意义。

Copilot是全球影响力最大的AI编程工具之一,它的定价变化说明:即使是用户规模很大的AI产品,也需要重新平衡用户感知、产品价值和模型消耗之间的关系。

信号二:底层模型价格继续快速下降

DeepSeek V4发布后,公开API价格被报道大幅低于OpenAI同类模型,缓存命中价格也进一步降低。

这说明底层模型能力正在快速商品化,推理价格也在持续下降。

但这并不意味着所有AI应用都会同步降价。

原因很简单:用户买的不是模型本身,而是完整的产品体验。

一个AI应用的成本,不只包括模型调用,还包括产品研发、工作流设计、数据处理、权限系统、审计合规、稳定性保障、客服支持和销售交付。

所以,当模型越来越便宜时,上层应用面临的不是“必须降价”,而是一个更复杂的问题:

用户会越来越清楚地感知到底层模型在变便宜,因此上层应用必须证明,自己收的钱不只是模型差价,而是真正的业务价值。

这会倒逼AI产品从“套壳模型”走向更深的工作流设计。

信号三:大厂合作关系也在重新分配价值

微软和OpenAI近期调整合作协议,也说明AI产业链里的价值分配正在变化。

过去,模型、云资源、产品入口、收入分成可以高度绑定在一个大联盟里。但随着模型选择变多、云合作关系变复杂、企业客户需求更细分,单一的商业绑定方式会越来越难覆盖全部场景。

这背后的趋势是:

AI商业模式正在从粗粒度的“统一打包”,走向更细粒度的“能力拆分、资源计量和价值分成”。

把这三个信号合在一起看,AI产品的定价正在从单一订阅,逐步走向:

基础订阅 + 用量额度 + 超额计费 + 高阶能力单独计价。

这可能会成为未来一段时间内AI产品最主流的定价形态。

三、一个框架:用“三因子模型”判断AI功能到底值不值得做

趋势说完,落到产品经理的实操层面。

当我们设计一个AI功能时,最常见的问题不是“能不能做”,而是:

这件事值不值得用AI做?用户愿不愿意为它付费?

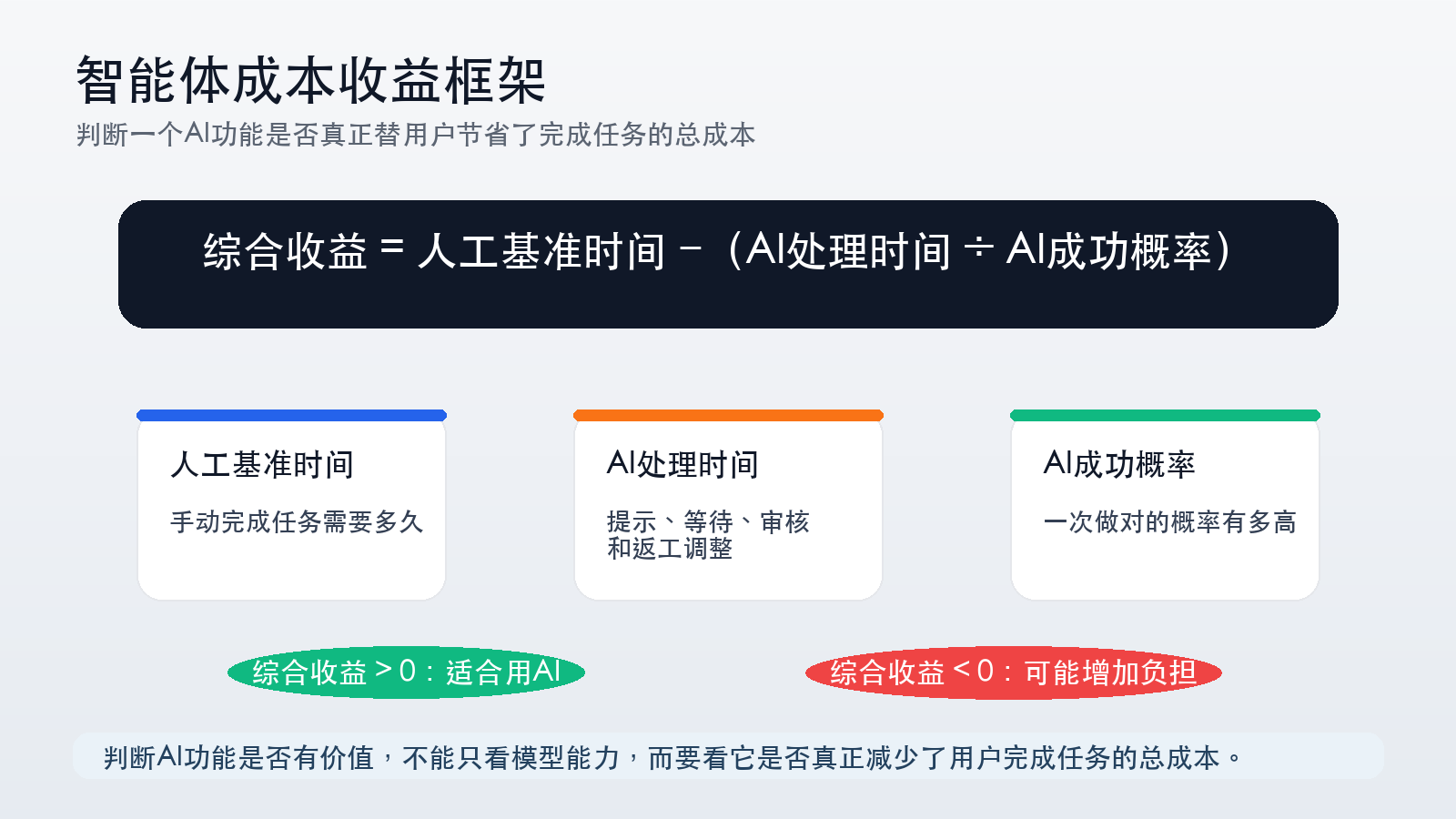

我常用一个简单框架,叫做“智能体成本收益框架”。核心看三个因子:

- 人工基准时间:用户手动完成这个任务需要多久?

- AI成功概率:AI一次做对的概率有多高?

- AI处理时间:写提示词、等待输出、审核结果、返工调整,总共需要多久?

可以用一个简化公式来表达:

综合收益 = 人工基准时间 −(AI处理时间 ÷ AI成功概率)

当综合收益为正,说明AI确实节省了用户时间;当综合收益为负,说明这个AI功能看起来很炫,但实际可能增加了用户负担。

举个例子。

如果用户手动写一份竞品分析需要2小时,使用AI需要20分钟,且结果一次可用的概率是80%,那么AI的有效处理时间约等于25分钟。

这时,AI明显创造了价值。

但如果某个任务人工只需要5分钟,AI生成要3分钟,用户还要花10分钟检查和修改,那么这个功能就不一定值得做。

这个框架不仅能判断“要不要用AI”,也能帮助我们思考“该怎么定价”。

因为AI产品的定价,本质上不是给功能标一个数字,而是回答:

我替用户节省了多少时间,降低了多少成本,减少了多少不确定性?

如果一个AI功能能把2小时的人工作业压缩到20分钟,它的价格锚点就不应该只看模型调用成本,而应该看它替用户节省的人工成本和业务机会成本。

这也是为什么AI产品不能只用“Token成本 × 毛利率”来定价。

底层成本决定价格下限,用户价值决定价格上限。

真正合理的定价,应该在两者之间找到平衡。

四、三个问题:每个AI产品经理都要回答的定价题

具体到产品设计,每个AI产品经理至少要回答三个问题。

问题一:你的产品是“工具”,还是“引擎”?

如果你的产品是工具,比如AI写作助手、AI翻译、AI图片生成,用户的使用频率通常波动很大。

有的人每天重度使用,有的人一个月只打开几次。

这种场景下,纯固定订阅很容易产生交叉补贴:轻度用户觉得不划算,重度用户又可能带来过高成本。

因此更适合采用“基础额度 + 超额计费”或“积分包”的方式。

但如果你的产品是引擎,比如AI客服、AI销售线索处理、AI自动化工作流,它更像一个持续运行的业务系统。用户消耗相对稳定,价值也更容易和业务结果绑定。

这种情况下,可以采用“平台费 + 用量费 + 结果费”的混合模式。

比如:每月基础服务费覆盖系统能力,消息量、工单量、调用量按阶梯收费,高价值结果再单独计价。

问题二:你的成本结构是固定成本为主,还是边际成本为主?

如果你的主要成本来自模型推理、长上下文调用、多模态处理和高频任务执行,那么边际成本很高,定价必须考虑用量。

否则,用户越成功、用得越多,平台反而越容易亏钱。

但如果你的主要成本来自研发、数据治理、私有化部署、交付实施和客户成功,那么固定成本占比更高,订阅制仍然有存在价值。

这类产品的重点不是精确计量每一次调用,而是用订阅费覆盖长期服务成本,再用一定的用量边界控制风险。

所以,AI产品不是一定要放弃订阅制。

更准确的说法是:

AI产品需要从“单一订阅制”,走向“订阅和用量结合”的分层定价。

问题三:用户能不能接受“用得多付得多”?

按量计费最大的难点,不是数学问题,而是心理问题。

用户习惯了“每月固定付费”,突然看到费用随使用量波动,很容易产生失控感。

尤其在企业场景里,预算可预测性非常重要。哪怕按量计费理论上更公平,只要账单不可控,用户也会抗拒。

所以,AI产品设计按量计费时,必须配套三类机制:

- 用量可见:用户随时知道自己用了多少额度

- 费用可控:用户可以设置预算上限和自动停用规则

- 预警及时:接近额度上限时提前提醒,而不是月底突然出账单

好的按量计费,不是让用户每次使用都心疼钱,而是让用户觉得:

我知道自己花了多少钱,也知道这些钱换来了什么。

这才是AI产品定价体验的关键。

五、终局思考:当模型变成水电煤,产品经理的护城河在哪里?

最后聊一个更大的问题。

当模型越来越便宜、能力越来越强、API越来越标准化,模型本身会变成什么?

我认为会越来越像基础设施。

就像云计算、带宽、电力一样,模型能力会成为很多产品背后看不见但无处不在的底层能力。

当模型变成基础设施,行业竞争会发生三层变化。

第一,模型层的竞争会从“谁更强”逐渐转向“谁更便宜、更稳定、更容易集成”。

强模型仍然重要,但单纯依赖模型能力形成壁垒会越来越难。

第二,应用层的竞争会从“接入模型”变成“设计系统”。

未来真正有价值的AI产品,不是简单把一个模型接进来,而是把模型、数据、权限、流程、审核、协作、反馈机制编排成一个能稳定解决问题的系统。

第三,产品经理的核心能力会从“选模型”变成“铺轨道”。

所谓铺轨道,就是把用户任务拆解清楚,把AI适合做的环节、人工必须介入的环节、结果如何验证、失败如何兜底,都设计成一套稳定流程。

竞争优势不在于“我会用AI”,而在于:

我能设计出让AI高效、稳定、可控地完成任务的系统。

按量计费只是表层变化。

它背后真正折射出的趋势是:AI行业正在从“能力稀缺时代”进入“能力充裕时代”。

能力稀缺时,谁拥有最强的模型谁赢。

能力充裕时,谁能把模型变成稳定、可计量、可交付的业务系统,谁更有机会赢。

对产品经理来说,这其实是一个好消息。

因为理解用户、设计流程、拆解任务、权衡成本和收益,本来就是产品经理的核心能力。

只是这一次,我们需要把定价逻辑也纳入产品设计之中。

AI产品的价格,不应该只是商业部门最后贴上的标签。

它应该从一开始,就成为产品系统的一部分。

本文仅代表个人观点,欢迎讨论。

本文由 @沐歌聊AI 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益