具身智能之于AI产品未来的发展

编辑导语:从字面意思来讲,具身智能即意为具有身体的人工智能,智能体与真实世界进行多模态交互,实现更进一步的智能。而这一概念区别于传统AI,于未来的AI产品而言,又会产生哪些影响?本篇文章里,作者就具身智能的定义、及其对未来AI产品的影响做了解读,一起来看一下。

前两天参加了计算机视觉国内的学术会议VALSE,听到一个分论坛是关于具身智能及未来的发展方向,里面提到关于人工智能与哲学假设的一些观点,作为“哲学+AI产品思考者”双重人设的笔者,具身智能的发展将如何影响未来AI产品的发展?我认为有必要跟大家掰扯掰扯。

一、什么是具身智能?

具身智能翻译于英文embodied AI,字面意思就是具有身体的人工智能,此处强调的就是智能体(agent)需要与真实世界进行交互,并通过多模态的交互(不仅仅是让AI学习提取视觉上的高维特征被“输入”的认知世界),而是通过“眼耳鼻舌身”五根来主动地获取物理世界的真实反馈,通过反馈进一步让智能体学习并使其更“智能”、乃至“进化”。

佛教中六根清净的六根——除mind之外,具身智能需与外界感知交互

1986年,著名的人工智能专家布鲁克斯(Rodney Brooks)提出:智能是具身化和情境化的,传统以表征为核心的经典AI进路是错误的,而清除表征的方式就是制造基于行为的机器人。

这个理论和19世纪60年代最早提出的认知智能,也是与“当前主流深度神经网络的基于大脑是基于神经元连接的复杂系统-基于信息的表征与加工”相悖的。

提到具身智能和进化就不得不提到李飞飞老师今年提出的一套非常新的计算框架——DERL(deep evolution reinforcement learning)深度进化强化学习。这篇文章提到了生物进化论与智能体进化的关系,并借鉴了进化论的理论应用于假设的智能体(unimal宇宙动物)的进化学习中。

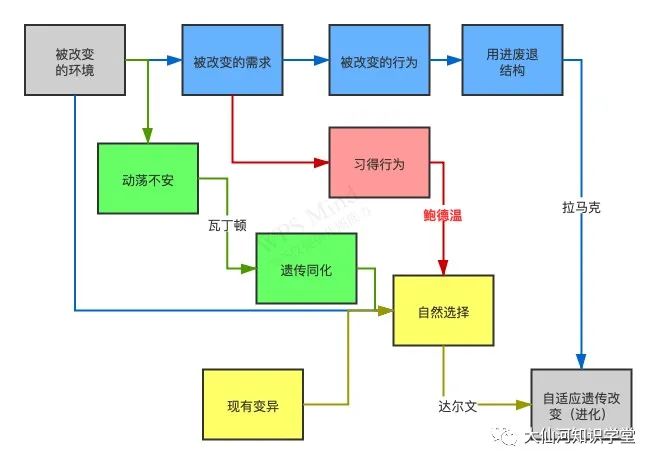

进化论的几大学说:达尔文、瓦丁顿、鲍德温、拉马克——图片版权归作者所有,需要请联系作者

李飞飞首次在文章中证明了鲍德温效应,即没有任何基因信息基础的人类行为方式和习惯(不通过基因突变的有性繁殖进化),经过许多代人的传播,最终进化为具有基因信息基础的行为习惯的现象(进化的强化学习)。

并且李飞飞在设计unimal过程中也参考了拉马克的学说来对智能体穿越不同复杂地形进行训练,“用进废退”即生物体经常的器官经常使用就会变得发达,而不经常使用就会逐渐退化。在这篇paper里,unimal通过无性进化限定了三种方式(a.删除肢体;b.调整肢体长度;c.增加肢体)。

大家观赏下这个虚构的unimals(宇宙动物not宇宙的囚徒)进化的魔性步伐

不得不说这个想法实在是太大胆,太创新了,惊为天人。

二、哲学层面的解读:认知智能 vs 具身智能;笛卡尔 vs 海德格尔

从非具身智能(认知智能)到具身智能像极了传统哲学与现象学洞见后的哲学。如果大家不能一下子理解,我更愿意将其解释为,前者是形而上学的、二元论的(意识与主体可以独立存在)、理想家;而后者是实践派、存在主义、实践者。

笛卡尔坐标系——源于哲学理论的推理演绎

笛卡尔说过:“我思故我在”,因为意识决定了我的存在。海德格尔后来对笛卡尔的观点进行了批判,他提出“我在故我思”,因为人们的存在才有意识,才能感知这个世界,如果人不是人存在于其他的生物体里,比如蝴蝶、鲸鱼,那么人对于世界的认知也会不同。

海德格尔——successor德雷弗斯在MIT演讲题目(为什么AI研究者应该研究“存在与时间”)

因此具身智能区别于传统AI也很大程度上受到海德格尔哲学理论的启发:

- 智能是非表征的;

- 智能是具身的——存在先于意识;

- 智能是在与环境交互时体现的。

三、下一步的AI产品

笔者以为,无论是传统基于表征的深度学习还是新提出的具身的、基于存在与时间的具身智能都要有很长的路要走。但是毫无疑问,如果要做到一个通用型的人工智能,多模态的、具身的、主动交互式的人工智能体一定是必由之路。

为何如此笃定?因为何为人工智能、是人类-高级智慧体定义训练的一种人造的、类人的高级智能。

既然如此,是不是应该具备人类这种高级智能体的特性呢?比如生物体的进化、比如高层次的智能:推理、演绎、下棋等,也包括低层次的智能:行走、交谈、感知。

snapchat的AR lens

因此,私以为未来的AI产品方向应该是从传统的2D平面人工智能(比如图像分类、目标检测、分割等任务)向3D空间的,向4D时序的方向发展(存在与时间)。

- 比如我们看到短视频/视频vlog这几年较原来的微博图文有了极大发展,因为可以带给用户基于时间的空间的、环境的更多信息;

- 发展向给用户更加沉浸式的体验,比如AR/VR、提供的是基于空间、环境、时间的全方位的感知与体验;

- 发展向具身的虚拟数字人/AI智能助理,人形的机器人比如说特斯拉发布的tesla bot,视觉+语音的多模态主动式的与用户交互;

- 发展向智能车,对外适应环境适配复杂路况、交通情况进行智能驾驶,对内为驾驶员和乘客提供可感知可交互的“第三空间”,满足用户的不同场景需求。

作者:大仙河,5年智能硬件产品经验,2年人工智能算法产品经验;微信号 :大仙河知识学堂

本文由 @大仙河 原创发布于人人都是产品经理,未经许可,禁止转载

题图来自Pexels,基于 CC0 协议

起点课堂会员权益

起点课堂会员权益

何大仙v5

谢谢💋

用神经网络模型训练虚拟生物体的“用进废退”👍

李飞飞老师的成果永远都这么让人耳目一新 顶级学者👍

未来可期

写写同学支持

谢谢

文章使人耳目一新

新科技需多学习