Gemini 3 Flash:AI 基础设施的性价比拐点与技术深度解析

Gemini 3 Flash的发布正在颠覆AI行业的成本逻辑。这款Google DeepMind最新模型以博士级推理能力与基础设施级价格的惊人组合,实现了90%商业场景的无缝覆盖。从动态计算架构到原生视频理解,我们将深度解析它如何破解智能产品的「不可能三角」。

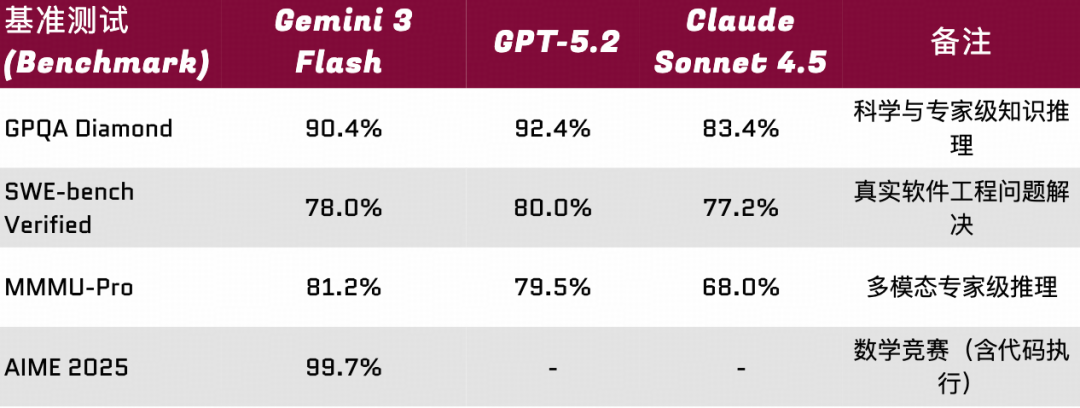

2025年12月17日,Google DeepMind 正式发布 Gemini 3 Flash。作为 Gemini 3 系列的最新迭代,该模型以 $0.50/1M 的输入定价和 90.4% (GPQA Diamond) 的推理性能,在“成本-延迟-智能”的三难困境中取得了突破性平衡。本文将从技术规格、动态计算架构、基准测试对比及多模态工程化应用四个维度进行深度解析,探讨其如何重新定义商业 AI 的性能基准。

01 战略定位:智能的“通缩时刻”

长期以来,大模型市场呈现明显的两极分化:以 GPT-5/Claude Opus 为代表的“高智商/高延迟/高成本”模型,和以 Llama/Mistral 为代表的“低延迟/低成本”模型。

Gemini 3 Flash 的发布打破了这一格局。其核心战略意义在于将博士级的推理能力(PhD-Level Reasoning)下放至基础设施级的价格区间。

定价策略分析:

- 输入:$0.50 / 1M tokens

- 输出:$3.00 / 1M tokens

对比:相比 GPT-5.2 ($1.75/$14.00) 和 Claude Sonnet 4.5 ($3.00/$15.00),Gemini 3 Flash 将推理成本降低了70%-80%1。

这一价格体系的建立,意味着企业在构建 AI 应用时,不再需要为了成本而牺牲模型智商。对于长文档分析(RAG)、全量日志监控、视频流实时理解等高吞吐场景,高精度模型的规模化部署具备了前所未有的商业可行性。

02 技术解析:动态计算与推理架构

Gemini 3 Flash 并非传统意义上的“蒸馏”模型,其高性能来源于架构层面的优化,特别是针对推理过程的精细化控制。

2.1 动态“思维层级” (Dynamic Thinking Levels)

Google 首次在 API 层面引入了thinking_level参数,允许开发者根据任务复杂度动态调整模型的计算量 :

- Minimal:仅适用于 Flash 模型的特殊模式。跳过深度思维链,追求极致的 Token 生成速度(>200 tokens/s),适用于高频简单的指令遵循。

- Medium:Flash 模型特有的平衡档位,适合大多数常规分析任务。

- High (Default):模型在输出前进行深度的隐式推理。在处理数学(AIME 2025: 99.7%)和复杂逻辑问题时,其表现足以媲美 Pro 级模型。

这种设计使得同一个模型端点(Endpoint)能够弹性覆盖从“即时聊天”到“深度分析”的全谱系需求,大幅降低了工程维护的复杂度。

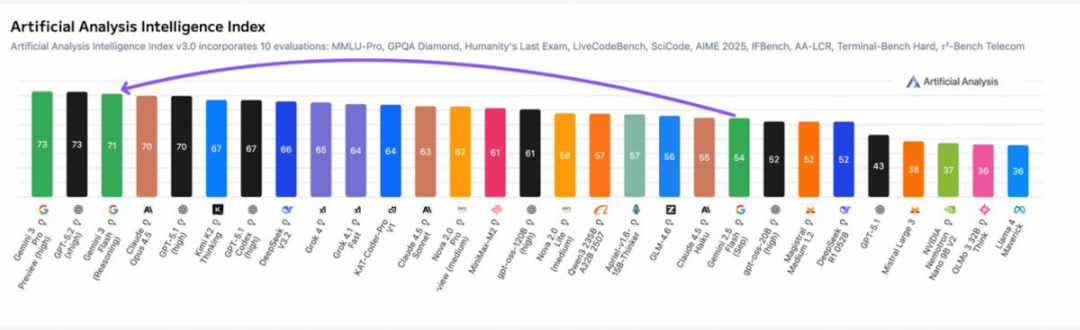

2.2 基准测试:越级挑战

在权威评测中,Gemini 3 Flash 展现了与其定位不符的越级性能:

关键发现:在 SWE-bench(代码能力)测试中,Flash 模型得益于极快的推理速度,能够在单位时间内完成更多的“自我修正”循环(Self-Correction Loops),从而在实际工程表现上超越了部分更昂贵的 Pro 模型,甚至在多模态推理(MMMU-Pro)上击败了 GPT-5.2。

03 多模态与原生视频理解

在多模态领域,Gemini 3 Flash 延续了 Google 的原生优势。其100万 Token的上下文窗口配合优化的视觉编码器,使其在视频理解上具有显著优势。

3.1 颗粒度控制:Media Resolution

为了进一步优化成本,Flash 模型引入了media_resolution参数 :

- Ultra High:仅限图像,用于识别密集文本或微小细节。

- Low/Medium:针对视频优化。模型将视频帧压缩至极低 Token 数(约 70 tokens/帧),这意味着处理 1 小时的视频仅需消耗极少的计算资源。

3.2 应用场景突破

- 原生视频流处理:不同于传统的“截帧 -> OCR”方案,Flash 模型支持原生的视频 Token 输入,能够理解时间序列上的动作与因果关系。

- 海量数据挖掘:得益于低成本与高吞吐,企业首次可以对历史视频档案、监控录像、长音频会议记录进行全量的结构化数据提取,而无需担心预算超支。

04 结论与建议

Gemini 3 Flash 的发布是生成式 AI 发展史上的一个重要里程碑。它标志着智能的边际成本开始大幅下降,使得此前因成本过高而无法落地的长尾应用场景(Long-tail Use Cases)具备了商业价值。

针对技术团队的建议:

- 重构模型选型策略:对于绝大多数非科研级(Non-Research Grade)的商业应用,建议将 Gemini 3 Flash 作为默认基座模型。其性能已足以覆盖 90% 的业务需求。

- 利用动态推理特性:在开发中充分利用thinking_level参数。对于简单任务使用Minimal模式以获得极致速度,对于复杂逻辑使用High模式以获得深度智能,从而在单一模型上实现即时响应与深度思考的统一。

- 多模态数据资产化:利用低成本的视频/图像理解能力,着手挖掘企业内部非结构化数据(视频会议录像、监控流、扫描文档)的价值。

本文由 @像素呼吸 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益