AI动捕技术革命下的行业重构与产品经理的新战场

AI动捕技术正以惊人的速度打破传统动捕的高成本壁垒,从好莱坞到独立游戏工作室,一场从‘穿戴’到‘感知’的技术革命正在进行。本文将深度解析AI动捕与传统技术的核心差异,揭示为何《黑神话:悟空》仍坚守光学动捕,以及无标记点技术如何开辟百亿级新市场。

在人工智能与计算机视觉技术飞速发展的当下,动作捕捉(Motion Capture,简称Mocap)这一曾经被好莱坞大片和AAA级游戏大作垄断的技术,正经历着前所未有的“民主化”变革。本文作为一份深度行业研究报告,旨在为产品经理、行业分析师及相关从业者提供一份关于AI动捕行业现状、市场动态及未来趋势的详尽指南。

报告首先回顾了动捕技术的演进历程,深度剖析了光学动捕、惯性动捕与新兴AI视频动捕的技术差异与应用边界。结合《黑神话:悟空》等现象级案例,探讨了AAA级游戏制作中动捕技术的实际应用逻辑与不可替代性。同时,基于海量市场数据,分析了全球及亚太地区动捕市场的增长潜力,特别是无标记点(Markerless)动捕技术的爆发式增长。

针对用户体验,报告引入了“恐怖谷”理论的心理学视角,分析了虚拟人与NPC交互中的动作保真度对用户情感的影响。最后,结合笔者过往使用Xsens制作虚拟人的实战经验与近期在行业面试中的深度见闻,评估了当前的入行前景,并为有志于进入该领域的产品经理提供了具体的职业发展建议与策略展望。

一、从“穿戴”到“感知”的范式转移

1.1 动捕技术的“祛魅”时刻

曾几何时,提及动作捕捉,人们脑海中浮现的画面往往是身穿布满反光小球紧身衣的演员,在造价昂贵、布满摄像头的空旷影棚中做出各种夸张动作。这种被称为“光学动捕”的技术,长期以来代表着行业的最高标准,但也因其动辄数十万美元的搭建成本和复杂的专业门槛,成为阻挡中小型创作者的高墙。

然而,随着AI技术的到来以及蓬勃式的发展,这堵高墙正在被人工智能技术动摇。基于计算机视觉的AI动捕技术,号称只需一个普通的RGB摄像头,即可从视频中提取人体骨骼数据,生成3D动作。这不仅是技术的迭代,更是一场生产力的解放。

1.2 个人视角的变迁:从Xsens到AI

作为一名曾深度使用Xsens惯性动捕设备的从业者,我见证了这一变迁的阵痛与惊喜。Xsens曾是我们眼中的“便携神器”,它摆脱了光学相机的场地束缚,让我们能在户外、办公室甚至走廊里进行捕捉。但它依然需要穿戴设备、校准传感器,且时刻面临着“磁场干扰”和“零点漂移”的焦虑。

近期的面试经历让我敏锐地察觉到,行业对动捕的定义正在发生微妙的变化。我也开始查阅多方资料研究Move AI与DeepMotion的算法差异、如何用低成本方案解决AI动捕的脚滑问题,我想这些问题的背后也许是整个行业对降本增效的极致追求,以及对AI技术边界的不断试探。

1.3 核心议题

本文将围绕以下核心问题展开深度探讨:

- 市场真相:AI动捕到底是在取代传统市场,还是在创造新市场?

- 技术边界:在《黑神话:悟空》这样的顶级制作中,为什么AI动捕依然无法撼动光学动捕的地位?

- 用户心理:当AI生成的动作不够完美时,用户感知的“恐怖谷”效应是如何产生的?

- 职业前景:在AI接管了“捕捉”这一环节后,人类从业者的价值锚点应当定在哪里?

第二章:全球动捕行业发展现状与市场格局

2.1 市场规模与增长驱动力

根据多家权威机构的市场调研数据,全球3D动作捕捉系统市场正处于稳健上升通道,而其中的细分领域——无标记点(Markerless)动捕市场,则呈现出爆发式增长态势。

2.1.1 整体市场数据

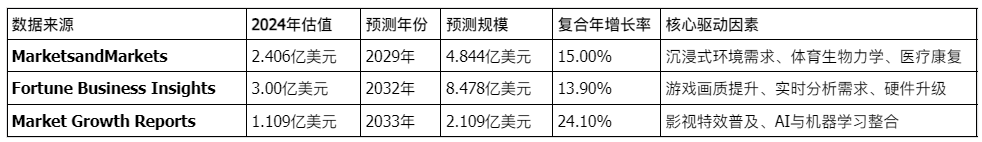

2024年,全球3D动作捕捉系统市场的估值约为2.4亿至3亿美元。虽然这个基数在科技行业中看似不大,但其增长率却十分可观。预测数据显示,到2029年,市场规模将达到4.84亿美元,复合年增长率(CAGR)高达15.0%。更乐观的预测认为,到2032年,该市场将突破8.47亿美元。

表 2-1:全球3D动捕市场规模预测对比

2.1.2 无标记点市场的爆发

如果说传统动捕市场是稳步增长,那么无标记点市场则是“指数级”爆发。数据显示,无标记点动捕行业预计将从2025年的152.5亿美元增长至2035年的744.7亿美元,CAGR高达17.18%。

洞察:这里存在一个巨大的数据差异(传统动捕的几亿美元 vs 无标记点的几百亿美元)。这揭示了一个核心事实:AI动捕并非仅仅在蚕食传统动捕的份额,而是在将动捕技术泛化到监控、安防、自动驾驶、零售分析等非娱乐领域。对于产品经理而言,这意味着“动捕”的应用场景已经远远超出了游戏和电影的范畴。

2.2 竞争格局与主要玩家

目前的市场呈现出“老牌巨头转型”与“AI新贵崛起”并存的局面。

2.2.1 传统硬件巨头的护城河

- Vicon & OptiTrack(光学双雄):这两家公司依然牢牢占据着高端市场(生命科学、工程级科研、3A大作)。面对AI的冲击,Vicon推出了Valkyrie相机系列,强调高达2600万像素的分辨率和对高速运动的捕捉能力,这是目前AI通过普通摄像头无法企及的物理壁垒。同时,他们也在积极整合机器学习算法来辅助标记点识别,试图在“精准度”上构建绝对防线。

- Movella (Xsens) & Rokoko(惯性双杰):Xsens继续在抗磁干扰和户外便携性上深耕,是目前中高端影视预演和游戏制作的主力。Rokoko则展现出了极强的软件转型意愿,不仅卖动捕服,还推出了“Rokoko Vision”双摄AI动捕方案,试图打通从硬件到纯软件的全生态链。

2.2.2 AI动捕新势力的野蛮生长

- Move AI:被公认为目前消费级AI动捕的“画质天花板”。它不依赖单一摄像头,而是利用多台iPhone进行多视角同步录制,通过摄影测量原理解决深度遮挡问题,精度直逼入门级光学设备,但成本仅为后者的几十分之一。

- DeepMotion & Plask:主打Web端、单摄像头、零硬件门槛。它们是独立开发者和Vtuber的最爱,支持直接上传视频生成3D动画。虽然精度和稳定性略逊一筹(存在抖动和滑步),但其“免费/低价订阅”的SaaS模式极大地降低了用户门槛。

- Kinetix & Wonder Dynamics:专注于特定场景的自动化,如Wonder Dynamics可以将视频中的真人直接替换为CG角色,并自动完成光照匹配和动捕,直击影视后期痛点。

2.3 区域发展差异

北美地区凭借好莱坞和硅谷的技术积累,目前占据了约37%-40%的市场份额。然而,亚太地区被预测为增长最快的区域,CAGR达到17.6%。

这一增长主要得益于:

- 中国游戏产业的崛起:以腾讯、网易、米哈游及游戏科学为代表的厂商对高品质3D内容的巨大需求。

- 虚拟偶像(Vtuber)文化:在日本和中国,虚拟主播已成为庞大的产业,对低成本、实时互动的动捕方案有着刚性需求。

- 政策扶持:中国对数字经济、元宇宙及VR/AR产业的政策倾斜,加速了相关技术的落地。

第三章:技术硬核对比——AI动捕的边界与突破

作为产品经理,不仅要看市场热闹,更要懂技术门道。为什么在《黑神话:悟空》里,杨奇和冯骥依然选择昂贵的Vicon,而不是用几台iPhone搞定动作?这涉及到了AI动捕目前尚无法逾越的物理与算法边界。

3.1 三大技术流派的原理级对比

为了清晰展示技术差异,我们将光学、惯性与AI视觉动捕进行多维度对比。

表 3-1:主流动捕技术方案深度对比

3.2 惯性动捕(Xsens)的“阿喀琉斯之踵”:漂移

结合我个人的使用经历,Xsens的最大痛点在于位置漂移。IMU传感器非常擅长测量“旋转”(比如手臂弯曲了多少度),但非常不擅长测量“位移”(比如人向前走了几米)。

它是通过对加速度进行二次积分来推算位移的,这意味着极其微小的传感器误差,经过几秒钟的积分累积,就会变成巨大的位置偏差。在实际使用中,我们经常发现演员在原地做了一套动作,但在软件里,模型却慢慢“滑”出了几米远。虽然Xsens有算法(如HD Reprocessor)来修正,但在长时间录制或复杂地形互动时,这依然是个大问题。这也是为什么在需要绝对空间定位(如多人交互、定点跳跃)时,光学动捕依然不可替代。

3.3 AI动捕的致命伤:深度歧义与高频抖动

AI动捕目前面临两大核心技术挑战,这也是它难以进入3A大作最终生产流程的原因:

3.3.1 单目深度歧义

在单摄像头(如DeepMotion, Plask)方案中,AI面临着一个物理难题:它不知道屏幕上的二维图像在三维空间中有多远。

举个例子:一个手臂在画面中看起来很短,是因为手臂本身很短?还是因为手臂伸向了镜头产生了透视缩短?

AI只能通过大量训练数据去“猜”。这种猜测往往会导致四肢比例忽长忽短,或者动作在Z轴(深度方向)上表现平平,缺乏立体感。

3.3.2 无法消除的高频抖动

由于AI是逐帧(Frame-by-Frame)估算关键点位置的,且每一帧的像素噪点、光照变化都会影响估算结果,导致生成的骨骼在微观层面上处于不断的“震颤”中。虽然可以通过平滑算法(如Butterworth滤波器)来处理,但这往往会牺牲动作的细节和锐度,导致动作看起来“肉肉的”或有延迟。

3.3.3 脚滑

这是AI动捕最显著的特征。由于AI难以像压力传感器那样精确感知脚底何时与地面接触,它生成的动画往往是“浮”在地面上的。当角色迈步时,支撑脚本应牢牢钉在地面,但在AI数据中,支撑脚往往会随着身体的移动而产生微小的滑动。这种“滑冰”效果是打破沉浸感的头号杀手。

3.4 解决方案:多视角几何与物理约束

为了解决上述问题,行业正在向多视角方案演进。

Move AI之所以被推崇,是因为它强制要求使用至少2台(推荐4台)iPhone。通过多视角的几何三角测量,它不再需要AI去“猜”深度,而是像人眼一样有了立体视觉,从根本上解决了单目深度歧义问题。

此外,未来的AI模型正在引入物理引擎约束。不仅仅是生成视觉上合理的动作,还要生成物理上合理的动作(例如,重心必须在支撑面内,否则角色会摔倒)。这种结合了物理仿真(Physics Simulation)的生成式AI,是突破当前技术天花板的关键。

第四章:游戏行业的应用真相——从独立游戏到《黑神话:悟空》

游戏行业是动捕技术最大的试验场,但不同量级的项目对技术的选择截然不同。

4.1 3A大作的坚持:以《黑神话:悟空》为例

《黑神话:悟空》作为中国首款现象级3A动作游戏,其流畅且充满韵味的战斗动作是其核心竞争力之一。

4.1.1 为什么必须是光学动捕?

游戏科学团队在制作过程中,大量使用了Vicon光学动捕系统。

- 动作复杂度:游戏主角“天命人”以及各路妖王的动作设计,融合了中国传统武术、戏曲身法。例如,主角使用的棍法(劈棍、立棍、戳棍)涉及极高频率的舞动和精微的重心切换。

- 高频采样需求:AI动捕通常受限于摄像头帧率(30fps或60fps),而光学动捕可以轻松达到120fps甚至更高。对于高速挥舞的金箍棒,低帧率会导致严重的运动模糊和轨迹断裂,只有光学系统能精准捕捉到武器的末端轨迹。

- 演员的表现力:动捕演员殷凯在采访中提到,他需要表演极其细腻的“猴性”动作——抓耳挠腮的微动作、蹲踞时的肌肉紧张感。这些微小的细节是AI目前的算法会当作“噪点”抹除掉的,但正是这些细节构成了角色的灵魂。

4.1.2 空间计算与虚拟资产的融合

除了动作,游戏科学还利用空间计算(Spatial Computing)技术对大量现实中的古建筑(如山西玉皇庙)进行3D扫描。高精度的场景模型要求同样高精度的角色动作与之匹配。如果角色动作有滑步或穿模,由于场景极其逼真,这种违和感会被无限放大。

结论:在追求极致体验的3A领域,AI动捕目前只能用于预演或次要NPC,核心战斗动作依然是光学动捕的天下。

4.2 独立游戏的福音:AI动捕的降维打击

对于独立开发者而言,AI动捕是“雪中送炭”。

成本逻辑:独立游戏通常没有预算雇佣专业武打演员或租赁Vicon影棚。Move AI或Rokoko Vision提供的方案,让他们可以在自家客厅里,用几百块钱的成本获得“80分”的动作数据。

案例:像《Sifu》(师父)这样的动作游戏,虽然最终成品极其精良,但在开发早期和部分过场动画中,利用低成本动捕进行快速迭代是行业常态。AI动捕让独立开发者敢于尝试复杂的叙事表演,而不必局限于简单的站桩对话。

4.3 隐藏的成本:数据清洗

无论是3A还是独立游戏,动捕数据都不能直接用。

“动捕只是开始,清洗才是地狱。”

这是我在使用Xsens时最深刻的体会,也是AI动捕目前的痛点。AI生成的原始数据通常包含大量噪声。

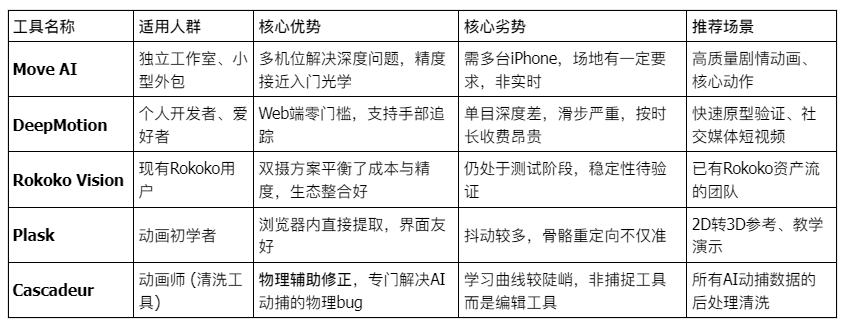

技术美术(Tech Animator)的崛起:行业内出现了一个巨大的需求缺口,即懂得如何快速“清洗”AI数据的人。使用Blender的NLA(非线性动画)编辑器、Maya的重定向工具,或者MotionBuilder来修复脚滑、平滑抖动、修正骨骼扭曲,成为了一项核心技能。

产品机会:Cascadeur这款软件之所以火爆,就是因为它通过AI辅助物理修正,专门解决动捕数据的“清洗”难题,让动作符合物理规律。这给产品经理的启示是:不要只盯着“捕捉”工具,服务于“后处理”的工具同样是蓝海。

第五章:用户体验心理学——虚拟人交互与恐怖谷

产品经理在设计虚拟人或NPC交互时,必须面对一个心理学门槛:恐怖谷效应。

5.1 动态恐怖谷:当动作背叛了外表

传统的恐怖谷理论主要关注静态外貌(如僵硬的塑胶皮肤)。但研究表明,动作的不协调比外貌的不完美更容易触发恐怖谷效应。

感知失调:当一个建模极其逼真(Metahuman级别)的虚拟人,做出了机械、抖动或无视物理规律(如滑步)的AI生成动作时,用户的潜意识会立刻报警:“这不是人,这是尸体或病人。”这种认知失调会带来强烈的厌恶感。

“僵尸效应”:AI动捕生成的数据如果缺乏微动作(Micro-movements,如呼吸带来的胸腔起伏、重心的轻微摇摆),角色看起来就会像死了一样僵硬。反之,如果噪点过多,角色看起来就像患了帕金森症。

5.2 用户对下一代NPC的期待

随着大语言模型的接入,用户对NPC的期待已经从“预设脚本”变成了“真实反应”。

低延迟的情感同步:用户骂NPC一句,NPC需要立刻表现出愤怒。如果LLM生成文本很快,但驱动身体动作的AI需要2秒钟生成,这种延迟会瞬间破坏沉浸感。未来的产品必须追求Audio-to-Motion的实时低延迟生成。

多模态一致性:语气必须与肢体语言匹配。如果NPC用愤怒的语气说话,但身体动作是通用的“闲置”状态,用户会感到极度违和。AI动捕需要进化到能理解语意情感,自动匹配手势。

第六章:未来展望——基于技术边界的推演

6.1 从“捕捉”到“生成”:Generative Motion

动捕行业的终极杀手可能不是更好的摄像头,而是生成式AI。

就像Midjourney取代了部分摄影素材一样,Text-to-Motion(文本生成动作)技术正在崛起。模型如MotionGPT、T3M允许用户输入“一个沮丧的人在雨中艰难行走”,直接生成骨骼动画,完全绕过物理捕捉环节。

预测:未来3-5年,通用动作(走、跑、跳、基础交互)将主要由AIGC生成;而动捕技术将退守到“特型表演”领域——即那些包含强烈个人风格、情感爆发或极高难度的动作表演。

6.2 物理感知的回归

目前的AI动捕大多是“运动学”的,只管位置不管力。未来的AI将是“动力学”的。通过强化学习,AI将学会“模拟”重力、摩擦力和肌肉力量,从而自动修正那些不符合物理规律的滑步和穿模,让AI动捕的数据无需清洗即可直接使用。

结语

AI动捕行业正处于一个充满了噪音与希望的青春期。一方面,资本的喧嚣和Demo的惊艳让人觉得“人人都是动画师”的时代已来;另一方面,实际生产中的脚滑、抖动和恐怖谷效应又时刻提醒我们物理世界的复杂性。

对于产品经理而言,这是一个最好的时代。技术门槛的降低意味着我们可以将动捕技术带入医疗、体育、社交等前所未有的领域。但我们要保持清醒:技术是手段,体验才是目的。无论算法如何迭代,能够打动人心的,始终是那些注入了人类情感与灵魂的动作——正如《黑神话:悟空》中那只猴子,每一个抓耳挠腮背后,都是对真实的极致敬畏。

附录:核心参考数据表

表 A-1:2025年主流AI视频动捕工具横向评测

本文由 @DaisyXX 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益