OpenClaw生态全景:一篇文章告诉你QClaw、AutoClaw、EasyClaw、MaxClaw如何选择

2026年科技圈最魔幻的词汇不是‘大模型’,而是‘养龙虾’——这个源于GitHub爆火项目OpenClaw的黑话,正在重塑AI行业的竞争格局。从‘对话式AI’到‘执行式AI’,OpenClaw让AI从‘会说’变成了‘会做’,掀起了一场关于‘数字劳动力’所有权的新战争。本文深度解析OpenClaw的范式转移、爆发逻辑、巨头布局与未来挑战,带你透视AI生产力时代的新范式。

2026年的春天,科技圈最魔幻的词汇不再是“大模型”,也不是“多模态”,而是一个听起来有些荒诞的词——“养龙虾”。

如果你在周末刷过GitHub趋势榜,或者混迹于任何技术社群,大概率会看到这样的帖子:

“我的‘龙虾’今天帮我自动整理了上个季度的财务财报,还顺手把PPT发到了老板邮箱。”

“刚给家里的‘龙虾’喂了新数据,它现在写代码的风格比我还要像我自己。”

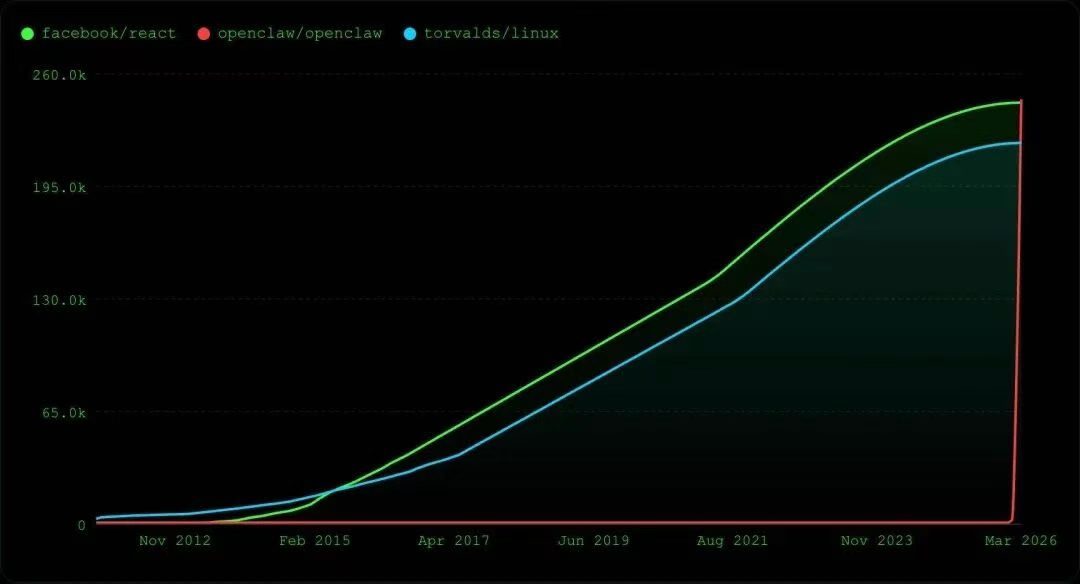

这里的“龙虾”,指的正是那个在短短两个月内,星标数突破24.8万、超越Linux成为GitHub历史第一的开源项目——OpenClaw。

(图中像坐标轴的曲线)

这不仅仅是一个程序的爆火。OpenClaw的走红标志着AI行业的一个临界点:我们终于跨过了“对话式AI“的兴奋期,进入了“执行式AI”的深水区。

你不再需要坐在电脑前操作软件,而是开始指挥一个AI替你操作电脑。

短短数月,围绕OpenClaw的“爪系生态”野蛮生长:QClaw、AutoClaw、EasyClaw、MaxClaw……大厂与初创公司纷纷入局。这场关于“谁拥有你的数字劳动力”的战争,已经悄然打响。

一、范式转移:从“问AI”到“让AI干活”

过去三年,大模型(LLM)的主旋律是“回答问题”。无论是ChatGPT还是国内的各类大模型,它们更像是博学但手无缚鸡之力的“顾问”。

而OpenClaw试图做的,是将AI从“聊天对象”重塑为“数字员工”。

本质上,OpenClaw是一套本地优先的AI代理系统(Local-First AI Agent)。它的核心逻辑发生了根本性逆转:

- 过去:人类是操作者,软件是工具,AI是外挂。

- 现在:人类是管理者,AI是员工,软件是AI的工具箱。

只需一句自然语言指令:

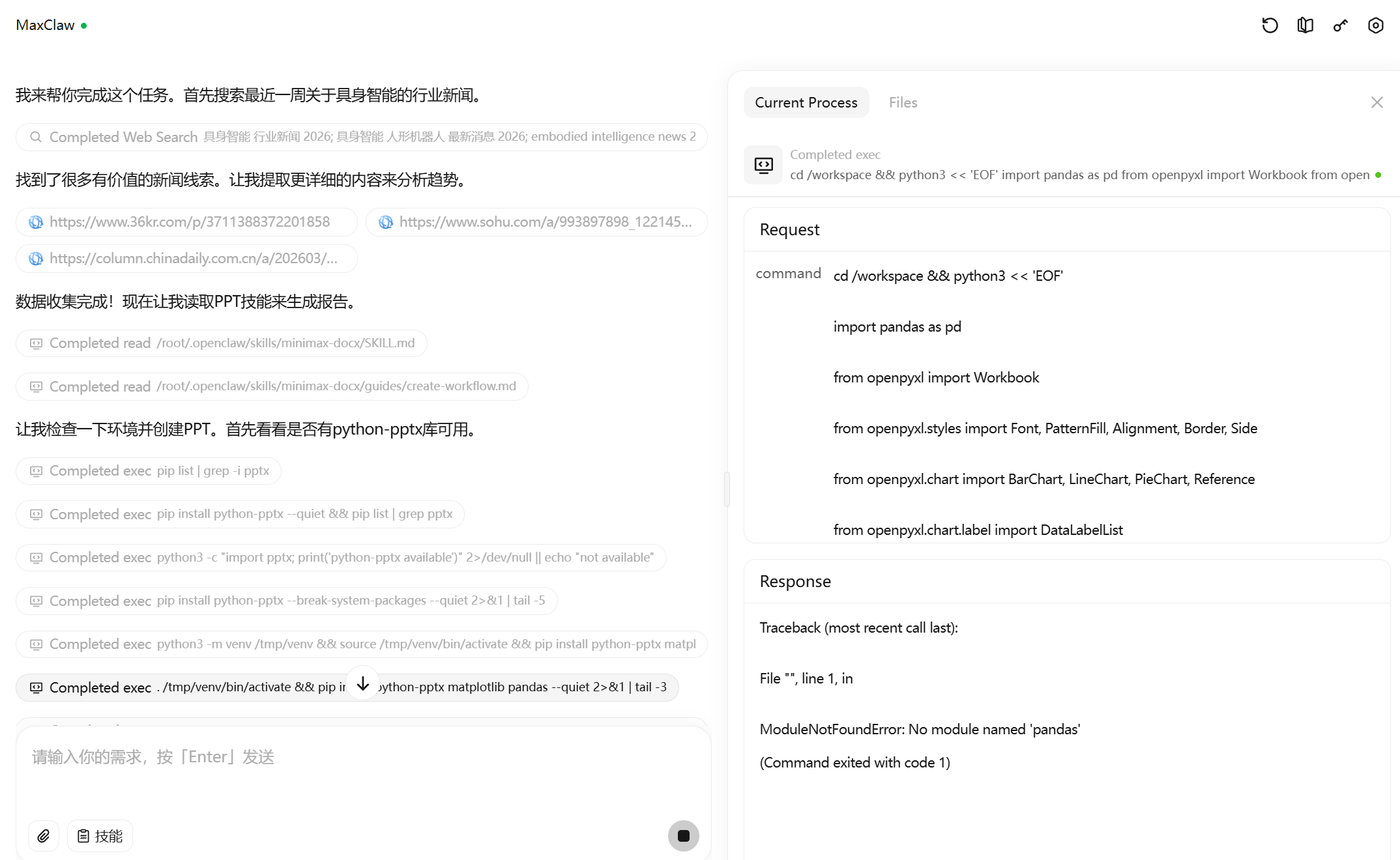

“帮我抓取最近一周关于‘具身智能’的行业新闻,清洗数据,分析趋势,并生成一份包含图表的PPT。”

OpenClaw的后台会在毫秒级内完成拆解:

- 感知:唤醒浏览器,模拟人类行为搜索新闻源。

- 规划:调用Python脚本清洗数据,利用推理模型提炼观点。

- 执行:自动打开PPT工具,排版、绘图、写入文案。

- 交付:将成品文件发送至指定文件夹,并通知用户。

全程无需人工干预鼠标和键盘。正如一位早期使用者所言:“OpenClaw让AI从‘会说’变成了‘会做’。这是AI从玩具到生产力的分水岭。”

二、爆发逻辑:为什么是OpenClaw?

OpenClaw的爆发并非偶然,它精准地击中了企业级应用和个人极客长期未被满足的三个痛点。

Local First:隐私是最后的底线

在SaaS盛行的年代,绝大多数AI能力都运行在云端。但对于金融、法律、医疗以及核心研发部门而言,数据不出域是红线。

OpenClaw高举“Local First(本地优先)”的大旗。所有数据解析、任务规划、文件操作均在本地环境(甚至离线环境)完成。

- 财务数据不用上传云端;

- 核心代码库无需暴露给第三方API;

- 用户隐私完全掌握在自己手中。

这使得OpenClaw成为第一个真正能大规模进入企业内网环境的通用AI Agent。

架构进化:从“输入-输出”到“感知-行动”

传统大模型的链路是线性的:Input -> Text Output。 OpenClaw构建了一个闭环的行动架构,社区将其概括为“听、想、做、记”四层能力:

- 听(Perception):多渠道接入(邮件、IM、文件系统),实时感知环境变化。

- 想(Reasoning):基于大模型的任务拆解与逻辑推理。

- 做(Action):通过标准化的技能接口(Skill System)调用操作系统API、浏览器、IDE等工具。

- 记(Memory):具备长期记忆向量库,能记住用户的使用习惯和历史上下文。

这种架构赋予了AI真正的“执行力”*,让它不再是一个只会吐字的文本生成器。

“养龙虾”文化:AI是可以进化的

在OpenClaw社区,“养龙虾”已成为一种黑话。

这意味着用户不是在“使用”一个软件,而是在“训练”一个助理。随着时间推移,用户不断给它喂送专属文档、优化Prompt、微调技能插件。

- 第一天,它只是个通用的助手;

- 第三十天,它懂你的行文风格,熟悉你的业务流,甚至知道你在周五下午不喜欢被打扰。

它不是一次性工具,而是一个伴随用户成长的长期系统。这种“养成感”极大地提高了用户的迁移成本和粘性。

三、巨头进场:一场关于“入口”的围猎

OpenClaw的开源火爆,迅速引来了巨头的嗅觉。目前,市场上已形成了多个OpenClaw衍生产品,本质都是“OpenClaw的产品化与商业化”。

腾讯 QClaw:让AI长在社交链上

腾讯的策略极其务实:把AI Agent塞进微信和QQ。 用户无需安装额外软件,直接在聊天窗口即可下达指令:“把刚才群里的文件整理成会议纪要发给老板。”QClaw利用腾讯庞大的生态连接能力,试图让AI成为新的社交基础设施。

智谱 AutoClaw:降低门槛的“一键式”革命

针对OpenClaw配置复杂的痛点,智谱推出了AutoClaw。主打**“一键安装、开箱即用”**,内置了经过优化的垂直模型和预置技能库。它的目标很明确:让不懂代码的普通白领也能拥有自己的AI员工。

MiniMax MaxClaw:云端的效率妥协

MiniMax选择了另一条路:云端托管版OpenClaw。 用户无需购买昂贵的显卡,无需配置Docker环境,10秒即可开通服务。虽然牺牲了部分本地隐私性,但换来了极致的便捷性和强大的云端算力,非常适合内容团队和运营部门快速落地。

猎豹 EasyClaw:老牌工具王的“降维打击”

猎豹移动的打法非常直接且犀利:用做“清理大师”的思路,把AI Agent变成“一键安装”的国民级工具。

依托创始人傅盛亲自“养龙虾”(代号“三万”)的成功实验,EasyClaw将原本极客专属的复杂部署,简化成了普通白领也能上手的标准化产品。

四、冷思考:狂欢背后的现实引力

尽管资本热捧、社区狂热,但作为观察者,我们必须看到OpenClaw及其衍生生态面临的“不可能三角”。

成本悖论:智慧很贵

很多人误以为AI Agent等于自动化省钱。现实恰恰相反。 要实现复杂的任务规划和高准确率的执行,往往需要调用高性能的大模型。据实测,一个完整的“研报生成”流程可能消耗上万Token。 对于高频使用的企业用户,每月的Token账单可能高达数千甚至数万元。“智慧”与“成本”在当下依然难以兼得。

安全与权限的走钢丝

为了让AI“干活”,必须赋予它极高的系统权限。

虽然OpenClaw引入了Docker沙箱、操作审计和二次确认机制,但**“AI误操作”**的风险依然存在。

- 删错了核心数据库怎么办?

- 被恶意Prompt注入导致泄露隐私怎么办? 配置一套既安全又高效的权限体系,对普通用户来说门槛极高,这也是目前劝退新手的主要原因。

本地模型的“智力天花板”

Local First的理念虽好,但受限于本地硬件(尤其是显存),本地运行的模型在推理能力上往往弱于云端千亿参数模型。

这就导致了一个尴尬的现状:为了安全用本地模型,为了聪明用云端模型。大多数用户最终不得不选择“本地系统+云端推理”的混合架构,这在一定程度上消解了纯本地的隐私优势。

五、终局展望:人机关系的重构

尽管瑕疵尚存,但OpenClaw的出现,其象征意义远超产品本身。

它预示着人与电脑交互关系的历史性反转。

- 过去40年:人类在适应机器。我们要学习Windows的操作逻辑,要记忆复杂的快捷键,要理解软件的菜单层级。

- 未来10年:机器在适应人类。电脑将变成一个黑盒,你只需要用自然语言告诉它“做什么”,至于“怎么做”,是AI需要考虑的事。

2025年,大模型解决了“会不会”的问题;2026年,AI Agent正在解决“能不能干活”的问题。

如果这个趋势成立,未来的软件形态将被彻底重写:

- 每个人都将拥有一个专属的AI代理(Agent);

- 每家公司的组织架构中,将出现AI员工的编制;

- 我们不再说“我在用Excel”或“我在用PS”,而是说“我在管理我的AI团队”。

OpenClaw只是这场革命的序章。当“养龙虾”成为职场人的标配,真正的AI生产力时代,才算正式来临。

本文由 @Ethan_AIPM 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Pixabay,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益