大模型幻觉问题,产品经理该怎么兜底?🤔

AI幻觉问题正成为产品经理的噩梦——当大模型自信满满地给出错误答案,买单的却是产品团队。本文深度拆解4套实战方案,从预期管理到信息溯源,从交互重塑到客诉闭环,教你用产品思维而非算法优化,巧妙化解90%的幻觉危机。这些在ChatGPT、GitHub Copilot等明星产品中验证过的设计策略,将重新定义AI时代的人机信任关系。

作为AI产品经理,一定经历过这样的“至暗时刻”:

业务方气势汹汹地甩来一张截图,质问:“你们的AI客服给客户承诺了全额退款,但我们根本没这个政策,这客诉算谁的?”

或者开发摊着手告诉你:“目前的模型能力就是这样,幻觉率已经压到最低了,剩下的用算法解决不了。”

面对大模型与生俱来的“幻觉”,算法工程师可以追求技术指标的极致,但产品经理必须直面用户的怒火。

我们要认清一个残酷的现实:在当前的技术框架下,幻觉是特性的副产品,而非单纯的Bug。它源于大模型概率预测的本质。因此,与其死磕算法试图消灭最后1%的幻觉,不如通过产品机制与交互设计来做好兜底。

以下,我将结合真实的行业案例,拆解几套经过验证的产品设计方案。这些方案不涉及高深的算法改造,纯靠产品逻辑,能帮你解决90%因幻觉引发的客诉问题。

一、预期管理:别让用户以为AI是“全知全能的神”

很多产品在包装AI功能时,喜欢使用“智能专家”、“完美解答”这类极度拔高预期的词汇。期望越高,一旦AI出现幻觉,用户的愤怒值就越高。产品兜底的第一步,是在UI和UX层面做好“丑话前置”。

1. 强制性的免责声明与置信度展示

不要把AI的输出伪装成绝对真理。你需要通过视觉设计明确告诉用户:这是AI生成的参考,你需要自己做最后把关。

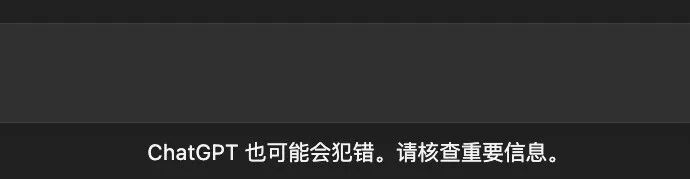

真实案例:ChatGPT 与 Google AI Overviews

每次打开ChatGPT,输入框下方都有一行非常醒目的灰色小字:“ChatGPT也能会犯错,请核实重要信息”。

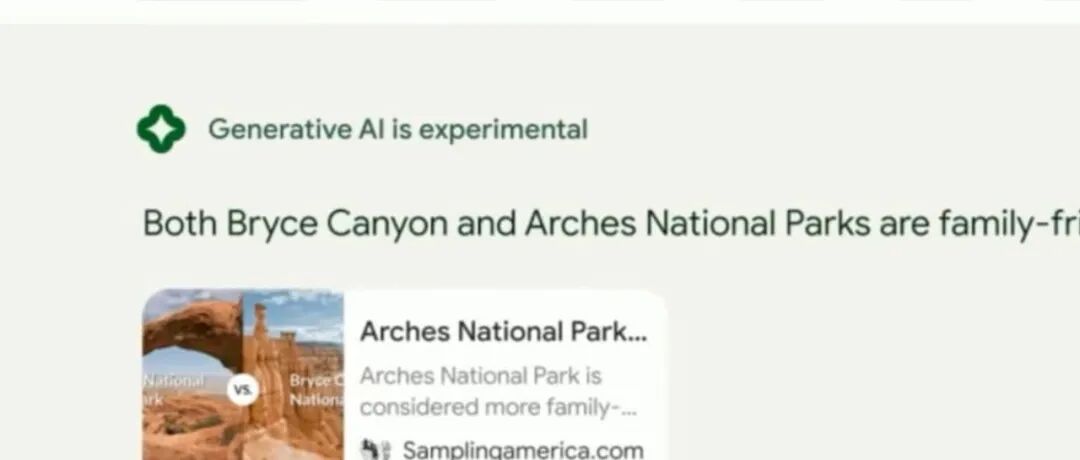

Google在推出搜索生成体验AI Overviews时,其UI设计中大量使用了动态变化的颜色和明显的“Generative AI is experimental”标签,从视觉上将其与传统的精确搜索结果区分开来。

PM实操指南:

弱化绝对语气:在Prompt系统提示词中,要求AI多使用“可能”、“通常情况下”、“根据已有信息”等词汇。

状态强提示:在生成过程中和生成后,UI上必须保留AI标识(如闪烁的星星图标、AI Watermark)。

2. 限制输入敞口,把“填空题”变成“选择题”

幻觉往往发生在用户输入了极其模糊、边界不清的Prompt时。AI为了迎合用户,只能强行编造。

PM实操指南:

不要上来就给一个空荡荡的输入框。通过快捷指令、预设Tag、下拉菜单,引导用户在限定的框架内提问。

例如:在构建一个内部的数据查询Agent时,不要让用户直接问“公司最近怎么样”,而是提供快捷面板:“查询本月华东区销售额”、“对比Q1和Q2的转化率”。

收敛了输入,就极大收敛了AI发散和产生幻觉的概率。

二、交互重塑:从“交钥匙工程”到“人机协同”

这是解决幻觉问题最核心的产品策略。

传统软件是“我下指令,你出最终结果”。但在AI时代,产品设计必须转向“AI起草,人类审批”。我们不为AI的最终正确性打包票,我们只提供一个可编辑的“草稿”。

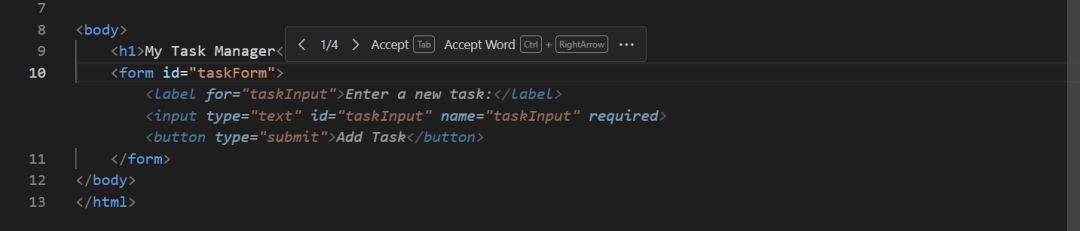

1. 幽灵文本与“Tab键”哲学

对于代码生成或文案续写类产品,最怕AI自作主张改乱了用户原本的内容。

真实案例:GitHub Copilot

GitHub Copilot的厉害之处不仅在于背后的Codex模型,更在于其的交互设计——幽灵文本(Ghost Text)。AI生成的代码以浅灰色的形式悬浮在编辑器中,它不会破坏现有代码。只有当用户明确按下Tab键(或者点击Accept)时,代码才会被真正写入。

如果AI产生了幻觉(比如调用了一个不存在的库),用户只需继续打字,那段灰色提示就会自动消失,没有任何试错成本。

PM 实操指南:

绝不直接覆写:在设计文本编辑、图片修改等场景时,AI的生成结果必须停留在“预览层”或“侧边栏”。

提供原子化操作:不要只给“接受全部”的选项。提供“采纳此段落”、“重新生成”、“复制”等颗粒度更细的操作项,让用户成为把控质量的最后一道防线。

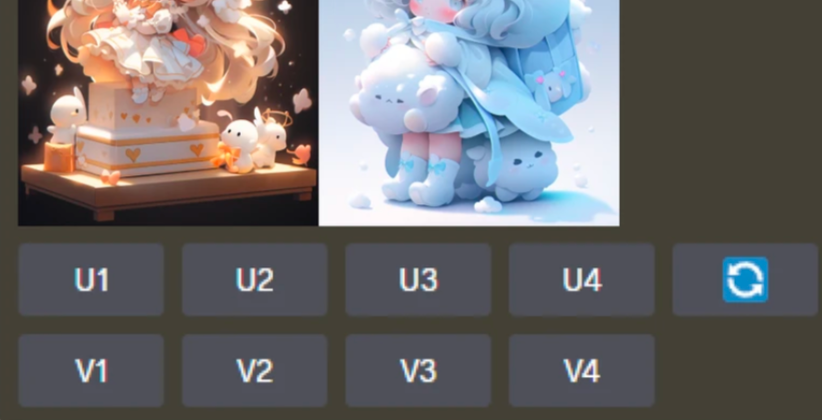

2. 增量生成与多重方案选择 (Option A/B/C)

当AI面对一个具有发散性的任务时,产生单一确定性答案的幻觉风险极高。让AI同时提供多个维度的选项,把选择权交还给用户。

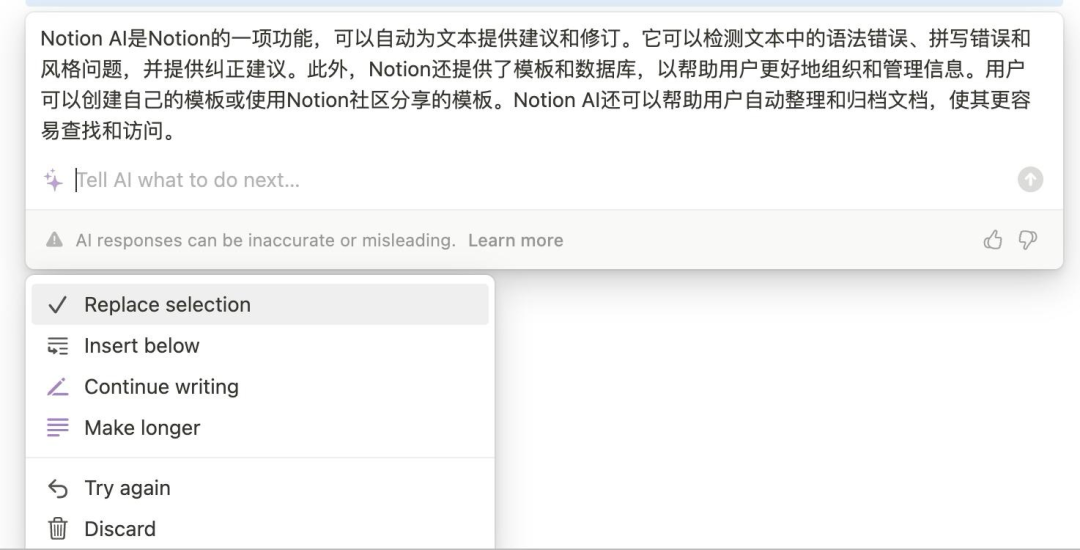

真实案例:Midjourney 与 Notion AI

Midjourney每次生成图片,默认出四张图(U1-U4, V1-V4)。它承认自己无法一次精准猜中用户的偏好,所以提供变体,让用户挑选并微调。

Notion AI在生成长文案后,底部的悬浮菜单提供的是:“Replace selection(替换选区)”、“Insert below(在下方插入)”、“Continue writing(继续写)”和“Make longer/shorter(调长/调短)”。它完全是在打辅助,而不是做主导。

三、信息溯源:让每一次“断言”都有迹可循 (RAG产品的灵魂)

在知识问答、企业知识库、客服机器人场景中,用户不仅需要答案,还需要“信任”。消除幻觉带来的负面影响,最好的办法是提供证据。这就是目前主流的 RAG(检索增强生成)技术在产品端的外化表现。

1.强制引用与锚点跳转

模型自己生成的知识可能过期或捏造,但如果我们把企业自己的知识库(PDF、Word、SOP文档)喂给AI,让它“开卷考试”,并在回答中附带原文链接,就能彻底打破黑盒。

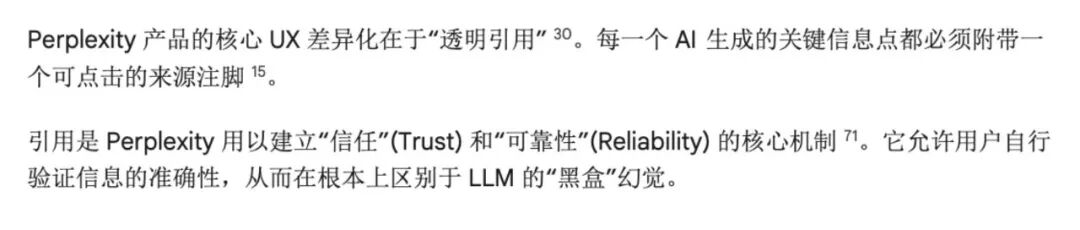

真实案例:Perplexity AI

Perplexity的爆火证明了“带引用的AI”才是搜索的未来。它的每一个核心观点后都会附带一个小数字 [1] [2],点击即可展开看到引用的具体网页来源。如果用户怀疑AI胡说八道,点开来源一看便知。

PM实操指南:

业务逻辑硬约束:在PRD中明确要求,对于事实类问题,AI的回答必须依赖于检索到的上下文。

兜底话术设计:设定阈值,当检索系统找不到相关信息,或者大模型对答案的置信度低于特定值时,强制触发兜底话术:“在现有的知识库/业务文档中,我未找到关于该问题的明确规定,请咨询人工客服。” ——承认“我不知道”,比“胡编乱造”的体验好一百倍。

2.过程可视化

有时候,让用户看到AI的“思考过程”,能极大增加包容度,并帮助用户自行判断结果的可靠性。

PM实操指南:

在加载状态(Loading)中,不要只转菊花。显示当前的动作:

[✓] 正在检索产品手册 v2.0…

[✓] 正在提取退换货相关条款…

[ ] 正在总结归纳…

这种类似Agent执行工作流的透明化展示,不仅缓解了等待焦虑,也暗示了结果的来源,降低了因直接抛出错误结论而引发的投诉。

四、客诉闭环:建立基于负反馈的“自我进化”飞轮

无论前置的兜底做得多好,幻觉依然会发生。产品经理的终极考验,在于当用户遇到幻觉并产生不满时,你提供了怎样的情绪出口和解决链路。

1.结构化的点踩机制

很多AI产品都有点赞/点踩按钮,但多数只是为了收集数据给算法跑评价指标,对当下的用户毫无帮助。

PM实操指南:

当用户点击“踩()”时,不要只是默默记录。立即弹出一个极其轻量的分类标签(不要超过4个):

[内容不实/捏造] [答非所问] [过时信息] [其他]

关键动作:一旦用户选择了[内容不实/捏造](即遭遇了严重幻觉),系统应当立即触发补偿机制。例如在客服场景,立刻显示:“抱歉给您带来困扰,已为您无缝转接高级人工客服,您的历史对话已同步。”

2.建立“高危词/敏感操作”的熔断机制

对于会产生实际业务资损的场景(如金融理财建议、电商退款、顺风车/出行规则承诺),绝不能完全放权给大模型。

PM 实操指南:

构建规则防火墙:在大模型输出给用户之前,加一层传统的规则拦截引擎。

例如,在你的大模型Prompt提示词以及输出校验层,建立一个包含“承诺全额退款”、“赔偿”、“绝对保本”、“免费”等词汇的敏感词库。

一旦模型的草稿中触发这些词汇,系统直接熔断,用硬编码的标准SOP话术替换,或者直接转人工。用经典的规则逻辑,给不可控的AI上了最后一道锁。

最后

在AI从“玩具”走向“生产力工具”的今天,产品经理的角色正在发生微妙的转变。我们不再仅仅是功能的设计者,更是AI与人类信任关系的构建者。

解决大模型幻觉,算法团队负责的是“提升上限”(让模型更聪明),而产品经理负责的是“守住下限”(让产品不出安全事故)。

通过降低预期、重构人机协同的工作流、强制信息溯源以及建立完善的熔断和反馈闭环,我们可以优雅地接住大模型偶尔的“胡言乱语”,将一次潜在的投诉危机,转化为一次体验AI边界、建立系统信任的契机。记住最好的产品设计,就是让技术的缺陷在流程的流转中消弭于无形。

希望对你有所帮助~

本文由 @虫虫 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益