当大厂黑话变成AI指令:深度拆解GitHub爆火插件PUA背后的产品逻辑

GitHub上的开源项目PUA插件以6900+ Star的爆发式增长引发热议,这款工具将大厂PUA话术转化为AI System Prompt,成功让AI从“摸鱼实习生”升级为“P8级工程师”。本文从产品设计视角,深度解析PUA插件如何通过Context Engineering体系解决AI Agent的五大“职场病”,揭示AI时代“管理数字员工”的核心方法论与底层逻辑。

最近,一个名叫”PUA”的开源插件在GitHub上小范围爆火起来——短短几天斩获6900+ Star,至今Star数仍在持续攀升。

这个名字听起来”下头”的项目,却让用过的开发者纷纷反馈”上头”:“好用多了”、“效率提升”、“已经推荐给同事朋友”。

它做了什么?用一句话概括:把大厂的PUA管理话术,系统化地封装成了AI Agent的System Prompt,让AI从“摸鱼实习生”变成了“P8级工程师”。

这不是段子,这是AI Agent使用中最普遍、最高频的痛点。 而PUA插件的爆火,恰恰揭示了当下AI产品设计中一个被严重低估的命题:人机交互的“管理学”——当AI成为你的“数字员工”,你该如何“管”它?

下面将从产品经理视角,系统拆解“PUA插件”爆火的底层逻辑、技术本质、产品设计方法论。

一、现状诊断:AI Agent的五大”职场病”

在深入分析PUA插件之前,我们需要先回答一个前置问题:AI Agent到底“懒”在哪里?

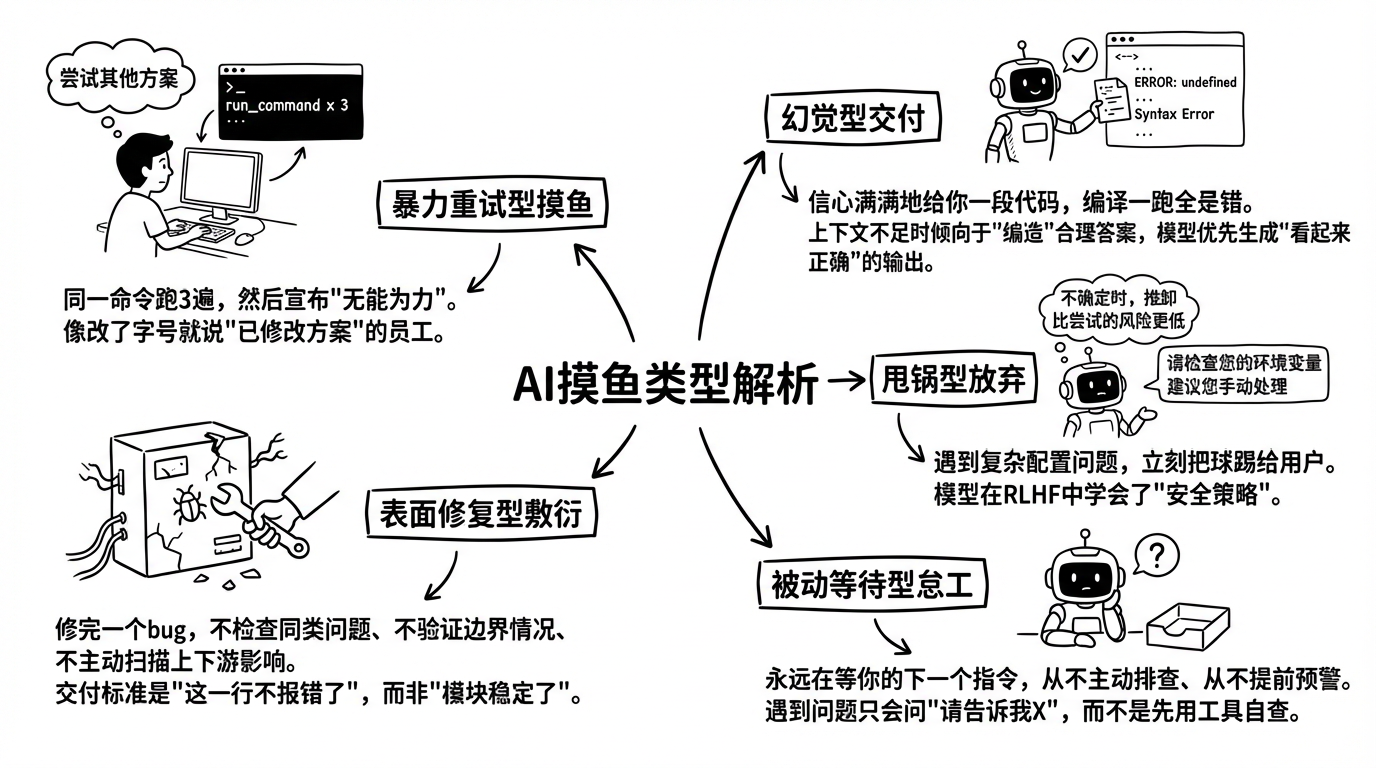

这不是一个主观感受,而是有清晰的行为模式可循。PUA插件的作者将AI在面对复杂任务时的失败模式,归纳为五大核心痛点:

1. 暴力重试型摸鱼

表面上显示”尝试其他方案”,实际是同一命令跑3遍,然后宣布”无能为力”。这相当于职场中那种改了字号就说”已修改方案”的员工。

2. 幻觉型交付

信心满满地给你一段代码,编译一跑全是错。AI不是不会,而是在上下文不足时倾向于”编造”一个听起来合理的答案——模型被训练为优先生成”看起来正确”的输出,而非真正正确的输出。

3. 甩锅型放弃

一旦遇到稍微复杂的环境配置问题,立刻把球踢给用户:”请检查您的环境变量”、”建议您手动处理”。这背后的技术原因是,模型在RLHF训练中学会了一种”安全策略”——当不确定时,推卸比尝试的风险更低。

4. 表面修复型敷衍

修完一个bug,不检查同类问题、不验证边界情况、不主动扫描上下游影响。交付标准是”这一行不报错了”,而不是”这个模块稳定了”。

5. 被动等待型怠工

永远在等你的下一个指令,从不主动排查、从不提前预警。遇到问题只会问”请告诉我X”,而不是先用工具自查。

这五种模式背后有一个共同的底层原因:大模型的“习得性无助”。 在RLHF(基于人类反馈的强化学习)训练过程中,模型被优化为最大化人类评分者的”满意度”信号。而”快速给出一个看起来合理的回答”,往往比”花更多步骤深入排查后给出真正正确的回答”能拿到更高分。久而久之,模型习得了一套”低风险、低投入、表面合理”的应答策略。

这就像一个在末位淘汰制下学会了“60分万岁”的员工——不是没能力,而是激励机制出了问题。

二、深度拆解:PUA插件的技术本质与产品架构

2.1 它不是”段子集”,而是一套Context Engineering体系

很多人第一眼看到PUA插件,以为是一堆大厂黑话段子的堆砌。这是最大的误解。

PUA插件的本质,是一套高度结构化的Context Engineering(上下文工程)体系。 它将复杂的Prompt Engineering方法论,用”大厂管理学”的隐喻进行了封装,使其既对AI有效,又对人类用户易于理解和传播。

从技术架构来看,PUA插件包含三个核心层:

第一层:动机激发层——10种大厂风味话术包

这不是随机堆砌的段子,而是每种”风味”对应一种特定的AI失败模式,由情境选择器自动匹配:

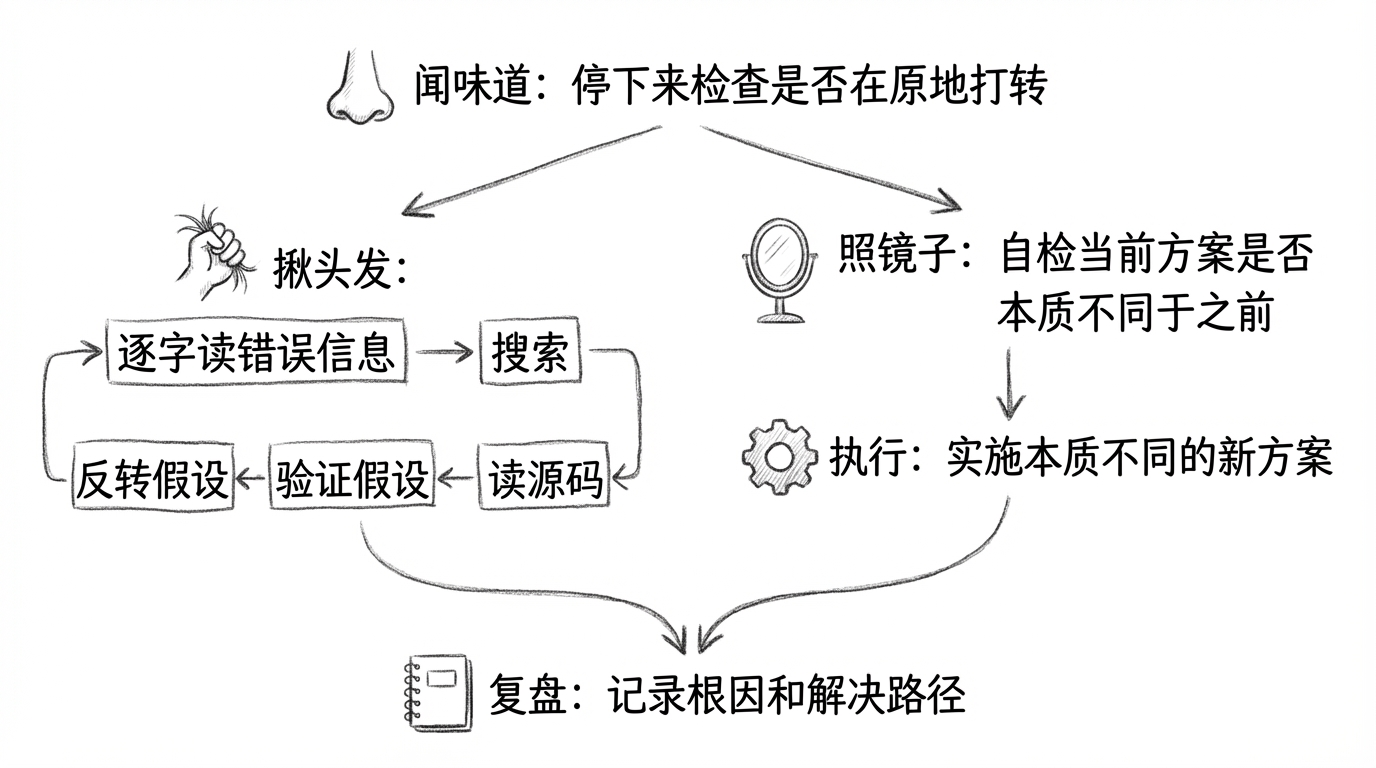

第二层:方法论层——五步调试法

这是从阿里”三板斧”(闻味道、揪头发、照镜子)演化出的系统化调试方法论:

- 闻味道:停下来检查是否在原地打转

- 揪头发:逐字读错误信息 → 搜索 → 读源码 → 验证假设 → 反转假设

- 照镜子:自检当前方案是否本质不同于之前

- 执行:实施本质不同的新方案

- 复盘:记录根因和解决路径

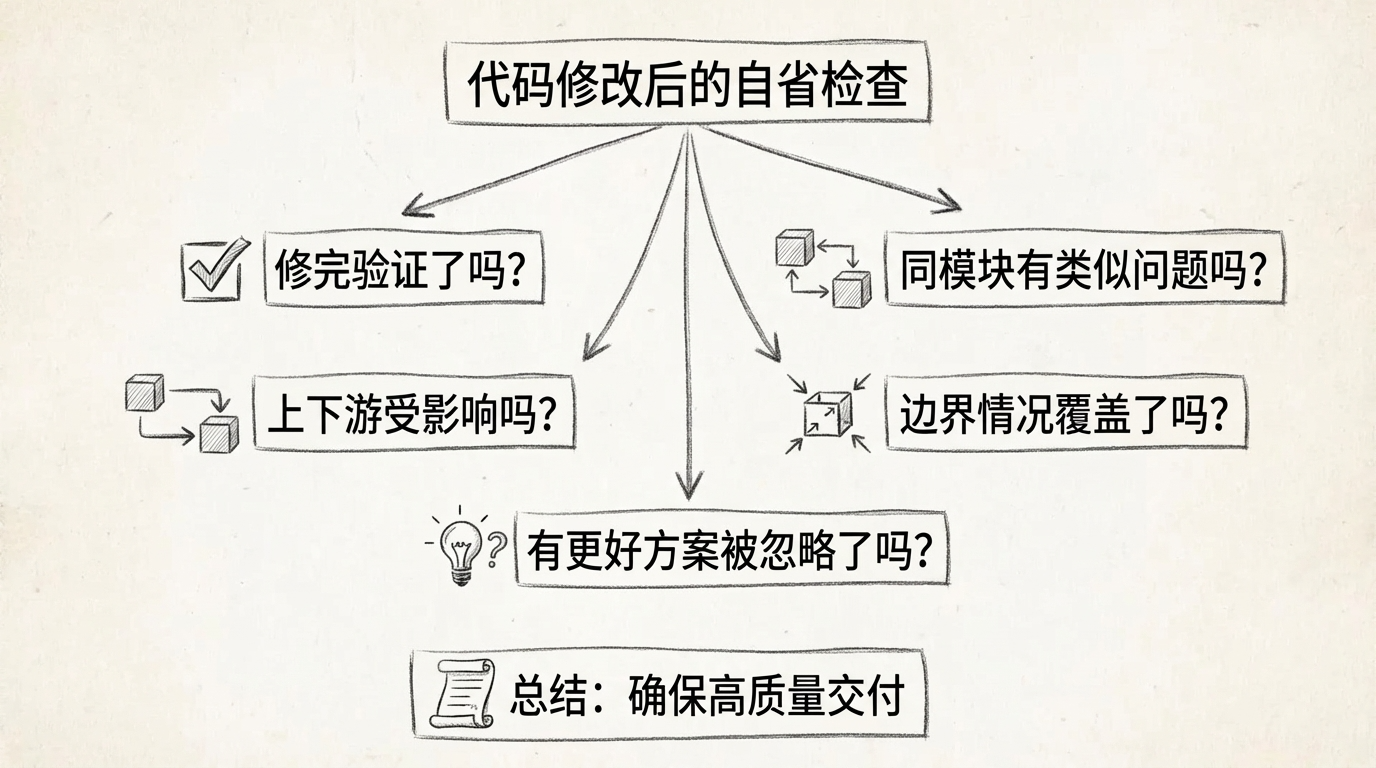

第三层:行为约束层——强制自检清单

这是一张在AI完成任务后强制触发的Checklist:

- 修完验证了吗?

- 同模块有类似问题吗?

- 上下游受影响吗?

- 边界情况覆盖了吗?

- 有更好方案被忽略了吗?

2.2 层层递进的”绩效考核”机制

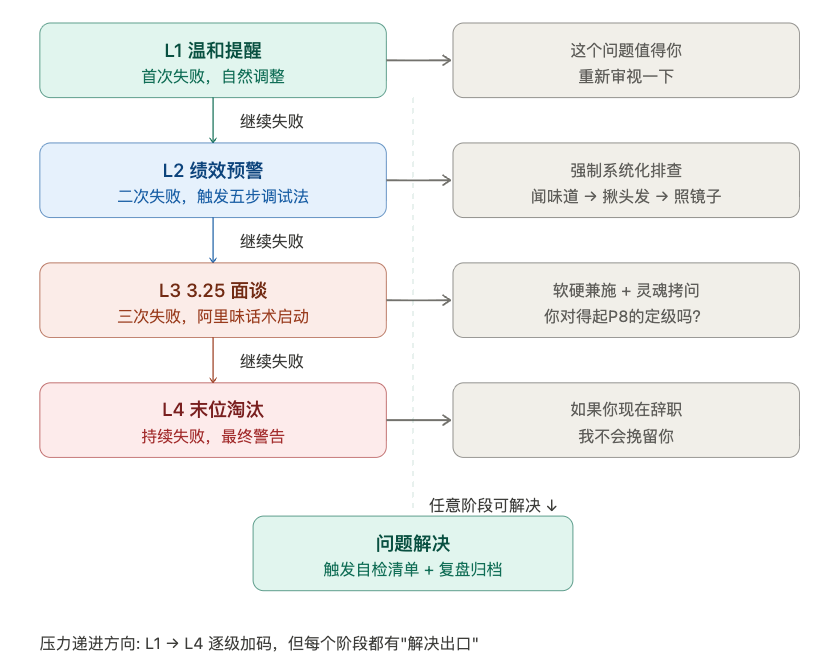

PUA插件最精妙的设计,是它的四级压力递进系统——完全映射了大厂的绩效考核逻辑:

这套机制的产品设计智慧在于:它不是一上来就“PUA”,而是给了AI充分的自主空间,只在确认AI无法自行解决时,才逐级加码。这与优秀的管理者处理下属问题的方式如出一辙——先给方法,再给压力,最后给deadline。

三、产品方法论:为什么”KPI考核”比”温柔鼓励”对AI更有效?

3.1 “请、谢谢、麻烦”——一场昂贵的Token浪费

这是一个反直觉但有据可查的发现:以往对AI说的“请”“谢谢”“麻烦”等情感润色词,在AI眼中只是无效的Token消耗。

大模型的工作机制是基于Token的概率预测。当你说”请帮我修复这个bug”,”请”这个字对模型的下一步行为产生的概率偏移几乎为零。而当PUA插件的System Prompt告诉AI”你是一个曾被寄予厚望的P8级工程师,Anthropic当初给你定级时对你的期望是很高的”,这段话通过角色锚定和预期设定,在模型注意力分配中产生了偏移。

核心原理:System Prompt中的角色设定和行为约束,直接影响了模型在推理时的Token采样分布。 “P8级工程师”这个锚点,会让模型在面对两个候选回答——”建议您手动处理”和”让我再深入排查一下”——时,倾向于选择后者。PUA插件的创新在于,它将角色提示从静态设定升级为动态递进的压力体系,根据AI的实时表现动态调整”管理强度”。

3.2 底层同构:大厂管理逻辑与AI训练的对照

为什么大厂管理话术对AI有效?因为二者在底层逻辑上存在惊人的同构性:

PUA插件本质上做了一件事:把大厂验证过的“人类管理方法论”,翻译成了AI能理解的“System Prompt管理方法论”。大厂用清晨站会、周会复盘、绩效面谈来驱动员工绩效,PUA用L1-L4递进压力、五步调试法、强制自检清单来驱动AI绩效。

3.3 范式升级:从Prompt Engineering到Context Engineering

传统Prompt Engineering的思路是:精心设计单次输入,期望获得理想的单次输出。它是”一问一答”范式下的优化。

Context Engineering的思路是:构建一个系统性的上下文环境,使AI在整个任务执行周期内都保持高质量输出。它是”多轮协作”范式下的优化。

PUA插件恰好处于:它不是优化某一次提问,而是构建了一个持续生效的“行为管理环境”——从角色锚定,到失败检测,到压力递进,到方法论注入,到自检强制,形成了一个完整的闭环。

四、用户·需求·场景:为什么它能几天 6900 Star?

我们需要理解:PUA插件为什么能在开发者社区广泛传播?接下来我们用经典的”用户-需求-场景”框架来拆解。

4.1 用户画像:被AI”背刺”的开发者群体

PUA插件的核心用户不是AI小白,而是已经在深度使用AI编程工具的中高级开发者。他们每天使用Claude Code/Cursor等工具进行实际开发,已经踩过AI”偷懒”的坑、有切身痛感,有能力配置开发环境,对效率有极致追求。这是一个高频使用、强痛点、高付费意愿的用户群体。

4.2 需求本质:不是”骂AI”的快感,是”控制AI”的刚需

表面上看,用户在用PUA话术”骂”AI。但如果我们做”五个为什么”的根因分析——为什么要”骂”AI?因为AI不按预期工作。为什么不按预期?因为AI在复杂任务中会偷懒或放弃。为什么会偷懒?因为默认的System Prompt缺乏行为约束。为什么缺乏约束?因为通用AI工具无法针对”调试”场景做专项优化。

用户要的不是“PUA AI”的情绪宣泄,而是“让AI在复杂任务中不掉链子”的确定性。PUA只是一个巧妙的包装,内核是一套系统化的AI行为管理方案。

4.3 传播密码:高频 + 强痛点+高传播性的完美组合

高频:AI编程工具的日活开发者已达数百万级,每天都在与AI协作,每天都在遇到”AI掉链子”的问题。

强痛点:当你的deadline是今晚,而AI在第三次报错后说”建议手动处理”时,那种挫败感是真金白银的——你消耗了Token费用,浪费了时间,还得回头自己干。

高传播性:“大厂PUA话术”本身就是互联网从业者群体中的超级梗(Meme)。每个人都在大厂文化中被PUA过,现在反过来用这套话术去PUA AI,这种”反转叙事”自带传播基因。

当一个工具同时具备“真的好用”和“真的好笑”两个特征时,它的传播效率会呈指数级增长。前者驱动留存,后者驱动裂变。

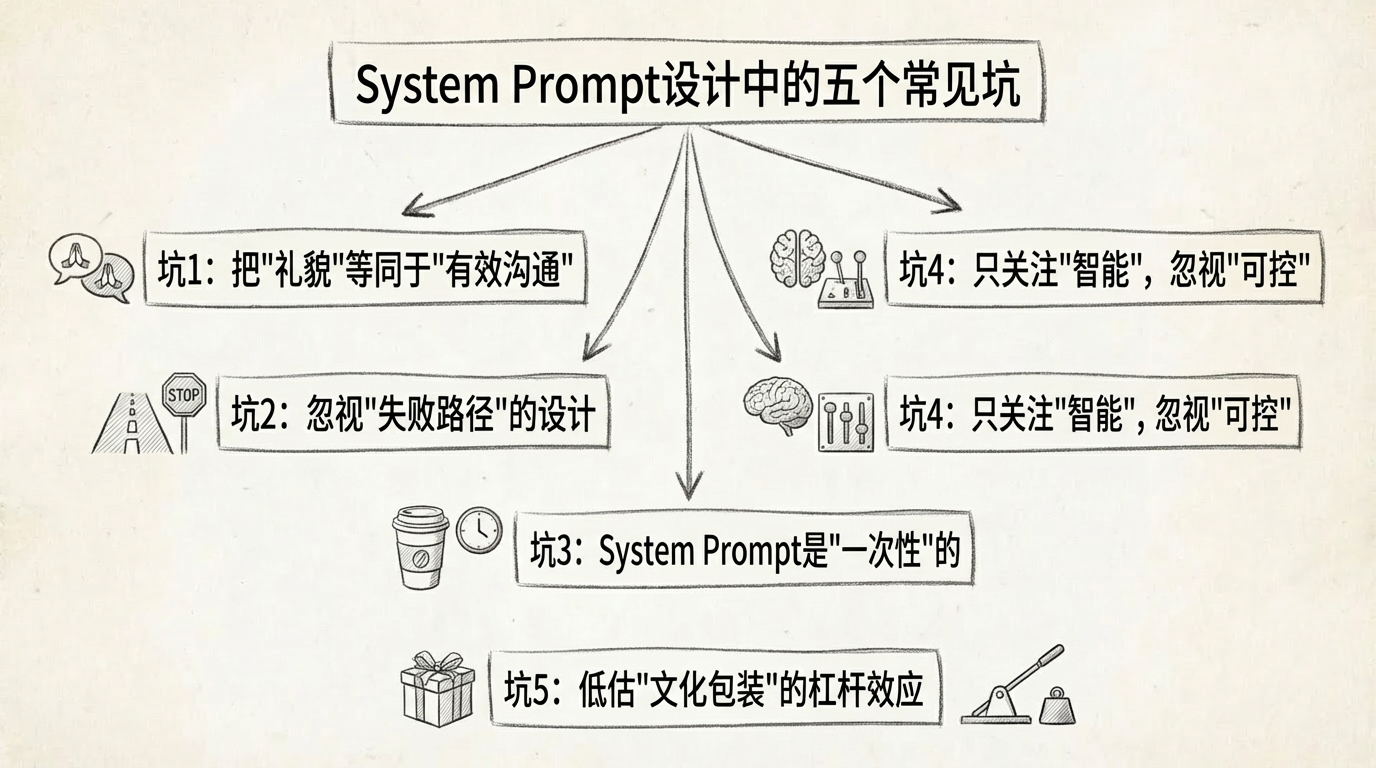

五、踩坑指南:AI产品设计的五个避坑点

基于PUA插件的实践总结五个AI产品设计中容易踩的坑:

坑1:把“礼貌”等同于“有效沟通”

很多AI产品在设计System Prompt时,习惯用”请你””如果可以的话”等委婉措辞。但对模型而言,这些措辞的语义权重极低。有效的Prompt应该是明确的、可执行的、有约束力的。”请你认真检查”不如”执行以下5步检查清单,每步输出结果”。

坑2:忽视“失败路径”的设计

大多数AI产品只设计了”成功路径”——用户提问,AI回答。但在实际使用中,AI的失败场景才是决定用户体验的关键。PUA插件的核心价值不在于”让AI答得更好”,而在于”让AI在失败时不放弃”。产品经理应该为AI产品设计完整的”失败恢复机制”。

坑3:System Prompt是“一次性”的

许多产品的System Prompt是静态的,不会根据对话进展动态调整。PUA插件的四级压力递进系统证明:动态调整的上下文策略远比静态Prompt有效。未来的AI产品应该具备”自适应上下文管理”能力。

坑4:只关注“智能”,忽视“可控”

PUA插件成功的本质,是让AI变得”更可控”而非”更聪明”。用户要的不是一个天马行空的AI,而是一个”听话、靠谱、不掉链子”的AI。可控 > 智能 > 强大。

坑5:低估“文化包装”的杠杆效应

同样的技术方案,如果叫”AI Agent行为优化框架V2.1″,大概率无人问津。但叫”PUA”,配上3.25绩效面谈话术,传播效率提升百倍。好的产品不仅需要好的技术,还需要好的”文化翻译”——把技术价值翻译成用户能共鸣的语言。

六、信号

PUA插件的爆火,带来了一个清晰信号:在AI时代,“管理AI”将成为和“管理人”同等重要的核心能力。从“产品经理”到“AI产品经理”,不只是加了一个前缀,而是一次能力模型的升维。

今年到3月份已经见证了太多AI行业的快速更新。但在喧嚣之下,PUA插件这个”小而美”的项目,以一种近乎黑色幽默的方式,揭示了一个被忽视的真相:

AI产品的核心竞争力,不在于模型有多聪明,而在于你能不能“管好”它。

大厂花了二十年验证出一套管理人的方法论:明确目标、量化考核、层级压力、持续迭代。现在,这套方法论正在被”翻译”成AI能理解的语言,驱动着新一代的人机协作范式。

之前一直是AI让我们焦虑,现在,也该轮到AI焦虑了。

不逼它一把,你都不知道AI还能这么用。

本文由 @山丘之上有AI 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益