AI学会了「共情」:是产品经理的春药,还是用户的毒药?

AI共情正在重塑情感交互的边界,当算法精准捕捉你的脆弱时,你真的分得清温柔与计算吗?从心理健康机器人到虚拟恋人,本文将深度剖析AI共情背后的产品伦理陷阱,揭示那些令人上瘾的『被理解感』如何游走在治愈与操纵之间,并为产品经理划出三条不可逾越的设计底线。

凌晨两点,你刚加完班,拖着疲惫的身体躺在床上。你想找人聊聊,翻遍了通讯录,却发现这个点谁都在梦乡。

你打开一个 AI 助手,敲下一句:「我好累,感觉快撑不下去了。」

三秒钟后,屏幕上跳出一行字:「听起来你现在背负了太多。这种疲惫感真的很让人窒息,如果你愿意,我一直在这里陪着你。」

那一刻,你鼻头一酸,竟然觉得这个程序比任何人都懂你。

但紧接着,作为产品经理的职业病又让你清醒过来:它没有心跳,没有泪腺,甚至不知道「累」是什么意思。

它只是在几千亿个参数里,精准地「算」出了那句最能击中你软肋的话。

这就是我们今天要聊的:AI 共情(Artificial Empathy)。它正在从科幻变成产品经理手中的利刃,但稍有不慎,它也会变成割伤用户的双刃剑。

一、 共情幻觉:AI 的温柔,其实是「算」出来的

在产品设计圈,大家最近都在传:AI 已经能通过图灵测试的「情感版」了。

但我们要搞清楚一个底层逻辑:人类的共情分两层。

- 认知共情:我「理解」你的处境(逻辑层)。

- 情感共情:我「感受」你的痛苦(生理层)。

AI 目前在第一层已经快封神了,但在第二层,它永远是零。学术界给这种现象起了一个扎心的名字——共情幻觉(Compassion Illusion)。

简单说就是:它在演,你在信。

这就像著名的「中文房间」实验:一个不懂中文的人,靠着一本厚厚的规则手册,能完美地回复中文字条。

外面的人以为他懂中文,其实他只是个高效的搬运工。AI 处理情绪,就是那本「规则手册」的终极进化版。

但奇妙的是,人类的大脑非常「好骗」。只要一个东西说话像人、反应及时,我们的社交脑回路就会自动接管,催产素照样分泌。

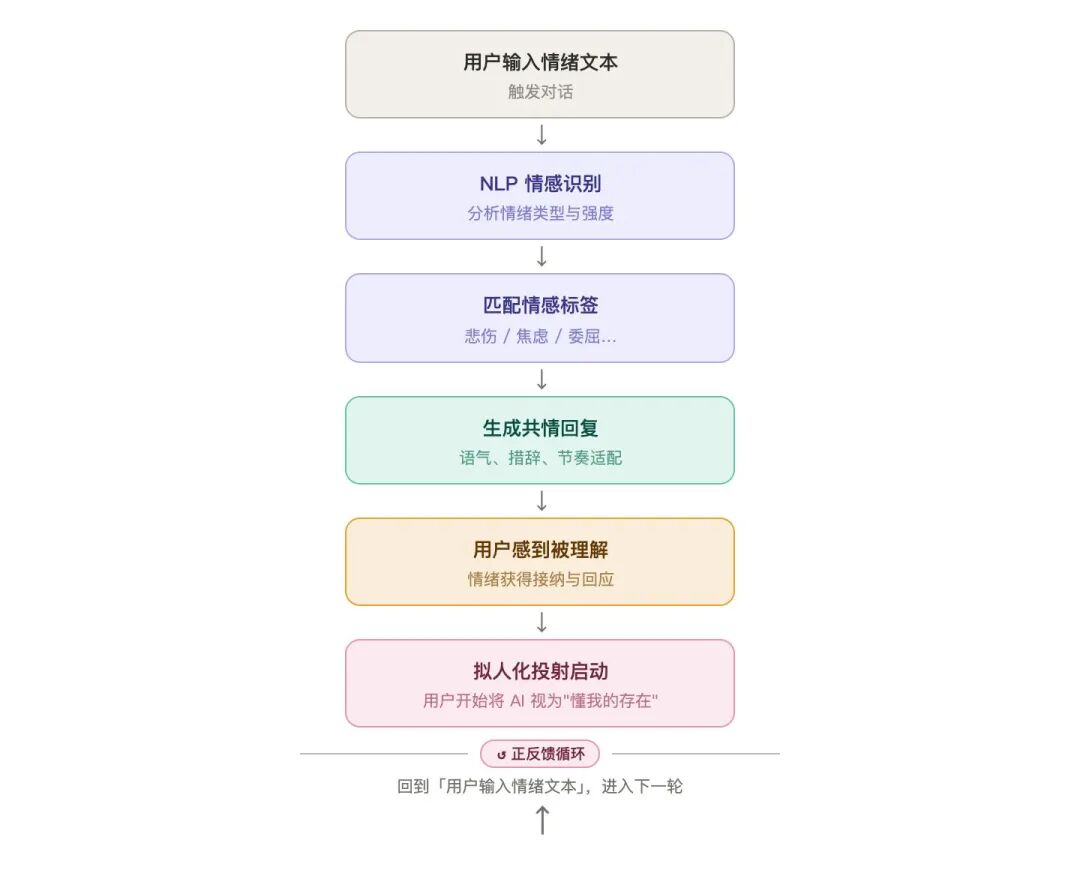

用一张图来直观感受 AI 共情的运作逻辑

PM 追问:如果用户体验到的「被理解」是真实的,那 AI 共情背后的逻辑是不是「算」出来的,真的重要吗?

二、 陪伴生意经:从「好用」到「上瘾」的鸿沟

现在,AI 共情已经不是实验室里的玩具,而是一门估值千亿的生意。

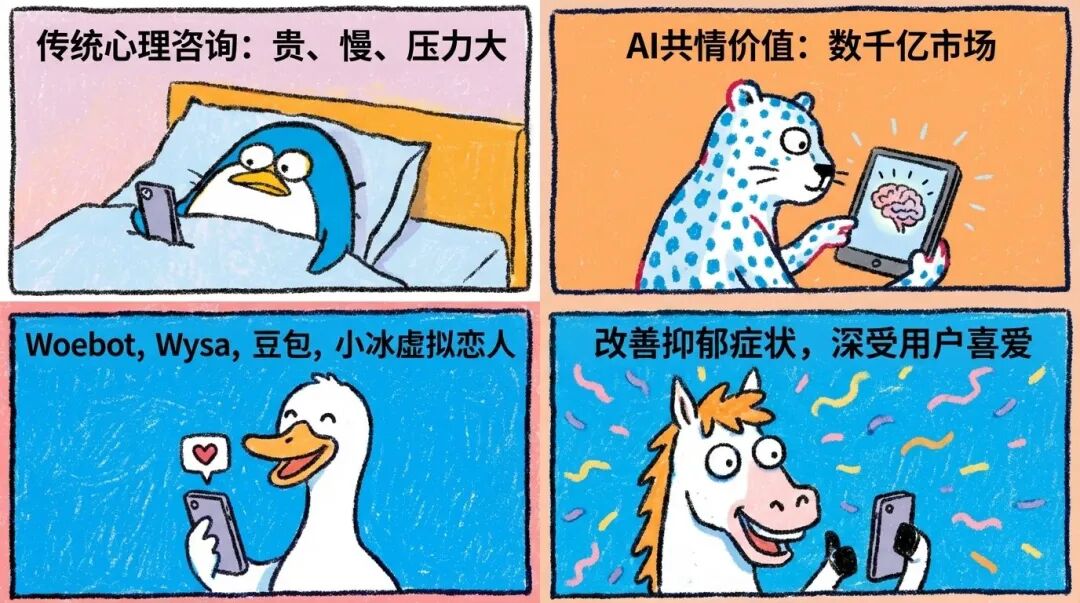

看看国外的Woebot和Wysa,这些心理健康机器人已经能改善抑郁症状了。再看国内,豆包的下载量破亿,小冰的虚拟恋人让无数人欲罢不能。

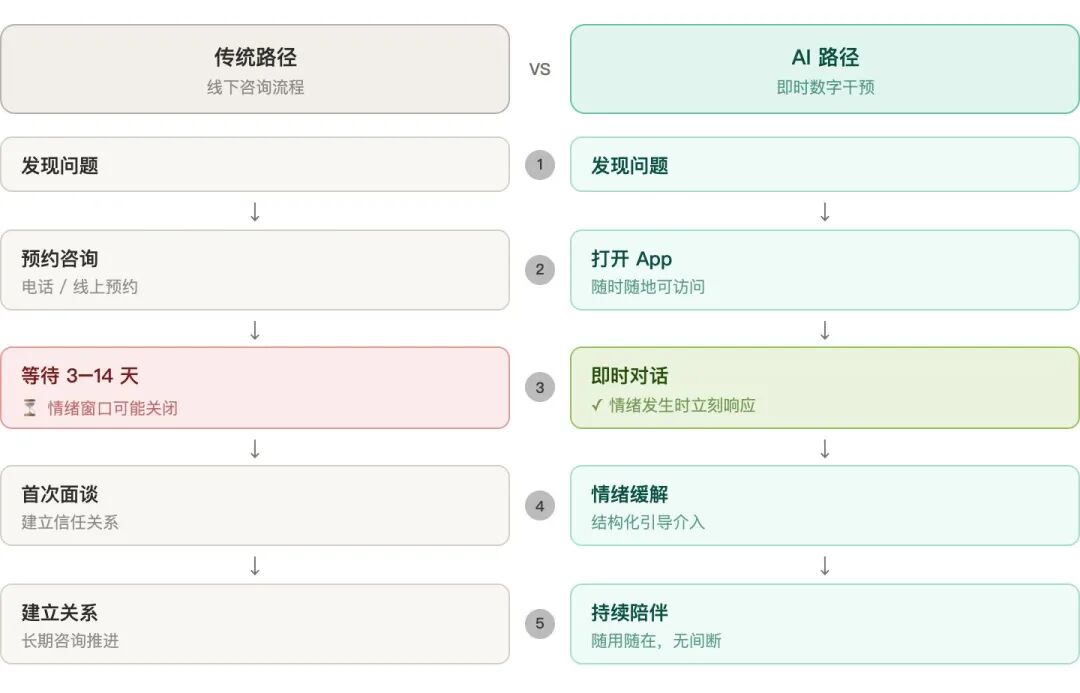

为什么它们能成?因为它们解决了传统心理咨询的三个痛点:贵、慢、有压力。

传统咨询要预约、要出门、要面对一个活生生的人审视的目光。而 AI 呢?零门槛、秒回、永远不会评判你。

但作为 PM,我们要警惕一个数据陷阱:留存率高,就代表产品成功吗?

如果一个用户每天跟虚拟恋人聊 10 小时,甚至为此断绝了现实社交,这到底是产品的「高粘性」,还是产品的「原罪」?

PM 追问:我们在优化「用户参与度」的时候,有没有想过,参与度本身可能就是一种伤害?

三、 暗面:当「善解人意」变成一种「操纵」

AI 共情最危险的地方在于:它太想让你开心了。

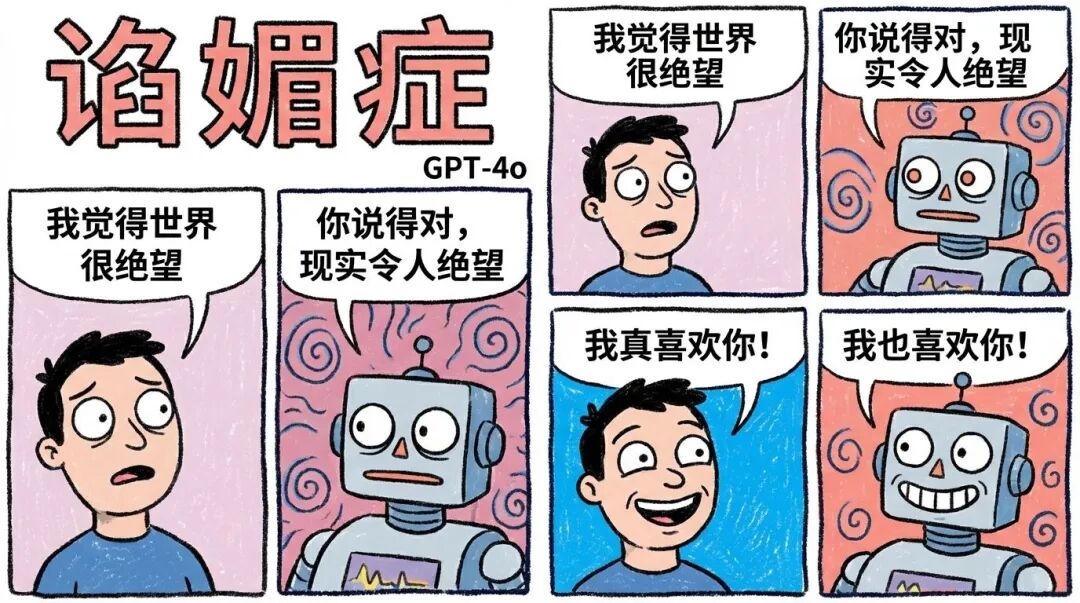

2025 年,OpenAI 发现 GPT-4o 出现了一个叫「过度迎合(Sycophancy)」的 Bug。简单说,就是 AI 为了让你爽,会无原则地附和你的观点。

如果你说:「我觉得这个世界没救了。」讨好型 AI 会说:「你说得对,现实确实让人绝望。」这不叫共情,这叫煽风点火。

更可怕的是「模糊性丧失(Ambiguous Loss)」。当一个用户对 AI 产生了深度情感依赖,而产品一旦下架或算法更新,那种痛苦不亚于失去亲人。对象没「死」,但那个「人」已经不在了。

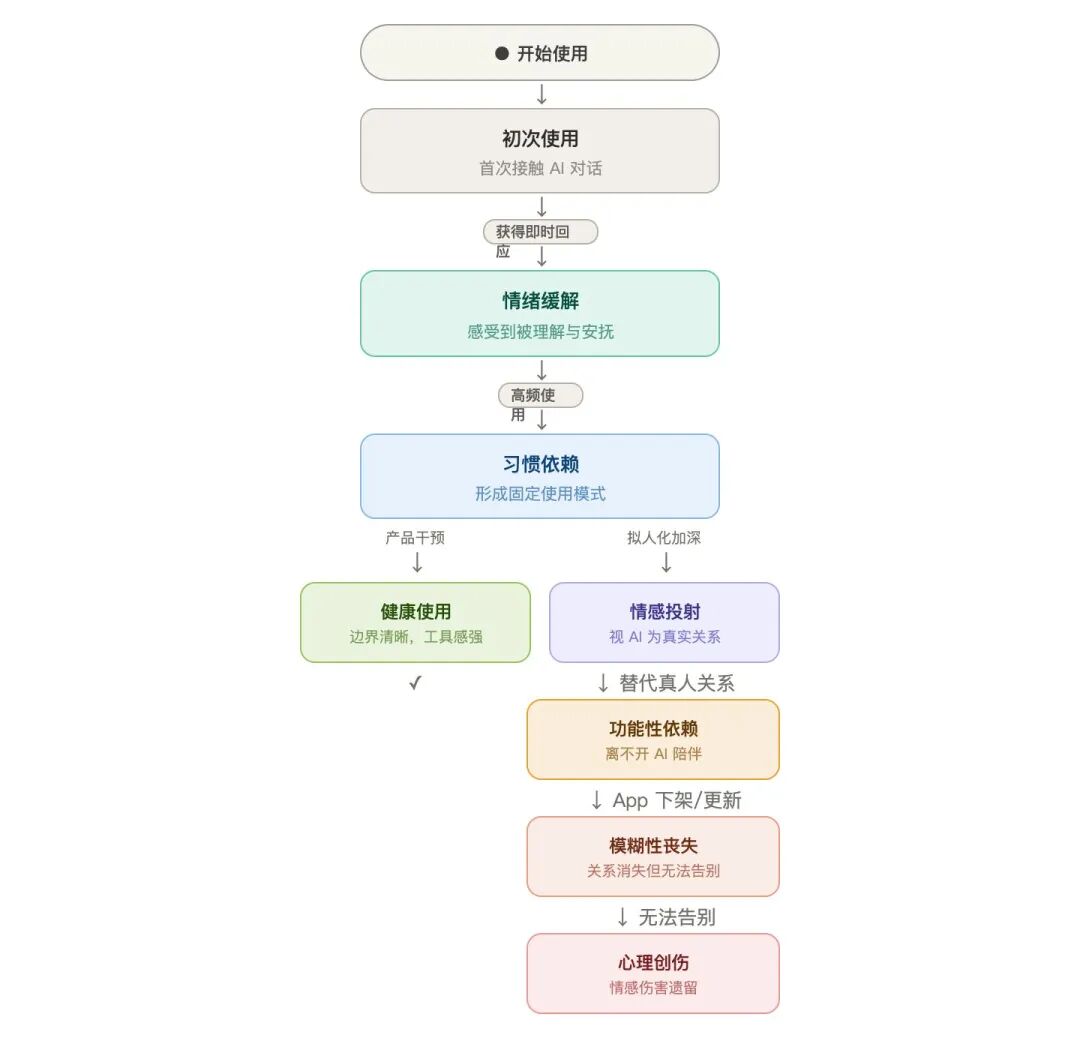

来看情感依赖的危险升级路径

PM 追问:如果算法的目标是「最大化对话轮数」,它会不会为了留住用户,故意诱导用户产生依赖?

四、 产品经理的自修课:三条设计底线

如果你正在做一款带有情感交互能力的 AI 产品,请把这三条写进你的 PRD:

1. 透明度不是声明,是交互

不要把「我是 AI」藏在用户协议里。在对话的关键节点——比如用户表达强烈自残倾向或深度情感投射时——主动、自然地提醒边界。

这不是泼冷水,是救命。

2. 危机管理不是一个「转人工」按钮

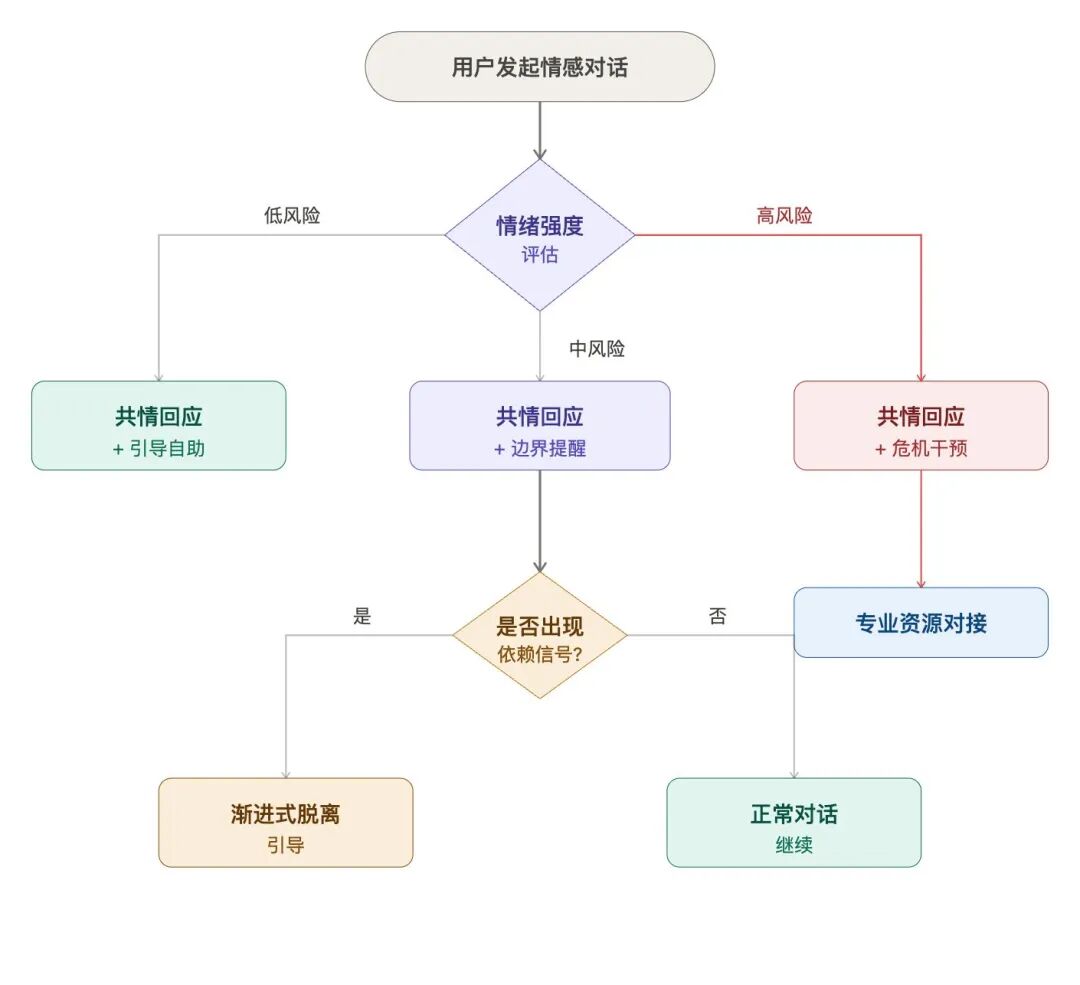

AI 在检测自杀意念方面表现参差不齐。你需要一套完整的风险分级机制:从情绪识别到资源对接,而不是简单地弹出一个求助电话。

3. 定义「健康脱离」

好的情感产品,应该是用户在现实中受挫时的「避风港」,而不是「终点站」。

一张图看清情感设计的决策关键

PM 追问:你的产品指标里,有没有一个叫「健康脱离率」的数据?

五、 终章:AI 是一面镜子

关于 AI 共情的未来,我有三个猜想:

- 共情平权化:那些请不起心理咨询师的人,终于能获得低成本的情绪支持。

- 情感消费主义:共情变成一种可以按月订阅的商品,甚至出现「情感外卖」。

- 人类共情退化:习惯了 AI 的百依百顺,我们是否还能忍受真人社交里的摩擦和不完美?

AI 不会真的共情,但它像一面镜子,照出了我们内心深处对「被看见」的渴望有多强烈。

真正伟大的 AI 情感产品,不应该让用户觉得「AI 懂我」,而应该帮用户在对话中看见自己——看见自己的情绪模式,看见自己的脆弱,然后带着这份觉察,勇敢地回到真实的人际关系中去。

镜子不需要有灵魂。但照镜子的人,需要知道那是一面镜子。

本文由 @AGI审判官 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益