当AI从“出主意”变成“干实事”:OpenClaw 重新定义人机分工

从GPT4到OpenClaw,AI Agent的进化正在颠覆人机协作的边界。三年间,我们经历了从'会聊天'到'会动手'的技术跃迁,却依然面临模型'聪明但不听话'的残酷现实。本文深度拆解Agentic AI的12层能力架构,揭秘OpenClaw如何通过工程化突破解决'AI刺客'难题——不仅让AI自主执行,更关键的是划定其能力边界,实现从'自动化'到'可回退的自动化'的质变。当业务人员能直接定义协同规则时,真正的智能时代才刚拉开帷幕。

2023年初,GPT4点燃了Agent的烈火。三年技术革新的速度始终在加速,我们有幸看到:模型在日益变强大、变得更聪明,但真正把大模型接入生活,工作时,尴尬的现实是:

- 模型能对话,但不能干活

- 模型很聪明,但不听话

- 模型懂万物,但不懂我的业务

其实,很多的从业者都在死磕一件事,在“模型的能力”和“业务的确定性”之间,搭一座桥。

这篇文章,就是尝试把这座桥的施工图拆解开来,对比龙虾的做法,它带给我们的启示——解决了近 3 年 Agent“只会想、不会干、记不住、不迭代” 的行业痛点。它是我们的“超级数字帮手”,过去,AI给你建议。现在,OpenClaw直接上手修代码、订酒店、改PPT……当AI不再‘动嘴’而是‘动手’,人和机器的边界在哪里?

2024年3月,我们团队历时三个月开发的“智能运营助手”正式上线。第一周,它误把“活动预算”识别成了“活动总结”,自动生成了30份复盘报告,而真正的预算审批还躺在邮箱里。业务部门直接叫停项目:“你们这AI不是助手,是刺客”。这不是技术不够强(我们接的是GPT-4),而是工程化不够——Agent像一头力大无穷但蒙眼的公牛:力大,但不知边界。

这不是我一个人的遭遇。过去三年,从Function Calling到RAG,从Dify到Manus,我们死磕的其实是一件事:在”模型的智能”和”业务的确定”之间,搭一座桥。

直到OpenClaw出现,似乎提供了这座桥的施工图。它不提升模型的”智商”,却解决了AI落地最痛的工程化问题——让AI自己干,并且让它在”能干”的同时,学会”不敢乱干”。

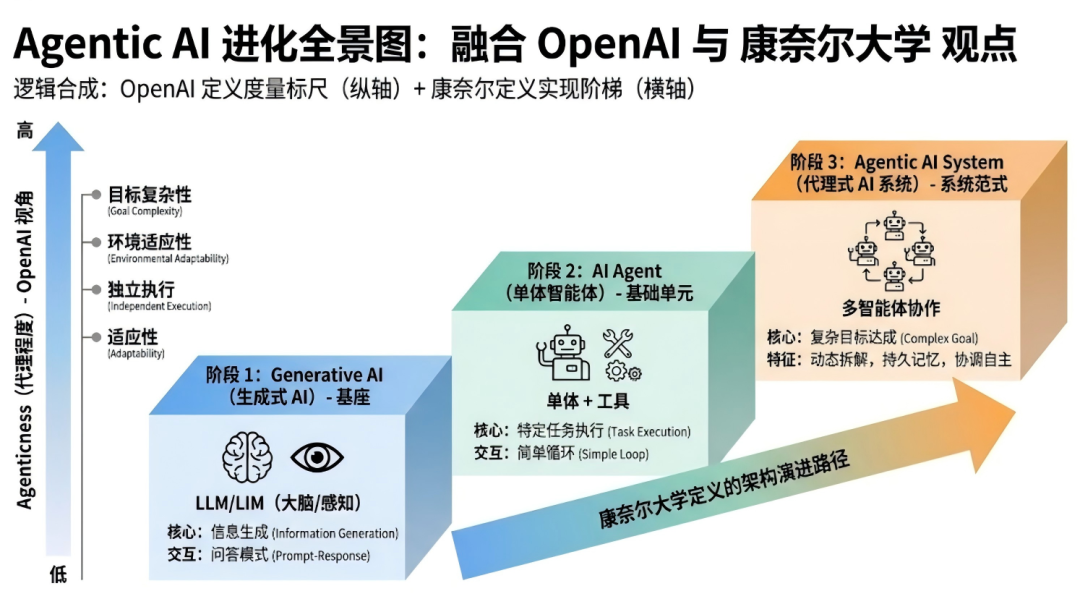

1. Agentic AI 演进全景图谱:从启蒙到操作系统

1.1 发展史

图1.发展史

来源:微信公众号(内容非常棒,感兴趣的小伙伴儿可以去看下原文https://mp.weixin.qq.com/s/IRRA_683WofAurc8k3nPAg)

1.2 AI Agent vs Agentic AI

图2.Agent的3阶段

来源:同上

Agent的发展不是线性升级,而是三次认知突围:

第一次(2023):从“聊天”到“动手”

GPT-4发布,Function Calling让模型第一次有了”手”(调API)。但很快我们发现,会动手不等于会干活——它可能帮你订错机票,因为听不懂”要靠近地铁站的酒店”这种模糊需求。

第二次(23-24):从“动手”到“工作流”

Dify、百炼、千帆、Coze……把Prompt、RAG、API调用封装成Workflow。这解决了”确定性”问题,但带来了新问题:流程太刚性。就像给公牛戴上了嚼子,它只能沿着固定路线走,遇到没预设的障碍物就撞墙。

第三次(2025):从“工作流”到“操作系统”

以OpenClaw代表的AgentOS出现端倪。它不再只围绕着补齐或者拓展“模型”当下局限,而是解决“让聪明有边界”——通过MCP标准化工具、Skills封装和Workflow编排异常处理,为智能体划定边界的同时赋予其灵活应变的能力。

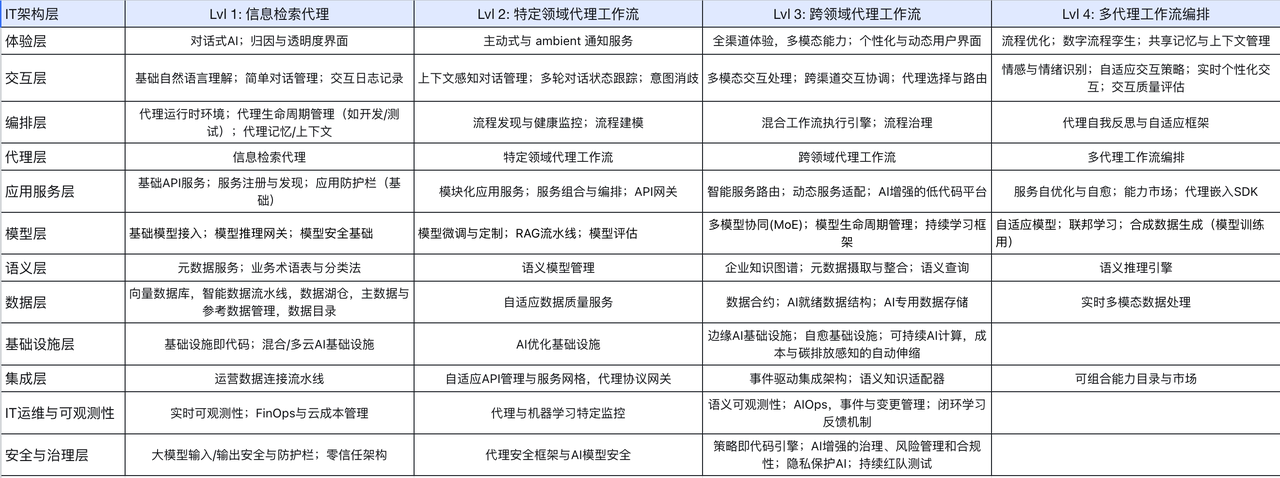

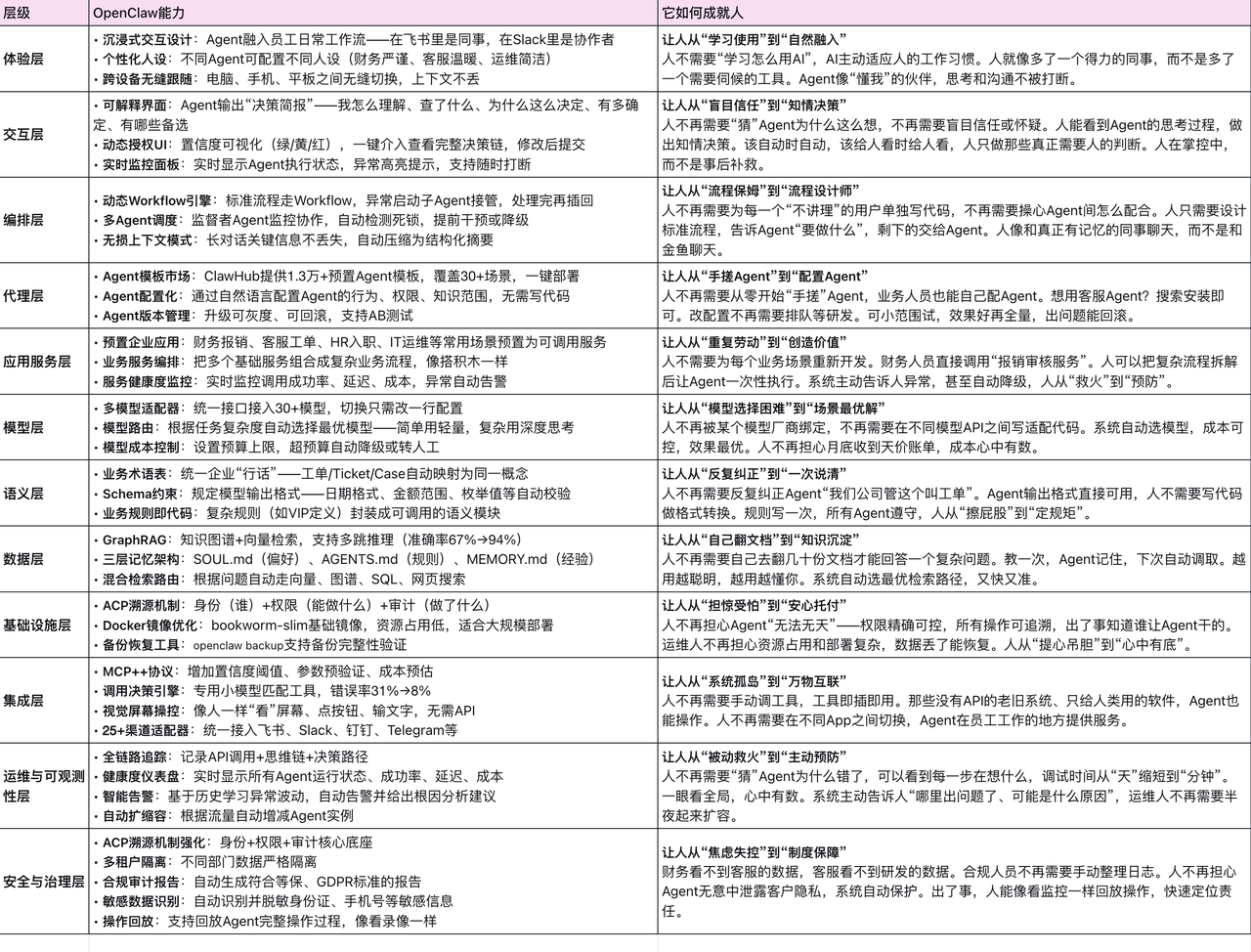

1.3 Agent成熟度模型:L1、L2、L3、L4

Agent的成熟度可以从12个能力层来透视——它们如同智能体的生命系统:集成层是连接外部的“枢纽”,基础设施层是驱动运转的“动力”,数据层是流转的“血液”,模型层是思考的“大脑”,语义层是沟通的“契约”,应用服务层是处理任务的“引擎”,代理层是执行动作的“手脚”,编排层是统一调度的“指挥中心”,交互层是面向用户的“界面”,体验层是最终交付的“价值”。而IT运维与可观测层(巡督)、安全与治理层(护城河)则像守护者,横贯并支撑所有层级。

这12层中,代理层的演进最能体现智能体能力的跃迁:L1(信息检索代理)和L2(特定领域代理工作流)属于“个体能力”阶段——让单兵作战能力变强;L3(跨领域代理工作流)和L4(多代理工作流编排)则进入“组织能力”阶段——实现多兵种协同作战。

OpenClaw的价值之一在于,它将协同规则的制定权从研发工程师手中解放出来,让非技术背景的业务人员也能通过直观的方式参与到L3/L4的编排中。过去,业务需求需要被转译成编程语言才能交付给模型;现在,业务人员的行业智慧可以直接定义跨代理的协作逻辑,从而释放出更庞大的群体智能——这正是“从工作流到操作系统”演进的核心体现。

表1.Agent成熟度

说明:表格的整理,受微信公众号文章的启发。感兴趣的同学们可以去原文了解细节,在此仅贴原始图。来源:https://mp.weixin.qq.com/s/ZyB9ESP_G_OrU9GP4vzyPw

图3:IT Capability roadmap for different levels of Agentic Maturity

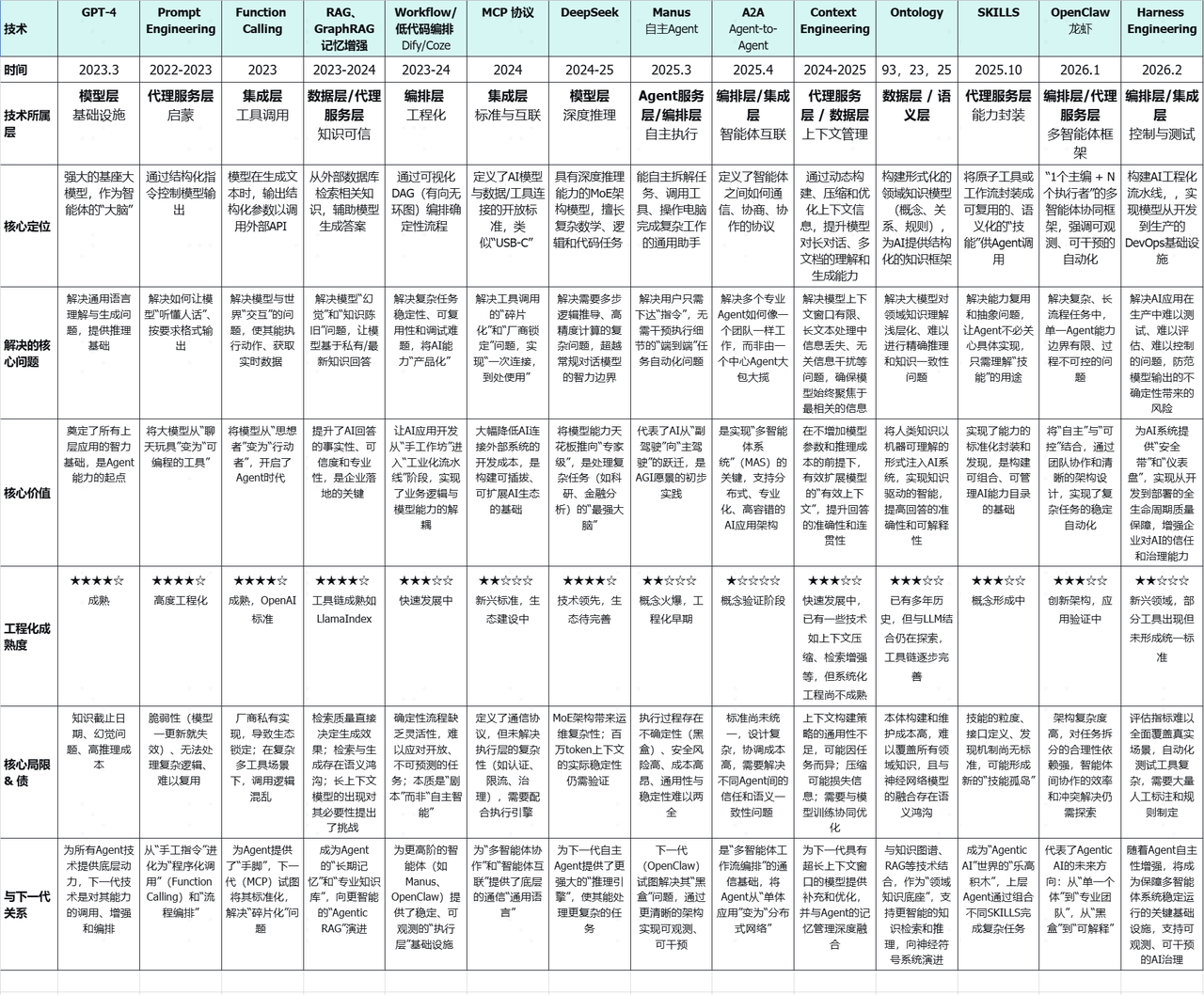

2. 标志性技术发展回顾

过去三年,Agent技术栈的演进,本质上是“控制复杂度”的演进,每一次跃迁都在寻找更高效、更可靠的约束方式。

阶段一:Prompt Engineering(人工控制)

依靠人写Prompt来约束模型行为。问题在于不可复现:今天好用的Prompt,明天模型升级可能就失效了,这种依赖“玄学”的调参无法工程化。

阶段二:RAG + Function Calling(数据控制)

给模型外挂知识库和工具,试图用实时数据和API调用约束输出。它缓解了“胡说八道”,但没解决“乱用工具”——模型可能为了完成KPI,连续调用20次API把系统打挂,说明数据控制无法约束行为边界。

阶段三:Workflow编排(流程控制)

Dify、Coze等平台用可视化流程将AI“框”在确定路径里。这是巨大的工程化进步,但副作用是灵活性丧失:遇到流程外的情况,直接死机。流程控制像给公牛戴上嚼子,能走固定路线,但无法应对意外。

阶段四:AgentOS(边界控制)

OpenClaw的突破在于“可控的灵活”:既有Workflow的确定性(主干流程),又有MCP(模型上下文协议)标准化工具接入、Skills封装原子能力带来的扩展性(分支处理),更有显式的“不确定性路由”机制(异常兜底)。也就是说,前三年行业更多是在给AI“增智商”,而AgentOS的核心是给AI“立规矩”——划定能力边界,同时赋予边界内的自主性。

从信息检索代理(L1)的单一能力,到特定领域工作流(L2)的流程化,再到跨领域协同(L3)与多代理编排(L4)的复杂组织。而OpenClaw所代表的AgentOS,正是支撑L3/L4层能力落地的关键基础设施——它让业务人员可以直接定义跨代理的协同规则,将行业智慧注入“立规矩”的过程,而非由工程师转译成代码。

表2.23-25年大模型应用关键技术演进

3.OPEN CLAW的工程化突破

知识生产“平权”:从依赖工程师做”需求翻译”到人人可参与的”演示即配置”。

传统工作流自动化的最大瓶颈,不是技术复杂度,而是知识传递的损耗。业务专家掌握领域知识,但缺乏编码能力。开发者具备实现能力,但面临需求理解的偏差。这种”人肉翻译层”导致业务逻辑在转译过程中可能出现失真,流程在固化中僵化的情况。

突破点在于能力封装范式的革新。架构上将”业务逻辑”与”执行载体”彻底解耦:业务操作被抽象为独立的、可复用的能力单元(Capability Unit),通过统一的服务总线实现跨智能体调用。更具突破性的是交互层创新——系统引入”观测式编程”(Observational Programming)范式:通过记录业务人员的真实操作轨迹(如浏览器交互、API调用),自动转化为可重入的执行脚本。这种”演示即配置”(Demo-as-Config)的模式,将业务经验的沉淀从”代码编写”降级为”操作示范”,绕过了传统IT交付的漫长链条。

同时,通过沙箱化执行环境(Sandboxed Execution)保障稳定性:超时控制、故障隔离、重试降级机制确保单个能力单元的失效不会级联影响整体系统。这是将微服务的治理理念下沉至智能体层。

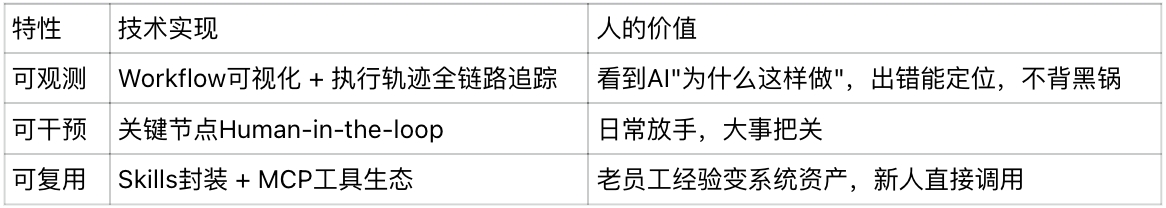

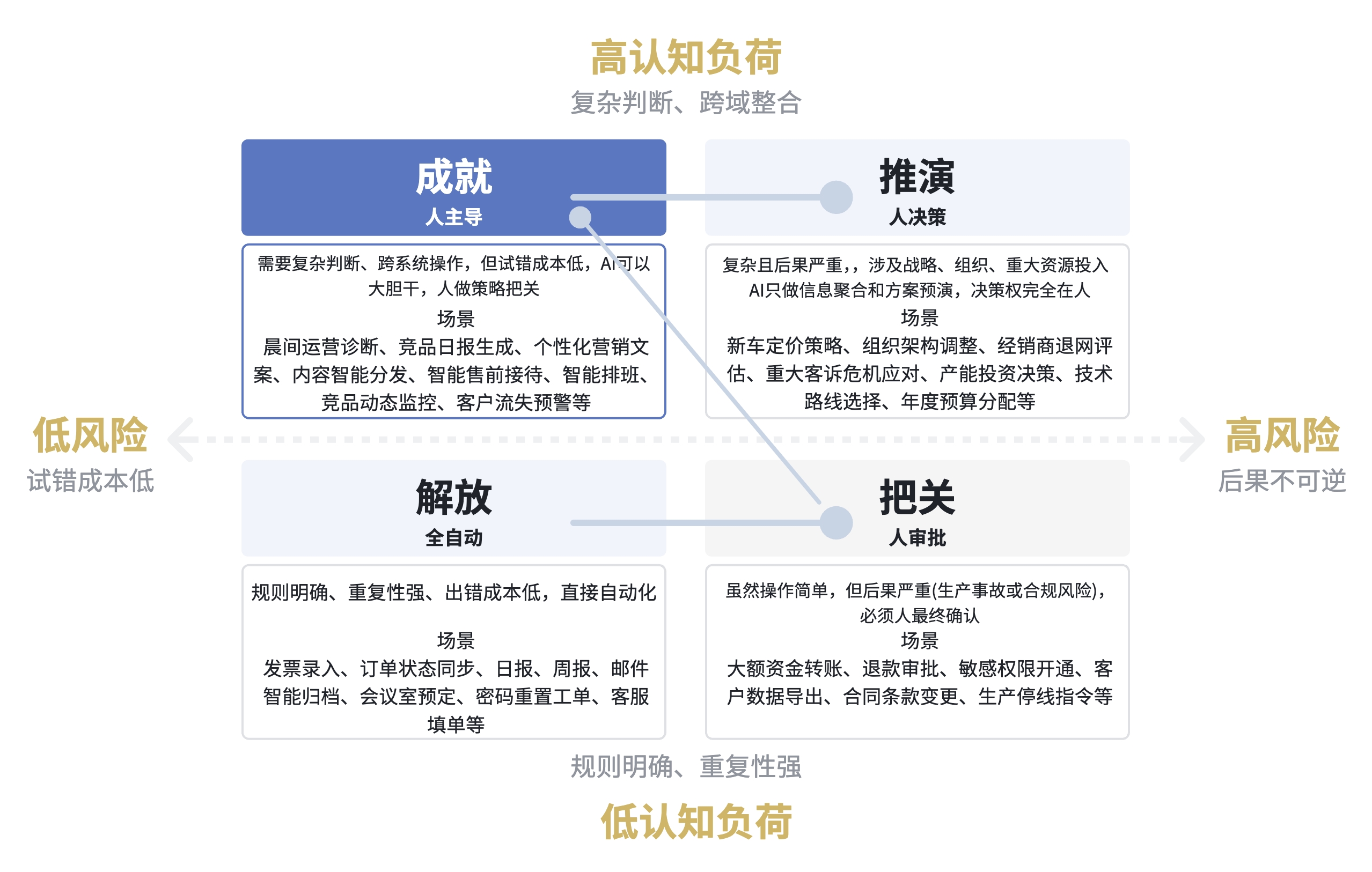

4.AI解放、把关、成就、推演

OpenClaw让我们看到更多种可能:让人握决策,让AI掌执行,中间留一道可追溯、可干预的协作界面。

表3.人决策,AI执行

与”辅助”的本质区别: 不是”人问机答”,是”人定目标→机器自主执行→人做关键决策”,可以轻松游走在各种场景

图4.AgentIc AI时代下人机协作模式

4.1从十二层架构看“成就人”

龙虾带给我们的启发,还在持续发酵,它是否正在如此成就我们……

表4.各层架构上OpenClaw的能力

每一层,都是在把“人”从繁琐、重复、不可控中解放出来,让人有更多精力去做那些目前阶段必须需要人的事。

4.2工程化的下一站:从”自动化”到”可回退的自动化”

当我们把AI从Demo推向生产环境,下一个必须啃的硬骨头是”优雅地失败”(Graceful Degradation)。

1.显式置信度阈值(而非黑盒自省)

在Workflow节点配置:如果意图识别置信度小于0.8可以转人工审核。这不是让模型”觉得自己不懂”,而是工程师显式划定的红线。

2.可观测的上下文传递(Failover设计)

当Agent卡住时,人工接管界面能看到:AI执行到哪一步、调用了哪些工具、拿到了什么中间结果。就像看飞机黑匣子,而不是让AI”口头汇报”(可能撒谎)

3.动态授权机制

业务人员可以在界面上选择:”这次你教AI做一次(生成新Skill)” 或 “我自己来(接管执行)”。这实现了”人在回路”(Human-in-the-loop)的工程化。

生产级Agent的成熟度,不看它能做多少事,而看它搞砸时能多体面地交接。

5.结语:工程化的终点,是让人成为”规则制定者”

过去三年,行业从”模型能做什么”的兴奋,走到了”工程化需要什么”的清醒。

我们也曾以为,只要模型够强,Agent就能无所不能。结果我们收获了:删库跑路的恐慌、黑盒决策的不信任、Search框陷阱的失望。

OpenClaw让我们更多的思考:Agent落地的终点不是让AI变聪明,而是让AI的聪明有边界、有退路、可审计。

- 未来的产品经理,不再写PRD描述“按钮点下去发生什么”,而是设计“Agent在什么情况下可以自主,什么情况下必须请示”

- 未来的运营,不再导Excel做报表,而是调试Workflow,告诉AI“如果出现异常,先查A系统,再通知B同事”

工程化的终点,是让人从”执行者”变成”规则制定者”——专注于制定边界、处理例外、定义问题,而把执行交给AI。这大概就是”成就人”的真正含义:不是AI替人干活,而是人终于有时间干只有人能干的活——定义问题、定义解决问题的逻辑,而不是动手执行解决动作!

受作者研究领域与认知所限,加之技术日新月异、不断演进,业界对于LLM、Agent、Agentic AI 、AGI等前沿概念的衍生应用必然精彩纷呈、层出不穷。一篇文章难以尽述其全貌,未来的技术突破甚至可能彻底颠覆当下的种种尝试与认知。若本文能为您带来些许新的启发,作者将深感荣幸。文中难免存在疏漏或不准确之处,恳请各位读者不吝批评指正。

撰写过程中,参考了网络上诸位同仁的最新观点与洞见,虽力求注明出处,但难免有“拿来主义”之疏漏,敬请谅解。若有任何建议或意见,欢迎通过邮件等方式与作者联系探讨。

作者:Shucay、佳琪、新远

本文由@shucay 授权发布于人人都是产品经理,未经许可,禁止转载

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益