医疗智能体·第2讲——合规护城河:等保、PIPL与HIPAA的架构实战

医疗AI的爆发不仅是底层技术的狂欢,更是产品合规设计的修罗场。面对极其敏感的患者健康数据,单纯的技术堆砌往往会带来致命风险。如何在严密监管下,将枯燥的合规要求转化为流畅的产品体验与底层架构特征?这是一份专为医疗产品经理准备的高阶实操指南。

医疗Agent面临的“合规三角”底层博弈

在严肃医疗行业做产品设计,合规从来不是产品上线前的最后一道安全检查,它必须是业务需求评审时的第一准则。随着智能体具备了自主任务规划、长文本上下文记忆和外部工具调用的能力,传统的静态数据系统保护思路已经彻底失效。

在Agent架构中,数据不仅在各个网络节点中高频流动,还在被大语言模型进行极度复杂的语义理解、逻辑推理和文本生成。这就要求我们在产品起步阶段,就必须直面悬在头顶的三座大山:等保2.0、PIPL以及HIPAA。

等保2.0决定了医疗系统网络与物理安全的准入基线,PIPL严格约束了国民个人信息生命周期与授权管理。而对于涉及跨国业务或采用海外大模型基座的项目,HIPAA法案更是不可逾越的隐私安全铁律。

业务法务团队通常只会抛出“严禁泄露患者隐私”的红线警告,但产品经理的核心任务是解答“在系统架构和前台交互上到底应该怎么做”。将这三套合规体系无缝融入Agent的业务流,本质上是在寻找算法效能、用户体验与法律边界的最大公约数。

PIPL落地:重塑“知情同意”的渐进式交互

《个人信息保护法》(PIPL)对医疗AI产品最深刻的影响,在于对“敏感个人信息”必须采取单独同意的硬性机制。医疗Agent在多轮自然对话中,极易不知不觉地诱导用户输入具体症状、既往病史甚至上传体检报告。

过去的粗暴做法是在用户首次注册时,直接弹出一个长达几万字且晦涩难懂的隐私协议。这在强调沉浸式交互的Agent时代是极差的用户体验,也极其容易被监管部门认定为“一揽子强制授权”而面临违规下架风险。

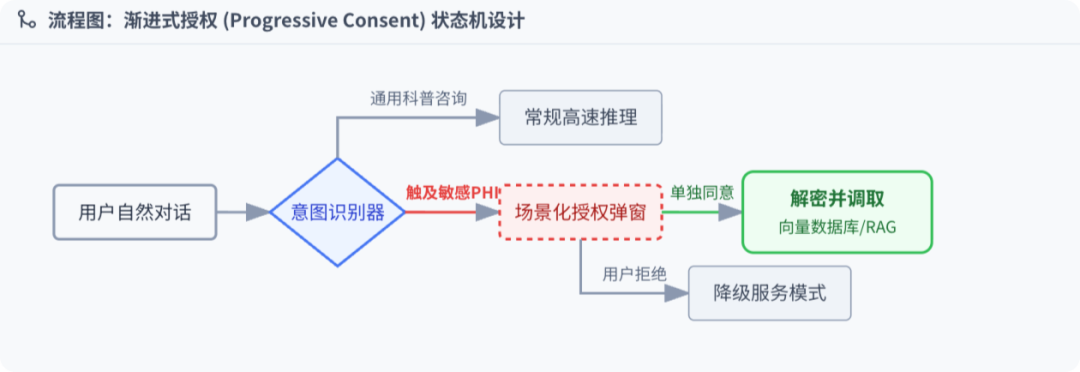

更优雅的产品化方案应当是渐进式授权(Progressive Consent)。在Agent的对话流与状态机设计中,我们需要预埋专门的“敏感数据意图触发器”。只有当模型识别到需要调用用户的私密医疗档案进行检索增强分析时,前端界面才会动态弹出专项授权卡片。

这种场景化、即时性的授权拦截,不仅大幅降低了用户的防备心并提升了信任感,更完美契合了PIPL中反复强调的“最小必要”和“单独同意”的合规原则。

另一方面,为了保持多轮对话的连贯性,Agent通常会依赖向量数据库(Vector DB)来构建长期记忆。但PIPL赋予了用户彻底删除个人信息的“被遗忘权”。这里的合规陷阱在于,许多系统的注销仅仅是简单解绑了用户ID。

在底层向量知识库中,其实仍然悄悄留存着带有个人行为特征的Embedding高维数据。因此,产品经理需要在PRD中定义一条极其明确的深度数据抹除链路。当用户触发清理记忆指令时,系统不仅要清空关系型数据库的对话文本,必须联动物理级清除向量库中的相关数据切片。

HIPAA严苛要求:PHI脱敏机制与隔离沙盒

对于致力于出海或业务链条涉及北美市场的医疗Agent项目,HIPAA(美国健康保险流通与责任法案)是每天都要面对的达摩克利斯之剑。其核心焦点是对受保护健康信息(PHI)的绝对控制,并详细规定了18类必须隐去的个人标识符。

在系统架构层面,永远不要把未经处理的原始患者对话数据,直接透传给外部商业大模型的API接口。我们必须在前端用户输入流与后端LLM推理引擎之间,强制插入一个拥有独立算力的隐私网关服务(Privacy Gateway)。

产品经理需要与算法工程师紧密配合,在此环节定义严密的数据脱敏规则。比如当用户输入“我叫张三,1985年出生,最近在吃阿司匹林”时,隐私网关必须利用专属的实体识别(NER)技术进行拦截与替换。

这段话在到达云端大模型前,必须被动态改写为“我叫[患者姓名],[出生年份]年出生,最近在吃阿司匹林”。这种基于API网关层的动态脱敏与伪像化处理,从根本上阻断了敏感数据外泄和第三方模型投毒的恶性风险。

同时,HIPAA极其看重可追溯性,要求对敏感数据的任何访问、修改和跨域传输都必须有迹可循。在Agent产品中,由于AI具备一定的自主决策权和工具调用权,传统的IT日志记录方式已经远远不够用了。

我们要设计带有业务上下文链路的智能审计系统。不仅要记录某时某刻谁调用了接口,更要详细记录Agent在处理这段脱敏意图时,究竟基于什么逻辑触发了外部医学知识库的查询。这种精细化埋点是应对医疗纠纷时最有利的溯源武器。

等保2.0基线:构筑Agent底座的安全堡垒

等保2.0(网络安全等级保护)主要针对业务系统的物理环境、网络通信和主机算力层面的安全防护,国内正规医疗信息系统通常需要强制通过等保三级的测评。虽然这听起来偏向后端和运维领域,但产品经理如果不深刻理解,极易导致需求返工。

引入医疗智能体后,系统通常需要从传统的基于角色的访问控制(RBAC),全面升级为基于属性的访问控制(ABAC)。这是因为AI助手调取数据的动作更加灵活和不可控,需要引入更多维度的交叉验证机制。

权限的下发需要综合评估主治医生角色、当前所处的内网物理环境时段,以及该患者是否正处于合规的授权就诊周期内。只有当这些环境属性与业务属性全部匹配时,Agent后台才被允许解密并调取该患者的历史病历进行分析。

此外,数据在网络传输中和静态落盘存储时都必须形成完整的加密闭环。在编写需求文档时,产品经理要明确规定前端应用与Agent核心后台的通信交互,必须采用高强度的安全加密协议来防范中间人攻击。

对于落盘存储在底层数据库中的结构化病历或长文本对话记忆,必须采用国密算法进行加密存储。同时在面向医生或患者的前端页面展示时,对于身份证号、联系方式等极度敏感的字段,必须封装默认打码(Masking)的UI组件进行模糊化处理。

Agent架构中的“合规嵌入”分层实战

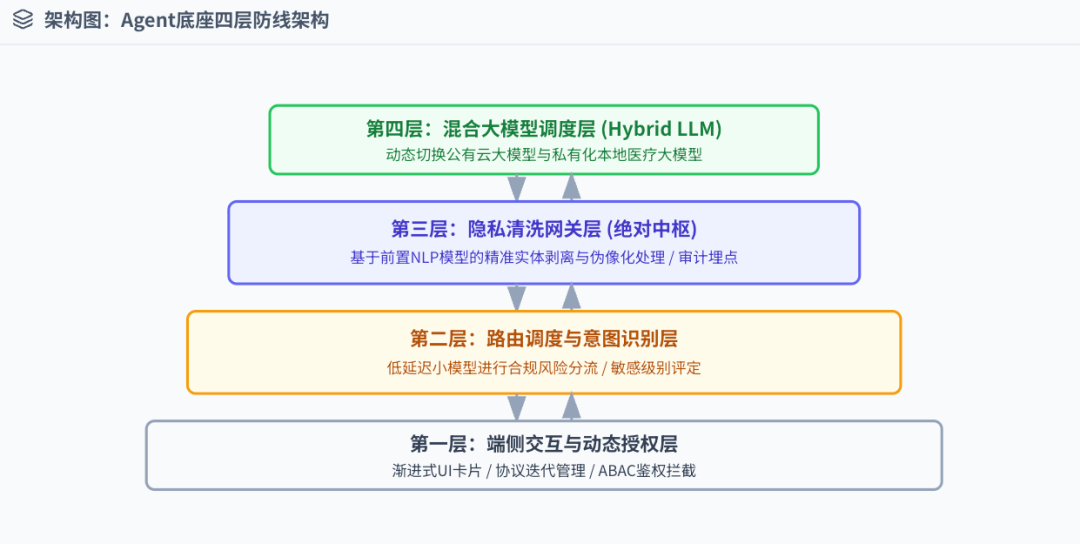

将上述三套庞大且严苛的合规要求进行深度融合,我们需要主导构建一个“合规前置”的复杂AI架构。这不再是简单调用一个黑盒大模型接口,而是一个精心设计的多层防线与智能调度枢纽。

第一层是端侧交互与动态授权层。这里是离用户最近的防线,主要负责执行渐进式的授权弹窗流以及隐私协议的版本迭代管理。在此节点收集到的所有业务数据,都会被打上代表用户授权范围的特殊合规标签,再流转到下一层。

第二层是路由调度与意图识别层。当用户的提示词进入系统后,我们先利用低延迟的小参数量模型进行合规风险分流。如果只是一般的健康科普咨询,则走常规的高速推理通道;若识别到涉及具体病症的高敏感输入,则立刻触发强化保护模式。

第三层是隐私清洗网关层,这是整个合规架构的绝对核心中枢。部署在这一层的前置NLP模型会像手术刀一样,精准剥离所有法定敏感标识符。所有通过此节点的文本信息都会被彻底“伪像化”,确保没有任何可直接关联到个人的特征漏网。

第四层是混合大模型调度层(Hybrid LLM Routing)。对于经过彻底脱敏的数据,我们可以放心地调用参数量更大、推理更强的云端大模型;而如果遇到特定场景无法完全脱敏,架构必须能够动态且无缝地切换到本地私有化部署的垂直医疗大模型,确保核心数据绝不出域。

医疗AI产品经理的常态化合规破局之道

在医疗领域拥抱AI,合规绝不是阻碍产品商业创新的绊脚石;相反,它是建立业务极高护城河的最有效手段。一旦你的团队跑通了一套既能发挥大模型涌现能力,又完全符合监管苛刻标准的Agent系统,这就成了难以复制的核心竞争力。

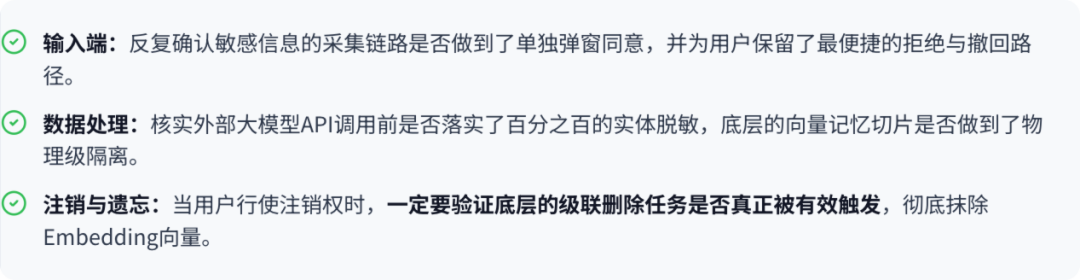

建议产品团队在日常的敏捷迭代中,建立并严格执行一份动态的合规自查清单。在输入端,反复确认敏感信息的采集链路是否做到了单独弹窗同意,并为用户保留了最便捷的拒绝与撤回路径。

在数据处理与存储端,务必核实外部大模型API调用前是否落实了百分之百的实体脱敏,底层的向量记忆切片是否做到了物理级隔离。当用户行使注销权时,一定要验证底层的级联删除任务是否真正被有效触发。

将冷冰冰的法律条文,巧妙地转化为系统里一个个优雅的架构节点和丝滑的交互组件,正是当代高阶AI产品经理的核心价值所在。通过将复杂的合规能力封装为底层服务,我们才能在坚守患者隐私红线的同时,尽情释放医疗智能体的无限业务潜力。

本文由人人都是产品经理作者【科技叨叨馆】,微信公众号:【科技叨叨馆】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益