五月全球“AI大爆炸”:卷技术、拼落地、比价格

在这个五月份,科技圈不可谓不热闹,从OpenAI发布GPT-4o、谷歌召开2024年I/O开发者大会,再到国内互联网大厂的系列探索……新一轮的技术大爆炸开始了,新一轮的AI竞赛,也开始了。

这个五月,全球科技圈异常热闹。

先是OpenAI和谷歌掰手腕,后有微软、苹果的开发者大会即将召开;反观国内,大厂和创业公司也都在拼场景、卷技术。

5月15日,谷歌举办了2024年I/O开发者大会,AI是全场的主题,谷歌发布了Gemini 1.5 Pro的新版本,谷歌CEO皮查伊宣布谷歌已经全面进入Gemini时代。

原本打算掀起全球的科技狂欢的谷歌没想到被OpenAI抢了先。

就在谷歌发布会前一天,OpenAI举行了春季发布会,发布最新多模态大模型GPT-4o,相较于GPT-4 Trubo速度更快、价格也更便宜。更重要的是,该大模型响应速度更接近人类水平,无限接近现实。

OpenAI这场空降的发布会,被市场看作是对谷歌的“截胡”和“狙击”。双方“掰手腕”的核心竞争点在于AI,这个令全球科技市场兴奋的技术,一场关于AI技术的比拼再度开启。

大洋彼岸的中国,也聚集了一众参与大模型军备竞赛的玩家,正努力缩小与国外科技公司的差距,并在场景、价格、落地上有更多的探索。

5月15日,字节近期推出豆包大模型,日均处理1200亿Tokens文本,生成3000万张图片;5月14日,腾讯混元大模型升级开源,采用与Sora同款DiT架构;5月9日,阿里云正式发布通义千问2.5,模型性能全面赶超GPT-4 Turbo……

经过一年多的发展,大模型技术不断提高,玩家们要面对的不仅是技术上的差距,更重要的是如何通过场景落地、商业化覆盖大模型高昂的训练成本以及研发成本。

新一轮的技术大爆炸开始了,新一轮的竞赛也开始了。

一、OpenAI 与谷歌的AI竞赛,拉开新一轮技术大爆炸的序幕

连着两天,大洋彼岸的OpenAI和谷歌掀起了新一轮的AI军备竞赛。

5月14日凌晨,继上周预告了ChatGPT和GPT-4“就像魔法一样”的重大更新后,OpenAI揭开了最新大模型的神秘面纱。

会上,OpenAI发布了新旗舰模型“GPT-4o”,这里的“o”代表“omni”,意为“全能”。顾名思义,最新的GPT-4o是款全能型大模型,也是OpenAI CEO阿尔特曼口中“很有意思的东西。”

为了彰显“全能”,OpenAI首席技术官米拉·穆拉蒂用大量篇幅介绍GPT-4o的先进程度。比如,GPT-4o可以综合利用语音、文本和视觉信息进行推理;GPT-4o在GPT-4的基础上,新增语音处理能力,掌握多国语言;GPT-4o还可接受文本、音频和图像的任意组合作为输入,并生成文本、音频和图像的任意组合输出。

用OpenAI官网的话来解释,GPT-4o在文本、推理和编码智能方面达到了GPT-4 Turbo级别的性能,同时在多语言、音频和视觉功能上也达到了新高水位线。

整场发布会最大的亮点,也是最特别之处莫过于GPT-4o更像人。

图源OpenAI官网

一方面,GPT-4o几乎可以做到即时回应,没有停顿。OpenAI表示,在GPT-4o推出之前,用户使用语音模式与ChatGPT进行对话时,延迟时间分别为GPT-3.5的2.8秒和GPT-4的5.4秒,GPT-4o将这一延迟被大幅缩短为320毫秒。

另一方面,GPT-4o能在与人的对话中,通过图表、图像等形式判断用户的情绪、状态,并给出“情绪化”的回应——夸张的、戏剧的、低沉的……

当电影《Her》中的画面照进现实,GPT-4o的“拟人化”给了市场足够多惊喜。GPT-4o驱动下的ChatGPT,已不再是一个单纯追求性能的AI工具,而是可以主动给予用户情绪价值的AI助理。

这一次,GPT-4o的出现,是OpenAI向本就不平静的池水中投掷了一枚极具杀伤力的炸弹,并直指同在硅谷的科技巨头谷歌,谷歌必须直面劲敌。

就在OpenAI开发布会的第二天,谷歌年度I/O开发者大会主题演讲上,谷歌CEO皮查伊发布数十款Google和 AI 结合产品,堪称“全家桶”级别,全力对战OpenAI。

其中包括支持200万Tokens长文本的Gemini 1.5 Pro和 Gemini 1.5 Flash、谷歌版Sora技术Veo,最强开源模型Gemma 2,支持生成式搜索的AI Overviews、第六代TPU等。

围绕AI,皮查伊及同事进行了长达110分钟的演讲,据谷歌统计,皮查伊提及AI的次数高达121次。

不过,有GPT-4o“拟人”在前做标杆,谷歌发布会最受关注的莫过于AI助手Project Astra。

相比于谷歌上一代AI助手Google Assistant,Project Astra是一个实时、多模式的AI助手,通过接收信息、记住它所看到的内容、处理该信息和理解上下文细节来与周围的世界进行交互,没有延迟或延迟,可以回答问题或帮助你做几乎任何事情。

演示视频中,Project Astra可以通过手机摄像头识别现实环境,实现了能看、能说、能听。这与前一天GPT-4o的功能不谋而合。

图源谷歌官网

相比于GPT-4o提供情绪价值,Project Astra更强调指向人、机器与现实世界的三重交互。用谷歌Deepmind负责人哈萨比斯的话说,这是真正通向AGI的万能助手项目。

此外,谷歌还针对生成式AI大模型Gemini进行了多功能拓展。

谷歌在Gemini Advanced中加入新模型成员Gemini 1.5 Pro,称它拥有的上下文窗口在全球消费类聊天机器人中最长,窗口起始就有100万个Tokens;今年年底,这个数字将被扩大到200万Tokens,最终目标是无限上下文;Gemini 1.5 Pro将向150 多个国家地区的Gemini Advanced订阅者提供,支持超过35 种语言。

在多模态功能方面,今年夏季谷歌将扩展Gemini用语音进行深入双向对话的能力,该功能被称为Live。通过 Gemini Live,用户可以与 Gemini 交谈,并可以从各种自然的声音中选择它回应的声音,用户甚至可以按照自己的节奏说话;谷歌还表示,今年年内将加入相机功能,实现实时视频。

全面接入 Gemini 的“谷歌办公全家桶”,也将在未来几个月内陆续上线“智能问答”“智能邮件回复”“表格图像化总结”等新功能。

在谷歌最擅长的搜索上,谷歌在一周内将在美国推出“AI概览”(AI Overviews)功能,搜索引擎会直接归纳总结搜索结果;谷歌还推出了新的TPU,第六代TPU芯片Trillium,较上一代芯片的算力表现翻4.7倍。

可以看到,在全球技术的中心硅谷,OpenAI与谷歌的“厮杀”正如火如荼地进行着。更重要的是,GPT-4o的限量免费抬高了这场竞争的维度,未来的谷歌如何应战,还要看市场后续的表现。

二、卷技术、拼落地、比价格,国内大厂竞逐大模型风口

大模型风口之下,AI重构了边界,也掀起了一众创业者和巨头们探索新业务的热情。

当这样的热情来到大洋彼岸的中国,丝毫没有减少。和硅谷的公司几乎同步,国内大厂也在大模型风口上你追我赶。

一个明显的变化是,去年国内大厂还处在大模型军备竞赛的初期,竞相推出大模型产品;今年,经过一年的技术发展,大厂们的竞争点不仅限于技术,还有价格,更重要的是落地场景。

5月9日,阿里云正式发布通义千问2.5,宣布模型性能全面赶超GPT-4Turbo,成为地表最强中文大模型。

在阿里云AI峰会上,阿里云首席技术官周靖人介绍,阿里云大模型API日调用量已经过亿;除了日常2C应用外,也服务了9万家企业客户;尤其在开源场景中,周靖人强调,开源是阿里云的战略。目前通义开源模型下载量已超过700万。

同样选择对外开源的还有腾讯混元文生图大模型。5月14日,腾讯宣布其旗下混元文生图大模型全面升级,并对外开源。这也是首个中文原生的类 Sora 架构开源模型,支持中英文双语输入及理解,参数量15亿。

放眼市场,当下的文生图开源生态,比如Stable Diffusion基本围绕英文语义理解,要先把中文翻译成英文才能生成图片。腾讯混元文生图大模型的出现,打破了这一现状,让文生图生态更了解中文。

值得注意的是,腾讯在大模型上的打法有着明显的产品思维。自去年9月混元大模型上线以来,腾讯采取的就是“大模型全家桶”策略,其内部目前已有超400个业务在接入腾讯混元大模型。比如,此次混元大模型升级后,既可以是微信读书的“AI问书”,也可以是腾讯会议的“AI小助手”。

事实上,关于开源还是闭源,行业的讨论由来已久。百度创始人李彦宏曾表示,“大模型开源的意义其实不是很大,这些开源模型都是在外头零零散散小规模地去做各种各样的验证应用,它没有经过大算力的验证。”

“对百度而言,开源还得自己去维护一套开源的版本,这是不划算的;相反,同等能力下,闭源模型的推理成本一定是更低的,响应速度一定是更快的。”李彦宏认为。

这样的路径之下,百度文心一言采用了闭源模式。近期,百度推出多个轻量级大语言模型,并上线Agent Builder、App Builder和Model Builder三大开发工具,帮助开发者和企业创建智能体、开发AI原生应用和定制模型。

据百度2024年一季度财报披露,发布一年多,“文心一言”用户数突破2亿,文心大模型日调用量也达2亿。

本质上,开源还是闭源,是大模型厂商在成本和技术上衡量。尤其是在大模型应用市场,大家都试图推出更普惠的大模型应用。

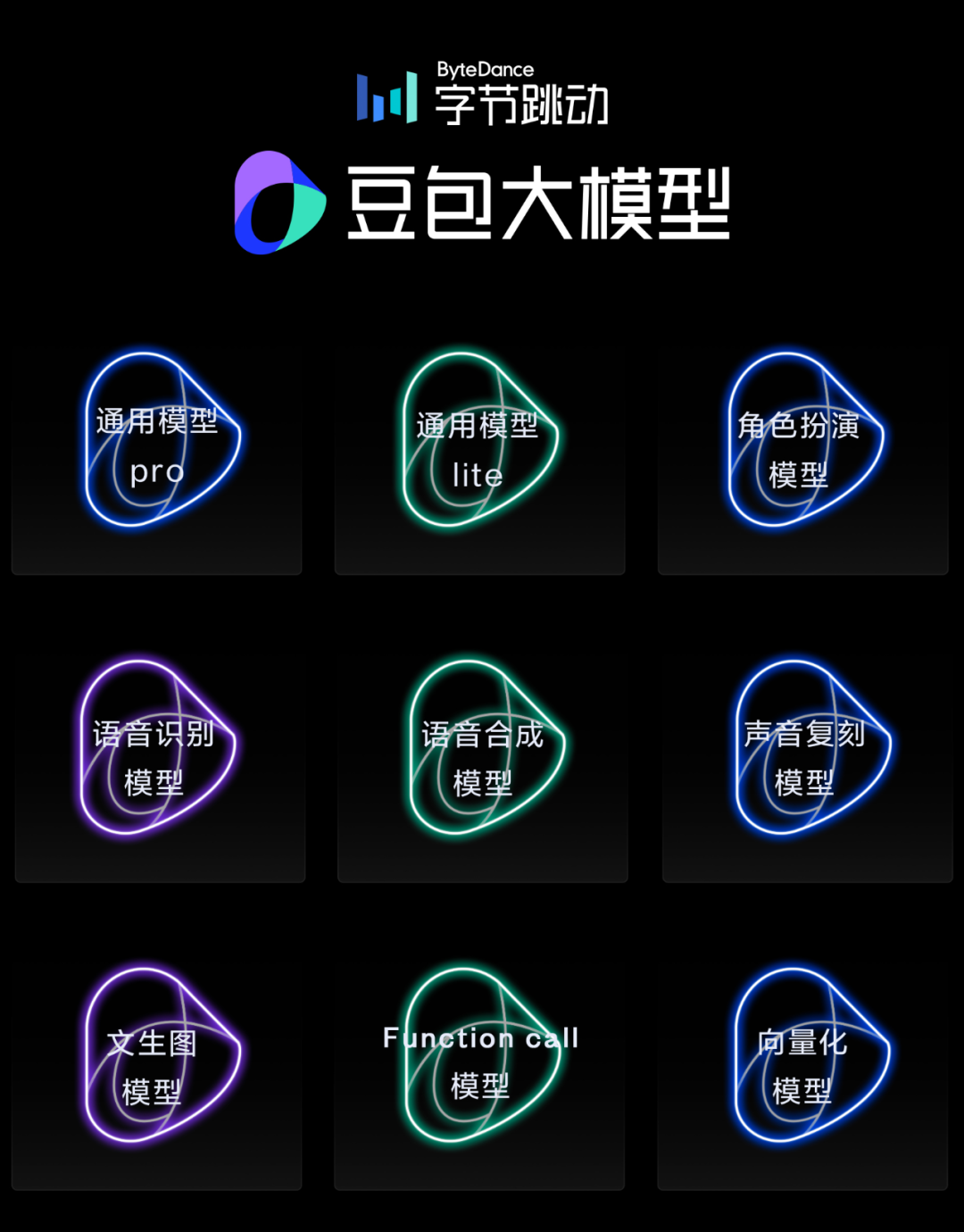

最突出的是字节豆包大模型。5月15日,尽管没有公布榜单成绩和参数规模,但豆包大模型靠价格出圈了。

豆包主力模型pro-32k版的模型推理输入价格仅为 0.0008 元 / 千 Tokens,相当于一元钱就能买到125 万Tokens,比行业价格低 99.3%;在处理 128K 长文本时,豆包通用模型 pro 的推理输出价格为 0.005/ 千 Tokens。

这堪称是行业“地板价”。以OpenAI发布的全新模型GPT-4o为例,GPT-4o的价格已经来到输入5美元 / 百万Tokens(约为0.035 元/千Tokens),输出15美元 / 百万 Tokens(约为0.1元/千Tokens);而像阿里、腾讯等国内大模型均价在0.12元/千Tokens左右。

火山引擎总裁谭待在接受媒体采访时提到,“降价是用技术优化成本来实现的。如果只是补贴,用亏损换收入是不可持续的,火山引擎不会走这条路。”

如何进行技术优化,据介绍,模型本身就有优化的空间,模型结构、训练方法都可以持续改进,包括业界很关注的MoE(混合专家模型),就是优化推理成本很好的解决方案。

其次是工程上的优化。大模型的调用量越大,优化推理成本的空间也越大。以前的模型都是单机推理,大模型用的是分布式推理。所以如果能把各种各样的底层算力用得更好,推理成本就会大大降低。

事实上,为了让用户可以低成本地使用AI,并推动应用的发展,降价是国内大模型厂商的共识。

今年2月份,阿里云宣布全线下调云产品官网售价,平均降价幅度超过20%,最高降幅达55%,涉及100多款产品、500多个产品规格,4月份,阿里云将降价策略扩大至海外公有云产品。

大厂们之所以打起价格战,是因为大模型价格越低,使用的人越多;使用量越大,大模型才能被调用得越来越好。简言之,价格力的出现,才能推动大模型更好地落地。

2024年,被行业看作是大模型落地元年,推出大模型已不再是新鲜事,重要的是充分释放大模型的生产力,如何真正实现落地。

对于大模型厂商而言,如何真正服务好企业,是考验各家AI产品是否是个好商品的重要标准。

三、火热和洗牌并行,资本市场更冷静看待大模型

从ChatGPT横空出世后,大模型的火热有目共睹。面对大模型带来的技术革命,不仅是微软、谷歌、百度、字节、阿里、腾讯等大厂下场做大模型,众多与AI相关的创业公司涌现出来。

在我国,更是诞生了“新AI四小龙”:百川智能、月之暗面、MiniMax、智谱AI。从估值上看,除百川智能估值超百亿元外,月之暗面、MiniMax目前估值分别为超23亿美元和超25亿美元,智谱AI估值超百亿元。

“新AI四小龙”快速成长的背后,是资本的助推。CBInsights数据显示,2023全年生成式AI新创在全球获得约204亿美元融资,是2022年36亿美元的5倍以上。

火热的背后,也有一些现象值得思考。最为明显的一点是,与上一代移动互联网创业潮相比,这场AI掀起的创业潮,资本和创业者都显得更为冷静谨慎。

从创业者角度看,大模型创业从研发大模型,到落地应用场景,这条路的成功不仅依赖资金的投入和人力的积累,更需要过硬的技术和清晰的落地路径,缺一不可。

从资本角度看,创业公司烧钱换增长在大模型行业是行不通的,投资者不会因为短暂的增长就不遗余力地押注真金白银。

市场研究机构CB Insights发布的《2023年人工智能行业现状报告》指出,2023年中国AI领域的投融资案例数量约为232起,与去年同期相比下降了38%;融资总额约为20亿美元,同比大幅下降了70%。

肉眼可见的是,市场冷静下来了,在钱少的时候,对于创业公司而言,活下来更加重要。尤其是到了今年,商业化、落地等关键词成为大模型新的竞赛点后,商业模式不清晰,营收增长乏力的企业或面临危机,行业或将迎来真正洗牌阶段。

从新变化看,今年,场上大模型玩家都从围绕模型层的“参数之争”,转变为发力应用层的“用户之争”,百度创始人李彦宏也多次表示“卷模型不如卷应用”。

海外市场和国内类似,投资Facebook和Salesforc的Meritech Capital,以及TCV、General Atlantic、Blackstone等机构纷纷暂停对生成式AI的关注。Gartner分析师John-David Lovelock称,大模型数十亿美元的投资数量已经放缓且几乎已经结束,热钱涌向AI 应用。

今年5月这波技术大爆炸后,玩家们都瞄准了“更像人”的方向,即推出互动能力更强的AI助手。

过去一周内,创业公司月之暗面和零一万物接连发布Kimi+和万知,两款产品定位均为AI专业助手。其中,Kimi+搭建了一套智能体商店,包含办公助手、研报生成、学术搜索、提示词设计、辅助写作等场景;万知则是一套一站式AI工作平台,覆盖写作助手、文件解读、PPT图文制作等功能。

同时,也有一些企业从加入“百模大战”开始,就将应用落地放在重要位置。举例而言,“技术顶天,应用落地”是科大讯飞在发展大模型过程中始终遵循的两项准则,在研发技术的同时,思考场景落地与商业化。

近期,科大讯飞披露投资者关系活动记录表显示,其多模态大模型能力已广泛应用在教育、医疗、工业、汽车、机器人等领域。此外,科大讯飞与人保集团联合发布了人保首个百亿级参数的专属问答领域大模型“人保大模型”;在软件等 IT 行业,科大讯飞的 AI 程序员不仅在公司内部使用,也已经在软通动力、交通银行等100 多家企业“上岗”。

从爆火至今,大模型经历了很多个重要节点,其中最重要的是从参数到应用的演变,大模型跑得快的标准正变成好用和实用。

行业的共识在于,通用大模型公司的能力水平再高,最终也要依靠商业化造血,底层通用大模型可能最终仅剩少数玩家,但应用层的创业生态会相对繁荣。

从这点上看,新一轮的AI应用竞赛或许不会出现一家独大的情况,巨头和创业公司都将有机会突围。不过,硅谷掀起的这场席卷全球的科技竞赛,已经呈现出更内卷的态势,这考验着各个玩家的技术实力和赚钱能力,想不被淘汰,只能跑得更快。

作者:王慧莹;编辑:子夜

来源公众号:连线Insight(ID:lxinsight),产业升级创新者的聚集地。

本文由人人都是产品经理合作媒体 @连线Insight 授权发布,未经许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益