真假“长文本”,国产大模型混战

最近一段时间,Kimi实在是太火了,A股和大模型圈都在讨论,连带着大厂也加入了“长文本”的混战。大模型应用千千万,为什么是长文本能率先掀起波澜?基于长文本的特性,又能解决哪些AI应用落地的实际问题呢?本文尝试解答这些问题。

Kimi有多火爆?凭一己之力搅乱A股和大模型圈。

Kimi概念股连日引爆资本市场,多个概念股随之涨停。在一片看好的态势中,谁都想来沾个边,据光锥智能不完全统计,目前,至少有包括读客文化、掌阅科技、万兴科技等在内的十家上市公司发布公告透露正在了解或接入了Kimi 智能助手。

眼看着Kimi的火越烧越旺,大厂也垂涎三尺,连夜加入了大模型“长文本” 的四国大战。

对标月之暗面Kimi 智能助手的200万字参数量,百度文心一言将在下个月开放200万~500万字长文本处理功能,较此前最高2.8万字的文档处理能力提升上百倍;阿里通义千问宣布升级,开放最高1000万字的长文本处理能力;360智脑正在内测500万字,功能正式升级后将入驻360AI浏览器。

四家中国大模型公司把长文本能力“卷”出了新高度。作为参考,目前,大模型最强王者OpenAI的GPT-4 Turbo-128k可处理文本能力约为10万汉字,专攻长本文的Claude3-200K上下文处理能力约为16万汉字。

但同样都是“长”,有人是孙悟空,有人是六耳猕猴。

一位大模型行业的人士向光锥智能表示:“确实有一些公司用RAG(检索增强)来混淆视听。无损的长文本和RAG,两项技术各有优势,也有结合点,但归根到底还是不同的技术……很容易就用‘长本文’来混淆视听。”

“百度、阿里、360,大概率都使用了RAG方案”,该业内人士表示道。

无论是RAG还是长文本,一味地“长”并不能代表所有。如同上一轮,大模型厂商“卷”参数,大模型参数不是越大就越好,文本长度,也不是越长,模型效果就越好。除了上下文长度,记忆能力、推理能力、算力都是共同的决定性因素。(详细观点请参考《卷完参数后,大模型公司又盯上了“长文本”?》一文)

进入2024国产大模型落地元年,大模型应用千千万,为什么是长文本能率先掀起波澜?基于长文本的特性,又能解决哪些AI应用落地的实际问题呢?

一、长文本,真的越长越好吗?

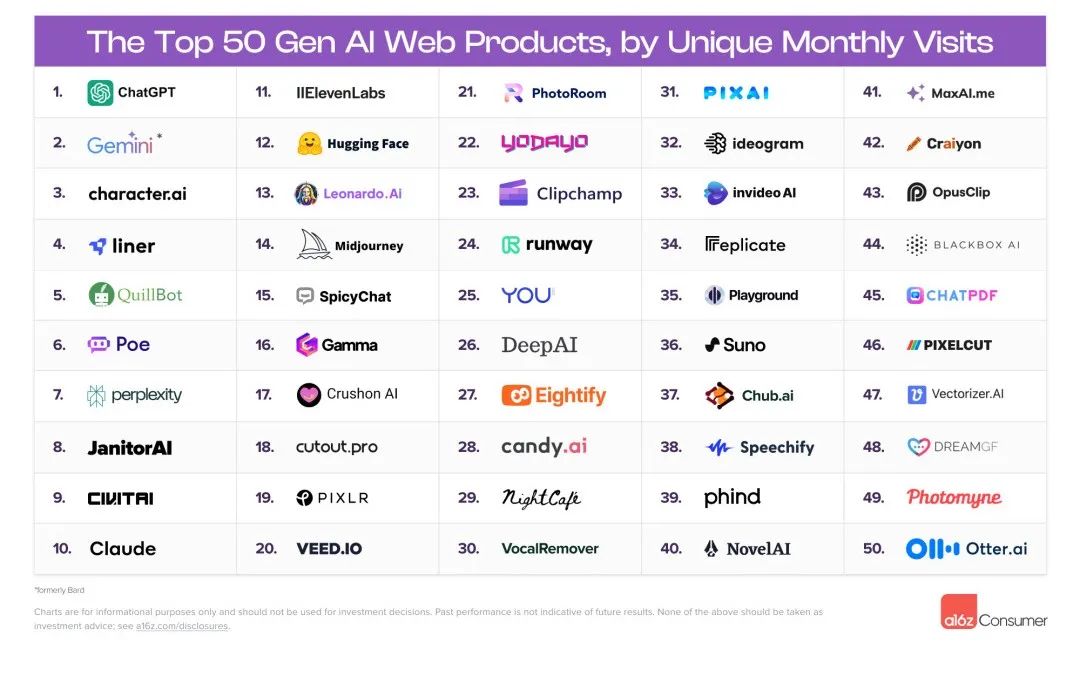

自ChatGPT诞生以来,国外一直在持续不断地涌现出新的AI应用,产生流量的同时,也令人看到了商业化的可能性。

据风险投资公司a16z近期发布的《GenAI 消费应用 Top100 报告》显示,用户月访问量最大的应用网站中,类ChatGPT的效率助手占据了榜单前十的大壁江山,ChatGPT的每月网络访问量接近20亿次,第二名Gemini的每月访问量约为4亿次。

但同样AI应用活跃而繁荣的场景却并没有在中国成功上演。在月之暗面的Kimi 智能助手凭借流量和人气出圈之前,国内能够达到一定体量的应用只有两个,一个是百度推出的文心一言App,另一个是字节跳动推出的豆包。

据相关数据统计,截至2023年9月,百度文心一言App的月活量达到最高峰值710万;同年12月,字节豆包月活达到200万,2024年1月在此基础上翻了一番达到400万。

文心一言凭借百度的大模型先发优势和搜索流量优势,一度成为国内流量最大的AI应用;而豆包背靠抖音流量转化池,虽然发布时间稍晚一步,但在后期实现了反超。

在这样背景之下,Kimi的爆火显得尤为特殊,某种意义上可以说,Kimi是国内第一个靠产品能力和用户自来水破圈的AI应用。

月之暗面创始人杨植麟曾告诉光锥智能,其团队发现正是由于大模型输入长度受限,才造成了许多大模型应用落地的困境,这也是月之暗面聚焦长文本技术的原因所在。

站在用户角度来看,好不好用是检验AI应用产品最关键的指标,而这都依赖于Kimi背后的长文本技术。

若将长文本的能力进一步拆解,大致可以包括长度、记忆、理解、推理几个能力。

越来越长的文本长度,可以进一步提升现在AI应用的可用性和专业性。

对普通用户而言,与AI助手简短的闲聊能够引起兴趣,但不能解决问题,特别对于法律、医学、金融等一些专业领域,需要前期“喂”给大模型特定的数据和知识,才能精准地输出答案;对企业而言,更需要一个“专家型”的助手,大量的企业数据、行业数据都需要提前导入,没有损耗地输入和输出,从而保证最后的分析结果具有可参考性。Claude就是一个典型的例子,凭借长文本的优势与ChatGPT走出不同的路线,收获了大量的2B垂直行业的企业用户。

多轮对话和记忆能力可以直接应用到现在大部分的场景中,比如游戏场景中的NPC,通过长文本输入给予其角色设定,玩家每一次的对话都会被记录,并且能够生成个性化的游戏档案,避免了重新登录而需要反复唤醒的问题;在执行Agent(智能体)任务场景,能够增强记忆能力,辅助Agent形成清晰的行动步骤,避免出现Agent打架的现象。

长文本的理解和推理能力体现在两个方面,一类是对想象类的应用理解生成,一类是对逻辑类应用的生成。例如在对AI小说的应用中,长文本的能力体现在能够理解用户输入的prompt,对其想象性的扩写;在编程、医疗问答等领域,则需要调用其逻辑的推理能力,合理化地续写编程,根据用户描述推理病状。

月之暗面副总裁许欣然曾表示,大模型无损上下文长度的数量级提升,将进一步打开对 AI 应用场景的想象力,包括完整代码库的分析理解、自主完成多步骤复杂任务的智能体Agent、不会遗忘关键信息的终身助理、真正统一架构的多模态模型等。

所以,长文本从来都是一项综合性的能力,而非越长就越好。相反,过分追求长,可能引发算力匮乏的问题。

二、大模型公司卷“投流”,一天获客成本20万

流量狂飙、宕机后五次扩容;日活用户数达百万,月环比增长率107.6%;赶超微信、杀进App Store免费版应用第五名,月之暗面交出了一份漂亮的成绩单。

但这也只是一个开始,多位业内人士在今年刚开年曾向光锥智能透露,走过高速技术迭代的2023年,大模型来到了产业落地和商业化的下半场。

去年,各家已经相继亮剑,智谱、百川、面壁不同程度上都开启了商业化。月之暗面稍慢,目前还未公布商业化的方案,但急切地开始了商业化加速进程,B站、抖音等社交平台都能看到Kimi助手投流的广告。

尽管,各家都从未将2C的变现路线排除在外,但是延续2016年AI 1.0时代的思路,多数还是将2B作为了首要的突破口。有了技术,去找技术和产业落地方向,探索落地方案似乎成为了理所应当。

月之暗面则是大模型公司的另类,去年10月份第一次公开露面后,就瞄准了2C的应用市场。杨植麟曾表示,长文本是月之暗面根技术,在这技术之上可以分裂出不同场景和领域的2C应用。

在Kimi效应爆发前,就有很多普通和企业用户反馈,“Kimi是国内最好的AI助手,没有之一”,从一开始就注重产品效果和用户体验的Kimi,现在爆发似乎带有一定的必然性。

商业化压力之下,大模型公司大概率会选择2B、2C两条腿走路。对比其他大模型公司,月之暗面则又提供了另一种商业化的路径参考,其他玩家从先2B再2C,以2B拉动2C,而月之暗面则属于先2C后2B,再以2C的产品拉动2B的单子。

毕竟,除了国外的ChatGPT,之前在国内根本看不到2C产品增长的案例。Kimi靠近半年的积累,凭一己之力在2C撕开了一道口子,众多大厂或许是看到了2C更多的可能性,才急于下场向市场证明自身具备长文本能力。

但回到商业化赚钱的本质,仍要思考如何将一时的流量转化成实打实的付费率。

光锥智能观察发现,现在大部分的大模型公司在推产品时还是互联网推流的那一套,旧瓶装新酒,抖音、B站、小红书投流推广,在线下的写字楼电梯、机场、地铁打广告。

一通操作下来的实际转化率有多少尚未可知,但为获客花出去的都是真金白银。据新浪科技报道,有投资人透露,目前Kimi用户获客成本达到12元~13元。根据下载量预估,Kimi近一个月来日均下载量为17805。按此计算,Kimi每天的获客成本至少20万元。

现在市面上大部分的AI助手都是免费下载使用,基于网络负外部效应,当用户越来越多的时候,其资源的耗损就越来越大。此次的Kimi宕机事件就是最好的例证,顺时暴涨的用户量给算力和服务器都造成了压力,与之带来的还有大量的token成本的消耗。

对大模型公司而言,规模化、付费率和成本的三方拉扯问题,短时间内无法得到解决,即使是流量吊打其他应用的ChatGPT也面临盈亏平衡的困境。

据data.ai数据显示,截至2023年6月19日,ChatGPT iOS端上线首月的日活付费率约为4.36%。OpenAI预测,对于压缩成本后的GPT-3.5模型和GPT-4模型,若月付费率每月提升0.25%或不能持续;若月付费率每月提升0.5%或能扭亏。

月付费率不断提升听起来很性感,但现实却是“未老先衰”,爆发性的增长还未迎来,增长停滞先一步到来。

对大模型厂商,特别是创业公司来说试错的机会并不多,不能刚从技术的坑出来,又一头扎进投流的坑,跟风长文本不能解决所有问题,跑出商业化模式才是。

作者:郝 鑫

来源公众号:光锥智能(ID:guangzhui-tech),前沿科技,数智经济。

本文由人人都是产品经理合作媒体 @光锥智能 授权发布,未经许可,禁止转载。

题图来自 Pixabay,基于 CC0 协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益