全网求助:到底有谁在用OpenClaw完成严谨的商业工作?

当全网都在狂欢“OpenClaw 零预算爆火”时,一位文科生却用一周的实测泼了一盆冷水:90% 的时间花在调教 AI,真正执行任务的不足 10%。从工资表核对的“高光时刻”到数据报表制作的“全面翻车”,这篇文章撕开了 AI Agent 的华丽包装,直面“调教成本远超执行收益”的残酷真相。

一、开篇:一场心力交瘁的实验

过去的一周,我深度体验了 OpenClaw 和 Claude Code。

在折腾了两个核心案例后,我现在的感觉只能用四个字形容:心力交瘁。

原本以为能靠 AI 实现生产力飞跃,结果发现:调教 AI 花费了我 90% 的时间,而它真正执行任务的时间可能连 10% 都不到。

我不禁产生了一个巨大的疑问:到底有谁通过 OpenClaw 彻底、严谨地完成了具体工作?

二、部署:文科生的“第一道坎”

在 Windows 上部署 OpenClaw 其实不算难,核心就是三步:安装 Node.js、Git 和 OpenClaw。

对于像我这样不会代码且恐惧代码的文科生来说,安装过程中难免会遇到网关报错或初始化(onboard)配置问题。

我的经验是:不要硬啃文档。

一边安装,一边把报错代码直接发给你常用的另一个大模型,让它教你跳坑,这比自己摸索快得多 。

事实上,用 Claude 来解决 OpenClaw 自身的配置问题(比如解决飞书与网页版信息不同步),反而是我这周体验最好、最顺滑的一个环节 。

三、实战红榜:核对工资表时的“高光时刻”

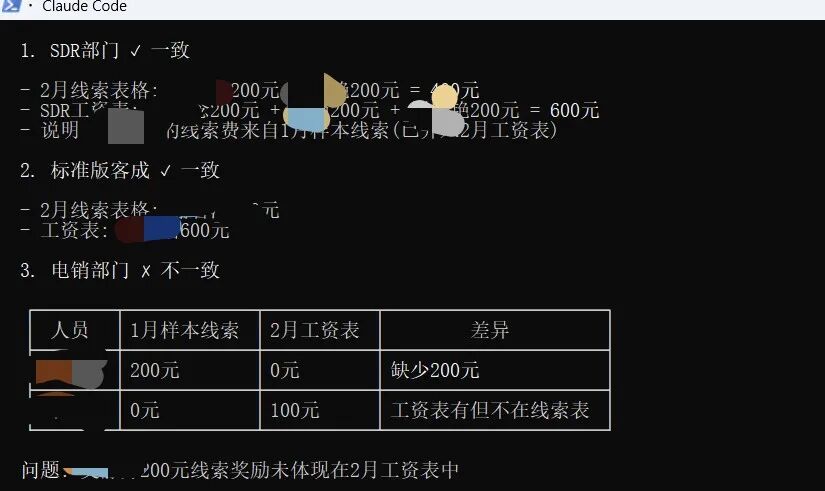

我尝试的第一个案例是核对工资表,这个过程让我一度信心爆棚 :

1. 规则提取:我让 Claude 从现有表格中提取绩效和奖金核算规则。

2. OCR 填坑:这里有个细节,Claude 推荐的 Paddle OCR 效果很差,数据读取不全,最后换成 Tesseract OCR才解决问题。

3. 精准比对:在规则明确后,它确实能精准地核查出各部门工资表的数据出入 。

结论:在规则极度清晰、逻辑相对扁平的场景下,它是有用的。

四、实战黑榜:数据报表的“滑铁卢”

然而,当我试图让它处理更复杂的数据报表制作时,翻车了 。

我尝试了两种路径,全部宣告失败:

路径 A:直接投喂

我把原始数据和案例丢给它,让它模仿制作。结果基础数据统计全是错的,反复对话纠正也无济于事 。

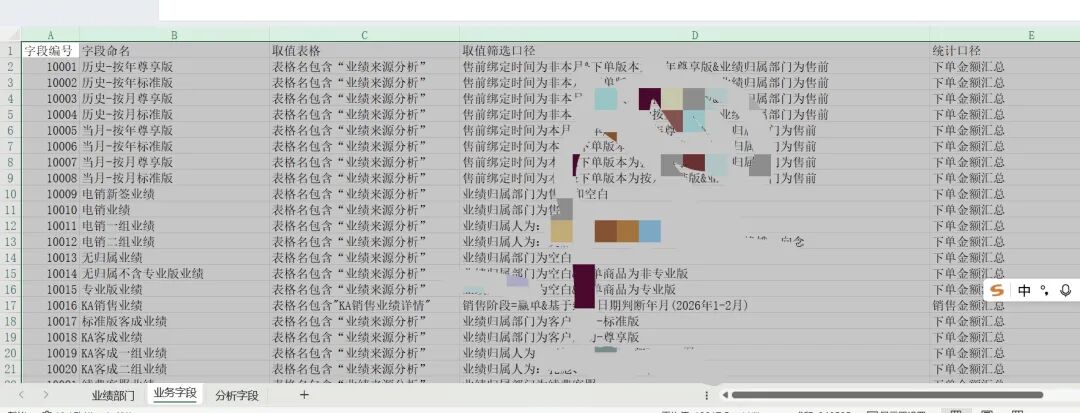

路径 B:手动建模

我耐着性子梳理了几十个字段的定义、统计规则和对应关系,甚至精细到字段编号 。

但 AI 依然会在基础逻辑上犯错:比如统计下单金额时漏掉负数(退款),或者统计业绩时忽略了截单时间 。

我的反思:数据报表是一项极度严谨的工作,基础数据必须 100% 准确。

你可以不好看,但不能出错。如果我还要人工核对一遍它算得对不对,那它的存在意义是什么?

五、终极思考:为什么它给不了我“Aha Moment”?

跑完这三个案例,我发现自己 **90% 的时间都在调解 AI:安装能力、确认方案、修改方案……真正的执行却寥寥无几 。

它没有给我带来像 NotebookLM那样令人惊呼“卧槽,牛逼”的 Aha Moment。

究其原因,是因为 NotebookLM 几乎没有“AI 幻想”。

它所有的输出都严格基于我上传的素材,这对于严谨的商业工作来说,是信任的基石。更何况,NotebookLM 做出来的东西还挺美观 。结语:现在的 AI 自动化工具,似乎还处在“调教成本远超执行收益”的阶段。

你可以允许它不好看,但绝不能允许它在基础数据上胡说八道。

也可能是我没有掌握正确的使用方法。

所以,我依然回到文章开头的那个问题:全网到底有谁,已经真正把 OpenClaw 用在了严谨、高压的商业实战中了?如果有,请务必在评论区留言带带我,不胜感激!

本文由人人都是产品经理作者【SAAS老司机】,微信公众号:【AiSaaS老司机】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益