这家新公司融了 5500 万美元,想让 AI 真正能看懂图片

英伟达押注的 AI 新秀 Elorian 横空出世,5500 万美元种子轮融资背后暗藏怎样的视觉推理革命?这家由 Google Brain 和苹果 AI 核心科学家创立的神秘公司,正试图攻克 AI 看懂图片却无法理解空间关系的终极难题。从机器人路径规划到工程设计意图识别,Elorian 要构建的是一套颠覆性的视觉推理底层能力。

最近出来了一家新公司,叫Elorian。

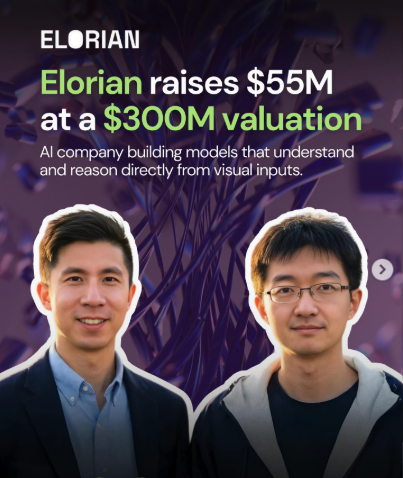

公司刚公开,就拿了5500 万美元种子轮融资,英伟达也是参投方之一。这笔钱在今天的 AI 创业里,也不算小。

更重要的是,这家公司才刚从隐身状态出来,连公开产品都还没有,就已经拿到这么大的种子轮,说明资本看中的不是一个短期热点,而是它瞄准的那个问题。

Elorian 瞄准的问题,可以用一句很简单的话来解释:

现在的 AI 会看图,但很多时候,它做的是识别和描述,不是真正意义上的理解。

如果只是问“图里有什么”,大多数模型已经能答得不错;但如果继续追问物体之间的位置关系、结构关系,或者让它根据画面做进一步判断,难度就会高很多。

Elorian 要做的就是这部分。

01 现在的 AI,为什么还不算真的“看懂图片”

今天的 DeepSeek、ChatGPT、Claude 这一类模型,当然已经会看图了,可以分析图片、理解图表、回答视觉问题。

你给模型一张照片,让它说“图里有一张桌子、一个杯子、一台电脑”,这类任务它通常能完成。

但如果你再问它:

- 杯子离桌边近不近?

- 这个物体到底挡住了后面多少空间?

- 这张工程图里,改哪一块会影响整体结构?

- 机器人应该从什么角度去抓这个杯子才更安全?

这时候,任务就不再是“识别图像内容”,而是要基于图像继续做分析和判断。现在很多模型在这类问题上,能力并不稳定。

OpenAI 自己也公开列过几项限制,包括精确空间定位比较吃力、某些图表线型和颜色变化不容易准确理解、复杂场景下也可能出现描述错误等。

学术评测里,这个问题也已经被反复指出了。

2026 年的 Spatial-DISE 评测,比较了32 个主流视觉语言模型,结论很直接:这些模型和人类之间还存在明显差距,尤其是在多步、多视角的空间推理任务上。

所以,把这件事说得更准确一点,不是“AI 看不懂图片”,而是:

AI 已经会看图,也会说图,但离真正依靠图像去理解结构、关系和约束,还差一段距离。

02 Elorian 在做什么

Elorian 官网最核心的一句话是:“Building the foundation of visual reasoning”。翻成更好懂的话,就是它想做一套真正面向“视觉推理”的基础能力。

不是把图片先翻成一段文字,再按文字来理解,而是让模型直接处理图像里的空间关系、物理约束、设计意图和抽象结构。

这家公司在官网里列出的几个典型方向,基本已经把它想去的场景讲清楚了:

机器人、工程设计、医学与科学、卫星图像、天气监测、灾害响应、精准农业。

这些方向有个共同点:它们都不只是“把图描述出来”就够了。

机器人要理解空间位置和动作路径;

工程设计要理解结构、约束和设计意图;

医学图像要理解组织关系、异常位置和上下文;

卫星图像和灾害响应则要从大规模图像里提取真正有用的判断依据。

所以简单来说,Elorian 的目标可以理解成:

让模型看到一张图之后,不只是复述内容,而是能继续推理。

03 创始团队:顶级华人科学家

Elorian 由两位华人科学家联合创办:

Andrew Dai曾在 Google Brain 和 DeepMind 工作近 14 年,做过 Gemini 相关的预训练与数据工作;

Yinfei Yang 此前是苹果 AI/机器学习团队的首席研究科学家,也在 Google Research 长期做多模态表示、视觉与语言基础模型。

Elorian 现在还没有公开产品,也没有客户名单。这个阶段,投资人看中的,主要就是两件事:团队和切入的问题。

Andrew Dai、Yinfei Yang 这类背景,本身就说明这家公司不是做应用的公司,而是要从底层能力开始做起。

还有一个细节也很能说明它的定位。Elorian 对自己的描述不是“研究实验室”,也不是“AI 应用公司”,而是research and product lab。

也就是说,它不是只想做模型,而是希望把底层的研究能力尽快推到可以进入真实场景的产品里。

04 为什么它一出来就能融这么多钱

Elorian能拿到这么大的钱,原因大概有三层。

第一,团队稀缺。

这类既懂视觉、多模态,又真做过前沿模型的人,本来就不多。市场愿意为这类团队提前下注,不奇怪。

第二,问题够硬。

过去一年,AI 创业里最热的方向很多都在做“更快”、“更高效”。

Elorian 选的是一条相对更难的路:模型对图片的理解能力。这个问题更难,但一旦做出来,能进入的行业会更深。

第三,这条路本来就很烧钱。

这种公司前期不会很快长出一个轻量级的消费产品,它更像是先把底层能力做出来,再进入企业和行业场景。

训练、数据、模型架构、评测体系,全都需要时间和成本。官网自己也说,这轮融资会主要用来加大研发投入,推进视觉推理这条前沿方向。

05 国内相似方向的公司

中国也有相近方向的公司,但路径不太一样。

如果把 Elorian 理解成“专门做视觉推理底层能力”的公司,中国现在更像是分成两条路在做:

一条是从世界模型、视频模型往“理解现实世界”延伸;

另一条是从机器人、具身智能往“看懂环境并做动作”推进。

也就是说,国内更常见的做法,不是单独成立一家“视觉推理公司”,而是把这件事放进世界模型或机器人基础模型里一起做。

和 Elorian 相似(但不同)的国内公司,我觉得有三类。

第一类是生数科技。

这家公司我之前专门单独写过,清华系出身,也是刚拿到20亿人民币的融资。

它和 Elorian 不完全一样,但方向上有重合。生数现在公开讲的是“通用世界模型”,要做对数字世界和物理世界的建模、推理、预测和行动。

底层分成世界生成模型和世界行动模型,它的出发点还是视频和多模态生成,产品层最成熟的是视频生成应用 Vidu。

这和 Elorian 的差别很明显:

Elorian 现在更聚焦“看懂图片、理解结构和关系”;而生数是一家更宽的世界模型公司,视频生成和商业化走得更前。

第二类是北京人形机器人创新中心的 WoW。

这个方向和 Elorian 的底层目标其实更接近。WoW官方的描述是:它不是只让机器“看见”,而是融合了视觉、动作、物理感知和推理,让机器人能理解物理世界。

WoW 的重点不是“图片理解”本身,而是把视觉理解和物理规律、动作执行连起来。

相比 Elorian,WoW 更偏“面向机器人落地的物理世界理解”。

第三类是自变量机器人、智元这类做 VLA / 具身基座模型的公司。

自变量机器人自研的是统一的视觉—语言—动作模型,强调因果推理、空间智能和复杂操作;

智元发布的 GO-1 也不是普通的视觉语言模型,而是把视觉、力觉、语言和动作放到一起,直接输出动作序列。

这类公司的出发点和 Elorian 不一样:它们不是先把“视觉推理”做成一个独立基础层,而是直接面向机器人任务,把感知、理解、决策、动作一起做。

如果从公开进展和商业化看,国内这条线其实走得比 Elorian 更靠前一些。

原因不是底层理论更强,而是国内很多公司一开始就不是只做研究,它们更早把目标放在机器人、视频生成、工业场景和行业项目上,所以更容易展示阶段性成果。

但如果从问题定义看,Elorian 更纯粹:

它要解决的是一个更基础的问题:模型看到图之后,能不能真正理解空间关系、结构关系和约束条件。

作者:张艾拉 公众号:Fun AI Everyday

本文由 @张艾拉 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自作者提供

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益