如何建立人和AI协同工作中的信任?

随着技术的发展,AI这个“聪明的工具”出现了,它不再是简单被操作,具有全新的性质。那我们今天就来聊聊怎样建立人与AI协同中的信任。

一直以来我们都在尝试更多的利用AI算法分担客服的日常工作,比如帮助客服挑选用户喜欢的商品,或是主动回答一些买家问题。

但是在大促复盘后却发现,在客服人员最忙碌的时候,ai相关功能的关闭率反而上升了,很奇怪对吧。我们访谈了一些客服,收集了一些比较共性的声音,“不是自己配置的,不放心” “有时候发错,耽误事” ,诸如此类。

看得出来客服不太信任这些有AI介入的功能,所以今天我们就来聊聊怎样建立人与AI协同中的信任。

Part 1:为什么人与AI的信任关系这么重要?

随着技术的发展,AI这个“聪明的工具”出现了,它不再是简单被操作,具有全新的性质。

1. 【黑盒性】工作原理不再能被简单理解

ai这个“工具”的工作原理正在变为黑盒,和普通应用软件直观的输入-输出过程相比,普通人越来越难以真正明白AI在“想什么”。

下图是卷积神经网络系统原理图,常用在自然语言处理中,我也看不懂,放这儿意思意思。

2. 【平等性】在合作中的地位逐渐提升

传统的工作流是以人为主,操作“工具”为辅。但随着ai的能力提升,让人和“工具”更接近平等的合作伙伴,双方都互有诉求。

3. 【渗透性】全方位的介入日常工作生活

普通的一天:起床,用siri查询天气。出门,用地图app查看路线。回家,网站根推荐视频和游戏。AI以生活助理,路线规划,内容推荐,玩伴等各种方式,越来越多的融入我们的日常,成为不可缺少的重要一环

面对这个看不透又离不开的伙伴,信任就变得前所未有的重要。

Part 2:怎样建立和强化信任?

从信任的产生机制入手,因不同的产生原因,信任可以分为三种:

(1)威慑性信任:通过惩罚类的手段强制各参与方产生信任的机制

常见案例:商业合同,基于法律的权威让签署双方互相信任。

(2)技术性信任:通过技术手段使各参与方产生信任的机制

常见案例:大众点评,通过第三方(老顾客)提供的信息,帮助新顾客和店铺互相信任。

(3)了解性信任:基于参与各方之间深入的了解而产生信任的机制

常见案例: 社区无人小店,基于邻里之间的深入了解(如工作单位)而产生的自助商业模式。

在实际情况中,由于威慑性和技术性信任都是基于客观共识,所以起效速度快,可以用来快速建立信任。了解性信任需要大量信息和个人判断,只能逐渐起效,但是对比前两种信任,信任程度会更深,所以可以在后续过程中使用。

Part 3:实践落地

总结以往的案例,会发现技术性和了解性信任相结合的手段效果通常不错。他们起效时间互补,信任程度还能不断加深。而威慑性信任,想什么呢,还想威慑用户不成?

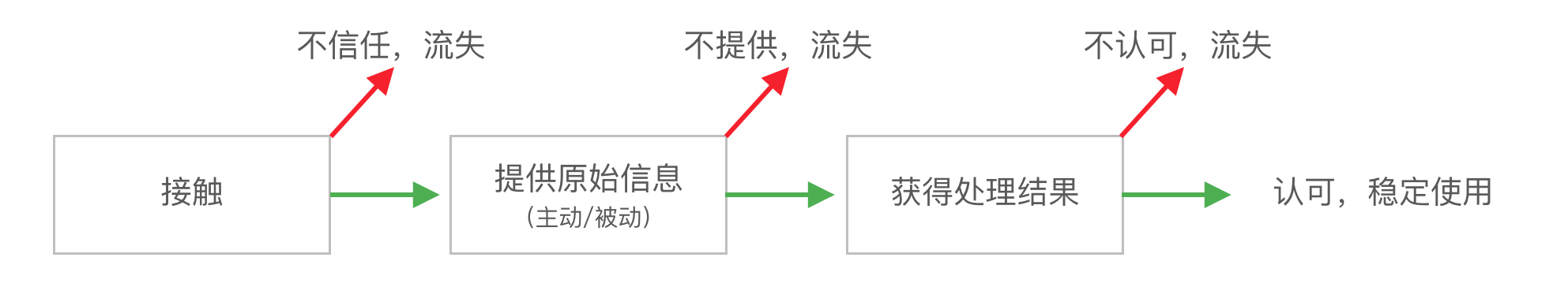

常见的人-AI的交互过程大致可分成“接触—提供原始信息—获得处理结果”3个节点:

我们总结了各个节点中,一些常用的提升信任感的设计技巧,在下文中结合案例进行说明。

节点1. 接触

在这个节点,用户面对陌生的ai工具,常常仅凭第一印象决定是否尝试,为了让用户快速形成正向认知。

常见的可以采用以下几个手段:

1.1 合理使用第三方评价/成功案例等手段,快速建立可信的第一印象

这个很好理解,有第三方背书的产品总是看起来靠谱一些,毕竟有先行者探路,只要跟着用就好了。

DO:晓多客服机器人的案例中,通过行业龙头和政府客户的案例,给浏览者快速建立了可信,可靠的印象。

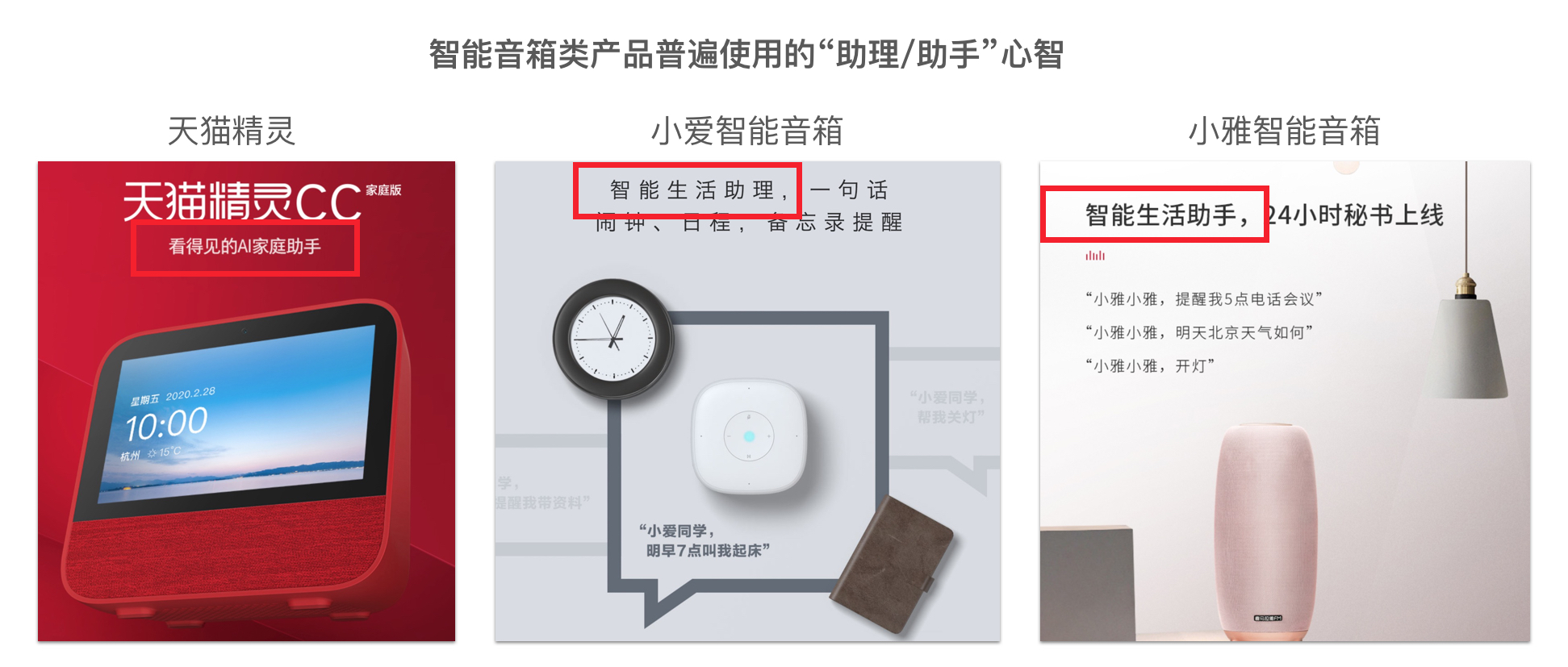

1.2 借助相似的现有认知,帮助用户了解AI

介绍一个完全陌生的对象通常比较困难,而如果合理借用现有认知,则可以相对容易一些,例如家具广告使用“家具中的劳斯莱斯”这样的说辞,借用用户对劳斯莱斯品牌的固有认知,来传达自己产品的高级感。

DO:常见的助理类AI,通常借用“家庭助手”“生活助理”“专属秘书”这样的现有心智,快速传达本身全能,聪明,可靠的能力预期。

1.3 介绍AI的能力而非技术

复杂先进的技术让AI有能力完成日常任务,但是在用户看来,技术深涩且没有感染力,理解困难,并非核心关注点,如果一味的介绍技术,用户很容易失去兴趣。

DO:Google Assistant的官网首页,借用生活中常见的场景让用户快速明确的了解AI能力,而背后复杂的IOT,语音识别,近远场声音捕捉等技术等都被隐藏了起来。

DONT:相比之下,天猫精灵的官网首页做了大量的性能数据列举,用户对产品能力了解不够,感染力就弱了很多。

1.4 让用户了解ai的真实能力边界和影响范围,建立合理预期

现有技术条件下,AI的真实能力有限,一味夸大会让用户建立过高的预期,最终在使用过程中流失,因此,需要让用户了解AI的真实能力边界,在部分严谨的使用场景中,这一点尤其重要。

节点2. 主动/被动的提供原始信息

在这个节点,需要用户主动或被动的提供原始信息以进行后续加工,为了让用户放心,情愿的提供数据,可以采用以下手段:

2.1 说明数据来源和去向,增加ai的透明度和可信度

当希望用户提供信息时,可以通过解释数据来源,可能的用处等,增加AI的透明度和可信度,例如我们需要用户提供地理位置,搜索记录等隐私信息时,就需要着重说明对这些信息的保护措施,打消用户的顾虑。进一步也可以引导用户提供更多的信息,带来更优质的结果。

2.2 阐述对原始信息的要求,增加用户使用的成功率

AI对原始信息通常有一定要求,如语音信息需尽量避免方言,采用常规语法,地理位置信息要求相当的精度。让用户了解这些隐藏的要求,能够很大程度增加用户使用的成功率。

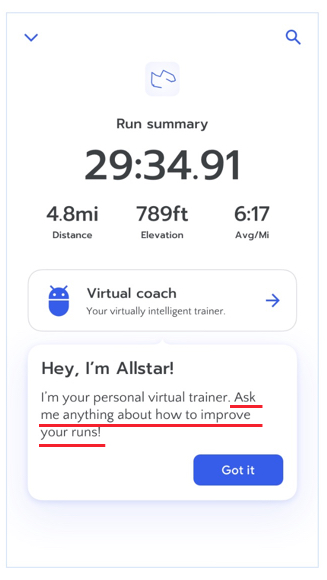

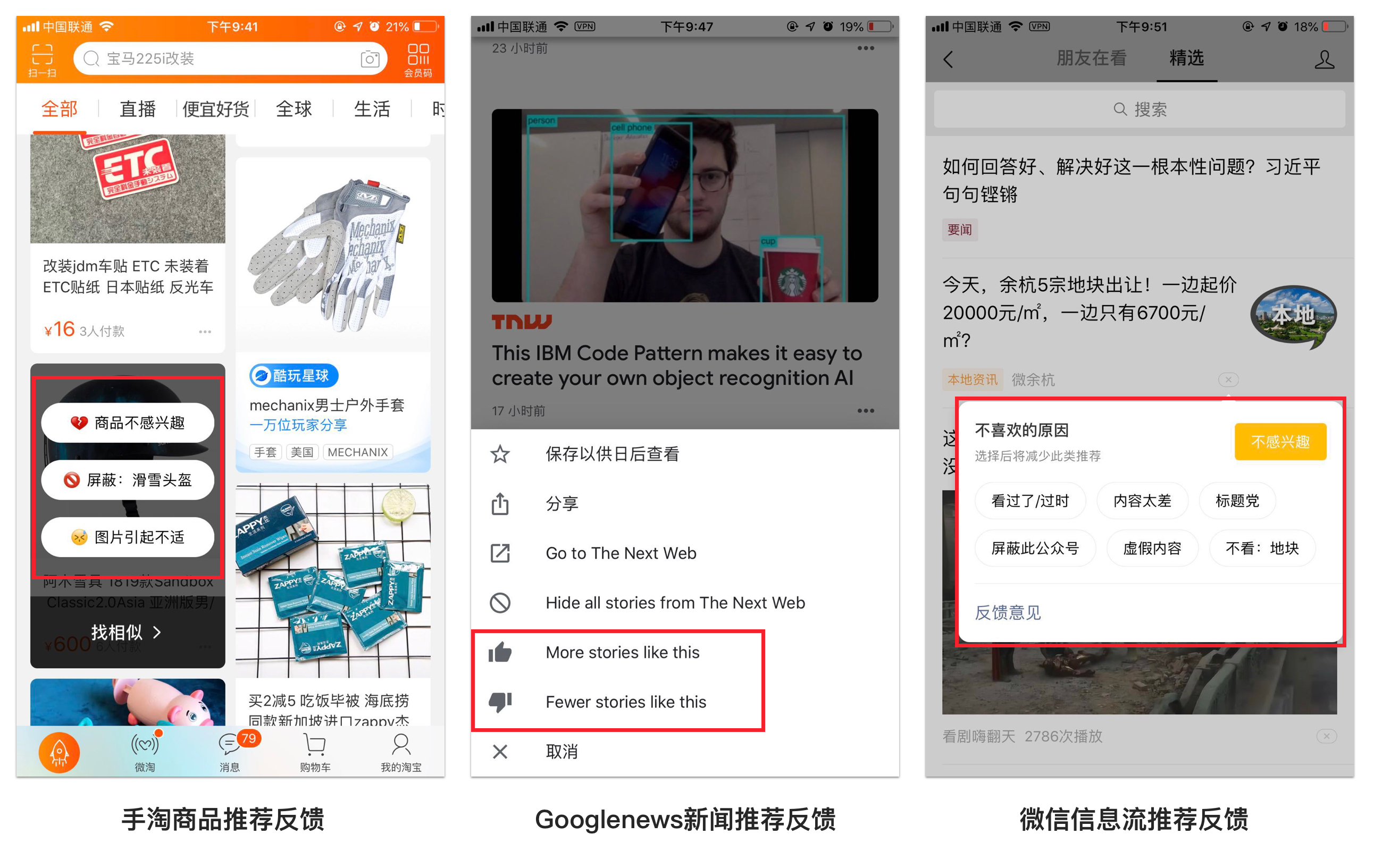

当下chatbot的能力还无法支持用户天马行空的提问和千奇百怪的问法,为了保证较好的使用效果,可以主动引导用户在固定范围内,使用规范问法提问。

DO:Siri主动引导用户学习chatbot的问题/问法。

DONT:让用户随意提问,但实际上无法应对,实际使用体感较差。

节点3. 获得处理结果

在这个节点,用户获得了经ai加工后的数据结果,可以使用以下手段,提升用户对结果的接纳度。

3.1 简述运作原理,让用户了解其行为和处理结果的关系

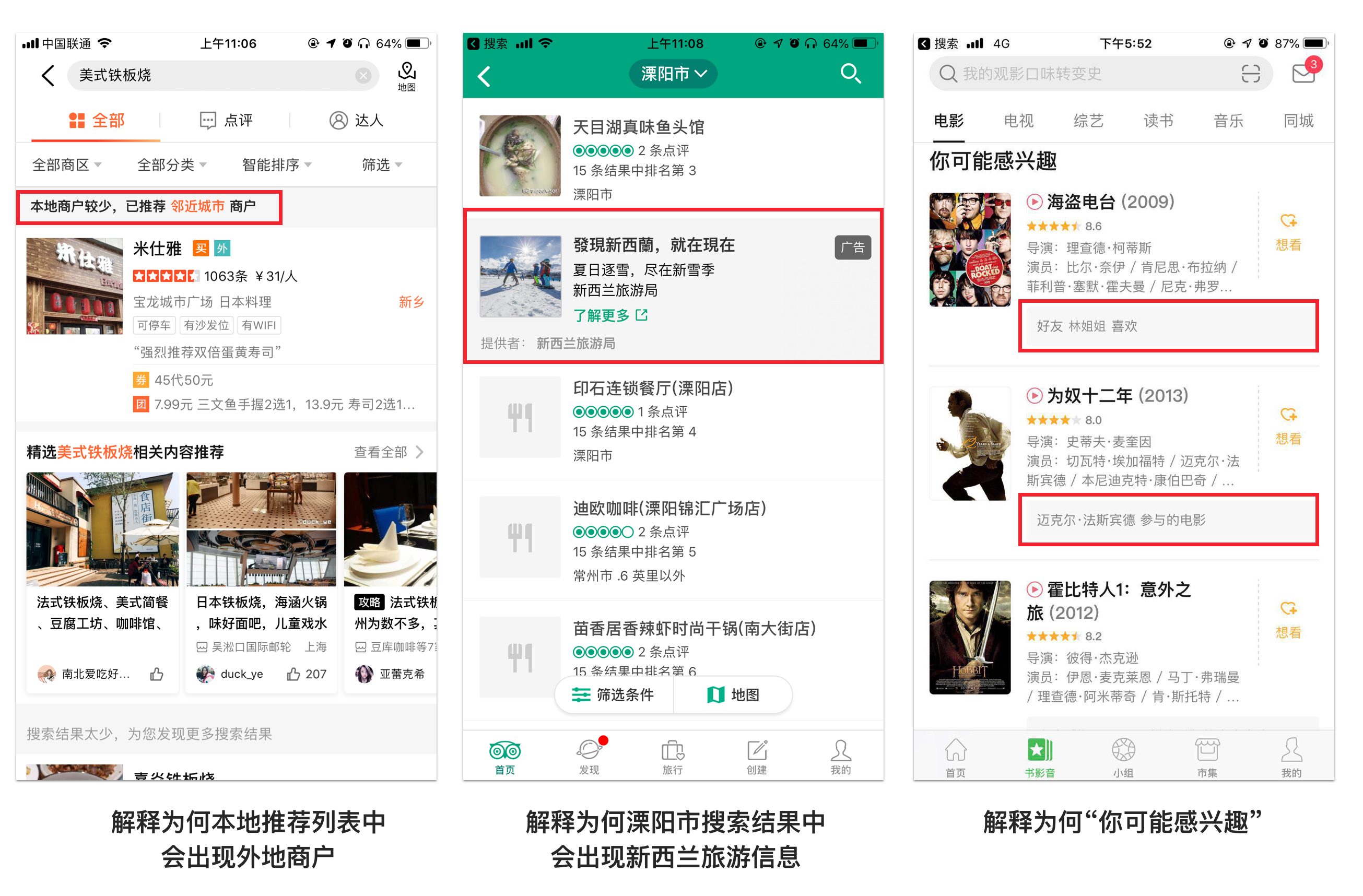

让用户尽量了解系统的工作原理,在用户操作后进行解释是最好的时机。无论AI的处理结果是否和用户预期一致,解释“为什么”都能够更容易的获取用户的信任。

Do:各类搜索结果,通常都会包含一定程度的解释。

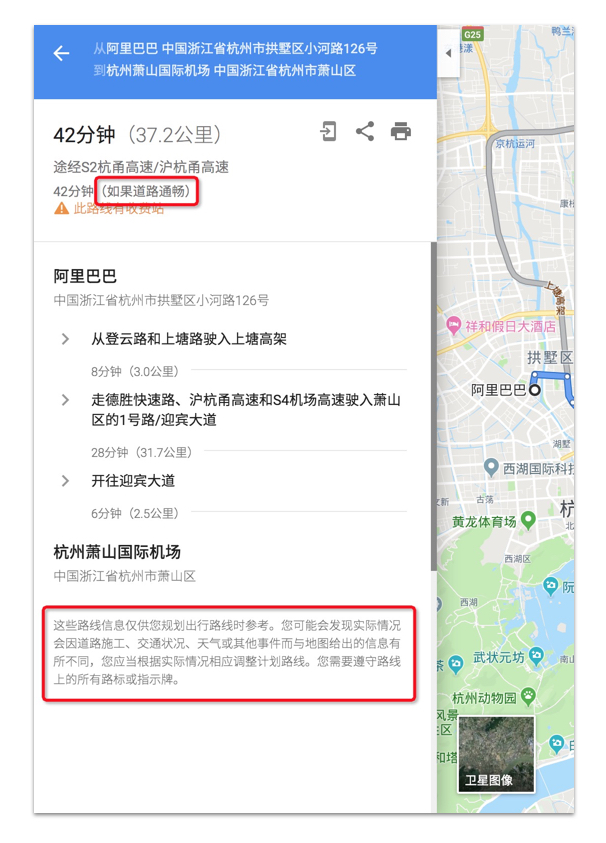

3.2 提示可能包含的偶发风险

当场景比较特殊时,需要明确ai的限制性,并且向用户作出解释。

Do:在路线规划的场景中,由于路况信息复杂,信息获取受限,需要提示用户考虑偶发情况。

3.3 提供优化处理结果的方式

因为现阶段的各种限制,ai输出的结果往往不尽如人意,若长期无法优化,就会失去用户的信任,最终流失。为了解决这一问题,可以尝试让用户了解其可以通过某种途径逐渐优化结果,保持信任

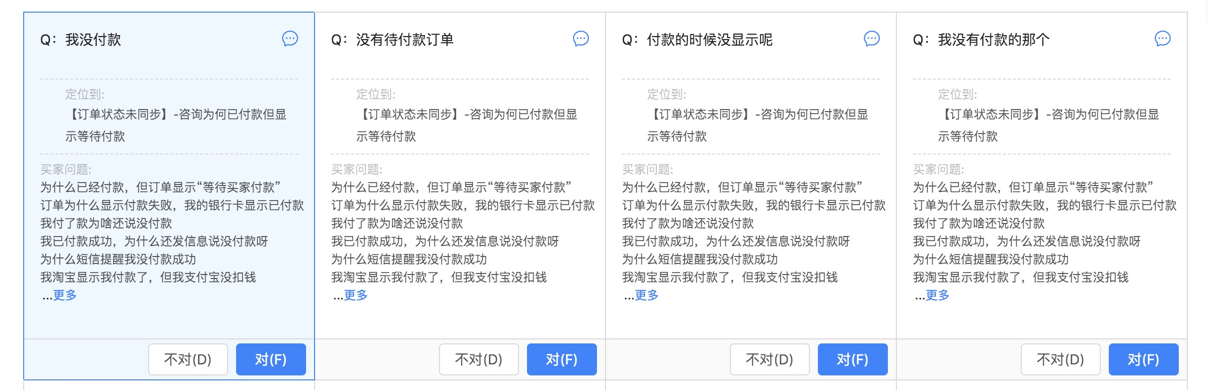

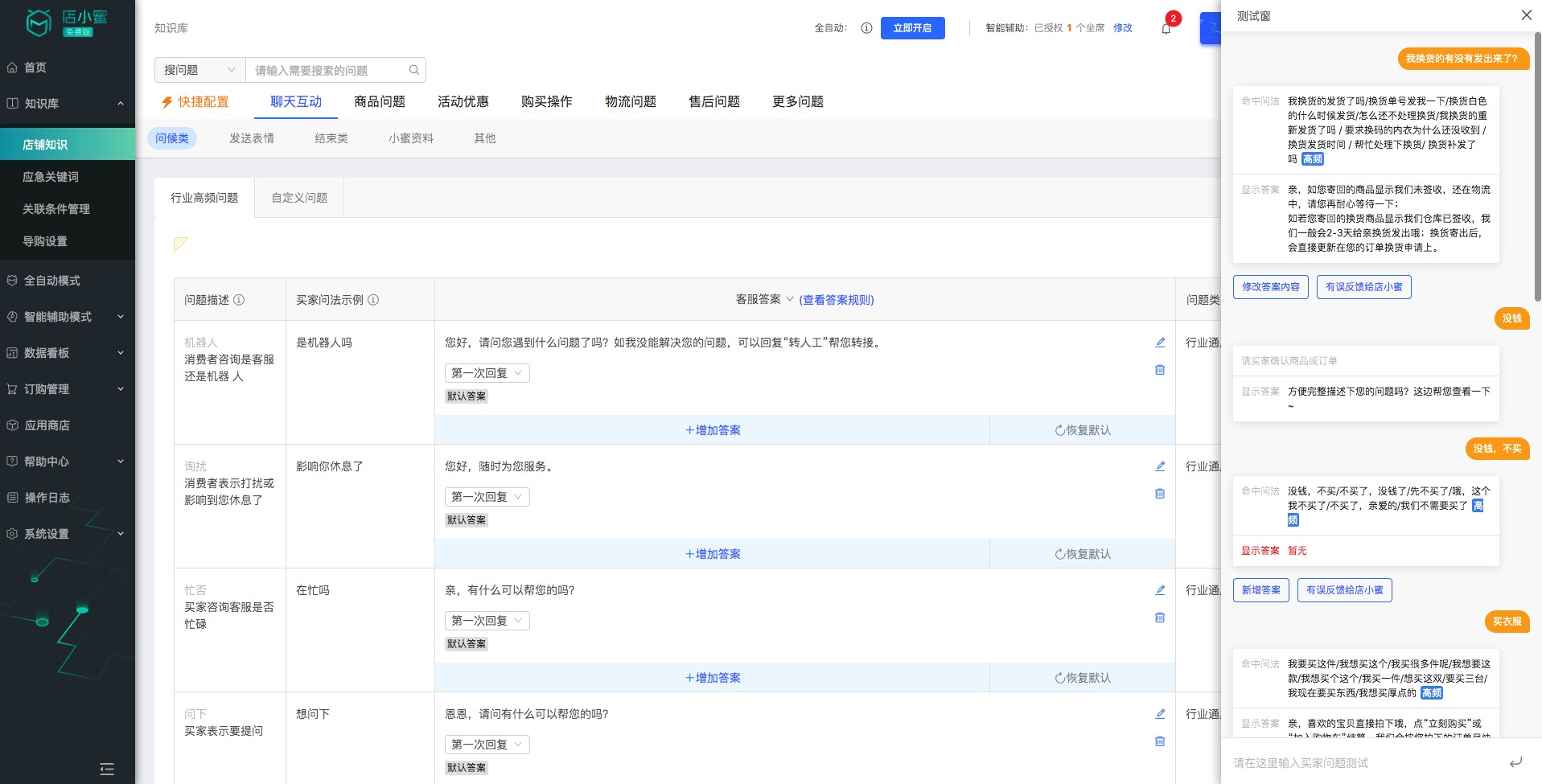

Do:某chatbot,管理员可以在后台主动优化答案。

Do:推荐算法通过“喜欢” “不喜欢”,用户能主动参与答案优化。

Do:配置ai对话能力时,用户能够主动测试并优化回答。

写在后面

通过以上这些手段,可以帮助人和ai之间建立相对稳固的信任关系。但是在实际设计过程中,也要注意整体节奏的把控,一次性要求用户彻底的信任常常适得其反,引导用户逐步提升信任度会是比较稳妥的方式。

本文由 @闲邻张 原创发布于人人都是产品经理。未经许可,禁止转载

题图来自Unsplash,基于CC0协议

起点课堂会员权益

起点课堂会员权益

666

简直是及时雨,正想找人与机器产生信任相关的资料呢