座舱大模型:除了讲笑话,它还能干点正事吗?

今年繁忙的春节返乡路上,你还在通过“你好,小爱同学”来机械地调低两度空调,或者听它讲一个干瘪的冷笑话,那么你的车快落后了。

在刚刚过去的 2026 CES展,行业达成了一个心照不宣的共识:座舱大模型的“聊天室”时代正式终结,Agent(智能体)化的“执行时代”已经全面降临。今天的核心议题是:当大模型拥有了座舱底层的“操作权限”,它究竟能为我们解决哪些真实的物理世界问题?

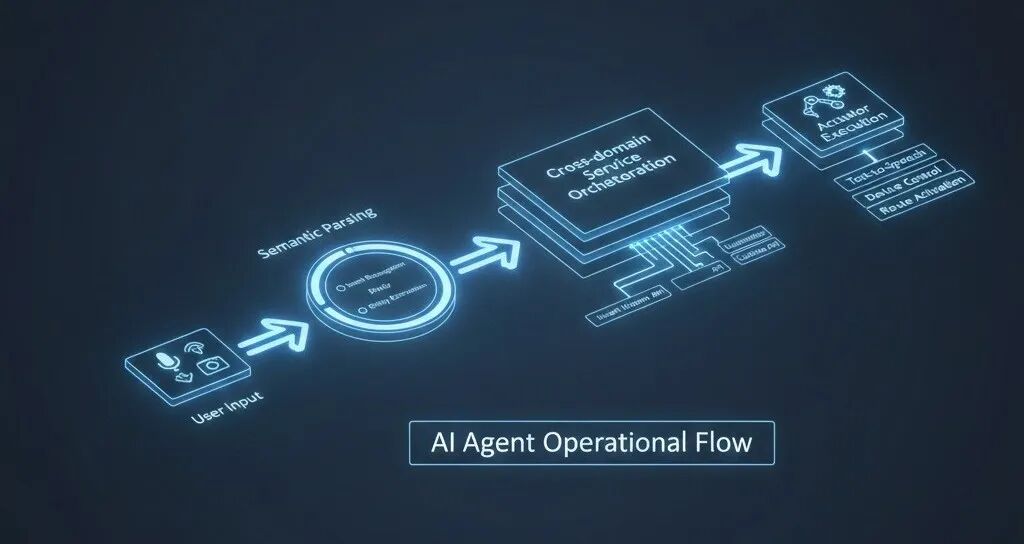

语义转向执行:从“听得懂”到“办得成”

三年前,我们衡量座舱大模型的标准是“语义识别准确率”;现如今,我们的衡量标准是“动作成功率(Action Success Rate)”。

技术演进:从 NLP 到 VLA

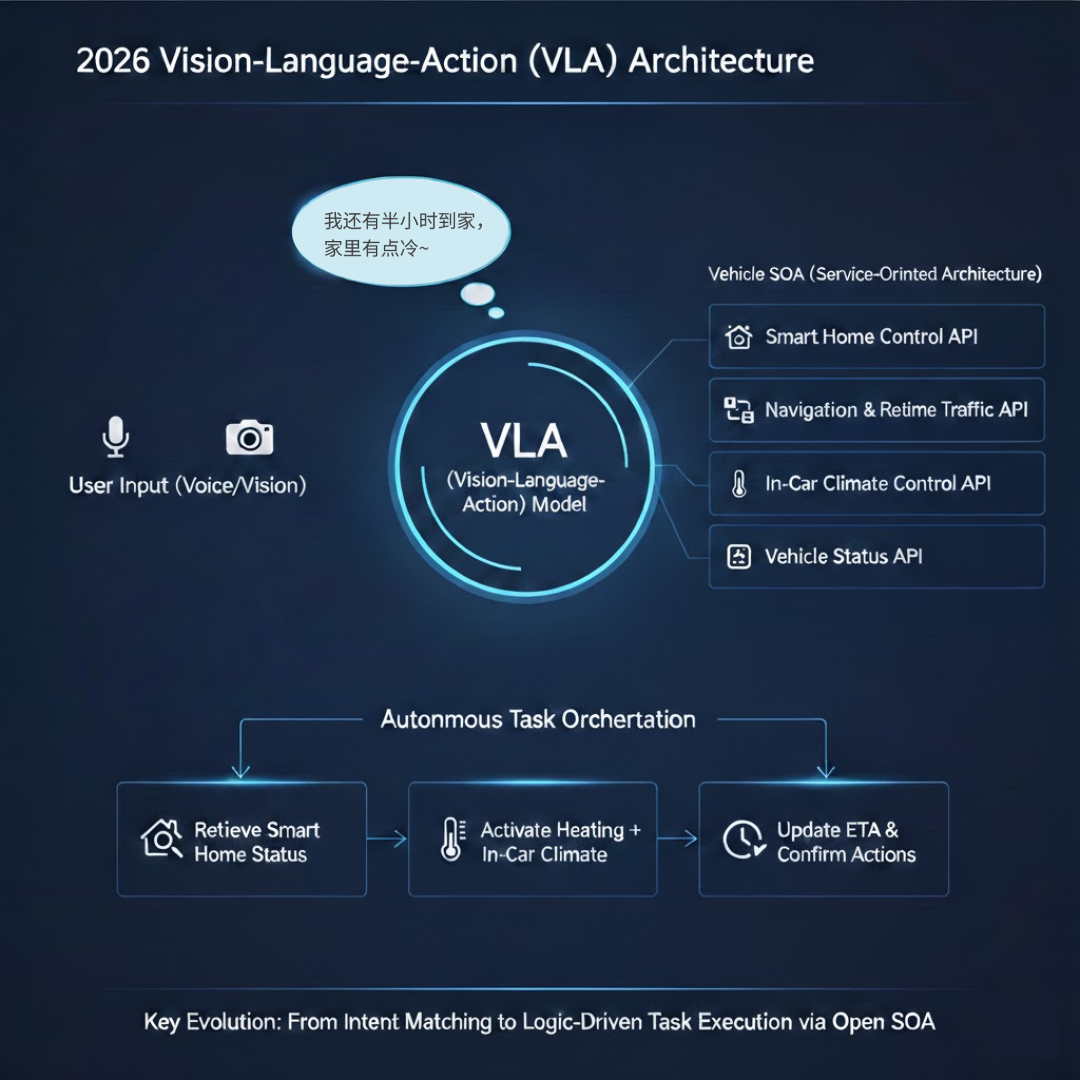

传统的座舱交互是基于“意图匹配”,模型在封闭的指令集里找答案。而最新的领先架构(基于VLA 视觉-语言-动作模型的座舱系统)实现了逻辑自洽的任务编排。

案例:当你对车说“我还有半小时到家,家里有点冷”,Agent 不再是复读你的话,它会自主串联三个动作:1-检索智能家居 App 状态;2-启动家庭地暖;3-根据实时路况反馈预计到达时间并开启车内恒温。

底层支撑:这得益于车载SOA(面向服务的架构)的全面开放。大模型通过调用原子化的服务接口,实现了从“文本生成”到“指令执行”的闭环。

任务编排(Orchestration):座舱“数字管家”

行业趋势,座舱 Agent 的核心价值在于处理“长路径、非标场景”。

硬核逻辑:端云协同的算力分配

根据 2026 年智舱白皮书,主流车机的 NPU 算力已突破48 TOPS。这使得大部分日常交互可以在本地完成,而复杂的任务编排则通过云端完成。

- 多智能体协作(Multi-Agent):现在的座舱内往往运行着多个子 Agent。导航 Agent 负责路径规划,能源 Agent 负责寻找充电桩,生活 Agent 负责餐厅预订。

- 博弈与决策:比如在“边充电边吃火锅”的复杂需求下,Agent 会基于时效性与能源损耗进行多维度权衡。它会告诉你:“建议去 3 公里外的充电站,那里有你喜欢的品牌,且充电位无需排队。”

主动服务:大模型如何学会“察言观色”

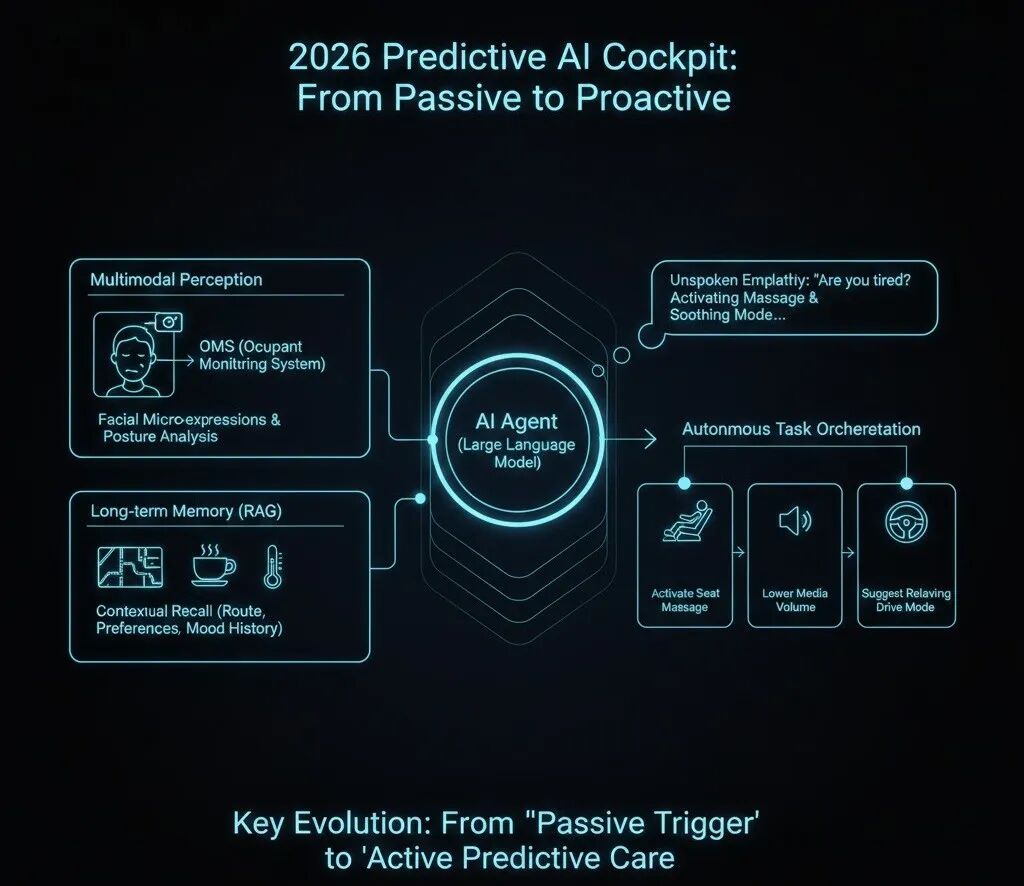

如果 Agent 只是被动等待指令,那它依然是工具。2026 年的突破在于“被动触发”向“主动预测”的范式转移。

感知层面的“多模态”集成

- OMS(乘员监测)与大模型融合:2026 年的车内摄像头不再只是监控疲劳。大模型通过分析你的面部微表情和坐姿,判断你是否处于焦虑或疲惫状态。

- 上下文记忆(Long-term Memory):基于 RAG(检索增强生成)技术,座舱 Agent 记住了你去年的返乡路线、你常喝的咖啡品牌,甚至你对空调温度的敏感度。

产品思考:

当 Agent 发现你在驾驶位上频繁调整坐姿并叹气时,它会自动开启座椅按摩并调低媒体音量,询问是否需要切换到更舒缓的智驾模式。这种“无声的体贴”,才是大模型在座舱里真正的“正事”。

隐私与算力:为什么“端侧推理”是安全底线?

在 2026 年,如果一家车企还把所有的座舱语音上传云端,那么它在市场上将彻底失去公信力。

- 100% 本地化:随着DeepSeek-MoE等高效架构的迭代,2026 年的主流车型已能实现 7B 参数模型在车机 NPU 上的全量本地运行。

- 数据不出车:个人习惯、家庭住址、情绪数据全部锁死在本地加密空间。大模型只在本地进化,只为你一个人服务。

3点建议

- 不要过度拟人化,要过度工具化:不在乎你的 AI 声音有多像真人,他们在乎的是它能不能一次性把那该死的洗车预约办好。

- 关注“非确定性”边界:Agent 也有“幻觉”。作为 PM,必须设计好Human-in-the-loop(人工回环)机制,特别是在涉及转账或车辆物理操作时。

- 算力不是唯一指标,吞吐量才是:别只吹 TOPS,看模型的Tokens per Second。在时速 120 公里时,0.5秒的延迟可能就是生与死的距离。

结语

2026 年智能座舱,正在从“硬件的堆砌”演变为“智力的容器”。

大模型正在完成它在汽车里的第二次进化:从一个只会讲俏皮话的“数字宠物”,变成了一个拥有双手(SOA 接口)和眼睛(多模态感知)的“副驾驶”。

如果你还在为大模型能写诗而欢呼,请抬头看看——你的爱车已经开始帮你处理这一路的风霜雨雪了。

本文由 @OpenAIer 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Pexels,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益