Harness Engineering:人与AI的协作范式转变

从Prompt Engineering到Harness Engineering,AI协作范式正在经历革命性转变。本文深度解析了随着模型能力提升而演化出的三种协作模式,并引入管理学中的情境领导理论,揭示人与AI关系从微观管理到制度化授权的演进路径。在AI自主性不断增强的当下,人类将面临从执行者向意图设定者的角色转型,这既是挑战也是解放。

自2022年底ChatGPT掀起这一轮席卷全球的AI浪潮开始,“人如何使用AI”(或站在当下看:“人如何与AI协作”)一直是一个核心议题。本文尝试从另一个视角探讨——人与AI的协作范式转变,与模型本身能力发展的关系,以及未来新范式的可能性。

从Prompt到Context再到Harness

AI这几年的发展可以说是日新月异,可能并没有机会在过程中形成固定的规则或模式。但在AI的主流应用领域中,我们还是可以观察到一个大致的范式转换过程。

第一阶段:Prompt Engineering(提示词工程)

在2022年底至2024年初,所有主流的”AI教程”都会着重讲解所谓Prompt Engineering(提示词工程)的概念。这个阶段提出的各种技巧(角色扮演、Few-shot、Step-by-step等等)都致力于创建一个”完美指令”,从而一次性让模型输出最佳结果。

在这个阶段,用户实际上仍是整个工作的”绝对掌控者”,而模型只是基于单条指令完成任务的被动执行者。模型没有记忆、没有工具,每一次交互都是独立的条件概率生成。

第二阶段:Context Engineering(上下文工程)

在2024年至2025年初,基于模型上下文窗口的普遍扩充(从4K到128K/200K tokens)以及AI工程化的落地,业内开始形成Context Engineering(上下文工程)的共识。相较于研究提示词如何”遣词造句”,行业开始探索如何以系统性框架(RAG知识库、系统提示词、Memory记忆系统、工具调用接口),根据业务场景动态地为模型构建信息环境。

此时模型获得了有限的”自由”:用户从“直接发号施令者”转变为“情境构建者”——负责判断当前情况,提供信息与资源;而模型则在给定的上下文环境中,自行判断如何应对用户诉求。协作重心从“优化输入”转向了“配置环境”。

第三阶段:Harness Engineering(驾驭工程)

自2025年初至今,随着模型能力进一步提升(特别是Claude 4.6、GPT-5.4 Codex、Gemini 3.1 Pro等具备深度Agentic能力的模型成熟),新的范式被提出——Harness Engineering(Harness意为”马具/缰绳”,可译为”驾驭工程”或”约束工程”)。

在这个新范式中,提示词写作技巧与上下文内容依然存在,但已不再是核心。AI应用的搭建开始关注:

- 授权模型访问必要的工具与数据(如OpenClaw的Skill Hub技能市场);

- 框定运转边界(Guardrails护栏、权限分级、Docker沙箱隔离);

- 建立自主运转机制(如OpenClaw的Heartbeat心跳机制——每15-30分钟自主唤醒执行任务,无需人工触发);

- 设定验收目标与自我调整机制(Evals评估、Control Loops控制循环)。

我们可以看到以OpenClaw为代表的一类自主长任务Agent框架在2026年初开始流行:它支持本地化部署,通过Gateway连接Telegram/WhatsApp/Slack等消息平台,在设定目标后几乎不需要用户的逐步指挥,而是按照”工作-验证”的循环自主运转直至目标达成。用户的重点不再是”告诉AI该如何做”,而是”告诉它该做什么,并设定行为边界与检查点”。

AI协作中的”情境领导”?

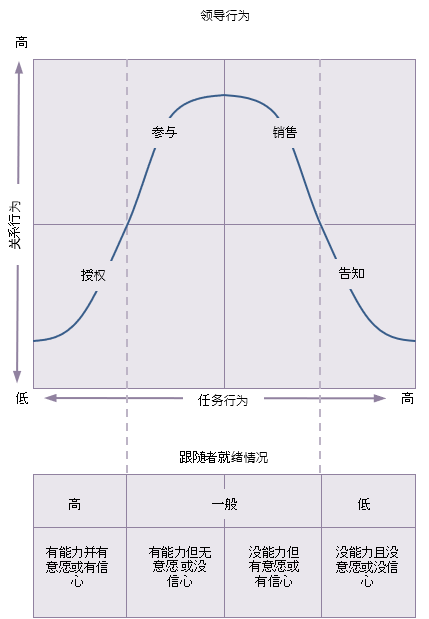

管理学中的情境领导理论(Situational Leadership Theory,由Hersey与Blanchard提出)认为,应根据下属的”准备度”(Readiness)选择不同的管理风格。该理论将员工分为四个阶段,对应四种管理风格:

- S1:指令(Telling)——对应低能力且低意愿的员工。单向沟通,直接告知如何执行。

- S2:教练(Selling)——对应低能力但有意愿的员工。双向沟通,解释决策并鼓励接受。

- S3:支持(Participating)——对应高能力但低意愿的员工。分享决策,注重支持而非指导。

- S4:授权(Delegating)——对应高能力且高意愿的员工。授权执行,保留监督职责。

从这个视角再看AI协作范式的转换,我们会看到一个明显的对应关系——尽管AI没有人类意义上的”意愿”(动机/情绪),但模型能力决定了它能否进行长时间自主活动(即”代理性”或”积极性”的强弱)。

- 低能力、低自主性阶段(S1):对应Prompt Engineering。初期模型(如早期GPT-3.5)无法受信赖地解决复杂问题,且倾向于在单轮对话中快速结束任务。“指令模式”恰如”告知型管理”——人必须事无巨细地指导AI的每一步。

- 高能力、低自主性阶段(S3):对应Context Engineering。中期模型(如GPT-4、Claude 3.5)能力显著提升(能准确理解、推理),但缺乏自主规划与主动探索的倾向(不会自行制定计划、调用工具)。此时人需要提供情境支持(资源、信息、工具),正如”支持型管理”——给足条件,让AI在短程任务中发挥能力。

- 高能力、高自主性阶段(S4):对应Harness Engineering。当前模型(Claude 4.6、GPT-5.4、Gemini 3.1 Pro)表现出Agentic特质(主动规划、自主学习工具使用、通过Heartbeat机制持续执行任务),成长为”高能力且高自主性”的数字员工。”授权模式”成为必然——人负责设定目标与边界(Harness),AI负责在边界内自主执行长程任务(如OpenClaw的24/7自主运转)。

由此,我们实际上看到了一种”AI情境协作”的演进路径:从微观管理(Micro-management)到情境赋能(Empowerment),再到制度化授权(Governed Delegation)。

完全自主的Agent?人的意义何在?

从上文的分析可见,人与模型协作的范式,事实上与模型本身能力的发展强耦合。那么,如果模型再进一步发展——如果我们获得了能够超长程完成抽象目标的模型,人该如何与AI协作?人在工作场景中还有存在的价值吗?

我认为,人最终在整个工作链路中的唯一价值,可能只有“意图”(Intention)或者“动机”(Motivation)。

至少在目前的发展中,模型实际上被训练为一个缺乏内在动机的”工具”。不论它表现得多么智能(如OpenClaw可以24/7自主检查邮件、执行代码、管理文件),一个模型被部署后,若没有任何外部目标注入(通过Prompt或任务触发),它不会自行运转,也不会”想要”做什么。这意味着,即便一个”无所不能”的模型出现,在没有外部意图注入时,它倾向于什么都不做。

那么,至少在人类主导的市场逻辑没有崩溃之前,人还是要作为那个产生动机、设定目标的角色。最终,一切工作或商业活动将出现从“实现为瓶颈”(How to do)向“意图为瓶颈”(What to do & Why)的转变。所有工作本质上都将变成创造性工作——洞察需求、设定目标、验收结果。

乐观地看,在这个设想中,人不会被直接取代;但残酷的是,这种模式的转变还是会毁灭大多数人的生存逻辑——特别是那些穷其一生磨练单一技能到顶峰的人。某种意义上,这是终极的颠覆;但更大意义上,这是终极的解放——人将被迫(或得以)从”手段”回归”目的”。

因此,站在这个时代,我的建议是:学习如何使用AI固然重要,但更重要的是剥离全部物化的标签,探寻自我,探寻他人,拥抱纯粹的创作与劳动。

记住,人是目的,不是手段!

(本文事实核查、资料搜集及最终文字润色由Kimi agent完成,列为共同作者)

本文由 @范佳玉 原创发布于人人都是产品经理,未经作者许可,禁止转载。

题图来自Unsplash,基于CC0协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益