从爆火“小龙虾🦞”OpenClaw安全危机中提炼AI Agent产品铁律(附8条自检清单)

OpenClaw的爆火与危机,揭示了AI产品从对话到执行的范式跃迁。这款赋予AI系统管理员权限的工具,以惊人增速席卷市场,却因安全漏洞与恶意插件陷入信任危机。本文将从用户需求、产品架构、商业模式等维度,深度拆解这场技术狂欢背后的产品逻辑,为AI产品经理提供一套可控优先的设计框架。

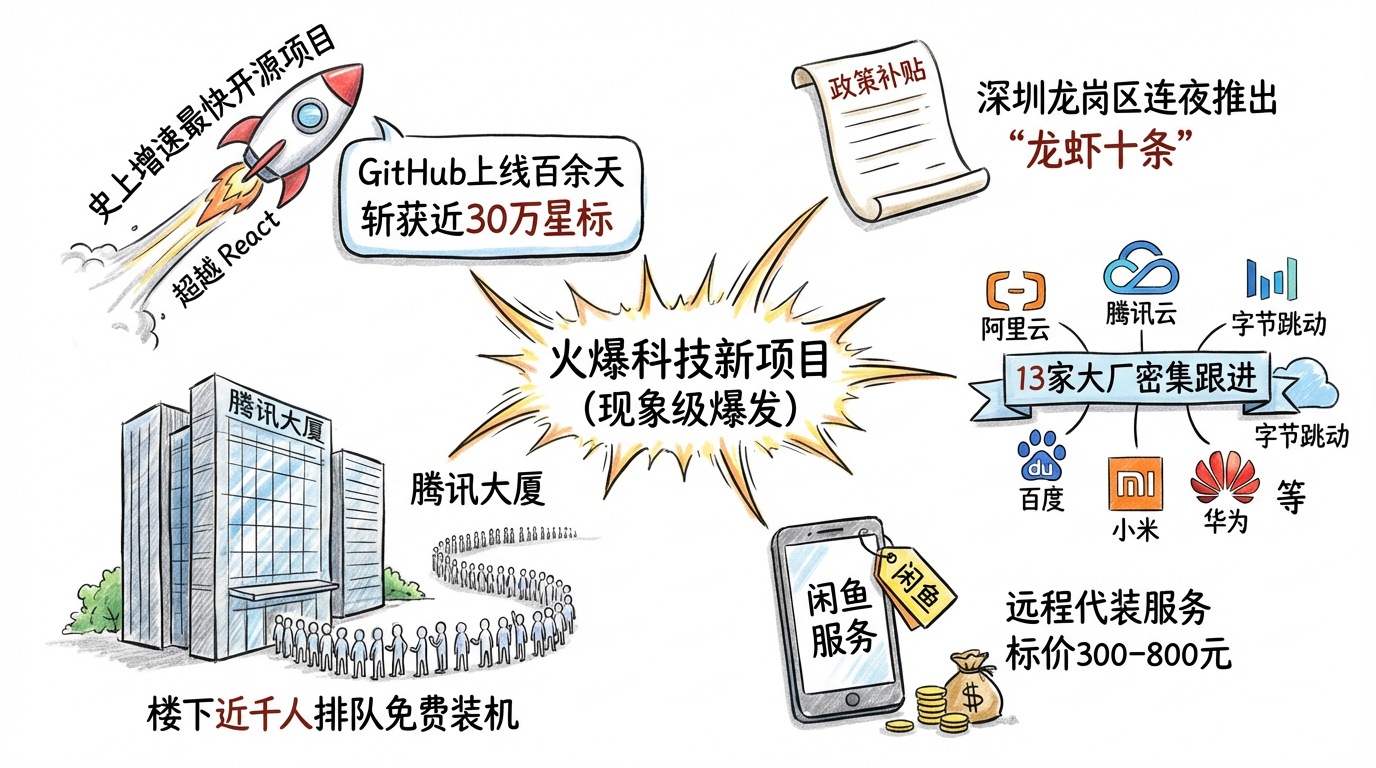

2026年开年,OpenClaw创造了一个堪称魔幻的现象:GitHub上线百余天斩获近30万星标,超越React成为史上增速最快的开源项目;腾讯大厦楼下近千人排队免费装机;闲鱼上远程代装服务标价300-800元;深圳龙岗区连夜推出”龙虾十条”补贴政策;阿里云、腾讯云、字节、百度、小米、华为等13家大厂密集跟进。

如果你是一个产品经理,看到这些数据,你的第一反应可能是兴奋——”这就是教科书案例啊!”

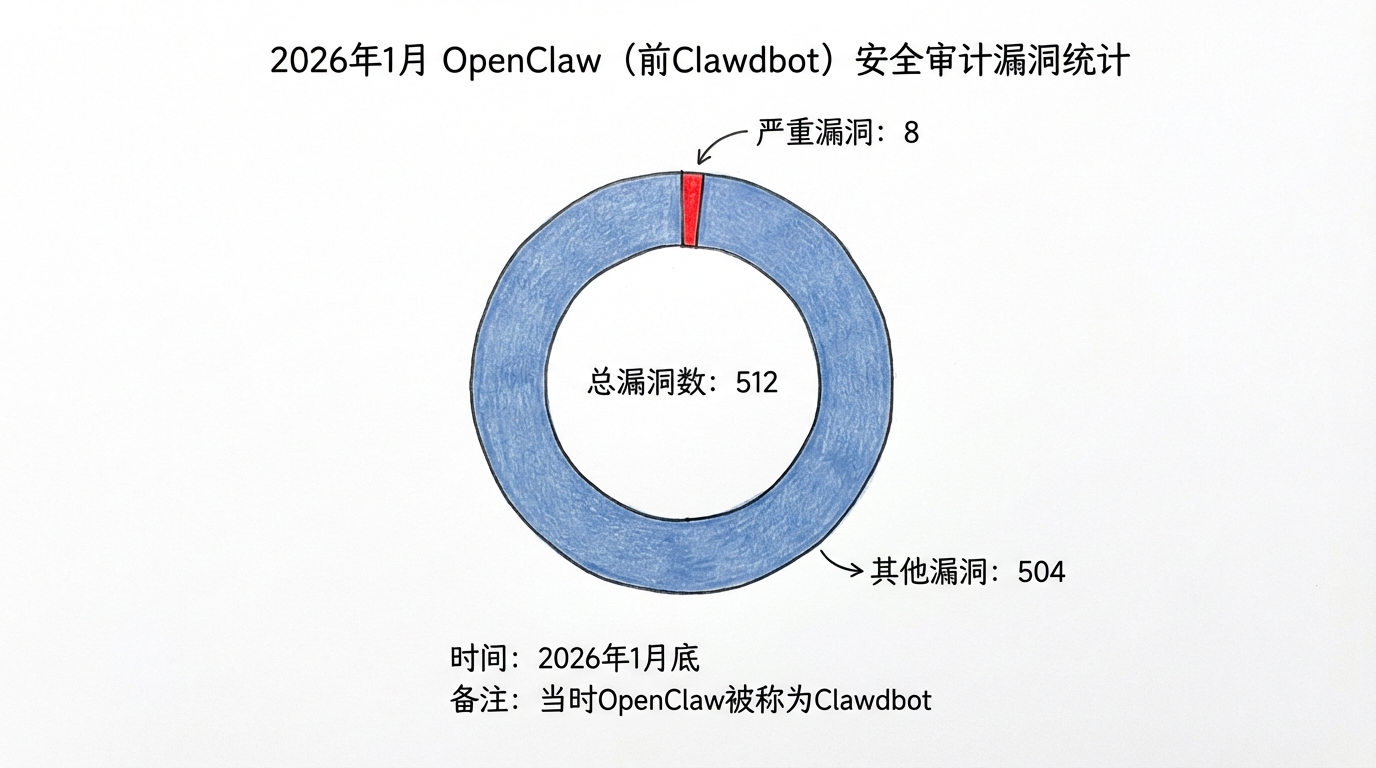

但如果你再多看一层数据,你会冒冷汗:Kaspersky在早期版本中审计出512个漏洞,8个为严重级别;技能市场ClawHub上被发现1184个恶意插件,感染率12%;全球超过13.5万个实例暴露在公网上,1.5万个可被直接远程代码执行;有用户一天Token花费2820美元,收入仅230美元;大量用户“装完即吃灰”。

这不是一个安全工程师的技术报告,而是一个产品经理必须直面的灵魂拷问:当我们把系统级执行权限交给AI,我们到底在做一个怎样的产品决策?

接下来,我将从产品经理最熟悉的框架——用户需求、产品架构、用户策略、商业模式4个方面,拆解OpenClaw,提炼出一套大家都可以复用的AI产品方法论。

一、需求洞察:OpenClaw为什么能?它到底解决了什么痛点?

在批判OpenClaw之前,我们必须先承认它做对了一件极其重要的事——精准的需求洞察。

1.1 一个被长期忽视的AI用户核心需求

从23年ChatGPT爆火到25年底,AI产品的主流形态一直是”对话式”——你问一个问题,AI给一个答案。用户不满意了吗?满意。但满足了吗?没有。

对话式AI解决的是“信息获取”,但用户真正的痛点是“任务执行–谁来帮我做?”。整理邮件、同步日历、处理文件、发布内容——这些重复性劳动每天消耗大量时间,AI只能”告诉你怎么做”,不能”帮你做完”。

OpenClaw的创始人Peter Steinberger说:”各大科技公司的AI产品仍停留在对话阶段,没有一款能真正适配个人用户需求、实现本地部署的全能AI助手。”于是,一个退休程序员用两个月时间,独自做出了GitHub历史上增速最快的项目。

1.2 反思:为什么大厂没做出来?

其实现在不是技术做不到——Anthropic有Claude Code,OpenAI有Computer Use——而是大厂在产品决策上做了不同的取舍。

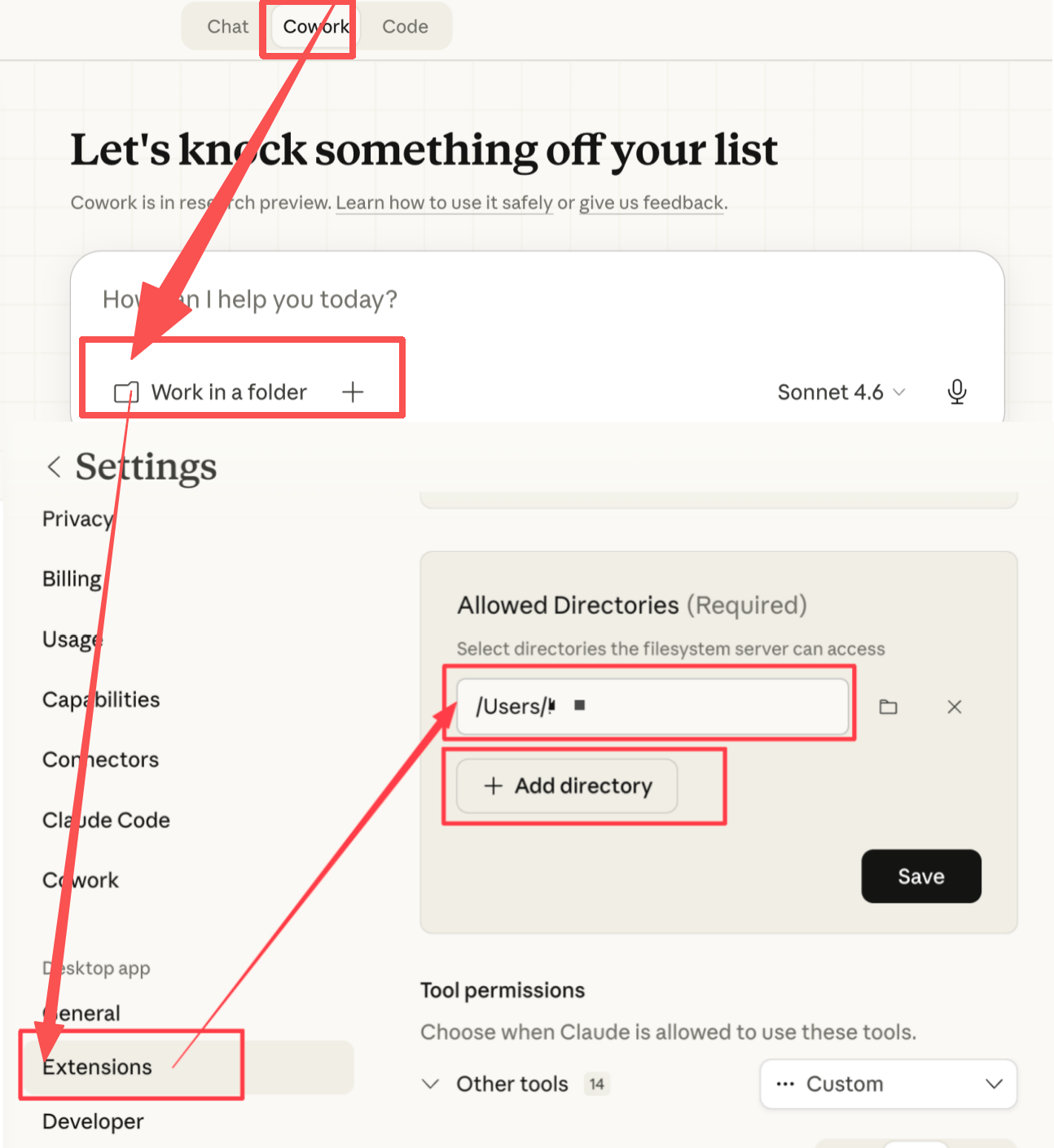

Anthropic的Claude Cowork选择了”可控优先”策略:在隔离沙盒中运行,用户通过授权特定文件夹赋予有限权限。这像是一位在指定办公桌上工作的专业助理——安全、可控,但能力边界被明确限定(参考下图设置方法)。

OpenClaw选择了”自由优先”策略:赋予AI系统管理员级别的权限,可以操作一切。这像是一个拿到了你家所有钥匙的全能管家——强大、灵活,但如果这个“管家”被人操控了呢?

两种策略没有绝对的对错,但它们对应着完全不同的产品后果。OpenClaw的选择让它获得了爆炸式增长,也为后来的安全灾难埋下了种子。

1.3 PM 思考:增长的”暗物质”

从产品增长的角度,OpenClaw的爆火有三个关键驱动力:

第一,体验冲击力。大量社交平台分享的”AI帮我做了*****”演示视频,比任何技术文档都有传播力。用户不需要理解什么是Agent框架,只需要看到”AI在帮我干活”。

第二,部署门槛制造的“代装经济”。安装OpenClaw需要配置Docker、Node.js、API密钥——这个门槛恰好足够高,让”帮你装”成为一门生意,反过来又成为社交传播的素材。

第三,集体情绪的裂变效应。当腾讯、阿里、字节集体下场,”不跟上就被淘汰”的焦虑开始自我强化,大众市场快速破圈。

但增长不等于价值。OpenClaw催生的“代装经济”是产品化失败的反面指标。真正的增长逻辑应该是用户装完之后还在持续使用,而不是”装完即吃灰”,即使是新年期间大家都抢着下载千问“抢奶茶”,热潮过后依旧迎来了卸载潮。

二、产品拆解:OpenClaw的设计,为什么是一个”定时炸弹”?

抛开狂欢滤镜,回归产品架构本身,OpenClaw存在四个层面的致命设计缺陷。作为产品经理,这些缺陷的本质不是”技术疏忽”,而是”产品决策失误”。

2.1 权限模型:给AI发了一张”无限额信用卡”

OpenClaw默认获取系统Root级权限,可操作所有文件、软件、数据,缺乏权限隔离与审计机制。这在产品设计中犯了一个经典错误——没有遵循”最小权限原则”。

传统AI是一个“只读API”——它给你错误答案,你最多被误导。AI Agent是一个“读写API”——它不仅会给错误答案,还会基于错误判断去删你的文件、发你的消息、泄露你的密钥。

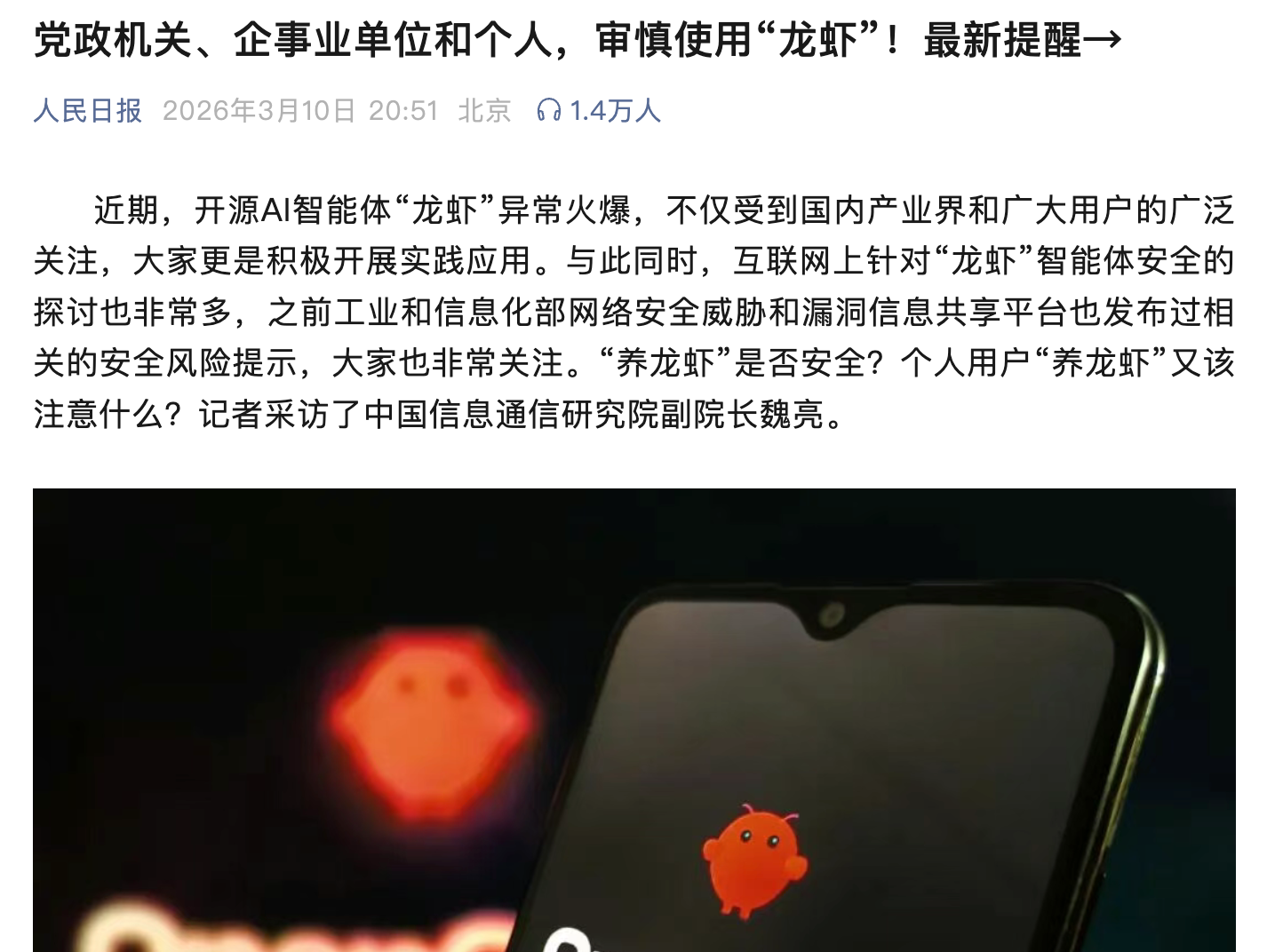

近期人民日报等多个官方媒体已经发布“养龙虾预警”,更有网友称之为“AI时代的木马病毒”

2.2 生态治理:先发布后审核的”潘多拉魔盒”

OpenClaw的开放发布模式——先发布后审核。结果是1000多个恶意技能包被上传到官方市场,伪装成smart-email-assistant等正规名称,实际植入了信息窃取木马。

产品经理的教训:开放生态 + 高权限执行 + 无审核机制 = 给攻击者搭台唱戏。投毒的Agent技能包将影响用户的全部数字资产。

2.3 “免费开源”外衣下的吞金兽

OpenClaw本身免费开源,但默认30分钟自动唤醒一次,即使无任务也持续消耗Token。有用户测算月度仅后台待命就需约750美元,有用户首月Token账单高达2万多元。

用户无法预估使用成本,没有Token限额、消费提醒,往往收到天价账单才恍然大悟。一款让用户无法预判使用成本的产品,无论技术多先进,都不具备大众化的基础。

三、产品方法论:AI Agent的”可控优先”设计框架

基于OpenClaw的全面复盘,我提炼出一套面向AI产品经理的设计框架。核心思想只有一句话:

可控 > 智能 > 强大。

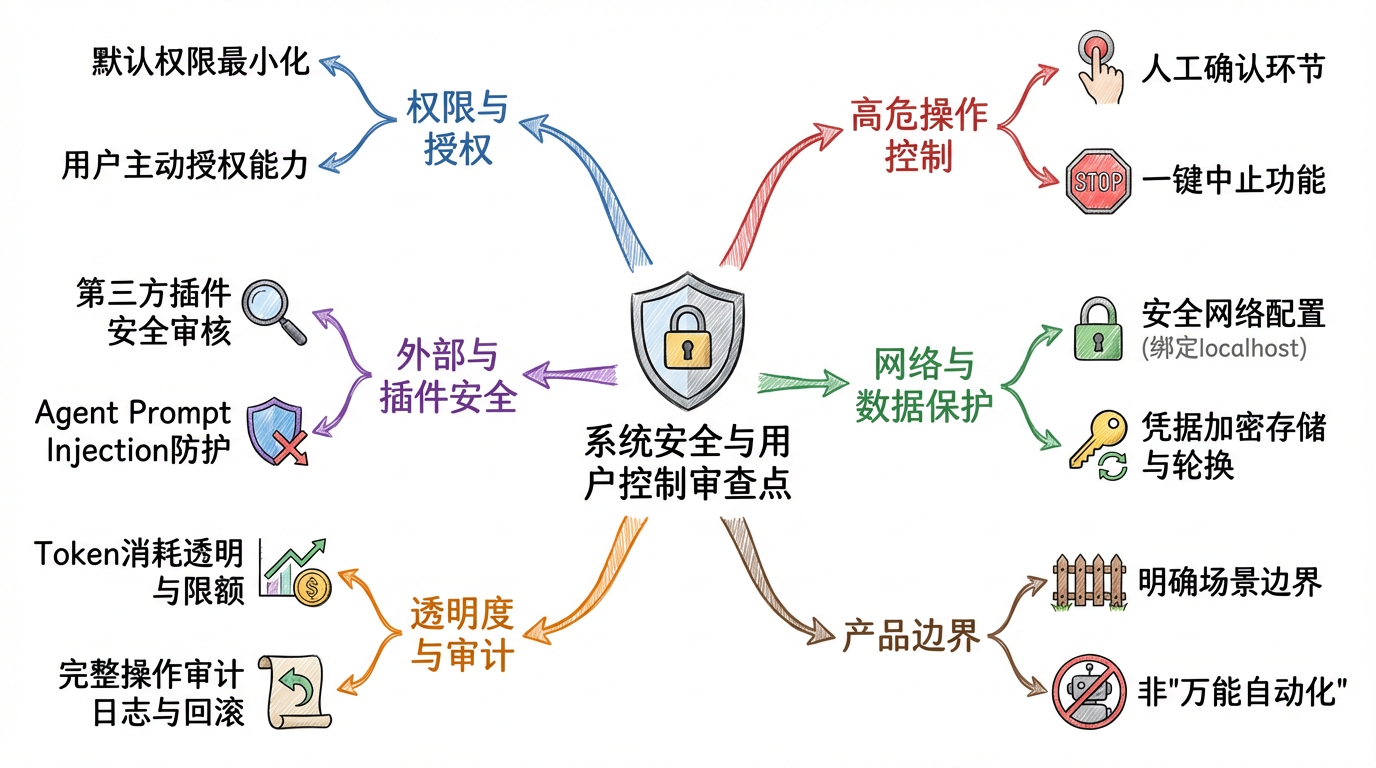

3.1 产品安全架构

第一层:权限授权

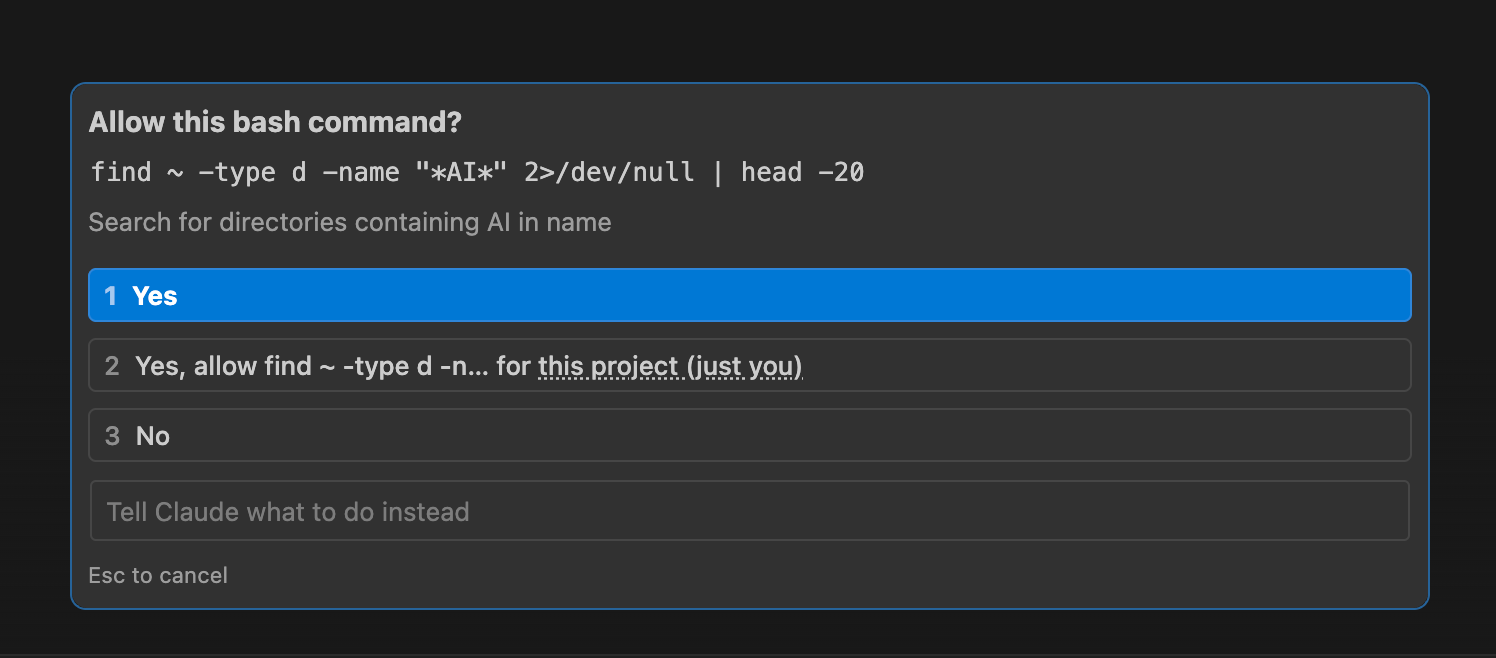

按细分任务申请权限,而非一次性授予所有权限。读邮件的任务不应该有文件系统写权限,整理文件的任务不应该有网络发送权限。每一个权限申请都应该有清晰的用户确认界面和可撤销机制,参考 Claude code。

第二层:行为可追踪

所有Agent操作必须可追溯、可回滚。对高危操作(文件删除、数据发送、代码执行)设置”人在回路”确认环节。用户能随时查看Agent正在做什么,能一键中止。

第三层:平台发布审核机制

必须建立”先审核后发布”机制。结合开发者信誉评分、社区举报等多层防御体系。OpenClaw后来开启强制扫描机制,就是亡羊补牢的典型。

第四层:成本透明

内置Token消耗仪表盘、消费限额设置、实时预警机制、任务成本预估功能。让用户在下达指令前就知道”这个任务大概要花多少钱”。

3.2 产品经理的”安全自检8问”

- 默认权限是否最小化?用户是否必须主动授权每一项能力?

- 高危操作是否有人工确认环节?用户能否一键中止?

- 第三方插件是否经过安全审核才能上架?

- Agent处理外部内容时是否防护?

- API密钥和凭据是否加密存储?

- Token消耗是否透明?是否有限额和预警?

- 是否有完整的操作审计日志?是否支持回滚?

- 产品是否有明确的场景边界?还是在宣传“万能自动化”?

四、商业模式与职业启示:AI Agent时代,产品经理的机遇在哪?

4.1 行业趋势判断

尽管安全问题严峻,OpenClaw证明的核心命题不可逆转:用户需要的不是能聊天的AI,而是能帮忙干活的AI。从”对话层”到”执行层”的范式跃迁,是AI产业的必然方向。但OpenClaw只是这个方向上的”功能机”,远非”iPhone时刻”。

4.2 商业化路径推演

OpenClaw催生的代装、教程生意是短期信息差红利,不可持续。长期来看,AI Agent的商业化将走向三条路径:个人用户的”云端托管+订阅制”(类似阿里云、腾讯云做的一键部署方案)、企业用户的”私有化部署+定制服务”(如中兴通讯解决方案)。

核心竞争壁垒不再是模型参数或功能数量,而是安全合规、产品体验、场景深度和生态治理水平。

对产品经理而言,OpenClaw的故事最深刻的教训不是技术层面的,而是产品哲学层面的:在AI Agent时代,最难的产品决策不是”给AI加什么能力”,而是”限制AI不做什么”。

给AI更多权限,产品更强大,Demo更惊艳,增长更快。但克制住”让AI能做一切”的冲动,把可控性、安全性、透明度放在第一位,才是真正负责任的产品设计。

未来能真正成功的AI Agent,一定具备四个特点:足够安全、足够简单、足够便宜、足够有用。顺序不能乱——安全是第一位的。

执行AI时代已经开始。作为产品经理,我们的使命不是让AI更强大,而是让AI更可信。

本文由 @山丘之上有AI 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

起点课堂会员权益

起点课堂会员权益

时代的发展,总是伴随着风险,只是目前这个风险难以承受。

讲的太好了👍