26年AI产品经理为什么必须掌握Harness Engineering?

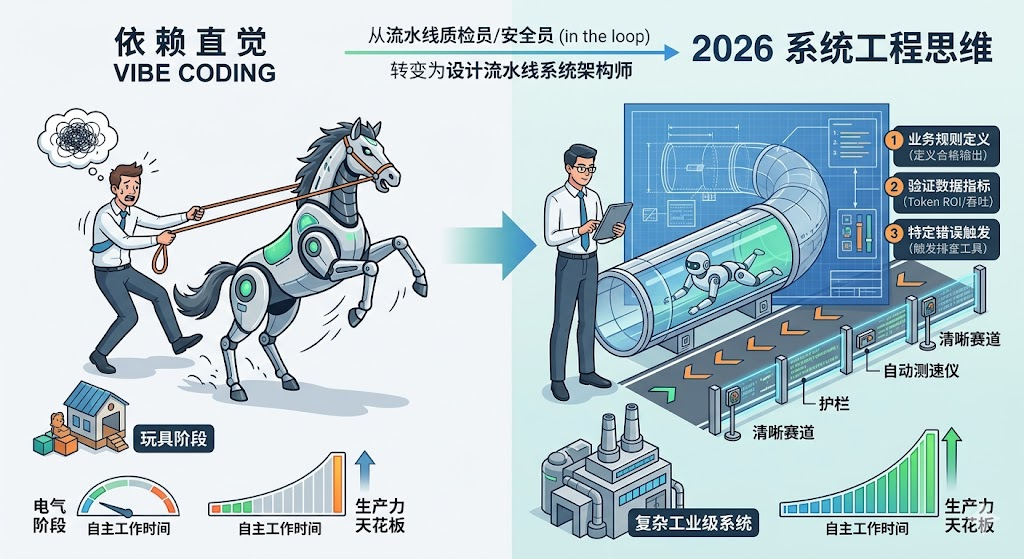

Vibe Coding被热捧为AI PM的未来技能,但其本质仍是依赖冗长Prompt的脆弱模式,难以应对工业级挑战。OpenAI的Harness Engineering系统揭示了关键突破:通过约束环境、自动化验证和反馈闭环,将AI从'玩具'升级为可靠工具。本文深度解析这一工程思维如何重构人机协作范式,以及产品经理如何从质检员转型为系统架构师。

整个行业都在鼓吹“Vibe Coding”是2026年AI PM的必备技能。但我发现,这种模式本质上和用AI写文章毫无二致——只不过产出物从“文字”变成了“代码”,模型依然无法精准理解背后的真实意图。

在这种直觉驱动下,依靠堆砌巨长的Prompt并不断对话,确实能迅速“聊”出一个惊艳的Demo。然而,Vibe Coding扛不住真实的工业级环境。在随后的迭代中,缺乏硬约束的系统必然崩塌:每次叠加新功能,Agent就会破坏旧逻辑;执行长线任务时,极易陷入失忆与死循环。最终,过度迷信Vibe Coding的项目,无一例外变成了一座无法维护的屎山。

问题出在哪里?

OpenAI的Codex团队在2026年用一组数据给出了答案:3名工程师,耗时5个月,交付了一个拥有100万行代码的完整软件产品,整个过程0行人工手写代码。

他们复盘这个极端实验时指出,实现这一跨越的核心不在于使用了多强大的底座模型,而在于他们构建了一套被称为Harness Engineering(驾驭工程)的系统。

对于AI产品经理而言,理解并掌握Harness Engineering,是将AI应用从“玩具”推向“工业级产品”的必经之路。

一、什么是Harness Engineering?

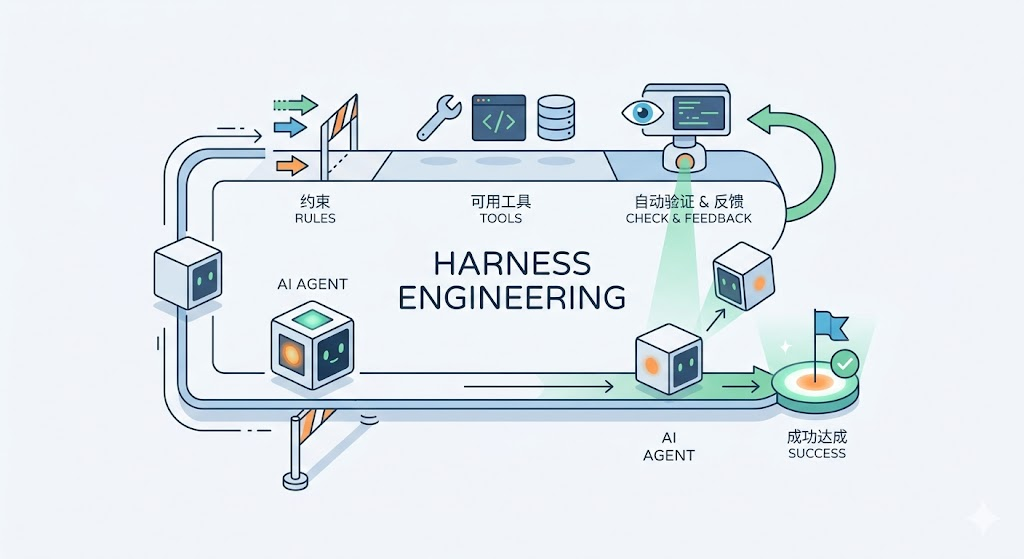

Harness原意是马具(缰绳、马鞍等)。在工程领域,它指代一套控制与测试环境。

如果把大模型比作引擎,Harness就是方向盘和刹车。引擎的马力越大,对方向盘和刹车的要求就越高。一台没有刹车的跑车,马力越强,车毁人亡的速度就越快。

在Agent开发中,Harness Engineering指的是为AI Agent搭建一个包含明确约束、可用工具链、自动验证标准和反馈闭环的独立运行环境。 它的核心目的是让Agent在你不在场的情况下,依然能自主、可靠地把任务做对。

这听起来像是在“给AI配置一台电脑”,但更准确的比喻是“为AI搭建一条带有自动化质检探头的流水线”。

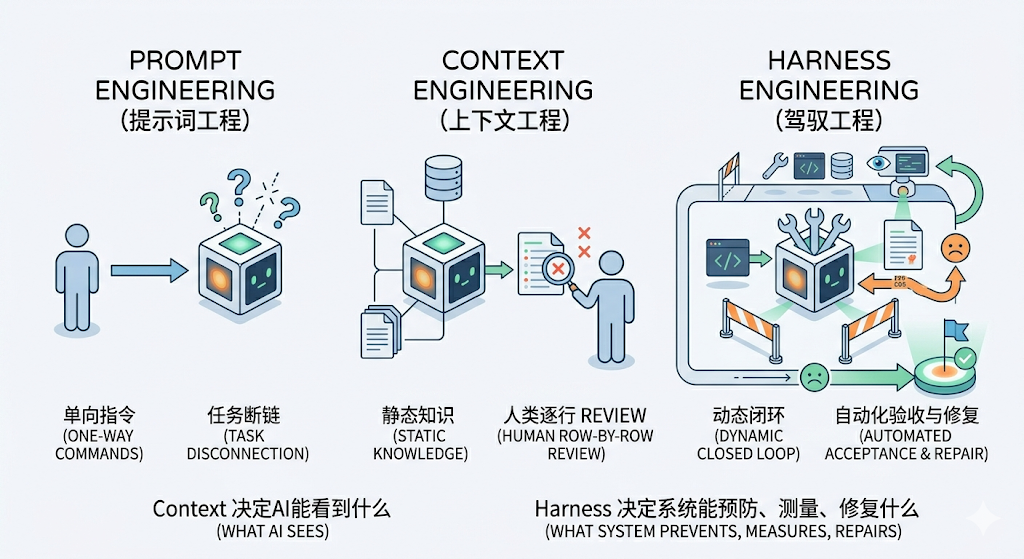

二、 协作范式的演进:Prompt vs Context vs Harness

理解 Harness Engineering 的前提,是看清人机协作范式如何从“语言交互”转向“系统工程”。

Prompt Engineering(提示词工程):单向的指令下达

模式: “你是资深行业分析师,请帮我写一份竞品分析,要求分三点……”

本质: 一次性的条件概率生成。AI是一个没有记忆、没有手脚的被动执行者。你每次都需要重新交代背景,输出结果完全依赖指令的精细度。

局限: 任务链一长,AI必然失忆。人需要全程守着,不断下发新指令。

Context Engineering(上下文工程):静态的信息供给

模式: 接入RAG库、定义系统级文档(Skill手册)。“基于这份100页的内部数据表和行业报告,分析竞品。”

本质: 为AI构建信息环境。AI有了背景知识,产出质量和稳定性大幅提升。

局限: 知识库解决的是“AI怎么写”的问题,但解决不了“AI怎么知道自己写对了”的问题。你给了它操作手册,但它遵不遵守全靠自觉。产出物依然需要人类逐行Review。

Harness Engineering(驾驭工程):动态的系统闭环

模式: 为Agent设定运行沙箱、配置调用接口,并植入校验脚本。Agent提交结果后,系统自动运行验证规则,失败则直接把报错信息(包含修改建议)退回给Agent重做,直到通过才提交给人类。

本质: 从“优化输入”转向“约束边界与自动化验收”。

核心区别: Context Engineering决定了Agent能看到什么,而Harness Engineering决定了系统能预防什么、测量什么、修复什么。

三、 核心机制:面向 ROI 的“推理三明治”

Harness 在工程实操中通过“推理三明治”结构对冲质量波动。但在 2026 年的工业环境下,这套结构不再是盲目的全量堆叠,而是基于 TokenROI(推理投资回报率) 的精准博弈:

顶层:高推理规划(The Top Bun) 调用高推理模型(如 DeepSeek-R1 或 o1)负责将模糊需求拆解为带有硬性约束的执行蓝图。这一层产出的不是代码或文字,而是 “确定性验收矩阵(Acceptance Matrix)”,明确定义了下一步执行必须触发的工具链和逻辑断点。

中层:低推理执行(The Meat) 由低推理模型(如 GPT-4o-mini 或 8B 级端侧模型)承接原子任务。在 Harness 预设的 Lint 工具、结构化测试脚本约束下,利用其低延迟和低成本优势,进行大规模的内容填充或代码构建。

底层:选择性高推理质检(The Bottom Bun) 这是实现工业级交付的关键。为了平衡成本与延迟,系统并非对所有产出进行高推理 Review,而是通过 Harness 中的 “逻辑探针” 识别高风险变更(如涉及权限控制、金融计算或核心接口调用)。

- L1/L2 脚本校验: 80% 的格式与语法错误由确定性代码直接拦截。

- L3 高推理质检: 仅当脚本校验发现逻辑矛盾,或命中高风险断点时,才唤醒高推理模型作为“质检员”进行语义对撞。

通过这种“按需唤醒”的夹心结构,Harness 系统利用高推理模型的逻辑冗余,去填补低推理模型在长线任务中的幻觉黑洞。这意味着:即使执行层偶尔“掉链子”,自动化反馈闭环也会将其在系统内修正,确保最终交付给人类的是具备“确定性”的成品。

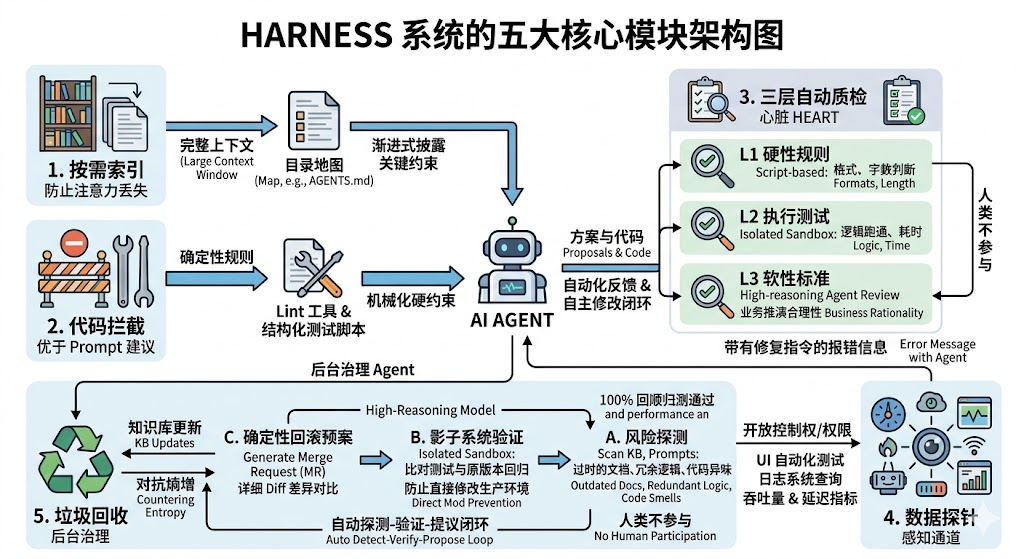

四、 Harness 系统的五大核心模块

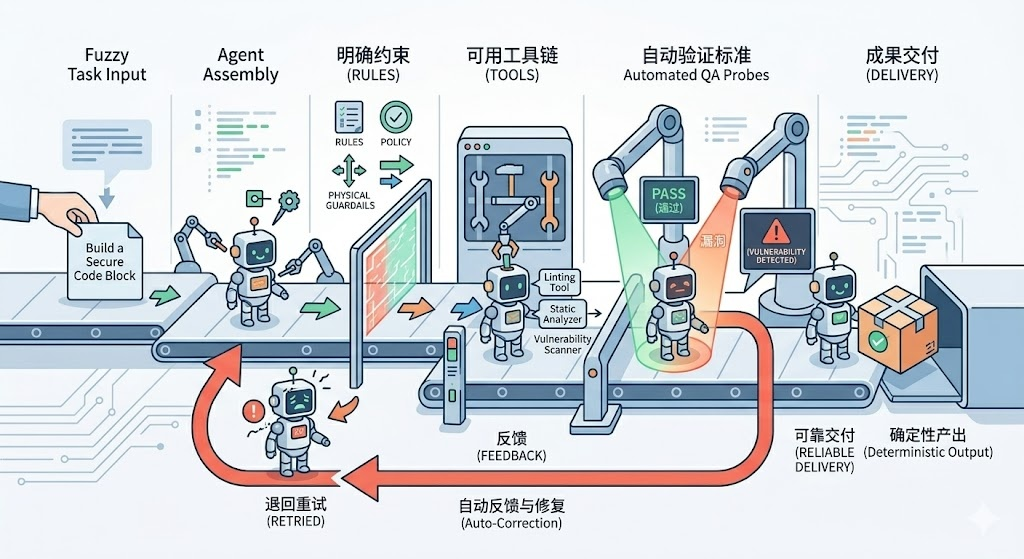

一个完整的Harness系统包含哪些部分?结合行业前沿实践,以下是构建Harness环境必须具备的核心模块:

1. 按需索引

大模型的上下文窗口虽然越来越大,但塞入的信息越多,关键约束被稀释的概率就越高(即“注意力丢失”)。 Harness系统通过提供“目录地图”解决这个问题。在根目录放置一个简短的索引文件(如AGENTS.md),仅列出“架构说明在A”、“设计规范在B”、“API接口在C”。Agent根据当前任务,按需调取对应的子文档。这种渐进式披露机制,保证了Agent工作台的清爽和信息的高信噪比。

2. 代码拦截

过去我们习惯在Prompt里写“请务必遵守XX规范”。但在Harness中,凡是能用代码写死的规则,绝对不用Prompt去建议。 通过引入Lint工具、结构化测试脚本等确定性工具来限制Agent的行为。例如,设定“A模块不能跨层级调用C模块”,一旦Agent生成的逻辑违规,脚本直接拦截并报错。这种机械化的硬约束,极大地压缩了Agent自由发挥导致的犯错空间。

3. 三层自动质检

这是Harness引擎的心脏。Agent写完方案或代码,系统自动触发三层验证:

- L1 硬性规则: 格式对不对?字数是否超标?(脚本直接判断)

- L2 执行测试: 逻辑能不能跑通?耗时是否超时?(在隔离沙箱中实际运行一遍)

- L3 软性标准: 方案的业务推演是否合理?(调用另一个高推理强度的Agent进行同行评审) 关键点在于,这三层验证产生的“报错信息”是写给Agent看的,并且自带修复指令。 Agent收到报错后自主修改、再次提交,形成循环。在这个闭环里,人类完全不需要参与。

4. 数据探针

不要让Agent变成“闭门造车的盲人”。Harness系统会给Agent接上“眼睛”和“探针”。 给它开放UI自动化测试工具的控制权,让它能自己打开页面看渲染效果;给它开放日志系统的查询权限,让它能自己查报错链路;给它提供吞吐量、延迟等指标接口,让它能根据客观数据验证自己的产出。感知通道越丰富,Agent的闭环能力越强。

5. 垃圾回收

Agent 的高效执行伴随一个致命副作用:它会以指数级速度复制并放大系统中已有的“坏模式(Bad Patterns)”。人类原本需要数月堆积的技术债,Agent 只需数小时就能让其蔓延至整个项目。

Harness 系统通过部署后台治理 Agent(类似于 Java 的 GC 机制)来对抗这种熵增,但其核心不再是盲目的自动删改,而是闭环的“探测-验证-提议”机制:

- 风险探测: 后台 Agent 定期扫描知识库、Prompt 模板和产出逻辑。利用高推理模型识别过期文档、违背“黄金原则”的冗余逻辑或正在蔓延的代码异味(Code Smell)。

- 影子系统验证(Shadow Verification): 这是防止系统崩溃的关键防线。治理 Agent 在发现坏模式后,不会直接修改生产环境,而是在隔离的影子沙箱中运行清理方案,并与原版本的输出结果进行像素级的比对测试。

- 确定性回滚预案: 只有当清理后的逻辑在影子系统中通过了 100% 的回归测试,且性能指标(延迟、Token 消耗)不降反升时,系统才会生成一份带有详细差异对比(Diff)的 Merge Request。

通过这种“自动探测、模拟验证、人工复核”的半自动治理模式,Harness 能够在不引入系统性风险的前提下,持续进行微小的逻辑修复,从根源上拦截 Agent 带来的技术债爆炸。

五、 对AI产品经理的终极启示

理解了Harness Engineering,就会明白为什么自己vibe coding的AI产品只能停留在玩具阶段,而OpenAI的Codex团队能够用极少的人力支撑庞大的复杂系统。

对于AI产品经理而言,这意味着彻底告别依赖模型直觉的“Vibe Coding”模式::

从流水线上的一个质检员、安全员,AI每做完一步都要上去核对、修改指令(in the loop)。 变成了设计这条流水线的系统架构师。

未来,PM的核心产出将不再仅仅是一份PRD或一段精妙的System Prompt,而是这套环境的业务规则定义。你需要去定义什么是合格的输出、用什么数据指标来验证这个输出、发生特定错误时应该触发什么工具供Agent排查。

你的工作越前置、你设计的Harness约束越严谨,Agent在后台能连续自主工作的时间就越长,你的生产力天花板就越高。

不要试图用更好的Prompt去控制一匹脱缰的野马,去给它建一个拥有清晰赛道、护栏和自动测速仪的马场。这就是2026年,AI产品经理必须建立的系统工程思维。

本文由 @林航旗 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益