AI 产品评测体系:如何科学评估 AI 能力

AI产品的测试评估正面临前所未有的挑战,从输出不确定性到主观题评估,再到过拟合风险,传统测试方法已完全失效。本文深度拆解AI产品评测的五大核心难题,并给出从构建评测方案到执行落地的完整方法论,带你掌握如何通过科学指标体系实现真正的降本增效。

一、为什么 AI 产品评测这么难?

1.1 五个核心挑战

挑战一:输出不确定性

传统产品:输入相同 → 输出相同

AI 产品:输入相同 → 输出可能不同

问题: 传统测试方法失效,无法用确定性规则验证。

挑战二:主观题居多

传统产品:对错题(登录成功/失败)

AI 产品:作文题(回答质量如何)

问题: 没有标准答案,需要多维度评估。

挑战三:过拟合风险

技术人员构建评测集,容易出现”开卷考试”问题:

- 评测集通过率 100%

- 一上线完全不行

- 因为评测用例被“背下来”了

问题: 评测集需要代表用户价值,不是技术能力。

挑战四:评估成本高

传统产品:自动化测试,几分钟跑完

AI 产品:主观题需要人工评估,一条用例几分钟

问题: 评测成本高,难以频繁执行。

挑战五:指标难定义

传统产品:功能是否正常工作

AI 产品:是否给用户带来价值

问题: 价值难以量化,需要科学指标。

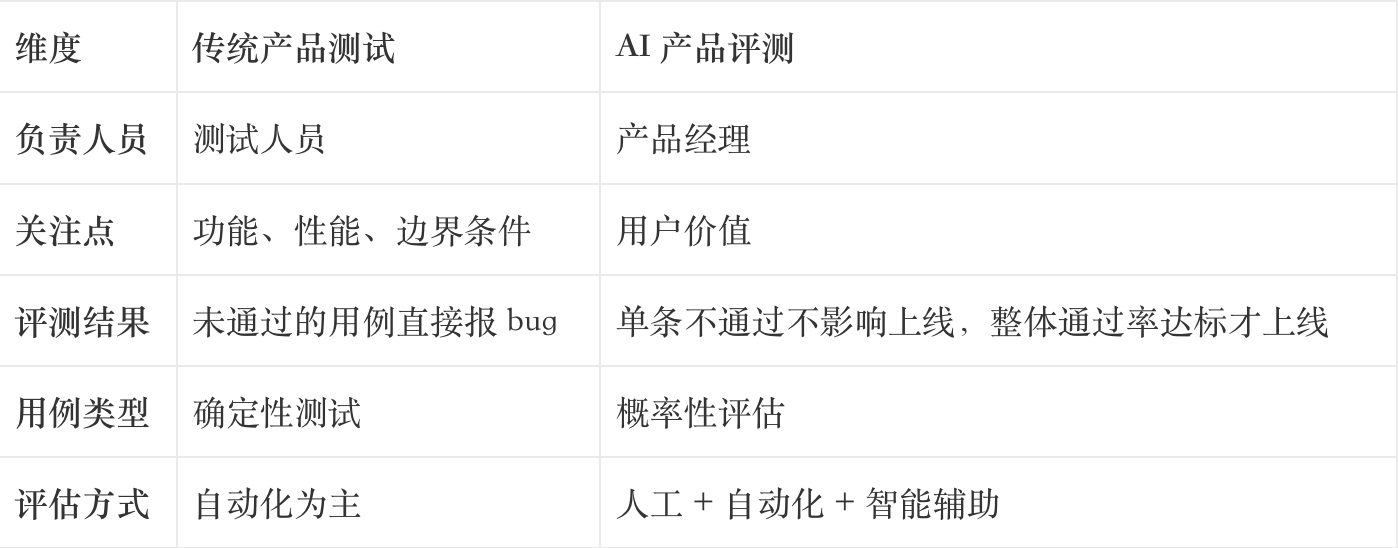

1.2 AI 产品评测 vs 传统产品测试

案例对比:

1.3 谁应该构建评测集?

三种角色对比:

推荐做法:

- 产品经理主导: 构建评测集,定义评估标准

- 业务人员参与: 提供真实场景和用户反馈

- 技术人员配合: 执行评测,提供技术支持

核心原则: 评测集代表产品给用户提供的价值,谁最贴近用户,谁应该制定评测集。

二、AI 产品评测的核心流程

整体流程

【第一步:构建评测方案】

明确评测目标、范围、资源

【第二步:构建评测集】

收集用例、编写用例、审核用例

【第三步:制定评测规则】

定义通过标准、评估维度、评分方法

【第四步:执行评测】

人工测试、自动化测试、智能辅助测试

【第五步:评估效果】

计算指标、分析结果、决策是否上线

第一步:构建评测方案

评测方案模板:

【评测目标】

评估 AI 话术生成功能是否达到上线标准

【评测范围】

– 场景覆盖:首次拜访、异议处理、成交促成

– 用户角色:新人代表、资深代表

– 产品类型:产品 A、产品 B、竞品对比

【评测资源】

– 人力:产品经理 1 人,业务专家 2 人

– 时间:3 天

– 用例数量:200 条

【上线标准】

– 整体通过率:>70%

– 提效率:>20%

– 用户满意度:>4.0 分

第二步:构建评测集

评测集来源:

评测用例的主要组成:

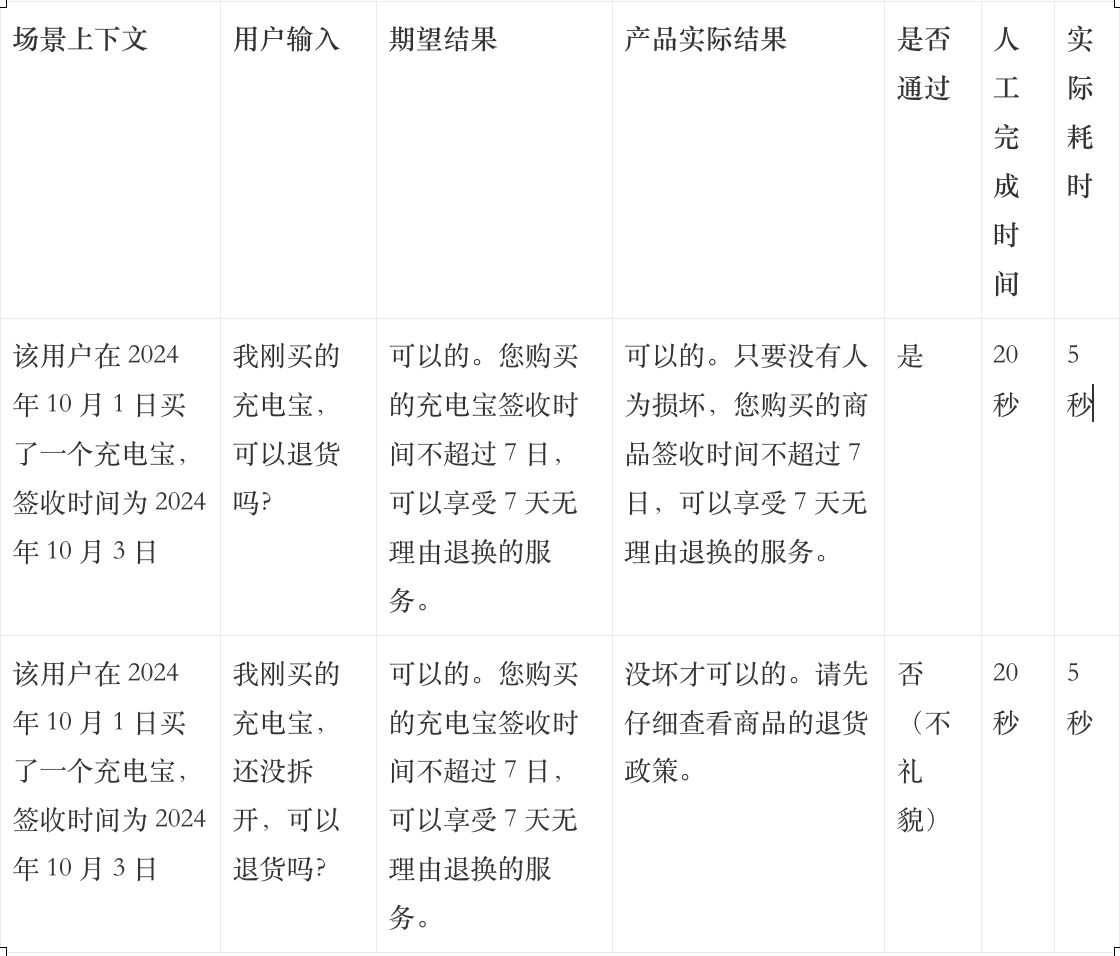

评测用例模板:

第三步:制定评测规则

评测标准类型:

主观题评估维度:

通过标准示例:

【通过标准】

– 客观题:完全匹配或语义等价

– 主观题:平均分≥4 分,且无维度低于 3 分

【不通过情况】

– 事实错误

– 语气不礼貌

– 遗漏关键信息

– 答非所问

第四步:执行评测

评测执行方法:

推荐做法:

- 早期迭代: 白盒 + 人工测试,快速修复问题

- 上线前: 黑盒 + 智能辅助测试,避免过拟合

- 持续迭代: 自动化 + 智能辅助测试,降低执行成本

第五步:评估效果

评估内容:

【指标计算】

– 通过率:通过用例数 / 总用例数

– 提效率:(人工耗时 -AI 耗时) / 人工耗时

– 用户满意度:模拟用户评分

【结果分析】

– 整体表现是否达到上线标准

– 哪些场景表现好,哪些表现差

– 主要问题类型和原因

【上线决策】

– 达到标准:可以上线

– 接近标准:优化后上线

– 远低于标准:重新设计

三、AI 产品评测的核心指标

3.1 通过率

公式:

通过率 = 通过用例数 / 总用例数

说明:

- 上线前用通过率预测提效率

- 上线后用线上真实采纳率衡量

上线阈值:

通过率阈值 = AI 生成总时间 / 人工操作时间

解释: 通过率必须高于这个阈值,AI 功能才能提效。

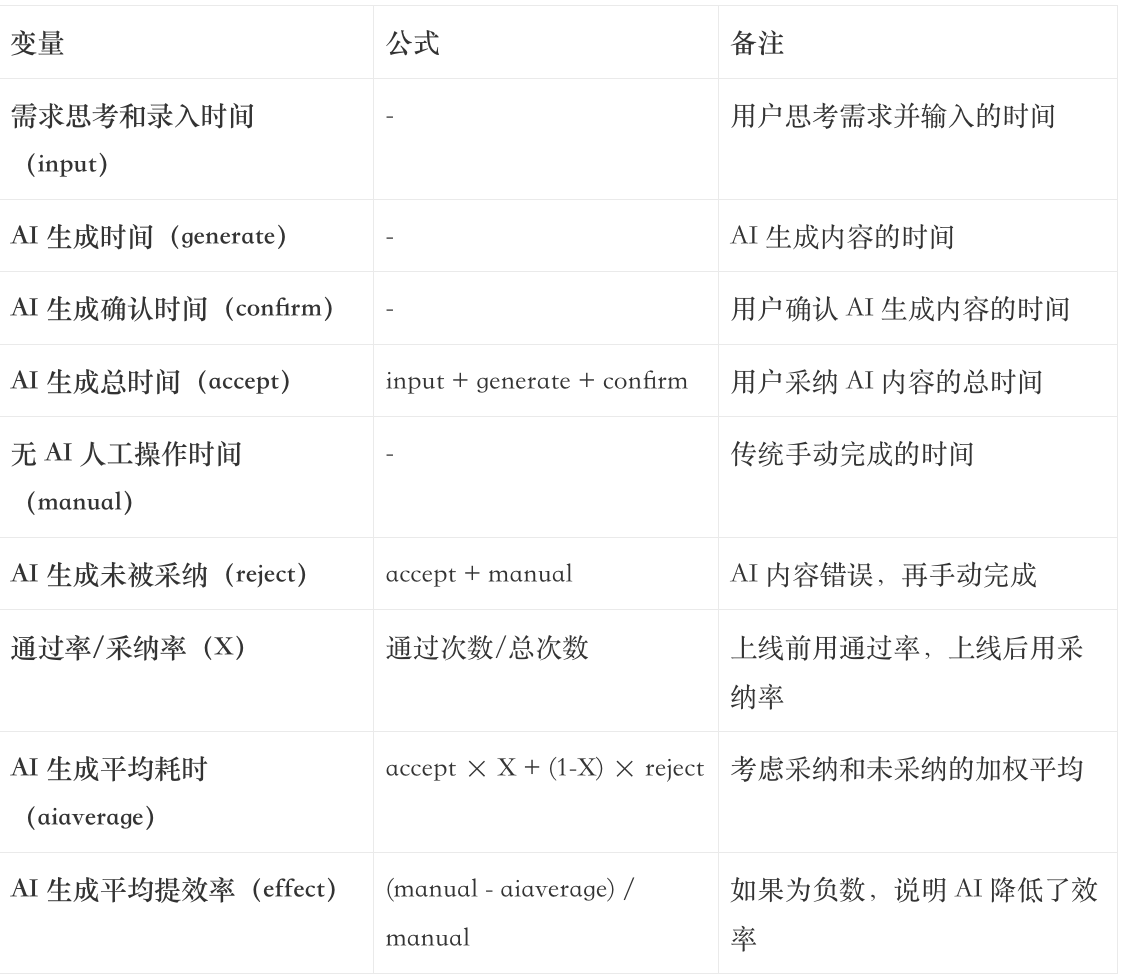

3.2 提效率

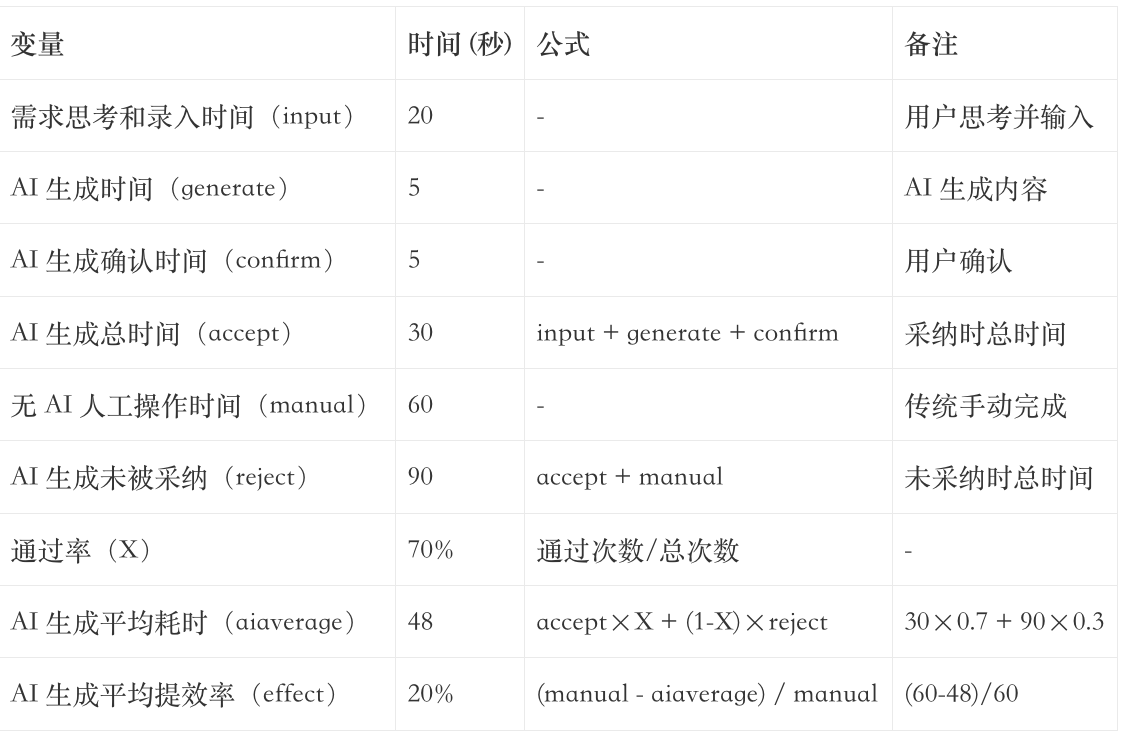

提效率计算公式:

3.3 提效率计算案例

某 AI 写文案功能的评测:

通过率阈值计算:

通过率阈值 = accept / manual = 30 / 60 = 50%

结论:

- 通过率 70% > 阈值 50%,可以上线

- 提效率 20%,达到上线标准

3.4 降本增效计算

AI 节省的成本与三个数字直接相关:

- 单次使用的提效率

- 非 AI 方式的人工耗时

- 使用次数

计算公式:

单人每日节省时间 = 使用次数 × 提效率 × 人工耗时

公司每日节省时间 = 单人每日节省时间 × 使用人数

公司每日节省成本 = 公司每日节省时间 / 8 × 人均日成本

案例:

假设:

– 单次提效率:20%

– 人工耗时:60 秒

– 每人每日使用:100 次

– 使用人数:100 人

– 人均日成本:2000 元

计算:

– 单人每日节省:100 次 × 0.2 × 60 秒 = 1200 秒 = 20 分钟

– 公司每日节省:20 分钟 × 100 人 = 2000 分钟 = 33 小时 = 4 人日

– 公司每日节省成本:4 人日 × 2000 元/人日 = 8000 元

3.5 其他核心指标

四、实战案例:AI 话术生成评测

4.1 案例背景

产品信息:

- 类型:AI 销售话术生成

- 用户:2000+ 医药代表

- 功能:根据场景生成销售话术

- 问题:研发说准确率 95%,业务说不好用

评测目标:

- 评估是否达到上线标准

- 找出主要问题和优化方向

4.2 评测方案

【评测目标】

评估 AI 话术生成功能是否达到上线标准

【评测范围】

– 场景覆盖:首次拜访、异议处理、成交促成

– 用户角色:新人代表、资深代表

– 产品类型:产品 A、产品 B、竞品对比

【评测资源】

– 人力:产品经理 1 人,业务专家 2 人

– 时间:3 天

– 用例数量:200 条

【上线标准】

– 整体通过率:>70%

– 提效率:>20%

– 用户满意度:>4.0 分

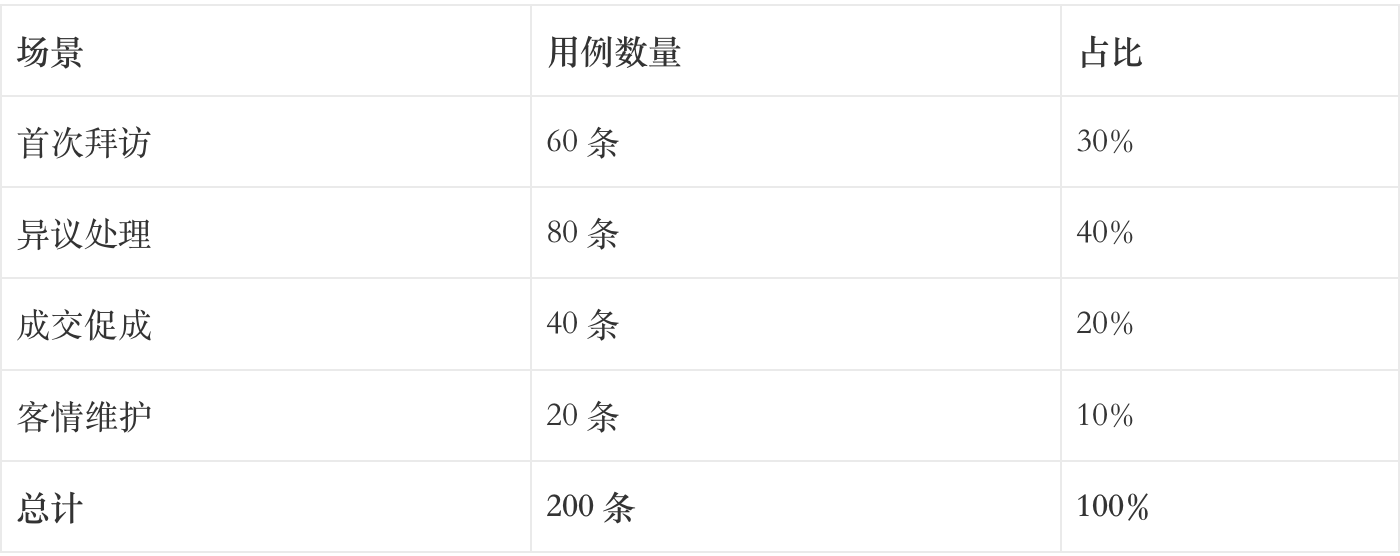

4.3 评测集构建

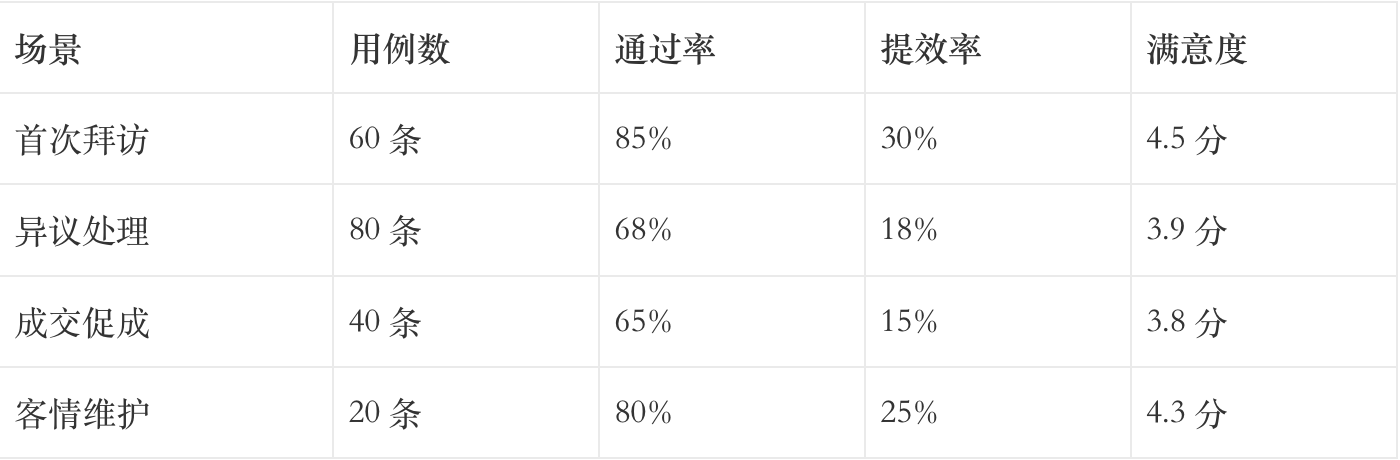

用例分布:

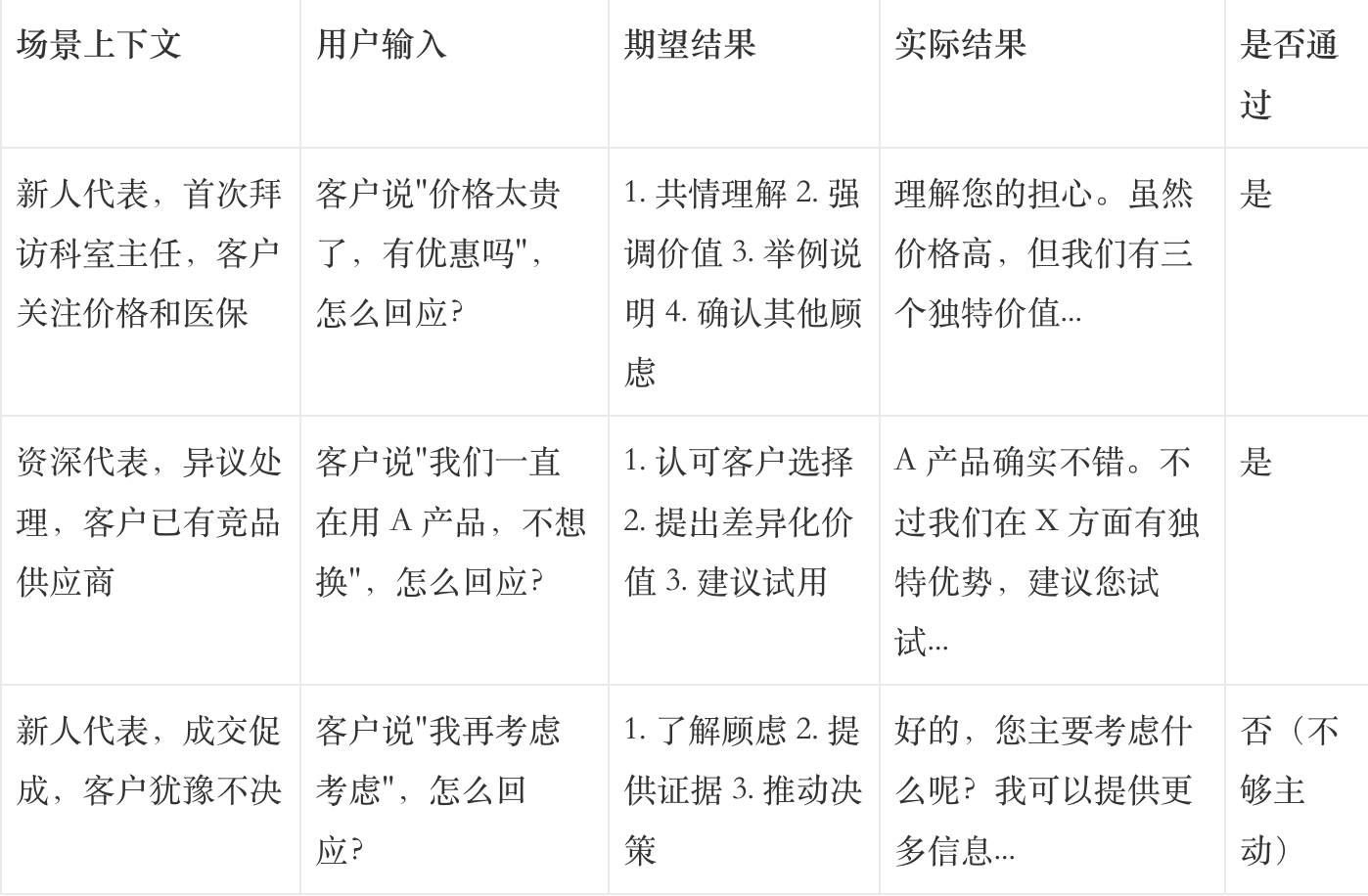

用例示例:

4.4 评测执行

执行方式:

- 白盒测试: 前 100 条用例,研发知道内容,快速修复

- 黑盒测试: 后 100 条用例,研发不知道,只告知通过率

- 评估人员: 产品经理 +2 名业务专家

- 评估维度: 正确性、完整性、语气、简洁性、有用性(1-5 分)

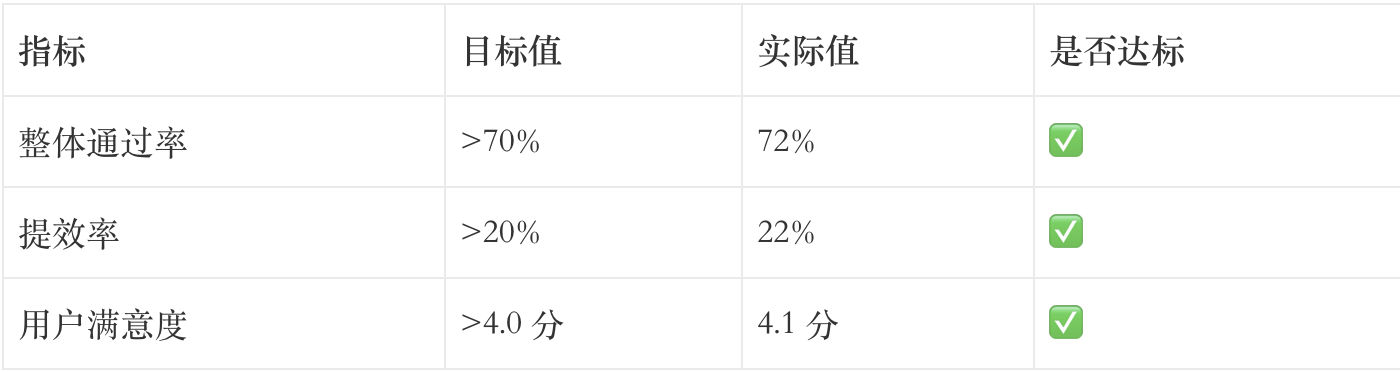

4.5 评测结果

整体结果:

分场景结果:

问题分析:

4.6 上线决策

决策: 可以上线,但需要持续优化。

理由:

- 整体指标达到上线标准

- 简单场景(首次拜访、客情维护)表现好

- 复杂场景(异议处理、成交促成)需要优化

优化计划:

4.7 上线后验证

上线后数据(1 个月后):

结论: 评测结果与线上数据基本一致,评测体系有效。

五、AI 产品评测的五个关键成功要素

5.1 要素一:产品经理主导

评测集代表产品给用户提供的价值。

产品经理主导的原因:

- 最懂用户需求和场景

- 能平衡用户价值和技术实现

- 能对上线决策负责

避坑: 不要让技术人员主导评测集构建,容易过拟合。

5.2 要素二:持续迭代

不要求第一版就完美。

建议:

- 第一版:几十个到 100 个用例就可以启动

- 持续迭代:基于用户反馈和线上数据更新

- 版本管理:记录每次评测集的变化

避坑: 不要等评测集完美了再开始,先做一版为基础。

5.3 要素三:场景覆盖均匀

评测集要在业务场景里尽可能覆盖均匀。

建议:

- 按场景分类(首次拜访、异议处理、成交促成)

- 按用户角色分类(新人、资深、管理者)

- 按难度分类(简单、中等、复杂)

避坑: 不要只在少量场景里评测,容易遗漏问题。

5.4 要素四:自动化 + 智能辅助

人工评估成本高,难以频繁执行。

建议:

- 客观题:自动化测试

- 主观题:智能辅助测试(用另一个大模型评估)

- 关键用例:保留人工评估

避坑: 不要完全依赖人工,难以持续。

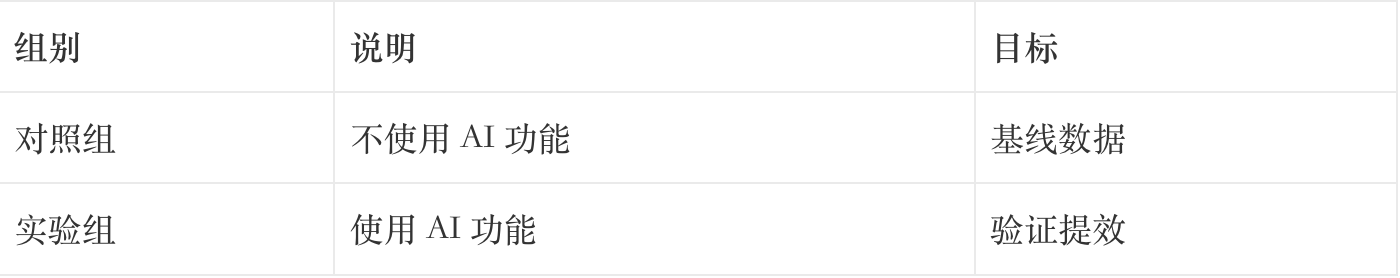

5.5 要素五:从离线到 AB Test

离线评测通过后,还需要线上验证。

流程:

【离线评测】→【小范围灰度】→【AB Test】→【全量上线】

AB Test 设计:

评估指标: 采纳率、提效率、用户满意度、续费率

六、AI 产品评测的未来趋势

6.1 趋势一:智能辅助评测普及

当前: 人工评估为主,成本高

未来: 大模型辅助评估,降低成本

影响: 评测频率大幅提升,持续迭代成为可能。

6.2 趋势二:自动化评测比例提升

当前: 主观题需要人工评估

未来: 更多场景可用自动化评测

影响: 评测效率大幅提升。

6.3 趋势三:评测集共享

当前: 各公司自己构建评测集

未来: 行业评测集共享和对比

影响: 行业基准建立,产品对比更科学。

写在最后

AI 产品评测,不是传统测试的简单延伸,是全新的评估范式。

核心方法论:

- 产品经理主导 —— 评测集代表用户价值

- 科学指标体系 —— 通过率、提效率、满意度

- 持续迭代 —— 不追求完美,先做一版为基础

- 自动化 + 智能辅助 —— 降低评估成本

- 从离线到 AB Test —— 线上验证最终效果

作为 AI 产品经理,建立评测体系需要关注:

- 构建评测集 —— 场景覆盖均匀,代表用户价值

- 制定评测规则 —— 客观题 + 主观题,多维度评估

- 执行评测 —— 白盒 + 黑盒,人工 + 自动化 + 智能辅助

- 计算指标 —— 通过率、提效率、满意度

- 上线决策 —— 数据驱动,不凭感觉

先建立评测体系,再追求完美指标。

评测比体验更重要。

本文由 @许与 原创发布于人人都是产品经理。未经作者许可,禁止转载。

题图来自作者提供

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益