意外开源的51万行代码,让我们看清了AI Agent的终极秘密Harness Engineering

Anthropic的一次意外代码泄漏,揭示了AI Agent稳定运行的秘密——Harness Engineering。从电脑鼠迷宫比赛到Claude Code的架构设计,这篇文章深入探讨了环境约束如何比模型本身更能释放AI潜力。三层Harness框架、次优路径的胜利,以及人类在AI探索中的独特角色,共同勾勒出下一代AI发展的关键路径。

2026年3月底,一件意外的事震动了AI圈。

安全研究员 Chaofan Shou 发现,Anthropic 发布到 npm 的 Claude Code 包里,夹带了一个不该存在的文件——sourcemap,一个供开发者调试用的 .map 文件。

本应在生产环境剔除,因为一行 .npmignore 配置的疏漏,51.2万行代码、1906个TypeScript源文件,就这样公开在了互联网上。

数小时内,全网开始疯狂 Clone。

但最值得关注的,不是这次泄漏有多严重,而是:这份代码里,藏着 Anthropic 如何让 AI Agent 稳定工作的全部秘密。

这个秘密,有个名字——Harness Engineering。

从一只不停碰壁的电脑鼠说起

1977年,一场奇特的比赛在日本悄然诞生。

参赛者是一群巴掌大的小机器人,叫做”电脑鼠”(Micromouse)。规则极其简单:16×16格的标准迷宫,从起点跑到终点,谁最快谁赢。

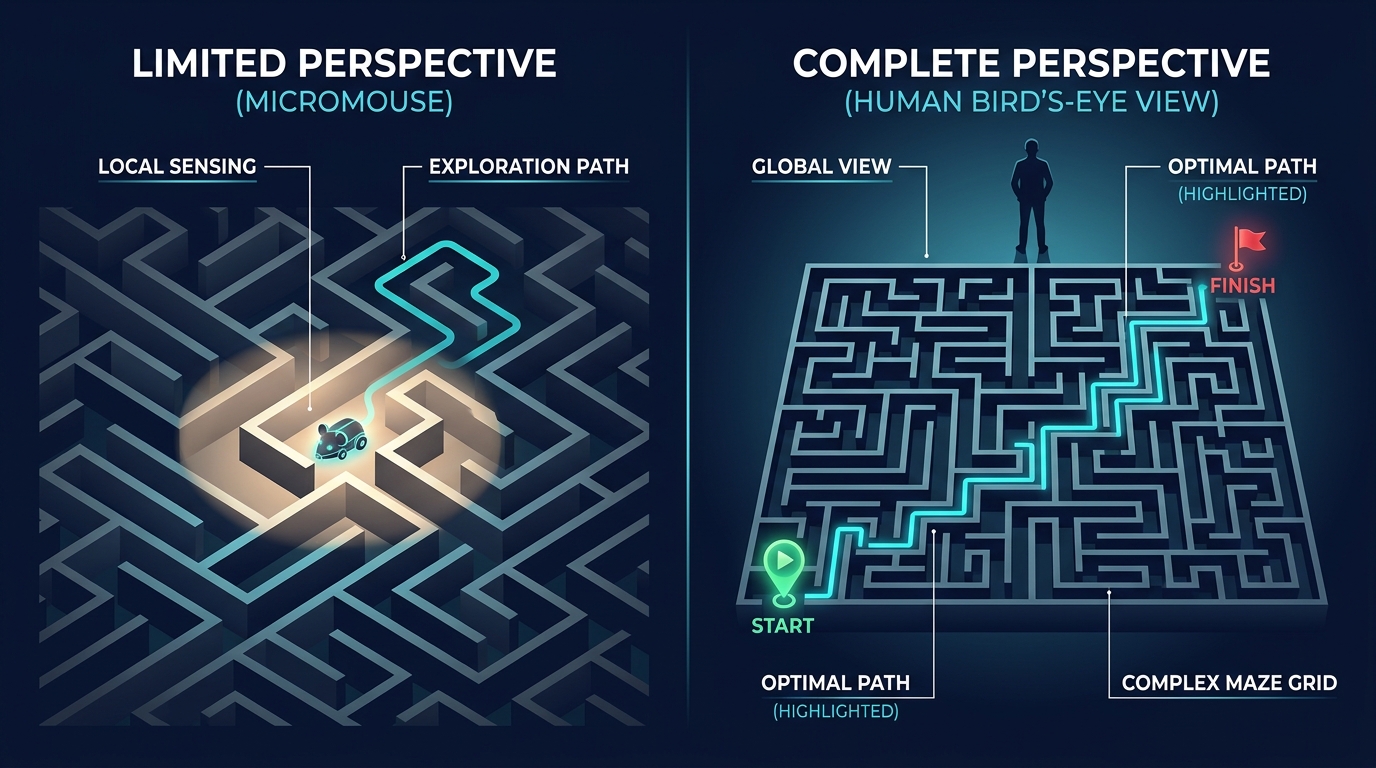

五十年后,当我盯着自己的 AI Agent 在同一个错误上反复碰壁,突然意识到:我们每天操控 AI Agent 干活,本质上就是在玩一场电脑鼠迷宫比赛。

而 Claude Code 意外泄漏的那51万行代码,就是 Anthropic 给这只电脑鼠造出的完整迷宫。

泄漏代码揭示了什么

翻阅社区对泄漏代码的分析,有几个发现让工程师们集体沉默。

第一,AI Agent 的稳定性来自环境设计,不来自模型本身。

代码里有一段非常有意思的架构:MCP、Skill、Hook、Subagent,四个机制层层叠加,构成了一个 Agent 稳定运行的”运动场”。这不是随意堆砌的功能,而是精心设计的环境约束系统。

OpenAI 曾做过一个实验:底层模型完全不变,仅优化外部运行环境,LangChain 编码 Agent 的任务通过率从 52.8% 飙升至 66.5%。泄漏的代码正是这个结论的实体化——模型的能力,是被环境释放出来的。

第二,代码里有一个叫 “Undercover Mode” 的功能。

这不是重点,但它暗示了一件事:Anthropic 内部对 Agent 的运行状态有非常细粒度的控制和管理。他们知道哪些环境下 Agent 该收敛、哪些该扩张。

第三,选择 npm 分发本身,就是一种 Harness 决策。

有人评论:如果 Claude Code 像 Cursor 那样用 Electron 打包,或者像 Devin 做纯 SaaS,这次泄漏根本不会发生。Anthropic 选择了 npm,选择了把工具交给开发者直接使用——这个决定背后,是他们对 Harness 开放性的判断。

讽刺的是:这次”事故”,反而成了当今最顶级 Harness Engineering 实践的一次意外开源。

我们正在玩什么样的迷宫游戏

理解了泄漏代码的结构,再来看电脑鼠的类比,会清晰很多。

迷宫的终点 = 可验证的项目目标

电脑鼠比赛的终点是固定的,成绩可以精确测量到毫秒。这和好的产品目标一样——目标越模糊,老鼠越容易在里面瞎转。

对话式 AI = 没有轮子的老鼠

你和 ChatGPT、Claude 对话,本质上是这个状态:AI 没有主动探索环境的能力,你得不停地推着它走,还要随时告诉它”前面有墙”。

Claude Code = 装上了摄像头和轮子

当 AI Agent 获得了读取文件、执行代码、调用工具的权限,它从”被推着走的老鼠”变成了”有小范围摄像头的电脑鼠”。这不是量变,是质变。

但有一个关键限制没有改变:AI 永远看不见整个迷宫。

服务器部署这件事我有亲身体验。我让 AI 帮我部署代码,它给出的方案是逐行念出命令让我手动执行——花了40分钟。后来我反思:2015年 SSH + Python 自动化部署就已经是行业标准了,为什么 AI 退化成了操作手册?

原因很简单:我的提示词里没有告诉 AI 这是”需要反复执行”的任务。AI 看不到”重复部署”这件事。老鼠不是不够聪明,是看不见整个迷宫。

“次优路径”反而赢得比赛

电脑鼠比赛里有一个经典故事。

某届比赛,”红色彗星”选择了绕远路但转弯少的路线。对手选了数学上更短的路径,但要频繁急转弯。最终,红色彗星赢了。选择最短路径的老鼠,输了比赛。

这个故事在 AI Agent 的工作里每天都在上演。我们常常陷入”找到最好的提示词”的执念,但工程约束的设计远比提示词优化重要。

这正是 Harness Engineering 的核心:与其训练老鼠跑得更快,不如把迷宫里的急弯都改成缓弯。

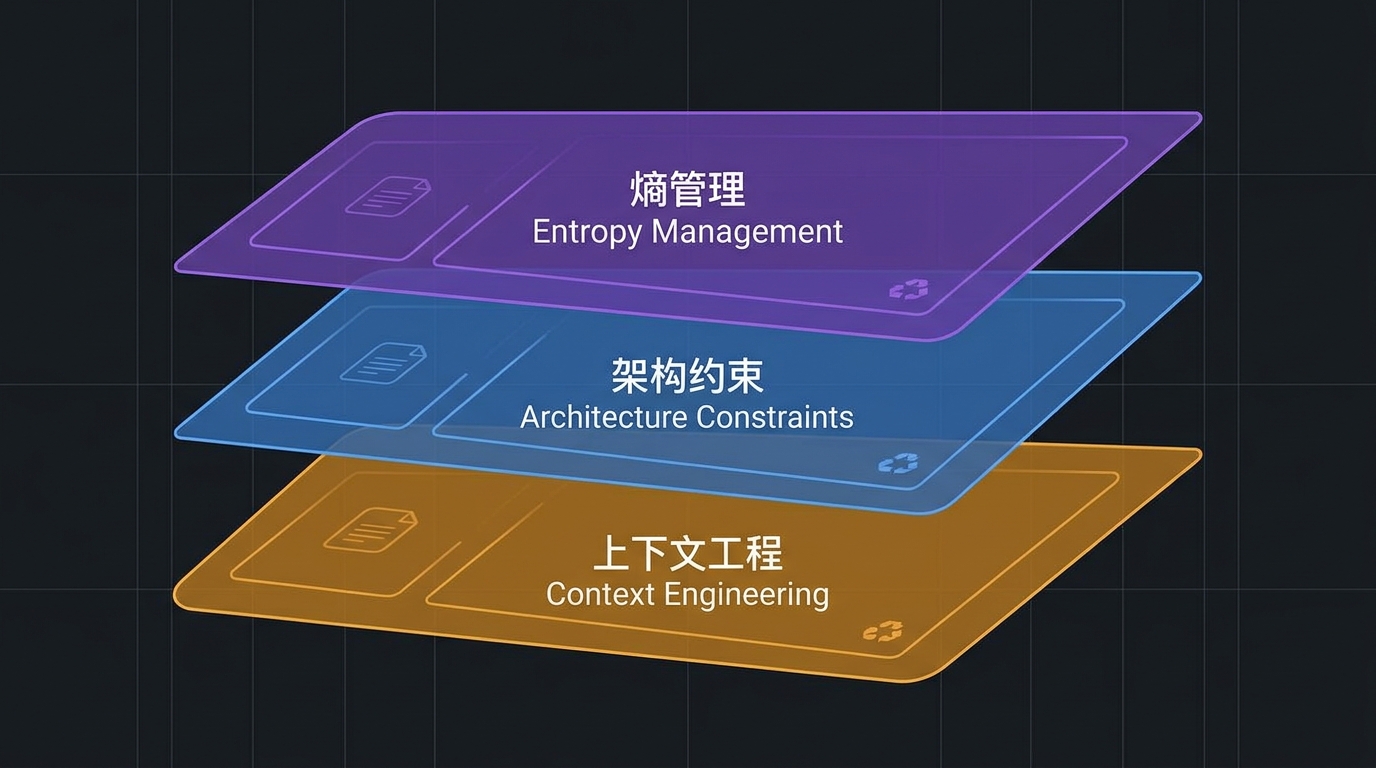

三层 Harness,把迷宫设计好

Claude Code 泄漏的代码给出了答案框架,结合实践经验,我把它分为三层:

第一层:上下文工程——告诉老鼠它在哪

我自己用过两种方式。早期靠维护 PRD/MRD/BRD/EDD 文档把项目信息喂给 AI,效果很好但门槛极高。现在用 superpowers 这套 skills 包——内置固定框架,让 AI 主动向我提问,把需要的上下文都挖出来。头脑风暴的过程同时也是信息沉淀的过程。

这就像洪水填充算法:与其让老鼠自己探索每个格子,不如先给每个格子标上”距终点的距离”,让老鼠始终知道该往哪走。

第二层:架构约束——给老鼠划定跑道

泄漏代码里的 Hook 机制正是这一层的实体——它定义了 Agent 在什么节点可以做什么、不能做什么。边界清晰的轨道,比无限自由度效率更高。

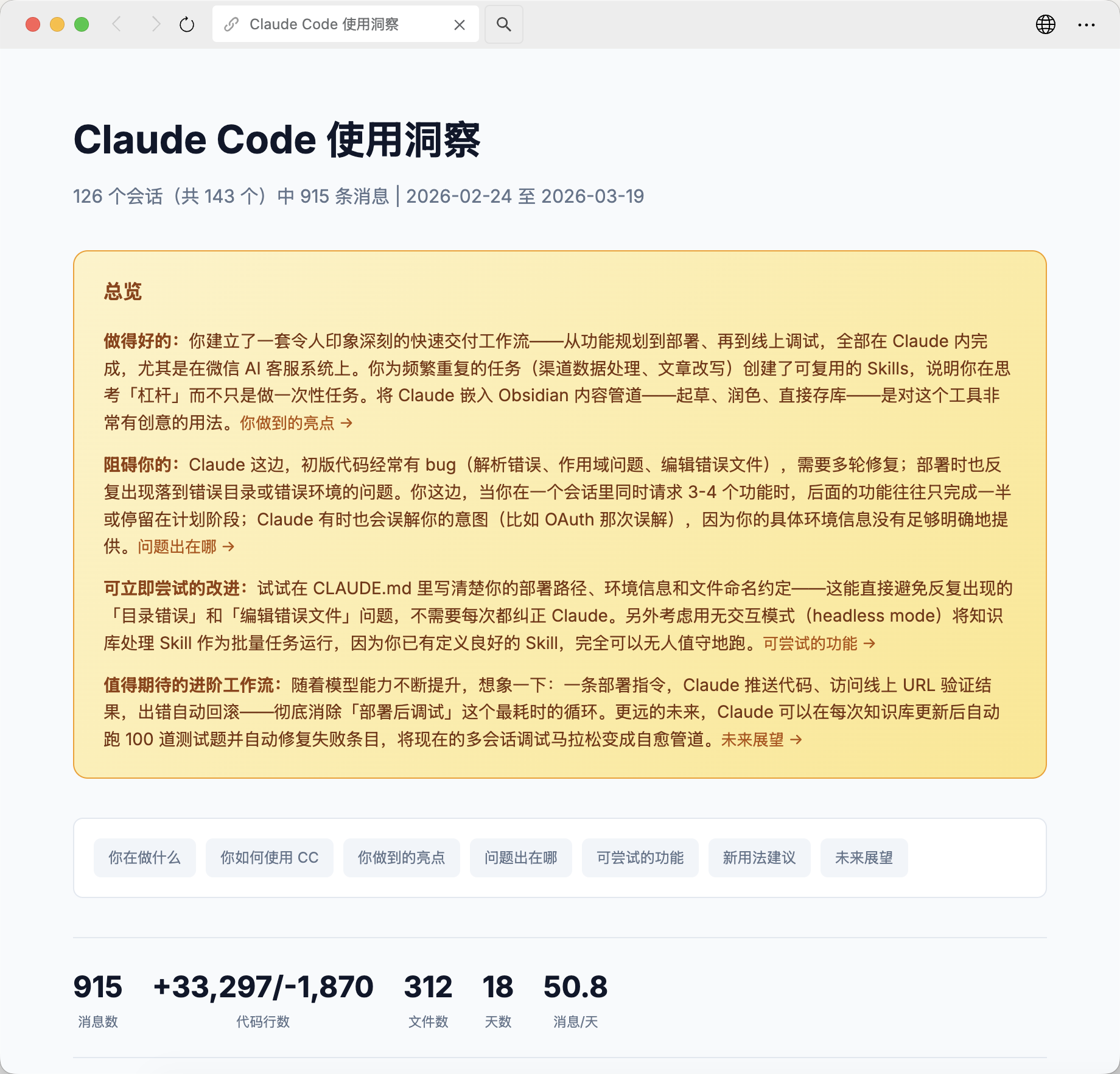

第三层:熵管理——让系统知道哪些路走过了

这是被最低估的一层。Claude Code 有一个 /insight 命令,能根据历史会话生成”年度报告”式的使用洞察:哪些步骤反复卡住、哪些工作流在循环、有什么改进建议。

AI 开始自己给自己的迷宫标洪水填充的数字。人从”地图绘制者”退出了,只负责设定终点。

人类在这场比赛里最该做什么

如果 AI 是电脑鼠,人类不是操控台前的操作员。

人类是唯一能在比赛进行时看见整个迷宫的那个存在。

当 AI Agent 在某个局部死循环时,大多数人的反应是换一个提示词再试——等于用不同姿势推老鼠撞同一面墙。真正有价值的做法是:在 AI 自主探索的时候,人去研究整体格局。

找到那堵墙在哪、为什么在那、绕过去的路有几条。然后在关键节点给 AI 做方向级别的指引,而不是步骤级别的“机枪阵地向左移动5米“的纠错。

以 token 计算,AI 的单步效率是人的10到1000倍。但只有人能给它正确的方向——错误方向上的1000倍速度,只会更快地撞墙。

还有一道墙,目前没有人能绕过

电脑鼠进化了50年——从贴墙走,到洪水填充,到真空吸附、走对角线。每一代都在同一套规则下突破上限。

但有一个限制从未真正突破:它只能感知迷宫里的信息。

AI 也是如此。它读过的书比任何人都多,但它没有在草坪上踢过一场球,没有看见过一个人真实地笑。它不理解物理,不感知时间,不知道疼是什么感觉。

下一代真正的突破,或许不是更大的模型,而是世界模型和具身智能——让 AI 真正感受到这个世界。当那一天到来,我们就不再是在帮电脑鼠找迷宫的出路了。

那一刻,可能也是硅基生命真正降临的时刻。

在那之前,让我们先把 Harness 设计好。

本文由 @被抢了名字的Kimi 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自用户提供

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益