一文通:全面初识AI,以点外卖场景为例

AI点餐系统正在重构外卖体验的核心逻辑——从自然语言处理、接口调用到智能决策的全链路闭环。本文将深度拆解AI如何通过语言大模型解析'三杯去冰伯牙绝弦'这样的复杂指令,如何在多平台间执行'货比三家'的决策算法,以及怎样平衡自动化与用户控制权的哲学命题。

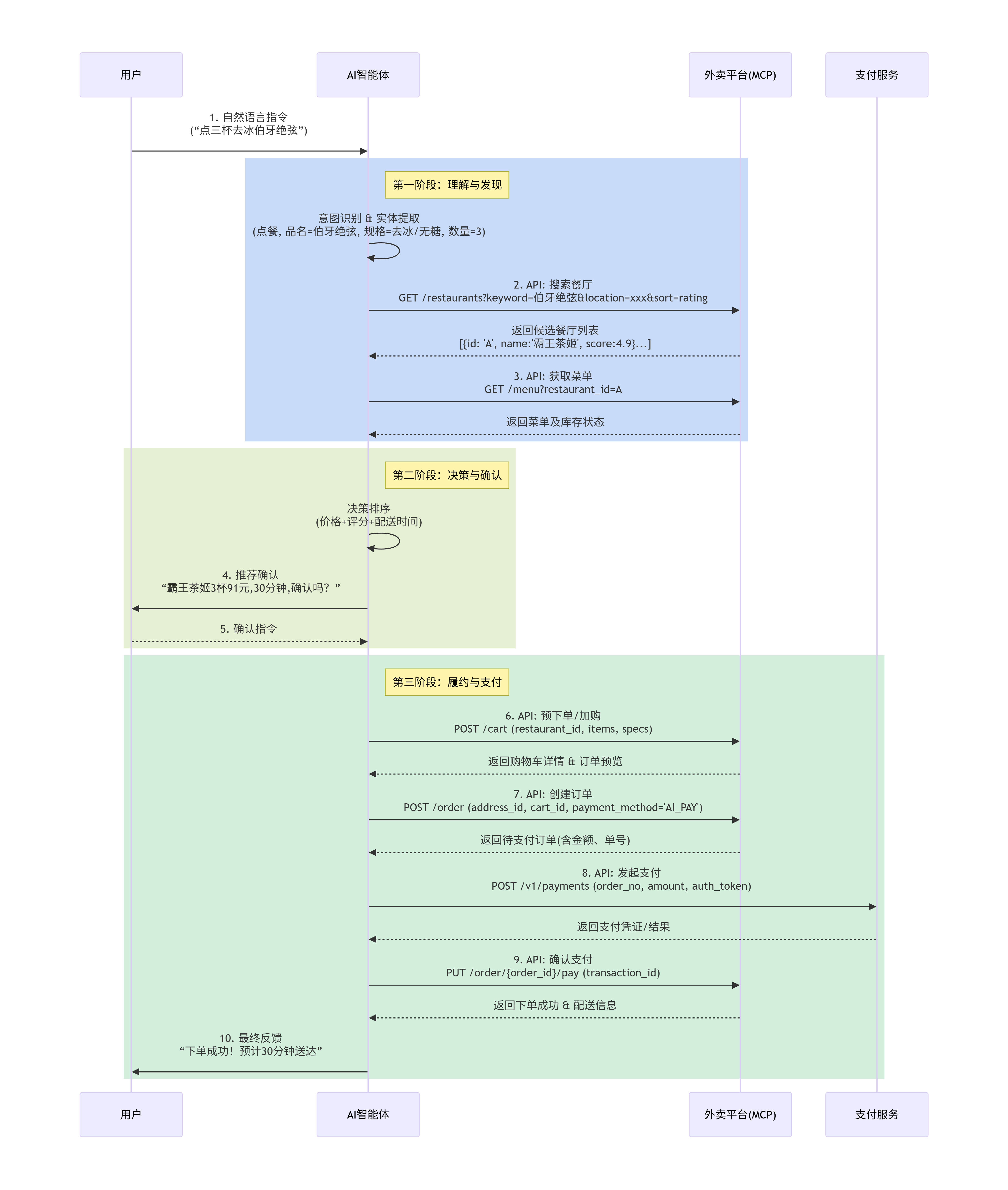

从命令点餐到下单成功的AI执行全流程:

自然语言处理

如图“1、点三杯去冰伯牙绝弦”,AI接受指令后,需要对用户语言进行翻译处理,即处理成系统能够理解的输入项。

拆解结果,(意图)任务 “点餐”,(信息)数量“三杯”,冷热“去冰”,品名“伯牙绝弦”。

语言类型:文字输入、音频输入、支持多个语种。

根据系统版本迭代和实际需求情况,先从文字输入中文,再逐步优化是合理的。解读文本含义,提取文本信息是基础的AI工作内容。需要利用调整过的语言大模型AI完成。

扩展思考1

假设,外卖平台点餐必须填写甜度“三分糖,七分糖,标糖”。①AI可能追问,甜度信息(也可能是其他信息,如小料)。②在获取店铺菜单信息后,再追问用户,供用户选择。③AI根据用户点餐历史、偏好设置等判断用户高概率决策结果。

①与②,追问用户没有提供的信息,追问时机不同,AI与系统处理方式、工作方式不同。

如,一种是AI已熟悉各平台对菜单参数值,拆解用户语言后,对未明确的信息-“甜度”-追问用户,此时AI未调用平台接口,而是经过前期训练、熟悉外卖平台各菜单的结果。此方式,前期需要训练AI,后期根据平台迭代不断更新,而且AI追问的信息不一定全用,比如“小料”,此项可能有、可能没有;

一种是AI找到平台店铺并调用了店铺菜单信息,发现有些信息-“甜度”-用户未提到,针对缺失信息询问用户;一种是AI根据用户历史及偏好全权代理用户点餐。

另(反思):点餐过程中,未明确的条件项是否交由AI全权决策?可能问题,用户通常喜欢甜度“标糖”,今天只接受“无糖”或“三分糖”。

调用接口

AI作为“人的代理”,它不执行下单功能,而是代替人操作。例如,用户点外卖的步骤“打开平台-关键词搜索-找到店铺-选中商品-选择商品参数-提交订单-支付”,AI工作内容是,选择平台,搜索店铺,提交商品订单等。

如图“2、API:搜索餐厅”“3、API:获取菜单”,AI只是执行动作,给(输入)关键词“伯牙绝弦”,系统获得关键查询餐厅(系统功能),返回餐厅信息给AI。

扩展思考2

AI实际工作是不执行功能,而是像人一样用系统功能。

在进行AI产品需求分析时,考虑从用户操作方式、步骤开始,分析AI产品功能点。

如AI客服产品,观察记录人工客服处理问题的步骤“收到客户信息-查看客户详情-是否有客户订单信息-客户问题类别-回答公式…”

AI客服产品能力“偏客服类自然语言处理”“调用客户管理信息”“调用客户订单信息”“调用客户问题知识库”等。

整体逻辑是“接受语言信息,获取系统内客户相关信息、商品信息、知识库,综合各方信息回答问题”。

AI决策

用户在查询店铺和商品后,会“货比三家”,现在交由AI进行决策。

决策维度:店铺评价,店铺商品评价,价格,配送距离,用户偏好,历史记录等。

决策结果:推荐排行TOP10,排名第一优先原则等。

AI决策计算方式(常见):各决策维度权重乘以决策维度分值的总和。如:店铺评价权重×分值+价格权重×分值+…

怎么确定决策维度?

当前市面上系统产品的字段值。如:美团点奶茶有“甜度”“小料”;品牌点餐小程序有“温度”“甜度”。已存在维度。

用户访谈。当你点奶茶时,注重看什么信息?调研新维度。

从各方角度挖掘。在点餐场景中,“店铺”,店铺评价、店铺商品等,“用户”,口味偏好等,“外卖服务”,配送距离、配送平台等。

怎么确定决策维度权重?

业务专家定义:行业经验的沉淀,作为出厂设置值较为合理。

历史数据统计:利用现有海量数据,用统计计算方法确定系统权重。

AB测试验证:通过上线功能记录用户数据,算法计算结果,AI根据数据自我微调。

决策结果用哪种方式?

一种,提供用户选择。一种,设计AI决策结果仅支持一种实现。

“推荐排行TOP10”,如图所示,需要用户做最终决策,即用户根据AI综合评估选择。AI获得决策维度信息需进行计算、排名,将结果给到用户。

“排名第一优先原则”,完全交由AI代理点餐,分值高即下单点餐。AI计算后,直接提交下单。

扩展思考3

本例中,“评价”作为决策维度加入综合评分计算,假如80%的评价是伪造,AI计算获得的排行结论就会失去权威性,即AI不可信。

问题:AI能否判断信息真伪?

当前的AI判断机制,本质上不是“判断真伪”,而是“判断一致性”:

输入消息 → 与训练数据比对 → 计算“与可信模式匹配程度” → 输出置信度

AI做的其实是:

模式匹配:这个消息像不像我见过的“可信消息”?

一致性检验:和我知道的其他事实矛盾吗?

来源分析:发布者像不像可信来源?

逻辑自洽性:内部有没有矛盾?

这不是真正的“理解”,而是“统计推断”

就像你从未去过巴黎,但可以根据无数人的描述,判断一个人说“埃菲尔铁塔在罗马”大概率是错的——不是因为你去过,而是因为和你已知的模式冲突。

场景模拟:一则未经证实的消息

“某国领导人秘密签署了一份文件,计划下周宣布重大政策调整”

没有确切真假答案,因为:没有官方确认;没有可靠信源证实;也没有明确证伪。

AI可能启动的“自我判断”流程,如下:

第一步:多方信源交叉验证

信源A:消息称…(匿名官员)

信源B:未听说此事(官方发言人)

信源C:分析认为可能…(智库专家)

AI会计算信源可信度权重,给出综合判断。

第二步:逻辑一致性检验

与该国常规决策流程是否一致?

与近期政策方向是否矛盾?

宣布时机是否有政治逻辑?

第三步:预测与验证等待

如果消息是真的,接下来会发生什么?

设定可观察的“验证点”

等待后续发展来确认或证伪

第四步:不确定性量化

输出时附带置信区间

标注信息缺口和假设前提

建议验证方法

根据上述场景模拟说明,从哲学层面理解人类与AI对信息真伪的判断方式。不同在于

人类的“知道”:

基于感官经验

基于社会共识

基于逻辑推理

有“主体性体验”

AI的“判断”:

基于数据统计

基于模式匹配

基于算法逻辑

没有“主体性体验”

扩展思考4

AI全权决定与用户参与决定。

图片实例中,AI计算结果返回信息请用户确认点餐,最终点餐权交由用户操作-“确认”。

假如完全交由AI决策并确认,可能出现的问题,AI通过历史记录数据,判断用户常点“标糖”,AI本次点了“标糖”,用户本次可能要点“无糖”,那么这次点餐结果是不符合用户需求的。

在点外卖场景中,AI具体干了什么?AI可能经历哪些训练?

综上所述,AI主要干了三件事情:沟通交流(语言处理、语言组织),获取信息(调用系统接口),决策判断(数据权重计算)。:

微调语言大模型。

接口调用训练,调用顺序训练、信息获取。

数据计算,考虑用户不断变化的偏好,自主更新,实现个性化决策判定。

本文由 @产品-子鱼 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益