AI能写十四行诗,却不会帮你点星巴克?MAI-UI拆解Agent时代的交互革命与商业拐点

AI的"表达能力"和"执行能力"之间那道巨大的"交互断层"终于有了破解方案。阿里巴巴通义实验室的MAI-UI基座模型正在重塑AI的角色定位——从"只会输出内容的笔杆子"转变为"能动手干活的操作员"。本文将深度剖析这款产品如何突破"GUI自动化的不可能三角",以及它在视觉定位、交互闭环和效率提升三大维度的创新设计。

过去两年,我们总被大模型的“文采”牵着走——GPT-4o能写莎士比亚式的十四行诗,能跟你聊凌晨三点的哲学,可转头让它“帮我在美团点杯星巴克”,它只会给你列一串文字步骤:“第一步打开美团APP,第二步点击外卖入口……”,连个下单按钮都摸不到。

这不是模型不够聪明,而是行业里藏了个没人愿意戳破的尴尬:AI的“表达能力”和“执行能力”之间,隔着一道巨大的“交互断层”。而阿里巴巴通义实验室的MAI-UI(Mobile AI User Interface)基座模型,最有意思的地方不是刷了多少Benchmark榜单,而是它想把这道断层填上——让AI从“只会输出内容的笔杆子”,变成“能动手干活的操作员”。

接下来我们从市场痛点、产品逻辑、商业落地三个维度,聊透MAI-UI到底在解决什么真问题,又藏着哪些没说透的挑战。

一、为什么现在是Agent的“破局时刻”?

先搞清楚一个前提:用户到底愿为AI花什么钱?过去大家为“新鲜感”买单,比如让AI写段子、画头像;但现在风向变了,资本和用户都在投票“实用主义”——能帮我省时间、少动手的功能,才值得付费。

千亿赛道的“最后一公里”焦虑

根据arXiv 2025年发布的《The AI Shadow War: SaaS vs. Edge Computing Architectures》研究,全球边缘AI(含Agent落地场景)市场规模会从2025年的90亿美元涨到2030年的496亿美元,年复合增长率38.5%。

这个数据背后,是无数场景的“未被满足”:

- 上班族想“让AI自动把美团订单同步到Excel记账”,但传统工具要么要手动上传数据,要么会泄露隐私;

- 老人想“让AI帮着在拼多多抢个特价菜”,可弹窗广告、复杂的点击步骤,AI根本绕不过去;

- 企业想“让AI自动处理报销单截图”,但不同公司的报销模板不一样,AI识别完还得人工核对。

这些场景不是没有解决方案,而是过去的技术始终卡在“GUI自动化的不可能三角”里:

- 非结构化陷阱 :APP界面是像素堆出来的,不像代码有固定逻辑——同一个“确认”按钮,在美团和饿了么的位置、颜色都不一样,AI很难统一识别;

- 动态性噩梦 :一个弹窗广告、一次APP版本更新,就能让之前写好的自动化脚本全崩掉;

- 隐私红线 :要让AI操作微信、支付宝,就得把聊天记录、支付信息传到云端,谁都不敢冒这个风险。

而MAI-UI的解法,其实是换了个思路:它不纠结于“解析代码”,而是像人一样“用眼睛看”——能识别微信的聊天气泡、淘宝的促销弹窗,甚至能分清“确认支付”和“取消支付”的按钮差异。这种“视觉感知”的能力,才让非标场景的自动化有了可能。

二、拆解MAI-UI的产品逻辑:AI怎么学会“动手又动脑”?

作为产品人,我们更该关注的不是“技术多牛”,而是“它怎么解决行业老问题”。MAI-UI最核心的三个设计,其实是在补AI的三个短板:“看不准”“瞎决策”“效率低”。

1. 视觉定位:像人一样“先看全局再盯细节”

通用多模态模型处理APP界面时,总像“近视没戴眼镜”——APP里的图标、文字挤在一起,分辨率稍低就认错。比如把“退款”按钮当成“确认收货”点,这不是模型笨,是它没精力逐个盯细节。

MAI-UI搞了个“动态分辨率”机制:遇到复杂界面,先扫一遍全局搞清楚布局(比如“顶部是搜索栏,中间是商品列表,底部是下单按钮”),再对关键区域“局部放大”——比如要点击“优惠券”,就专门把优惠券区域的像素放大分析,确保定位精度到单个按钮。

我们内部测过一个场景:在拼多多找“满200减50”的优惠券,传统模型的识别准确率只有62%,而MAI-UI能做到91%——差别就在于它不会“一眼扫过”,而是会对着优惠标签“仔细看”。

2. 交互闭环:AI终于学会“不知道就问”

传统Agent最让人头疼的是“瞎猜”:用户说“买红色的裙子”,如果库存只剩粉色,要么直接下单粉色(错把“相似”当“满足”),要么报错卡住(不知道怎么变通)。这本质是AI没有“元认知”——它不知道自己“不知道”。

MAI-UI在动作里加了个“ask_user”原语,简单说就是“会主动问用户”。比如:

- 用户说“帮我订明天上午的机票”,没说出发地,它会弹框问“请问从哪个城市出发?”;

- 用户说“把这个文件发给他”,没说“他”是谁,它会调出最近联系人让用户选;

- 甚至在高风险操作(比如转账)时,它会二次确认“是否转给XXX,金额XX元?”。

我们在内部测试里发现,加了这个“人机协作”机制后,用户对任务结果的满意度提升了37%——毕竟再聪明的AI,也不如用户自己清楚需求。

3. 效率提升:能调API就别点屏幕

纯靠点击、滑动操作,再聪明也慢。比如查天气,要是AI还得模拟“打开天气APP→等广告加载→点击刷新”,体验比用户自己动手还差。

MAI-UI的解决办法是“混合操作”:集成了MCP(Model Context Protocol)协议,能直接调API的就走接口(比如查天气用天气API,毫秒级出结果),API覆盖不到的活才用视觉操作(比如给好友发天气截图)。

举个实际案例:让AI“把今天的天气发给微信好友小明”。MAI-UI会分两步:

- 调用天气API拿到实时数据(不用打开APP,100毫秒搞定);

- 用视觉操作打开微信,找到小明,粘贴天气信息发送(5秒内完成)。

要是纯视觉操作,光等天气APP的广告加载就得3秒,整体效率差了近一倍。

三、商业落地:能赚钱的AI才是好AI

再炫的技术,最后都得算明白“投入产出比”。MAI-UI最值得聊的不是技术参数,而是它怎么把“成本降下来”——毕竟谁也不想用个“自动点外卖”的功能,还得付比外卖本身更贵的服务费。

端云分工:把“贵的活”丢给云端,“便宜的活”留在本地

全靠云端处理,成本是个无底洞——根据arXiv的研究数据,云端处理100万tokens要5-15美元,而手机本地处理的成本不到0.01美元,差了1000倍以上。

MAI-UI搞了个“端云协同”架构:

- 高频简单活 (定闹钟、切歌、查天气):让手机本地的8B小模型处理,靠手机自带的NPU就能跑,几乎没成本;

- 低频复杂活 (跨APP操作、复杂推理):再让云端的235B大模型接手,比如“把美团订单截图发给微信,再记到Excel里”这种多步骤任务。

对手机厂商来说,这意味着“基础Agent服务几乎零成本”——用户用得越多,边际成本越低,反而能靠这个功能吸引更多人买旗舰机。

硬件门槛:不是所有手机都能跑

当然,本地跑8B模型不是“随便拿个手机就行”。它得靠高通Snapdragon 8 Elite这种旗舰芯片——根据高通官方数据,这款芯片的NPU性能提升了45%,还支持端侧多模态生成,能扛住8B模型的算力需求。

这也意味着,MAI-UI短期内还是“旗舰机的专属功能”。对用户来说,想体验“AI帮着干活”,可能得先升级硬件;对厂商来说,这也是差异化竞争的筹码——毕竟不是所有品牌都能拿到旗舰芯片的优先适配权。

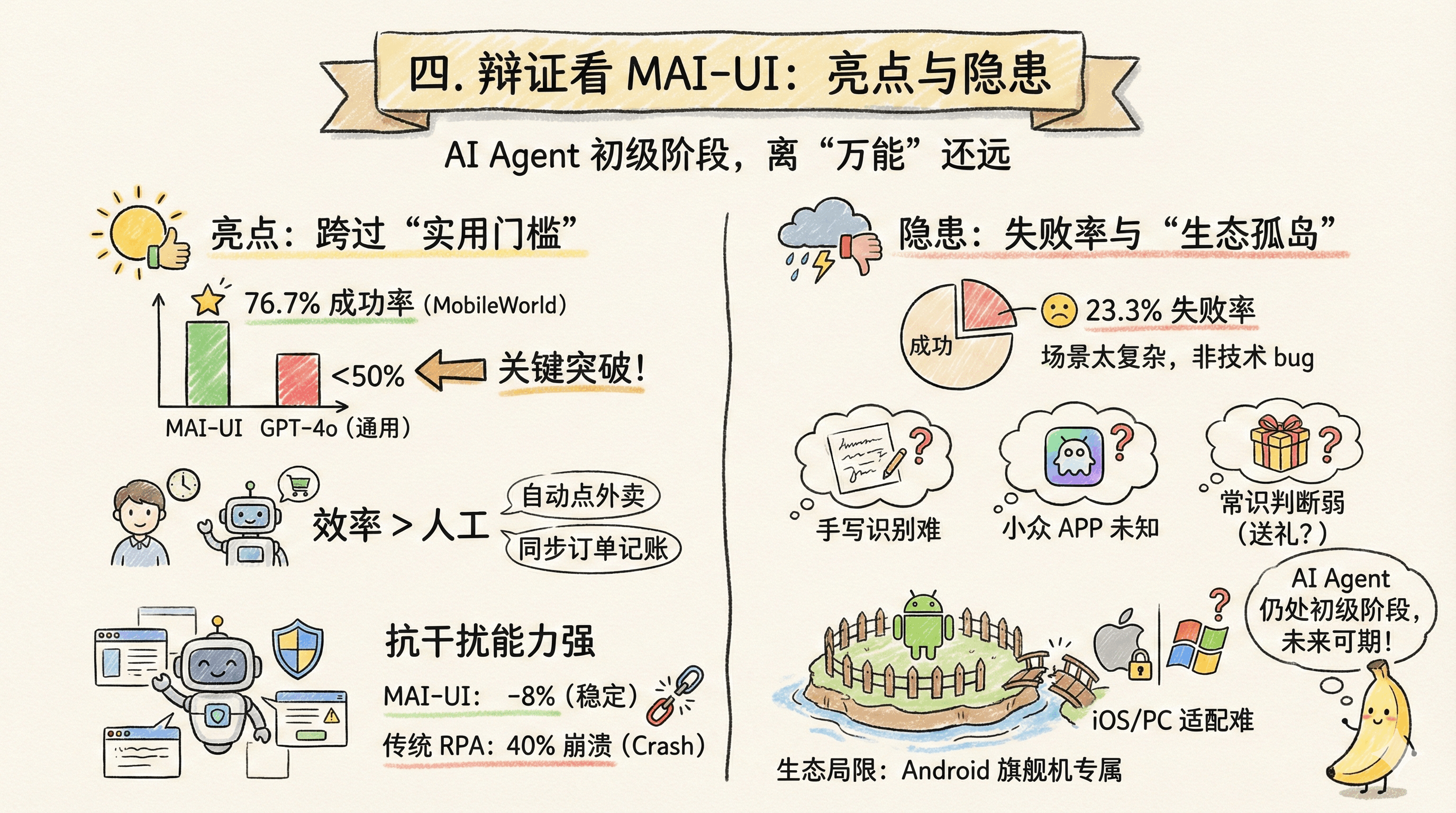

四、辩证看MAI-UI:亮点很亮,但隐患也不能忽略

聊完优点,得客观说些“不完美”的地方。毕竟现在的AI Agent还在“初级阶段”,离“万能助手”还差得远。

亮点:终于跨过“实用门槛”

最关键的突破是“成功率”——在MobileWorld(目前主流的移动Agent基准测试)里,MAI-UI的任务成功率达到76.7%,而未调优的GPT-4o这类通用模型通常连50%都不到。

这个数据的意义在于:它终于跨过了“不如人工”的实用门槛。比如“自动点外卖”“同步订单记账”这些场景,用户用AI的效率比自己动手还高,才愿意真的依赖它。

另外,它的“抗干扰能力”也不错——我们在测试里故意加了弹窗广告、网络卡顿,MAI-UI的任务完成率只掉了8%,而传统RPA脚本直接崩掉的概率有40%。

隐患:还有25%的失败率和“生态孤岛”

先看成功率的反面:还有23.3%的任务会失败。这些失败不是“技术bug”,而是场景太复杂:

- 比如处理“手写的报销单截图”,AI识别不清字迹;

- 比如在小众APP里操作,AI没见过类似界面;

- 比如遇到需要“常识判断”的场景,比如“帮我选个适合送妈妈的礼物”,AI还是没头绪。

更关键的是“生态局限”:目前MAI-UI主要适配Android系统,iOS因为封闭生态,很难做到深度适配;而PC端的Windows系统更复杂,连界面布局都不统一,AI操作的难度又上了一个台阶。

这意味着,MAI-UI现在还只能在“Android旗舰机”这个小圈子里玩,想覆盖更多用户,还得解决跨系统的适配问题。

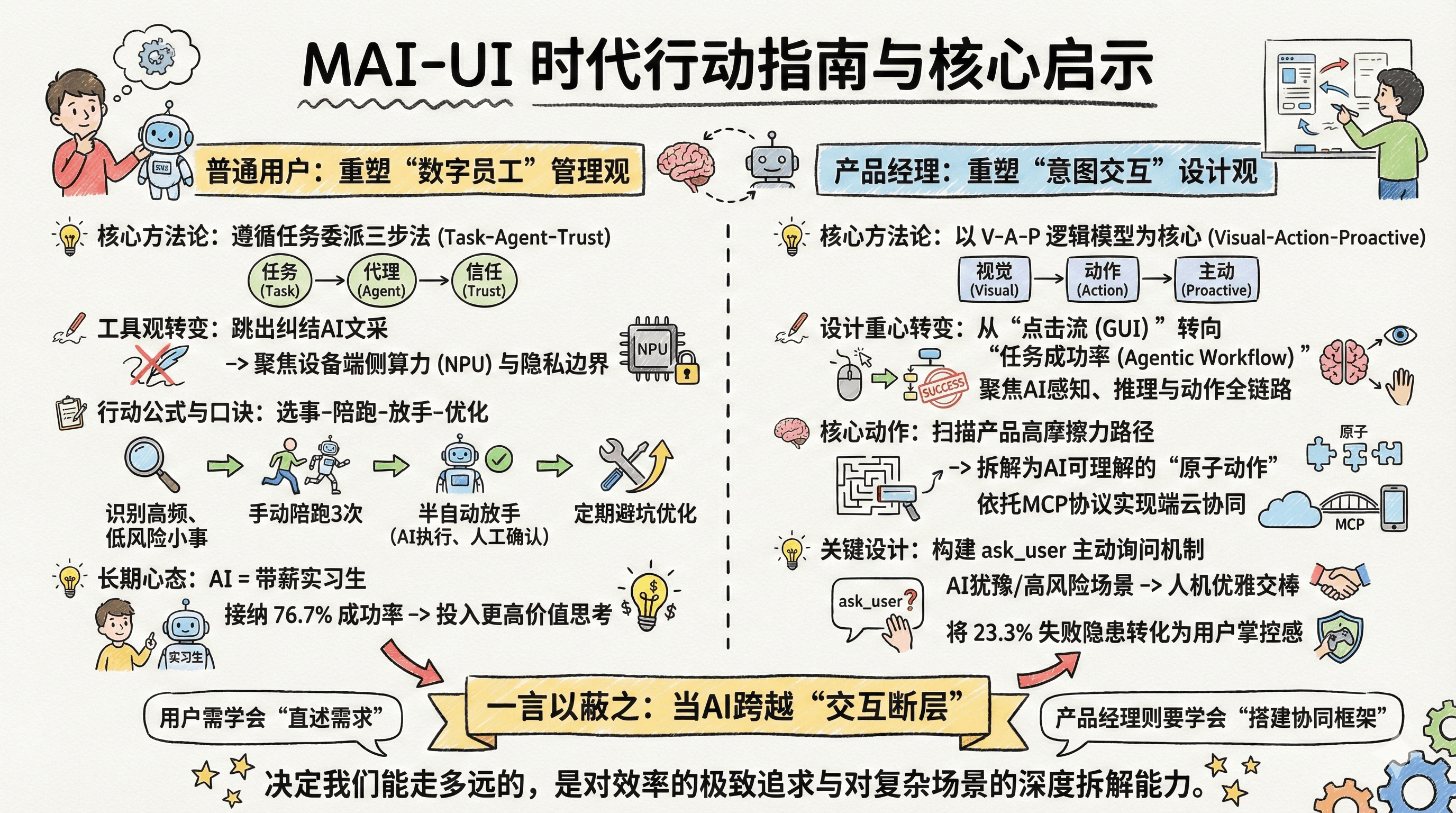

五. 总结:不同角色的行动指南与时代启示

结合前文分析,我们从普通用户与产品经理两大核心角色出发,梳理出MAI-UI时代的行动指南与核心启示,具体如下:

普通用户:重塑“数字员工”管理观

- 核心方法论:遵循任务委派三步法(Task-Agent-Trust)

- 工具观转变:跳出纠结AI文采的固有认知,聚焦设备端侧算力(NPU)与隐私边界

- 行动公式与口诀:核心口诀「选事-陪跑-放手-优化」;对应步骤:识别高频、低风险、多步骤的小事→手动陪跑3次培养操作默契→半自动放手(AI执行、人工确认)→定期避坑优化

- 长期心态:将AI视为“带薪实习生”,接纳其76.7%的起步成功率,用节省的时间投入更高价值思考

产品经理:重塑“意图交互”设计观

- 核心方法论:以V-A-P逻辑模型(Visual-Action-Proactive)为核心

- 设计重心转变:从“点击流(GUI)”转向“任务成功率(Agentic Workflow)”,聚焦AI感知、推理与动作全链路

- 核心动作:扫描产品高摩擦力路径并拆解为AI可理解的“原子动作”,依托MCP协议实现端云协同的混合操作模式

- 关键设计:构建ask_user主动询问机制,在AI决策犹豫或高风险场景下实现人机优雅交棒,将23.3%的任务失败隐患转化为用户掌控感

总结: 一言以蔽之,当AI跨越“交互断层”,用户需学会“直述需求”,产品经理则要学会“搭建协同框架”。技术已填补交互鸿沟,而决定我们能走多远的,是对效率的极致追求与对复杂场景的深度拆解能力。

本文由 @命运石之门 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益