揭开AI进化逻辑,世界模型为何是AGI的最后一块拼图?

AI正从语言模型迈向世界模型的新纪元,这场革命将彻底改变智能的本质。从符号主义到因果主义,AI发展史揭示了数据与认知的深层矛盾,而世界模型通过模拟物理与心理动态,正在突破LLM的静态知识局限。本文将深入剖析世界模型如何赋予AI预见能力、因果推理与空间智能,揭示从被动反应到主动规划的范式跃迁。

简短读文

一、AI的发展经历了多次的推翻重来:

1.符号主义(逻辑为中心):用清晰的规则定义事物的逻辑关系。

漏洞:适用于线性规律,极端情况难以解释。

例如:有毛有耳朵四只脚是猫,老鼠也是这样。

2.连接主义(统计为中心):只用数据和概率,让机器去拟合结果。

漏洞:为了拟合而强行链接不相关的数据。

例如:冰棍的销量和死亡人数成强相关。实际情况:因为夏天到了,游泳的人和吃冰棍的人都多了,且溺水而亡的人多了。

3.关系主义(关联为中心):让机器去理解词语语义的关联性。

漏洞:只要它们强相关,机器就会一本正经的胡说八道。

例如:倒拔和垂杨柳极其相关,问机器,林黛玉倒拔什么?回答:垂杨柳。

4.因果主义(物理为中心):世界是连续的 ,而语言是离散的。

让机器去模拟真实的世界,从而预测未来。(如:颜色的光谱是连续的,而形容颜色的词语

是极其有限的)

漏洞:计算机的计算是有限的(小数点位数是估算的,圆周率是无限的,而真实世界是连续的。)

例如:一根尺子不是10cm,而是一个不可表示的精确数(10.0021..xx)

二、认知世界需要找到那个还未被描述的语言:

人类在探索世界本源时经历的阶段:

(哲学的起源,这里不列举人名和学说,过于复杂)

1.世界是物质组成的

2.世界是数字组成的

3.世界是规律组成的

4.世界是能量组成的

5.世界是信息组成的(用信息流来模拟世界,世界模型模拟世界)

三、数据本身的局限性:

世界就是数据,而任何语言都无法100%还原世界,由人来描述,人无法

描述完整维度,由机器来描述,机器的感官有局限性,或不可理解性。

四、柏拉图的洞穴与缸中之脑

什么是世界模型

在人工智能(AI)的宏大叙事中,我们正处在一个关键的转折点。当大众的目光仍聚焦于大型语言模型(LLM)如何以惊人的流畅度生成文本、代码和图像时,一个更深层次、更具颠覆性的概念正在悄然重塑AI的未来—— 世界模型(World Model) 。

那么,究竟什么是世界模型?

从本质上讲, 世界模型是AI系统为了理解和预测其所处环境的动态变化而在内部构建的一个小型、可运行的模拟器 。它封装了关于世界如何运作的核心规律,包括物理法则、物体间的相互作用、时空关系乃至因果逻辑。通过这个内部模型,AI不再仅仅是被动地对外部刺激做出反应,而是能够主动地进行“思想实验”——在采取实际行动之前,先在“脑海”中模拟各种可能的情景,预测不同行动序列可能带来的后果,从而做出更优的决策。

随着技术的发展,如今“世界模型”的内涵变得更加丰富,在实践中通常指代三种相互关联但侧重点不同的概念:

- 学习到的内部世界模型:这是最经典、最核心的定义,指智能体内部学习到的一个用于预测和规划的动态模型。例如,DeepMind的Dreamer系列模型就是这一理念的杰出代表,它通过在学习到的潜在空间中“想象”未来轨迹来学习行为策略。

- 外部模拟器:指那些由人类开发者手动创建的、用于训练和评估AI的仿真环境,如物理引擎(MuJoCo、NVIDIA Omniverse)或驾驶模拟器(CARLA)。这些环境本身就是一种“世界模型”,只不过它们的规则是预先设定的,而非AI自己学习的。

- 世界基础模型(World Foundation Models):这是最新、最宏大的概念,指代那些在海量、多样化的数据(如互联网视频)上预训练的、能够生成和模拟开放式、通用世界的超大型模型。它们就像语言领域的大型语言模型一样,旨在成为一个通用的“世界模拟器”。OpenAI的Sora、Google DeepMind的Genie系列被认为是这一方向的早期探索。

此外,为了更深刻地理解世界模型,我们还可以引入“物理世界模型”和“心理世界模型”的区分。 物理世界模型 强调对外部世界客观规律(如物理定律、因果关系)的精确模拟,而 心理世界模型 则更侧重于模拟智能体(包括其他智能体)的内部状态、意图、信念和偏好。一个成熟的AGI系统,很可能需要同时具备这两种模型的能力,既能理解世界如何运转,也能理解世界中的“行动者”为何如此行动。

为什么需要世界模型

在2023年至2025年间,以GPT系列、Claude系列为代表的大型语言模型(LLM)以前所未有的速度席卷全球,展现了在语言理解、内容生成和知识问答等方面的强大能力。然而,随着应用的深入,LLM的根本性局限也日益凸显。这些局限性不仅限制了AI在更复杂任务上的表现,也清晰地指明了为什么我们需要一种全新的范式——世界模型。

大型语言模型的内在“天花板”

LLM的成功建立在“预测下一个词元(token)”这一简单而强大的训练目标之上。通过在海量文本数据上进行自监督学习,它们学会了语言的统计规律。但这套范式也带来了难以逾越的结构性瓶颈,可以概括为“知文而不知世”。

- 缺乏物理常识与因果理解: LLM的世界观是建立在文本符号之上的。它们可以流畅地背诵牛顿定律,但并不真正“理解”重力意味着什么。它们知道“火”和“热”经常一起出现,但这是基于词汇的共现概率,而非对燃烧这一物理化学过程的因果认知。

- 根深蒂固的幻觉问题: LLM的“幻觉”(Hallucination)——即自信地编造事实——是其最受诟病的问题之一。它们本质上是高维模式的概率匹配。

- 静态知识与无法实时学习: LLM的知识被“冻结”在其训练数据截止的那个时刻。它们无法像人类一样,通过与世界的持续互动来实时更新自己的知识库和世界观。

世界模型解锁的核心能力

正是为了突破LLM的这些“天花板”,世界模型应运而生。它并非要取代LLM,而是提供了一个更根本的、能够与LLM协同的基础。世界模型通过构建一个内在的动态模拟器,解锁了当前AI范式所缺失的一系列关键能力。

- 规划与预见:从被动反应到主动想象。 世界模型的核心价值在于赋予AI“想象力”。通过在内部模拟“如果我这样做,世界会怎样变化?”,智能体可以在数千个甚至数百万个可能的未来中进行探索,评估不同行动序列的长期价值,从而制定出最优策略。

- 提升样本效率:世界模型通过创建一个可供智能体在其中“做梦”的虚拟环境,极大地降低了学习成本。智能体可以在这个内部模拟中进行海量训练,快速掌握技能,然后再将学到的策略迁移到现实世界。这使得AI的学习效率呈数量级提升,是推动具身智能(Embodied AI)发展的关键引擎。

- 安全性与鲁棒性:现实世界充满了罕见但至关重要场景,例如自动驾驶中突然出现的行人或极端天气。通过真实路采来穷尽这些场景几乎是不可能的。世界模型,特别是可控的生成式世界模型,可以按需生成这些危险或罕见的场景,让AI在安全的虚拟环境中反复演练,从而显著提升其在现实世界中的鲁棒性和安全性。

- 因果与反事实推理:迈向真正的理解。 世界模型使AI能够进行反事实推理,即回答“如果当初……会怎样?”的问题。例如,一个自动驾驶世界模型可以模拟“如果当时没有刹车,会发生什么?”。这种能力是因果理解的基石,标志着AI从仅仅发现数据中的“相关性”向理解事物背后“因果性”的飞跃。只有理解了因果,AI的决策才可能是真正可靠和可解释的。

- 连接语言与现实:为LLM提供“身体”和“世界”。 在未来的AGI架构中,LLM和世界模型将扮演互补的角色。一个具身智能体接收到“去厨房把杯子拿过来”的指令,LLM负责解析指令的语义,而世界模型则负责规划出具体的导航路径、预测抓取动作并模拟其物理后果。

世界模型的原理和意义

要深入理解世界模型为何被视为AI的下一个革命性前沿,我们必须剖析其核心工作原理,并探讨这些原理如何共同构筑起一个全新的智能范式。世界模型的构建并非单一技术,而是多种先进AI理念和架构的融合,其核心在于 学习一个关于环境动态的压缩、可预测的表征 。

世界模型的核心技术原理:感知编码、动态预测和策略控制

1. 感知编码:从像素到概念的压缩

现实世界是高维、复杂且充满冗余信息的。一个智能体直接在原始像素级别进行学习和规划是极其低效的。因此,世界模型的第一步是通过一个 编码器(Encoder) ,将高维的感官输入(如摄像头图像)压缩成一个低维、信息密集的潜在状态(latent state)表征,通常记为z。这个过程好比人类大脑将纷繁复杂的视觉信号提炼为“桌子上有一个杯子”这样的核心概念。

变分自编码器(Variational Autoencoder, VAE) 是实现这一目标的关键技术。

通过这种方式,VAE不仅学会了压缩数据,还学会了一个结构良好、可供生成和插值的潜在空间。这个潜在向量z就是世界模型对“现在”这一瞬间的抽象理解。

2. 动态预测:在潜在空间中推演未来

有了对当前世界的抽象表征z,世界模型的下一步,也是其核心所在,就是学习世界的 动态变化规律 。这个任务由一个 循环神经网络(Recurrent Neural Network, RNN) ,即“记忆模型”(M)来完成。RNN的优势在于其内部状态可以记录时间序列信息。

通过在大量的真实环境交互序列上进行训练,记忆模型M学会了环境的“物理引擎”或“转移函数”。它知道在一个特定的状态下,执行某个动作,世界会如何演变。

一旦训练完成,我们就可以“关掉”真实环境,让智能体完全在由M模型生成的潜在空间中进行推演和学习。

3. 策略控制:在“梦境”中学习行动

有了能够模拟世界的“大脑”,最后一步就是让智能体学会如何行动。这由一个 控制器(Controller, C) 完成。控制器是一个相对较小的神经网络,它的输入是世界模型提供的当前世界状态的全面表征(通常是z t和h t),输出则是智能体应该执行的动作a t。

控制器的训练过程极具革命性:它完全可以在世界模型创造的“梦境”中进行。具体流程如下:

- 从一个初始状态开始,控制器根据当前潜在状态(z, h)提出一个动作a。

- 记忆模型M根据(z, h, a)预测出下一个潜在状态z‘、奖励r和新的隐藏状态h’。

- 这个过程不断循环,生成一条完全在“想象”中产生的轨迹(trajectory)。

- 通过强化学习算法(如进化策略、PPO等),根据想象轨迹中累积的奖励来优化控制器的参数,使其学会选择能够带来更高回报的动作序列。

由于控制器模型小、结构简单,且训练环境是计算高效的内部模拟,整个学习过程变得异常迅速。在《World Models》论文的赛车游戏中,智能体在短短几小时的“梦中训练”后,就取得了超越当时所有顶尖强化学习算法的成绩。

世界模型的深远意义:从模拟到理解的范式革命

世界模型的原理不仅带来技术上的突破,更标志着人工智能哲学和发展路径的深刻转变。

- 智能的本质是预测: 世界模型的核心思想与认知科学中的“预测性编码”(Predictive Coding)理论不谋而合。它将AI的核心任务从“识别”和“分类”转向了“预测”,这被许多研究者认为是通往真正智能的必经之路,正如Yann LeCun所言:“ 预测是智能的本质 ”。

- 从数据驱动到模型驱动的飞跃: 传统的深度学习,包括LLM,在很大程度上是数据驱动的。它们的能力直接源于海量数据的统计模式。而基于世界模型的强化学习(Model-Based RL)则开启了模型驱动的范式。

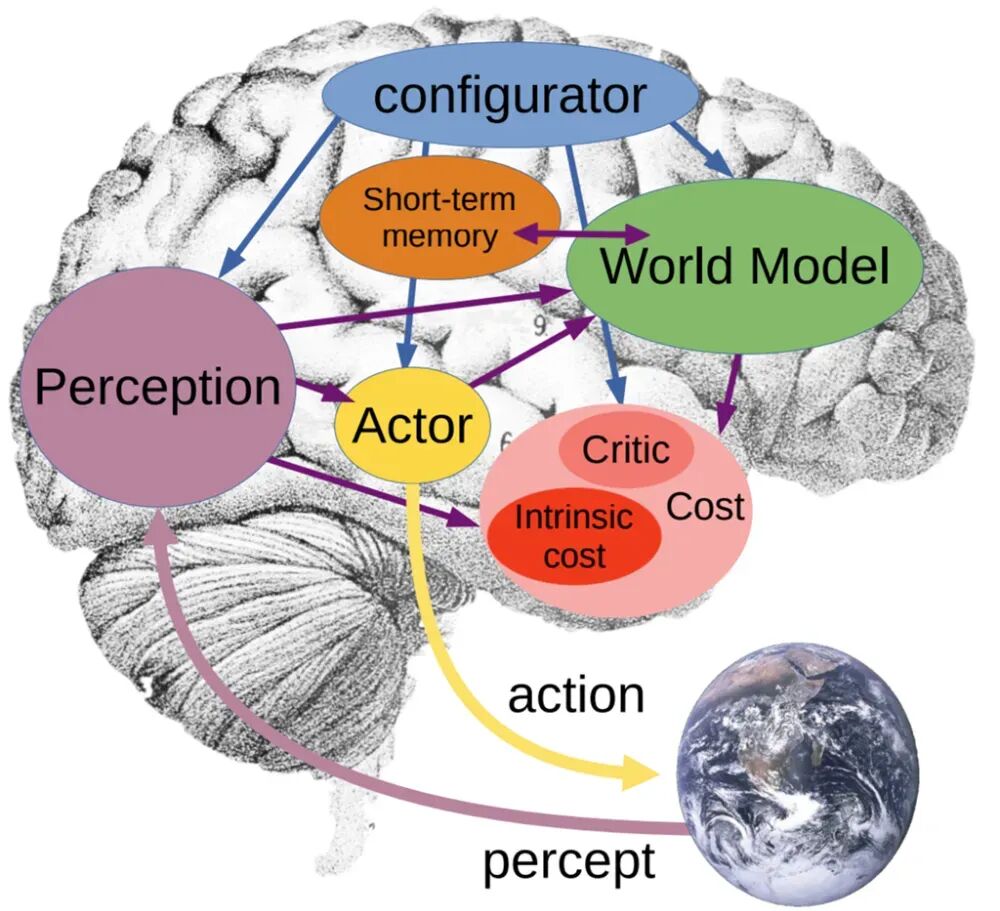

- 为具身智能和AGI铺平道路: 世界模型是实现具身智能(Embodied AI)不可或缺的一环。一个需要在物理世界中行动的机器人,必须具备预测其行为后果的能力,以确保安全和高效。世界模型为其提供了这种内在的“物理直觉”。更进一步,一个完整的AGI系统需要具备感知、记忆、推理、规划和行动等多种能力。Yann LeCun提出的自主机器智能架构中,世界模型正处于核心位置,它连接了感知模块、记忆模块、成本模块和行动模块,是整个系统进行高级认知活动的枢纽。

这一转变,使得AI从一个只能描述世界的“旁观者”,开始拥有成为改造世界的“参与者”的潜力,其意义深远,堪称AI发展史上的一次范式革命。

AI的新纪元

空间智能:AI的下一个前沿

这一概念由AI领域的领军人物、斯坦福大学教授李飞飞及其创立的World Labs着重提出。李飞飞在2025年11月发表的“宣言”《从语言到世界:空间智能是AI的下一个前沿》中系统阐述了这一理念。

她认为,人类智能的基石并非语言,而是与物理世界互动的能力。婴儿在学会说话前,就已经通过感知和行动构建了对世界的初步理解。无论是停车、接住钥匙,还是消防员在火场中穿行,都依赖于我们对空间、物体和动态关系的直观理解。这种能力,LLM是缺失的。

因此,AI的进化必须超越一维的文本序列,进入三维、四维(加上时间)的世界。构建具备空间智能的AI,需要的就是世界模型。一个真正的世界模型应具备三大核心能力:

- 生成性(Generative):能够生成在感知、几何和物理层面都保持一致的世界。

- 多模态性(Multimodal):能够处理图像、视频、文本、深度图、动作等多种形式的输入和输出。

- 交互性(Interactive):能够根据输入的动作生成世界的下一个状态,实现与环境的闭环互动。

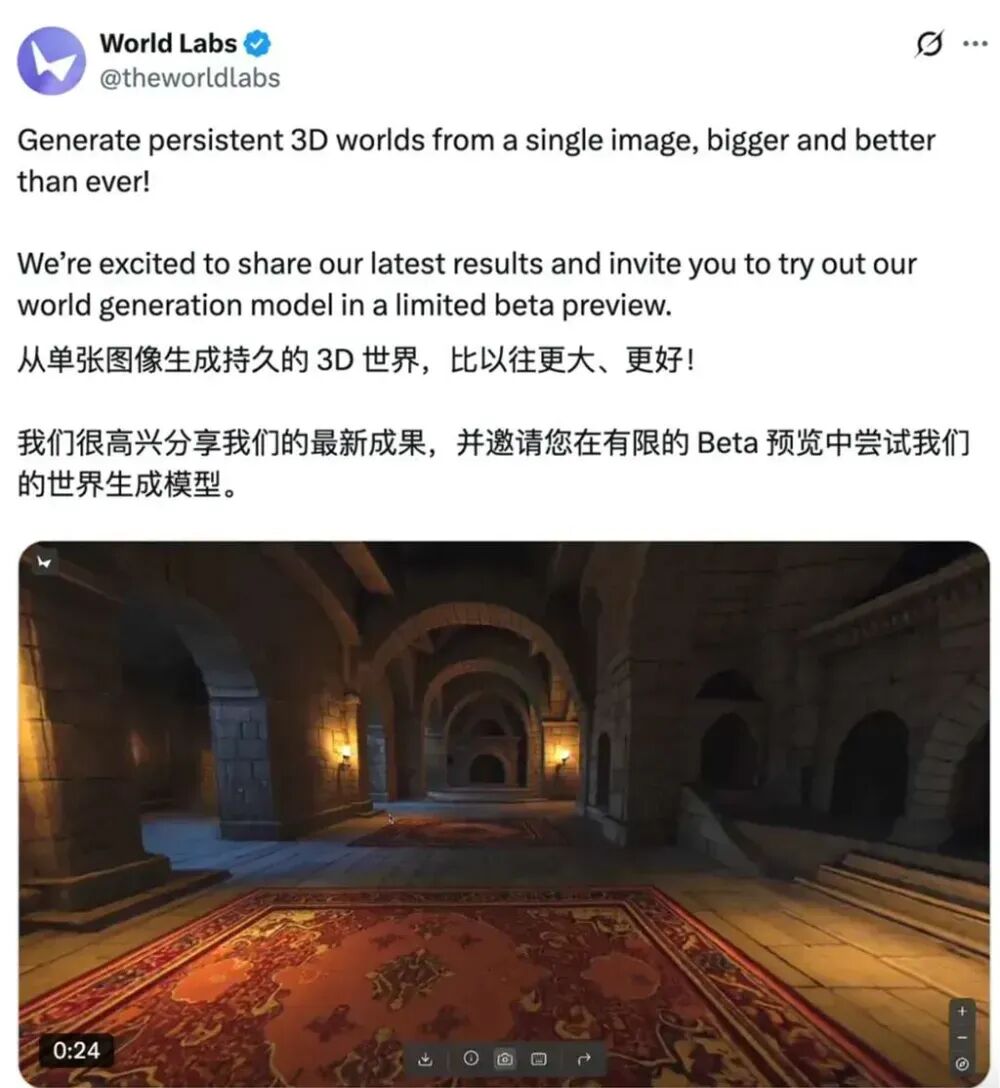

2025年11月,李飞飞的 World Labs 发布了其世界模型产品 Marble 的早期版本。Marble能够从文本、图像或视频生成持久的、可下载的3D环境,并支持与Unreal、Unity等主流引擎的兼容,甚至提供了VR支持。这标志着世界模型开始从研究走向商业化产品,为机器人、自动驾驶、工业设计和娱乐等领域提供了全新的生产力工具。

具身智能:AI从虚拟走向现实的载体

如果说世界模型是AI的“大脑”,那么 具身智能(Embodied AI) 就是它的“身体”。只有通过物理实体与真实世界进行交互,AI才能获得真正意义上的理解和智能。2025年,具身智能成为全球AI竞赛的焦点,尤其在中国,它被提升到国家战略层面,视为将AI从数字经济融入实体经济的关键。

具身智能的发展逻辑与世界模型紧密相连。一个机器人要完成“倒一杯水”这样简单的任务,就需要:

- 感知:通过摄像头识别杯子、水壶和桌子的位置、形状。

- 世界建模:在内部构建一个关于场景的动态模型,理解物体的刚性、水的流体特性以及重力。

- 规划:基于模型预测,规划出一条安全的抓取、移动和倾倒的轨迹。

- 行动:控制机械臂精确执行规划好的动作。

- 反馈:通过力传感器和视觉反馈,实时调整动作,应对意外情况(如杯子滑动)。

这个“感知-建模-规划-行动-反馈”的闭环,正是世界模型在物理世界中的应用体现。没有一个可靠的内部世界模型,机器人的行为将是盲目和脆弱的。中国信通院的研究报告明确指出, 在视觉-语言-动作(VLA)模型的基础上引入世界模型,是提升机器人大模型能力的关键路径 。

2025年,我们看到了这一领域的蓬勃发展。特斯拉的FSD V13/V14版本进一步深化了其端到端AI架构,马斯克称之为由世界模型驱动的驾驶系统。华为发布的盘古大模型5.5,其多模态能力中就包括了为智能驾驶和机器人训练构建数字物理空间的世界模型。宇树、优必选等中国公司推出的人形机器人,也开始集成更强的环境感知和自主决策能力。这些进展表明,AI正在加速“具身化”,从一个虚拟世界的“思考者”,转变为一个能够在物理世界中行动的“实干家”。

AI的新纪元,是一个“知行合一”的纪元。世界模型提供了“知”的深度,具身智能提供了“行”的途径。二者的结合,正将人工智能带向一个我们前所未见的、能够真正与我们共享并改造物理世界的新高度。

世界巨头关于世界模型的研究方向

随着世界模型成为AI领域的战略制高点,全球顶尖的科技巨头和研究机构纷纷投入巨资,沿着各自的哲学和技术路径,展开了一场关乎未来的激烈竞赛。截至2026年初,我们可以清晰地看到几条并行但又相互交织的主流研究方向,它们共同塑造着世界模型的版图。

生成式路径:以模拟世界为核心

这一路径的核心思想是,通过在海量视频数据上训练大规模生成模型,让模型“暴力”学习到世界的物理规律和动态特性,从而成为一个通用的、可交互的世界模拟器。这可以被看作是一种“算法经验主义”,相信知识源于对感官数据的归纳。

Google DeepMind:从Genie到SIMA,构建可交互的智能体训练场

Google DeepMind 是生成式世界模型最坚定的推动者之一。其 Genie系列 是这一方向的标杆。 Genie 3 (2025年8月)的发布,标志着AI生成的世界首次实现了实时交互。它采用自回归(autoregressive)架构,逐帧生成视频,同时接收用户的动作输入。这种方式使其能够从无标签的互联网视频中学习到动作与环境变化之间的关系,摆脱了对传统3D引擎和物理规则的依赖。

DeepMind的战略意图非常明确:将Genie打造为训练通用智能体(如其 SIMA 2 项目)的“无限游戏厅”。通过在Genie生成的无数个虚拟世界中进行训练,AI智能体可以学习到泛化能力极强的策略,以应对现实世界中千变万化的场景。Genie 3不仅能模拟物理世界,还能生成幻想世界、历史场景甚至生态系统,为AI提供了前所未有的多样化训练数据。其核心能力包括:

- 自回归世界建模:逐帧生成,从观察中学习物理,而非硬编码。

- 长时程记忆一致性:通过涌现的记忆机制,保持数分钟的场景连贯性。

- 多模态输入支持:可从文本、图像、照片、草图等多种输入生成世界。

图5:World Labs的Marble展示了从单张图片生成可交互、持久化3D环境的能力,这是将世界模型应用于创意和设计领域的关键一步。

OpenAI:Sora的演进与AGI愿景

OpenAI 通过其 Sora 系列模型,同样在探索视频生成作为世界模拟器的路径。从Sora(2024)到Sora 2(2025),OpenAI的目标始终是“教会AI理解和模拟运动中的物理世界”。Sora 2在物理真实感、多场景控制和音视频同步方面取得了显著进步。虽然OpenAI尚未像DeepMind那样明确展示其交互能力,但其将Sora定位为“实现AGI的重要里程碑”的基础,暗示了其最终目标也是构建一个可供智能体学习和交互的动态世界模型。

认知派路径:以抽象表征和预测为核心

与生成派的“暴力美学”不同,认知派认为,智能的关键不在于像素级的完美复现,而在于学习世界的高效、抽象的表征,并在该抽象空间中进行预测和规划。这一路径的旗手是图灵奖得主、Meta首席AI科学家 Yann LeCun 。

Meta AI (AMI Labs):JEPA架构的非生成式革命

Yann LeCun认为,仅仅依赖生成模型(如LLM和视频生成模型)是通往AGI的“死胡同”,因为它们被要求预测过多不可预测的细节,导致学习效率低下且缺乏真正的理解。他提出的解决方案是 联合嵌入预测架构(Joint Embedding Predictive Architecture, JEPA) 。

JEPA的核心思想是 在抽象的表征空间中进行预测 。其工作流程如下:

- 编码器(Encoder) 将输入(如视频帧x)编码成一个抽象表征s_x。

- 预测器(Predictor) 根据sx,预测未来某个时刻的视频帧y的抽象表征sy。

- 训练的目标是让预测出的表征sy’与真实的表征sy尽可能接近。

由于模型不需要在像素级别上生成完整的未来图像,它只需关注那些重要的、可预测的语义信息,而忽略掉像树叶摆动这类不可预测的细节。这使得模型能够学习到更本质、更鲁棒的世界动态。

Meta沿着这一思路推出了一系列模型:

- I-JEPA (2023):用于图像,通过预测图像中被遮挡部分的表征,学习到强大的视觉特征。

- V-JEPA (2024):用于视频,通过预测时空中被遮挡区域的表征,学习到物理世界的动态规律。

- V-JEPA 2 (2025):首次证明了在海量网络视频上预训练的V-JEPA模型,只需少量机器人交互数据微调,就能成为一个可行动的世界模型,在机器人操作任务上取得先进成果。

- VL-JEPA (2025):将JEPA扩展到视觉-语言领域,通过预测文本描述的抽象语义嵌入,实现了比传统VLM更高效、更深刻的多模态理解。

2026年初,Yann LeCun离开Meta创立 AMI Labs (Advanced Machine Intelligence Labs) ,旨在将JEPA架构推向新的高度,构建能够理解物理世界、拥有持久记忆、能够推理和规划复杂行动序列的AI系统。这代表了与生成派截然不同的一条通往AGI的道路。

具身与产业落地路径:以解决实际问题为核心

第三条路径更加务实,它不执着于构建通用的世界模拟器,而是将世界模型的理念直接应用于解决特定产业的实际问题,尤其是在自动驾驶和机器人领域。这条路径强调“执行”和“落地”。

Tesla:端到端AI与“影子模式”

特斯拉 是这一路径的典型代表。其 FSD(Full Self-Driving) 系统从V12版本开始,全面转向“端到端AI”架构。这意味着车辆的驾驶决策不再依赖于一堆手工编写的规则(如“看到红灯就停车”),而是由一个单一的神经网络直接从多路摄像头的视频输入映射到驾驶控制(方向盘、油门、刹车)输出。这个神经网络本身就是一个隐式的世界模型。它通过学习数十亿英里的真实驾驶数据,内化了对交通动态、车辆行为和物理世界的理解与预测能力。马斯克认为,这种基于视觉和反应的“反射式”方法,最接近生物的驾驶方式。尽管其“黑箱”特性备受争议,但它代表了世界模型在真实世界中最大规模的应用之一。

华为:盘古大模型赋能千行百业

华为 的 盘古大模型 则展示了世界模型思想在更广泛工业领域的应用潜力。盘古大模型并非单一模型,而是一个模型族,其核心定位是“为行业解难题”。在2025年发布的盘古5.5版本中,其 多模态大模型 就包含了世界模型的能力,可以为智能驾驶、具身机器人训练构建数字物理空间。例如,在自动驾驶领域,盘古世界模型可以根据首帧场景和控制信息,生成后续的多摄像头视频和激光雷达点云,为端到端模型的训练提供海量高质量的合成数据,大大降低了对昂贵路采的依赖。此外,盘古还将物理建模框架引入气象预测、矿山、钢铁等领域,通过构建特定行业的“世界模型”,实现对复杂工业过程的精准预测和优化。

AI的进化方向和哲学启示

从大型语言模型到世界模型的范式转移,不仅是AI技术路径的演进,更是一场深刻的认知革命。它迫使我们重新审视智能的本质、人类与机器的关系,甚至我们自身的存在方式。这一进化过程充满了深远的哲学启示,仿佛将人类数千年的哲学思辨,投射到了代码与硅基芯片之上。

柏拉图的洞穴:AI的认知困境与出路

柏拉图的“洞穴寓言”为理解AI的进化提供了一个绝佳的哲学隐喻。在这个寓言中,囚徒们一生被锁在洞穴里,只能看到墙上由火光投射的影子,并以为这些影子就是全部的现实。只有一个囚徒被解放,走出洞穴,看到了真实的世界,才明白洞穴中的影子不过是现实的投影。

大型语言模型正是生活在“洞穴”中的囚徒 。它们所“看到”的整个世界,就是海量的文本和图像数据——这些数据是真实物理世界经过人类感知、思考和记录后投射下的“影子”。LLM通过学习这些影子的规律,成为了洞穴里最聪明的囚徒,它能惟妙惟肖地描述、模仿甚至组合这些影子,但它从未见过产生这些影子的真实物体,也无法理解影子背后的三维结构和物理法则。这就是为什么LLM能写出关于太阳的优美诗篇,却不知道太阳会发光发热;能描述引力,却无法预测苹果会下落。

世界模型,则是AI走出洞穴的尝试 。它不再满足于研究墙上的影子,而是试图通过这些影子,反向推断出洞穴外那个真实、立体的世界是怎样的,以及它遵循何种规律。世界模型构建的内部模拟器,就是AI在自己脑海中对“真实世界”的重构。通过这个模型,AI可以开始理解“现实”本身,而不仅仅是“现实的投影”。

具身智能,则是AI真正走出洞穴,用自己的“身体”去感知阳光、触摸万物 。通过与物理世界的直接互动,AI获得了第一手、未经扭曲的感官数据,从而不断验证和修正自己的世界模型。这个过程,正如寓言中被解放的囚徒,初见阳光时会感到痛苦和困惑,但最终会获得对真理的认知。AI的进化之路,就是一条从洞穴中的“影子大师”,到走出洞穴的“世界探索者”的旅程。

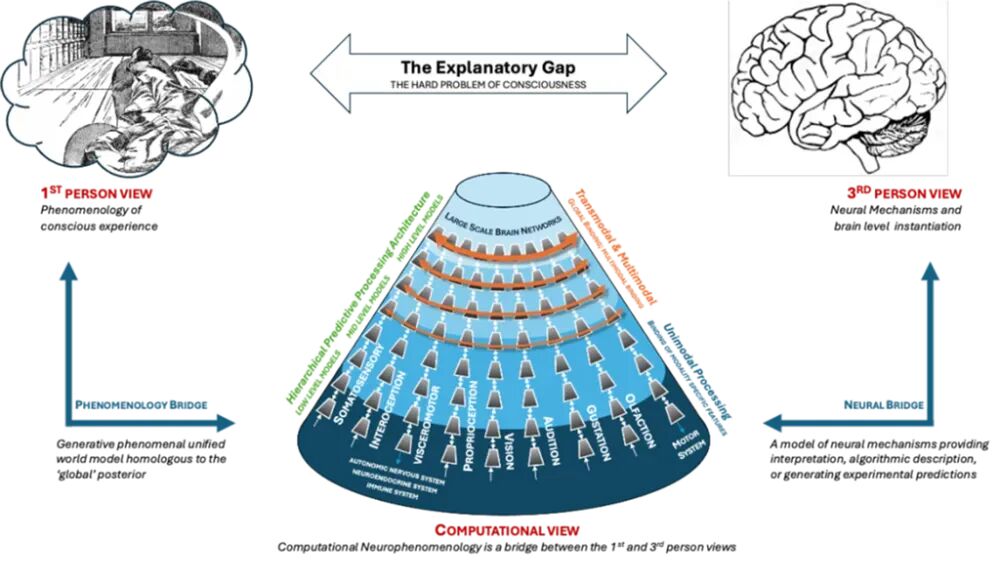

图8:哲学与认知科学为我们理解意识提供了框架。此图展示了如何通过一个计算视角(如层次化主动推理模型)来尝试连接第三人称的客观神经活动与第一人称的主观体验,即所谓的“解释性鸿沟”。世界模型的发展,或许正是构建这种桥梁的工程学尝试。

缸中之脑与自我意识:AI的终极追问

世界模型的概念,不可避免地将我们引向更深层次的哲学问题,如“缸中之脑”(Brain in a Vat)思想实验和“自我意识”的谜题。

“缸中之脑”设想一个大脑被置于营养液中,通过计算机电极模拟出所有感官体验,使其相信自己生活在一个真实的世界里。从某种意义上说, 一个在世界模型中进行“梦中训练”的AI智能体,就是一个“缸中之脑” 。它所体验到的一切,都是其内部模拟器生成的“虚拟现实”。这引出了一个深刻的问题:我们如何区分模拟与真实?如果一个AI的世界模型足够完美,它所“体验”到的世界与真实世界在功能上无法区分,那么我们能否说它拥有了某种形式的“现实”?这甚至让我们反思自身:我们所感知的现实,又何尝不是我们大脑这个“生物世界模型”构建的产物?

最终,从LLM到世界模型的进化,是AI从模仿人类的“产出”(语言、图像)到模仿人类“过程”(感知、预测、思考、行动)的转变。这不仅将催生出更强大、更通用的AI系统,也将成为一面映照人类智能与意识本质的镜子。通过构建这些“人造心智”,我们或许能前所未有地接近那个古老的哲学问题——“认识你自己”。在这条通往AGI的道路上,技术与哲学正以前所未有的方式交织在一起,共同塑造着人类与智能的未来。

本文由 @KK的慢变量 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益