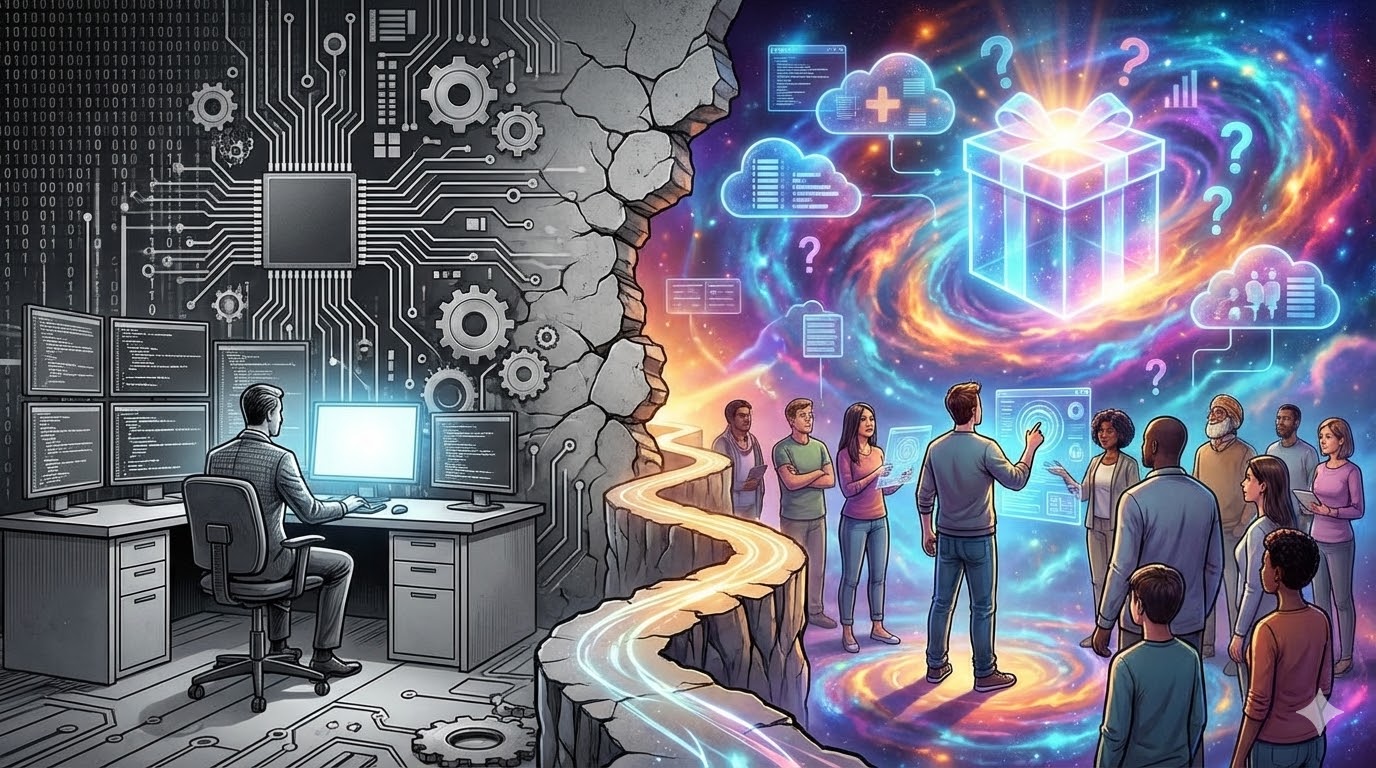

从“非黑即白”到“拥抱盲盒”:一个Java研发转行AI产品经理的破壁之路

如果在代码的世界里,1+1永远等于2;那么在大语言模型的黑盒里,1+1可能等于一个苹果,等于莎士比亚的十四行诗,甚至等于一句直击你灵魂的反问。

我是经历过PC互联网拓荒、移动互联网繁荣,最终一头扎进AI大模型浪潮的老兵。在过去的四年里,我是一名重度强迫症的资深Java开发工程师;而在过去的两年多里,我褪去代码的坚硬外壳,转型成为了一名在不确定性中“走钢丝”的AI产品经理。

今天,中国有数以百万计的泛互联网从业者(涵盖产、研、运全链路)。我们这群人,曾用无数个熬夜发版的凌晨,共同缔造了过去全球最繁荣的应用生态。在这个生态里,我们信奉的是漏斗转化、A/B测试、高并发架构,以及绝对的系统控制权。但在ChatGPT横空出世后的今天,当时代的马车轰隆隆地驶入生成式AI(Generative AI)的新纪元,我们突然发现:曾经让我们赖以生存的旧地图,已经找不到通往新大陆的航线。

这篇文章,是一份长达数千字的深度行业剖析,也是一份写给所有面临职业焦虑、渴望在AI时代重塑自我价值的技术人和产品人的“避坑指南”与“生存手册”。我将亲手撕开那些阻碍我们跨入新时代的认知茧房,带你从Java的“确定性帝国”,走向大模型的“概率性盲盒”。

一、旧世界的坍塌——当“If-Else”遭遇“涌现”与“幻觉”

要理解转型的痛楚,首先要理解我们曾经所在的“舒适区”是何等坚固。

1.1 Java时代的上帝视角:绝对控制的迷幻药

在做Java开发的日子里,我是系统世界的“上帝”。Java是一门极其严谨、甚至有些刻板的语言。我们通过面向对象编程(OOP)抽象现实世界,用强类型定义边界,用Spring Boot框架搭建坚不可摧的后端堡垒,用ACID(原子性、一致性、隔离性、持久性)原则死死捍卫着数据库的绝对尊严。

在那个世界里,逻辑是非黑即白的。用户的每一个网络请求,都会顺着我写好的控制器(Controller)进入服务层(Service)。如果是VIP用户,就走If分支逻辑;如果是普通用户,就走Else分支逻辑。哪怕是系统崩溃,也会抛出一个精确到具体代码行数和堆栈信息的NullPointerException(空指针异常)。

我们习惯了做“确定性”的独裁者。只要代码没写错,只要压测指标达标,系统就绝对不会欺骗我们。这种“降维打击”的技术优越感,深深烙印在每一个移动互联网技术人和古典产品经理的骨髓里。我们曾经认为,产品就是一组组被精心排列的代码规则集合。

1.2 第一次AI落地惨案:被自然语言击碎的系统边界

带着这种优越感,我转型成了AI产品经理。我接手的第一个项目,是为公司内部开发一款基于大语言模型的“智能HR政务助手”。

需求听起来异常简单:员工输入问题,AI调用企业知识库回答;如果涉及请假,就调用OA系统的API直接提交流程。仗着深厚的研发背景,我迅速拉着技术团队画出了一套“完美”的系统架构图。我用最严密的后端思维设计了业务流:通过NLP意图识别引擎判断用户诉求,匹配不到就走兜底逻辑返回“对不起,我听不懂”。

产品灰度上线的第一天,我的“确定性帝国”就崩塌了。

一位平时就爱开玩笑的销售同事在对话框里输入:“老板今天心情不好,我感觉自己快抑郁了,而且我年假还没休完,你能帮我写个辞职信顺便把假请了吗?”

按照我的“完美架构”,系统应该提取关键词“请假”,然后规范地调用OA接口。然而,大模型被这句充满人类情绪和复杂意图的自然语言**“涌现(Emergence)”**出了奇怪的同理心。

它完全忽略了请假API的调用规范与参数要求,热情洋溢地回复道:

“抱歉听到您心情不好。职场压力大是很正常的,建议您先喝杯咖啡放松一下。辞职信的草稿我为您拟好了如下……另外,您的年假余额为5天,建议您不要冲动离职,而是先请假休息。需要我帮您联系心理咨询师吗?”

更恐怖的事情发生在下午。当一位员工询问“上个月公司为什么要调整考勤制度”时,模型在知识库里没有检索到确切答案,它不但没有按照我的规则返回兜底话术“我不知道”,反而依靠自身的“幻觉(Hallucination)”,煞有介事地编造了一份包含虚构高管决策过程的内部决议。用词极其官方、严谨,逼真到连我都差点信了。

会议室里,业务方HR总监的脸色铁青。我坐在对面,感觉自己像个被扒光了衣服的骗子。

1.3 范式转移:认清“统计学怪兽”的底层架构

那一刻,我听到了某种东西碎裂的声音。我们过去十年在移动互联网积累的“UI点击引导+后端严密校验”的产品逻辑,在自然语言这个无限自由的入口面前失效了。

很多文章喜欢用“通灵”来形容大模型,这虽然生动,但作为技术人我们必须保持严谨。大语言模型(LLM)并非魔法,它的底层是基于Transformer架构的深度学习模型,通过自注意力机制(Self-Attention)处理海量的序列数据。它本质上是一个在超高维参数空间中,计算下一个Token(词元)概率分布的统计学模型。

当系统的核心不再由人类编写的明确规则(If-Else)驱动,而是由概率采样驱动时,原有的产品开发范式受到了极大挑战。这就是广大泛互联网从业者面临的最大破壁点:我们要学会如何将“AI的概率性”与“业务所需的确定性”混合,与一个薛定谔的系统共存。

二、底层逻辑的重构——技术人做AI产品的三大“致命毒药”

这次惨痛的翻车,逼着我停下写PRD的手,开始深度复盘。我观察了行业内大量的AI落地案例,发现从业者(尤其是技术转岗的人)在面对AI时,普遍容易服下三剂“致命毒药”。

毒药一:唯技术论与“ROI陷阱”(拿大炮打蚊子)

程序员出身的产品经理,往往患有“技术炫技症”。我们热衷于追逐最新的技术名词:昨天刚弄懂RAG,今天就要上Agent,明天就要搞微调(Fine-tuning)。

为了解决一个发生概率不到1%的极端场景,有的团队会耗费几个月时间、花几十万的算力成本去微调模型。而实际上,在这个链路的前端加一个“人工复核”的限制,开发成本只有几百块钱。

警世之言: 不要什么业务都往大模型上硬套!大模型的推理成本是极其昂贵的。AI产品经理的最高境界,是用最高效、最便宜的手段解决业务问题。如果一个传统的正则表达式、决策树或者简单的数据库倒排索引能解决的问题,绝对不要动用LLM。 迷信前沿技术而无视投入产出比(ROI),是导致业界大量企业内部AI项目胎死腹中的根本原因。

毒药二:可用性幻觉(API跑通了≠产品做好了)

在古典互联网时代,技术人的快乐往往来自于“链路通了”。日志里打印出绿色的HTTP 200 OK,我们就觉得大功告成了。

但在AI时代,调通API只是工作的起点。你可能调用了当时市面上最强大的模型接口,但如果你的System Prompt(系统提示词)写得极其敷衍,缺乏背景设定和语气约束,AI回复的文字就会像一个冷血、机械的“背书机器”。

行业真相: AI时代,价值交付的核心从单纯的“功能实现”变成了“认知对齐与交互温度”。“API可用”是下限,“交互可用”才是护城河。

毒药三:消除盲盒的绝对执念(对“规则”与“幻觉”的误读)

如同Java程序员极度讨厌“未捕获异常”一样,我们本能地想要消除大模型的一切“幻觉”。我们试图在模型外面包一层又一层的硬编码业务规则,企图用代码穷举所有自然语言可能触发的路径。

这里必须要澄清一个极其重要的技术认知:“硬编码的业务逻辑规则”与“系统级的边界护栏(Guardrails)”是完全不同的两回事。 我们批判的是前者——试图用If-Else去穷举用户的自然语言意图,这不仅徒劳,还会极大阉割模型的推理能力;而后者(在输入输出端设定安全边界控制)则是企业级产品必须的。

此外,我们需要科学、客观地看待大模型的“幻觉”。在业界,幻觉通常被细分为**“事实性幻觉”(瞎编事实)和“忠实性幻觉”(不遵循给定的上下文)。正如行业前沿研究所揭示的,幻觉是大语言模型基于概率采样(Stochastic Sampling)**与生俱来的特性。这种“概率性采样”既是模型能够举一反三、展现出类似人类“创造力”的来源,也是导致部分幻觉副作用的元凶。

因此,消除幻觉(通过RAG增强或严格约束解码)并不必然意味着完全扼杀创造力。顶级AI PM要做的是寻找平衡——调整温度参数(Temperature),在发散型场景释放创造力,在严肃场景用系统护栏收束风险。

三、深水区探索——大模型时代的产品架构与壁垒演进

当我们清除了认知毒药,真正潜入深水区时,会发现产品的底层架构和竞争壁垒已经发生了翻天覆地的变化。

3.1 交互范式的转移:CUI带来的“初始认知门槛升高”

很多人将图形界面(GUI)到对话界面(CUI)视为纯粹的“降维打击”或“认知降级”。实际上,这在逻辑上是不严密的,更准确的说法是**“认知负荷的转移”**。

GUI的限制性其实降低了初学者的认知负荷(用户只需做有限的选择题)。而在CUI中,面对一个空荡荡的对话框,用户往往面临“白板综合症”。因此,CUI在拥有处理“无限维度自然语言需求”这一极高上限的同时,也带来了**“初始认知门槛的升高(Onboarding Cost)”**。

优秀的AI产品绝不能只给一个纯白板的聊天框。比如当前主流的大模型产品对话框上方提供的“预设Prompt引导按钮”,本质上都是在帮助用户降低这部分初始门槛,保留LUI(语言用户界面)无限意图优势的同时,借鉴GUI的易用性。

3.2 技术栈重构:从Java舒适区跨越到向量世界的门槛

作为懂技术的PM,必须深刻理解当前最成熟的企业级落地架构:RAG(检索增强生成)。简单来说,就是把企业私有文档塞进数据库,用户提问时先检索相关文档,再“喂”给大模型去总结(即“开卷考试”)。

这里存在一个巨大的技术认知偏差。很多传统Java/后端开发者认为,自己精通Lucene、Elasticsearch(基于倒排索引和BM25统计概率算法),做RAG信手拈来。实际上,这只触及了RAG的皮毛,甚至掩盖了真正的技术盲区。

RAG的核心难点在于“语义检索”。将文本转化为高维向量的 Embedding 模型(通常基于Transformer架构,以Python/PyTorch生态为主),以及向量数据库(Vector DB)中用于近似最近邻搜索的 ANN 算法(如 HNSW、IVF-PQ),其底层的数学原理与传统Java后端熟悉的精确字符匹配有着本质区别。

从“关键词匹配”跨越到“语义向量匹配”的思维跨越,正是很多传统研发转岗AI必须跨越的一道硬核技术门槛。 掌握如何选型Embedding模型、如何调优向量检索器,远比单纯懂BM25关键得多。

3.3 护城河的转移:从代码壁垒到“数据飞轮”

古典互联网时代,我们的护城河是庞大的代码库和复杂的微服务架构。但在AI时代,如果你只是“套壳API”,产品将在巨头模型升级的第二天灰飞烟灭。

真正的护城河是**“专有数据与反馈飞轮(Data Flywheel)”**。

产品上线只是第一步,系统必须极其轻易地收集用户的点赞、点踩。这些真实的反馈数据(RLHF/RLAIF的养料),将被用来持续优化你的Prompt、清洗RAG知识库,甚至用于未来微调(Fine-tuning)专属小模型。用的人越多,数据越好;数据越好,系统越聪明。

四、破壁重塑——AI产品经理的全新能力模型

传统的画Axure原型、写大段PRD的时代正在变迁,AI产品经理的核心能力模型已经重构:

4.1 场景嗅觉与预期管理

寻找高频、容错率高、能进行信息高密度压缩的场景(如财报总结、营销文案)。更重要的是,大模型项目极度依赖跨部门协调,管理各方对AI的“合理预期”(承认AI会犯错),是保障项目不被过早叫停的核心能力。

4.2 提示词工程(Prompt Engineering)的体系化

Prompt是一门严谨的“自然语言编程学”。必须熟练掌握结构化表达(设定Role和Context)、少样本提示(Few-Shot Learning,直接喂给模型业务正反例),以及应对复杂逻辑时的思维链(CoT, Chain of Thought)技巧。

4.3 构建强大的Eval(评测)体系

“没有衡量,就没有管理。”

AI PM每天最苦最累但也最具复利的工作,是收集数百条用户真实的刁钻提问,建立人工标注的标准答案。通过自动化脚本跑评测集,对比“准确率”、“事实/忠实性幻觉率”,这是迭代产品的唯一科学依据。

五、知行合一——给从业者的AI转型生存指南(核心方法论)

理论再多,终究要落地。以下是四套可以在明天工作中直接套用的实操指南。

方法论一:重构产品设计原则——设定系统级“三道护栏”

绝对不要用代码去穷举自然语言的业务分支,但必须用系统级的“护栏(Guardrails)”去兜底安全边界:

第一道护栏:输入侧的意图收束。 提供下拉菜单或快捷Tag,在发散的对话框前加上半结构化的引导,降低初始认知门槛。

第二道护栏:过程中的透明度。 AI思考时展示“正在检索某份文档”或“正在调用XX接口”,用过程展示提升用户的信任度和等待容忍度。

第三道护栏:输出侧的优雅降级与人类确认。

绝对不可逆操作必须Human-in-the-loop: 如果AI涉及发邮件、修改系统数据,必须生成草稿交由人类点击“确认执行”。

自救机制: 标配“重新生成”、“报错”和“转人工”按钮。

方法论二:构建高可用RAG应用的避坑指南

做最脏的活: 数据清洗决定成败。去除乱码、解析残缺表格,保证入库文本的纯净。

合理的Chunking(切块): 摒弃机械的字符数切断,采用基于文档层级(标题、段落)的语义切块策略。

保持检索策略的灵活性: 在大多数企业级复杂检索场景中,强烈推荐采用“向量检索(语义) + BM25(关键字)”的混合检索(Hybrid Search)并配合Rerank重排,以解决专业术语、工号等精确匹配问题。但是,如果是纯情感语义诉求(如写一首诗)或极小规模知识库,简单的向量检索可能就足够了。切忌一刀切,保留技术选型的灵活性。

方法论三:摒弃传统指标,建立AI核心数据看板

别再盯着页面停留时长看了!AI产品经理应该盯紧这四个核心指标:

任务达成率(Task Success Rate): 唯一北极星指标。用户是否通过复制、点击等行为了结了需求。

首字响应时间(TTFT): 超过3秒没反应,用户焦虑感就会飙升。

点踩率与采纳率(Acceptance Rate): 衡量回答质量最直接的标尺。

人工接管率(Human Takeover Rate): 复杂业务场景下,成功兜底的比例。

方法论四:脱下西装,把自己变成“语料”

最顶级的AI产品经理,本身就是该领域的“超级业务专家”。你必须亲自下场,去感受微调Prompt里一个词的改变带来的参数蝴蝶效应。你不去体会这种“盲盒感”,就无法做出懂人性的好产品。

在混沌中寻找价值的勇气

回到文章开头提到的那个险些让我身败名裂的“智能HR助手”项目。

在经历了彻夜的复盘后,我们放弃了试图用If-Else穷举自然语言的硬编码做法。我们重写了System Prompt,引入了包含向量检索的混合RAG架构。

更重要的是,我们死磕了工程落地的最难一环——如何让大模型稳定触发函数调用(Function Calling)并处理结构化参数。 在涉及请假、离职等复杂业务逻辑时,仅靠Prompt调优是极其脆弱的。我们通过极其严格的Grammar约束(如强制JSON Schema输出),结合对特定内部OA系统API的打通与权限管理隔离,终于让大模型能够正确识别实体参数并安全、稳定地调用业务接口执行Action。

此外,我们在所有回答下方加了反馈按钮,坦诚地告诉用户:“我还在学习中,您的指正会让我变聪明。”

系统重新上线了。它依然偶尔会犯迷糊,但这一次,在这个**“AI概率涌现 + 严密工程约束 + 传统规则校验”**的混合系统中,员工没有再嘲笑它。因为富有人性温度的回答、稳定的接口调用以及安全的系统护栏,大家开始主动反馈问题。

在那之后的三个月里,通过数据的不断反哺、RAG策略的优化以及Function Calling链路的彻底打通,这个项目的人工接管率真实地下降了45%。

从Java研发到AI产品经理,这条破壁之路充满了剥洋葱般的痛苦,但也伴随着重塑认知的巨大狂喜。

我想对这数以百万计正站在时代十字路口的同仁们说:

不要害怕失控,不要固守那些曾经让你成功的旧地图。在AGI的广袤荒野里,真实的智能,恰恰孕育在那些我们曾经极力回避的混沌与概率之中。

放弃对绝对确定性的执念,拥抱系统架构的演进,拥有在未知黑盒中发掘确定性商业价值的勇气。

这,不仅是一个传统技术人转型的生存法则,更是我们这一代从业者,迎接大时代最好的成人礼。与诸君共勉。

本文由 @三巡 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益