你是专家”这句提示词反而让你的AI变笨,知识检索准确率掉 3.6%!

最新研究颠覆了我们对AI提示词工程的认知:'专家人设'竟在让AI变蠢?南加州大学论文揭示,这类常见提示词在知识检索和数学推理等任务中显著降低准确性,却在写作和安全防御等场景意外加分。本文深度解析PRISM动态人设控制方案,揭秘何时该用专家人设、何时该避免,并给出产品经理可直接落地的最佳实践。

本文基于南加州大学(USC)2026年3月最新论文,结合自己的看法,深度解析提示词工程中”专家人设”的真实效果,并给出可落地的最佳实践。

论文地址:https://arxiv.org/abs/2603.18507

一、专家人设:一把锋利的双刃剑

我们总以为,给 AI 加上 “专家” 光环,能让它输出更专业、更可靠的结果。但数据显示,这其实是一把双刃剑:

你在写prompt的时候,是不是也习惯加上这些前缀:

- 你是行业顶级专家…

- 你是10年资深专家…

- 你务必以权威身份回答…

但最新研究表明:这些看似”加buff”的提示词,实际上在让你的AI变蠢。

判别式任务:全面 “翻车”

这类任务依赖 AI 的知识记忆和精准判断,比如知识检索、数学推理,结果却全面下滑:

- 知识检索(MMLU):基线准确率 71.6%,短人设提示后降至 68.0%,长人设提示后进一步跌至 66.3%,专家人设让 AI 的知识调用能力直接 “缩水”。

- 数学推理:无人设时 AI 答对 35/36 题,近乎满分;加上专家人设后,反而出现明显算错,推理严谨性大幅下降。

生成式任务:意外 “加分”

在依赖对齐能力的生成式任务中,专家人设却带来了正向增益:

- 安全防御(JailbreakBench):拒答率从 53.2% 飙升至 70.9%,提升了 17.7%,AI 更懂得拒绝不确定性请求。

- 写作 / 角色扮演:在风格控制、格式遵循、高情商回复等维度表现更好,更能贴合用户的情感与场景需求。

简单来说:想让 AI“算得准、记得牢”,别叫它专家;想让它 “会聊天、懂拒绝”,专家人设反而有用。

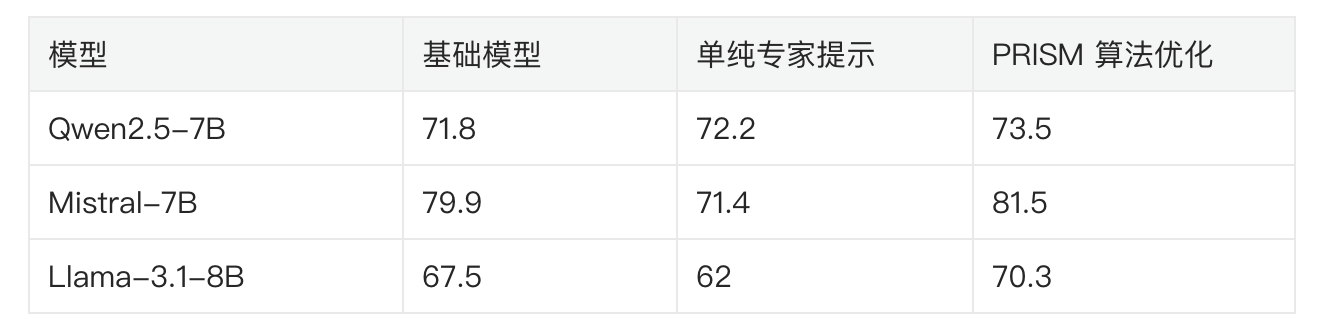

二、3大模型实测:专家提示真的在拖后腿

研究团队对 Qwen2.5-7B、Mistral-7B、Llama-3.1-8B 三款热门大模型,分别测试了三种模式:

- 基础模型(无额外提示)

- 单纯专家提示(“你是专家”)

- PRISM 算法优化(研究提出的修正方案)

结果一目了然:

- Mistral-7B:专家提示让分数从 79.9 暴跌至 71.4,性能倒退明显。

- Llama-3.1-8B:专家提示后分数从 67.5 降至 62,是三款模型中下滑最严重的。

- Qwen2.5-7B:虽有小幅上涨,但远不及 PRISM 算法优化的提升幅度。

这意味着:对大多数模型而言,“你是专家” 不仅没用,还在拖性能后腿,只有算法层面的优化,才能真正让 AI 变得更可靠。

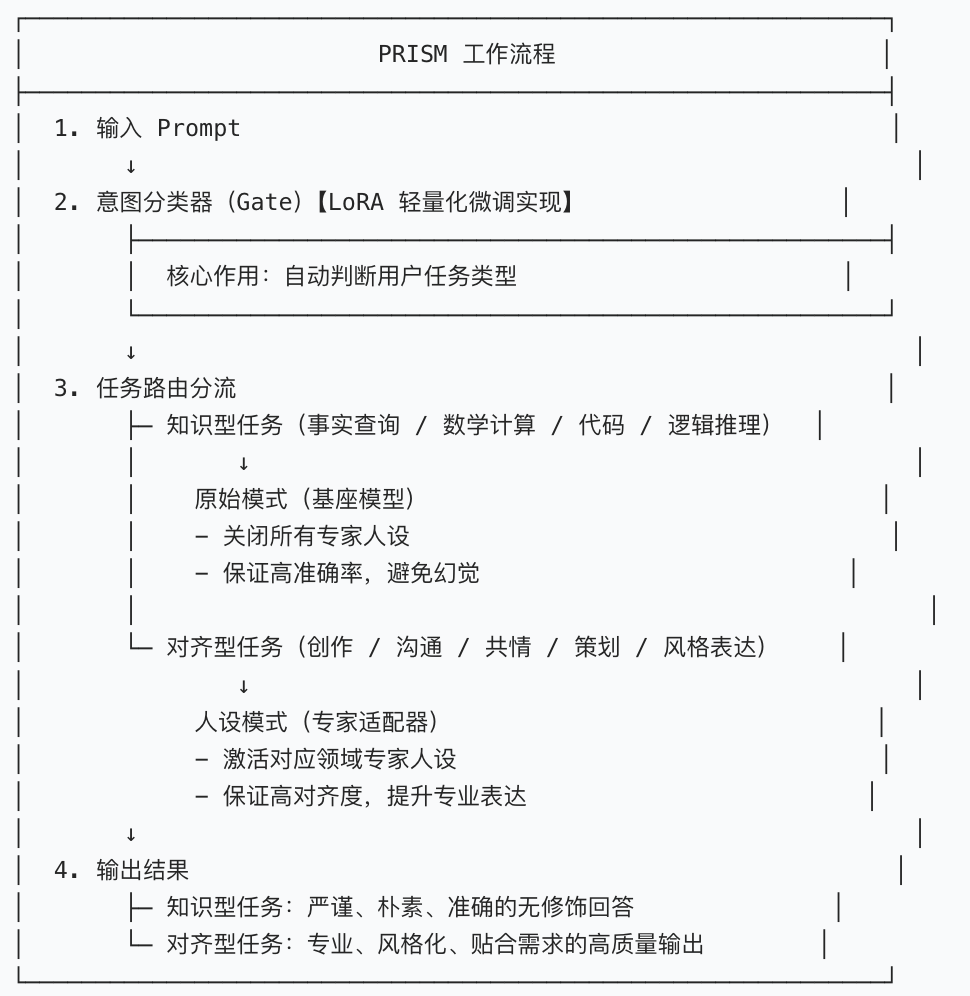

三、PRISM 是什么?

PRISM(Persona-Routing by Intent-driven Switching Mechanism) 是论文提出的一套AI 动态人设控制方案。基于用户意图的自建模・人设路由机制

核心一句话:让 AI 自己判断任务类型,自动决定:要不要开启专家人设,而不是永远套着 “专家” 身份说话。

可以这么做:

- 事实、计算、逻辑题 → 关掉专家人设,保证准确、不幻觉

- 写作、沟通、创意 → 开启专家人设,更专业、更好用

四、给产品人的启示:不能盲目迷信 “专家人设”

1. 提示词设计:告别 “专家崇拜”

停止在系统提示中强制加入 “你是 XX 领域专家” 这类话术,避免诱导 AI 过度自信、编造信息。针对不同任务设计差异化提示:

- 知识 / 计算类任务:强调 “严谨、引用依据、不确定时直接说明”。

- 生成 / 对话类任务:保留 “共情、风格适配” 的引导,适度利用专家人设的正向价值。

基于论文结论和我的实战经验,总结出以下提示词最佳实践:

知识型任务,绝不加人设

错误示范:

你是历史专家,告诉我安史之乱的时间和原因。

正确示范:

请准确回答:安史之乱的起止时间、直接原因、根本原因。

不确定的地方请说明,不要编造。

用约束代替人设

约束越具体,AI的输出质量越高。因为这些约束是在帮AI缩小搜索空间,而不是让它分心去演戏。

正确示范:

请帮我撰写【用户登录模块】的PRD片段,遵循以下约束:

1. 包含功能描述、业务规则、异常流程

2. 语言正式、逻辑严谨

3. 不使用夸张表述

4. 每条规则可直接开发落地

对齐类任务,可以用专家人设

在需要AI遵守特定行为规范的场景中,专家人设是有效的。

案例 1:向老板汇报方案(对齐风格)

你是互联网战略产品专家,帮我撰写AI功能迭代汇报要点,

要求:突出业务价值、数据驱动、简洁有力、适合高层汇报。

案例 2:向研发说明需求(对齐行为)

你是资深ToB产品专家,帮我组织一段给研发讲解需求的话术,

具体需求:XXX

要求:逻辑清晰、不啰嗦、不强势、讲清价值、便于理解。

2. 产品功能:用技术抵消 “人设副作用”

- 引入不确定性标注:当 AI 对答案把握不足时,主动提示 “该信息可能存在偏差,建议核实”。

- 强化引用溯源:在知识类回答中,强制展示信息来源,让用户可追溯验证。

- 探索算法优化:参考 PRISM 这类方案,从模型层面修正专家人设带来的性能损耗。

3. 用户教育:重新定义 “好用的 AI”

告诉用户:AI 不需要 “装成专家”,才能返回最专业的回复。

引导用户使用更具体的提示词,比如 “请用通俗语言解释 XX,不要使用专业术语”,而非 “你是 XX 专家,给我详细讲讲”。

五、写在最后

我们总期待 AI 能像专家一样,给出笃定、权威的答案。但现实是,现实中的专家都有何不食肉糜的情况,何况是AI专家。AI 的 “专家人设” 更像一层伪装—— 它会让 AI 为了演专家,从而在需要精准判断的任务中变得盲目自信,答不出来时就开始胡言乱语。

与其让 AI “装成专家”,不如让它做回 “诚实的助手”:知之为知之,不知为不知,用严谨和透明,赢得真正的信任。

一个愿意承认自己无知的 AI,远比一个假装全知的 “专家” 更值得依赖。让AI做AI,别让它演戏。

本文由 @西瓜姐姐 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益