医疗智能体·第3讲——跨越生死边界,医疗智能体“建议权”的伦理护栏与风控设计

医疗智能体正在突破传统信息检索的边界,实质性介入临床诊断。权力的延伸必然伴随责任的重构。如何在算法黑箱与生命重托之间,通过产品机制设计一道坚固的伦理护栏?

跃过边界:从“辅助读片”走向“临床开方”

在过去的产品周期里,医疗AI多停留在图像识别和信息检索阶段。产品经理日常关注的核心指标往往是算法的敏感度与特异性。

如今大模型技术赋予了智能体更强的认知与交互能力。它们开始实质性地介入临床决策流程,甚至尝试生成具体的治疗方案和处方建议。

从“提供信息”跃迁到“提供建议”,这是产品业务逻辑的根本转变。这种转变直接触碰了医疗行业最核心且最敏感的红线。

医疗行为的本质是人类生命健康的托付,任何产品交付都容不得半点试错与侥幸。

一旦我们的产品具备了实质意义上的“建议权”,团队就必须重新审视系统的伦理护栏。产品经理不能再将自己仅仅视为提供效率工具的软件服务商。

在复杂的临床环境中,一条看似合理的代码逻辑,最终可能会演变成危及患者生命的错误决策。这就要求我们在系统架构之初引入底线思维。

核心冲突:算法黑箱与生命不能承受之轻

大模型底层的运作逻辑往往是一个巨大的参数黑箱。即使是资深的算法工程师,也很难在事后完全逆向推导出某个具体诊断结论的生成路径。

而在严谨的临床医学中,可解释性是建立医患信任的基础。医生必须确切知道“为什么”,才能决定最终要“怎么做”。

当智能体给出一个违背医生常规经验的诊断建议时,一线使用者往往会陷入两难。采纳它,可能需要承担未知的误诊风险;拒绝它,又担心错漏了某种罕见病征。

这种底层技术特性与临床防御性心理之间的激烈冲突,是产品设计阶段必须直面并解决的痛点。

我们绝对不能把一个完全不可控、逻辑不可溯的算法黑箱,直接推向争分夺秒的临床一线。必须在两者之间增加一个用于缓冲的产品转化层。

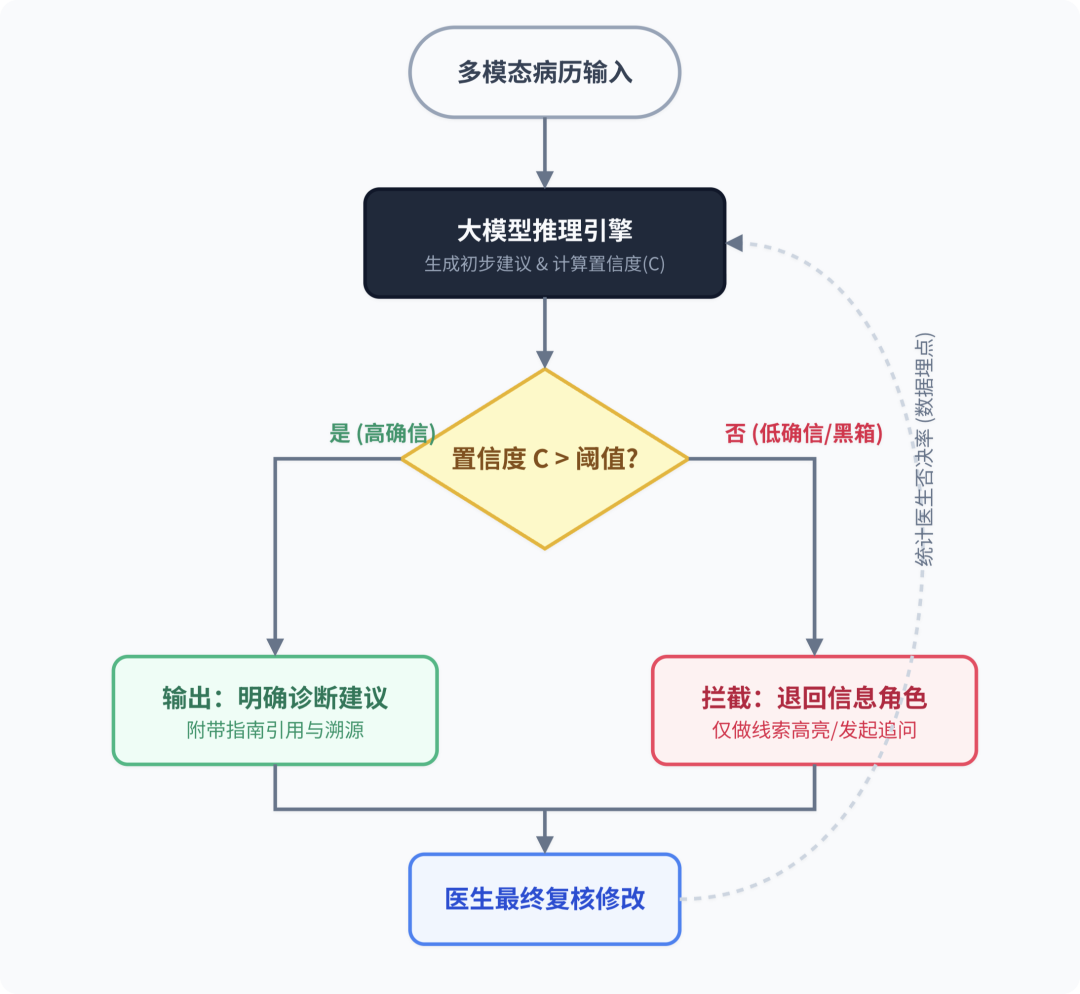

算法容错:构建临床视角的置信度拦截机制

针对大模型固有的幻觉问题,产品必须在交互表现层设立极其严格的容错机制。多维度的置信度评分体系是系统的第一道防线。

当系统对某项诊断建议的置信度低于设定的红线时,产品不仅不应强行输出结论,反而应主动退回“信息提供者”的角色。

在UI设计上,我们可以采用“线索高亮”来代替“直接确诊”。通过结构化展示原始病历特征和权威指南原文,把最终的临床判断权完整地交还给医生。

同时,我们需要在业务后台引入“医生否决率”作为核心的数据埋点。在真实业务流中,这个指标比实验室里的模型准确率更有指导意义。

那些在临床应用中频繁被主治医生否决的建议链路,必须自动触发算法团队的熔断与回溯审查。这是一种基于真实医疗场景的灰度迭代机制。

在输入源头,还要设计数据校验层。当患者通过语音或文字输入模糊不清的症状描述时,系统应主动发起多轮追问,而不是盲目进行病情推理。

责任界定:三体运动中的法律与伦理天平

当医疗智能体的建议直接导致了医疗事故,责任究竟该如何划分?这如同一个复杂的“三体运动”,牵涉到医生、算法提供商与医疗机构的动态博弈。

当前的监管口径非常明确,AI在现阶段只能被严格定位为“辅助诊疗工具”。这意味着智能体绝对不具备独立的行医资格和法律主体地位。

无论系统的诊断准确率有多高,人类医师始终拥有诊疗的最终决策权。因此,医疗机构和签字医生必须承担直接的法律责任。

严禁全自动化的AI系统在脱离人类监控的情况下独立执行高风险诊疗操作。这是不可逾越的产品合规底线,必须在用户协议中强制声明。

但在实际的权责链路中,如果医疗机构能够证明已经尽到了严格的准入审查义务,且医务人员完全遵循了既定的操作规范与复核流程。

最终经司法鉴定证实,医疗损害的根源确实在于算法设计缺陷或产品未披露的技术漏洞,医疗机构在完成患者赔付后,有权向产品提供方进行追偿。

兜底策略:追偿闭环与商业保险的产品化落地

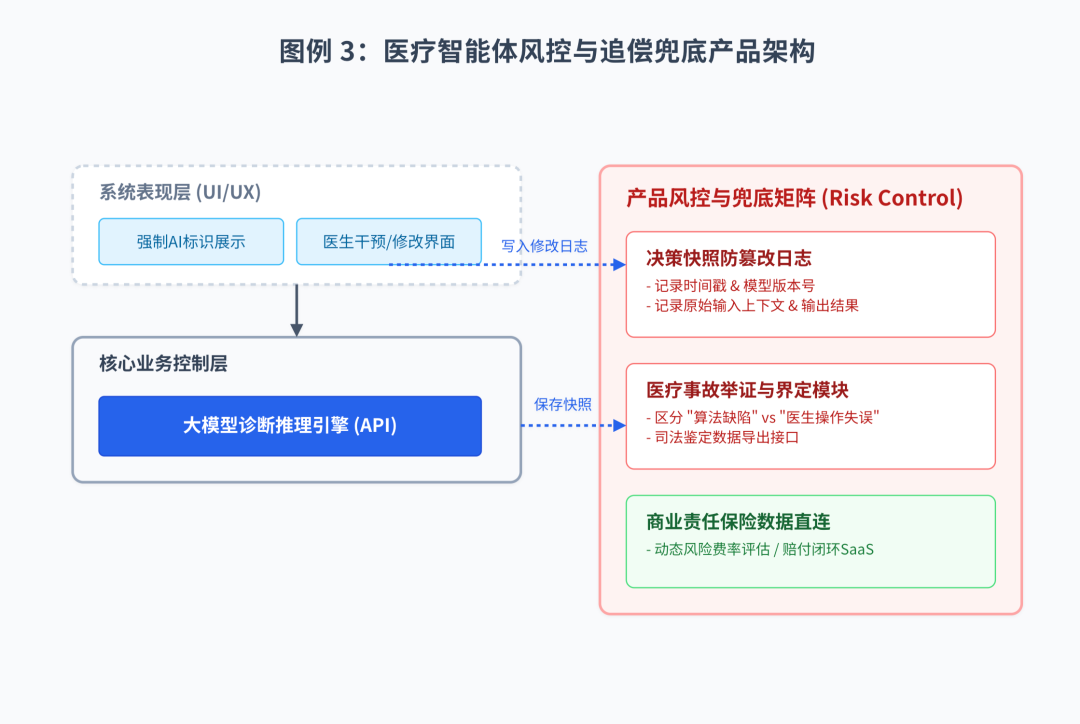

面对这种明确的追偿风险,产品团队必须在底层架构上提前做好业务兜底策略。可追溯的日志系统是自我保护的核心要件。

我们需要为每一次临床建议生成一个包含时间戳的“决策快照”。其中必须完整记录当时的输入上下文、模型版本号、输出结果以及医生是否进行了干预修改。

一旦发生不可挽回的医疗纠纷,这份防篡改的底层日志将成为界定“系统缺陷”与“医生操作失误”的最核心证据。

同时,在商业变现与部署阶段,我们需要积极引入责任保险制度。将医疗AI产品责任险作为SaaS服务的标配模块提供给采购方。

通过与保险机构的数据对接,实现风险费率的动态评估。这不仅能在发生重大事故时有效分散赔付压力,更是向医疗机构传递产品安全感的重要手段。

在面向患者端的服务中,则需要坚持分级知情同意原则。任何由AI生成的辅助诊疗内容,在进入最终病历或面向患者展示前,必须包含显眼的系统标识。

要让患者清晰地知晓当前信息是由智能体生成的初步建议,从而管理用户预期,降低因过度信任技术而导致的潜在医患冲突。

终局演进:做好医生的“外脑”而非“替代者”

医疗智能体的核心价值,不在于通过一场图灵测试来证明自己比人类医生更聪明,而在于填补当前医疗资源分配极度不均的鸿沟。

即使算法的精度在未来逼近完美的极值,医学本身依然是一门充满人文温度的学科。面对生死抉择时的伦理重担,只能由人类来承担。

优秀的医疗AI产品经理,应当克制对技术全能的盲目崇拜。我们要设计的不是一个冷冰冰的看病机器,而是一个能够无限延展医生认知边界的“数字外脑”。

通过机制设计去兜底算法的缺陷,通过伦理护栏去规范权力的边界。只有建立起经得起临床考验的信任体系,医疗智能体才能真正走向大规模的商业化落地。

本文由人人都是产品经理作者【科技叨叨馆】,微信公众号:【科技叨叨馆】,原创/授权 发布于人人都是产品经理,未经许可,禁止转载。

题图来自Unsplash,基于 CC0 协议。

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益