AI 看得见漏斗,看不见”沉默”:定量研究中,产品经理不可替代的 3 种判断力

AI数据分析报告显示产品指标全线飘绿,团队正准备庆祝时,客服投诉却暴露了真相——数据背后是用户被困在糟糕体验中的无声呐喊。本文深度剖析AI分析报告的三大盲区,揭示产品经理不可替代的语境权、缺席权和归因权,并给出数据归因五步法,帮助团队在AI时代保持关键判断力。

一、一份”全绿”的数据报告,为什么差点把产品带进沟里

复盘会定在周五下午三点。

这个工具型 SaaS 团队刚跑完一轮版本迭代,PM 把埋点数据、漏斗报告和一批录屏样本一股脑交给 AI 做分析。等咖啡端上来的时候,报告已经出来了——页面停留时长上涨,核心按钮点击率提升,用户参与深度指标全线飘绿,AI 给出明确建议:扩大流量,快速放量。

会议室里的人几乎都在点头。幻灯片已经翻到了下一步行动计划那页,只差一句拍板。

然后客服同学插了一句话:最近”骂产品难用”的工单突然多了很多,昨天还被一个客户在群里公开截图投诉。

PM 皱了眉,把会议叫停,临时拉大家去看了二十份录屏。

那二十分钟没有人说话。

停留时长变长,不是用户更认真在用——是页面加载卡顿、信息层级混乱、退出按钮藏得太深,用户找不到出口,只能困在原地。等了五秒、十秒、二十秒,页面终于响应了,但他已经不知道自己要干什么了。

点击率上涨,不是设计优化有成效——是关闭按钮做得太小,主按钮的位置让人误判,用户在大量误触,点错了又得重新来。那个被点了三十一次的按钮,大多数都是误触。埋点只记录了”点击发生”,没有记录”点击之后的懊悔”。

那份 AI 报告,每个数字都是真的,几乎每个结论都是错的。

团队里有人开口了,声音有点小:所以我们之前的数据是假的?

不是假的。数据是真的,只是它记录的不是产品成功的证明,而是用户被困住的证明。两件事的数字,恰好长得一模一样。

这件事打出来的认知只有一个:AI 不是在胡说,它只是忠实地放大了一个结构性缺口——埋点记录的是行为结果,但行为背后的意图,它看不见。

停留时长增加,可以是爱,也可以是困。点击率提升,可以是喜欢,也可以是误操作。在数字层面,这两件事没有区别。

所以这篇文章真正想聊的问题,不是”AI 会不会做数据分析”——它当然会,而且越来越强。真正的问题是:为什么 AI 越强,产品经理越不能从定量研究里退出来?

二、最危险的不是坏数据,而是”好数据 + 好报告 + 好逻辑”

先把话说公平。

AI 在数据这块确实干得不赖。清洗数据、识别趋势、发现异常、生成归因初稿,这些原本要耗掉半天的工作,AI 两个小时就能给出可用的结果。越来越多的团队在用它跑日常分析,效率确实提上来了,这没什么问题。

但问题不出在”能不能分析”,出在分析建立在什么前提上。

AI 默认你给它的数据已经够用、够准、足够代表真实。但现实不是这样。

数据不是事实本身,数据是事实留下来的痕迹。点击不等于喜欢,停留不等于投入,留存不等于创造了价值,转化也不等于用户真的认可这个产品。每一个指标,都是现实世界在埋点系统里投下的一道影子。影子的形状不等于本人的样子。

这里有一个很反直觉的判断:坏数据会让团队警惕,好数据才最容易让人放下戒心。

“坏数据”至少还会触发质疑——留存掉了三十个点,没有人会直接拍板放量。但”好数据 + 逻辑严密的 AI 报告 + 配色漂亮的图表”,最容易让团队在该继续追问的时候提前收手。没有人会去质疑一份看起来如此自洽的报告,尤其是当 AI 已经帮你把”为什么好”解释得头头是道的时候。

这是一种很难被意识到的危险。它不是数据说谎,而是数据被误读。而且越是认真做数据的团队,越容易掉进这个坑——因为他们对数据的信任度本来就更高。

AI 最危险的,不是分析错,而是分析得太像那么回事。

三、AI 拿不走的,不是分析能力,而是 3 种判断权

产品经理在定量研究里真正不可替代的东西,不是读报表的速度,也不是写 SQL 的能力,而是三种 AI 系统性拿不到的判断权:语境权、缺席权、归因权。

语境权——同一个指标,在不同产品里可能代表相反的意思

来看几个场景,几乎每个产品团队都撞到过:

工具型产品里,停留时长下降通常是好事——用户用更短的时间完成了同样的任务,效率提升,路径压缩,正是产品该追求的目标。但内容型产品里,停留时长下降就是个麻烦信号,大概率意味着内容吸引力在下滑,用户划了两下就不想看了。

同样的数字,方向完全相反。

同样是”咨询次数下降”:可能是操作流程更顺滑了,用户不用再问;也可能是用户在更早的地方就已经走掉,根本没走到咨询那一步。两种情况的数字变化是一样的,但背后一个是产品成功,一个是产品失败。

同样是”功能使用率上升”:可能是需求真的被满足了,用户主动来用;也可能只是入口被放到了最显眼的位置、打扰性弹窗推多了,用户是被迫进去的,不是主动选择的。前者是产品有价值,后者是产品在骚扰用户。

AI 读到的是数字变化,但它不天然知道这个数字在当前产品里是否代表正向。它会基于通用逻辑给出判断,但通用逻辑不等于当前业务逻辑。

AI 会优化它看得见的指标,但产品经理必须先判断——这个指标,值不值得被优化,以及在当前阶段优化它是否真的有意义。

更根本的问题是:这个指标往北极星指标方向走,还是在消耗它?局部漂亮、整体在掉的情况,在任何一个做功能迭代的团队都发生过。

AI 读的是数,PM 翻译的是意义。这两件事之间的距离,在数字好看的时候最大。

AI 会读数,PM 要负责翻译这个数在当前业务里的真实含义。

缺席权——最关键的问题,往往藏在”没有出现的数据”里

这是三种判断权里最难被替代的一个,也是本文想重点说的部分,因为几乎没有文章在讲这件事。

AI 能处理的,只有被记录下来的行为。但很多真正影响产品判断的信号,恰恰来自那些没有留下任何痕迹的人。

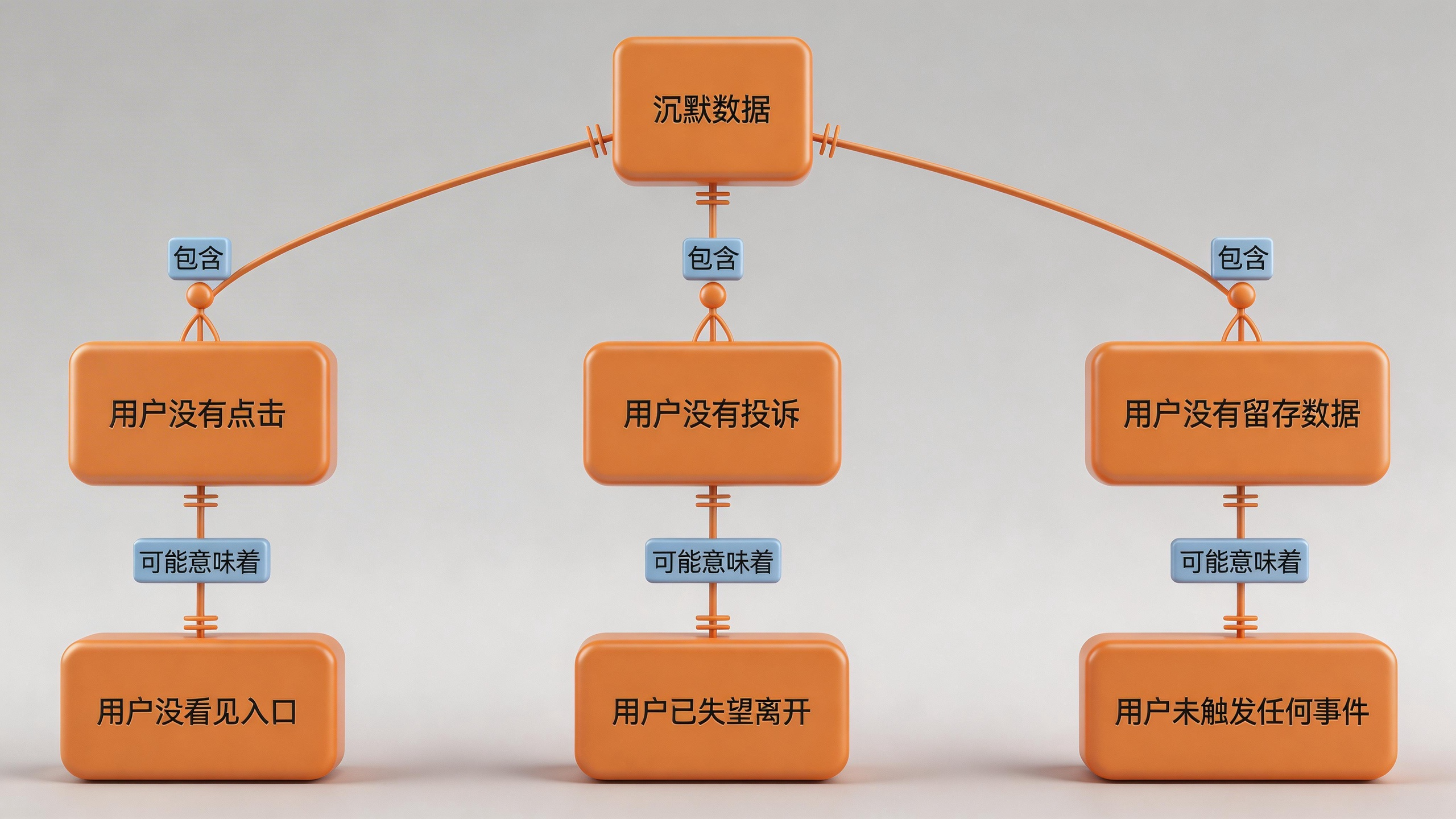

第一类沉默:用户没有点击

不代表他不感兴趣。也可能是那个入口的视觉权重太低,他压根没扫到过。用户的注意力是有路径的,他的视线从哪里扫进来,在哪里停留,在哪里离开,这些都是真实发生的行为,但绝大多数埋点系统只记录”点没点”,不记录”有没有看见”。

一个功能点击率极低,团队的第一反应往往是”用户不需要”,但实际上可能只是”用户没看见”。这是两种完全不同的问题,对应的解法也完全不同。前者需要重新设计功能,后者只需要调整视觉权重。这件事不会出现在任何埋点里。

第二类沉默:用户没有投诉

不代表他满意。更可能的情况是,他觉得投诉了也没用,或者他已经找到了替代品,安静地走了,再也没有回来。

提交反馈的那批用户,有一个很典型的特征:他们是对产品还抱有期望的人。真正失望透顶的那批人,往往不会写反馈,他们用脚投票,悄无声息地消失了。这意味着投诉里看到的问题,通常比真实问题要温和得多——因为最强烈的不满已经带着主人离开了,没有被记录下来。

第三类沉默:用户没有留存数据

不代表他不存在。可能他进来看了一眼,感觉不对,直接关掉,没有注册,没有触发任何事件,在整个分析系统里是隐形的。

这类用户通常是产品最应该研究的人——他们来了,但没有留下。他们身上藏着第一印象的真实反应,藏着注册门槛是否合理的答案,藏着产品价值主张是否清晰的线索。但因为”没有触发任何事件”,他们在 AI 的分析视野里根本不存在。

把这三类现象放在一起,就是本文最核心的一个概念:沉默数据。

沉默数据不是看板里那些已经被统计出来的指标,而是那些因为没有触发事件、没有完成注册、没有发起反馈、没有留下路径记录,于是被分析系统自动边缘化的人和行为。他们是漏斗里最关键的一批人,但他们不发声,AI 就看不见他们。

回头看文章开头的那个案例:埋点记录了留在页面里的用户行为。但那些进来五秒就退出的人呢?他们关掉页面,什么都没触发,从数据面板上消失了。然而恰恰是他们,才更可能是产品真正失败的证据。停留时长的均值因为这批人的离开反而被拉高了——因为留下来的都是被困住的人,他们停留的时间更长。

这就是为什么那份 AI 报告会得出那样的结论:它只看到了留下来的人,而那批人恰好是体验最差的人。

产品经理能做的,是去客服记录里找骂声,去访谈里问那些沉默的人卡在哪里,去竞品的应用商店评论区看没有回来的用户说了什么,去社群里捞那些用了一次就不再用的人的真实反馈,去看用户进入页面后五秒内的热力图,去研究那些开了但没有完成注册的会话路径。

这不是”交叉验证”那么简单,是一种更主动的判断——去看那些 AI 看不见的地方。

AI 擅长分析留下来的痕迹,PM 必须负责看见那些没有留下痕迹的人。

归因权——很多波动,根本不发生在产品内部

有一个误区在很多团队里根深蒂固:一看到数据波动,第一反应就是去功能、交互、文案、路径里找原因。

但产品从来不是在真空里运行的。

- 留存连续两周下滑——团队开了两次会,把新手引导流程翻来覆去地改,优化了四个细节,上线后数字没有明显变化。一个做竞品监控的同学顺手查了一下,发现竞品同期做了大型补贴活动,用户临时迁移过去。等活动结束,留存自然恢复了。两周的迭代,解决的是一个不存在的问题。

- 转化突然上升——数据好看,团队准备总结经验复制。后来发现那两周有一个高质量的行业媒体做了专题报道,带来了一批精准用户,这批人的转化率本来就高。等媒体流量消退,数字立刻回到原来的水平。那次”成功的迭代”什么都没改变,只是踩上了一个短暂的流量红利。

- B 端系统使用率下降——IT 部门收到工单,准备排查系统稳定性问题。运营同学打了几个电话,发现是客户那边负责操作的同学离职了,新来的人还没上手,用得少是因为还不会用。这种情况修产品没有任何意义,需要的是一次客户培训。

某个功能数据在某个版本突然波动——PM 认为是这个版本的改动生效了。但回头一查,统计口径在那个版本的发布节点悄悄改过一个字段定义,数字变化的一半来自口径调整,不是产品效果。

AI 基于后台埋点做分析,它能看到的边界,就是埋点所能记录的范围。 它会优先在产品内部找解释,不是因为它笨,而是因为它拿不到埋点之外的信息。渠道质量变了、竞品做了动作、客户内部发生了变化、口径调整过——这些信息不在数据库里,AI 永远看不见。

但产品经理知道,很多时候最真实的答案,在渠道数据里,在竞品监控里,在销售的微信群里,在客户成功的通话记录里。AI 更像一个内部分析器,PM 必须把产品重新放回真实的商业环境里去理解。

三种判断权放在一起,逻辑链就很清晰了:AI 读得懂数字,但它不知道这个数字在当前业务里意味着什么(语境权);它看得见留下来的行为,但它看不见那些沉默离开的人(缺席权);它能在埋点范围内找原因,但它看不见埋点之外的世界(归因权)。

三种判断权缺一不可,而且只有人才能补上这三块缺口。这不是 AI 能力不够强的问题,是它的信息边界决定的。无论模型迭代多快,它始终只能分析它收到的数据,而那些真正决定产品生死的判断,往往发生在数据边界的外面。

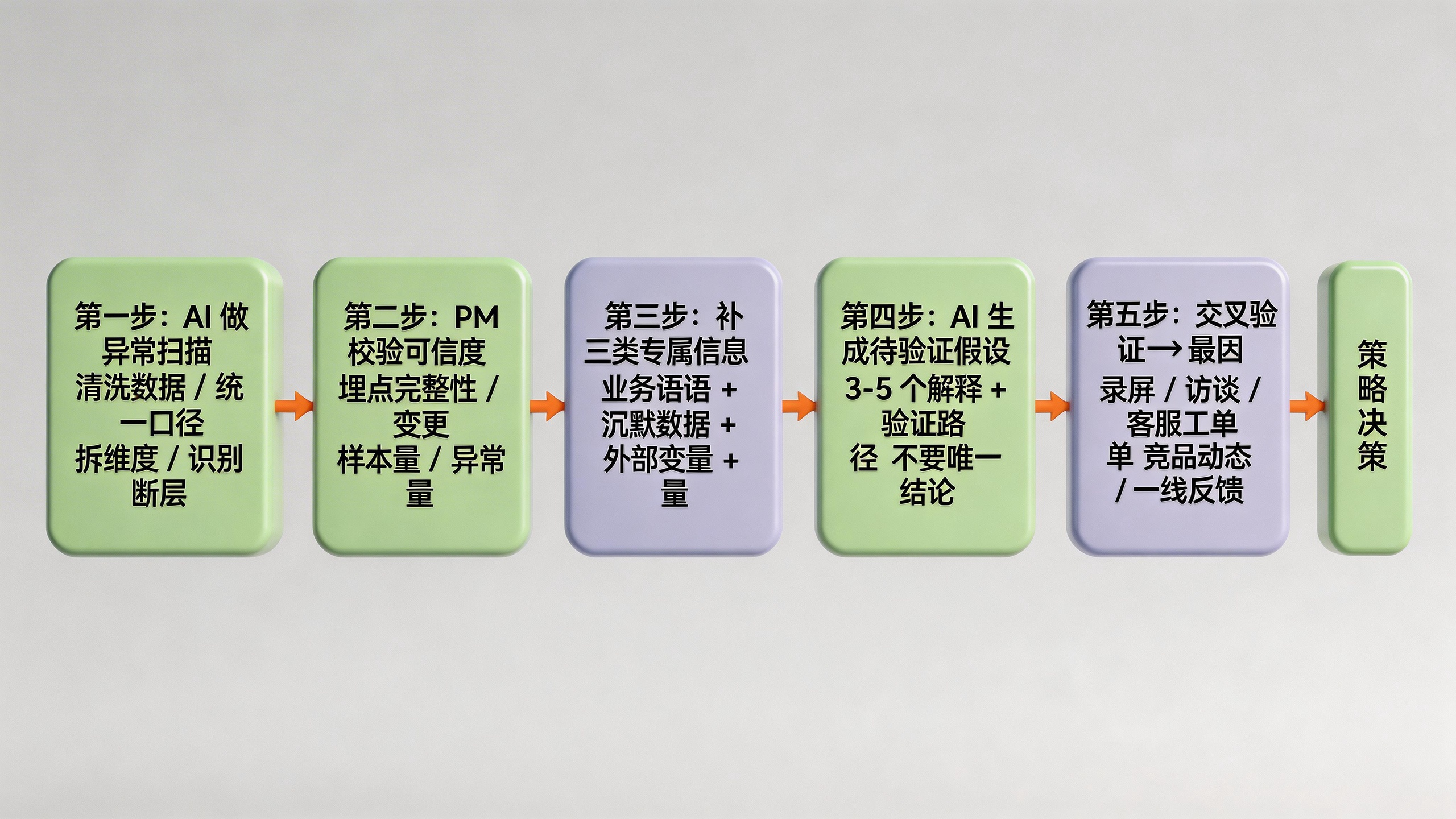

四、AI 看快,PM 看准——数据归因五步法

有了前面这些判断,这里给出一个可以直接带回团队用的工作方法。

命名:AI 看快,PM 看准——数据归因五步法。

第一步:先让 AI 做异常扫描,不让它直接做最终归因

这一步把 AI 用在它真正擅长的地方:清洗脏数据、统一统计口径、多维度拆解、做交叉分析、识别数据断层、找出哪个环节的指标偏离了正常范围。

它最大的价值是帮团队把”先看哪里”这件事从两天压缩到两小时。原本需要 PM 手动拉好几个维度的数据做对比,AI 可以快速给出初步的问题区域定位。

但这一步只到”圈出可疑信号”就停——不要让 AI 在这一步解释原因。 它圈出的是”哪里异常”,至于为什么异常,这是后续步骤的事情。很多团队在这里出问题,就是让 AI 一步到位,同时给了”哪里异常”和”为什么异常”,然后把两件事都当成结论接受了。

第二步:PM 先做可信度校验

拿到 AI 扫出的异常区域,先别急着找原因——先判断这个数据能不能信。

要检查的事情有几类:这段时间埋点有没有缺失或重复计算?统计口径最近有没有改过,尤其是版本发布节点前后?时间窗口选得合不合理,有没有把节假日效应混进去?样本量够不够,小样本的波动很容易造成误判?有没有异常流量进来把数字拉偏了?

这一步做得扎实,很多”波动”在这里就能解释清楚。口径改了、节假日因素、样本量不足——这三类原因能解释掉 30% 以上看起来需要深度归因的数据变化,根本不需要往下走。

PM 在这一步的价值,是用业务经验判断”这个数值变化合不合理”。即便不知道原因,有经验的 PM 通常能感觉出来数字是否”对”。这种感觉建立在对产品正常运转节奏的深度认知上,是 AI 没有的东西。

第三步:补三类 AI 拿不到的信息

这是 PM 价值最集中的地方,每次归因分析都不能省。三类信息必须亲自去补。

- 业务语境:当前产品处于什么阶段,北极星指标是什么,这个季度团队在赌哪个方向。同一个功能的数据变化,在获客期和留存期的解读完全不同;同一个指标的下滑,在核心用户群和边缘用户群里的含义也完全不同。这些信息只存在于 PM 的脑子里,AI 拿不到。

- 沉默数据:流失用户说了什么,未注册的人卡在哪里,哪些人从来没有走到过关键路径。这些信息要去找客服记录、去看最近的用户访谈、去翻竞品的差评、去捞社群里的真实吐槽。这一步耗时,但往往是发现真正问题的地方。

- 外部变量:渠道有没有变化,竞品有没有新动作,有没有活动补贴在影响数字,节假日效应是不是还没消化完,行业里有没有什么大事发生。把这些可能性逐一排查一遍,很多”产品内部归因”会原地消解。

第四步:让 AI 生成假设,而不是唯一结论

提问方式的差别很关键,这一步决定后面的分析方向对不对。

不要问:”这些数据说明了什么原因?”

要问:”基于这些数据,以及我补充的业务语境和外部变量,请给出 3 到 5 个可能的解释,并说明每一个解释还需要什么证据来验证。”

这个问法让 AI 从”结论发布者”变成”假设提供者”。团队拿到的不是一个需要相信或反对的答案,而是一组需要验证的可能性。每个假设后面跟着”还需要什么证据”,这让团队知道下一步去哪里找信息,而不是陷入对 AI 结论的讨论。

一份好的假设列表,通常会覆盖产品内部原因、用户行为变化、外部环境因素三个维度各一到两个。如果 AI 给出的假设全部都在产品内部找原因,说明你在第三步补充的外部变量信息不够充分,需要回去再补。

第五步:用交叉验证做最终归因

拿着第四步产出的假设清单,去逐一验证。

每一个假设都有对应的验证方式:用户体验问题去看录屏,交互流程问题去做用户访谈,功能使用问题去翻客服工单,外部竞品因素去看竞品监控数据,渠道质量问题去查分渠道的分层数据,内容吸引力问题去看用户的停留热力图。

让多个信息源共同指向同一个解释,而不是靠单一维度的数据拍板。当三个不同来源都指向同一个问题,这个归因就是可信的。当各个来源指向不同方向,说明问题可能是复合的,或者还有一层没挖到。

最终归因必须由人来完成。AI 负责提供假设候选池,验证工作是 PM 带着团队做的,结论是团队一起判断的。这条线不能移动。

AI 负责看快,PM 负责看准。前者解决效率,后者决定方向。

五、真正会被高估的,不是 AI 的分析能力,而是团队对”好看数据”的信任冲动

说一个让很多 PM 不太舒服的判断。

过去我们以为,数据分析能力是核心竞争力——会读报表,会写 SQL,会在周会上把指标讲得头头是道,这些是一个 PM 专业度的证明。多少人在晋升材料里把”数据驱动”写成一项硬技能,花时间学 Python,学 BI 工具,学怎么看归因漏斗。

但 AI 进来之后,这些能力的壁垒正在快速降低。AI 比人读得快,汇总得更全,图表做得更漂亮,连初步的归因假设都能自动生成。这件事已经是事实,不是威胁,就是现实。

那真正贵起来的是什么?

是另一种能力,听起来很朴素,做起来极难:

在一份答案看起来极其正确的时候,依然保持怀疑。

这件事要求 PM 同时具备几种东西——对业务目标的深度理解,才知道什么数字”感觉不对”;对用户心理的真实敏感,才知道数字背后的人在经历什么;对口径变化的持续警惕,才能识别数字本身是否可信;以及对”看似正确”保持一种职业性的不安感,让你在别人都在点头的时候还想再问一句”等等,这件事真的这么简单吗?”

回到文章开头那个案例,那个把会议叫停的 PM,她当时未必能说清楚哪里不对。就是有一个感觉——客服那边说工单多了,但数据面板全是绿的,这两件事不应该同时成立。这种对”矛盾信号”的敏感,才是那二十分钟录屏真正的起点。

这不是 AI 能培养的,也不是 AI 能替代的。它建立在对产品、用户、业务的长期积累上,建立在踩过足够多坑之后形成的那种直觉上。

AI 让”读懂数据”越来越廉价,但”质疑数据、重建因果、守住判断权”会越来越贵。

会在恰当的时候叫停一场即将走歪的会议,这件事的价值,比会写 SQL 高得多。

六、数据只能告诉你”发生了什么”,产品经理必须回答”为什么发生”以及”这是不是一件真正的好事”

定量研究的终点,不是一份漂亮的分析报告,不是一组全绿的指标,也不是一个从数字推出来的迭代方向。

真正重要的事只有一件:透过这些数字,搞清楚用户到底经历了什么,业务到底发生了什么,以及接下来这条路要不要继续走。

AI 能帮你更快地看见变化,但它天然看不见变化背后的人——那个困在页面里找不到出口的用户,那个进来看了一眼就关掉的访客,那个安静离开再也没有回来的老用户,那个投诉里没有出现但已经去用竞品的人。这些人,AI 看不见。

回到文章开头那二十份录屏——那个发现真相的人不是 AI。是那个感觉不对劲、强行叫停了会议、把所有人拖去看录屏的 PM。

AI 看得见漏斗,AI 看不见”沉默”。

AI 可以帮你快速扫出数据里的异常,可以生成一份逻辑严密的归因报告,可以在会议室里让所有人信服地点头。

但有一件事,它永远做不了:判断这些数字变好,到底是不是一件真正的好事。

因为这个判断需要知道数字背后的人经历了什么,需要理解业务在这个阶段真正该赌什么,需要对”看起来正确”保持足够的戒心,需要在所有人都在点头的时候,还有人愿意去看二十份录屏。

未来被 AI 替代的产品经理,是那些把自己变成了更快的数据读取器的人。留下来的,是那些知道什么时候该停下来问一句”这是真的吗”的人。

本文由 @苏苏的AI笔记 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益