多轮对话产品避坑指南:从用户意图识别到兜底策略

在多轮对话设计中,大模型和Agent的火爆并未带来预期的用户体验提升,反而暴露出诸多问题。从意图遗忘到死亡连环问,再到黑盒等待和脆弱的兜底策略,这些问题让AI产品沦为用户的噩梦。本文深入剖析四大常见陷阱,并提供实战解法,助你打造真正智能的多轮对话体验。

大模型(LLM)和 Agent 概念彻底火了之后,很多产品经理的第一反应是:

“太好了,不用再写那些像复杂的决策树了,把 Prompt 丢给大模型,它自己就能和用户聊。”

但现实往往是被数据狠狠打脸:用户在多轮对话中的流失率极高。为什么?因为很多产品做出来的不是“智能助理”,而是“智障审讯官”。用户稍微偏离一下预设的话术,或者说两句废话,AI 就开始胡言乱语,甚至彻底忘记上一轮的上下文。

做 AI 产品的核心,在于控场。

今天我们不只谈产品落地,从用户输入第一句话开始,到最终完成任务,多轮对话中到底有哪些坑?怎么避开?

避坑指南一:拒绝“伪多轮”,拯救意图遗忘症

典型的踩坑场景:

很多所谓的“多轮对话”,其实只是把前几轮的聊天记录当成历史文本一股脑塞给大模型。当上下文变长、信息变多时,AI 会出现“注意力涣散”,导致核心参数丢失。

解法:引入对话状态追踪机制

不要过度迷信大模型原生的上下文记忆能力,在做任务型对话时,产品逻辑里必须有一套独立的“记事本”,也就是DST机制。

当用户每说一句话,后台系统不是简单地记录句子,而是去更新一个 JSON 格式的“状态表”。

真实业务案例分享:

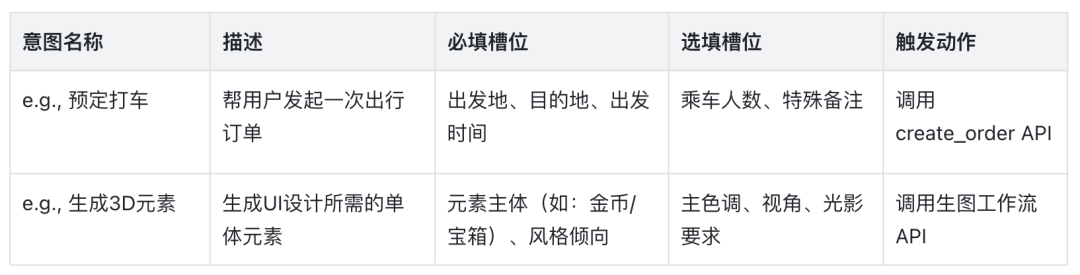

以出行打车出行场景为例。

可复用经验:

在prd中,必须明确定义出当前任务所需的必填槽位和选填槽位。只要必填槽位没满,Agent 就继续通过追问(澄清)来补齐信息;一旦填满,立刻触发最终 Action(比如请求打车 API 或生图 API)。

避坑指南二:不要把用户当犯人审,告别“死亡连环问”

典型的踩坑场景:

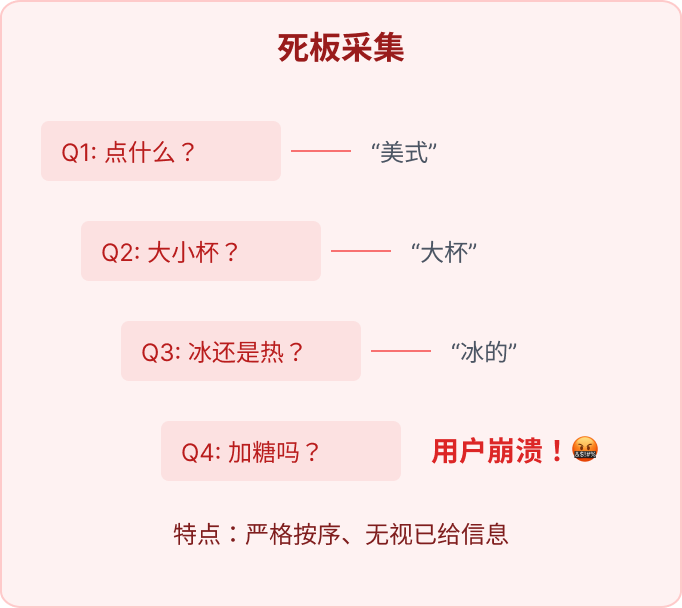

传统机器人的死板之处在于严格按顺序收集条件。现代多轮对话设计的核心体验应该是:兼容用户的随意性。

干货解法:动态多意图抽取与跳跃式引导

1.一次性抽取多槽位:当用户在第一轮输入“我要大杯冰美式不加糖”时,后端的 NLU(自然语言理解)模块必须能一次性把[饮品: 美式], [杯型: 大杯], [温度: 冰], [糖度: 无糖]全部提取出来,直接跳过前面的所有追问,进入支付确认环节。

2.优雅地处理“跑题”:用户在订票中途突然问:“对了,你们这支持微信支付吗?” 此时 Agent 不应该报错,而应该触发一个 QA 意图,回答完毕后,主动把话题拉回来:“支持微信支付的。我们刚才说到您的出发时间,请问您打算几点出发?”

可复用经验:

设计对话流时,引入“主干任务”与“支线打断”的概念。任何时候用户触发了支线,系统在处理完支线后,必须有一个明确的“重定向”策略,引导用户回到未完成的主干槽位填充。

避坑指南三:对付“黑盒等待”,建立系统可见性体验

Agent 经常需要执行耗时操作,比如:调用 API 查询复杂数据、执行长代码、或者调用工作流sop。

典型的踩坑场景:

用户发出指令后,界面出现一个转圈的 Loading 动画。10秒过去了,20秒过去了。用户不知道是网络断了、应用卡死了,还是 AI 正在算。于是疯狂点击刷新,导致任务中断或后端资源严重浪费。

干货解法:状态可见与阶段性反馈(流式与中间态展示)

著名的尼尔森交互十大原则第一条就是“系统状态可见性”。在 AI 产品中,这点至关重要。

真实业务案例分享:

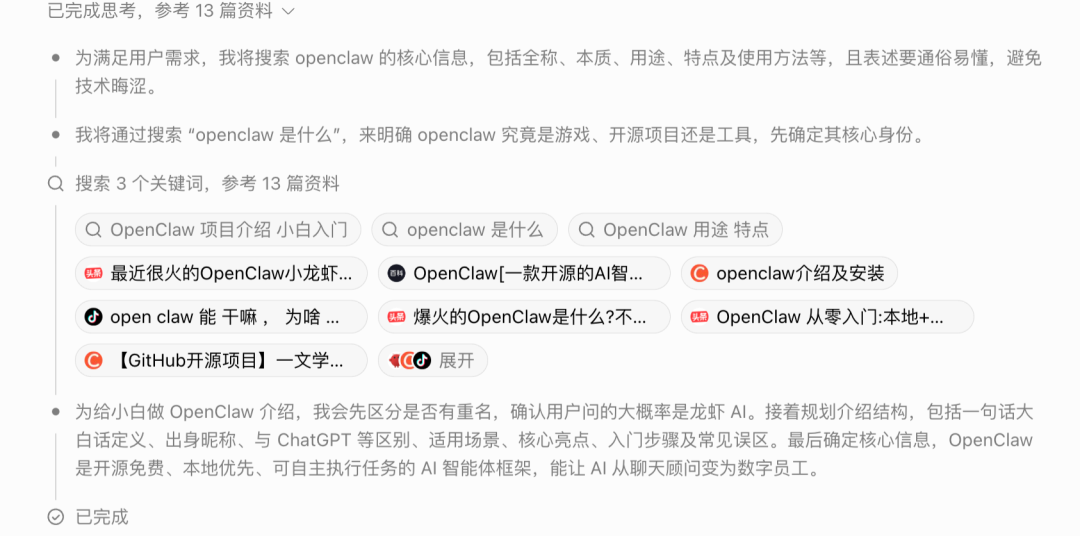

1.ChatGPT/deepseek/豆包等等的处理:使用流式输出,字是一个一个蹦出来的,这极大地缓解了用户的等待焦虑。

2.Midjourney / 复杂工作流 Agent 的处理:

当生成图片或处理复杂任务时,如果无法做文本流式输出,就必须做步骤拆解回显。

- 界面提示1:“已理解您的需求,正在为您提取参数…”

- 界面提示2:“参数提取完成,正在调用渲染引擎(约需15秒)…”

- 界面提示3:“(展示一张带有高斯模糊的低分辨率草图)雏形已生成,正在进行细节精修…”

可复用经验:

如果你的后端 Action 耗时超过 3 秒,PRD 中必须要求开发加上“过程状态反馈”。不要只给一个 Loading 态,要把 AI 正在执行的思考过程或工具调用用通俗的语言展示给用户看。

避坑指南四:脆弱的兜底策略,别只会说“我还在学习中”

再聪明的 AI 也有翻车的时候。当用户的意图超出了系统能力边界,或者系统出现故障时,大部分产品的表现极差——直接抛出一句“对不起,我没听懂您的话,我还在不断学习中。” 这是一句正确的废话,对用户毫无帮助。

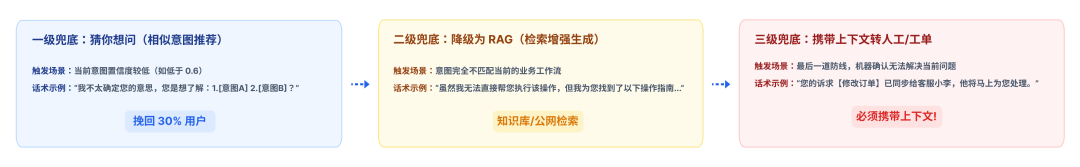

干货解法:渐进式的三级兜底策略

优秀的产品经理会把“异常流”设计得比“正常流”还要精致。

一级兜底:猜你想问(相似意图推荐)

当 AI 计算出用户当前意图的置信度较低(比如低于 0.6)时,不要直接说不知道。

话术示例:“我不太确定您的意思,您是想了解:1. [猜测意图A] 2. [猜测意图B] 3. 还是其他?” 这能挽回至少 30% 的用户。

二级兜底:降级为 RAG(检索增强生成)搜索

如果意图完全不匹配当前的业务工作流,系统应自动降级。去公司的知识库、FAQ 库甚至公网进行检索,然后用大模型润色后输出。

话术示例:“虽然我无法直接帮您执行该操作,但我为您找到了以下相关操作指南…”

三级兜底:携带上下文转人工/工单

这是最后一道防线。核心注意点是:必须携带上下文。

反面教材:转人工后,客服第一句话:“您好,请问有什么可以帮您?”(用户会愤怒:我刚才跟机器人说了五分钟你没看到吗?)

正面设计:“已为您转接人工专家。您的核心诉求【修改订单详情】及【刚才填写的3项信息】已同步给客服小李,他将马上为您处理。”

多轮对话不是让 AI 随便瞎聊,而是在一个无形的漏斗里,用最自然的语言交互,引导用户把填空题做完。少一点“审问感”,多一点“状态追踪”和“可见性反馈”,把异常兜底当成核心体验来做,你的 Agent 就不再是一个玩具,而是一个真正能提效的生产力工具。

希望能为正在设计对话产品的你提供一些实质性的帮助~

本文由 @虫虫 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益