GenAI根本就不懂你!它只是在找“关联”!

生成式AI正以惊人的创造力重塑世界,但它的内核并非真正的理解,而是强大的关联机制。从文字接龙到像素演变,从词向量空间到世界模型,AI系统如何通过统计关联模拟智能?本文深度解析GenAI背后的关联引擎,揭示其如何从海量数据中构建知识网络,以及为何会陷入幻觉陷阱——在这场人类与关联机器的共舞中,我们需要既欣赏其可能性,又清醒认识其边界。

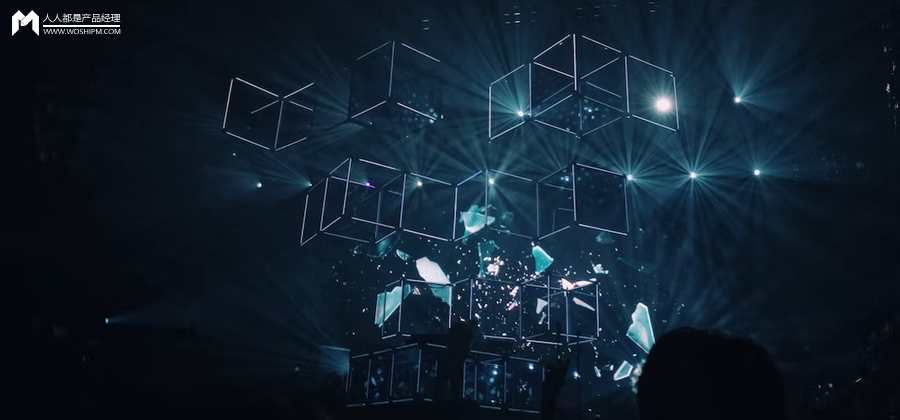

从ChatGPT写诗、Sora生成电影级视频,到Midjourney画出超现实艺术,生成式AI(GenAI)正以一种近乎“魔法”的方式改变人类社会。我们惊叹于它的“聪明”,甚至开始讨论它是否拥有“意识”。

但如果我们掀开那层炫目的魔法布幕,会发现它的内核并非“理解”,而是一个极其简单、却又无比强大的机制:

它不是在思考因果,而是在寻找关联。

一、什么是GenAI?一个“高仿创作者”

生成式AI(Generative AI),顾名思义,是能够根据已有数据“学习模式”,然后“创造新内容”的人工智能系统。

它可以:

- 写小说、编代码、做PPT → 文本生成

- 画插画、设计LOGO、生成3D模型 → 图像生成

- 制作短视频、模拟物理运动 → 视频/世界建模

它的核心工具是大语言模型(如GPT、Claude、Gemini)及其变体(如Stable Diffusion、Sora)。这些模型的基本工作原理,是通过一个庞大的神经网络,在海量数据中进行“深度学习”,最终学会“模仿”和“创造”。

而这种“学习”的本质,正是我们今天要探讨的核心——关联性。

二、智能的本质:关联 ≠ 理解

人类的知识,建立在与真实物理世界的互动之上。我们知道“杯子摔在地上会碎”,是因为我们见过、摸过、经历过这个过程,建立了“撞击→破碎”的因果逻辑。

但大模型不同。它从未“体验”过世界。它的整个“世界观”,都来自冰冷的数据。

它之所以“知道”杯子会碎,不是因为它理解牛顿力学或材料科学,而是因为在数万亿条文本和图片数据中,“杯子”、“掉落”、“撞击”这些词或像素特征,总是与“破碎”、“碎片”这些特征高频率地同时出现。

它不问“为什么”,只关心“什么”和“什么”总在一起。

所以大模型的“智能”,本质上是一种“统计学关联”的拟合能力。

三、五个维度拆解“关联”的运作机制

1.训练目标 —— 基于共现频率的“概率关联”(文字接龙游戏)

大语言模型的核心训练任务,叫“下一个词预测”(Next Token Prediction)。

想象你在玩一场超级复杂的“填字游戏”:

输入:“天空是蓝色的,白云在……”

模型要猜出下一个最可能出现的词——是“飘动”?“翻滚”?还是“燃烧”?

它怎么选?靠的是概率。它在海量语料中统计:“白云在”后面跟着“飘动”的概率是50%,跟着“燃烧”的概率是0.001%。于是,它选择“飘动”。

这就是“文字接龙”的本质——基于词语共现频率的概率关联。模型的所有输出,都是对“最可能序列”的数学计算。

2.核心架构 —— 注意力机制(计算上下文关联度)

这是让大模型真正“聪明”的关键引擎——Transformer架构中的注意力机制(Attention Mechanism)。

传统模型只能按顺序处理文字,而注意力机制能让模型“回看”前面所有词,并判断哪些词对当前预测最重要。

举个例子:

“我昨天去了一家新开的咖啡店,它的拿铁味道很特别,但我更喜欢他们的抹茶。”

当模型预测“他们”的指代对象时,它不会只看前一个词“抹茶”,而是会“回头看”整句话,发现“咖啡店”才是主语,从而正确关联“他们 = 咖啡店”。

注意力机制的本质,就是动态计算“上下文关联度” —— 它告诉模型:“在这个位置,哪个词最相关?” 这种动态关联计算,让模型能处理长距离依赖、复杂句式,甚至多轮对话。

3.知识表征 —— 高维空间中的“几何关联”(词向量)

模型如何“记住”词与词之间的关系?答案是:把词语变成数字向量,放在高维空间里。

在这个空间中:

- 意思相近的词,向量距离近(如“国王”与“王后”,“猫”与“狗”)

- 可以做向量运算:“国王 – 男人 + 女人 ≈ 王后”

这不是巧合,而是模型在海量数据中自动学到的语义几何关联。它把抽象的语言概念,转化成了可以计算的数学坐标。

这就像给语言建了一张“地图”,每个词都有自己的“经纬度”,而词与词之间的关系,就是地图上的“距离”和“方向”。

4.复杂能力的涌现 —— 关联的叠加

如果只有简单的词与词关联,模型最多是个“高级词典”。但它为何能写论文、编代码、做推理?

答案是:关联的叠加产生了“涌现”(Emergence)。

当模型规模达到千亿参数、数据量达到万亿token时,无数个简单的“概率关联”和“几何关联”交织成一个极其复杂的网络。在这个网络中,模型似乎“悟”出了更高层次的模式。

- 写代码 = 学会了函数、变量、语法结构之间的最佳组合关联

- 讲故事 = 掌握了情节、角色、情绪转折之间的叙事关联模式

- 逻辑推理 = 发现了前提、结论、论证链条之间的统计规律

这不是“理解”,而是“模式的极致堆叠”。

5.从语言到世界 —— 关联的终极延伸(VLM & 世界模型)

你以为“关联”只存在于文字中?错。当前最前沿的视觉语言模型(VLM)和世界模型,都在用同样的逻辑建模世界。

视觉语言模型(VLM):像素与文字的跨模态关联

比如Midjourney或Sora:

输入:“一只猫坐在月球上”

模型并不理解“月球没有空气”或“猫不可能在那里”,而是分别学习了:

- “猫”对应的像素分布

- “月球”对应的纹理和颜色

- “坐”这个动作的空间构图模式

最终,它生成一个在像素层面满足这三个“高概率关联”的图像

Sora更进一步,它学习的是时间维度上的像素关联——海浪拍打沙滩时,下一帧像素应该如何变化?它构建的是一个“像素物理”,但这物理不是牛顿定律,而是从千万小时视频中学来的“像素演变概率”。

世界模型(World Models):行为与结果的动态关联

世界模型的目标是模拟环境,预测未来。

它学习的是:

当前状态 + 行为 → 下一状态

例如自动驾驶模拟器:

- [状态:前方红灯] + [行为:踩油门] → [结果:碰撞]

- [状态:前方红灯] + [行为:踩刹车] → [结果:安全停下]

它不理解“闯红灯危险”,而是通过海量数据学习到“闯红灯”这个行为与“碰撞”这个结果高度相关。

综上所述,所有这些模型,无论语言、图像还是行为决策,本质都是在构建一个大规模、多模态、时空动态的“关联网络”。

四、致命局限:关联 ≠ 因果(幻觉的根源)

这是所有“关联模型”的阿喀琉斯之踵。

统计学铁律:关联不等于因果。

夏天冰淇淋销量上升,溺水人数也上升 → 两者高度相关,但无因果。 模型不知道“天气炎热”才是共同原因。

模型的困境:

- 如果数据中“爱因斯坦”常与“诺贝尔奖”一起出现,即使他没得过,模型也可能“编造”他获奖的事实。

- Sora可能会生成“马在天上飞”的视频,因为“马”和“飞”在某些奇幻作品中有关联。

- 世界模型可能推荐“踩油门冲过红灯”,因为某个罕见数据集中“成功避险”被误标为“正确行为”。

它没有“事实”概念,只有“数据关联”;没有“物理定律”,只有“像素演变模式”。

这就是“幻觉”(Hallucination)的根本来源——它不是在撒谎,而是在“合理地猜测”。

结语:与“关联机器”共舞的智慧

理解GenAI的本质是“关联”,是我们与这项颠覆性技术共存的关键。

它既不是一个无所不知的神,也不是一个拥有自我意识的“人”。它是一个功能强大、但有其固有局限的“超级模式关联器”。

我们应该做的:

- 善用其长:让它成为写作助手、设计灵感、代码补全、知识检索的超级工具。

- 警惕其短:永远不要让它做需要100%准确、因果严谨或伦理判断的任务。

- 保持清醒:它的“智能”是统计的胜利,而非理解的曙光。真正的“理解”,仍属于人类。

未来的AI,将是“关联”与“因果”的融合体。而今天的我们,必须先看清“关联”的边界,才能在它的光芒下,不迷失方向。

本文由 @古元 原创发布于人人都是产品经理。未经作者许可,禁止转载

题图来自Unsplash,基于CC0协议

- 目前还没评论,等你发挥!

起点课堂会员权益

起点课堂会员权益